Machine learning e sua subcategoria, deep learning, exigem uma quantidade substancial de poder computacional que só pode ser fornecido por GPU. No entanto, nem todo GPU serve, então aqui estão os melhores GPU para machine learning, por que são necessários e como você pode escolher o certo para seu projeto.

Por Que Preciso de um GPU para Machine Learning?

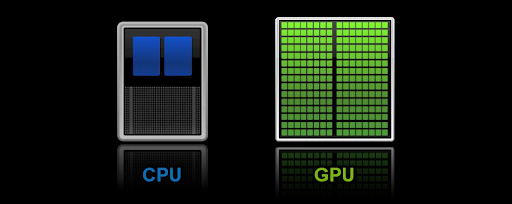

Como mencionado antes, machine learning exige muito poder que apenas GPU podem fornecer. Enquanto CPU funcionam bem para aplicações em menor escala, qualquer coisa mais pesada que tarefas single-threaded ou computação geral causará frustração e gargalos. A diferença significativa em poder computacional vem da capacidade de processamento paralelo do GPU e da grande diferença no número de núcleos. Um CPU típico pode ter 4 a 16 núcleos, enquanto os melhores GPU para machine learning podem ter milhares de núcleos, especialmente tensor cores, cada um capaz de lidar com uma pequena parte da computação ao mesmo tempo.

Esse processamento paralelo é a chave para lidar com cálculos de álgebra linear e matricial muito melhor do que CPU, por isso GPU são muito melhores para tarefas como treinar grandes modelos de machine learning. No entanto, escolher os melhores GPU para machine learning não é fácil.

Como Escolher o Melhor GPU para IA e Deep Learning

Agora, a maioria dos GPU é poderosa o suficiente para lidar com tarefas típicas. No entanto, machine learning e deep learning exigem outro nível de poder e qualidade. Então, a questão que permanece é: o que torna um bom GPU para deep learning?

Um bom GPU para deep learning deve ter as seguintes qualidades e características:

Cuda Cores, Tensor Cores e Compatibilidade

AMD e Nvidia oferecem os melhores GPU para machine learning e deep learning, sendo o segundo significativamente superior. Isso se deve aos Tensor cores e CUDA cores do Nvidia. Tensor cores lidam com cálculos comuns em IA e machine learning, como multiplicações matriciais e convoluções (usadas em redes neurais profundas). CUDA cores, por outro lado, permitem que os melhores GPU para treinamento de IA realizem processamento paralelo distribuindo eficientemente operações por todo o GPU. GPU sem esses dois geralmente têm dificuldades com cargas de work de ML e deep learning.

Dito isto, as recentes atualizações do AMD na plataforma ROCm e aceleradores MI-series melhoraram seus GPU, e você os verá em nossa lista. No entanto, GPU do Nvidia ainda são os melhores para deep learning devido ao ecossistema de software bem otimizado e suporte amplo a frameworks (como TensorFlow, PyTorch, JAX). Os melhores GPU para machine learning devem ter alta compatibilidade com esses frameworks de ML, pois uma incompatibilidade pode levar a ineficiências na aceleração, suporte de driver e bibliotecas (como cuDNN e TensorRT do NVIDIA) e escalabilidade geral à prova de futuro.

Você também pode não ter acesso completo às ferramentas fornecidas pelo toolkit NVIDIA CUDA, como bibliotecas aceleradas por GPU, compilador e runtime C e C++, além de ferramentas de otimização e debug.

VRAM (Video RAM), Padrão de Memória e Largura de Banda de Memória

Como em qualquer coisa relacionada a computadores, GPU é importante, e o mesmo vale para as melhores GPUs para machine learning e deep learning. Como os datasets para treinar modelos de machine learning podem ficar extremamente grandes (até múltiplos TBs para deep learning), as melhores GPUs para machine learning devem ter bastante memória RAM para acesso rápido. Isso ocorre porque modelos de deep learning precisam de memória significativa para armazenar pesos, ativações e outros dados intermediários durante o treinamento e inferência. A melhor GPU para treinamento de IA também deve ter uma largura de banda de memória decente para que você possa trabalhar com esses grandes datasets e acelerar as computações.

Por fim, o padrão de memória é um fator importante ao escolher as melhores GPUs para deep learning. As GPUs usam tipicamente GDDR (Graphics Double Data Rate) ou HBM (High Bandwidth Memory). Enquanto memórias GDDR oferecem alta largura de banda para coisas como machine learning e games, as melhores GPUs para machine learning usam HBMs que têm muito mais largura de banda com melhor eficiência.

| Tipo de GPU | Capacidade de VRAM | Largura de Banda de Memória | Memória Padrão | Melhor para |

| Nível básico (p.ex., RTX 3060, RTX 4060) | 8GB – 12GB | ~200-300 GB/s | GDDR6 | Modelos pequenos, classificação de imagens, projetos pessoais |

| Gama média (p.ex., RTX 3090, RTX 4090) | 24GB | ~1.000 GB/s | GDDR6X | Grandes datasets, redes neurais profundas, transformers |

| GPUs IA de alta performance (p.ex., H100, H200, A100, MI300X) | 40GB – 80GB | ~1.600+ GB/s | HBM2 | Modelos de linguagem grande (LLMs), pesquisa em IA, ML em nível enterprise |

| GPUs ultra de alta performance (p.ex., H100, A100, MI300X Instinct) | 80GB – 256GB | ~2.000+ GB/s | HBM3 | Treinamento de IA em larga escala, supercomputação, pesquisa com datasets massivos |

Para quem trabalha especificamente com grandes modelos de linguagem como o ChatGPT, Cloudzy oferece um GPU otimizada para ChatGPT solução com o poder necessário para fine-tuning e inferência tranquilos.

TFLOPS (Teraflops) e Precisão de Ponto Flutuante

Naturalmente, a performance da GPU é medida por seu poder de processamento. Isso depende de três fatores: TFLOPS, Largura de Banda de Memória e Precisão de Ponto Flutuante. Já discutimos largura de banda de memória nas melhores GPUs para treinamento de IA; aqui está o que cada um dos outros dois significa e por que é importante. TFLOPS, ou Teraflops, é a unidade que mede a velocidade com que uma GPU lida com cálculos complexos. Assim, em vez de medir a velocidade de clock do processador (quantos ciclos um processador completa por segundo), TFLOPS mede quantas trilhões de operações de ponto flutuante uma GPU pode executar por segundo. Simplificando, TFLOPS diz o quão poderosa uma GPU é ao lidar com tarefas que exigem muita matemática.

Porém, Precisão de Ponto Flutuante, como o nome sugere, mostra o nível de precisão que a GPU permitirá o modelo manter. As melhores GPUs para deep learning usam precisão mais alta (p.ex., FP32), que oferece cálculos mais precisos mas com custo de performance. Precisão mais baixa (p.ex., FP16) acelera o processamento com precisão ligeiramente reduzida, o que muitas vezes é aceitável para tarefas de IA e deep learning.

Começar um Blog

Começar um Blog

Auto-hospede seu WordPress em hardware de primeira linha, com armazenamento NVMe e latência mínima em todo o mundo. Escolha sua distribuição favorita.

Obtenha WordPress VPS| Precisão | Caso de Uso | Aplicações de Exemplo |

| FP32 (Precisão Simples) | Treinamento de modelo de deep learning | Reconhecimento de imagem (ResNet, VGG) |

| TF32 (TensorFloat-32) | Treinamento com precisão mista | NLP, sistemas de recomendação |

| FP16 (Meia Precisão) | Inferência rápida | Direção autônoma, reconhecimento de fala, aprimoramento de vídeo com IA |

Em vez de investir pesadamente em hardware físico, você pode acessar instantaneamente as GPUs de Deep Learning da Cloudzy, com tecnologia RTX 4090, otimizadas para workloads de machine learning e deep learning.

Melhores GPU para Machine Learning em 2025

Agora que você sabe o que as melhores GPUs para machine learning devem ter, veja nossa lista das melhores GPUs classificadas por desempenho, largura de banda de memória, throughput, etc.

| GPU | VRAM | Largura de Banda de Memória | Memória Padrão | TFLOPS | Precisão de Ponto Flutuante | Compatibilidade |

| NVIDIA H100 NVL | 188 GB | 7.8 TB/s | HBM3 | 3,958 | FP64, FP32, FP16 | CUDA, TensorFlow |

| NVIDIA H100 Tensor Core | 80 GB | 2 TB/s | HBM2 | 1,979 | FP64, FP32, FP16 | CUDA, cuDNN, TensorRT |

| NVIDIA RTX 4090 | 24 GB | 1.008 TB/s | GDDR6X | 82.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA L40 Tensor Core | 48 GB | 768 GB/s | GDDR6 | 40 | FP64, FP32, FP16 | CUDA, cuDNN, TensorRT |

| NVIDIA GeForce RTX 4070 | 12 GB | 504 GB/s | GDDR6X | 35.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX 3090 Ti | 24 GB | 1.008 TB/s | GDDR6X | 40 | FP64, FP32, FP16 | CUDA, cuDNN, TensorRT |

| AMD Radeon Instinct MI300 | 128 GB | 1.6 TB/s | HBM3 | 60 | FP64, FP32, FP16 | ROCm, TensorFlow |

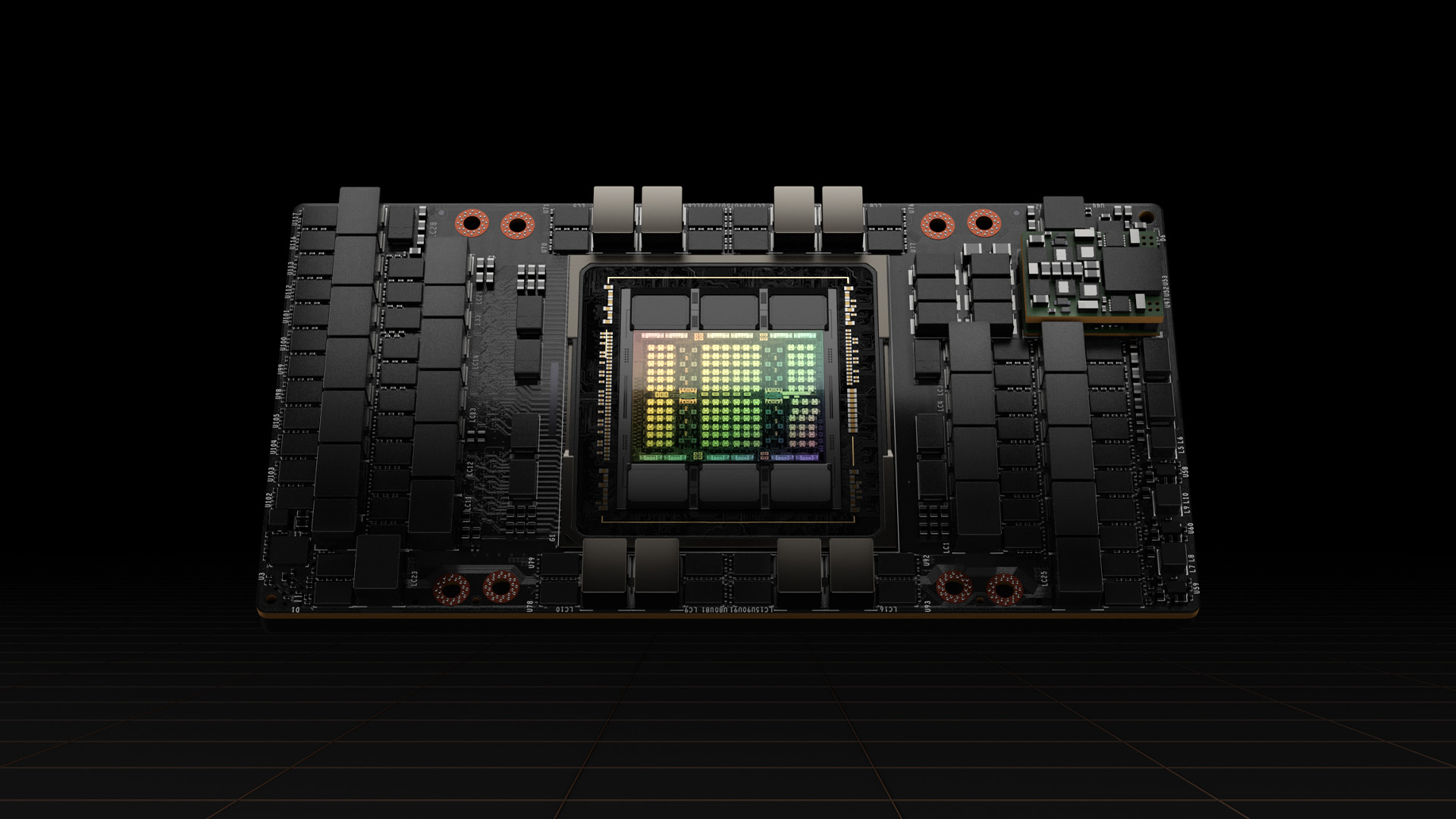

NVIDIA H100 NVL

A melhor GPU para machine learning, a H100 NVL, oferece desempenho excepcional para deep learning em larga escala, otimizada para workloads multi-tenant e de alto desempenho.

- Melhor Para: Pesquisa de IA avançada, treinamento de modelos em larga escala e inferência.

- Desvantagem: Extremamente cara, indicada principalmente para ambientes empresariais ou de pesquisa.

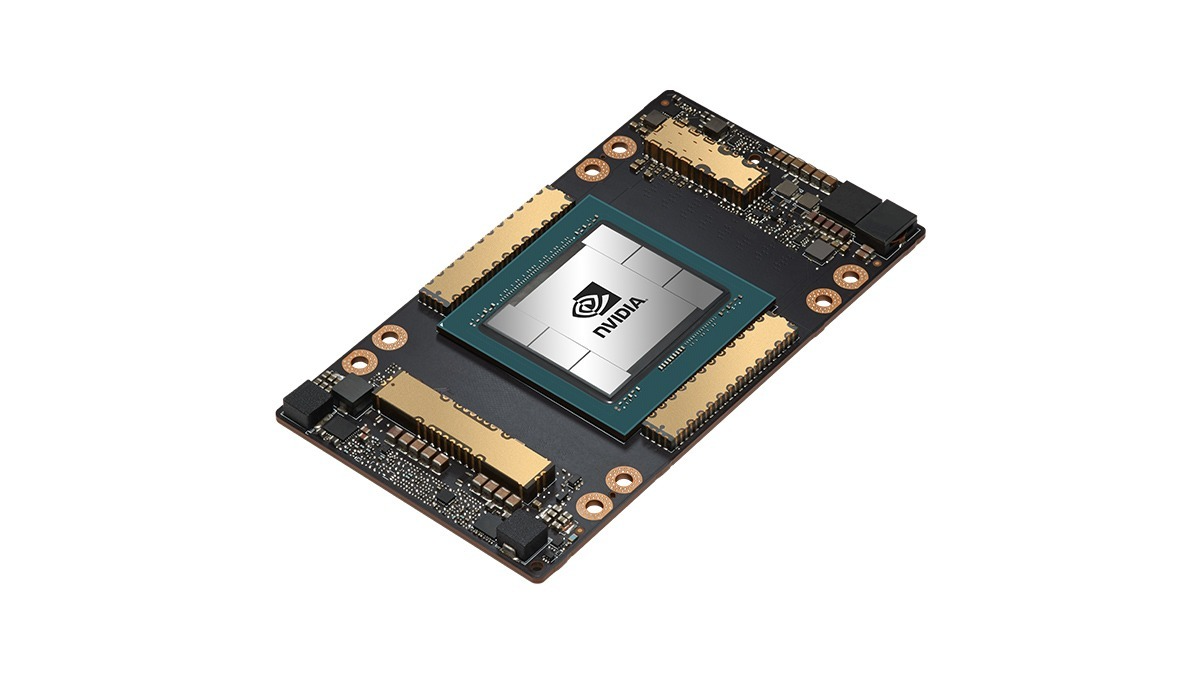

NVIDIA A100 GPU com Núcleos Tensor

A H100 oferece desempenho massivo para redes neurais com 80 GB de memória de alta largura de banda (HBM2), adequada para workloads exigentes.

- Melhor Para: Modelos de machine learning em larga escala, pesquisa de IA e aplicações em nuvem.

- Desvantagem: Cara, voltada principalmente para empresas.

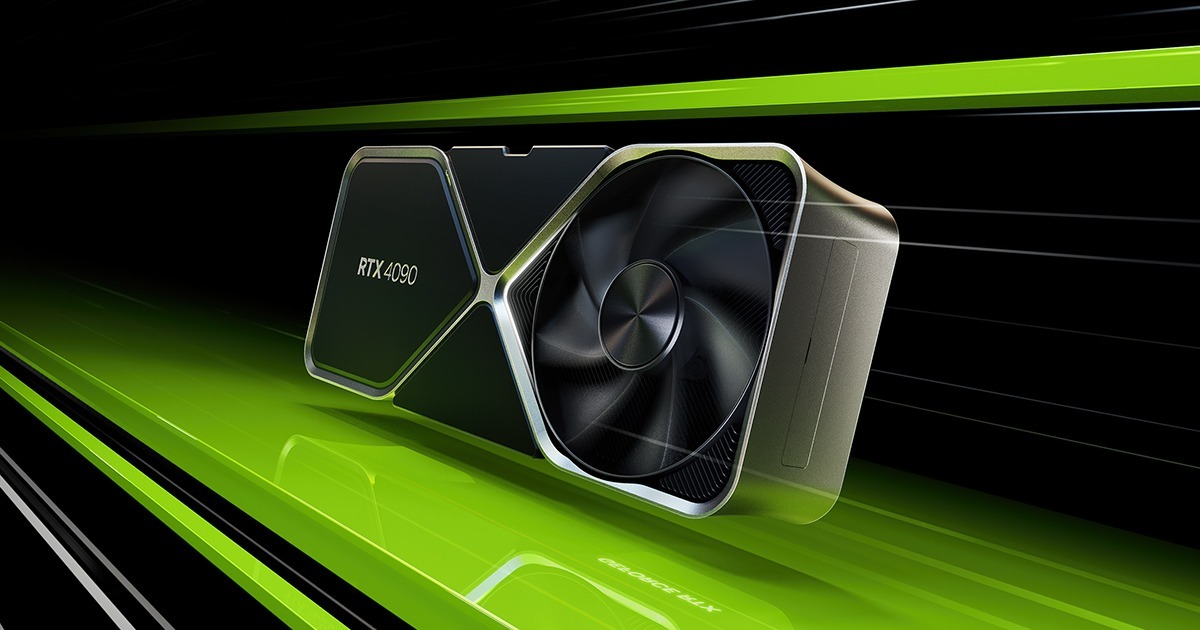

NVIDIA RTX 4090

Excelente tanto para jogos quanto para workloads de IA, com 24 GB de memória GDDR6X e enorme capacidade de computação paralela.

- Melhor Para: Tarefas ML de alto desempenho e pesquisa de IA que exigem poder computacional extremo.

- Desvantagem: Consome muita energia, custo elevado e tamanho grande.

NVIDIA RTX A6000 Núcleo Tensor GPU

Suporta aplicações de IA com 48 GB de memória GDDR6, bem adaptada para workstations e profissionais de criação.

- Melhor Para: Pesquisa de IA, deep learning e workloads de alto desempenho.

- Desvantagem: Custo elevado, geralmente indicada para ambientes profissionais.

NVIDIA GeForce RTX 4070

Bom equilíbrio entre preço e desempenho com fortes capacidades de ray-tracing, com 12 GB de GDDR6X

- Melhor Para: Entusiastas e pequenas empresas com necessidades médias de machine learning.

- Desvantagem: Throughput limitado para datasets maiores e modelos muito grandes.

NVIDIA RTX 3090 Ti

NVIDIA RTX 3090 Ti. Memória grande (24 GB GDDR6X) e poder computacional robusto, ideal para treinar modelos médios a grandes.

- Melhor Para: Entusiastas e aplicações de pesquisa que precisam de processamento AI potente.

- Desvantagem: Muito cara, consome muita energia e pode ser excessiva para projetos menores.

AMD Radeon Instinct MI300

Ótima para cargas de trabalho AI e HPC, com desempenho competitivo.

- Melhor Para: Cargas de trabalho de aprendizado de máquina em configurações centradas em AMD.

- Desvantagem: Menos consolidada em deep learning em comparação com NVIDIA, menos frameworks suportados.

Cloud GPU VPS do Cloudzy

Uma das melhores GPU para aprendizado de máquina disponíveis hoje é, sem dúvida, a RTX 4090. Mas é cara, vai aumentar sua conta de energia e seu tamanho pode forçá-lo a atualizar para um gabinete maior ou modificar suas peças. É uma dor de cabeça. Por isso, aqui na Cloudzy, oferecemos GPU online para aprendizado de máquina para que você não tenha que se preocupar com nada disso. Nosso GPU VPS vem equipado com até 2 RTX 4090 GPU, armazenamento NVMe SSD de 4 TB, largura de banda de 25 TB por segundo e 48 vCPU.

Tudo com preços acessíveis, com cobrança flexível por hora ou mês, além de várias opções de pagamento como PayPal, Alipay, Cartões de Crédito (via Stripe), PerfectMoney, Bitcoin e outras Criptomoedas.

Por último, na pior das hipóteses, se não estiver satisfeito com nosso serviço, oferecemos garantia de reembolso de 14 dias.

Plataformas de Realidade Aumentada (AR) dependem muito de GPU de alto desempenho para oferecer experiências imersivas em tempo real. Assim como GPU com núcleos CUDA e Tensor são críticos para treinar modelos de deep learning, são igualmente vitais para renderizar ambientes AR complexos e suportar recursos orientados por IA como reconhecimento de objetos e mapeamento espacial. Na Cloudzy, nosso AR Cloud usa tecnologia GPU avançada para garantir desempenho confiável, baixa latência e escalabilidade, tornando-o ideal para empresas que desejam implementar aplicações AR em larga escala.

Quer você esteja desenvolvendo aplicações AI, treinando modelos ou realizando pesquisas, nossos Soluções AI VPS são projetados para oferecer o melhor desempenho em GPU por uma fração do custo usual.

Pensamentos Finais

Com a crescente demanda de poder computacional e modelos de IA cada vez maiores e mais complexos, GPU certamente será parte integral de nossas vidas. Por isso, vale a pena estudar sobre eles e entender como funcionam.

É por isso que recomendo fortemente que você confira Tim Dettmerso artigo sobre tudo que você precisa saber sobre GPU e conselhos práticos ao escolher uma GPU. Ele tem formação acadêmica sólida e domina deep learning.