إذا كنت تتخذ قراراً H100 مقابل RTX 4090 للذكاء الاصطناعي، تذكّر أن معظم «الاختبارات المعيارية» لا تعني شيئاً حتى تتسع VRAM فعلياً لنموذجك وذاكرة التخزين المؤقت. RTX 4090 هو الخيار الأمثل لأعمال بطاقة GPU واحدة التي لا تتجاوز 24 GB.

H100 هو ما تلجأ إليه حين تحتاج إلى نماذج أكبر، أو معالجة متزامنة أعلى، أو عزل متعدد المستخدمين، أو وقت أقل في التعامل مع قيود الذاكرة.

سأحلّل الأمر وفق أنواع أعباء العمل، وأستعرض أنواع الاختبارات المعيارية، ثم أقدّم لك خطة اختبار سريعة يمكنك تشغيلها على بنيتك الخاصة.

إجابة سريعة: H100 مقابل RTX 4090 لأعباء عمل الذكاء الاصطناعي

H100 الأفضل لتدريب النماذج الكبيرة والاستنتاج الجاد، بفضل مجمعات HBM الكبيرة، وعرض نطاق ترددي عالٍ جداً للذاكرة، ودعم NVLink وMIG للعزل. RTX 4090 الأنسب حين تريد سرعة عالية بسعر أفضل على بطاقة GPU واحدة، طالما يتسع عبء عملك في 24 GB دون تنازلات متكررة. المواصفات وميزات المنصة تجعل هذا الاختيار واضحاً.

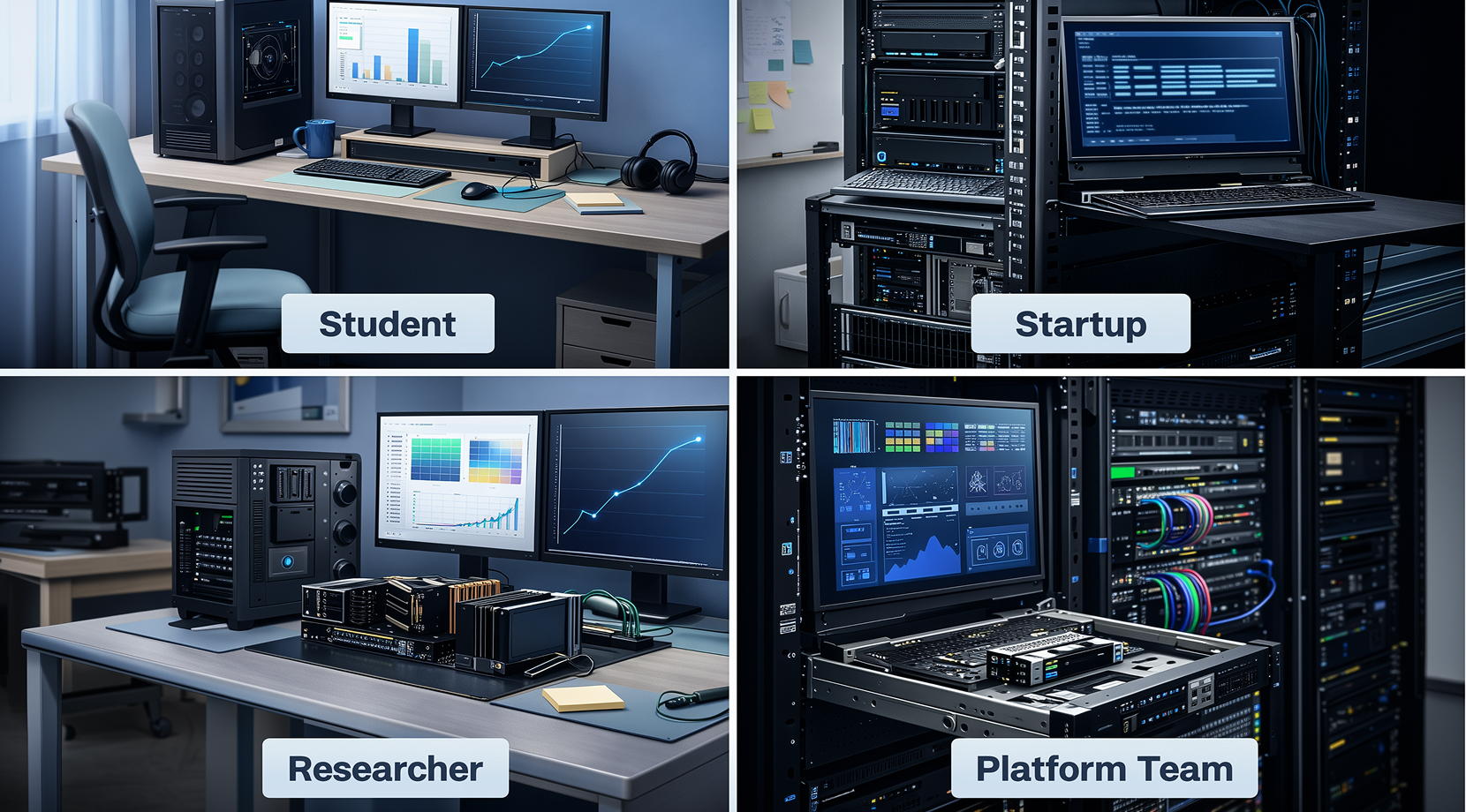

إليك قائمة الاختيار السريع حسب الملف الشخصي:

- مطوّر LLM محلي (مطوّر منفرد / طالب): RTX 4090 حتى تصبح VRAM هي عنق الزجاجة.

- مهندس ML في شركة ناشئة (يطلق MVP): RTX 4090 للاستنتاج والضبط الدقيق في المراحل الأولى، ثم H100 حين تحتاج إلى تزامن مستقر أو نماذج أكبر.

- باحث تطبيقي (تجارب متكررة): H100 إذا كنت تصطدم باستمرار بأخطاء نفاد الذاكرة، أو حدود حجم الدُفعات، أو السياقات الطويلة.

- فريق الإنتاج / المنصة (استنتاج متعدد المستأجرين): H100 لتقسيم MIG، وهامش موارد أعلى، وتوسّع أكثر سلاسة.

انطلاقاً من هذا الإطار، يتناول بقية المقال الحدود التي يصطدم بها المستخدمون في الواقع العملي، وكيف تتوافق أرقام المعايير المرجعية معها.

السؤال الوحيد الذي يستحق الإجابة: ماذا يمكن أن يَسَعَ VRAM؟

معظم النقاشات حول H100 مقابل RTX 4090 هي في جوهرها نقاشات تتعلق بـ VRAM. في عمل LLM، تستهلك VRAM كلٌّ من الأوزان, التنشيطات أثناء التدريب، وحالات المُحسِّن في التدريب، وكذلك ذاكرة التخزين المؤقت KV أثناء الاستدلال. هذا الأخير هو ما لا يتوقعه كثيرون، إذ يتمدد مع طول السياق وعدد الطلبات المتزامنة.

الجدول التالي تقريبي متعمَّد، لأن الاستيعاب الفعلي يتوقف على الإطار البرمجي ودقة الحسابات وعوامل الحِمل الإضافي.

إليك نظرة سريعة على سؤال: هل يعمل دون مشاكل؟

| حمل العمل | الواقع المعتاد لبطاقة RTX 4090 (24 GB) فردية | الواقع المعتاد لبطاقة H100 (80–94 GB) فردية |

| استدلال نموذج LLM بحجم 7B (FP16 / BF16) | جيدة في الغالب | هامش مريح |

| استدلال نموذج LLM بحجم 13B | ضيق في الغالب، يتوقف على السياق | جيدة في الغالب |

| استدلال النماذج بحجم 70B | يتطلب تكميماً مكثفاً أو تفريغاً للذاكرة | أكثر واقعية بكثير |

| استدلال SD/SDXL مع دُفعة صغيرة | جيدة في الغالب | يعمل جيداً مع هامش أوسع للدُّفعات |

| التشغيل مع تزامن عالٍ للطلبات | ضغط KV cache يظهر بسرعة | مساحة أكبر، أداء أكثر استقراراً تحت الضغط |

إذا كنت تريد قائمة مقارنة أوسع لـ GPU (لا تقتصر على هذين الخيارين)، فإن مرجعنا الشامل لـ أفضل بطاقات الرسومات للتعلم الآلي في 2025 يوفر جدولاً مرجعياً لـ VRAM وعرض نطاق الذاكرة عبر GPUs الشائعة في مجال AI.

بمجرد التحقق من أن حجم العمل يناسبك، يصبح عرض نطاق الذاكرة هو العامل التالي الذي يحدد مدى سلاسة الأداء.

عرض النطاق: لماذا يبدو HBM مختلفاً

كثير من النقاشات حول أداء AI تتمحور حول ذُرى الحوسبة، لكن نماذج المحولات (Transformers) شديدة الحساسية لحركة البيانات في الذاكرة. ميزة H100 أنه يجمع بين مجموعات HBM كبيرة وعرض نطاق ذاكرة مرتفع جداً، إضافةً إلى عرض نطاق NVLink وتقسيم MIG على مستوى المنصة.

نظرة سريعة على المواصفات

المواصفات لن تختار GPU المناسبة نيابةً عنك، لكنها تفسر لماذا يبدو نفس حجم العمل سهلاً على بطاقة وضيقاً على أخرى. تُبرز هذه النظرة السريعة أبرز العوامل المؤثرة في تدريب LLM والاستدلال وسلوك التقديم.

| المواصفة | H100 (SXM / NVL) | RTX 4090 |

| VRAM | 80 GB / 94 GB | 24 GB |

| عرض نطاق الذاكرة | 3.35–3.9 تيرابايت/ثانية | GDDR6X (مقيّد بالسعة عند 24 GB) |

| الاتصال البيني | NVLink + PCIe Gen5 | PCIe (منصة المستهلك) |

| تعدد الأنظمة | حتى 7 أنظمة MIG | غير متاح |

مراجع المواصفات: NVIDIA H100, NVIDIA RTX 4090.

ما يعنيه هذا عملياً:

- إذا كنت تسعى إلى رفع حجم الدفعة أو طول السياق، فإن H100 يحافظ على الاستقرار لفترة أطول قبل أن تُضطر إلى المقايضات.

- إذا كنت تخدم طلبات متعددة في آنٍ واحد، فإن H100 يوفر هامش ذاكرة أوسع، مما يؤخر ظهور تأخيرات الذيل غير المنتظمة.

- إذا كان عملك في الغالب مستخدماً واحداً ونموذجاً واحداً وسياقاً محدوداً، فإن الـ 4090 يمنحك في الغالب أداءً سريعاً ومُرضياً.

عرض النطاق لا يُغني عن الاختبار الدقيق للأداء. لكنه يفسر لماذا قد تبدو GPUs متقاربة في اختبار محدود، ثم تتباعد نتائجها تحت الضغط الحقيقي.

معايير أداء موثوقة: H100 مقابل RTX 4090

ليست معايير الأداء كلها على مستوى واحد، وهذا هو السبب في أن عبارة «أرقامي لا تتطابق مع أرقامك» تتكرر باستمرار. في حالة H100 مقابل RTX 4090، من المفيد تقسيم معايير الأداء إلى مسارين:

- المسار أ (النتائج المجتمعية): llama.cpp-style tokens/sec tests and simple inference scripts.

- المسار ب (الاختبارات الموحدة): نتائج على غرار MLPerf Training و MLPerf Inference، تركز على قواعد قابلة للتكرار.

لقطة استدلال على غرار Llama.cpp

هذا هو النوع من الاختبارات الذي يجريه الناس في المنزل ثم يتجادلون حوله لأيام. وهو مفيد لأنه يعكس سلسلة أدوات حقيقية يستخدمها كثير من المطورين، لكن من السهل تفسيره بشكل خاطئ إذا أغفلت الملاءمة والدقة.

المقارنات العامة على غرار llama.cpp تُظهر أداءً جيداً جداً لـ RTX 4090 على النماذج الصغيرة والتشغيلات المضغوطة (quantized)، بينما تتجاوز النماذج الكبيرة بدقة عالية سقف VRAM.

إليك النمط الذي يجب أن تتوقعه:

| النموذج | GPU | النتيجة المعتادة |

| فئة 7B | RTX 4090 | معدل رموز/ثانية مرتفع، واستدلال سلس لمستخدم واحد |

| فئة 13B | RTX 4090 | أداء جيد، لكن حجم السياق والعبء الإضافي يبدآن في التأثير |

| فئة 70B | RTX 4090 | لا يناسب الذاكرة بشكل مباشر دون ضغط أو إزاحة حادة |

| فئة 70B | H100 | أكثر واقعية للاحتفاظ بالنموذج في الذاكرة وتقديم الخدمة باستقرار |

النقطة من هذا الجدول ليست «RTX 4090 سيئ» أو «H100 سحري». بل إن سقف VRAM هو الذي يحدد ما يمكنك الاحتفاظ به في الذاكرة، وهذا ينعكس على السرعة والاستقرار وحجم الضبط الذي ستضطر إلى إجرائه.

إذا كنت تقلص طول السياق باستمرار لمجرد الاستمرار في العمل، فهذه هي اللحظة التي تتوقف فيها هذه المقارنة عن كونها نظرية.

ما الذي يضيفه MLPerf ولا تضيفه معايير المنتديات

وُجد MLPerf لأن «سكريبتات عشوائية وتخمينات» لا تصلح حين تقف أمام قرار بتكلفة تبلغ آلاف الدولارات. وقد أضاف MLCommons أحمال عمل ذكاء اصطناعي توليدي حديثة بمرور الوقت، وقد صُمِّم MLPerf ليجعل النتائج قابلة للمقارنة بين الأنظمة المختلفة.

على صعيد التدريب، تقرير NVIDIA حول MLPerf Training v5.1 مثال جيد على كيفية إفصاح الموردين عن وقت التدريب، مع تفاصيل حول بيئة التقديم وقواعد المعيار المتبعة.

هذا المعيار لن يخبرك كيف تتصرف طلباتك الخاصة، لكنه اختبار سلامة على مستوى النظام، ومؤشر على أداء هذه الفئة من الأجهزة وفق قواعد محددة.

لننتقل الآن إلى الجانب الأكثر تأثيراً في قرارات الشراء: الوقت والمال اللازمان لإنجاز العمل فعلياً.

التكلفة والوقت وتكلفة الفرصة البديلة

كثير من H100 مقابل RTX 4090 كثيراً ما تُصاغ القرارات على أنها "سعر الشراء مقابل سعر الإيجار"، وهذا نادراً ما يكون الإطار الصحيح. الإطار الأدق هو: كم من الساعات تحتاج لبناء نموذج قابل للاستخدام فعلاً، وكم من الوقت تهدره في مواجهة القيود؟

ثلاثة سيناريوهات شائعة توضح هذه المقايضات بجلاء.

الضبط الدقيق الأسبوعي على النماذج الصغيرة والمتوسطة

إذا كانت عمليات التشغيل لديك تبقى ضمن 24 GB دون تنازلات متكررة، فإن مسار 4090 يبدو خياراً ممتازاً. تكرر التجربة بسرعة، ولا تحتاج إلى جدولة وقت على كلستر، وإعدادك بسيط. أما إذا تحول كل تشغيل إلى "خفِّض الدفعة، اقطع السياق، أعد المحاولة"، فإن H100 فكرة أكثر منطقية، على الرغم من تكلفتها الأعلى.

الخدمة مع تزامن حقيقي

التزامن يرفع الضغط على ذاكرة KV cache بسرعة. هنا تُؤتي مساحة H100 الإضافية وأدوات التحكم في المنصة ثمارها، خاصة إذا كنت تحتاج إلى زمن استجابة منتظم.

إذا كنت لا تزال تفكر في ما إذا كان خادم GPU هو الشكل والملاءمة الصحيحة لعملية نشرك، فإن GPU VPS مقابل CPU VPS طريقة مفيدة لمطابقة حجم العمل مع نوع البنية التحتية قبل أن تقضي وقتك في تحسين الشيء الخطأ.

مهام التدريب الكبيرة ذات المواعيد النهائية

فور أن تتجاوز نطاق شخص واحد وجهاز واحد، تصبح الأمور الأساسية هي ما تريد التركيز عليه: بيئات مستقرة، وأقل من أوجه الفشل، ووقت أقل يُهدر فيما هو في جوهره مراقبة دائمة. هذا بالضبط ما صُمِّم H100 من أجله.

إذا كنت لا تزال مترددا بعد هذا القسم، فالخطوة التالية ليست مزيداً من القراءة. بل هي النظر في كيفية تصرف مجموعة أدواتك عملياً، بما في ذلك احتكاك التعريفات وأعباء العمل متعددة المستخدمين.

البرمجيات والعمليات: التعريفات والاستقرار وتعدد المستخدمين والدعم

هذا هو الجانب الذي تتجاهله معظم مخططات المعايير، لكنه يمثل جزءاً كبيراً من الواقع اليومي.

RTX 4090 شائعة لأنها في متناول اليد وسريعة لكثير من سير عمل الذكاء الاصطناعي. المقايضة هي أنه حين يكبر استخدامك، ستصطدم بحدود تتعلق بسقف الذاكرة وأنماط التوسع غير المصممة للبيئات المشتركة متعددة المستأجرين.

H100 مصممة للكلسترات. ميزة MIG مهمة جداً لفرق المنصات لأنها تتيح تقسيم GPU واحد إلى شرائح معزولة، مما يقلل مشكلات "الجار المزعج" ويجعل تخطيط السعة أسهل بكثير. تسرد مواصفات H100 الرسمية من NVIDIA ما يصل إلى ٧ نسخ MIG حسب شكل الجهاز.

إذا كان حجم عملك شخصياً ومحلياً، يمكنك العيش بارتياح على جانب 4090 لفترة طويلة. أما إذا كان حجم عملك يخدم مستخدمين متعددين ويواجه العملاء، فإن H100 هي الخيار الأكثر أماناً.

إذن، بشكل عام، من يجب أن يختار ماذا؟

أيهما تختار لعبء عملك

لـ H100 مقابل RTX 4090، الخيار الصحيح في نهاية المطاف هو ما يزيل العقبات الكبرى أمامك.

مطور LLM المحلي (مطور منفرد / طالب)

اختر RTX 4090 إن كنت تعمل أساساً في النطاق من 7B إلى 13B، وتشغّل استدلالاً مضغوطاً، وتجرب RAG، أو تعمل على SDXL. انتقل إلى مستوى أعلى حين تجد نفسك تقضي وقتاً أطول في التحايل على قيود الذاكرة بدلاً من بناء ما خططت له فعلاً.

مهندس ML في شركة ناشئة (يطلق نموذجاً أولياً)

إن كان نموذجك الأولي يضم نموذجاً واحداً بحركة مرور معتدلة ويعمل بيسر، فإن 4090 بداية قوية. أما إن احتجت إلى زمن استجابة ثابت تحت الأحمال المتفاوتة، أو تزامناً أعلى، أو عدة أعباء عمل على المضيف نفسه، فإن H100 الخيار الأهدأ.

باحث تطبيقي (كثير من التجارب)

إن كنت تُضطر باستمرار إلى تسويات كتقليص حجم الدُّفعة أو التلاعب في الدقة، فإن H100 يمنحك تجارب أنظف وتشغيلات فاشلة أقل.

فريق الإنتاج / المنصة (خدمة متعددة المستأجرين)

H100 هو الخيار الواضح، أساساً لأن MIG والهامش الأعلى يُبسّطان تخطيط السعة ويُقلّصان نطاق التأثير عند حدوث ارتفاعات مفاجئة.

إن كنت لا تريد الالتزام بشراء الأجهزة بعد، فالإيجار هو الخطوة المثلى التالية.

مسار وسطي عملي: استأجر GPUs أولاً، ثم التزم

أوضح طريقة للبت في الأمر H100 مقابل RTX 4090 هي تشغيل لديك نموذجك، لديك مدخلاتك، و لديك طول السياق على كلا نوعَي الأجهزة، ثم قارن معدل التوكنات في الثانية وزمن الاستجابة الأقصى تحت الحمل.

هذا بالضبط ما بنينا من أجله Cloudzy GPU VPS، إذ يمكنك تشغيل خادم GPU في أقل من دقيقة، وتثبيت بيئتك مع صلاحيات root كاملة، والتوقف عن الاعتماد على معايير الآخرين.

إليك ما تحصل عليه في خطط GPU VPS لدينا:

- NVIDIA GPUs مخصصة (تشمل خيارات من فئة RTX 4090 وA100) حتى لا تتأثر نتائجك بالمستأجرين المجاورين.

- شبكة تصل إلى 40 Gbps على جميع خطط GPU، وهذا مهم جداً لسحب مجموعات البيانات، وسير عمل متعدد العقد، ونقل القطع الأثرية بسرعة.

- تخزين NVMe SSD، بالإضافة إلى DDR5 RAM وخيارات CPU عالية التردد على جميع المستويات، حتى لا يُعيق باقي النظام أداء GPU.

- DDoS حماية و وقت تشغيل ٩٩٫٩٥٪, حتى لا تتعطل المهام الطويلة بسبب انقطاعات الشبكة العشوائية.

- الفوترة بالساعة (مفيد للاختبارات المعيارية القصيرة) و ضمان استرداد الأموال خلال ١٤ يومًا لاختبار منخفض المخاطر.

شغّل قائمة المعايير ذاتها على خطة RTX 4090 أولاً، ثم كررها على خطة من فئة A100 حين تبدأ بالتعامل مع سياقات أوسع، أو طلبات متزامنة أكثر، أو نماذج أضخم. بعد ذلك، يصبح الاختيار بين H100 مقابل RTX 4090 عادةً ما تكشف عنه سجلاتك بنفسها.

قائمة مراجعة الأداء: اختبر خادمك بنفسك في 30 دقيقة

إن كنت تريد قراراً يمكنك الدفاع عنه، فاحصل على أربعة أرقام من التقنية ذاتها التي ستنشر عليها:

- رموز/ثانية عند طول السياق المستهدف

- زمن الاستجابة عند النسبة المئوية الخامسة والتسعين عند مستوى التزامن المتوقع لديك

- مساحة VRAM إضافية خلال المرحلة الأشد سخونة

- التكلفة لكل تشغيل مكتمل من البداية حتى النتيجة النهائية

اختبار دخاني بسيط باستخدام vLLM يبدو كالتالي:

pip install vllm transformers accelerate

python -m vllm.entrypoints.api_server \

--model meta-llama/Llama-3-8B-Instruct \

--dtype float16 \

--max-model-len 8192إن كنت تريد فهمًا واضحًا لما تستأجره فعلاً، فإن مقالتنا عن ما هو VPS GPU؟ يوضح الفرق بين الوصول المخصص لـ GPU، ومشاركة vGPU، وما يجب مراعاته قبل اختيار الخطة المناسبة.