Se você está decidindo H100 vs RTX 4090 Para IA, lembre-se de que a maioria dos "benchmarks" não importa até seu modelo e cache caberem na VRAM. RTX 4090 é o ponto ideal para trabalho com uma única GPU que fica dentro de 24 GB.

H100 é o que você precisa quando necessita de modelos maiores, concorrência mais alta, isolamento multi-usuário ou menos tempo gastos em manobras de memória.

Vou detalhar por carga de trabalho, mostrar tipos de benchmark e depois dar um plano de teste rápido que você pode executar em sua própria infraestrutura.

Resposta Rápida: H100 vs RTX 4090 para Cargas de Trabalho de IA

H100 vence para treinamento de modelos grandes e servimento sério porque oferece grandes pools de HBM, largura de banda de memória muito alta, NVLink e MIG para isolamento. RTX 4090 é melhor para "preciso de ótima velocidade em uma única GPU a um preço melhor" contanto que sua carga de trabalho caiba em 24 GB sem compromissos constantes. As especificações e recursos da plataforma deixam isso bem claro.

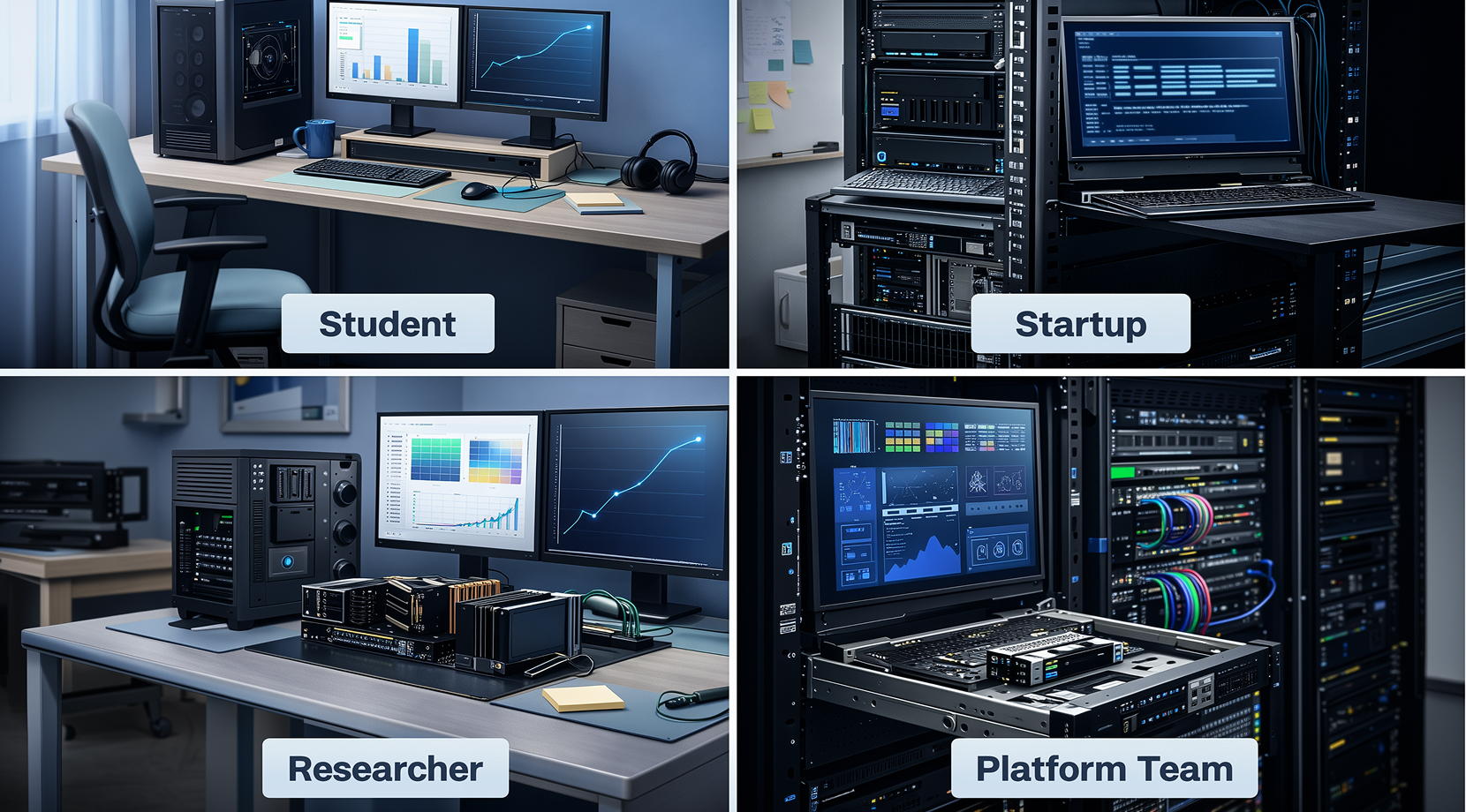

Aqui está a lista rápida por persona:

- Desenvolvedor LLM Local (Dev Solo / Estudante): RTX 4090 até que VRAM se torne o gargalo.

- Engenheiro de ML em Startup (Lançando um MVP): RTX 4090 para servimento e fine-tuning inicial, H100 quando você precisar de concorrência estável ou modelos maiores.

- Pesquisador Aplicado (Muitos Experimentos): H100 se você continua batendo em OOM, limites de batch ou contextos longos.

- Equipe de Produção / Plataforma (Multi-Tenant): H100 para slicing MIG, mais headroom e scaling mais suave.

Com esse contexto, o resto deste artigo trata dos limites que as pessoas enfrentam na prática e como os números de benchmark se alinham com eles.

A Única Pergunta de Benchmark a Considerar: O Que Precisa Caber em VRAM?

A maioria das discussões sobre H100 vs RTX 4090 são tecnicamente argumentos de VRAM. Em trabalhos LLM, VRAM é consumido por pesos, ativações durante o treinamento, estados do otimizador no treinamento, e pelo cache KV durante inferência. Este último é o que as pessoas geralmente não esperam, porque cresce com o comprimento do contexto e concorrência.

A tabela abaixo é intencionalmente de alto nível porque o ajuste exato depende do framework, precisão e overhead.

Aqui está a visão de "cabe sem drama?":

| Carga de trabalho | Realidade Típica de Single-GPU em RTX 4090 (24 GB) | Realidade Típica de Single-GPU em H100 (80–94 GB) |

| Inferência LLM de 7B (FP16 / BF16) | Geralmente tudo bem | Espaço confortável |

| Inferência de LLM 13B | Frequentemente apertado, depende do contexto | Geralmente tudo bem |

| Inferência de classe 70B | Precisa de quantização pesada/offload | Bem mais realista |

| Inferência SD/SDXL + batch pequeno | Geralmente tudo bem | Funciona bem, mais headroom de batch |

| Serving com concorrência maior | Pressão de cache KV fica evidente rápido | Mais espaço, mais estável sob carga |

Se você quer uma lista mais ampla de GPU (não só essas duas), nosso resumo de Melhores GPU para Machine Learning em 2025 é uma tabela de referência prática para VRAM e largura de banda de memória em GPUs AI comuns.

Uma vez que você sabe que sua carga de trabalho cabe, o próximo fator que define como "suave" ela se sente é a largura de banda de memória.

Largura de Banda: Por Que HBM Faz Diferença

Muita conversa sobre desempenho em AI se fixa em picos de compute, mas transformers são extremamente sensíveis ao movimento de memória. A vantagem de H100 é que combina pools HBM grandes com largura de banda de memória muito alta, além de largura de banda NVLink e particionamento MIG no lado da plataforma.

Resumo de Especificações

As especificações não vão escolher a GPU para você, mas explicam por que a mesma carga de trabalho parece fácil em uma placa e apertada em outra. Este quadro mostra o que afeta mais o comportamento de treinamento, inferência e deploy da LLM.

| Especificação | H100 (SXM / NVL) | RTX 4090 |

| VRAM | 80 GB / 94 GB | 24 GB |

| Largura de Banda de Memória | 3,35–3,9 TB/s | GDDR6X (capacidade limitada em 24 GB) |

| Interconexão | NVLink + PCIe Gen5 | PCIe (plataforma consumer) |

| Múltiplas Instâncias | Até 7 instâncias MIG | Não disponível |

Referências de especificações: NVIDIA H100, NVIDIA RTX 4090.

O que isso significa na prática:

- Se você está tentando aumentar o tamanho do batch ou o comprimento do contexto, a H100 tende a se manter estável por mais tempo antes de você ser forçado a fazer compromissos.

- Se você está servindo muitas requisições ao mesmo tempo, a H100 tem mais 'espaço de respiração', então você não enfrenta latência de cauda instável tão rápido.

- Se seu trabalho é principalmente de um único usuário, um único modelo, contexto modesto, a 4090 muitas vezes se sente rápida e satisfatória.

Largura de banda não substitui benchmarks bem feitos. Ela apenas explica por que duas GPUs podem parecer próximas em um teste estreito, depois se afastam sob carga real.

Benchmarks Confiáveis H100 vs RTX 4090

Benchmarks não são todos iguais, e é por isso que 'meus números não conferem com os seus' acontece o tempo todo. Para H100 vs RTX 4090, ajuda dividir benchmarks em dois caminhos:

- Caminho A (sensibilidade da comunidade): llama.cpp-style tokens/sec tests and simple inference scripts.

- Caminho B (suites padronizadas): Resultados no estilo MLPerf Training e MLPerf Inference, que focam em regras repetíveis.

Snapshot de Inferência no Estilo Llama.cpp

Esse é o tipo de teste que as pessoas rodam em casa e depois discutem por três dias. É útil porque reflete uma 'toolchain real' que muitos desenvolvedores usam, mas também é fácil de interpretar errado se você ignorar fit e precisão.

Comparações públicas no estilo llama.cpp mostram a RTX 4090 se saindo muito bem em modelos menores e execuções quantizadas, enquanto modelos grandes em precisão mais alta ultrapassam o limite da VRAM.

Aqui está o padrão que você deve esperar:

| Modelo | GPU | Resultado Típico |

| Classe 7B | RTX 4090 | Muitos tokens/seg, inferência single-user suave |

| classe 13B | RTX 4090 | Ainda bom, mas contexto e overhead começam a importar |

| categoria 70B | RTX 4090 | Não cabe bem sem quant/offload agressivo |

| categoria 70B | H100 | Muito mais realista manter residente e servir com confiabilidade |

O ponto desta tabela não é 'a 4090 é ruim' ou 'a H100 é mágica'. É que o limite da VRAM decide quanto você pode manter residente, e isso afeta velocidade, estabilidade e a quantidade de ajustes que você terá que fazer.

Se você está constantemente reduzindo o comprimento do contexto só para sobreviver, esse é o momento em que essa comparação deixa de ser teórica.

O que o MLPerf Adiciona que Benchmarks de Fórum Não Têm

O MLPerf existe porque "scripts aleatórios e achismos" não funcionam quando você está tomando uma decisão de vários milhares de dólares. MLCommons adicionou cargas de trabalho mais recentes de IA generativa ao longo do tempo, e o MLPerf foi projetado para tornar os resultados mais comparáveis entre sistemas.

No lado do treinamento, o artigo NVIDIA MLPerf Training v5.1 é um bom exemplo de como fornecedores relatam tempo de treinamento com detalhes sobre o ambiente de submissão e as regras de benchmark que estão seguindo.

Essa métrica não vai te dizer como seus prompts privados se comportam, mas é uma verificação de sanidade para scaling em nível de sistema e "como essa classe de hardware se comporta dentro das regras".

Agora vamos falar sobre a parte que mais afeta compras: o tempo e o dinheiro gastos para terminar o trabalho.

Custo, Tempo e Custo de Oportunidade

Muito H100 vs RTX 4090 decisões são enquadradas como "preço de compra vs preço de aluguel". Raramente esse é o enquadramento correto. Um melhor é: quantas horas você precisa para treinar um modelo que você consegue usar, e quanto tempo você perde lutando contra limitações?

Três cenários comuns mostram os tradeoffs com clareza.

Fine-Tuning Semanal em Modelos Pequenos a Médios

Se suas execuções cabem em 24 GB sem compromissos constantes, a rota 4090 é ótima. Você itera rapidamente, não precisa agendar tempo de cluster, e sua configuração é simples. Se cada execução vira "reduzir batch, cortar contexto, tentar de novo", H100 é uma ideia muito mais sensata, apesar do custo mais alto.

Servindo Com Concorrência Real

Concorrência pressiona cache KV rápido. É aqui que o headroom do H100 e seus controles de plataforma compensam, especialmente se você precisa de latência previsível.

Se você ainda está decidindo se um servidor GPU é a forma ou fit certa para seu deploy, nosso GPU VPS vs CPU VPS breakdown é uma forma útil de mapear a carga de trabalho para o tipo de infraestrutura antes de você gastar tempo otimizando a coisa errada.

Jobs de Treinamento Maiores Com Prazos

Assim que você está escalando além de uma pessoa, uma máquina, as coisas chatas são aquelas que você quer focar: ambientes estáveis, menos modos de falha, e menos tempo investido no que é basicamente supervisão. É esse o tipo de coisa para a qual H100 foi projetado.

Se você ainda está em dúvida depois dessa seção, o próximo passo não é mais leitura. É olhar como sua stack se comporta na prática, incluindo atrito de driver e cargas multi-user.

Software e Ops: Drivers, Estabilidade, Multi-User e Suporte

Essa é a parte que a maioria dos gráficos de benchmark pula, mas é uma fatia grande da vida do dia a dia.

RTX 4090 é popular porque é acessível e rápido para muitos workflows de IA. O tradeoff é que uma vez sua use case cresce, você é mais provável de esbarrar em limites de memória e padrões de scaling que não foram construídos para ambientes compartilhados e multi-tenant.

H100 é projetado para clusters. MIG é importante para times de plataforma porque permite dividir um GPU em fatias isoladas, reduzindo problemas de "vizinhos barulhentos" e facilitando muito o planejamento de capacidade. As especificações oficiais da NVIDIA para H100 listam até 7 instâncias MIG dependendo do fator forma.

Se sua carga de trabalho é pessoal e local, você pode trabalhar tranquilamente com 4090 por muito tempo. Se sua carga é multi-usuário e voltada para clientes, H100 é o caminho mais seguro.

Então, no geral, quem deveria comprar o quê?

Qual Você Deveria Escolher Para Sua Carga de Trabalho

Para H100 vs RTX 4090, a escolha certa é, no fim das contas, aquela que remove seus maiores obstáculos.

Desenvolvedor Local LLM (Dev Solo / Estudante)

Escolha RTX 4090 se você trabalha principalmente na faixa de 7B–13B, rodando inferência quantizada, experimentando RAG ou trabalhando com SDXL. Suba de nível quando passar mais tempo contornando limitações de memória do que construindo o que realmente planejou.

Engenheiro de ML em Startup (Lançando um MVP)

Se seu MVP é um modelo único com tráfego moderado e cabe confortavelmente, 4090 é um começo sólido. Se você precisa de latência estável sob picos, maior concorrência ou múltiplas cargas de trabalho por host, H100 é o caminho mais tranquilo.

Pesquisador Aplicado (Muitos Experimentos)

Se você frequentemente se vê forçado a fazer compromissos como reduzir batch size ou fazer acrobacias de precisão, H100 oferece experimentos mais limpos e menos tentativas desperdiçadas.

Produção / Time de Plataforma (Servindo Multi-Tenant)

H100 é a escolha óbvia, principalmente porque MIG e mais headroom facilitam o planejamento de capacidade e basicamente reduzem o impacto quando algo dispara.

Se você ainda não quer comprometer dinheiro em hardware, alugar é o melhor próximo passo.

Um Meio Termo Prático: Alugue GPUs Primeiro, Depois Decida

A forma mais clara de resolver H100 vs RTX 4090 é executar seu modelo, seu prompts e seu context length em ambas as classes de hardware, depois compare tokens/sec e tail latency sob carga.

É exatamente por isso que construímos Cloudzy GPU VPS, já que você consegue uma máquina GPU em menos de um minuto, instalar seu stack com acesso root completo e parar de chutar baseado no benchmark de outra pessoa.

Veja o que você ganha em nossos planos GPU VPS:

- GPUs NVIDIA Dedicadas (incluindo opções classe RTX 4090 e A100) para seus resultados não sofrerem desvio de vizinhos barulhentos.

- Até 40 Gbps de rede em todos os planos GPU, o que é importante para pulls de dataset, workflows multi-node e mover artefatos rapidamente.

- Armazenamento NVMe SSD, além de DDR5 RAM e opções CPU de alta frequência em todos os tiers, para que o resto da máquina não arraste o GPU para baixo.

- Proteção contra DDoS e um Tempo de atividade de 99,95%, para que trabalhos longos não sejam prejudicados por instabilidade de conexão.

- Cobrança por hora (útil para testes rápidos de desempenho) e um Garantia de reembolso de 14 dias para testes de baixo risco.

Execute a mesma checklist de desempenho em um plano RTX 4090 primeiro, depois repita em um plano classe A100 quando estiver lidando com contextos maiores, maior concorrência ou modelos maiores. Depois disso, escolher entre H100 vs RTX 4090 geralmente fica óbvio pelos seus próprios logs.

Checklist de Desempenho: Execute a Sua em 30 Minutos

Se você quer uma decisão que possa defender, colha quatro números da pilha exata que pretende usar:

- Tokens/seg no seu tamanho de contexto alvo

- latência p95 na sua concorrência esperada

- Espaço livre de VRAM durante o pico de carga

- Custo por execução concluída do início até o resultado

Um teste básico mínimo com vLLM fica assim:

pip install vllm transformers accelerate

python -m vllm.entrypoints.api_server \

--model meta-llama/Llama-3-8B-Instruct \

--dtype float16 \

--max-model-len 8192Se você quer ter clareza do que está realmente alugando, nosso artigo sobre O que é um GPU VPS? explica a diferença entre acesso dedicado a GPU, compartilhamento vGPU e o que verificar antes de escolher um plano.