Se seu plano é comprar uma nova GPU para parar de ver erros de falta de memória, a comparação 5070 Ti versus 5080 é a discussão errada. Ambas as placas têm 16 GB de VRAM, e esse limite de capacidade se manifesta em deep learning mais cedo do que a maioria das pessoas espera.

O 5080 é mais rápido, mas raramente permite executar um modelo significativamente maior. Na prática, você ainda acaba reduzindo o tamanho do batch, encurtando a janela de contexto ou descarregando para a memória do sistema, só para manter as execuções funcionando.

Por isso este artigo oferece uma análise genuína e realista do 5070 Ti versus 5080 para deep learning, além de um conjunto de opções que se encaixam se seu objetivo é treinar, fazer fine-tune ou servir modelos sem limites constantes de memória.

Se você ler apenas uma coisa, leia a seção de especificações e a seção "capacidade versus velocidade"; são as duas que impedem você de comprar a placa errada.

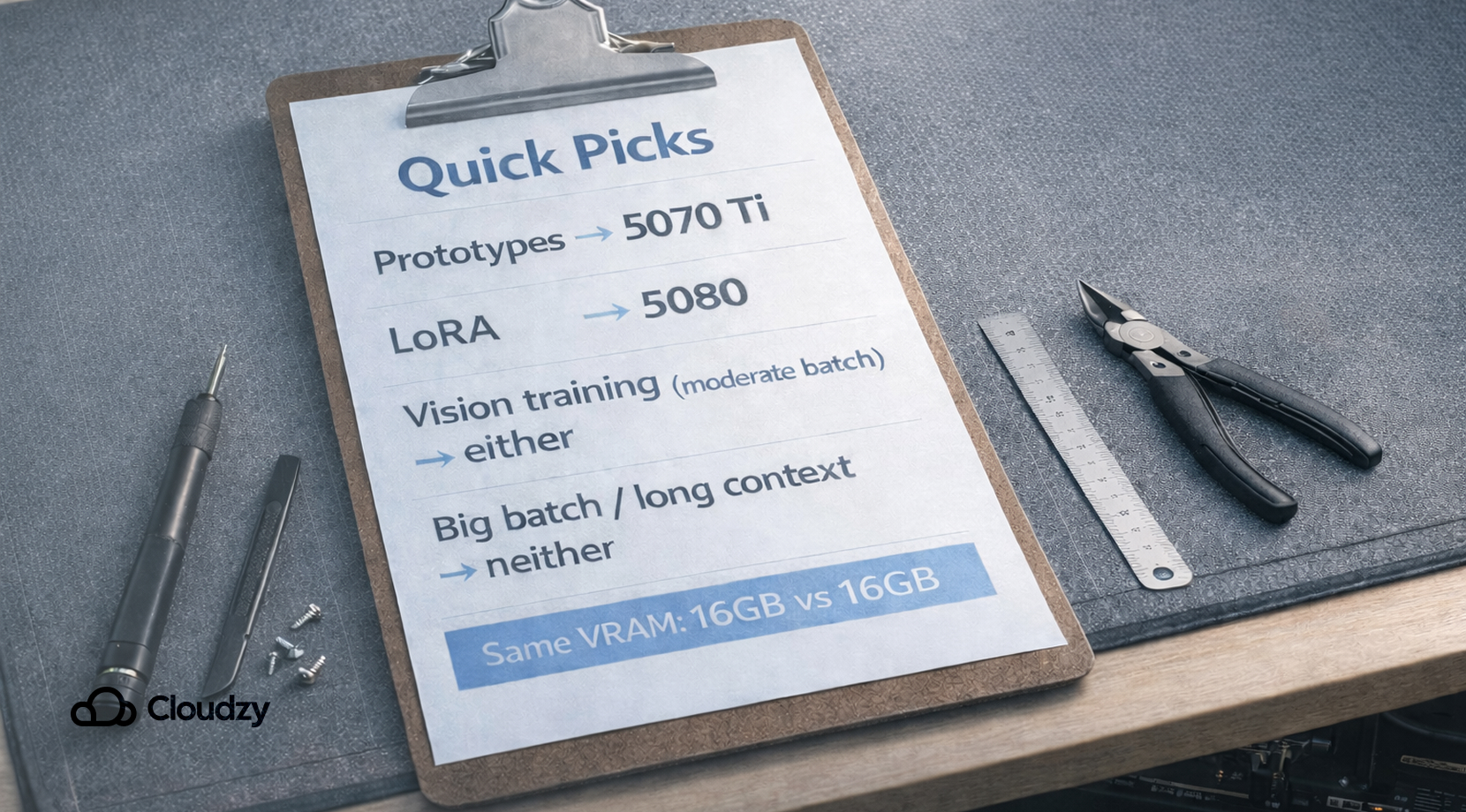

Escolhas Rápidas Conforme Seu Caso de Uso

A maioria não compra placas gráficas ao acaso. Vemos quatro perfis de comprador aparecer repetidamente, e a escolha entre 5070 Ti e 5080 cai diferente para cada um.

O Entusiasta Local com Jupyter

Você executa notebooks, ajusta configurações de quantização e se importa mais com "funciona" do que com throughput perfeito. Para você, a escolha entre 5070 Ti e 5080 geralmente vem do orçamento, porque ambas as placas funcionam bem em modelos pequenos e inferência quantizada, então ambas batem no mesmo teto de memória quando você aumenta a janela de contexto ou o tamanho do batch.

O Aluno de Pós-Graduação Treinando Modelos de Visão

Você quer experimentos reproduzíveis, não infinitas tentativas. O custo oculto não é a placa em si; é o tempo que você perde quando a execução falha na época 3 porque o dataloader, augmentações e modelo competem por memória.

O Engenheiro de Startup Lançando Inferência

Você se importa com latência de cauda e concorrência. Uma demo com um único usuário funciona bem em 16 GB, depois chega o tráfego de produção e a pressão do cache KV consome sua memória como um vazamento lento. Para servir modelos, a escolha entre 5070 Ti e 5080 pode ser uma distração se seu verdadeiro problema é capacidade para batching e prompts longos.

O Criador que Também Trabalha com ML

Você alterna entre apps criativos e ferramentas de ML, e odeia reinicializações, dores de cabeça com drivers e "feche o Chrome para treinar". Para você, a escolha entre 5070 Ti e 5080 faz sentido apenas se a placa gráfica é parte de um workflow limpo, não uma estação de trabalho frágil que desaba quando você faz multitarefa.

Com esses casos em mente, vamos aos detalhes do hardware e por que o fator limitante é o mesmo nos lugares que importam.

Especificações de Alta Prioridade para Deep Learning

A forma mais rápida de entender 5070 Ti versus 5080 é ignorar os números de marketing e focar na linha de memória.

Se você quer a visão completa da ficha técnica, aqui está uma tabela detalhada focando no que mais afeta o comportamento de treinamento e inferência. (Velocidades de clock e saídas de vídeo chamam atenção, mas não decidem se sua execução cabe.)

| Especificação (Desktop) | RTX 5070 Ti | RTX 5080 | Por Que Aparece em DL |

| VRAM | 16 GB | 16 GB | Capacidade é a barreira rígida para pesos, ativações e cache KV |

| Tipo de Memória | GDDR7 | GDDR7 | Comportamento semelhante, largura de banda ajuda, mas capacidade decide "cabe ou não" |

| Barramento de Memória | 256 bits | 256 bits | Limita largura de banda agregada; ajuda throughput, não tamanho do modelo |

| Núcleos CUDA | 8,960 | 10,752 | Mais compute ajuda em tokens/seg, não em "consigo carregar isso" |

| Potência Típica da Placa | 300 W | 360 W | Mais calor e espaço para fonte de alimentação, sem memória extra |

Fontes oficiais para especificações: RTX 5080, família RTX 5070

Basicamente, a 5080 é a placa mais rápida, a 5070 Ti é a mais barata. Para deep learning, a diferença aparece principalmente depois que sua carga de trabalho já cabe na memória.

A seguir, vamos ver por que VRAM desaparece tão rápido, mesmo em configurações que parecem leves no papel.

Por que VRAM Acaba Tão Rápido em Deep Learning

Quem vem de gaming costuma pensar que VRAM é como um pool de texturas. Em deep learning, é mais como uma bancada de cozinha apertada. Você não precisa só de espaço para os ingredientes, precisa de espaço para picar, cozinhar e servir, tudo ao mesmo tempo.

Aqui está o que normalmente ocupa VRAM durante uma execução:

- Pesos do modelo: os parâmetros que você carrega, às vezes em FP16/BF16, às vezes quantizados.

- Ativações: tensores intermediários salvos para backprop, geralmente o grande vilão no treinamento.

- Gradientes e estado do otimizador: overhead de treinamento que pode multiplicar as necessidades de memória.

- cache KV: overhead de inferência que cresce com o comprimento do contexto e a concorrência.

Por isso 5070 Ti vs 5080 pode parecer discutir potência de motor enquanto você puxa um trailer muito pesado. Você pode ter mais potência, mas o limite de engate continua sendo o gargalo.

Uma verificação rápida que usamos em nossos próprios testes é registrar tanto a memória alocada quanto a reservada em PyTorch. As notas de memória CUDA do PyTorch explicam o alocador com cache e por que a memória pode parecer "usada" em ferramentas como nvidia-smi mesmo após os tensores serem liberados.

Isso nos traz ao ponto principal desta discussão, que é que a maioria das falhas de deep learning em 16 GB não é porque é lento propriamente dito, mas porque você recebe OOM no pior momento possível.

As Primeiras Cargas de Trabalho que Quebram 5070 Ti vs 5080

Abaixo estão os padrões de deep learning que geralmente atingem os limites de memória primeiro em 5070 Ti vs 5080.

Serviço LLM com Prompts Longos e Concorrência Real

Um prompt solo com 2K tokens pode parecer ok. Adicione contexto mais longo, adicione batch, adicione um segundo usuário, e o cache KV começa a subir. É quando 5070 Ti vs 5080 desaba no mesmo resultado, onde você limita o contexto máximo ou reduz o tamanho do batch para sobreviver.

Um método de verificação simples:

- Execute seu servidor com seu contexto máximo real e batch.

- Monitore VRAM ao longo do tempo, não apenas na inicialização.

- Anote o ponto onde a latência aumenta, depois verifique o uso de memória na mesma janela.

Se você quer uma configuração de monitoramento confiável que não vire um projeto em si, nosso guia sobre software de monitoramento GPU cobre padrões práticos de logging CLI que funcionam bem em execuções reais.

Ajuste fino com LoRA ou QLoRA

Muita gente diz que "LoRA funciona em 16 GB", e não está errada. A pegadinha é assumir que o resto do seu pipeline é grátis. Buffers de tokenização, workers do dataloader, scaling de precisão mista e etapas de validação se acumulam muito rápido.

Na prática, o gargalo aqui não é tanto computação quanto margem. Se você não tiver VRAM de sobra, acaba tendo que ficar monitorando as execuções.

Treinamento de visão com entradas de alta resolução

Modelos de imagem têm um modo de falha sorrateiro onde um pequeno aumento de resolução, ou uma augmentação extra, pode te levar de estável para OOM. Entre RTX 5070 Ti e RTX 5080, isso aparece como tamanho de batch caindo para 1, depois acumulação de gradiente transformando seu treinamento em câmera lenta.

Execuções multimodais em uma GPU

Codificador de texto + codificador de imagem + camadas de fusão podem funcionar; porém, se você aumentar o comprimento da sequência ou adicionar um backbone de visão maior, o empilhamento de memória fica brutal.

"Minha GPU está bem, meu desktop não está"

Esse é o mais relável de todos. Você começa o treinamento, aí seu navegador, IDE e tudo mais que você roda pegam VRAM, e de repente sua config "estável" quebra. Pessoas em fóruns reclamam de fechar tudo, desabilitar overlays e ainda assim bater OOM no mesmo modelo que rodaram ontem.

Esse padrão aparece constantemente em Discussões sobre 5070 Ti vs 5080, também, porque ambas as placas ficam no mesmo limite de capacidade. Se isso soa familiar, a próxima pergunta é "o que fazemos sobre esse limite?"

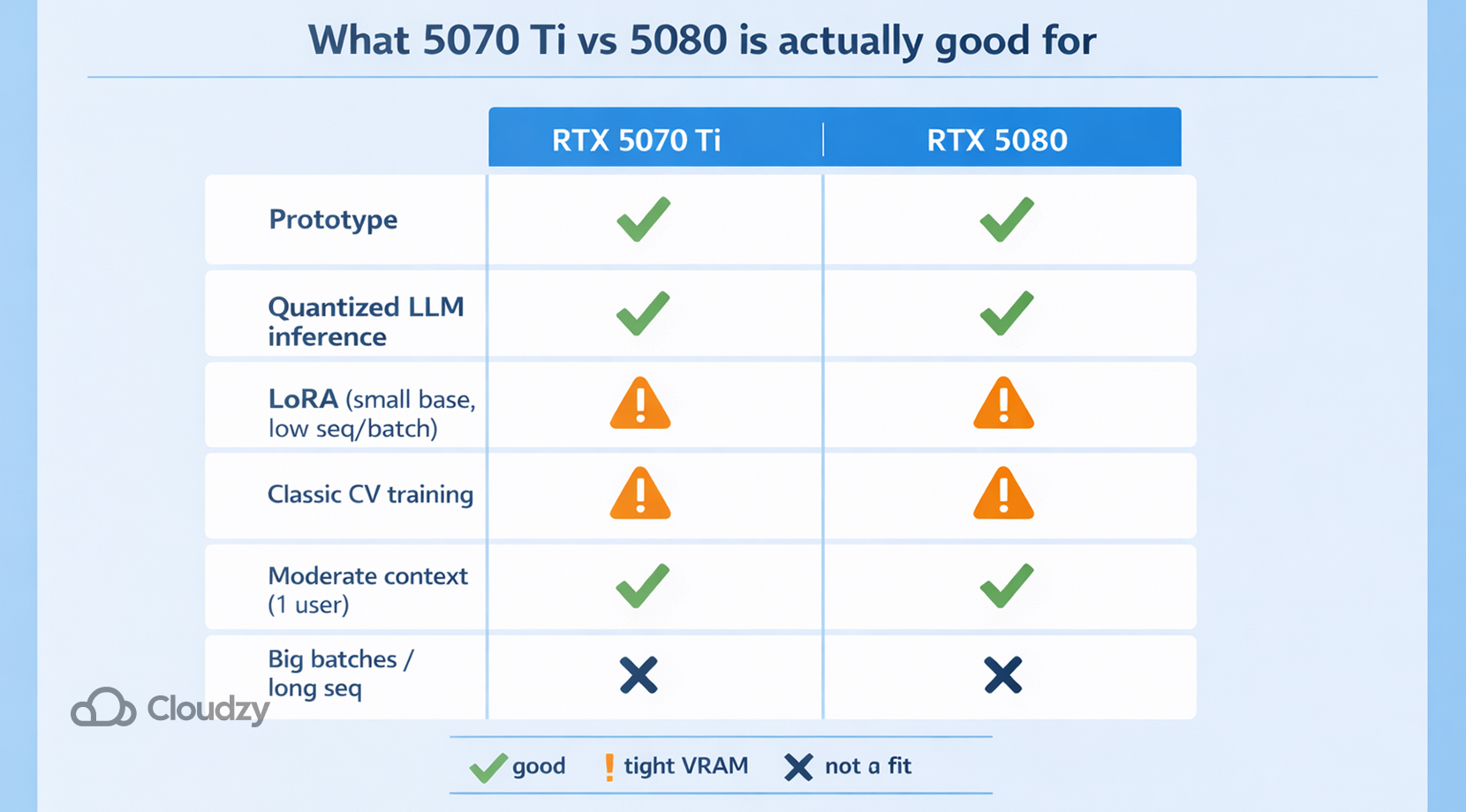

O que RTX 5070 Ti vs RTX 5080 é Actual para

É fácil criticar 16 GB em círculos de ML, mas não é inútil. É só limitado.

RTX 5070 Ti vs RTX 5080 pode ser um setup totalmente adequado para:

- Trabalho de protótipo: experimentos pequenos, ablações rápidas e sanity checks.

- Inferência de LLM quantizado: modelos menores com contexto moderado, usuário único.

- LoRA em modelos base menores: desde que você mantenha o comprimento de sequência e batch sob controle.

- Treinamento de visão clássico: tamanhos de imagem moderados, backbones moderados, mais paciência.

A questão é: se seu trabalho fica dentro do limite de memória, RTX 5080 geralmente vai se sentir mais rápido que RTX 5070 Ti, e você vai aproveitar a computação extra.

Mas no segundo em que você tenta fazer deep learning "sério", vai bater em problemas de margem de memória. Então vamos falar sobre táticas que ajudam em ambas as placas.

Como Aproveitar ao Máximo a VRAM Sem Sacrificar o Treinamento

Nenhum desses truques é mágica. São apenas as técnicas que fazem a 5070 Ti vs 5080 continuar útil por mais tempo.

Comece com Medição

Antes de mexer em hiperparâmetros, meça o pico de VRAM por passo. Em PyTorch, max_memory_allocated() e max_memory_reserved() há formas rápidas de ver o que seu treinamento está realmente fazendo.

Isso ajuda a responder perguntas como:

- O modelo em si é o gargalo principal, ou são as ativações?

- A VRAM dispara durante validação?

- A fragmentação está aumentando com o tempo?

Uma vez que você tem uma linha de base, o resto fica menos imprevisível.

Reduza Memória Onde For Possível

Uma simples sequência que usamos:

- Diminua o tamanho do lote até caber.

- Adicione acumulação de gradientes para recuperar seu lote efetivo.

- Ative precisão mista (BF16/FP16) se sua stack suportar.

- Adicione gradient checkpointing se as ativações forem dominantes.

- Só então comece a ajustar o tamanho do modelo.

Trate o Comprimento de Contexto como um Orçamento

Para transformers, o comprimento de contexto é o que mais problemas causa. Afeta o cálculo de atenção e, para inferência, o tamanho do cache KV. Na 5070 Ti vs 5080, você nota na hora em que ultrapassa alguns milhares de tokens: a VRAM sobe rápido, o throughput cai e você fica reduzindo o tamanho do lote só para manter a velocidade.

Uma abordagem recomendada:

- Escolha um comprimento máximo padrão que você consiga rodar com margem de segurança.

- Crie um segundo perfil para "contexto longo", com lote menor.

- Não misture os dois enquanto estiver debugando.

Não Confunda Cache de PyTorch com Vazamentos Reais

Muitos relatórios de "vazamento de memória" são na verdade comportamento do alocador. A documentação de PyTorch menciona que o alocador com cache pode manter memória reservada mesmo depois que tensores são liberados, e empty_cache() geralmente libera blocos de cache não usados de volta para outras aplicações, não de volta para PyTorch.

Isso importa porque usuários de 5070 Ti vs 5080 frequentemente se distraem com vazamentos fictícios em vez de focar nas fontes reais: tamanho do lote, comprimento da sequência e memória de ativação.

Esses ajustes tornam seu limite de memória utilizável, mas não mudam a realidade fundamental. Se seu projeto exige modelos maiores, contextos mais longos ou maior concorrência, você precisa de mais VRAM.

Preciso de Capacidade ou Velocidade Entre 5070 Ti vs 5080

Uma forma de ver isso é que velocidade é o quão rápido você consegue andar, e capacidade é quantas pessoas você consegue levar junto. Deep learning depende dos dois, mas capacidade decide se você consegue sair do estacionamento em primeiro lugar.

O 5080 entrega maior vazão que o 5070 Ti em muitas cargas de trabalho. Mas 5070 Ti vs 5080 não muda o "consigo carregar e executar" porque ambos atingem seus limites.

É por isso que as pessoas terminam decepcionadas após uma atualização. Sentem a melhoria de velocidade em testes pequenos, depois tentam com sua carga de trabalho real e batem na mesma parede. A parede só chega 30 segundos depois.

Então se você está pesquisando com deep learning em mente, ajuda decidir em qual categoria você se encaixa:

- Limitado em velocidade: você já consegue rodar, só quer passos mais rápidos.

- Limitado pela capacidade: você não consegue rodar, e gasta tempo reduzindo o problema.

A maioria das pessoas pesquisando 5070 Ti vs 5080 para deep learning está na segunda categoria, mesmo que ainda não perceba.

Agora vamos falar sobre a opção que geralmente economiza mais tempo: transferir o "trabalho pesado" para um GPU maior, sem reconstruir toda sua vida em torno de uma nova máquina local.

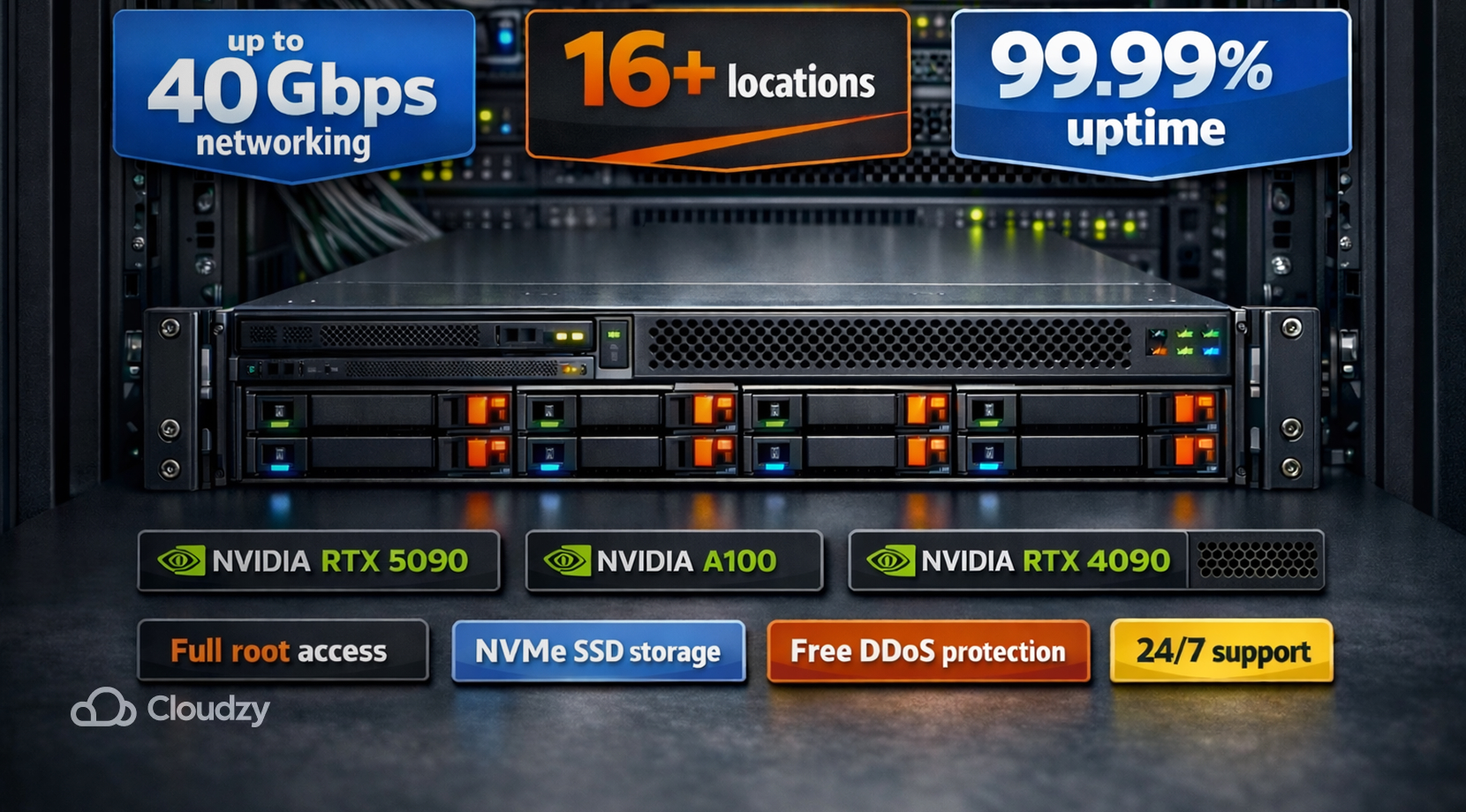

Uma Solução Acessível: Use um GPU VPS para Execuções Pesadas

Na nossa equipe de infraestrutura, o padrão mais comum que vemos é que as pessoas fazem protótipos localmente, depois atingem um ponto onde 5070 Ti vs 5080 não importa mais, porque o trabalho simplesmente não cabe.

É nesse momento que você quer acesso a um pool maior de VRAM para treinar e fazer testes de serving realistas. É exatamente aí que Cloudzy GPU VPS é um ajuste perfeito.

Nossos planos GPU VPS incluem opções NVIDIA como RTX 5090, A100 e RTX 4090, além de acesso root completo, armazenamento NVMe SSD, rede de até 40 Gbps, 12 localizações, proteção DDoS grátis, suporte 24/7 e meta de uptime de 99,95%.

Mas como isso te ajuda, seja com 5070 Ti vs 5080 ou qualquer outro GPU no mesmo nível? Bom:

- Você consegue rodar seu modelo real e fazer profile de prompts em hardware com mais VRAM, então as decisões ficam óbvias a partir de seus próprios logs.

- Você mantém seu GPU local para desenvolvimento e testes rápidos, depois aluga a "placa grande" só para o trabalho pesado.

Se você quer um lembrete rápido sobre o que um GPU VPS realmente é, e o que acesso dedicado vs compartilhado no GPU significa, nosso guia para iniciantes explica em linguagem clara.

E se você ainda não tem certeza se precisa de um GPU para sua carga de trabalho, nosso GPU vs CPU VPS essa comparação te dá uma ideia clara de que tipo de hardware treinar modelos, fazer inferência, rodar bancos de dados e aplicações web realmente precisam.

Com a infraestrutura definida, o último passo é escolher um fluxo de trabalho que não desperdice seu tempo.

Um Fluxo de Trabalho Simples para Descobrir O Que Você Precisa

Muitos developers de ML ficam presos a um dilema falso: comprar uma placa consumer maior ou sofrer. Na prática, 5070 Ti vs 5080 ainda cabe em um fluxo de trabalho sensato se você a usar como ferramenta de desenvolvimento local, não como sua stack de produção completa.

Aqui está um fluxo que funciona bem:

- Use sua placa de 16 GB para codificar, debugar e fazer pequenos testes.

- Mantenha um template de ambiente com 'placa grande' pronto para rodar remotamente.

- Mude treinamento e testes de servindo que precisam de mais memória para uma placa profissional.

- Monitore as execuções e salve logs, assim os resultados são reproduzíveis.

Se você quer uma análise mais profunda sobre escolher a classe certa de GPU para trabalho com ML em geral, nosso levantamento das melhores GPUs para machine learning é um bom próximo passo.

Então, no final das contas, 5070 Ti vs 5080 é uma escolha de computação local, mas escala em deep learning é uma escolha de infraestrutura. Falando em escala, se você quer saber como uma classe de placa maior muda o comportamento real de AI, nosso H100 vs RTX 4090 benchmark de desempenho estudo é uma comparação útil porque sempre volta ao mesmo tema: memória adequada em primeiro lugar, depois velocidade.