مع تزايد الطلب على LLM المحلية، يجد كثير من المستخدمين أنفسهم حائرين عند اختيار الأنسب منها، إذ إن تشغيلها ليس بالأمر البسيط الذي قد يبدو عليه. فهي تستهلك قدرًا لا بأس به من الموارد، بعضها أكثر من غيرها، مما يجعل كثيرين يُحجمون عنها، ناهيك عن الساعات الطويلة التي قد يقضيها المبتدئون وهم يحدقون في نافذة الطرفية.

غير أن ثمة خيارين بارزين يُيسّران الأمور. Ollama وLM Studio من أكثر المنصات استخدامًا لتشغيل LLM المحلية بأداء عالٍ. لكن الاختيار بينهما قد يكون صعبًا، إذ صُمّم كل منهما لأسلوب عمل مختلف. دعنا نُجري مقارنة مباشرة بين Ollama وLM Studio.

Ollama: أداة للمحترفين التقنيين

في سياق تشغيل LLM المحلية، يُعد Ollama خيارًا قويًا بفضل ميزاته المتعددة. فهو قابل للتهيئة بشكل واسع، ومتاح مجانًا بوصفه منصة مفتوحة المصدر يدعمها المجتمع.

رغم أن Ollama يُبسّط تشغيل LLM المحلية، فإنه يعتمد على واجهة سطر الأوامر CLI بالدرجة الأولى، مما يستلزم بعض المعرفة بالطرفية. وهذا النهج ميزة كبيرة في بيئات التطوير نظرًا لبساطته. وعلى الرغم من أن التعامل مع CLI ليس سهلًا، فإنه أقل استنزافًا للوقت مقارنةً بتشغيل LLM المحلية يدويًا من الصفر.

يحوّل Ollama حاسوبك الشخصي إلى خادم محلي مصغّر مزود بـ HTTP API، مما يتيح لتطبيقاتك وسكريبتاتك الوصول إلى نماذجه المتعددة. والنتيجة أنه يستجيب للأوامر تمامًا كما تفعل LLM عبر الإنترنت، دون إرسال بياناتك إلى السحابة. يُضاف إلى ذلك أن API الخاص به يُتيح للمستخدمين دمج Ollama وتوصيله بالمواقع وروبوتات الدردشة.

بحكم طبيعته القائمة على CLI، يتميز Ollama بثقله الخفيف، مما يجعله أقل استهلاكًا للموارد وأكثر تركيزًا على الأداء. لكن هذا لا يعني أنه يعمل على أي جهاز قديم، إلا أنه يبقى خيارًا جيدًا لمن يرغب في تحقيق أقصى استفادة من موارد جهازه وتوجيهها نحو نموذج LLM نفسه.

مما سبق، ربما خمّنت أن Ollama موجَّه بشكل رئيسي لبيئات التطوير، وهذا صحيح. بفضل سهولة دمجه، وحفاظه على الخصوصية المحلية، وتصميمه القائم على API، فإنه الخيار الواضح لمن يفكر بعقلية المطور.

في المقارنة بين Ollama وLM Studio، قد يكون Ollama هو الأفضل نظرًا لتصميمه الذي يضع API في المقدمة. إن كانت بيئة CLI غير مألوفة لديك، تابع القراءة لتتعرف على خيار أخف وأكثر سهولة في الاستخدام.

LM Studio: خيار سهل الاستخدام

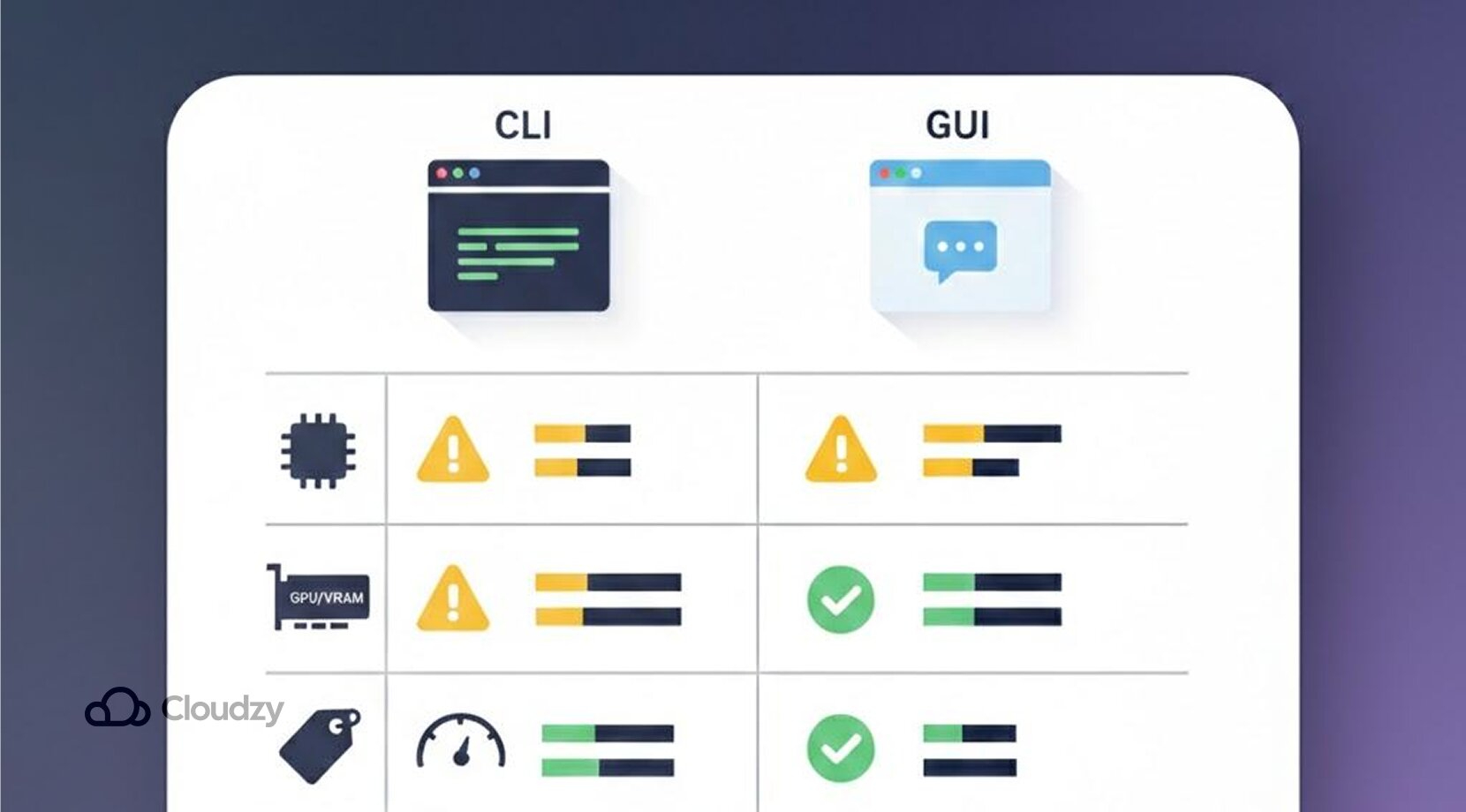

يقف LM Studio في تناقض واضح مع Ollama. فبدلًا من الاعتماد الكامل على واجهة سطر الأوامر، لا يتطلب أي أوامر في الطرفية، ولأنه مزوَّد بواجهة رسومية GUI، يبدو تمامًا كأي تطبيق سطح مكتب اعتيادي. وبالنسبة لبعض المبتدئين، تتلخص المقارنة بين Ollama وLM Studio في الاختيار بين بساطة CLI وسهولة الواجهة الرسومية GUI.

نهج LM Studio في إزالة الحواجز التقنية يقطع شوطاً بعيداً نحو توفير بيئة بسيطة لأي مستخدم. بدلاً من إضافة النماذج وتشغيلها عبر سطر الأوامر، يمكنك الاستعانة بالقوائم المتاحة والكتابة في صندوق محادثة مألوف. يبدو أن أي شخص يستطيع استخدام LM Studio للتجربة مع LLMs المحلية، إذ تبدو الواجهة قريبة جداً من ChatGPT.

يأتي كذلك بمتصفح نماذج مدمج داخل التطبيق، حيث يمكن للمستخدمين اكتشاف أي نموذج يرغبون فيه ونشره، بدءاً من النماذج الخفيفة المخصصة للمهام البسيطة، وصولاً إلى النماذج الثقيلة للمهام الأكثر تطلباً. علاوة على ذلك، يوفر هذا المتصفح وصفاً موجزاً للنماذج المتاحة وحالات الاستخدام الموصى بها، ويتيح للمستخدمين تنزيل النماذج بنقرة واحدة.

رغم أن معظم النماذج مجانية للتنزيل، قد تشترط بعضها تراخيص وحقوق استخدام إضافية. كما يوفر LM Studio في بعض سير العمل وضع خادم محلي لتسهيل عمليات التكامل، غير أنه مصمم في الأساس حول واجهة سطح مكتب سهلة تستهدف المبتدئين. مع ذلك، دعنا نضع Ollama وLM Studio جنباً إلى جنب.

ملاحظات جديرة بالاهتمام: Ollama مقابل LM Studio

قبل المضي قدماً، ثمة نقطة جوهرية ينبغي الإشارة إليها: عبارة «Ollama مقابل LM Studio» قد توحي بأن أحدهما أفضل من الآخر بشكل موضوعي، لكن الأمر ليس بهذه البساطة، إذ يستهدف كل منهما شريحة مختلفة من المستخدمين. إليك مقارنة سريعة بين Ollama وLM Studio.

| الميزة | Ollama | LM Studio |

| سهولة الاستخدام | أقل سهولة في البداية، يتطلب معرفة بالطرفية | مناسب للمبتدئين، يعتمد على النقر بالماوس |

| دعم النماذج | كثير من النماذج مفتوحة الأوزان الشائعة، gpt-oss، gemma 3، qwen 3 | مطابق لـ Ollama تماماً. gpt-oss، gemma3، qwen3 |

| التخصيص | قابل للتخصيص بدرجة عالية، يتكامل بسهولة عبر API | حرية أقل، يتيح ضبط الإعدادات الشائعة عبر أزرار التبديل والشرائح |

| متطلبات الأجهزة | يتوقف الأمر على النموذج؛ النماذج الكبيرة تعمل ببطء إن لم تتوفر الأجهزة الكافية | يعتمد أيضاً على حجم النموذج والأجهزة المتاحة لديك |

| الخصوصية | خصوصية ممتازة بشكل افتراضي، دون الحاجة إلى API خارجي إضافي | تظل المحادثات محلية، غير أن التطبيق يتواصل مع الخوادم للتحديثات والبحث عن النماذج وتنزيلها. |

| الاستخدام دون اتصال | يدعم العمل دون اتصال بالكامل بعد تنزيل النماذج | ممتاز أيضاً دون اتصال بمجرد تنزيل النماذج |

| المنصات المتاحة | Linux، Windows، macOS | Linux، Windows، macOS |

- معاناة الأجهزة مع النماذج المتقدمة: يميل معظم الناس إلى اختيار النماذج الأكبر والأكثر قدرةً كلما أتيحت لهم الفرصة. غير أن تشغيل هذه النماذج على أجهزة الحاسوب المحمولة قد يُفضي إلى مشكلات جدية، إذ تستهلك النماذج الكبيرة موارد RAM و VRAM بشكل مكثف. وهذا يعني في الغالب استجابات بطيئة، أو سياقاً محدوداً، أو فشلاً تاماً في تحميل النموذج.

- مشكلات البطارية: تشغيل LLMs محلياً في ظل أحمال عمل ثقيلة يستنزف البطارية بسرعة، مما يُقصّر عمرها الفعلي، فضلاً عن الضجيج المزعج الصادر عن المراوح ومشتّت الحرارة.

Ollama مقابل LM Studio: تنزيل النماذج

من أبرز الفروق بين Ollama و LM Studio طريقة كل منهما في تنزيل النماذج. فكما أُشير سابقاً، لا يتيح Ollama تثبيت LLMs المحلية بنقرة واحدة، بل يتطلب استخدام نافذة الطرفية الأوامر النصية للقيام بذلك. بيد أن هذه الأوامر سهلة الفهم والاستخدام.

إليك طريقة سريعة لتشغيل النماذج على Ollama.

- نزّل النموذج الذي تفضّله بكتابة ollama pull gpt-oss أو أي نموذج آخر تختاره (لا تنسَ تحديد الوسم المناسب، ويمكنك اختياره من المكتبة).

مثال: ollama pull gpt-oss:20b - يمكنك بعد ذلك تشغيل النموذج باستخدام الأمر ollama run gpt-oss

- يمكنك أيضاً إضافة أدوات برمجية أخرى، فمثلاً يمكن إضافة Claude بالأمر ollama launch claude

إذا لم تكن معتاداً على الطرفية والأوامر النصية، فإن LM Studio خيار مناسب لك. لا تحتاج إلى كتابة أي شيء في أي طرفية لتبدأ في العمل وتنزيل النماذج. ما عليك سوى التنقل إلى أداة تنزيل النماذج المدمجة والبحث عن LLMs بكلمات مفتاحية مثل Llama أو Gemma.

بدلاً من ذلك، يمكنك إدخال URLs الكاملة لـ Hugging Face في شريط البحث.

ثمة أيضاً خيار للوصول إلى تبويب الاستكشاف من أي مكان بالضغط على ⌘ + 2 في Mac، أو Ctrl + 2 في Windows / Linux.

Ollama: الأسرع أداءً

تكون السرعة أحياناً العامل الحاسم للمستخدمين والشركات. وعند المقارنة بين Ollama و LM Studio من حيث السرعة، يتقدم Ollama، وإن كانت النتائج قد تتفاوت بحسب الإعدادات والأجهزة المستخدمة.

في تجربة أحد مستخدمي Reddit في subreddit الخاص بـ r/ollama، كان Ollama أسرع في المعالجة من LM Studio.

وهذا ليس مجرد ادعاء، إذ أجرى المستخدم اختباراً عملياً على كلٍّ من Ollama و LM Studio بتشغيل qwen2.5:1.5b خمس مرات، ثم احتسب متوسط عدد الرموز في الثانية.

Ollama مقابل LM Studio: الأداء ومتطلبات الأجهزة

في ما يخص الأداء، تنتقل المقارنة بين Ollama و LM Studio من واجهة المستخدم إلى مواصفات الأجهزة. تشغيل LLMs محلياً لأول مرة تجربة مختلفة تماماً عما اعتدنا عليه مع LLMs السحابية، وتمنحك شعوراً بالاستقلالية، حتى تصطدم بحدود أداء جهازك.

نظراً للارتفاع الحاد في أسعار RAM و VRAM خلال السنوات الأخيرة، بات من الصعب تجهيز جهازك بالقدرة الكافية لتشغيل النماذج الكبيرة.

النماذج الشائعة تستهلك عادةً من ٢٤ إلى ٦٤ غيغابايت من RAM

نعم، سمعت صحيحاً. متطلبات الأجهزة لا تتعلق بمن يتفوق في Ollama مقابل LM Studio. إذا أردت تجربة سلسة عند تشغيل النماذج المتوسطة والكبيرة الحجم دون تأخير أو أعطال، فإن تثبيت ٢٤ إلى ٦٤ غيغابايت من RAM هو خيارك الأمثل. غير أن هذه الكمية في أغلب الحالات تصبح غير كافية مع السياقات الطويلة والأحمال الثقيلة.

يمكنك بالطبع تشغيل النماذج الأصغر حجماً، المعروفة بالنماذج المكممة، باستخدام ٨ إلى ١٦ غيغابايت من RAM، لكنك لن تحصل على نفس الأداء أو المرونة التي توفرها النماذج الأكبر، ناهيك عن بعض التنازلات في الجودة والسرعة. والمشكلة لا تقتصر على RAM وحده؛ بقية المكونات تحتاج هي الأخرى إلى مواصفات قوية.

وحدات GPU القوية ركيزة أساسية للعمل دون إحباط

على الرغم من أن النماذج يمكنها العمل على CPUs، إلا أن وحدة معالجة الرسوميات لا تزال تؤدي دوراً محورياً في تشغيلها. بدون GPU سريعة وكمية كافية من VRAM، ستواجه توليداً بطيئاً للرموز، وتأخيرات طويلة في الاستجابات المطوّلة، وسرعان ما تتحول التجربة بأكملها إلى عبء لا يُحتمل.

لا تعلّق آمالاً كبيرة، فحتى RTX 5070Ti ولا RTX 5080 لا تكفيان للتعلم العميق الجاد. ذلك لأن بعض الإعدادات التي تتجاوز ٦٠ ألف رمز سياق، يُشير فيها Ollama نفسه إلى الحاجة لنحو ٢٣ غيغابايت من VRAM، وهو أكثر بكثير من ١٦ غيغابايت VRAM التي توفرها هذه GPUs عادةً.

الترقية إلى ما هو أعلى من هذا النطاق باهظة التكلفة للغاية. وإن لم يكن السعر عائقاً بالنسبة لك، فلا يزال بإمكانك الاطلاع على بعض خيارات GPU التي تستحق الدراسة عند تشغيل LLMs محلياً.

ربما أصبحت الآن في حيرة من أمرك حول كيفية تجميع جهاز بالمواصفات الكافية لتشغيل نماذج LLM الكبيرة محلياً. هنا يصل كثيرون إلى نقطة تحول تدفعهم إلى البحث عن بديل آخر.

أحد البدائل التي يلجأ إليها المهتمون هو استخدام آلات افتراضية مزودة بأجهزة مثبتة مسبقاً بمواصفات عالية. استخدام VPS مثلاً، يتيح لك ربط حاسوبك المنزلي أو أجهزتك الشخصية بخادم خاص من اختيارك، مع توفر جميع المتطلبات المسبقة.

إذا بدا لك استخدام VPS حلاً مناسباً، فنوصيك بجدية بـ خادم Ollama الافتراضيمن Cloudzy، حيث تعمل في بيئة shell نظيفة. يأتي مع Ollama مثبتاً مسبقاً، فتبدأ العمل على LLMs المحلية فوراً وبخصوصية تامة. الأسعار معقولة، مع ١٢ موقعاً جغرافياً، وضمان تشغيل بنسبة ٩٩٫٩٥٪، ودعم فني على مدار الساعة طوال أيام الأسبوع. الموارد وفيرة، مع VCPUs مخصصة، وذاكرة DDR5، وتخزين NVMe عبر اتصال بسرعة تصل إلى ٤٠ Gbps.

Ollama مقابل LM Studio: من يناسبه أيهما

كما ذكرنا سابقاً، كلتا المنصتين فعّالتان جداً ولا تتفوق إحداهما على الأخرى بشكل مطلق، لكن هنا يكمن الفارق: كل منهما تناسب نمط عمل مختلفاً، وهذا هو المعيار الفاصل.

اختر Ollama للأتمتة والتطوير

هدفك عند استخدام Ollama لا يقتصر على التحدث مع نموذج، بل استخدامه مكوناً داخل مشروع أكبر. Ollama مناسب لـ:

- المطورون بناء منتجات كروبوتات المحادثة ونماذج المساعدة الذكية وغيرها من المنتجات التي تعتمد على التعلم العميق

- سير العمل التي تعتمد اعتماداً كبيراً على الأتمتة، كسكريبتات تلخيص التقارير أو توليد المسودات وفق جدول زمني

- الفرق التي تريد إصدارات نماذج ثابتة في أي بيئة

- أي مستخدم يبحث عن نهج يضع API في المقدمة، حتى تتمكن الأدوات الأخرى من الاتصال بالنماذج بشكل منتظم

في النهاية، إن كنت تريد نماذج يمكن الاعتماد عليها في تطبيقاتك، فقد يكون Ollama هو الخيار الأنسب.

LM Studio هو الخيار الأسهل للتعامل مع LLMS المحلية

إن كنت تريد استكشاف إعدادات AI المحلية دون الدخول في تعقيدات تقنية، فـ LM Studio هو الخيار الأمثل بلا شك.

بشكل عام، LM Studio أفضل لـ:

- المبتدئون الذين يخشون التعامل مع الطرفية وسطر الأوامر

- الكتّاب والمبدعون والطلاب الذين يحتاجون إلى واجهة محادثة بسيطة مشابهة لمساعدي AI

- من يجربون خيارات مختلفة، ويريدون مقارنة نماذج متعددة بسرعة لإيجاد ما يناسبهم

- كل من يبدأ للتو في التعامل مع الأوامر النصية ويريد ضبط الإعدادات دون الكتابة اليدوية

باختصار، إن أردت تنزيل LLMs المحلية والبدء فوراً، فـ LM Studio هو ما تحتاجه.

Ollama مقابل LM Studio: التوصية النهائية

بعيداً عن الضجة حول المنافسة بين Ollama وLM Studio، ما يهم فعلاً هو تجربتك اليومية المبنية على سير عملك وحدود أجهزتك.

Ollama بشكل عام:

- مرن ومصمم للمطورين

بينما LM Studio:

- متاح للمبتدئين مع واجهة رسومية مخصصة

كلاهما يحتاج إلى أجهزة قوية ومكلفة للعمل بسلاسة. كثير من الناس لا يملكون ترف تشغيل LLM محلية كبيرة بمفردهم. لذا، إن أردت تشغيل نماذج متقدمة دون الضغط على أجهزتك، فكّر في تجربة Ollama على VPS GPU مخصص. فيما يلي بعض الأسئلة الشائعة حول Ollama مقارنةً بـ LM Studio.