Com a demanda cada vez maior por LLMs locais, muitos usuários ficam confusos ao escolher a mais adequada, mas usá-las não é tão simples quanto parece. Sendo moderadamente exigentes em consumo de recursos, algumas mais que outras, muitos preferem se manter afastados, sem contar as muitas horas que iniciantes podem passar olhando para a linha de comando.

Existem, porém, dois candidatos proeminentes que simplificam bastante. Ollama e LM Studio são duas das plataformas mais usadas com performance de ponta para rodar LLMs locais. Mas escolher entre as duas pode ser difícil, já que cada uma é projetada para fluxos de trabalho diferentes. Sem mais delongas, vamos comparar Ollama vs LM Studio.

Ollama como Ferramenta para Desenvolvedores

No que se refere a executores de LLMs locais, Ollama é uma opção sólida graças aos seus muitos recursos. Não apenas é altamente configurável, como você também pode acessá-lo gratuitamente, já que é uma plataforma open-source apoiada pela comunidade.

Embora Ollama simplifique a execução de LLMs locais, ele é CLI-first (interface de linha de comando), então ainda requer conhecimento de terminal. Ser CLI-first é uma grande vantagem para fluxos de trabalho de desenvolvimento por sua simplicidade. Embora não seja fácil trabalhar com CLI, é menos trabalhoso aprender comparado a rodar LLMs locais por conta própria.

Ollama transforma seu computador pessoal em um mini-servidor local com uma API HTTP, dando a seus apps e scripts acesso aos seus vários modelos, o que significa que ele responde a prompts da mesma forma que um LLM online faria, sem enviar seus dados para a nuvem. Sem mencionar que sua API permite que usuários integrem Ollama e o conectem a websites e chatbots.

Pela sua natureza CLI, Ollama também é bem leve, tornando-o menos exigente em recursos e mais focado em performance. Isso, porém, não significa que você pode rodá-lo em um computador antigo, mas ainda é promissor para usuários que querem aproveitar ao máximo cada recurso disponível e canalizá-lo para o modelo LLM em si.

Com tudo isso dito, você deve ter adivinhado que Ollama é focado em fluxos de trabalho de desenvolvimento, e é verdade. Graças à sua integração fácil, privacidade local e design CLI-first, é uma escolha óbvia se você tem mentalidade de desenvolvedor.

No debate Ollama vs LM Studio, Ollama pode ser mais preferível pela sua abordagem CLI-first. Se uma interface CLI parece muito estranha pra você, continue para uma opção mais leve projetada com facilidade de uso em mente.

LM Studio: Uma Opção Amigável

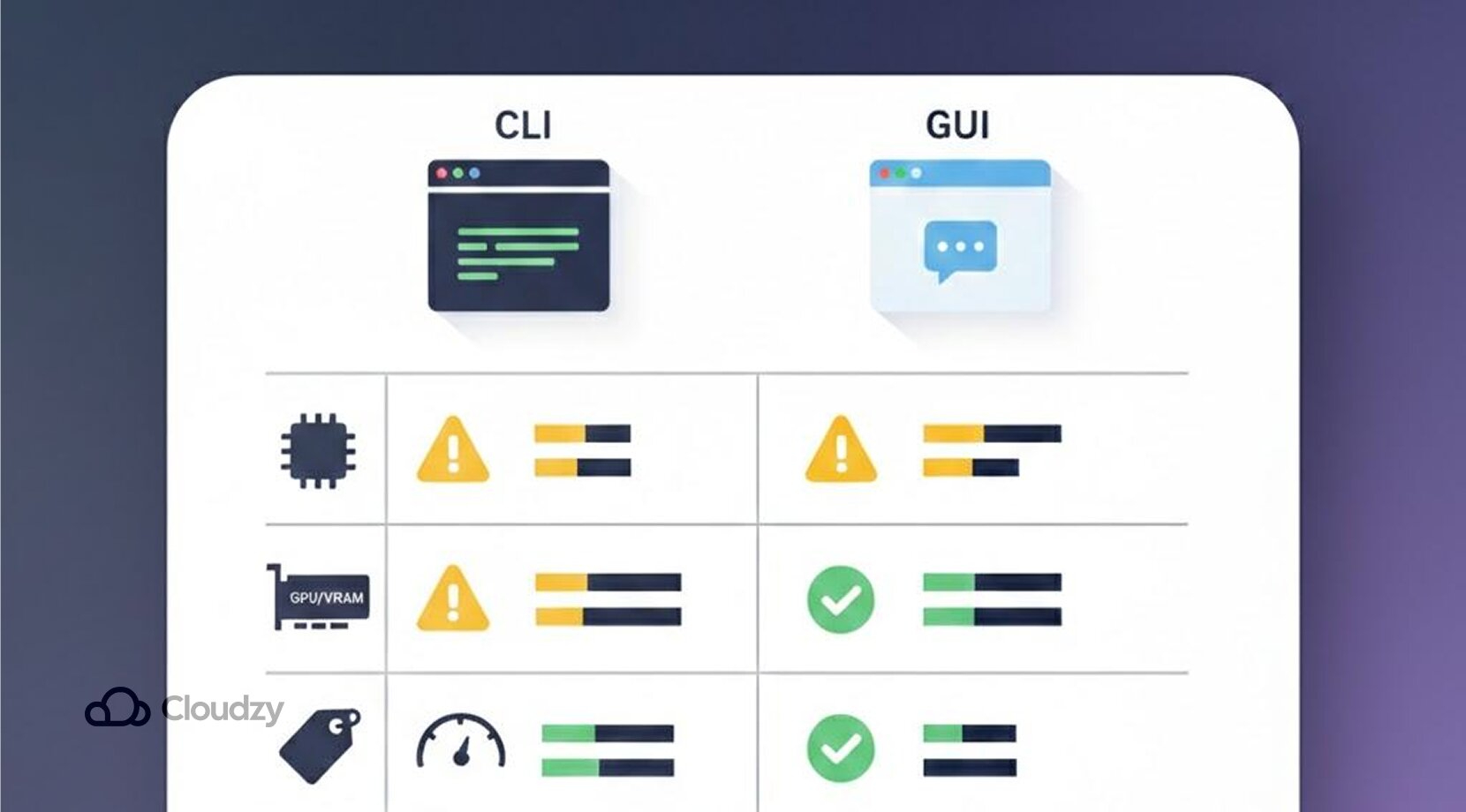

LM Studio contrasta muito com Ollama. Em vez de ser uma interface CLI completa, ele não requer nenhum comando de terminal para funcionar, e como é equipado com GUI (interface gráfica do usuário), parece exatamente como qualquer outro app desktop. Para alguns iniciantes, Ollama vs LM Studio se resume a simplicidade CLI vs GUI.

A abordagem do LM Studio em remover barreiras técnicas funciona bem para criar um espaço simples para qualquer usuário. Em vez de adicionar e rodar modelos com linhas de comando, você pode apenas usar os menus fornecidos e digitar em uma caixa tipo chat. Parece que qualquer um pode usar LM Studio para experimentar LLMs locais, já que parece tão intuitivo quanto ChatGPT.

Ele ainda vem com um navegador de modelos integrado bem legal onde usuários podem descobrir e fazer deploy de qualquer modelo que queiram, desde modelos leves para ações simples até pesados para tarefas mais exigentes. Além disso, este navegador fornece descrições breves dos modelos disponíveis e recomendações de uso, e permite que usuários baixem modelos com um único clique.

Embora a maioria dos modelos seja gratuita para baixar, alguns podem incluir licenças adicionais e direitos de uso. Para certos fluxos de trabalho, LM Studio também oferece um modo de servidor local para integrações fáceis, mas foi projetado principalmente para uma interface de desktop amigável para iniciantes. Dito isso, vamos comparar Ollama e LM Studio lado a lado.

Comparação Ollama vs LM Studio: Observações Importantes

Antes de prosseguir, um ponto crítico precisa ser esclarecido: a comparação "Ollama vs LM Studio" pode sugerir que um é objetivamente melhor que o outro, mas essa não é a história completa. Na verdade, eles foram criados para públicos diferentes. Aqui está um resumo rápido.

| Recurso | Ollama | LM Studio |

| Facilidade de uso | Menos intuitivo no começo, requer conhecimento de terminal | Amigável para iniciantes, mas exige muito clique do mouse |

| Suporte de modelo | Muitos modelos populares em código aberto: gpt-oss, gemma 3, qwen 3 | Exatamente os mesmos que Ollama: gpt-oss, gemma3, qwen3 |

| personalização | Altamente personalizável, integra-se facilmente via API | Menos flexível, ajusta configurações comuns via controles/deslizadores |

| Requisitos de hardware | Depende: modelos maiores são mais lentos sem hardware adequado | Novamente, depende do tamanho do modelo e do seu hardware |

| Privacidade | Privacidade excelente por padrão, sem contato externo com API | Conversas ficam locais, mas o app ainda contata servidores para atualizações e busca/download de modelos. |

| Uso offline | Funciona totalmente offline após baixar os modelos | Também excelente offline após baixar os modelos |

| Plataformas disponíveis | Linux, Windows, macOS | Linux, Windows, macOS |

- Modelos avançados causam gargalo de hardware: Qualquer um preferiria um modelo maior e mais capaz quando possível. Executá-los na maioria dos laptops, porém, causa problemas sérios, pois modelos maiores consomem muito RAM e VRAM. Isso resulta em respostas lentas, contexto limitado, ou o modelo nem carrega.

- Problemas de bateria: Executar LLMs localmente drena rapidamente a bateria sob carga pesada. Isso reduz a vida útil da bateria e ainda provoca barulho irritante dos ventiladores e dissipador.

Ollama vs LM Studio: Baixando Modelos

Outro aspecto na comparação Ollama vs LM Studio é a forma diferente de baixar modelos. Como mencionado, Ollama não instala LLMs locais com um único clique. Em vez disso, você usa seu terminal nativo e linhas de comando. Os comandos, porém, são simples de entender.

Forma rápida de executar modelos no Ollama.

- Baixe seu modelo favorito digitando ollama pull gpt-oss ou qualquer outro modelo que queira (não esqueça de incluir uma tag, que você pode escolher na biblioteca).

Exemplo: ollama pull gpt-oss:20b - Então execute o modelo com o comando ollama run gpt-oss

- Você também pode adicionar outras ferramentas de codificação. Por exemplo, pode adicionar Claude com ollama launch claude

Se terminais e comandos não são o seu forte, experimente o LM Studio. Não precisa digitar nada em nenhum terminal para começar a funcionar e baixar modelos. Basta ir até o seu gerenciador de modelos integrado e procurar por LLMs usando palavras-chave como Llama ou Gemma.

Alternativamente, você pode digitar Hugging Face e URLs completos na barra de pesquisa.

Existe até uma opção para acessar a aba descobrir de qualquer lugar pressionando ⌘ + 2 no Mac, ou Ctrl + 2 em Windows / Linux.

Ollama: Superior em Velocidade

Às vezes, velocidade é tudo que importa para usuários e empresas. Acontece que, comparando Ollama com LM Studio em termos de velocidade, Ollama é mais rápido, embora isso possa variar conforme a configuração e o hardware utilizados.

No caso de um usuário do Reddit no subreddit r/ollama, Ollama processou mais rápido que LM Studio.

Não é uma afirmação sem base, pois o usuário testou tanto Ollama quanto LM Studio executando qwen2.5:1.5b cinco vezes e calculou a média de tokens por segundo.

Ollama vs LM Studio: Desempenho e Requisitos de Hardware

Desempenho é onde a comparação Ollama vs LM Studio fica mais sobre hardware do que sobre a interface. Usar LLMs locais pela primeira vez é definitivamente diferente dos LLMs em nuvem que estamos acostumados. É empoderador ter um LLM só seu, até bater em uma limitação de desempenho.

Considerando que os preços de RAM e VRAM subiram enormemente nos últimos anos, é bastante difícil equipar sua máquina com poder suficiente para executar LLMs grandes.

Modelos Populares Costumam Usar 24-64GB de RAM

Sim, você ouviu direito. Requisitos de hardware não se tratam de quem vence em Ollama vs LM Studio. Se você quer uma experiência tranquila ao executar modelos populares médios ou grandes sem travamentos ou falhas, sua melhor opção é instalar 24-64GB de RAM. Na maioria dos casos, porém, até essa quantidade de RAM se torna irrelevante com contextos mais longos e cargas de trabalho mais pesadas.

Você pode, no entanto, executar modelos menores, frequentemente chamados de modelos quantizados, com 8-16GB de RAM, mas não obtém o mesmo conforto ou desempenho que com os maiores, sem mencionar que ainda haverá alguns compromissos de qualidade e velocidade. Infelizmente, RAM não é o único problema; outros componentes também precisam ser potentes.

GPUs Potentes São Essenciais para Evitar Frustrações

Embora modelos possam rodar em CPUs, sua unidade de processamento gráfico ainda desempenha um papel fundamental para o modelo funcionar bem. Sem uma GPU rápida e bastante VRAM, você terá geração de tokens lenta, atrasos longos para respostas maiores, e tudo rapidamente fica insuportável.

Não alimente esperanças porque nem mesmo a poderosa RTX 5070Ti nem a RTX 5080 é suficiente para aprendizado profundo sério. Isso ocorre porque em algumas configurações com 60k+ contexto, Ollama menciona ~23GB VRAM, muito mais que os típicos 16GB VRAM que essas GPUs oferecem.

Ir além dessa faixa de poder também é astronomicamente caro. Se preço não for uma preocupação sua, ainda há alguns opções de GPU fatores a considerar ao executar LLMs locais.

Neste ponto, você pode estar confuso sobre como montar uma máquina potente o suficiente para executar modelos LLM locais maiores. Este é o momento de virada para muitas pessoas conforme consideram uma solução diferente.

Uma abordagem alternativa que entusiastas consideram é usar máquinas virtuais com hardware robusto e pré-instalado. Usar um VPS (servidor privado virtual), por exemplo, é uma ótima forma de conectar seu laptop doméstico ou outro hardware pessoal a um servidor privado de sua escolha, com todos os pré-requisitos já configurados.

Se usar um VPS parece uma boa solução para você, recomendamos seriamente o Cloudzy Ollama VPS, onde você trabalha em um ambiente limpo. Vem com Ollama pré-instalado, então pode começar a trabalhar com LLMs locais com total privacidade. É acessível com 12 localizações, 99,95% de uptime e suporte 24/7. Recursos abundantes: VCPUs dedicados, memória DDR5 e armazenamento NVMe com conexão de até 40 Gbps.

Ollama vs LM Studio: Qual Você Precisa

Como mencionado, ambas as plataformas são altamente funcionais e nenhuma é superior. Mas há um detalhe: cada uma se adequa a fluxos de trabalho diferentes, então depende do que você precisa.

Escolha Ollama para Automação e Desenvolvimento

Seu objetivo ao usar Ollama não é apenas conversar com um modelo, mas usá-lo como componente dentro de outro projeto. Ollama é ideal para:

- Desenvolvedores construir produtos como chatbots, copilots e outros que exigem aprendizado profundo

- Fluxos de trabalho com muita automação, como scripts de resumo de relatórios ou geração de rascunhos agendados

- Equipes que exigem versões consistentes do modelo em qualquer ambiente

- Qualquer desenvolvedor que queira uma abordagem API-first, para que outras ferramentas possam se conectar aos modelos regularmente

No final, se você quer modelos confiáveis para suas aplicações, Ollama pode ser a melhor opção.

LM Studio é a Opção Mais Acessível para LLMs Locais

Se quer explorar configurações locais de IA sem complicações técnicas, LM Studio é definitivamente a melhor opção.

Em geral, LM Studio é melhor para:

- Iniciantes quem tem medo do terminal e linhas de comando

- Escritores, criadores ou estudantes que precisam de um simples assistente com chat de IA

- Pessoas que experimentam diferentes opções, buscando comparar rapidamente vários modelos para encontrar seu nicho

- Qualquer um que está começando a usar prompts e quer ajustar configurações sem digitar

Em resumo, se quer baixar e começar com LLMs locais, LM Studio atende suas necessidades.

Ollama vs LM Studio: Nossa Recomendação

Se você deixar de lado o hype em torno da competição entre Ollama e LM Studio, o que realmente importa é sua experiência no dia a dia, centrada no seu fluxo de trabalho e nas limitações do seu hardware.

Ollama é, em geral:

- Flexível e focado no desenvolvedor

Enquanto LM Studio é:

- Disponível para iniciantes com uma interface gráfica dedicada

Ambos exigem hardware pesado e caro para funcionar bem. Muitas pessoas não têm o luxo de executar um LLM grande localmente por conta própria. Por isso, se você quer rodar modelos avançados sem sobrecarregar seu hardware, considere testar Ollama em um GPU VPS dedicadoAbaixo estão dúvidas comuns sobre Ollama vs LM Studio.