Machine learning và lĩnh vực con của nó là deep learning đòi hỏi một lượng lớn công suất tính toán mà chỉ GPU mới có thể cung cấp. Tuy nhiên, không phải GPU nào cũng phù hợp, vì vậy đây là những GPU tốt nhất cho machine learning, lý do tại sao chúng cần thiết, và cách bạn có thể chọn GPU phù hợp cho dự án của mình!

Tại Sao Tôi Cần GPU Cho Machine Learning?

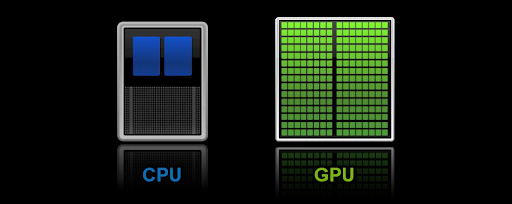

Như đã đề cập, machine learning yêu cầu rất nhiều sức mạnh mà chỉ GPU mới cung cấp, và mặc dù CPU hoạt động tốt cho các ứng dụng quy mô nhỏ hơn, nhưng bất cứ điều gì nặng hơn các tác vụ đơn luồng hoặc tính toán đa dụng sẽ chỉ gây ra sự bực bội và tắc nghẽn. Sự khác biệt đáng kể trong khả năng tính toán xuất phát từ khả năng xử lý song song của GPU và sự chênh lệch lớn về số lượng nhân. Một CPU tiêu biểu có thể có 4 đến 16 nhân, trong khi những GPU tốt nhất cho machine learning có thể có hàng ngàn nhân, đặc biệt là tensor cores, mỗi cái có khả năng xử lý một phần nhỏ của tính toán cùng một lúc.

Xử lý song song này là chìa khóa để xử lý các phép tính ma trận và đại số tuyến tính tốt hơn so với CPU, đó là lý do tại sao GPU lại tốt hơn nhiều cho các tác vụ như huấn luyện các mô hình machine learning lớn. Tuy nhiên, chọn những GPU tốt nhất cho machine learning không phải là dễ dàng.

Cách Chọn GPU Tốt Nhất Cho AI Và Deep Learning

Bây giờ, hầu hết GPU đều đủ mạnh để xử lý các tác vụ thông thường. Tuy nhiên, machine learning và deep learning đòi hỏi một mức độ sức mạnh và chất lượng khác. Vì vậy, câu hỏi vẫn còn là: Điều gì làm cho một GPU tốt cho deep learning?

Một GPU tốt cho deep learning nên có những đặc tính và tính năng sau:

Cuda Cores, Tensor Cores Và Tương Thích

AMD và Nvidia cung cấp những GPU tốt nhất cho machine learning và deep learning, với cái sau vẫn phía trước. Điều này là nhờ vào Tensor cores và CUDA cores của Nvidia. Tensor cores xử lý những phép tính phổ biến trong AI và machine learning, chẳng hạn như phép nhân ma trận và tích chập (được sử dụng trong các mạng thần kinh sâu). CUDA cores, mặt khác, cho phép những GPU tốt nhất cho huấn luyện AI thực hiện xử lý song song bằng cách phân phối hiệu quả các hoạt động trên GPU. GPU không có hai cái này thường gặp khó khăn với các khối lượng công việc ML và deep learning.

Điều đó nói lên rằng, những cập nhật gần đây của AMD đối với nền tảng ROCm và các bộ tăng tốc dòng MI đã cải thiện GPU của nó, và bạn sẽ thấy chúng trong danh sách của chúng tôi. Tuy nhiên, GPU của Nvidia vẫn là những GPU tốt nhất cho deep learning do hệ sinh thái phần mềm được tối ưu hóa tốt và hỗ trợ framework rộng rãi (ví dụ: TensorFlow, PyTorch, JAX). Những GPU tốt nhất cho machine learning nên có khả năng tương thích cao với các framework ML này, vì sự không phù hợp có thể dẫn đến inefficiencies trong tăng tốc, hỗ trợ driver và thư viện (ví dụ: cuDNN của NVIDIA, TensorRT), và khả năng mở rộng bền vững tổng thể.

Bạn cũng có thể không có quyền truy cập đầy đủ vào các công cụ do NVIDIA CUDA cung cấp, chẳng hạn như thư viện hỗ trợ GPU, trình biên dịch C và C++, runtime, cũng như các công cụ tối ưu hóa và gỡ lỗi.

VRAM (Video RAM), Chuẩn Bộ Nhớ Và Băng Thông Bộ Nhớ

Giống như bất kỳ thứ gì liên quan đến máy tính, bộ nhớ rất quan trọng, và điều tương tự cũng áp dụng cho GPU tốt nhất dành cho học máy và deep learning. Vì các tập dữ liệu để huấn luyện các mô hình học máy có thể trở nên cực kỳ lớn (lên tới nhiều TB cho deep learning), GPU tốt nhất cho học máy phải có đủ RAM để truy cập nhanh. Điều này là vì các mô hình deep learning cần bộ nhớ đáng kể để lưu trữ trọng số, kích hoạt và các dữ liệu trung gian khác trong quá trình huấn luyện và suy luận. GPU tốt nhất cho huấn luyện AI cũng nên có băng thông bộ nhớ tốt để bạn có thể di chuyển các tập dữ liệu lớn này và tăng tốc độ tính toán.

Cuối cùng, tiêu chuẩn bộ nhớ là một yếu tố quan trọng khi chọn GPU tốt nhất cho deep learning. GPU thường sử dụng GDDR (Graphics Double Data Rate) hoặc HBM (High Bandwidth Memory). Trong khi bộ nhớ GDDR cung cấp băng thông cao cho các ứng dụng như học máy và chơi game, GPU tốt nhất cho học máy sử dụng HBM có băng thông cao hơn nhiều với hiệu suất tốt hơn.

| Loại GPU | Dung lượng VRAM | Băng thông bộ nhớ | Bộ nhớ Tiêu chuẩn | Tốt nhất cho |

| Cấp độ cơ bản (ví dụ: RTX 3060, RTX 4060) | 8GB – 12GB | ~200-300 GB/s | GDDR6 | Các mô hình nhỏ, phân loại hình ảnh, dự án sở thích |

| Tầm trung (ví dụ: RTX 3090, RTX 4090) | 24GB | ~1.000 GB/s | GDDR6X | Tập dữ liệu lớn, mạng thần kinh sâu, transformer |

| GPU AI cấp cao (ví dụ: H100, H200, A100, L40S MI300X) | 40GB – 80GB | ~1.600+ GB/s | HBM2 | Mô hình ngôn ngữ lớn (LLM), nghiên cứu AI, học máy cấp doanh nghiệp |

| GPU cấp siêu cao (ví dụ: H100, A100, L40S Instinct MI300X) | 80GB – 256GB | ~2,000+ GB/s | HBM3 | Huấn luyện AI quy mô lớn, siêu tính toán, nghiên cứu trên các tập dữ liệu khổng lồ |

Đối với những người làm việc cụ thể trên các mô hình ngôn ngữ lớn như ChatGPT, Cloudzy cung cấp GPU được tối ưu hóa cho ChatGPT giải pháp với sức mạnh cần thiết để fine-tuning và suy luận mượt mà.

TFLOPS (Teraflops) Và Độ Chính Xác Floating Point

Tất nhiên, hiệu suất GPU được đo bằng sức mạnh xử lý của nó. Điều này phụ thuộc vào ba yếu tố: TFLOPS, Băng thông bộ nhớ và Độ chính xác dấu phẩy động. Chúng ta đã thảo luận về băng thông bộ nhớ khi chọn GPU tốt nhất cho huấn luyện AI; dưới đây là ý nghĩa của mỗi yếu tố còn lại và tại sao nó quan trọng. TFLOPS, hay Teraflops, là đơn vị đo tốc độ GPU xử lý các tính toán phức tạp. Vì vậy, thay vì đo tốc độ xung nhịp của bộ xử lý (bao nhiêu chu kỳ một bộ xử lý hoàn thành trong một giây), TFLOPS đo bao nhiêu tỷ phép toán dấu phẩy động một GPU có thể thực hiện trên giây. Nói cách đơn giản, TFLOPS cho bạn biết GPU mạnh mẽ đến mức nào trong việc xử lý các tác vụ nặng toán học.

Tuy nhiên, Độ chính xác dấu phẩy động, như tên gọi của nó, cho thấy mức độ chính xác mà GPU sẽ cho phép mô hình duy trì. GPU tốt nhất cho deep learning sử dụng độ chính xác cao hơn (ví dụ: FP32), cung cấp các tính toán chính xác hơn nhưng với chi phí hiệu suất. Độ chính xác thấp hơn (ví dụ: FP16) tăng tốc độ xử lý với độ chính xác giảm nhẹ, điều này thường được chấp nhận cho các tác vụ AI và deep learning.

Bắt Đầu Viết Blog

Bắt Đầu Viết Blog

Tự host WordPress của bạn trên phần cứng hạng nhất, với lưu trữ NVMe và độ trễ tối thiểu trên toàn thế giới, chọn distro yêu thích của bạn.

Nhận WordPress VPS| Độ chính xác | Trường hợp sử dụng | Ứng Dụng Ví Dụ |

| FP32 (Độ chính xác đơn) | Huấn luyện mô hình deep learning | Nhận dạng hình ảnh (ResNet, VGG) |

| TF32 (TensorFloat-32) | Huấn luyện độ chính xác hỗn hợp | NLP, hệ thống đề xuất |

| FP16 (Nửa Độ Chính Xác) | Suy diễn nhanh | Lái xe tự động, nhận dạng giọng nói, cải thiện video AI |

Thay vì đầu tư nặng vào phần cứng vật lý, bạn có thể truy cập ngay lập tức Dịch vụ GPU Deep Learning của Cloudzy, được cung cấp bởi GPU RTX 4090, được tối ưu hóa cho các khối lượng công việc học máy và deep learning.

GPU Tốt Nhất Cho Machine Learning Năm 2025

Bây giờ bạn đã có ý tưởng rõ ràng về những gì GPU tốt nhất cho machine learning cần có, đây là danh sách GPU tốt nhất của chúng tôi được xếp hạng theo hiệu suất, băng thông bộ nhớ, công suất tính toán, v.v.

| GPU | VRAM | Băng thông bộ nhớ | Bộ nhớ Tiêu chuẩn | TFLOPS | Độ chính xác dấu phẩy động | Khả năng tương thích |

| NVIDIA H100 NVL | 188 GB | 7.8 TB/s | HBM3 | 3,958 | FP64, FP32, FP16 | CUDA, TensorFlow |

| NVIDIA H100 Tensor Core | 80 GB | 2 TB/s | HBM2 | 1,979 | FP64, FP32, FP16 | CUDA, cuDNN, TensorRT |

| NVIDIA RTX 4090 | 24 GB | 1.008 TB/s | GDDR6X | 82.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA A100 Tensor Core | 48 GB | 768 GB/s | GDDR6 | 40 | FP64, FP32, FP16 | CUDA, cuDNN, TensorRT |

| NVIDIA GeForce RTX 4070 | 12 GB | 504 GB/s | GDDR6X | 35.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX 3090 Ti | 24 GB | 1.008 TB/s | GDDR6X | 40 | FP64, FP32, FP16 | CUDA, cuDNN, TensorRT |

| AMD Radeon Instinct MI300 | 128 GB | 1.6 TB/s | HBM3 | 60 | FP64, FP32, FP16 | ROCm, TensorFlow |

NVIDIA H100 NVL

GPU machine learning tốt nhất, H100 NVL, mang lại hiệu suất ngoài xứ cho deep learning quy mô lớn, tối ưu hóa cho các khối lượng công việc đa người dùng và hiệu suất cao.

- Tốt nhất cho: Nghiên cứu AI tiên tiến, huấn luyện mô hình quy mô lớn và suy luận.

- Nhược điểm: Giá cực kỳ cao và chủ yếu phù hợp với môi trường cấp doanh nghiệp hoặc nghiên cứu.

NVIDIA A100 Tensor Core GPU

H100 cung cấp hiệu suất khổng lồ cho mạng nơ-ron với 80 GB bộ nhớ băng thông cao (HBM2), phù hợp cho các khối lượng công việc nặng.

- Tốt nhất cho: Các mô hình machine learning quy mô lớn, nghiên cứu AI và các ứng dụng dựa trên cloud.

- Nhược điểm: Giá cao, chủ yếu hướng tới các doanh nghiệp.

NVIDIA RTX 4090

Xuất sắc cho cả gaming và khối lượng công việc AI, với 24 GB bộ nhớ GDDR6X và khả năng tính toán song song lớn.

- Tốt nhất cho: Các tác vụ ML cấp cao và nghiên cứu AI yêu cầu sức mạnh tính toán cực đại.

- Nhược điểm: Tiêu thụ điện năng cao, chi phí cao và kích thước lớn.

NVIDIA RTX A6000 Lõi Tensor GPU

Hỗ trợ các ứng dụng AI với 48 GB bộ nhớ GDDR6, phù hợp cho các máy trạm và những người sáng tạo chuyên nghiệp.

- Tốt nhất cho: Nghiên cứu AI, deep learning và các khối lượng công việc hiệu suất cao.

- Nhược điểm: Chi phí cao, thường phù hợp cho các môi trường chuyên nghiệp.

NVIDIA GeForce RTX 4070

Cân bằng tốt giữa giá và hiệu suất với khả năng ray-tracing mạnh mẽ, sở hữu 12 GB bộ nhớ GDDR6X.

- Tốt nhất cho: Những người đam mê và các công ty nhỏ hơn có nhu cầu machine learning ở mức trung bình.

- Nhược điểm: Công suất tính toán hạn chế cho các tập dữ liệu lớn hơn và các mô hình rất lớn.

NVIDIA RTX 3090 Ti

NVIDIA RTX 3090 Ti - Dung lượng bộ nhớ lớn (24 GB GDDR6X) và sức mạnh tính toán mạnh mẽ, phù hợp để huấn luyện các mô hình vừa đến lớn.

- Tốt nhất cho: Dành cho những người đam mê và các ứng dụng nghiên cứu cần xử lý AI mạnh mẽ.

- Nhược điểm: Giá thành cao, tiêu thụ nhiều điện năng, và có thể quá sức cho các dự án nhỏ hơn.

AMD Radeon Instinct MI300

Tuyệt vời cho khối lượng công việc AI và HPC, với hiệu suất cạnh tranh.

- Tốt nhất cho: Khối lượng công việc học máy trên các thiết lập tập trung vào AMD.

- Nhược điểm: Chưa được công nhận rộng rãi trong học sâu so với NVIDIA, hỗ trợ ít framework hơn.

Cloud GPU VPS Của Cloudzy

Một trong những GPU tốt nhất cho học máy hiện nay chắc chắn là H100; tuy nhiên, nó rất đắt, sẽ làm tăng hóa đơn điện của bạn, và kích thước của nó có thể buộc bạn phải nâng cấp lên case máy tính lớn hơn hoặc sửa đổi tất cả các bộ phận. Nó rất phiền toái, đó là lý do tại sao chúng tôi tại Cloudzy giờ đây cung cấp GPU trên đám mây cho học máy để bạn không phải lo lắng về bất kỳ vấn đề nào trong số đó. Các máy chủ của chúng tôi GPU VPS được trang bị tối đa 2 GPU H100, lưu trữ NVMe 4 TB, băng thông 25 TB mỗi giây, và 48 vCPU!

Tất cả với giá cả hợp lý, hỗ trợ thanh toán theo giờ hoặc theo tháng với nhiều hình thức thanh toán như PayPal, Alipay, Thẻ tín dụng (qua Stripe), PerfectMoney, Bitcoin và các loại tiền điện tử khác.

Cuối cùng, trong trường hợp xấu nhất, nếu bạn không hài lòng với dịch vụ của chúng tôi, chúng tôi cung cấp bảo đảm hoàn tiền trong 14 ngày!

Các nền tảng Thực tế Tăng cường (AR) trên đám mây phụ thuộc rất nhiều vào GPU hiệu suất cao để cung cấp các trải nghiệm thực tế, tức thì. Giống như GPU có CUDA và Tensor cores là điều cần thiết để huấn luyện các mô hình học sâu, chúng cũng rất quan trọng để hiển thị các môi trường AR phức tạp và hỗ trợ các tính năng do AI điều khiển như nhận dạng vật thể và lập bản đồ không gian. Tại Cloudzy, các máy chủ của chúng tôi AR Cloud sử dụng công nghệ GPU tiên tiến để đảm bảo hiệu suất ổn định, độ trễ thấp, và khả năng mở rộng, giúp các doanh nghiệp triển khai ứng dụng AR quy mô lớn.

Cho dù bạn đang xây dựng ứng dụng AI, huấn luyện mô hình, hay tiến hành nghiên cứu, các máy chủ của chúng tôi Giải pháp AI VPS được thiết kế để cung cấp hiệu suất GPU tốt nhất với giá chỉ bằng một phần của chi phí thông thường.

Suy nghĩ cuối cùng

Với nhu cầu sức mạnh tính toán ngày càng tăng và các mô hình AI ngày càng lớn và phức tạp, GPU chắc chắn sẽ trở thành một phần không thể thiếu trong cuộc sống của chúng ta. Vì vậy, điều tốt nhất là tìm hiểu thêm về chúng và hiểu cách chúng hoạt động cũng như tính chất của chúng.

Đó là lý do tại sao tôi khuyên bạn nên xem Tim Dettmersbài viết về tất cả những gì bạn cần biết về GPU và một số lời khuyên thực tế khi chọn GPU. Ông ấy vừa được vinh danh trong học thuật vừa am hiểu sâu sắc về học sâu.