El machine learning y su subcategoría, el deep learning, exigen una gran capacidad de cómputo que solo las GPU pueden ofrecer. Pero no cualquier GPU sirve: aquí encontrarás las mejores GPU para machine learning, por qué son necesarias y cómo elegir la adecuada para tu proyecto.

¿Por qué necesito una GPU para machine learning?

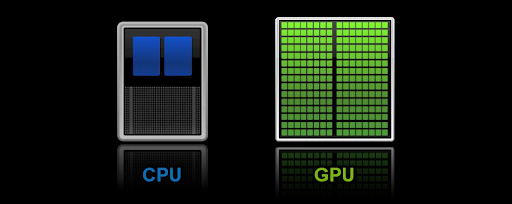

Como se mencionó antes, el machine learning requiere una potencia de cómputo que solo las GPU pueden proporcionar. Las CPU funcionan bien para aplicaciones de pequeña escala, pero cualquier tarea más exigente que el cómputo de propósito general o monohilo solo generará cuellos de botella y frustraciones. La diferencia fundamental está en la capacidad de procesamiento paralelo de las GPU y en su número de núcleos. Una CPU típica tiene entre 4 y 16 núcleos, mientras que las mejores GPU para machine learning pueden tener miles, especialmente tensor cores, cada uno capaz de procesar una parte del cálculo al mismo tiempo.

Este procesamiento paralelo es clave para gestionar cálculos matriciales y de álgebra lineal con mucha más eficiencia que las CPU, y por eso las GPU son mucho más adecuadas para tareas como el entrenamiento de modelos de machine learning a gran escala. Aun así, elegir las mejores GPU para machine learning no es sencillo.

Cómo elegir la mejor GPU para AI y deep learning

La mayoría de las GPU tienen potencia suficiente para tareas habituales, pero el machine learning y el deep learning exigen otro nivel. La pregunta que queda es: ¿qué hace que una GPU sea buena para deep learning?

Una buena GPU para deep learning debe reunir las siguientes características:

Cuda Cores, Tensor Cores y compatibilidad

AMD y Nvidia ofrecen las mejores GPU para machine learning y deep learning, con Nvidia claramente por delante. Esto se debe a los Tensor Cores y CUDA Cores de Nvidia. Los Tensor Cores se encargan de los cálculos más habituales en AI y machine learning, como multiplicaciones de matrices y convoluciones (presentes en redes neuronales profundas). Los CUDA Cores, por su parte, permiten que las mejores GPU para entrenamiento de AI realicen procesamiento paralelo distribuyendo las operaciones de forma eficiente por toda la GPU. Las GPU que carecen de estos dos tipos de núcleos suelen tener dificultades con cargas de trabajo de ML y deep learning.

Dicho esto, las mejoras recientes de AMD en la plataforma ROCm y en sus aceleradores de la serie MI han reforzado sus GPU, y algunas aparecerán en nuestra lista. Sin embargo, las GPU de Nvidia siguen siendo las mejores para deep learning gracias a su ecosistema de software bien optimizado y al amplio soporte de frameworks (por ejemplo, TensorFlow, PyTorch, JAX). Las mejores GPU para machine learning deben tener alta compatibilidad con estos frameworks de ML, ya que una incompatibilidad puede provocar ineficiencias en la aceleración, en el soporte de drivers y bibliotecas (como cuDNN y TensorRT de NVIDIA) y en la viabilidad a largo plazo.

Además, es posible que no tengas acceso completo a las herramientas del kit de NVIDIA CUDA, como las bibliotecas aceleradas por GPU, el compilador y el entorno de ejecución de C y C++, y las herramientas de optimización y depuración.

VRAM (Video RAM), estándar de memoria y ancho de banda de memoria

Como en cualquier ámbito relacionado con la informática, RAM es un factor clave, y lo mismo aplica a las mejores GPU para machine learning y DL. Dado que los conjuntos de datos para entrenar modelos de machine learning pueden volverse extremadamente grandes (varios TB en el caso del deep learning), las mejores GPU para machine learning deben contar con suficiente VRAM para un acceso rápido. Los modelos de deep learning necesitan memoria considerable para almacenar pesos, activaciones y otros datos intermedios durante el entrenamiento y la inferencia. La mejor GPU para entrenamiento de IA también debe tener un ancho de banda de memoria adecuado para mover estos grandes conjuntos de datos y acelerar los cálculos.

Por último, el estándar de memoria es un factor importante al elegir las mejores GPU para deep learning. Las GPU suelen usar memoria GDDR (Graphics Double Data Rate) o HBM (High Bandwidth Memory). Aunque las memorias GDDR ofrecen alto ancho de banda para tareas como machine learning y gaming, las mejores GPU para machine learning utilizan HBM, que ofrece un ancho de banda mucho mayor con mejor eficiencia.

| Tipo de GPU | Capacidad de VRAM | Ancho de banda de memoria | Estándar de memoria | Ideal para |

| Gama de entrada (p. ej., RTX 3060, RTX 4060) | 8GB – 12GB | ~200-300 GB/s | GDDR6 | Modelos pequeños, clasificación de imágenes, proyectos personales |

| Gama media (p. ej., RTX 3090, RTX 4090) | 24GB | ~1.000 GB/s | GDDR6X | Conjuntos de datos grandes, redes neuronales profundas, transformers |

| GPU de gama alta para IA (p. ej., Nvidia A100, H100, AMD MI300X) | 40GB – 80GB | ~1.600+ GB/s | HBM2 | Modelos de lenguaje de gran escala (LLM), investigación en IA, ML a nivel empresarial |

| GPU de gama muy alta (p. ej., Nvidia H100, AMD Instinct MI300X) | 80GB – 256GB | ~2.000+ GB/s | HBM3 | Entrenamiento de IA a gran escala, supercomputación, investigación con conjuntos de datos masivos |

Para quienes trabajan específicamente con modelos de lenguaje de gran escala como ChatGPT, Cloudzy ofrece una VPS GPU optimizada para ChatGPT solución con la potencia necesaria para un fine-tuning e inferencia sin problemas.

TFLOPS (Teraflops) y precisión de punto flotante

El rendimiento de una GPU se mide por su capacidad de procesamiento, que depende de tres factores: TFLOPS, ancho de banda de memoria y precisión de punto flotante. Ya hablamos del ancho de banda de memoria en el artículo sobre las mejores GPU para entrenamiento de IA; aquí explicamos qué significan los otros dos y por qué importan. Los TFLOPS, o teraflops, miden la velocidad a la que una GPU realiza cálculos complejos. En lugar de medir la velocidad de reloj de un procesador (los ciclos que completa por segundo), los TFLOPS indican cuántos billones de operaciones de punto flotante puede ejecutar una GPU por segundo. En pocas palabras: los TFLOPS dicen qué tan potente es una GPU para tareas con cálculos intensivos.

La precisión de punto flotante, como su nombre indica, determina el nivel de exactitud que la GPU permite mantener al modelo. Las mejores GPU para deep learning usan mayor precisión (por ejemplo, FP32), lo que ofrece cálculos más exactos a costa de algo de rendimiento. La menor precisión (por ejemplo, FP16) acelera el procesamiento con una ligera reducción de exactitud, lo cual suele ser aceptable para tareas de IA y deep learning.

Empieza a publicar

Empieza a publicar

Aloja tu propio WordPress en hardware de alto rendimiento, con almacenamiento NVMe y baja latencia en todo el mundo. Elige tu distribución favorita.

Obtén WordPress VPS| Precisión | Caso de uso | Aplicaciones de ejemplo |

| FP32 (precisión simple) | Entrenamiento de modelos de deep learning | Reconocimiento de imágenes (ResNet, VGG) |

| TF32 (TensorFloat-32) | Entrenamiento de precisión mixta | NLP, sistemas de recomendación |

| FP16 (media precisión) | Inferencia rápida | Conducción autónoma, reconocimiento de voz, mejora de vídeo con IA |

En lugar de invertir fuertemente en hardware físico, puedes acceder al instante a VPS de Deep Learning GPU de Cloudzy, impulsada por RTX 4090, optimizada para cargas de trabajo de machine learning y deep learning.

Las mejores GPU para machine learning en 2025

Ahora que tienes claro qué deben ofrecer las mejores GPU para machine learning, aquí tienes nuestra lista de las mejores GPU clasificadas por TOPS, ancho de banda de memoria, VRAM y más.

| GPU | VRAM | Ancho de banda de memoria | Estándar de memoria | TFLOPS | Precisión de punto flotante | Compatibilidad |

| NVIDIA H100 NVL | 188 GB | 7.8 TB/s | HBM3 | 3,958 | FP64, FP32, FP16 | CUDA, TensorFlow |

| NVIDIA Núcleo Tensor A100 | 80 GB | 2 TB/s | HBM2 | 1,979 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| NVIDIA RTX 4090 | 24 GB | 1.008 TB/s | GDDR6X | 82.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX A6000 Núcleo Tensor | 48 GB | 768 GB/s | GDDR6 | 40 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| NVIDIA GeForce RTX 4070 | 12 GB | 504 GB/s | GDDR6X | 35.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX 3090 Ti | 24 GB | 1.008 TB/s | GDDR6X | 40 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| AMD Radeon Instinct MI300 | 128 GB | 1.6 TB/s | HBM3 | 60 | FP64, FP32, FP16 | ROCm, TensorFlow |

NVIDIA H100 NVL

El mejor GPU para machine learning, el H100 NVL ofrece un rendimiento excepcional para deep learning a gran escala, optimizado para cargas de trabajo de alto rendimiento en entornos multi-tenant.

- Ideal para: Investigación avanzada en IA, entrenamiento de modelos a gran escala e inferencia.

- Desventaja: Precio muy elevado, orientado principalmente a entornos de investigación o empresarial.

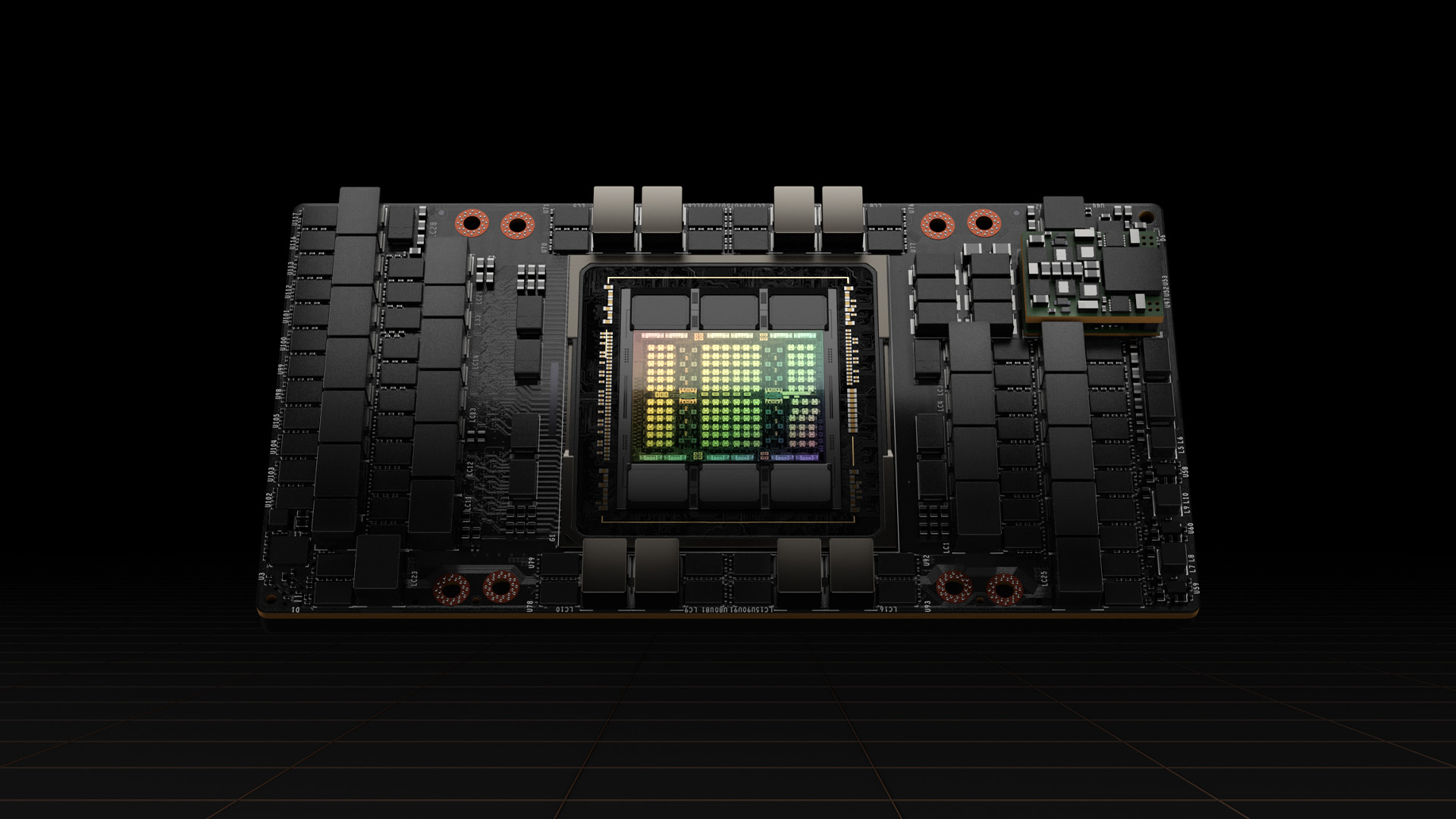

NVIDIA A100 GPU de núcleos tensoriales

La A100 ofrece un rendimiento enorme para redes neuronales, con 80 GB de memoria de alto ancho de banda (HBM2), adecuada para cargas de trabajo intensivas.

- Ideal para: Modelos de machine learning a gran escala, investigación en IA y aplicaciones en la nube.

- Desventaja: Precio alto, orientada principalmente a empresas.

NVIDIA RTX 4090

Excelente tanto para gaming como para cargas de trabajo de IA, con 24 GB de memoria GDDR6X y una gran capacidad de cómputo paralelo.

- Ideal para: Tareas avanzadas de ML e investigación en IA que requieren gran potencia computacional.

- Desventaja: Alto consumo energético, coste elevado y tamaño considerable.

NVIDIA RTX A6000 GPU de núcleos tensores

Compatible con aplicaciones de IA gracias a sus 48 GB de memoria GDDR6, ideal para estaciones de trabajo y creadores profesionales.

- Ideal para: Investigación en IA, deep learning y cargas de trabajo de alto rendimiento.

- Desventaja: Precio alto, orientada a entornos profesionales.

NVIDIA GeForce RTX 4070

Gouilibrio sólido entre precio y rendimiento, con gran capacidad de ray tracing y 12 GB de memoria GDDR6X

- Ideal para: Entusiastas y pequeñas empresas con necesidades de aprendizaje automático de nivel medio.

- Desventaja: VRAM limitado para conjuntos de datos grandes y modelos muy grandes.

NVIDIA RTX 3090 Ti

NVIDIA RTX 3090 TiGran capacidad de memoria (24 GB GDDR6X) y potencia de cómputo, ideal para entrenar modelos de tamaño mediano a grande.

- Ideal para: Entusiastas y proyectos de investigación que requieren un procesamiento de IA potente.

- Desventaja: Muy costosa, consume mucha energía y puede ser excesiva para proyectos pequeños.

AMD Radeon Instinct MI300

Excelente para cargas de trabajo de IA y HPC, con un rendimiento competitivo.

- Ideal para: Cargas de trabajo de aprendizaje automático en configuraciones centradas en AMD.

- Desventaja: Menos consolidada en deep learning comparada con NVIDIA, con soporte para menos frameworks.

Cloud GPU VPS de Cloudzy

Sin duda, una de las mejores GPU para aprendizaje automático disponibles hoy en día es la RTX 4090; sin embargo, tiene un precio elevado, disparará tu factura eléctrica y su tamaño puede obligarte a cambiar a una caja de ordenador más grande o modificar todos tus componentes. Es un verdadero quebradero de cabeza, y por eso en Cloudzy ofrecemos ahora una GPU en línea para aprendizaje automático, para que no tengas que preocuparte por nada de eso. Nuestra VPS GPU está equipada con hasta 2 GPU RTX 4090 Nvidia, 4 TB de almacenamiento SSD NVMe, 25 TB por segundo de ancho de banda y 48 vCPU.

Todo a precios asequibles, con facturación por horas y mensual de pago por uso, y una amplia variedad de opciones de pago como PayPal, Alipay, tarjetas de crédito (a través de Stripe), PerfectMoney, Bitcoin y otras criptomonedas.

Por último, en el peor de los casos, si no estás satisfecho con nuestro servicio, ofrecemos una garantía de devolución de dinero de 14 días.

Las plataformas cloud de Realidad Aumentada (AR) dependen en gran medida de GPU de alto rendimiento para ofrecer experiencias inmersivas en tiempo real. Al igual que las GPU con núcleos CUDA y Tensor son fundamentales para entrenar modelos de deep learning, también lo son para renderizar entornos AR complejos y dar soporte a funciones basadas en IA como el reconocimiento de objetos y el mapeo espacial. En Cloudzy, nuestras soluciones de AR Cloud utilizan tecnología GPU avanzada para garantizar un rendimiento fluido, baja latencia y capacidad de crecimiento, lo que las hace ideales para empresas que quieren desplegar aplicaciones AR a gran escala.

Tanto si estás desarrollando aplicaciones de IA, entrenando modelos o llevando a cabo investigaciones, nuestras soluciones VPS de IA están diseñadas para ofrecer el mejor rendimiento de GPU a una fracción del coste habitual.

Conclusiones

A medida que la demanda de potencia de cómputo crece y los modelos de IA se vuelven más grandes y complejos, las GPU serán sin duda una parte integral de nuestras vidas. Por eso conviene informarse sobre ellas y entender cómo funcionan y qué son.

Por eso te recomiendo que consultes Tim Dettmers' artículo sobre todo lo que hay que saber sobre GPUs y algunos consejos prácticos para elegir una GPU. Tiene una sólida trayectoria académica y un profundo conocimiento del aprendizaje profundo.