Il machine learning e la sua sottocategoria, il deep learning, richiedono una potenza di calcolo notevole che può essere fornita solo da GPU. Tuttavia, non qualsiasi GPU andrà bene, quindi ecco i migliori GPU per il machine learning, perché sono necessari, e come scegliere quello giusto per il tuo progetto.

Perché ho bisogno di un GPU per il machine learning?

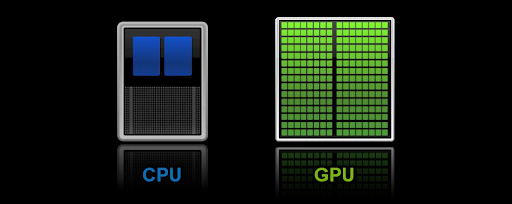

Come accennato in precedenza, il machine learning richiede molta potenza che solo GPU possono fornire. Mentre CPU funzionano perfettamente per applicazioni su scala ridotta, qualsiasi cosa più pesante di attività single-threaded o calcoli general-purpose causa solo frustrazioni e colli di bottiglia. La differenza significativa nella potenza computazionale dipende dalla capacità di elaborazione parallela di GPU e dalla grande differenza nel numero di core. Un tipico CPU potrebbe avere da 4 a 16 core, mentre i migliori GPU per il machine learning potrebbero averne migliaia, soprattutto tensor core, ognuno in grado di gestire una piccola parte del calcolo simultaneamente.

Questa elaborazione parallela è la chiave per gestire i calcoli matriciali e di algebra lineare molto meglio di quanto facciano CPU, ecco perché GPU sono molto superiori per compiti come l'addestramento di grandi modelli di machine learning. Tuttavia, scegliere i migliori GPU per il machine learning non è facile.

Come scegliere il miglior GPU per AI e deep learning

Ora, la maggior parte di GPU sono sufficientemente potenti per gestire compiti tipici. Però il machine learning e il deep learning richiedono un livello di potenza e qualità diverso. Quindi la domanda rimane: cosa rende un buon GPU per il deep learning?

Un buon GPU per il deep learning dovrebbe avere le seguenti qualità e caratteristiche:

Cuda Cores, Tensor Cores e compatibilità

AMD e Nvidia offrono i migliori GPU per il machine learning e il deep learning, con quest'ultimo decisamente in vantaggio. Questo grazie ai Tensor core e CUDA core di Nvidia. I Tensor core gestiscono i calcoli comuni in AI e machine learning, come moltiplicazioni matriciali e convoluzioni (usate nelle reti neurali profonde). I CUDA core, d'altra parte, permettono ai migliori GPU per l'addestramento di AI di eseguire elaborazione parallela distribuendo efficientemente le operazioni tra GPU. GPU senza questi due tipicamente faticano con i carichi di lavoro ML e deep learning.

Detto questo, i recenti miglioramenti di AMD alla piattaforma ROCm e agli acceleratori MI-series hanno migliorato i suoi GPU, e li vedrai nella nostra lista. Tuttavia, GPU di Nvidia rimangono comunque i migliori per il deep learning grazie al loro ecosistema software ben ottimizzato e al supporto diffuso dei framework (es. TensorFlow, PyTorch, JAX). I migliori GPU per il machine learning dovrebbero avere alta compatibilità con questi framework ML, perché una mancata corrispondenza può portare a inefficienze nell'accelerazione, nel supporto di driver e librerie (es. cuDNN di NVIDIA, TensorRT), e nella scalabilità complessiva futura.

Potresti anche non avere accesso completo agli strumenti forniti dal toolkit NVIDIA CUDA, come le librerie accelerate GPU, un compilatore e runtime C e C++, e strumenti di ottimizzazione e debug.

VRAM (Video RAM), standard di memoria e larghezza di banda della memoria

Come per qualsiasi aspetto legato all'informatica, RAM è importante, e lo stesso vale per i migliori GPU per machine learning e deep learning. Dal momento che i dataset per l'addestramento dei modelli di machine learning possono diventare estremamente grandi (fino a diversi TB per il deep learning), i migliori GPU per machine learning dovrebbero avere una buona quantità di VRAM per un accesso rapido. Questo perché i modelli di deep learning richiedono una memoria significativa per memorizzare i pesi, le attivazioni e altri dati intermedi durante l'addestramento e l'inferenza. I migliori GPU per l'addestramento di AI dovrebbero anche avere una larghezza di banda della memoria decente in modo che tu possa gestire questi grandi dataset e accelerare i calcoli.

Infine, lo standard di memoria è un fattore importante quando si sceglie il miglior GPU per il deep learning. I GPU utilizzano tipicamente memoria GDDR (Graphics Double Data Rate) o HBM (High Bandwidth Memory). Mentre le memorie GDDR offrono un'elevata larghezza di banda per applicazioni come il machine learning e i videogiochi, i migliori GPU per machine learning utilizzano HBM che hanno una larghezza di banda molto più elevata con una migliore efficienza.

| Tipo GPU | Capacità VRAM | Larghezza di banda della memoria | Memoria Standard | Migliore per |

| Livello base (ad esempio RTX 3060, RTX 4060) | 8GB – 12GB | ~200-300 GB/s | GDDR6 | Modelli piccoli, classificazione di immagini, progetti amatoriali |

| Fascia media (ad esempio RTX 3090, RTX 4090) | 24GB | ~1.000 GB/s | GDDR6X | Dataset grandi, reti neurali profonde, transformer |

| GPU AI ad alte prestazioni (ad esempio Nvidia A100, H100, AMD MI300X) | 40GB – 80GB | ~1.600+ GB/s | HBM2 | Modelli linguistici di grandi dimensioni (LLM), ricerca AI, machine learning a livello aziendale |

| GPU super ad alte prestazioni (ad esempio Nvidia H100, AMD Instinct MI300X) | 80GB – 256GB | ~2.000+ GB/s | HBM3 | Addestramento AI su larga scala, supercomputing, ricerca su dataset massivi |

Per chi lavora specificamente su modelli linguistici di grandi dimensioni come ChatGPT, Cloudzy offre un VPS ottimizzato per ChatGPT soluzione con la potenza necessaria per un fine-tuning e un'inferenza fluidi.

TFLOPS (Teraflops) e precisione in virgola mobile

Naturalmente, le prestazioni di GPU si misurano dalla sua potenza di elaborazione. Questo dipende da tre fattori: TFLOPS, larghezza di banda della memoria e precisione in virgola mobile. Abbiamo già discusso della larghezza di banda della memoria nel miglior GPU per l'addestramento AI; ecco cosa significano gli altri due e perché sono importanti. TFLOPS, o Teraflops, è l'unità che misura la velocità con cui un GPU gestisce calcoli complessi. Quindi, piuttosto che misurare la velocità di clock del processore (quanti cicli un processore completa al secondo), TFLOPS misura quante trilioni di operazioni in virgola mobile un GPU può eseguire al secondo. In parole semplici, TFLOPS ti dice quanto è potente un GPU nel gestire compiti che richiedono molti calcoli matematici.

Tuttavia, la precisione in virgola mobile, come suggerisce il nome, mostra il livello di accuratezza che GPU permetterà al modello di mantenere. I migliori GPU per il deep learning utilizzano una precisione più alta (ad esempio FP32), che fornisce calcoli più accurati ma a un costo prestazionale. Una precisione inferiore (ad esempio FP16) accelera l'elaborazione con una precisione leggermente ridotta, il che è spesso accettabile per compiti di AI e deep learning.

Inizia a Bloggare

Inizia a Bloggare

Ospita WordPress su hardware di fascia alta, con archiviazione NVMe e latenza minima in tutto il mondo, scegli la tua distro preferita.

Ottieni WordPress VPS| Precisione | Caso d'uso | Applicazioni di Esempio |

| FP32 (Precisione singola) | Addestramento di modelli di deep learning | Riconoscimento di immagini (ResNet, VGG) |

| TF32 (TensorFloat-32) | Addestramento con precisione mista | NLP, sistemi di raccomandazione |

| FP16 (Mezza Precisione) | Inferenza veloce | Guida autonoma, riconoscimento vocale, miglioramento di video con AI |

Invece di investire pesantemente in hardware fisico, puoi accedere istantaneamente a VPS Deep Learning GPU di Cloudzy, alimentato da RTX 4090, ottimizzato per carichi di lavoro di machine learning e deep learning.

Migliori GPU per il machine learning nel 2025

Ora che hai una buona comprensione di cosa dovrebbe avere la migliore GPU per machine learning, ecco la nostra lista delle migliori GPU classificate per prestazioni, larghezza di banda memoria, memoria, ecc.

| GPU | VRAM | Larghezza di banda della memoria | Memoria Standard | TFLOPS | Precisione in virgola mobile | Compatibilità |

| NVIDIA H100 NVL | 188 GB | 7.8 TB/s | HBM3 | 3,958 | FP64, FP32, FP16 | CUDA, TensorFlow |

| NVIDIA A100 Nucleo Tensor | 80 GB | 2 TB/s | HBM2 | 1,979 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| NVIDIA RTX 4090 | 24 GB | 1.008 TB/s | GDDR6X | 82.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX A6000 Tensor Core | 48 GB | 768 GB/s | GDDR6 | 40 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| NVIDIA GeForce RTX 4070 | 12 GB | 504 GB/s | GDDR6X | 35.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX 3090 Ti | 24 GB | 1.008 TB/s | GDDR6X | 40 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| AMD Radeon Instinct MI300 | 128 GB | 1.6 TB/s | HBM3 | 60 | FP64, FP32, FP16 | ROCm, TensorFlow |

NVIDIA H100 NVL

La migliore GPU per machine learning, la H100 NVL, offre prestazioni eccezionali per il deep learning su larga scala, ottimizzata per carichi di lavoro multi-tenant ad alte prestazioni.

- Ideale per: Ricerca AI all'avanguardia, addestramento di modelli su larga scala e inferenza.

- Svantaggio: Molto costosa e principalmente indicata per ambienti enterprise o di ricerca.

NVIDIA A100 GPU Tensor Core

La A100 offre prestazioni massicce per reti neurali con 80 GB di memoria ad alta larghezza di banda (HBM2), adatta per carichi di lavoro pesanti.

- Ideale per: Modelli di machine learning su larga scala, ricerca AI e applicazioni cloud.

- Svantaggio: Costosa, principalmente rivolta a imprese.

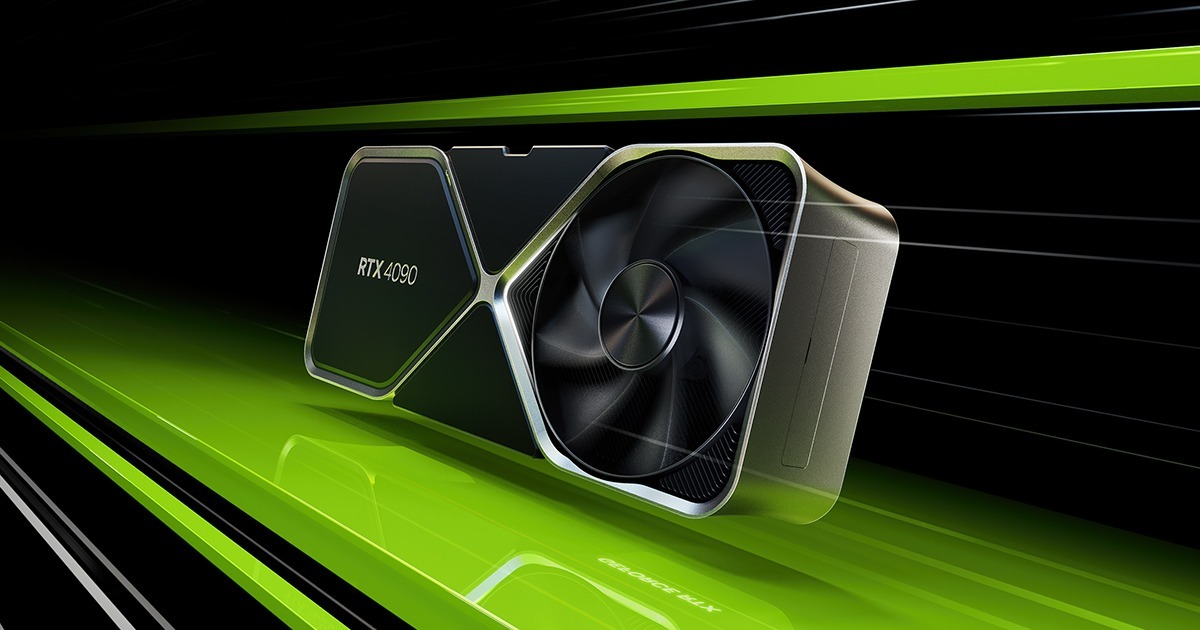

NVIDIA RTX 4090

Eccellente sia per il gaming che per i carichi di lavoro AI, con 24 GB di memoria GDDR6X e capacità di calcolo parallelo massiccia.

- Ideale per: Attività ML ad alto livello e ricerca AI che richiedono potenza computazionale estrema.

- Svantaggio: Consuma molta energia, costo elevato e dimensioni importanti.

NVIDIA RTX A6000 GPU con Tensor Core

Supporta applicazioni AI con 48 GB di memoria GDDR6, ben adatta per workstation e professionisti creative.

- Ideale per: Ricerca AI, deep learning e carichi di lavoro ad alte prestazioni.

- Svantaggio: Costo elevato, tipicamente indicata per ambienti professionali.

NVIDIA GeForce RTX 4070

Go offre il giusto equilibrio tra prezzo e prestazioni con forti capacità di ray-tracing, con 12 GB di memoria GDDR6X.

- Ideale per: Appassionati e piccole aziende con esigenze di machine learning di livello medio.

- Svantaggio: Memoria limitata per dataset più grandi e modelli molto voluminosi.

NVIDIA RTX 3090 Ti

NVIDIA RTX 3090 Ti - Ampia memoria (24 GB GDDR6X) e potenza computazionale elevata, ideale per l'addestramento di modelli medio-grandi.

- Ideale per: Appassionati e applicazioni di ricerca che richiedono elaborazione AI potente.

- Svantaggio: Molto costosa, consuma molta energia e può essere eccessiva per progetti più piccoli.

AMD Radeon Instinct MI300

Eccellente per carichi di lavoro AI e HPC, con prestazioni competitive.

- Ideale per: Carichi di lavoro di machine learning su setup incentrati su Radeon Instinct MI300.

- Svantaggio: Meno consolidata nel deep learning rispetto a NVIDIA, meno framework supportati.

Cloud GPU VPS di Cloudzy

Una delle migliori GPU per machine learning oggi disponibili è senza dubbio l'H100, ma è costosa, aumenterà le tue bollette elettriche, e le sue dimensioni potrebbero obbligarti ad aggiornare il case del computer o modificare tutti i componenti. È un'irritazione, ed è per questo che Cloudzy offre ora GPU per machine learning online, così non devi preoccuparti di nessuno di questi problemi. I nostri GPU VPS server sono dotati di fino a 2 H100, 4 TB di archiviazione NVMe, 25 TB al secondo di larghezza di banda, e 48 vCPU!

Tutto a prezzi accessibili con fatturazione a consumo oraria e mensile, oltre a un'ampia varietà di metodi di pagamento come PayPal, Alipay, carte di credito (tramite Stripe), PerfectMoney, Bitcoin e altre criptovalute.

Infine, nel peggiore dei casi, se non sei soddisfatto del nostro servizio, offriamo una garanzia di rimborso a 14 giorni!

Le piattaforme Augmented Reality (AR) Cloud dipendono fortemente da GPU ad alte prestazioni per fornire esperienze immersive in tempo reale. Proprio come le GPU con core CUDA e Tensor sono critiche per l'addestramento di modelli deep learning, sono altrettanto vitali per il rendering di ambienti AR complessi e il supporto di funzioni guidate da AI come il riconoscimento di oggetti e la mappatura spaziale. Con Cloudzy, i nostri AR Cloud server utilizzano tecnologia GPU all'avanguardia per garantire prestazioni affidabili, bassa latenza e scalabilità, rendendoli ideali per aziende che intendono distribuire applicazioni AR su larga scala.

Che tu stia costruendo applicazioni AI, addestrando modelli o conducendo ricerche, i nostri Soluzioni AI VPS server sono progettati per fornire le migliori prestazioni GPU a una frazione del costo usuale.

Considerazioni Finali

Con l'aumento della potenza computazionale necessaria e dei modelli AI sempre più grandi e complessi, le GPU saranno certamente una parte integrante delle nostre vite. Quindi è meglio documentarsi su di esse e capire come funzionano e cosa sono.

Ecco perché ti consiglio vivamente di consultare Tim Dettmersl'articolo su tutto quello che c'è da sapere sulle GPU e alcuni consigli pratici nella scelta di una GPU. È sia accademicamente riconosciuto che molto competente nel deep learning.