W latach 60. i 70., architektura monolityczna był faworyzowany do tworzenia aplikacji ze względu na ograniczone zasoby obliczeniowe, które wymagały połączenia wszystkich funkcjonalności w jedną, spójną jednostkę.

Aż do końca lat 90. i 2000., kiedy monolityczna struktura zaczęła być zbyt ograniczona dla stale rosnącego rozmiaru i złożoności aplikacji, szczególnie wraz z rozwojem internetu i systemów rozproszonych.

To rozwiązało ten problem i doprowadziło do opracowania bardziej modułowych podejść, takich jak architektura zorientowana na usługi (SOA) i, później, architektura mikroserwisów (MSA), które zyskały popularność na początku lat 2010.

Jednak to zaledwie pobieżne wyjaśnienie podstawowych koncepcji i zastosowania mikroserwisów. Przyjrzyjmy się, jak mikroserwisy zastąpiły architekturę monolityczną, jak działają mikroserwisy, oraz poznajmy przykłady ich zastosowania. Następnie omówimy kluczowe aspekty wdrażania mikroserwisów i co warto wiedzieć, jeśli chcesz je wdrożyć.

Czym są mikroserwisy? Jak działają?

Jak wspomniałem wcześniej, mikroserwisy pojawiły się jako rozwiązanie dla rosnącej złożoności i rozmiaru aplikacji, umożliwiając firmom podział funkcjonalności na niezależnie wdrażalne usługi.

Termin "mikroserwisy" spopularyzowali eksperci branżowi tacy jak Martin Fowler i James Lewis, którzy formalnie wprowadzili go w poście na blogu w 2014 roku. Ich praca zdefiniowała kluczowe zasady i cechy, w tym potrzebę niezależnie wdrażalnych usług, zdecentralizowanego zarządzania danymi oraz niezależności od technologii.

Od tamtej pory mikroserwisy stały się głównym wyborem architektonicznym, wspieranym przez postępy w technologiach konteneryzacji takich jak Docker, narzędziach orkiestracji takich jak Kubernetes, oraz platformach serverless. Ale jak działają mikroserwisy?

Jak działają mikroserwisy?

W swojej istocie architektura mikroserwisów dzieli dużą aplikację na mniejsze, odrębne usługi, z których każda odpowiada za konkretną funkcję biznesową. Te usługi komunikują się ze sobą przez sieć, zazwyczaj poprzez REST APIs, gRPC lub brokerów wiadomości takich jak RabbitMQ lub Apache Kafka.

Zgodnie z definicją Martina Fowlera i Jamesa Lewisa, wszystkie mikroserwisy mają cztery kluczowe cechy:

- Pojedyncza Odpowiedzialność: Każdy mikroserwis jest zaprojektowany do wykonania konkretnego zadania lub funkcji, co umożliwia specjalizację i zmniejsza złożoność.

- Niezależność: Mikroserwisy można rozwijać, wdrażać i skalować niezależnie od siebie, co zapewnia elastyczność i odporność.

- Zdecentralizowane zarządzanie danymi: Mikroserwisy często mają własne bazy danych, eliminując potrzebę jednej scentralizowanej bazy danych.

- Niezależność technologiczna: Zespoły mogą wybrać najlepszą technologię dla każdej usługi, bez ograniczeń wynikających z wyborów innych usług.

Podejście to kontrastuje z tradycyjną architekturą monolityczną, w której wszystkie komponenty aplikacji są ściśle zintegrowane w jedną, spójną całość.

Kluczowe etapy wdrażania mikroserwisów

Chociaż architektura mikroserwisów oferuje wiele korzyści, takich jak wysoka skalowalność, elastyczność, wydajność, izolacja błędów itp., wymaga wiedzy na temat efektywnego wdrażania mikroserwisów oraz solidnego planowania, aby się powieść.

Dlatego właśnie kluczowe jest posiadanie wszechstronnego zrozumienia pojęć, etapów i najlepszych praktyk dotyczących wdrażania mikroserwisów, aby osiągnąć sukces architektury mikroserwisów. Przyjrzyjmy się kluczowym etapom wdrażania mikroserwisów i temu, co każdy etap obejmuje.

Planowanie i przygotowanie wdrożenia mikroserwisów

Wszystkie dobre rzeczy wymagają planowania i cierpliwości, a aby wdrożyć mikroserwisy z powodzeniem, zdecydowanie będziesz potrzebować sporo planowania i cierpliwości. Dlatego właśnie ważne jest przestrzeganie najlepszych praktyk mikroserwisów oraz zaplanowanie i przygotowanie wszystkiego, czego potrzebujesz podczas wdrażania mikroserwisów.

Jak wspomniałem wcześniej, jedną z kluczowych zasad mikrousług jest Zasada Pojedynczej Odpowiedzialności. Jeśli pozostaniesz wierny tej zasadzie i upewnisz się, że każda mikrousługa skupia się na jednej funkcji, Twój zespół będzie mógł rozwijać, wdrażać i skalować usługi niezależnie.

Ponadto, do tej zasady należy również zasada słabego sprzężenia. Oznacza to, że każda usługa może funkcjonować niezależnie w komunikacji i ma minimalne zależności od innych usług. Z kolei pozwala to na to, że zmiany w jednej usłudze nie wpływają na inne, umożliwiając niezależne skalowanie mikrousług.

Zmniejsza to ryzyko awarii kaskadowych, gdzie problem w jednej części systemu wyzwala efekt domina i doprowadza do upadku całej usługi.

Ważną praktyką przy wdrażaniu mikrousług jest posiadanie dedykowanego magazynu danych dla każdej usługi, co wynika z zasady słabego sprzężenia. Zapobiega to konfliktom i umożliwia lepszą skalowalność usług.

Dodatkowo będziesz potrzebować asynchronicznych wzorców komunikacji między mikrousługami, takich jak brokerzy komunikatów, aby każda usługa mogła się komunikować bez bezpośrednich zależności.

Ostatnim elementem jest wdrożenie potoku Continuous Integration i Continuous Delivery (CI/CD) dla mikrousług. Potoki te pozwalają zespołom wdrażać nowe funkcje lub poprawki poprzez Narzędzia CI/CD takie jak Jenkins i GitLab, umożliwiające organizacjom utrzymanie stabilności systemu przy częstym wydawaniu nowych możliwości.

Teraz, gdy masz ogólne pojęcie o planowaniu i przygotowaniu potrzebnym do wdrożenia mikrousług, porozmawiajmy o strategiach ich wdrażania.

Strategie Wdrażania Mikrousług

Podczas wdrażania mikrousług wybór strategii zależy od funkcji usługi, ruchu, konfiguracji infrastruktury, umiejętności zespołu i kosztów. Generalnie strategie wdrażania mikrousług są następujące:

- Instancja Usługi w Kontenerze: W tym podejściu każda mikrousługa działa w osobnym kontenerze, zapewniając lepszą izolację niż model z wieloma instancjami na jednym hoście. Kontenery ułatwiają skalowanie i poprawiają alokację zasobów.

- Instancja Usługi w Maszynie Wirtualnej: Każda usługa działa w osobnej maszynie wirtualnej (VM), zapewniając jeszcze większą izolację niż kontenery. Chociaż poprawia to bezpieczeństwo i stabilność, zwykle wiąże się z większym narzutem.

- Etapowe wydania: Początkowo wdróż wersje mikrousługi dla małej grupy użytkowników, testując ich stabilność przed pełnym uruchomieniem. To podejście minimalizuje wpływ, jeśli pojawią się problemy, i umożliwia szybkie wycofanie zmian.

- Wdrożenie Blue-Green: Ta metoda wykorzystuje dwa identyczne środowiska produkcyjne, gdzie jedno obsługuje ruch na żywo, a drugie jest używane do testowania następnego wydania. Wdrożenie blue-green umożliwia łatwe wycofywanie zmian i aktualizacje bez przestojów, ponieważ ruch może być bezproblemowo przeswitchowany między dwiema środowiskami.

- Wydania etapowe: Ta strategia polega na stopniowym wdrażaniu aktualizacji dla różnych segmentów użytkowników lub środowisk. Często zaczyna się w środowiskach wewnętrznych, zanim dotrze do produkcji, ograniczając zasięg potencjalnych problemów i pozwalając zespołom na rozwiązywanie problemów etapami.

- Wdrożenie Bezserwerowe: To podejście wykorzystuje platformy bezserwerowe, takie jak AWS Fargate i Google Cloud Run, które automatyzują zarządzanie infrastrukturą poprzez obsługę skalowania i alokacji zasobów. W przypadku wdrożenia bezserwerowego nie ma potrzeby zarządzania serwerami bazowymi, co pozwala Ci skupić się na samych mikrousługach.

Po wyborze jednej z powyższych strategii wdrażania mikrousług będziesz potrzebować narzędzia do orkiestracji mikrousług.

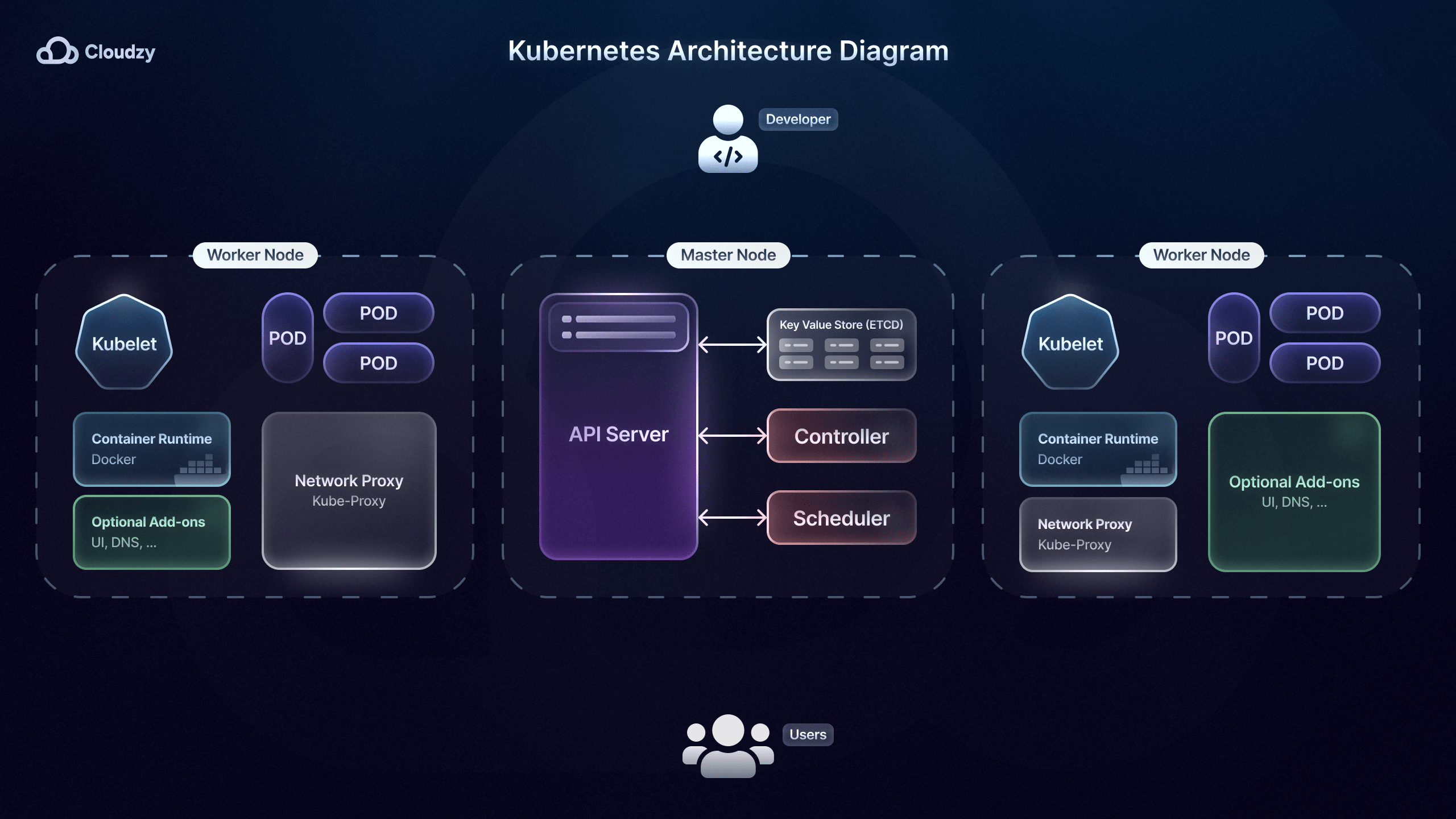

Orkiestracja mikroserwisów

Po wyborze jednej z wielu strategii wdrażania mikrousług będziesz potrzebować narzędzia do ich organizacji. Narzędzia do orkiestracji mikrousług, takie jak Kubernetes, automatyzują wdrażanie mikrousług, skalowanie, monitoring i zarządzanie konteneryzowanymi mikrousługami.

Na przykład Airbnb korzysta z Kubernetes, co pozwala jego inżynierom wdrażać setki zmian w mikrousługach bez ręcznego nadzoru. Ważną cechą narzędzi orkiestracji mikrousług takich jak Kubernetes jest wbudowane równoważenie obciążenia.

Dobrze zaimplementowane równoważenie obciążenia rozkłada przychodzący ruch między wiele instancji mikrousługi. Zapobiega to temu, by jedna instancja stała się wąskim gardłem, i zwiększa zdolność systemu do obsługi skoków w popycie.

Kubernetes odgrywa istotną rolę w zarządzaniu mikrousługami dzięki samoleczącym się możliwościom, w których nieudane kontenery są automatycznie zastępowane i ponownie uruchamiane. The New York Times wykorzystuje tę funkcję, aby utrzymywać swoje mikrousługi bez wpływu na doświadczenie użytkownika i przestojów.

Ponadto Kubernetes zwiększa bezpieczeństwo mikrousług poprzez zarządzanie konfiguracjami i tajnymi danymi, takimi jak poświadczenia bazy danych lub klucze API, za pomocą ConfigMaps i Secrets. Jest to szczególnie ważne dla firm takich jak Uber, które obsługują wrażliwe dane klientów i użytkowników.

Wreszcie, narzędzia orkiestracji mikrousług takie jak Kubernetes są szczególnie przydatne dla strategii mikrousług obejmujących aktualizacje wdrażające i wycofywania, takie jak etapowe wydania. Aktualizacje wdrażające pozwalają na wdrożenie nowych wersji mikrousług bez przerw w usłudze, utrzymując uruchomione niektóre instancje starej wersji.

Po skonfigurowaniu narzędzia orkiestracji mikrousług będziesz musiał budować i automatyzować Potoki CI/CD do wdrażania mikrousług.

Potoki CI/CD dla wdrażania mikrousług

Jak wspomnieliśmy wcześniej, potoki Continuous Integration i Continuous Delivery dla mikrousług to istotne aspekty wdrażania mikrousług. Potoki CD w pipelinach CI/CD odpowiadają za automatyczne wdrażanie zmian kodu do produkcji zaraz po przejściu faz testowania i integracji potoku CI/CD.

Następnie część CD potoku CI/CD wchodzi w grę, gdy zmiany kodu przejdą fazy testowania i integracji, a usługa jest wdrażana do narzędzia orkiestracji mikrousług, takiego jak klaster Kubernetes.

Ponadto etapy testowania i integracji są w pełni automatyzowane przez potoki CI/CD, ponieważ testy jednostkowe, testy integracyjne i testy end-to-end są wbudowane w pipeline.

Umożliwia to zespołom walidowanie aktualizacji na każdym etapie przy jednoczesnym utrzymaniu stabilności systemu. Dodatkowo, jeśli pojawią się problemy ze zmianami kodu pomimo różnych testów, automatyczne wycofywania mogą przywrócić poprzednią stabilną wersję.

Wreszcie, wdrażanie potoków CI/CD dla mikrousług zgodnie z najlepszymi praktykami mikrousług pomaga organizacjom osiągnąć szybszy rozwój, zmniejszyć błędy ręczne i utrzymać wysokie standardy jakości.

Wiele firm takich jak Spotify, Expedia, iRobot, Lufthansa, Pandora itp. korzysta z potoków CI/CD dla mikrousług poprzez narzędzia takie jak CircleCI, AWS CodePipeline i GitLab, aby automatyzować procesy wdrażania, zapewnić spójną jakość kodu i szybko dostarczać nowe funkcje przy jednoczesnym utrzymaniu stabilności systemu.

Wzorce komunikacji mikrousług

Sposób komunikacji mikrousług między sobą zależy całkowicie od funkcji, ogólnej architektury, pożądanej skalowalności i niezawodności twoich mikrousług. Generalnie stosuje się dwa główne wzorce komunikacji mikrousług: synchroniczny i asynchroniczny wzorce komunikacji mikrousług.

W synchronicznych wzorcach komunikacji mikrousług usługi oddziałują na bieżąco, co oznacza, że usługa wysyła żądanie i czeka na odpowiedź przed kontynuowaniem. Najczęściej stosowane synchroniczne wzorce komunikacji mikrousług to REST (Reprezentacyjny Transfer Stanu) API, gRPC (Go Remote Procedure Call), i GraphQL.

Tego rodzaju wzorce komunikacji mikrousług są zwykle stosowane w branżach i przez firmy, które wymagają przetwarzania danych w czasie rzeczywistym i natychmiastowych odpowiedzi. Branże takie jak finanse, opieka zdrowotna i e-commerce często używają wzorców komunikacji synchronicznej, aby zapewnić, że transakcje, pobieranie danych lub interakcje odbywają się natychmiast, utrzymując płynne i responsywne doświadczenie użytkownika.

Trzeba jednak powiedzieć, że chociaż synchroniczne wzorce komunikacji mikrousług oferują korzyści takie jak odpowiedzi w czasie rzeczywistym i prostota, mają również pewne wady, takie jak potencjalne wąskie gardła z powodu ścisłego sprzężenia, niska skalowalność przy dużych obciążeniach, powolne czasy odpowiedzi i wysokie opóźnienia podczas instancji dużego ruchu.

Z drugiej strony asynchroniczne wzorce komunikacji mikrousług są zwykle bardziej odpowiednie dla mikrousług, ponieważ opierają się na zasadzie Loose Coupling, którą omówiliśmy wcześniej.

Ten typ wzorca komunikacji mikrousług oddziela usługi, umożliwiając im wysyłanie i odbieranie wiadomości za pośrednictwem brokera, takiego jak Kafka lub RabbitMQ. Wysyłając wiadomości do kolejki, która pełni rolę bufora, usługi komunikują się niezależnie, zamiast czekać na odpowiedź, jak w przypadku komunikacji synchronicznej. Ten bufor umożliwia innym usługom przetwarzanie wiadomości we własnym tempie, pozwalając nadawcy kontynuować pracę bez czekania na odbiorę.

Asynchroniczny wzorzec komunikacji mikrousług oferuje nie tylko rozluźnioną strukturę dla wdrażania mikrousług, ale zapewnia również tę samą odpowiedź w czasie rzeczywistym, którą oferują synchroniczne wzorce komunikacji mikrousług.

Wynika to z architektury sterowanej zdarzeniami asynchronicznych wzorców komunikacji mikrousług sterowanych zdarzeniami, ponieważ usługi komunikują się, emitując zdarzenia, gdy nastąpi określona akcja. Inne usługi mogą subskrybować te zdarzenia i reagować odpowiednio. To umożliwia wysoce responsywne systemy, które reagują na zmiany w czasie rzeczywistym bez bezpośredniego sprzężenia między usługami.

Ponadto w trybie asynchronicznym Publikowanie-Subskrypcja (Pub/Sub) W wzorcach komunikacji mikrousług usługi (wydawcy) wysyłają wiadomości do tematu, a inne usługi (subskrybenci) nasłuchują tego tematu, aby otrzymywać aktualizacje. Ten model obsługuje wielu subskrybentów i równocześnie wysyła wiadomości do wielu usług.

Wreszcie, podobnie jak w wzorcach sterowanych zdarzeniami, asynchroniczny saga oparta na choreografii wzorce komunikacji mikrousług również wykorzystują zdarzenia do komunikacji między sobą; jednak w tym wzorcu obowiązuje określona kolejność, co oznacza, że zdarzenia wyzwalają następny krok i aktywują określoną usługę.

Różnica polega na tym, że we wzorcach sterowanych zdarzeniami nie ma określonej sekwencji ani przepływu pracy, a wiele usług może reagować na zdarzenie, w przeciwieństwie do określonego procesu i kolejności we wzorcu sagi opartej na choreografii.

Którzy typ asynchronicznego wzorca komunikacji mikrousług wykorzystasz, zależy od zadania i ogólnej funkcji twoich mikrousług. Kolejki wiadomości, takie jak RabbitMQ i Amazon SQS, są zwykle używane do planowania zadań, dystrybucji obciążenia oraz w e-commerce do przetwarzania zamówień i systemów powiadomień.

Brokery wiadomości sterowane zdarzeniami, takie jak Apache Kafka i AWS EventBridge, są zwykle używane do przetwarzania dużych strumieni zdarzeń w czasie rzeczywistym oraz routingu zdarzeń między mikrousługami w obszarach takich jak usługi finansowe i AWS środowiska.

Brokery wiadomości Publikowania-Subskrypcji (Pub/Sub), takie jak Go Cloud Pub/Sub i Redis Streams, są zwykle używane do skalowanego przesyłania wiadomości w systemach rozproszonych dla analityki w czasie rzeczywistym oraz pozyskiwania zdarzeń, powiadomień w czasie rzeczywistym i aplikacji czatów.

Wreszcie, brokery wiadomości sagi opartej na choreografii są głównie używane do przetwarzania zamówień e-commerce, systemów rezerwacji podróży oraz przypadków użycia, w których złożone, wieloetapowe transakcje muszą być koordynowane między wieloma usługami bez centralnej kontroli.

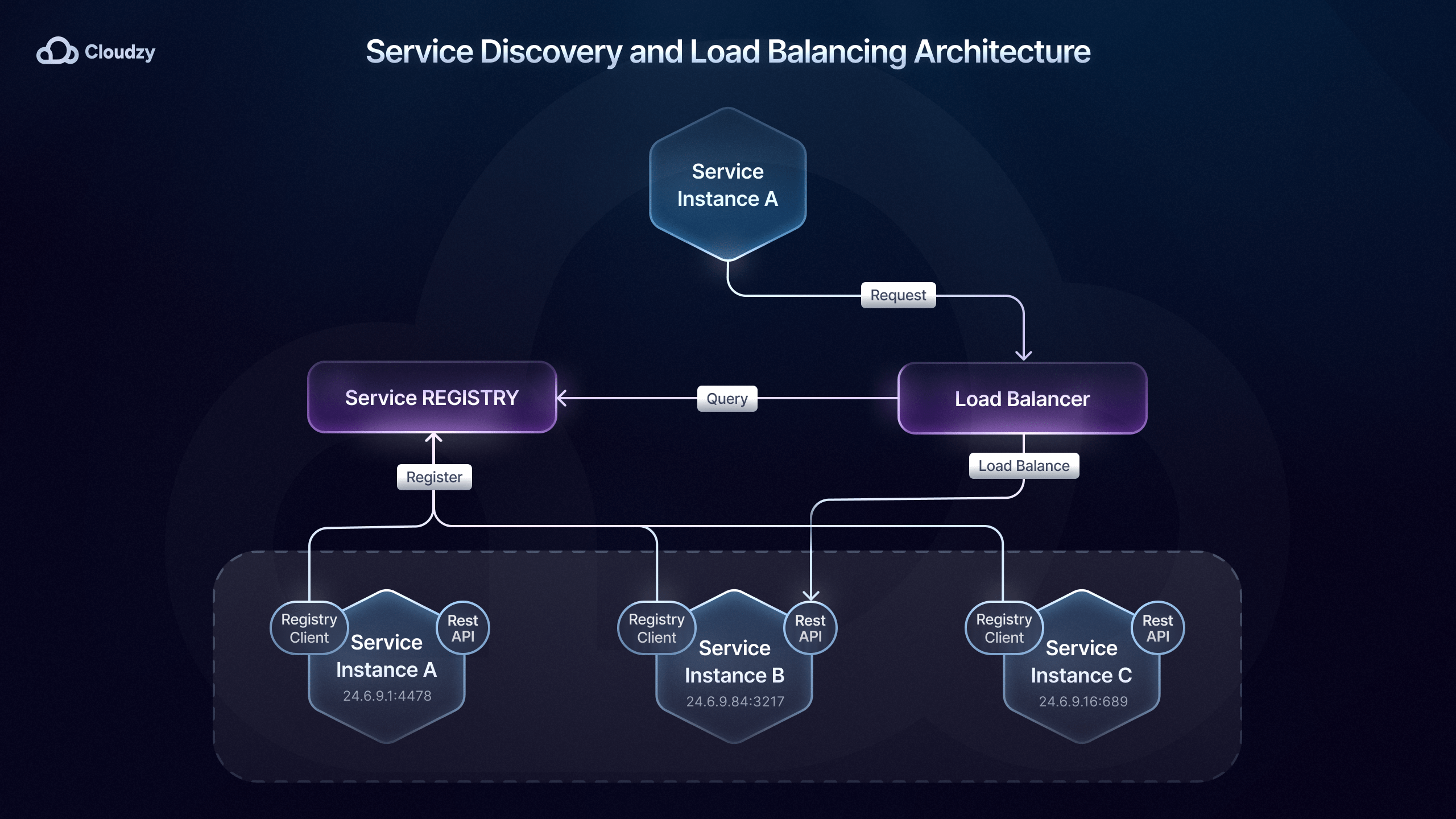

Odkrywanie usług mikrousług

Po wdrożeniu wzorca komunikacji, który odpowiada twoim potrzebom, musisz upewnić się, że usługi mogą się nawzajem zlokalizować. Jak wspominałem wcześniej, narzędzia orkiestracji mikrousług, takie jak Kubernetes, odgrywają ważną rolę w odkrywaniu usług mikrousług.

Odbywa się to za pośrednictwem wbudowanego odkrywania usług, które zapewnia Kubernetes DNS, które dynamicznie aktualizuje adresy IP i rekordy DNS, gdy usługi skalują się lub zmieniają lokalizację w klastrze.

Ta metoda odkrywania usług mikrousług jest nazywana odkrywaniem po stronie serwera, ponieważ odpowiedzialność za routing jest delegowana do modułu równoważenia obciążenia, który następnie wysyła zapytania do rejestru i kieruje ruch do odpowiedniej instancji.

Z drugiej strony, mamy również metodę odkrywania po stronie klienta dla odkrywania usług mikrousług, w której usługa lub brama API wysyła zapytania do rejestru usług, takiego jak Consul lub Eureka, aby znaleźć dostępne instancje.

Wybór, która metoda odkrywania usług jest najlepsza dla twojego wdrażania mikrousług, zależy od wymagań i skali systemu.

Dzięki odkrywaniu usług mikrousług po stronie klienta, klient ma pełną kontrolę nad tym, z którą instancją się komunikuje. To nie tylko pozwala na większą personalizację, ale także zmniejsza złożoność, ponieważ nie ma potrzeby scentralizowanej usługi odkrywania.

Na przykład, wdrażanie mikrousług Netflix wykorzystuje odkrywanie usług po stronie klienta z Eureka i Ribbon do równoważenia obciążenia, umożliwiając klientowi wybranie najlepszej instancji na podstawie kryteriów, takich jak opóźnienie i obciążenie serwera.

Jednak odkrywanie usług mikrousług po stronie serwera jest bardziej odpowiednie dla większych środowisk, ponieważ scentralizowana usługa odkrywania może poprawić wydajność i pozwolić na spójne równoważenie obciążenia w systemie rozproszonym.

Rozwiązania do odkrywania usług mikrousług po stronie serwera, takie jak Kubernetes, AWS Elastic Load Balancing i bramy API (Kong, NGINX, itp.), pomagają w efektywnym kierowaniu ruchu i utrzymaniu wysokiej dostępności. Są wykorzystywane przez firmy takie jak Airbnb, Pinterest, Expedia, Lyft, itp.

Bezpieczeństwo Mikrousług

Chociaż architektura monolityczna jest na ogół gorsza od MSA, jednym aspektem, w którym architektura monolityczna miała przewagę, było bezpieczeństwo. Ponieważ mikrousługi są oparte na zasadzie luźnego sprzężenia i są rozproszone, nie można wdrożyć jednego ogólnego środka bezpieczeństwa.

Ponieważ każda usługa musi być zabezpieczona niezależnie, konieczne są dodatkowe zabezpieczenia, gdyż powierzchnia ataku jest znacznie większa w architekturze mikroserwisów. W tym celu powszechnie stosuje się standardy takie jak OAuth2 i JSON Web Tokens (JWT) do uwierzytelniania i autoryzacji.

Ponadto, brama API jest również często wykorzystywana do zarządzania bezpieczeństwem między mikroserwisami, ponieważ wymusza uwierzytelnianie i autoryzację w punkcie wejścia. Dodatkowo, bramy API mogą również implementować limitowanie szybkości, rejestrowanie i monitorowanie, co zapewnia dodatkowe warstwy bezpieczeństwa mikroserwisów.

Choć te rozwiązania zabezpieczają główny punkt wejścia, konieczne są dodatkowe środki bezpieczeństwa mikroserwisów, aby pokryć komunikację między usługami.

Tu wchodzą w grę siatki usług, które dodają warstwę bezpieczeństwa sieci mikroserwisów i szyfrują ruch między usługami, wymuszając zasady takie jak wzajemne TLS. Te siatki usług zasadniczo ustawiają kompleksowe szyfrowanie end-to-end, które znacznie poprawia bezpieczeństwo mikroserwisów.

Skalowanie mikroserwisów

Jedną z największych zalet architektury mikroserwisów, i właśnie dlatego została opracowana, aby zastąpić monolit, jest jej wysoka skalowalność. Typowo skalowanie mikroserwisów może odbywać się na dwa sposoby: wertykalne i horyzontalne.

Zasadniczo skalowanie wertykalne mikroserwisów (przeskalowanie w górę) to dodanie większej ilości zasobów, takich jak CPU czy pamięć, do istniejącej instancji. Alternatywnie, skalowanie horyzontalne mikroserwisów (przeskalowanie na zewnątrz) rozdziela obciążenie i zwiększa wydajność.

Pod względem wdrażania, skalowanie wertykalne mikroserwisów jest łatwiejsze z tych dwóch, ponieważ wystarczy zmodyfikować jedną instancję, ulepszając do większego serwera, zwiększając pamięć lub moc obliczeniową w instancji w chmurze, lub dodając więcej pamięci masowej.

Ten typ skalowania jest typowo używany w przypadkach, gdy zwiększenie RAM czy CPU może poprawić wydajność zapytań i przetwarzanie danych, takich jak usługi odpowiadające za buforowanie w pamięci.

Oczywiście, skalowanie wertykalne mikroserwisów jest łatwiejsze i oferuje natychmiastowy wzrost wydajności, ale ma również wady. Skalowanie wertykalne jest ograniczone pojemnością sprzętu serwera, więc w pewnym momencie będziesz musiał przejść na skalowanie horyzontalne, aby kontynuować skalowanie wertykalne.

Ponadto skalowanie wertykalne wiąże się z wysokimi kosztami, ponieważ sprzęt i większe instancje generalnie są droższe. Na koniec, jeśli przeskalowana instancja zawiedzie, usługa całkowicie się wyłączy, ponieważ nie ma dodatkowych instancji, które mogłyby obsługiwać obciążenie.

W przypadku skalowania horyzontalnego mikroserwisów zamiast ulepszania zasobów jednej instancji, wdrażasz nowe instancje tej usługi. Choć instancje te działają niezależnie, nadal obsługują tę samą usługę i części tego samego obciążenia.

W przeciwieństwie do skalowania wertykalnego, skalowanie horyzontalne mikroserwisów jest nieograniczone, co oznacza, że możesz dodawać tyle instancji, ile potrzebujesz, aby obsłużyć rosnące obciążenia i skoki ruchu, oferując większą skalowalność.

Ponadto, ponieważ masz kilka instancji, jeśli jedna ulegnie awarii, nie stawiasz wszystkiego na jedną kartę, ponieważ inne instancje mogą nadal obsługiwać żądania. Na koniec, skalowanie horyzontalne jest znacznie bardziej opłacalne w długoterminowej perspektywie, ponieważ możesz używać kilka mniejszych i tańszych instancji, aby utworzyć bardziej niezawodną i potężniejszą wydajność.

To powiedziawszy, skalowanie horyzontalne i dodawanie większej liczby instancji wymagają więcej modułów równoważenia obciążenia, mechanizmów odnajdywania usług mikroserwisów i narzędzi do aranżacji mikroserwisów, co sprawia, że architektura mikroserwisów staje się znacznie bardziej złożona.

Skalowanie horyzontalne lepiej nadaje się do przypadków użycia, takich jak usługi sieciowe i aplikacje takie jak platformy e-commerce lub media społecznościowe, które często doświadczają zmiennego ruchu i dużej liczby żądań.

To powiedziawszy, nie jest to naprawdę sprawa wyboru jednego lub drugiego, ponieważ oba typy skalowania są obsługiwane w mikroserwisach i są konieczne w wielu przypadkach. Typowo mniejsze organizacje używają skalowania wertykalnego, ponieważ jest znacznie prostsze do wdrożenia i zarządzania, ale z czasem, w miarę rozwoju aplikacji, wprowadzane jest skalowanie horyzontalne, aby obsłużyć duże zapotrzebowanie.

Na koniec, platformy chmurowe oferują usługi automatycznego skalowania, które automatycznie dodają lub usuwają instancje na podstawie popytu w czasie rzeczywistym, co znacznie pomaga organizacjom zbilansować skalowanie wertykalne i horyzontalne.

Monitorowanie Mikroserwisów

Na tym etapie zasadniczo skończyłeś wdrażanie mikroserwisów. Pozostaje tylko upewnić się, że działa konsekwentnie i niezawodnie. Tu wchodzą w grę narzędzia do monitorowania mikroserwisów, takie jak Prometheus i Grafana wejdź.

Te narzędzia zapewniają wgląd w czasie rzeczywistym w metryki usług, dzięki czemu zespoły mogą śledzić wykorzystanie zasobów, opóźnienia i wskaźniki błędów. Dodatkowo, narzędzia te również oferują śledzenie rozproszone (Jaeger, Zipkin itp.), które pomaga wizualizować przepływy żądań między usługami i może być bardzo przydatne do diagnozowania problemów.

Na koniec, ponieważ awarie mogą kaskadować między usługami ze względu na rozproszony charakter mikroserwisów, agregacja dzienników jest praktyka krytyczną w monitorowaniu mikroserwisów. Konsolidując dzienniki na scentralizowaną platformę i ustawiając alerty w czasie rzeczywistym, zawsze będziesz o krok do przodu i będziesz mógł proaktywnie reagować na problemy zanim wpłyną na użytkowników.

Ostateczne Przemyślenia

Choć świat mikroserwisów jest niewątpliwie trudny do zrozumienia, zrozumienie podstaw i kluczowych etapów wdrażania mikroserwisów może sprawić, że cały proces będzie znacznie łatwiejszy. Ponadto, z biegiem lat, coraz więcej narzędzi ze znacznie większą liczbą funkcji jest do twojej dyspozycji, co sprawia, że wdrażanie mikroserwisów jest prostsze niż kiedykolwiek.

Często zadawane pytania

Jakie strategie wdrażania są powszechnie używane dla mikroserwisów?

Chociaż istnieje wiele różnych strategii wdrażania mikroserwisów, najczęściej stosowane strategie wdrażania obejmują instancje usług na kontener, wdrażanie etapowe, wdrażanie blue-green i wdrażanie bezserwerowe, z czego każda oferuje różne poziomy izolacji, elastyczności i skalowalności.

Jaką rolę pełni Kubernetes w aranżacji mikroserwisów?

Mikrousługi zależą od narzędzi orkiestracji, takich jak Kubernetes, które automatyzują wdrażanie, skalowanie i zarządzanie usługami konteneryzowanymi. Zapewniają równoważenie obciążenia, automatyczne skalowanie i samonaprawianie, gwarantując odporne i wydajne mikrousługi.

Jak zapewnić bezpieczeństwo w środowisku mikrousług?

Ze względu na swoją rozproszoną naturę, mikrousługi stanowią większe wyzwanie pod względem bezpieczeństwa niż architektura monolityczna. Bezpieczeństwo mikrousług obejmuje uwierzytelnianie i autoryzację żądań, szyfrowanie komunikacji między usługami oraz implementację bram API i mesh'y serwisów takich jak Istio do scentralizowanego zarządzania bezpieczeństwem.