Nếu bạn đang quyết định H100 so với RTX 4090 Với AI, hãy nhớ rằng hầu hết các 'benchmark' không quan trọng cho đến khi model và cache thực sự vừa với VRAM. RTX 4090 là điểm cân bằng tốt nhất cho công việc single-GPU nằm trong 24 GB.

H100 là cái bạn dùng khi cần các model lớn hơn, đồng thời cao hơn, cách ly nhiều người dùng hoặc ít phải căng thẳng về bộ nhớ.

Tôi sẽ chia nhỏ theo từng tác vụ, hiển thị các loại benchmark, rồi cho bạn một kế hoạch kiểm thử nhanh mà bạn có thể chạy trên stack của riêng mình.

Câu Trả Lời Nhanh: H100 vs RTX 4090 cho AI Workloads

H100 chiếm ưu thế cho huấn luyện model lớn và serving nghiêm túc vì nó mang lại các pool HBM lớn, bandwidth bộ nhớ rất cao, NVLink và MIG để cách ly. RTX 4090 tốt hơn cho 'Tôi cần tốc độ single-GPU tuyệt vời với giá tốt hơn' miễn là khối lượng công việc của bạn vừa với 24 GB mà không phải thường xuyên thỏa hiệp. Thông số và tính năng nền tảng làm cho điều này khá rõ ràng.

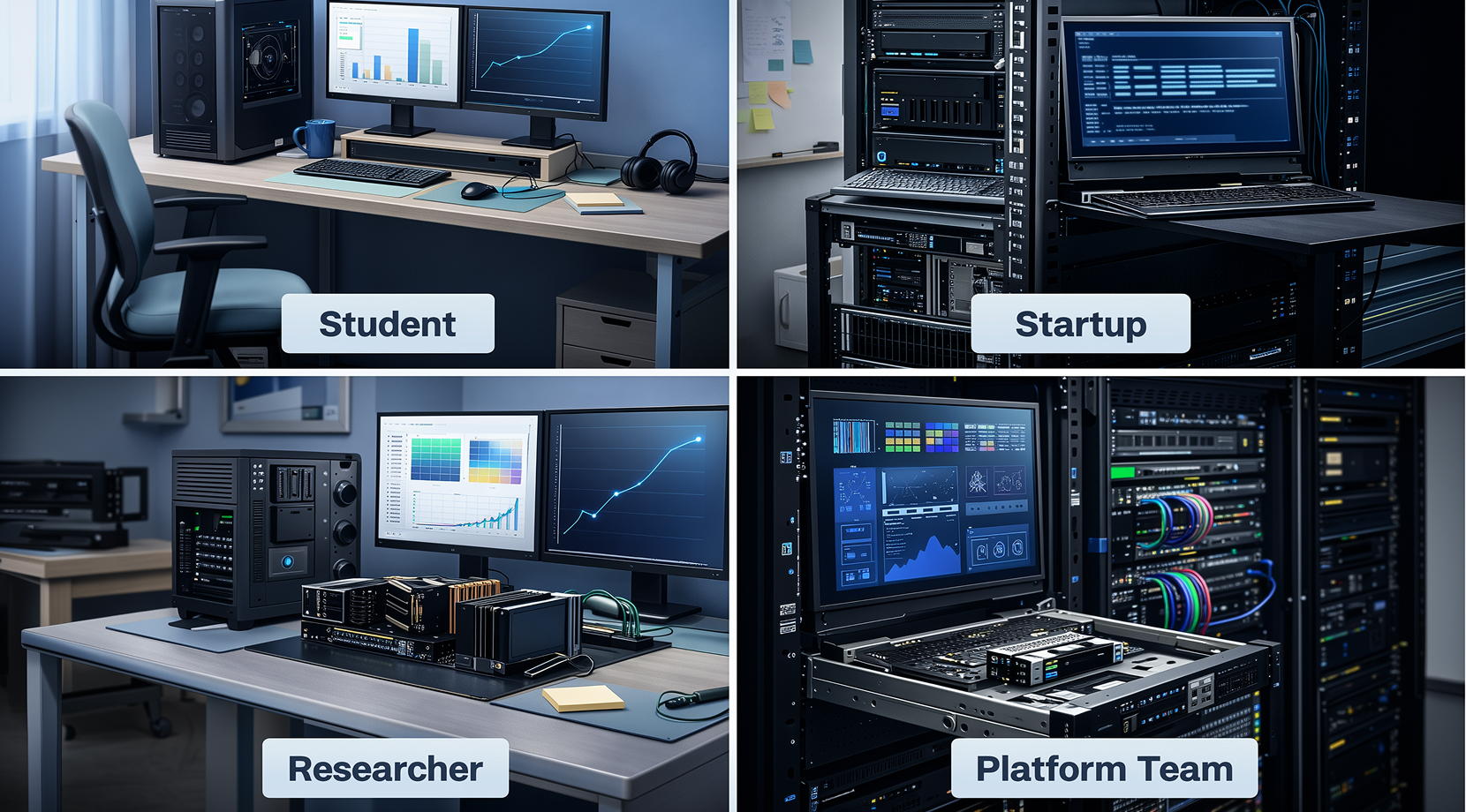

Đây là danh sách lựa chọn nhanh theo từng đối tượng:

- Nhà Phát Triển LLM Cục Bộ (Lập Trình Viên Solo / Sinh Viên): RTX 4090 cho đến khi VRAM trở thành nút thắt cổ chai.

- Kỹ Sư ML Startup (Đang Phát Hành MVP): RTX 4090 cho serving và fine-tuning ban đầu, H100 khi cần đồng thời ổn định hoặc model lớn hơn.

- Nhà Nghiên Cứu Ứng Dụng (Nhiều Thí Nghiệm): H100 nếu bạn liên tục gặp OOM, giới hạn batch hoặc context dài.

- Nhóm Sản Xuất / Nền Tảng (Phục Vụ Đa Người Dùng): H100 để chia MIG, tăng dung lượng dự phòng và scaling mượt mà hơn.

Với cách tiếp cận đó, phần còn lại của bài viết này nói về những giới hạn mà mọi người gặp phải trong thực tế, và cách các con số benchmark phù hợp với những giới hạn đó.

Câu Hỏi Benchmark Duy Nhất Cần Xem Xét: Cái Gì Phải Vừa Trong VRAM?

Hầu hết các cuộc thảo luận về H100 so với RTX 4090 về mặt kỹ thuật là các đối số VRAM. Trong công việc LLM, VRAM bị tiêu thụ bởi trọng lượng, kích hoạt trong quá trình huấn luyện, trạng thái tối ưu hóa trong quá trình huấn luyện, và bộ nhớ cache KV trong quá trình inference. Cái cuối cùng là cái mà mọi người thường không kỳ vọng, vì nó tăng theo chiều dài ngữ cảnh và đồng thời.

Bảng dưới đây có mục đích ở mức cao vì sự phù hợp chính xác tùy thuộc vào framework, độ chính xác và chi phí chung.

Đây là cách nhìn "nó có vừa mà không gặp vấn đề không?":

| Khối lượng công việc | Thực Tế Đơn GPU Điển Hình trên RTX 4090 (24 GB) | Thực Tế Đơn GPU Điển Hình trên H100 (80-94 GB) |

| Suy luận LLM 7B (FP16 / BF16) | Thường ổn | Đủ dung lượng dự phòng |

| suy luận LLM 13B | Thường khá chặt, tùy thuộc vào ngữ cảnh | Thường ổn |

| Suy luận loại 70B | Cần quant/offload nặng | Thực tế hơn nhiều |

| Inference SD/SDXL + batch nhỏ | Thường ổn | Ổn định, cộng thêm dung lượng dự phòng cho batch |

| Phục vụ với đồng thời cao hơn | Áp lực KV cache xuất hiện nhanh chóng | Nhiều chỗ hơn, ổn định hơn dưới tải cao |

Nếu bạn muốn danh sách GPU rộng hơn (không chỉ hai cái này), bài tóm tắt của chúng tôi về GPU Tốt Nhất Cho Machine Learning Năm 2025 là bảng tham khảo hữu ích cho VRAM và băng thông bộ nhớ trên các GPU AI phổ biến.

Khi bạn biết khối lượng công việc của mình vừa vặn, điều tiếp theo quyết định mức độ "mượt mà" là băng thông bộ nhớ.

Băng Thông: Tại Sao HBM Cảm Thấy Khác Biệt

Rất nhiều cuộc thảo luận về hiệu năng AI tập trung vào đỉnh tính toán, nhưng transformer rất nhạy cảm với chuyển động bộ nhớ. Ưu điểm của H100 là nó kết hợp các nhóm HBM lớn với băng thông bộ nhớ rất cao, cộng với băng thông NVLink và phân vùng MIG ở phía nền tảng.

Tổng Quan Thông Số

Thông số kỹ thuật không tự chọn GPU cho bạn, nhưng chúng giải thích tại sao cùng một khối lượng công việc lại cảm thấy dễ dàng trên một card và chật chội trên card khác. Ảnh chụp này cho thấy yếu tố nào ảnh hưởng nhiều nhất đến hành vi huấn luyện, suy luận và phục vụ của LLM.

| Thông số kỹ thuật | H100 (SXM / NVL) | RTX 4090 |

| VRAM | 80 GB / 94 GB | 24 GB |

| Băng thông bộ nhớ | 3,35–3,9 TB/s | GDDR6X (bị giới hạn dung lượng ở 24 GB) |

| Kết nối liên thống | NVLink + PCIe Gen5 | PCIe (nền tảng người dùng) |

| Đa thể hiện | Tối đa 7 phiên bản MIG | Không có |

Tham chiếu thông số kỹ thuật: NVIDIA H100, NVIDIA RTX 4090.

Điều này có nghĩa gì trong thực tế:

- Nếu bạn cố gắng tăng kích thước batch hoặc độ dài ngữ cảnh, H100 có xu hướng giữ ổn định lâu hơn trước khi bạn rơi vào những lựa chọn khó khăn.

- Nếu bạn phục vụ nhiều yêu cầu cùng lúc, H100 có nhiều 'không gian hô hấp bộ nhớ' hơn, vì vậy bạn không gặp phải độ trễ tail không ổn định nhanh chóng.

- Nếu công việc của bạn chủ yếu là một người dùng, một mô hình, ngữ cảnh vừa phải, RTX 4090 thường cảm thấy nhanh chóng và thỏa mãn.

Tuy nhiên, băng thông không thay thế benchmark tốt. Nó chỉ giải thích tại sao hai GPUs có thể trông gần nhau trong một bài kiểm tra hẹp, rồi tách biệt dưới tải thực.

Benchmark đáng tin cậy H100 vs RTX 4090

Benchmarks không phải tất cả đều giống nhau, đó là lý do tại sao 'các số của tôi không khớp với số của bạn' xảy ra liên tục. Để H100 so với RTX 4090, nó giúp chia benchmarks thành hai hướng:

- Hướng A (cảm giác cộng đồng): llama.cpp-style tokens/sec tests and simple inference scripts.

- Hướng B (bộ tiêu chuẩn hóa): Kết quả theo kiểu MLPerf Training và MLPerf Inference, tập trung vào các quy tắc có thể lặp lại.

Ảnh chụp suy luận kiểu Llama.cpp

Đây là loại bài kiểm tra mà mọi người chạy ở nhà, sau đó tranh luận trong ba ngày. Nó hữu ích vì nó phản ánh một 'toolchain thực' mà nhiều nhà phát triển sử dụng, nhưng nó cũng dễ hiểu sai nếu bạn bỏ qua fit và độ chính xác.

So sánh kiểu llama.cpp công khai cho thấy RTX 4090 hoạt động rất tốt trên các mô hình nhỏ hơn và các bộ định lượng, trong khi các mô hình lớn ở độ chính xác cao vượt qua trần VRAM.

Đây là mô hình bạn nên mong đợi:

| Mô hình | GPU | Kết Quả Điển Hình |

| Lớp 7B | RTX 4090 | Tokens/giây cao, suy luận một người dùng mượt mà |

| Lớp 13B | RTX 4090 | Vẫn tốt, nhưng ngữ cảnh và chi phí bắt đầu quan trọng |

| Lớp 70B | RTX 4090 | Không vừa vặn mà không có quant/offload tích cực |

| Lớp 70B | H100 | Thực tế hơn nhiều để giữ trong bộ nhớ và phục vụ một cách đáng tin cậy |

Mục đích của bảng này không phải 'RTX 4090 xấu' hay 'H100 kỳ diệu'. Đó là trần VRAM quyết định bạn có thể giữ lại bao nhiêu, và điều đó ảnh hưởng đến tốc độ, độ ổn định và lượng tinh chỉnh bạn sẽ làm.

Nếu bạn liên tục cắt giảm độ dài ngữ cảnh chỉ để tồn tại, đó là lúc so sánh này không còn mang tính lý thuyết nữa.

MLPerf Cung Cấp Gì Mà Các Bài Đánh Giá Trên Diễn Đàn Không Có

MLPerf tồn tại vì 'các script ngẫu nhiên và cảm tính' không hoạt động khi bạn đang đưa ra quyết định chi tiêu hàng ngàn đô la. MLCommons đã thêm các khối lượng công việc theo phong cách gen-AI mới hơn theo thời gian, và MLPerf được thiết kế để làm cho kết quả có thể so sánh hơn giữa các hệ thống.

Ở phía training, bài viết MLPerf Training v5.1 của NVIDIA là một ví dụ tốt về cách các nhà cung cấp báo cáo thời gian training cùng với chi tiết về môi trường submit và các quy tắc benchmark mà họ đang tuân theo.

Bài đánh giá này sẽ không cho bạn biết cách các prompt riêng tư của bạn hoạt động, nhưng nó là một kiểm tra hợp lý cho khả năng scaling ở mức hệ thống và 'hiệu suất của loại phần cứng này trong những điều kiện được quy định.'

Bây giờ hãy nói về phần ảnh hưởng nhiều nhất đến quyết định mua, đó là thời gian và chi phí để hoàn thành công việc.

Chi Phí, Thời Gian, và Chi Phí Cơ Hội

Rất nhiều H100 so với RTX 4090 các quyết định thường được xem như 'giá mua so với giá thuê.' Đó hiếm khi là cách nhìn đúng. Cách nhìn tốt hơn là bạn cần bao nhiêu giờ để tạo ra một mô hình bạn thực sự có thể sử dụng, và bạn mất bao nhiêu thời gian để vật lộn với các ràng buộc?

Ba kịch bản phổ biến cho thấy những sự đánh đổi khá rõ ràng.

Fine-Tuning Hàng Tuần Trên Các Mô Hình Nhỏ Đến Trung Bình

Nếu các lần chạy của bạn nằm trong 24 GB mà không cần những thỏa hiệp liên tục, con đường 4090 cảm thấy tuyệt vời. Bạn lặp lại nhanh chóng, bạn không cần lên lịch thời gian cluster, và thiết lập của bạn rất đơn giản. Nếu mỗi lần chạy biến thành 'giảm batch, cắt context, thử lại,' H100 là một ý tưởng hợp lý hơn nhiều, bất chấp chi phí cao hơn.

Phục Vụ Với Tính Đồng Thời Thực Tế

Tính đồng thời tăng áp lực cache KV nhanh chóng. Đây là nơi khả năng dự phòng của H100 và các kiểm soát nền tảng trả lại, đặc biệt nếu bạn cần độ trễ dự đoán được.

Nếu bạn vẫn đang quyết định xem liệu máy chủ GPU có phải là hình dạng hoặc sự phù hợp đúng cho triển khai của bạn, phần GPU VPS so với CPU VPS breakdown của chúng tôi là một cách hữu ích để ánh xạ khối lượng công việc tới loại cơ sở hạ tầng trước khi bạn dành thời gian tối ưu hóa điều sai.

Các Công Việc Training Lớn Hơn Có Thời Hạn

Ngay khi bạn mở rộng quy mô vượt quá một người, một máy, những thứ tẻ nhạt là những thứ bạn muốn tập trung vào, như những môi trường ổn định, ít chế độ hỏng hóc hơn, và ít thời gian dành cho những gì về cơ bản chỉ là giám sát. Đó chính xác là loại thứ H100 được thiết kế cho.

Nếu bạn vẫn còn do dự sau phần này, bước tiếp theo không phải là đọc thêm. Đó là xem xét cách stack của bạn hoạt động trong thực tế, bao gồm cả ma sát driver và khối lượng công việc đa người dùng.

Phần Mềm và Ops: Driver, Tính Ổn Định, Đa Người Dùng, và Hỗ Trợ

Đây là phần mà hầu hết các bảng đánh giá benchmark bỏ qua, nhưng nó là một phần lớn của cuộc sống hàng ngày.

RTX 4090 phổ biến vì nó dễ tiếp cận và nhanh cho nhiều quy trình làm việc AI. Sự đánh đổi là khi trường hợp sử dụng của bạn phát triển, bạn có khả năng gặp các giới hạn xung quanh giới hạn bộ nhớ và các mô hình scaling không được thiết kế cho các môi trường được chia sẻ, đa người thuê.

H100 được thiết kế cho các cluster. MIG rất quan trọng đối với các platform team vì nó cho phép bạn chia một GPU thành các phần cô lập, giảm vấn đề "noisy neighbor" và làm cho việc lập kế hoạch năng lực dễ dàng hơn nhiều. Danh sách thông số kỹ thuật chính thức của NVIDIA cho H100 hỗ trợ tới 7 instance MIG tùy theo form factor.

Nếu workload của bạn là cá nhân và chạy cục bộ, bạn có thể sống tốt trên phía 4090 trong một thời gian dài. Nếu workload của bạn là đa người dùng và hướng tới khách hàng, H100 là lựa chọn an toàn hơn.

Vậy nhìn chung, ai nên mua cái gì?

Bạn Nên Chọn Cái Nào cho Workload của Mình

cho H100 so với RTX 4090, lựa chọn đúng nhất là cái giải quyết được trở ngại lớn nhất của bạn.

LLM Builder Chạy Cục Bộ (Solo Dev / Sinh Viên)

Chọn RTX 4090 nếu bạn chủ yếu làm việc ở mức 7B–13B, chạy quantized inference, thử nghiệm RAG, hoặc làm việc với SDXL. Nâng cấp khi bạn dành nhiều thời gian hơn để giải quyết vấn đề bộ nhớ thay vì xây dựng thứ bạn lập kế hoạch.

ML Engineer Startup (Ship an MVP)

Nếu MVP của bạn là một model duy nhất với lưu lượng vừa phải và nó phù hợp thoải mái, 4090 là một khởi đầu tốt. Nếu bạn cần latency ổn định khi có tăng đột biến, concurrency cao hơn, hoặc nhiều workload trên một host, H100 là con đường ổn định hơn.

Applied Researcher (Nhiều Thử Nghiệm)

Nếu bạn thường xuyên phải đưa ra những sự thỏa hiệp như giảm batch size hoặc chuyển đổi precision, H100 giúp bạn có các thử nghiệm sạch hơn và ít lần chạy thất bại hơn.

Production / Platform Team (Phục Vụ Đa Tenant)

H100 là lựa chọn dễ dàng, chủ yếu vì MIG và dung lượng dự phòng cao hơn làm cho việc lập kế hoạch năng lực dễ dàng hơn và về cơ bản giảm tác động khi có gì đó tăng đột biến.

Nếu bạn vẫn không muốn cam kết bỏ tiền mua phần cứng, thuê là bước tiếp theo tốt nhất.

Một Con Đường Thực Tế Giữa Đôi: Thuê GPU Trước, Rồi Cam Kết

Cách sạch nhất để quyết định H100 so với RTX 4090 là để chạy của bạn mô hình, của bạn lời nhắc, và của bạn context length trên cả hai loại phần cứng, sau đó so sánh tokens/sec và tail latency dưới tải.

Đó chính xác là lý do tại sao chúng tôi xây dựng Cloudzy GPU VPS, vì bạn có thể lấy một box GPU trong dưới một phút, cài đặt stack của mình với root đầy đủ, và dừng đoán dựa trên benchmark của người khác.

Đây là những gì bạn nhận được trên các kế hoạch GPU VPS của chúng tôi:

- NVIDIA GPU Chuyên Dụng (bao gồm các tùy chọn RTX 4090 và A100-class) nên kết quả của bạn không thay đổi do noisy neighbors.

- Mạng lên tới 40 Gbps trên tất cả các kế hoạch GPU, đó là một vấn đề lớn cho dataset pulls, multi-node workflows, và di chuyển artifacts nhanh chóng.

- Lưu trữ NVMe SSD, cộng với DDR5 RAM và các tùy chọn CPU tần số cao trên tất cả các tiers, nên phần còn lại của box không kéo GPU xuống.

- Bảo vệ DDoS và một 99.95% thời gian hoạt động, nên các tác vụ dài không bị hỏng hóc vì nhiễu internet ngẫu nhiên.

- Tính phí theo giờ (tiện lợi cho các bài kiểm tra hiệu năng ngắn) và một Hoàn tiền trong 14 ngày để kiểm thử rủi ro thấp.

Chạy danh sách kiểm tra hiệu năng giống nhau trên kế hoạch RTX 4090 trước, sau đó lặp lại trên kế hoạch lớp A100 khi bạn xử lý ngữ cảnh lớn hơn, tính đồng thời cao hơn, hoặc mô hình lớn hơn. Sau đó, lựa chọn giữa H100 so với RTX 4090 thường trở nên rõ ràng từ nhật ký của chính bạn.

Danh Sách Kiểm Tra Hiệu Năng: Chạy Riêng Của Bạn Trong 30 Phút

Nếu bạn muốn một quyết định mà bạn có thể bảo vệ, lấy bốn con số từ chính xác ngăn xếp bạn dự định phát hành:

- Token/giây ở độ dài ngữ cảnh mục tiêu của bạn

- độ trễ p95 ở tính đồng thời dự kiến của bạn

- Dung lượng VRAM còn trống trong giai đoạn tải cao nhất

- Chi phí cho mỗi lần chạy hoàn thành từ bắt đầu đến kết quả cuối cùng

Bài kiểm tra khói tối thiểu với vLLM trông như thế này:

pip install vllm transformers accelerate

python -m vllm.entrypoints.api_server \

--model meta-llama/Llama-3-8B-Instruct \

--dtype float16 \

--max-model-len 8192Nếu bạn muốn hiểu rõ về những gì bạn thực sự thuê, bài viết của chúng tôi về GPU VPS Là Gì? giải thích sự khác biệt giữa quyền truy cập GPU riêng biệt, chia sẻ vGPU, và những gì cần kiểm tra trước khi bạn chọn kế hoạch.