Nếu kế hoạch của bạn là mua một GPU mới để không nhìn thấy lỗi hết bộ nhớ, so sánh 5070 Ti và 5080 là lập luận sai lầm. Cả hai card đều được trang bị 16 GB VRAM và giới hạn dung lượng này xuất hiện trong học sâu sớm hơn so với mọi người dự kiến.

RTX 5080 nhanh hơn, nhưng nó hiếm khi cho phép bạn chạy một mô hình lớn hơn có ý nghĩa. Trong thực tế, bạn vẫn phải giảm batch size, cắt ngắn context length, hoặc offload sang system RAM chỉ để giữ các lần chạy hoạt động.

Đó là lý do bài viết này mang lại cái nhìn thực tế, không lý tưởng về RTX 5070 Ti so với RTX 5080 cho deep learning, cùng với một bộ tùy chọn phù hợp nếu mục tiêu của bạn là huấn luyện, fine-tune, hoặc serving các mô hình mà không bị giới hạn VRAM liên tục.

Nếu bạn chỉ đọc một phần, hãy đọc phần specs và phần "capacity vs speed"; chúng là hai phần giúp bạn không mua nhầm.

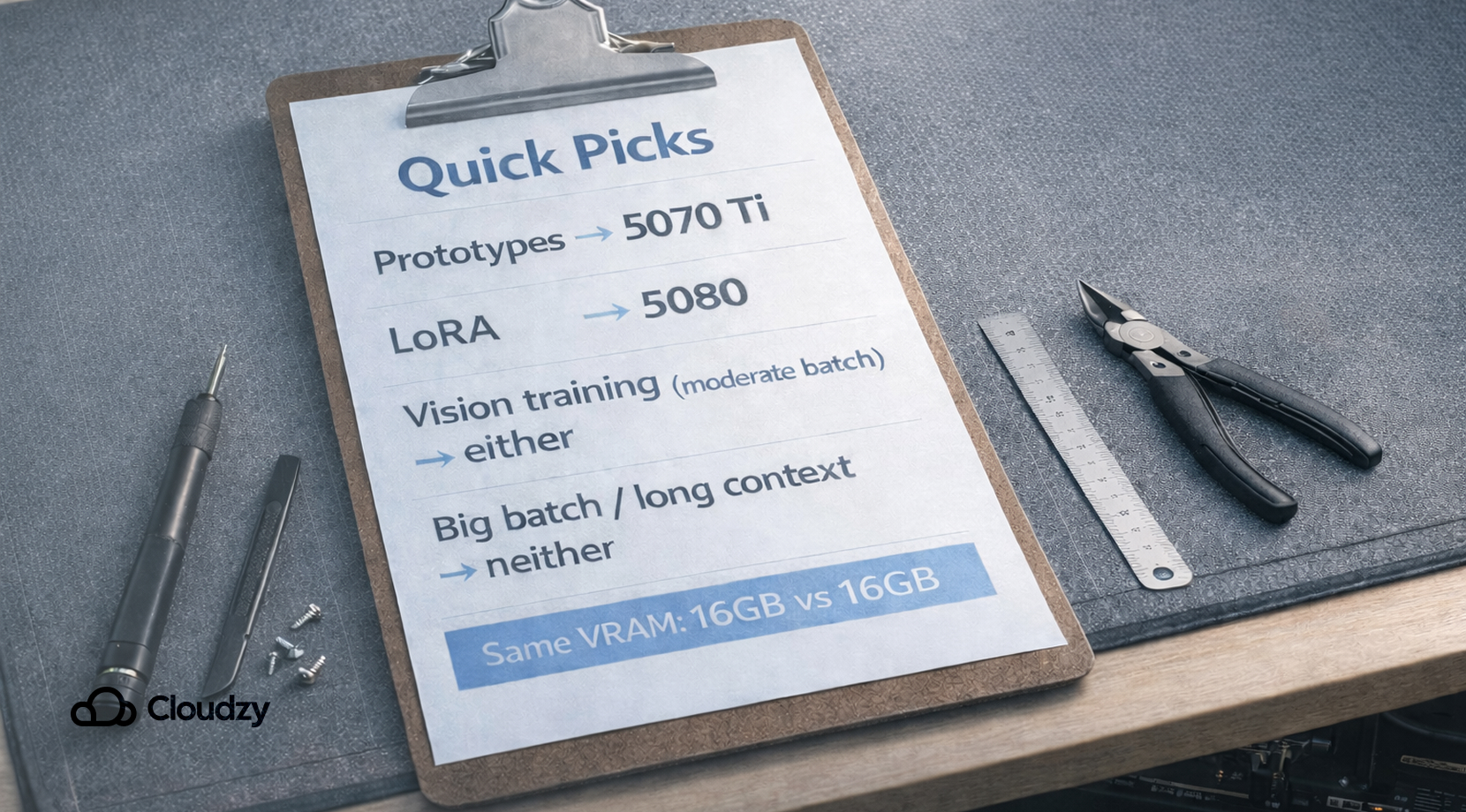

Quick Picks Dựa Trên Công Việc Của Bạn

Hầu hết mọi người không mua GPU một cách bừa bãi. Chúng tôi thấy bốn kiểu tư duy người mua phổ biến lặp đi lặp lại, và quyết định giữa 5070 Ti vs 5080 khác nhau với mỗi loại.

Nhà Phát Triển Địa Phương

Bạn chạy notebooks, thay đổi cài đặt quantization, và quan tâm hơn đến "nó hoạt động" hơn là throughput hoàn hảo. Đối với bạn, lựa chọn giữa 5070 Ti vs 5080 thường được quyết định bởi ngân sách, vì cả hai card sẽ hoạt động tốt trên các mô hình nhỏ và quantized inference, rồi cả hai đều chạm vào giới hạn VRAM khi bạn tăng context length hoặc batch size.

Sinh Viên Cao Học Huấn Luyện Các Mô Hình Vision

Bạn muốn các thí nghiệm có thể lặp lại, không phải thử lại liên tục. Chi phí ẩn không phải là card; nó là thời gian bạn mất khi các lần chạy thất bại ở epoch 3 vì dataloader, augmentations, và mô hình cạnh tranh nhau để có bộ nhớ.

Kỹ Sư Startup Triển Khai Inference

Bạn quan tâm đến tail latency và concurrency. Một demo một người dùng có thể trông tuyệt vời trên 16 GB, rồi traffic production xuất hiện, và áp lực KV cache tiêu hao VRAM của bạn như một rò rỉ chậm. Đối với serving, 5070 Ti vs 5080 có thể gây mất tập trung nếu vấn đề thực tế của bạn là capacity cho batching và long prompts.

Người Tạo Nội Dung Cũng Làm ML

Bạn chuyển đổi giữa các ứng dụng sáng tạo và ML tooling, và bạn ghét khởi động lại, sự cố driver, và "đóng Chrome để huấn luyện". Đối với bạn, 5070 Ti vs 5080 chỉ có ý nghĩa nếu GPU là một phần của quy trình làm việc sạch sẽ, không phải một workstation yếu ớt rơi vào trạng thái không hoạt động ngay khi bạn multitask.

Với những trường hợp đó trong tâm trí, hãy cùng đi vào chi tiết về phần cứng và tại sao yếu tố giới hạn là giống nhau ở những nơi quan trọng.

Specs Ưu Tiên Cao Cho Deep Learning

Cách nhanh nhất để hiểu 5070 Ti vs 5080 là bỏ qua các con số marketing và tập trung vào dòng bộ nhớ.

Nếu bạn muốn xem bảng spec đầy đủ, đây là một bảng chi tiết tập trung vào những gì ảnh hưởng nhất đến hành vi huấn luyện và inference. (Tốc độ xung nhịp và đầu ra màn hình rất hấp dẫn, nhưng chúng không quyết định xem lần chạy của bạn có vừa không.)

| Thông số (Máy tính để bàn) | RTX 5070 Ti | RTX 5080 | Tại Sao Nó Xuất Hiện trong DL |

| VRAM | 16 GB | 16 GB | Dung lượng là tường cứng cho weights, activations, và KV cache |

| Loại Bộ Nhớ | GDDR7 | GDDR7 | Hành vi tương tự, bandwidth giúp, nhưng dung lượng quyết định "vừa hay không" |

| Đường truyền Bộ nhớ | 256-bit | 256-bit | Giới hạn aggregate bandwidth; giúp throughput, không kích thước mô hình |

| Lõi CUDA | 8,960 | 10,752 | Compute nhiều hơn giúp tokens/sec, không "có thể tải được không" |

| Điện Năng Tiêu Thụ Điển Hình | 300 W | 360 W | Nhiều nhiệt độ và headroom PSU hơn, không có thêm VRAM |

Nguồn chính thức cho specs: RTX 5080, Gia đình RTX 5070

Nói chung, 5080 là card nhanh hơn, 5070 Ti là cái rẻ hơn. Với deep learning, sự khác biệt thường chỉ thấy rõ khi khối lượng công việc của bạn đã vừa với bộ nhớ.

Tiếp theo, chúng ta sẽ xem tại sao VRAM cạn kiệt rất nhanh, ngay cả trên những setup nhìn qua thì vẻ nhẹ.

Tại Sao VRAM Bị Cạn Kiệt Nhanh Chóng Trong Deep Learning

Người chuyển sang từ gaming thường cho rằng VRAM giống như một texture pool. Với deep learning, nó giống hơn một mặt bàn bếp hẹp. Bạn không chỉ cần chỗ cho nguyên liệu, mà còn cần chỗ để cắt, nấu, và plating, tất cả cùng lúc.

Đây là những gì thường nằm trong VRAM khi chạy:

- Trọng số mô hình: các tham số bạn tải, đôi khi ở FP16/BF16, đôi khi đã được lượng tử hóa.

- Kích hoạt: các tensor trung gian được lưu cho backprop, thường là thứ chiếm bộ nhớ nhất trong training.

- Gradients và optimizer state: overhead của training có thể nhân lên nhu cầu bộ nhớ.

- bộ nhớ cache KV: overhead của inference tăng theo độ dài context và số lượng yêu cầu đồng thời.

Đây là lý do tại sao 5070 Ti vs 5080 giống như tranh cãi về công suất động cơ trong khi bạn đang kéo một trailer nặng quá. Bạn có thể có nhiều mã lực hơn, nhưng công suất kéo vẫn là cái giới hạn.

Một cách nhanh để kiểm tra mà chúng tôi dùng trong testing là ghi lại cả bộ nhớ được cấp phát và được dự trữ trong PyTorch. PyTorch's CUDA memory notes giải thích về caching allocator và tại sao bộ nhớ lại có vẻ "đang dùng" trong các công cụ như nvidia-smi ngay cả sau khi tensor được giải phóng.

Điều này dẫn chúng ta đến điểm chính của cuộc thảo luận này, đó là hầu hết các lỗi deep learning trên 16 GB không phải vì nó chậm, mà vì bạn gặp OOM tại thời điểm tồi tệ nhất.

Những Khối Lượng Công Việc Đầu Tiên Làm Gãy 5070 Ti vs 5080

Dưới đây là những mô hình deep learning thường chạm đến giới hạn bộ nhớ trước tiên trên 5070 Ti vs 5080.

LLM Serving với Long Prompts và Real Concurrency

Một prompt đơn lẻ ở 2K tokens có vẻ ổn. Thêm context dài hơn, thêm batching, thêm một người dùng nữa, và KV cache bắt đầu tăng. Lúc đó 5070 Ti vs 5080 sụp đổ về cùng một kết quả, nơi bạn phải giới hạn max context hoặc giảm batch size để tồn tại.

Một phương pháp kiểm tra đơn giản:

- Chạy server của bạn với max context và batch thực tế của bạn.

- Quan sát VRAM theo thời gian, không chỉ ở lúc khởi động.

- Ghi nhận thời điểm latency tăng đột biến, rồi kiểm tra mức sử dụng bộ nhớ trong cùng khoảng thời gian đó.

Nếu bạn muốn một setup monitoring đáng tin cậy mà không trở thành một dự án riêng biệt, hướng dẫn của chúng tôi về Phần mềm giám sát GPU bao gồm các mô hình ghi nhật ký CLI thực tế hoạt động tốt trên các chạy thực tế.

Tinh chỉnh LoRA hoặc QLoRA

Nhiều người nói rằng "LoRA chạy được trên 16 GB," và họ không sai. Nhưng đừng quên rằng phần còn lại của pipeline của bạn cũng cần tài nguyên. Tokenization buffers, dataloader workers, mixed precision scaling, và validation steps sẽ tích lũy rất nhanh.

Trên thực tế, vấn đề ở đây không phải khả năng tính toán mà là lợi nhuận. Nếu bạn không có dự phòng VRAM, bạn sẽ phải canh chừng từng lần chạy.

Huấn luyện Mô hình Thị giác với Đầu vào Độ phân giải Cao

Các mô hình hình ảnh có một điểm yếu khó lường: một bước tăng độ phân giải nhỏ, hoặc một kỹ thuật augmentation thêm, có thể đẩy bạn từ trạng thái ổn định sang OOM. Trên 5070 Ti so với 5080, điều này biểu hiện là batch size sụp xuống 1, rồi gradient accumulation biến quá trình training thành một vòng lặp chậm từng bước.

Chạy Multimodal trên một GPU

Text encoder + image encoder + fusion layers có thể chạy được; tuy nhiên, nếu bạn tăng sequence length hoặc thêm vision backbone lớn hơn, lượng memory cần dùng sẽ tăng vọt rất nhanh.

"GPU của tôi vẫn ổn, nhưng máy tính để bàn của tôi thì không"

Đây là tình huống dễ gặp nhất. Bạn bắt đầu huấn luyện, rồi trình duyệt, IDE, và mọi thứ khác bạn chạy đều chiếm VRAM, và đột nhiên "cấu hình ổn định" của bạn bị hỏng. Người dùng trên diễn đàn than phiền về việc phải đóng tất cả các ứng dụng, vô hiệu hóa overlay, nhưng vẫn gặp lỗi OOM trên cùng một model mà họ chạy hôm qua.

Mô hình đó xuất hiện liên tục trong Thảo luận về 5070 Ti vs 5080, cũng vậy, vì cả hai card đều ở cùng mức giới hạn. Nếu những vấn đề này quen thuộc với bạn, câu hỏi tiếp theo là "chúng ta phải làm gì với giới hạn này?"

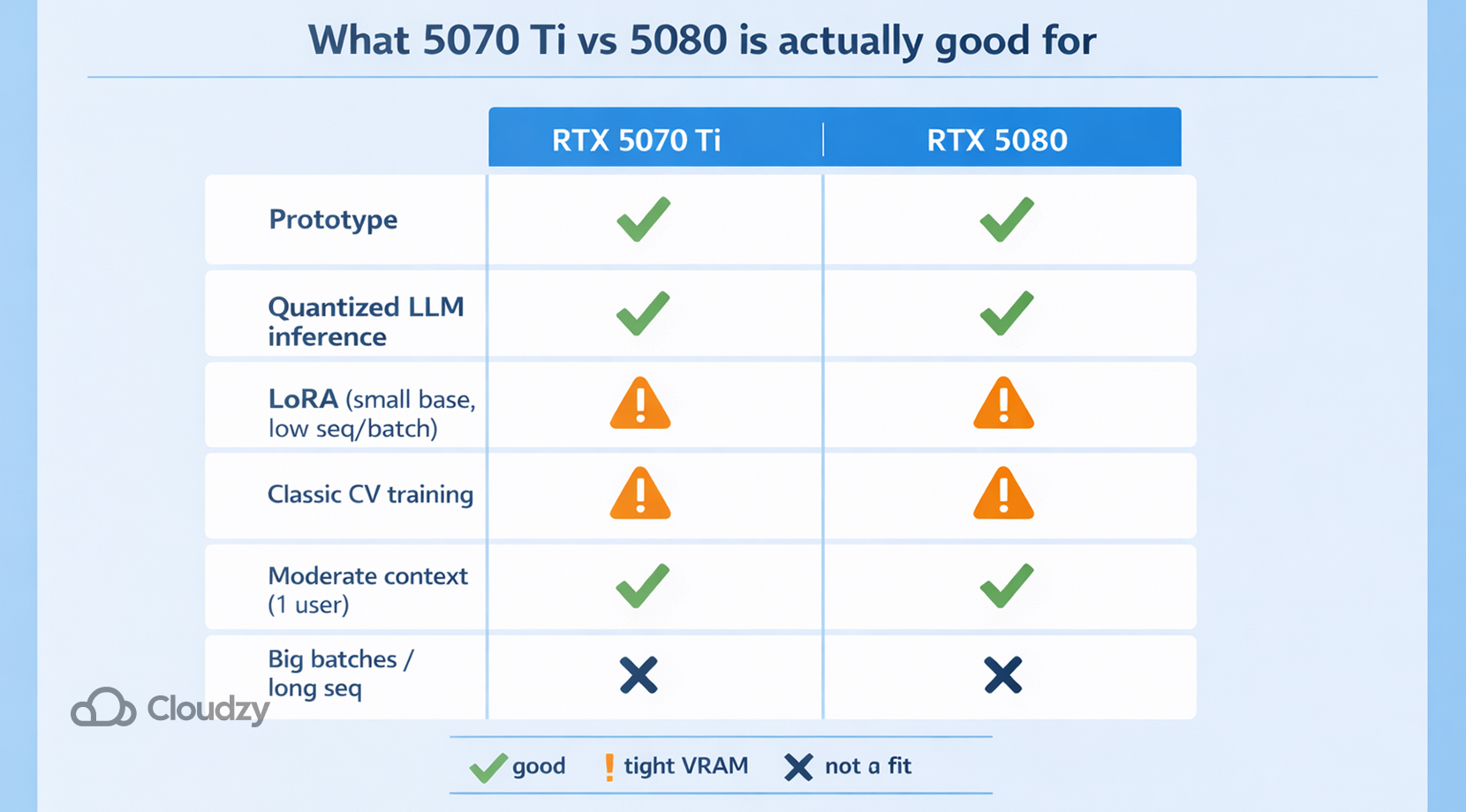

5070 Ti so với 5080 dùng để làm gì - Actually Good

16 GB bị chê trong cộng đồng ML, nhưng nó không vô dụng. Chỉ là hạn chế thôi.

RTX 5070 Ti và RTX 5080 hoàn toàn đủ cho:

- Công việc nguyên mẫu: các thử nghiệm nhỏ, kiểm tra nhanh chóng, và xác minh logic.

- Suy luận Quantized LLM: các mô hình nhỏ hơn với ngữ cảnh vừa phải, một người dùng.

- LoRA trên các mô hình cơ sở nhỏ hơn: miễn là bạn kiểm soát được độ dài sequence và batch size.

- Đào tạo tầm nhìn cơ bản: kích thước ảnh vừa phải, mô hình vừa phải, cần nhiều thời gian hơn.

Điều quan trọng là nếu công việc của bạn nằm trong giới hạn bộ nhớ, 5080 thường sẽ nhanh hơn 5070 Ti, và bạn sẽ hưởng lợi từ sức tính toán bổ sung.

Nhưng ngay khi bạn thử làm deep learning "nghiêm túc", bạn sẽ gặp ngay vấn đề về bộ nhớ. Vậy hãy nói về các cách xử lý hiệu quả trên cả hai card.

Cách Tối Ưu Hóa VRAM Giới Hạn Mà Không Làm Khó Khăn Quá Trình Huấn Luyện

Những thủ thuật này không phải là phép thuật. Đó là những bước cần thiết để giữ 5070 Ti vs 5080 hoạt động hiệu quả trong thời gian dài.

Bắt Đầu Bằng Đo Lường

Trước khi chỉnh sửa hyperparameters, hãy lấy số đỉnh VRAM trên mỗi bước. Trong PyTorch, max_memory_allocated() và max_memory_reserved() có những cách nhanh để thấy quá trình chạy của bạn thực sự làm gì.

Điều đó giúp bạn trả lời các câu hỏi như:

- Chi phí chính có phải từ mô hình hay từ activations?

- VRAM có tăng đột ngột trong quá trình validation không?

- Sự phân mảnh có tăng lên theo thời gian không?

Khi có một số liệu cơ sở, phần còn lại sẽ ít ngẫu nhiên hơn.

Giảm Bộ Nhớ Ở Những Nơi Có Thể

Một "thứ tự thực hiện" đơn giản mà chúng tôi sử dụng:

- Giảm batch size cho đến khi vừa.

- Thêm gradient accumulation để lấy lại batch hiệu quả.

- Bật mixed precision (BF16/FP16) nếu stack của bạn hỗ trợ.

- Thêm gradient checkpointing nếu activations chiếm ưu thế.

- Chỉ sau đó mới bắt đầu điều chỉnh kích thước mô hình.

Xem Context Length Như Một Ngân Sách

Đối với transformers, context length là yếu tố sẽ gây ra vấn đề lớn nhất. Nó ảnh hưởng đến tính toán attention và, đối với inference, kích thước KV cache. Trên 5070 Ti vs 5080, bạn sẽ nhận thấy ngay khi vượt quá vài nghìn tokens vì VRAM tăng nhanh, throughput giảm, và bạn phải giảm batch size chỉ để duy trì hoạt động.

Một phương pháp được đề xuất:

- Chọn max context mặc định mà bạn có thể chạy với dư lượng.

- Tạo một profile thứ hai cho "context dài", batch thấp hơn.

- Không kết hợp cả hai khi bạn debug.

Đừng Nhầm Lẫn PyTorch Cache Với Memory Leaks Thực Sự

Nhiều báo cáo "memory leak" thực chất là hành vi của allocator. Tài liệu PyTorch đề cập rằng caching allocator có thể giữ lại bộ nhớ dự trữ ngay cả sau khi tensors được giải phóng, và empty_cache() phần lớn giải phóng các khối cached không sử dụng trở lại các ứng dụng khác, không phải trở lại PyTorch.

Điều này quan trọng vì người dùng 5070 Ti vs 5080 thường bị phân tán bởi các rò rỉ giả tưởng thay vì tập trung vào nguồn rò rỉ thực sự: kích thước batch, độ dài sequence, và bộ nhớ activation.

Những điều chỉnh này làm cho giới hạn bộ nhớ của họ sử dụng được, nhưng chúng không thay đổi thực tế cốt lõi. Nếu dự án của bạn cần những mô hình lớn hơn, context dài hơn, hay concurrency cao hơn, bạn cần thêm VRAM.

Tôi Có Cần Dung Lượng hay Tốc Độ Giữa 5070 Ti vs 5080

Bạn có thể nhìn vấn đề này như sau: tốc độ là bạn lái xe nhanh bao nhiêu, dung lượng là bạn chở được bao nhiêu hành khách. Deep learning quan tâm cả hai, nhưng dung lượng quyết định liệu bạn có thể rời khỏi bãi đậu xe ngay từ đầu hay không.

5080 có thể cung cấp throughput cao hơn 5070 Ti trong nhiều workload. Nhưng 5070 Ti vs 5080 không thay đổi "tôi có thể tải nó và chạy nó" vì cả hai đều chạm tới giới hạn của chúng.

Đó là lý do tại sao mọi người lại thất vọng sau một nâng cấp. Họ cảm nhận được mức tăng tốc độ trong các bài kiểm tra nhỏ, rồi thử workload thực tế của họ và chạm vào bức tường tương tự. Bức tường chỉ đến muộn thêm 30 giây.

Vì vậy nếu bạn đang mua sắm với deep learning trong tâm trí, sẽ hữu ích khi quyết định bạn thuộc nhóm nào:

- Bị giới hạn tốc độ: bạn đã vừa, bạn chỉ muốn các bước nhanh hơn.

- Giới hạn về dung lượng: bạn không vừa sạch sẽ, và bạn dành thời gian thu nhỏ vấn đề.

Hầu hết mọi người nghiên cứu 5070 Ti vs 5080 cho deep learning đều ở nhóm thứ hai, ngay cả khi họ chưa nhận ra điều đó.

Bây giờ hãy nói về tùy chọn thường tiết kiệm được nhiều thời gian nhất: chuyển "công việc lớn" cho một GPU lớn hơn, mà không cần xây dựng lại toàn bộ cuộc sống xung quanh một rig địa phương mới.

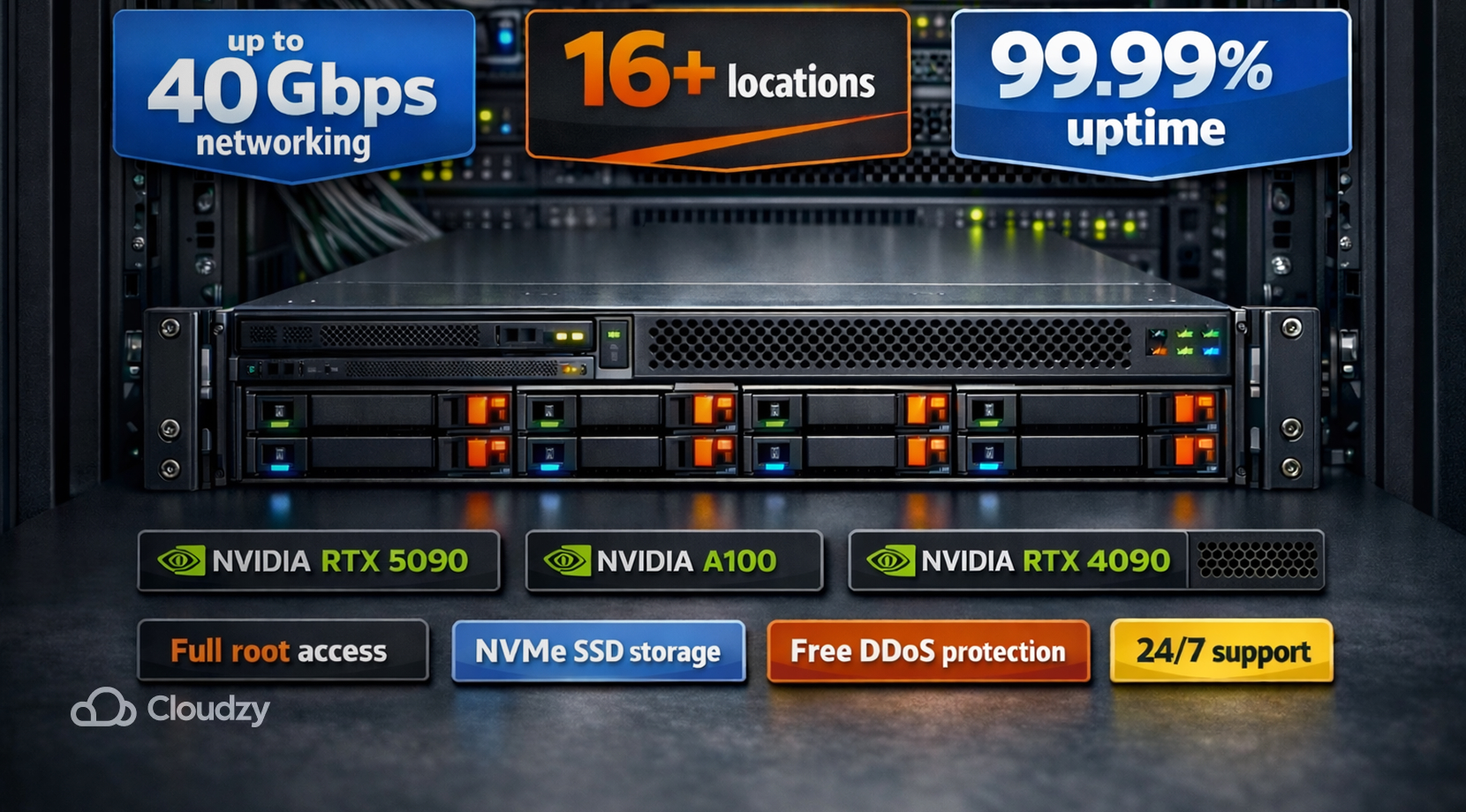

Một Giải Pháp Kinh Tế: Sử Dụng GPU VPS cho Các Tác Vụ Nặng

Trong nhóm infra của chúng tôi, pattern phổ biến nhất mà chúng tôi thấy là mọi người làm prototype cục bộ, rồi họ chạm tới một điểm mà 5070 Ti vs 5080 không còn quan trọng nữa, vì công việc đơn giản là không vừa.

Đó là thời điểm bạn muốn truy cập vào một pool VRAM lớn hơn để training và thử nghiệm serving thực tế. Đó chính xác là nơi Cloudzy GPU VPS là một sự lựa chọn hoàn hảo.

Các gói GPU VPS của chúng tôi bao gồm các tùy chọn NVIDIA như RTX 5090, A100, và RTX 4090, cộng với full root access, lưu trữ NVMe SSD, networking lên tới 40 Gbps, 12 vị trí, bảo vệ DDoS miễn phí, hỗ trợ 24/7, và mục tiêu uptime 99.95%.

Nhưng điều này giúp bạn như thế nào, cho dù là 5070 Ti vs 5080, hay bất kỳ GPU nào ở cùng level? À thì:

- Bạn có thể chạy mô hình thực tế và profile prompt của mình trên hardware với nhiều VRAM hơn, nên các quyết định trở nên rõ ràng từ chính các log của bạn.

- Bạn có thể giữ GPU địa phương của mình cho dev và quick tests, rồi thuê "big card" chỉ cho các tác vụ nặng.

Nếu bạn muốn có một bài ôn tập nhanh về GPU VPS thực sự là gì, và có nghĩa gì khi nói đến GPU dedicated vs shared access, hướng dẫn cho người mới bắt đầu của chúng tôi giải thích rõ ràng.

Và nếu bạn vẫn không chắc liệu bạn có cần GPU hay không cho workload của mình, thì GPU so với CPU VPS so sánh này sẽ giúp bạn hiểu rõ những yêu cầu phần cứng thực tế cho các công việc như huấn luyện mô hình, suy luận, cơ sở dữ liệu và ứng dụng web.

Khi đã có hạ tầng, bước cuối cùng là chọn quy trình làm việc không lãng phí thời gian của bạn.

Quy trình đơn giản để xác định những gì bạn cần

Nhiều người làm ML gặp phải tình huống khó chọn: mua card consumer cao cấp hơn hoặc chịu đựng hạn chế. Thực tế, 5070 Ti so với 5080 vẫn có thể phù hợp trong quy trình làm việc bình thường nếu bạn dùng nó để phát triển trên máy cục bộ, không phải làm toàn bộ production.

Dưới đây là quy trình mà chúng tôi thấy hiệu quả:

- Sử dụng 16 GB GPU của bạn để viết code, debug và chạy thử nghiệm nhỏ.

- Giữ sẵn một template môi trường "GPU lớn" để chạy từ xa.

- Di chuyển các bài kiểm tra huấn luyện và triển khai cần nhiều tài nguyên tới GPU VPS.

- Theo dõi các lần chạy và lưu nhật ký để kết quả có thể lặp lại.

Nếu bạn muốn tìm hiểu sâu hơn về cách chọn đúng loại GPU cho công việc ML nói chung, hãy xem bài tổng hợp của chúng tôi về GPUs tốt nhất cho machine learning là bước tiếp theo hữu ích.

Vậy, về cơ bản, 5070 Ti so với 5080 là lựa chọn về tính toán cục bộ, nhưng mở rộng deep learning là lựa chọn về cơ sở hạ tầng. Nói về mở rộng, nếu bạn tò mò về cách một loại card lớn hơn thay đổi hành vi AI thực tế, hãy xem H100 so với RTX 4090 benchmark so sánh này rất hữu ích vì nó luôn quay trở lại cùng một chủ đề: VRAM phù hợp trước, sau đó là tốc độ.