Si estás decidiendo H100 frente a RTX 4090 para IA, ten en cuenta que la mayoría de los «benchmarks» no importan hasta que tu modelo y caché encajen realmente en VRAM. RTX 4090 es el punto óptimo para trabajos con una sola GPU que no superen los 24 GB.

H100 es lo que necesitas cuando tus modelos son más grandes, la concurrencia es mayor, precisas aislamiento multiusuario o quieres dejar de hacer malabarismos con la memoria.

Lo desglosaremos por cargas de trabajo, veremos los tipos de benchmarks y te daré un plan de pruebas rápido que puedes ejecutar en tu propio entorno.

Respuesta rápida: H100 vs RTX 4090 para cargas de trabajo de IA

H100 es mejor para entrenamiento de modelos grandes y servicio en producción, gracias a sus grandes pools de HBM, alto ancho de banda de memoria, NVLink y MIG para aislamiento. RTX 4090 es mejor si buscas gran velocidad en una sola GPU a mejor precio, siempre que tu carga de trabajo quepa en 24 GB sin compromisos constantes. Las especificaciones y las características de la plataforma lo dejan bastante claro.

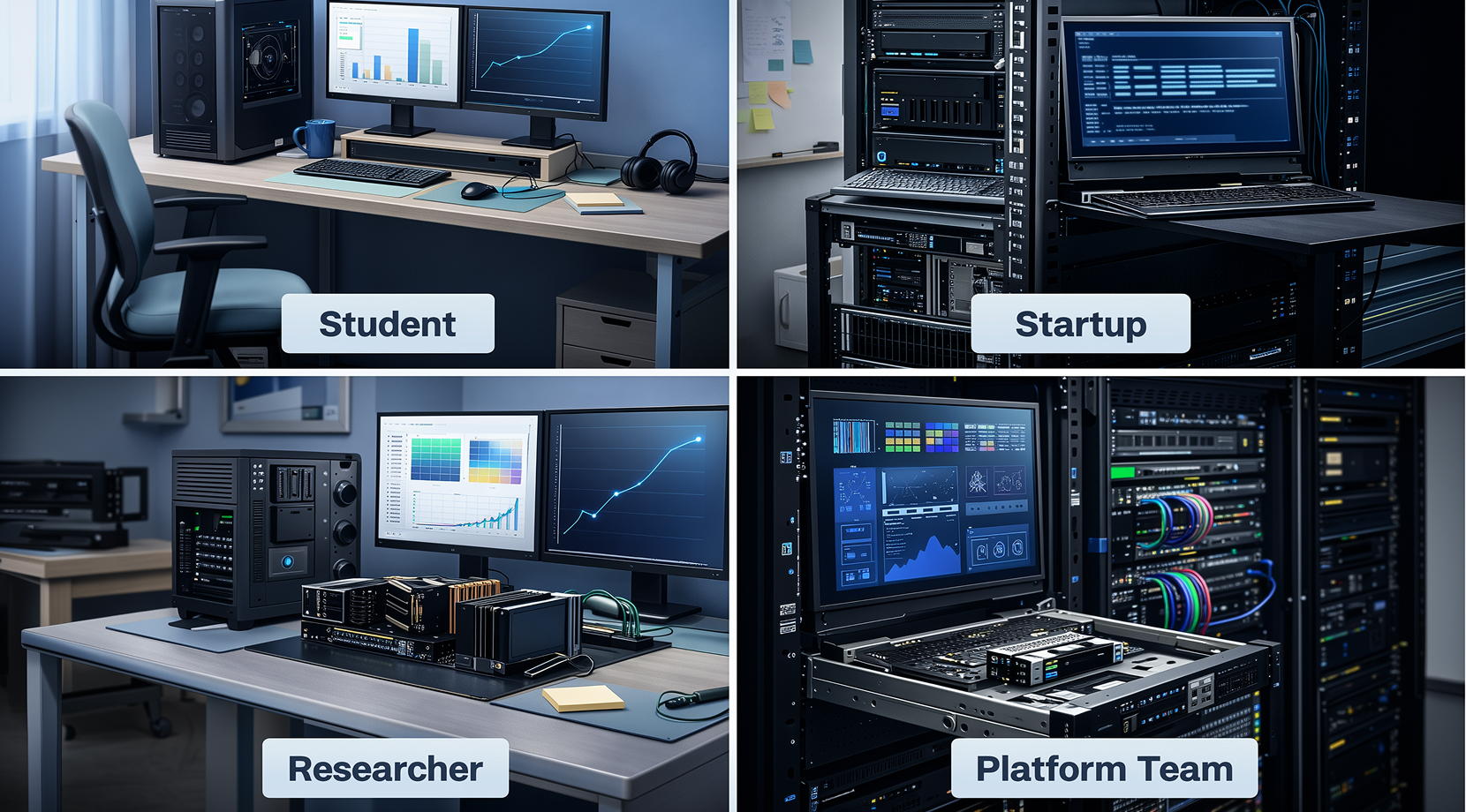

Aquí tienes la lista de elección rápida por perfil de usuario:

- Desarrollador de LLM local (dev en solitario / estudiante): RTX 4090 hasta que VRAM se convierta en el cuello de botella.

- Ingeniero ML en una startup (lanzando un MVP): RTX 4090 para servicio y fine-tuning en etapas tempranas; H100 cuando necesites concurrencia estable o modelos más grandes.

- Investigador aplicado (muchos experimentos): H100 si sigues encontrándote con OOM, límites de batch o contextos largos.

- Equipo de producción / plataforma (servicio multi-tenant): H100 para particionado con MIG, mayor margen de memoria y un escalado más fluido.

Con ese contexto, el resto del artículo trata sobre los límites con los que la gente se topa en la práctica y cómo encajan los números de los benchmarks con ellos.

La única pregunta de benchmark que importa: ¿qué tiene que caber en VRAM?

La mayoría de los debates sobre H100 frente a RTX 4090 son en el fondo argumentos sobre VRAM. En el trabajo con LLM, VRAM la consume pesos, activaciones durante el entrenamiento, estados del optimizador en el entrenamiento, y la Caché KV durante la inferencia. Este último es el que suele sorprender, porque crece con la longitud del contexto y la concurrencia.

La tabla siguiente es deliberadamente general, porque el ajuste exacto depende del framework, la precisión y la sobrecarga.

Una visión rápida de si todo cabe sin problemas:

| Carga de trabajo | Realidad típica en RTX 4090 (24 GB) con una sola GPU | Realidad típica en H100 (80–94 GB) con una sola GPU |

| Inferencia de LLM 7B (FP16 / BF16) | Generalmente buena | Margen cómodo |

| Inferencia de LLM 13B | Ajustado a menudo; depende del contexto | Generalmente buena |

| Inferencia de clase 70B | Requiere cuantización o descarga agresiva | Mucho más viable |

| Inferencia SD/SDXL + lote pequeño | Generalmente buena | Sin problemas, con mayor margen para el lote |

| Servicio con mayor concurrencia | La presión de la caché KV se nota rápido | Más margen, mayor estabilidad bajo carga |

Si quieres una lista más amplia de GPU (no solo estas dos), nuestro resumen de Las mejores GPU para machine learning en 2025 es una tabla de referencia práctica para VRAM y el ancho de banda de memoria entre las GPU más usadas en IA.

Una vez que sabes que tu carga de trabajo encaja, lo que determina qué tan fluida se siente en la práctica es el ancho de banda de memoria.

Ancho de banda: por qué HBM se siente diferente

Gran parte del debate sobre rendimiento en IA se centra en los picos de cómputo, pero los transformers son muy sensibles al movimiento de datos en memoria. La ventaja del H100 es que combina grandes bancos HBM con un ancho de banda de memoria muy alto, además de ancho de banda NVLink y particionamiento MIG en la plataforma.

Resumen de especificaciones

Las especificaciones no elegirán el GPU por ti, pero sí explican por qué la misma carga de trabajo se siente cómoda en una tarjeta y ajustada en la otra. Este resumen muestra qué factores influyen más en el entrenamiento, la inferencia y el comportamiento de servicio del LLM.

| Especificación | H100 (SXM / NVL) | RTX 4090 |

| VRAM | 80 GB / 94 GB | 24 GB |

| Ancho de banda de memoria | 3,35–3,9 TB/s | GDDR6X (limitado por capacidad a 24 GB) |

| Interconexión | NVLink + PCIe Gen5 | PCIe (plataforma de consumo) |

| Multi-instancia | Hasta 7 instancias MIG | No disponible |

Referencias de especificaciones: NVIDIA H100, NVIDIA RTX 4090.

Lo que esto significa en la práctica:

- Si intentas aumentar el tamaño del batch o la longitud del contexto, el H100 tiende a mantenerse estable durante más tiempo antes de que tengas que hacer concesiones.

- Si atiendes muchas peticiones simultáneas, el H100 tiene más margen de memoria disponible, así que la latencia de cola no se dispara tan rápido.

- Si tu trabajo es mayormente de un solo usuario, un solo modelo y contexto moderado, la 4090 suele sentirse rápida y suficiente.

El ancho de banda no reemplaza un buen benchmarking, eso sí. Solo explica por qué dos GPU pueden parecer similares en una prueba acotada y luego divergir bajo carga real.

Benchmarks fiables: H100 vs RTX 4090

No todos los benchmarks son iguales, y por eso «mis números no coinciden con los tuyos» es algo que pasa constantemente. Para H100 frente a RTX 4090, conviene dividir los benchmarks en dos categorías:

- Vía A (enfoque comunitario): llama.cpp-style tokens/sec tests and simple inference scripts.

- Vía B (suites estandarizadas): Resultados al estilo de MLPerf Training y MLPerf Inference, centrados en reglas reproducibles.

Instantánea de inferencia estilo Llama.cpp

Este es el tipo de prueba que la gente ejecuta en casa y luego discute durante tres días. Es útil porque refleja una cadena de herramientas real que muchos desarrolladores utilizan, pero también es fácil malinterpretarla si se ignoran el ajuste y la precisión.

Las comparativas públicas al estilo de llama.cpp muestran que la RTX 4090 rinde muy bien con modelos pequeños y ejecuciones cuantizadas, mientras que los modelos grandes a mayor precisión superan con creces el límite de la VRAM.

Este es el patrón que debes esperar:

| Modelo | GPU | Resultado típico |

| Clase 7B | RTX 4090 | Tokens/seg elevados, inferencia fluida para un solo usuario |

| Clase 13B | RTX 4090 | Aún buen rendimiento, pero el contexto y la sobrecarga empiezan a pesar |

| Clase 70B | RTX 4090 | No cabe bien sin cuantización agresiva o descarga de capas |

| Clase 70B | H100 | Mucho más viable mantenerlo residente y servirlo de forma estable |

El objetivo de esta tabla no es decir «la 4090 es mala» ni «la H100 es mágica». La cuestión es que el límite de VRAM de la VRAM determina cuánto puedes mantener residente, y eso afecta a la velocidad, la estabilidad y el tiempo que pasarás ajustando parámetros.

Si estás recortando constantemente la longitud del contexto solo para mantenerte a flote, ahí es cuando esta comparativa deja de ser teórica.

Qué aporta MLPerf que los benchmarks de foros no ofrecen

MLPerf existe porque «scripts aleatorios e intuiciones» no son suficientes cuando estás tomando una decisión de varios miles de dólares. MLCommons ha incorporado cargas de trabajo más recientes al estilo de IA generativa con el tiempo, y MLPerf está diseñado para hacer que los resultados sean más comparables entre sistemas.

En el lado del entrenamiento, el informe de MLPerf Training v5.1 de NVIDIA es un buen ejemplo de cómo los fabricantes reportan el tiempo de entrenamiento con detalles sobre el entorno de envío y las reglas del benchmark que siguen.

Esta comparativa no te dirá cómo se comportan tus prompts privados, pero sí es una prueba de que el sistema escala correctamente y de cómo rinde esta categoría de hardware bajo esas condiciones.

Ahora hablemos de lo que más influye en la decisión de compra: el tiempo y el dinero que cuesta terminar el trabajo.

Coste, tiempo y coste de oportunidad

Muchos H100 frente a RTX 4090 Las decisiones suelen plantearse como "precio de compra frente a precio de alquiler". Ese raramente es el enfoque correcto. Un enfoque mejor es: ¿cuántas horas necesitas para producir un modelo que puedas usar de verdad, y cuánto tiempo pierdes luchando contra las limitaciones?

Tres escenarios habituales muestran bien estas diferencias.

Fine-tuning semanal en modelos pequeños y medianos

Si tus ejecuciones caben en 24 GB sin compromisos constantes, la 4090 es una opción excelente. Iteras rápido, no tienes que reservar tiempo en un clúster y la configuración es sencilla. Si cada ejecución se convierte en "reducir el batch, recortar el contexto, volver a intentarlo", H100 es una opción mucho más sensata, a pesar del coste mayor.

Servicio con concurrencia real

La concurrencia presiona la caché KV rápidamente. Aquí es donde la capacidad adicional de H100 y sus controles de plataforma demuestran su valor, especialmente si necesitas latencia predecible.

Si todavía estás evaluando si un servidor GPU es la opción adecuada para tu despliegue, nuestro Cloudzy vs DigitalOcean análisis es una forma útil de relacionar la carga de trabajo con el tipo de infraestructura antes de perder tiempo optimizando lo que no toca.

Trabajos de entrenamiento grandes con plazos fijos

En cuanto escala más allá de una persona y una máquina, lo que importa son las cosas sin glamour: entornos estables, menos puntos de fallo y menos tiempo perdido en lo que básicamente es supervisión constante. Para eso está diseñado H100.

Si aún tienes dudas después de esta sección, el siguiente paso no es seguir leyendo. Es observar cómo se comporta tu stack en la práctica, incluyendo la fricción con los drivers y las cargas de trabajo multiusuario.

Software y operaciones: drivers, estabilidad, multiusuario y soporte

Esta es la parte que la mayoría de los gráficos de benchmarks ignoran, pero representa una buena parte del día a día.

RTX 4090 es popular porque es accesible y rápida para muchos flujos de trabajo de IA. El problema es que, cuando tu caso de uso crece, es más probable que te topes con los límites de memoria y los patrones de escalado que no están pensados para entornos compartidos y multiinquilino.

H100 está diseñada para clústeres. MIG es clave para los equipos de plataforma porque permite dividir una GPU en particiones aisladas, lo que reduce los problemas de "vecino ruidoso" y facilita mucho la planificación de capacidad. Las especificaciones oficiales de NVIDIA para H100 indican hasta 7 instancias MIG según el factor de forma.

Si tu carga de trabajo es personal y local, puedes trabajar cómodamente con la 4090 durante mucho tiempo. Si es multiusuario y de cara al cliente, H100 es la opción más segura.

Entonces, en definitiva, ¿quién debería elegir qué?

Cuál elegir según tu carga de trabajo

En cuanto al H100 frente a RTX 4090, la opción correcta es, en última instancia, la que elimina tus mayores obstáculos.

LLM local para desarrolladores en solitario o estudiantes

Elige RTX 4090 si trabajas principalmente en el rango de 7B a 13B, ejecutas inferencia cuantizada, experimentas con RAG o trabajas con SDXL. Da el salto cuando pases más tiempo lidiando con la memoria que construyendo lo que querías construir.

ML Engineer en una startup (lanzando un MVP)

Si tu MVP es un modelo único con tráfico moderado y cabe sin problemas, la 4090 es un buen punto de partida. Si necesitas latencia estable bajo picos de carga, mayor concurrencia o varias cargas de trabajo por servidor, H100 es la opción más tranquila.

Investigador aplicado (muchos experimentos)

Si te ves obligado constantemente a hacer concesiones como reducir el batch size o hacer malabares con la precisión, H100 te da experimentos más limpios y menos ejecuciones fallidas.

Equipo de producción / plataforma (serving multi-tenant)

H100 es la elección obvia, principalmente porque MIG y el mayor margen disponible simplifican la planificación de capacidad y reducen el impacto cuando algo se dispara.

Si todavía no quieres comprometerte con hardware fijo, alquilar es el mejor paso siguiente.

Un camino intermedio práctico: alquila GPUs primero y luego decide

La forma más clara de salir de dudas H100 frente a RTX 4090 es ejecutar tu modelo, tu prompts y tu longitud de contexto en ambas clases de hardware, y luego comparar tokens/seg y latencia de cola bajo carga.

Por eso mismo construimos Cloudzy GPU VPS, ya que puedes tener un servidor GPU en menos de un minuto, instalar tu stack con acceso root completo y dejar de adivinar basándote en el benchmark de otro.

Esto es lo que obtienes con nuestros planes GPU VPS:

- GPUs NVIDIA dedicadas (incluidas opciones de tipo RTX 4090 y A100) para que tus resultados no se vean afectados por vecinos ruidosos.

- Hasta 40 Gbps de red en todos los planes GPU, lo que marca una gran diferencia para descargar datasets, flujos de trabajo multi-nodo y mover artefactos rápidamente.

- Almacenamiento NVMe SSD, más DDR5 RAM y opciones CPU de alta frecuencia en todos los niveles, para que el resto del servidor no lastre a la GPU.

- Protección DDoS y un 99,95 % de disponibilidad, para que los trabajos largos no se vean arruinados por ruido aleatorio en la red.

- Facturación por horas (práctico para sprints cortos de benchmarking) y un Garantía de devolución de 14 días para pruebas de bajo riesgo.

Primero ejecuta el mismo conjunto de pruebas de rendimiento en un plan RTX 4090 y, cuando empieces a trabajar con contextos más grandes, mayor concurrencia o modelos más pesados, repítelas en un plan de tipo A100. A partir de ahí, elegir entre H100 frente a RTX 4090 suele quedar claro con tus propios registros.

Lista de pruebas de rendimiento: ejecútalas en 30 minutos

Si quieres una decisión que puedas justificar, obtén cuatro métricas del mismo stack que planeas desplegar:

- Tokens/s a tu longitud de contexto objetivo

- Latencia p95 a tu concurrencia esperada

- Margen de VRAM durante la fase de mayor carga

- Coste por ejecución completada de inicio a artefacto

Una prueba básica con vLLM tiene esta forma:

pip install vllm transformers accelerate

python -m vllm.entrypoints.api_server \

--model meta-llama/Llama-3-8B-Instruct \

--dtype float16 \

--max-model-len 8192Si quieres entender bien qué estás contratando realmente, nuestro artículo sobre ¿Qué es una GPU VPS? explica la diferencia entre acceso dedicado a GPU, compartición de vGPU y qué comprobar antes de elegir un plan.