Si tu plan es comprar una nueva GPU para dejar de ver errores de memoria insuficiente, el debate 5070 Ti vs 5080 no es el correcto. Ambas tarjetas tienen 16 GB de VRAM, y ese límite de capacidad aparece en el deep learning antes de lo que la mayoría espera.

La 5080 es más rápida, pero rara vez te permite ejecutar un modelo significativamente más grande. En la práctica, acabas reduciendo el tamaño del batch, recortando la longitud del contexto o descargando a la RAM del sistema solo para mantener los procesos en marcha.

Por eso este artículo ofrece una visión honesta y realista de la 5070 Ti vs 5080 para deep learning, además de una serie de opciones que se ajustan mejor si tu objetivo es entrenar, ajustar o servir modelos sin tener que lidiar constantemente con las limitaciones de VRAM.

Si solo vas a leer una parte, lee la sección de especificaciones y la de «capacidad vs velocidad»: son las dos que te evitan comprar lo que no necesitas.

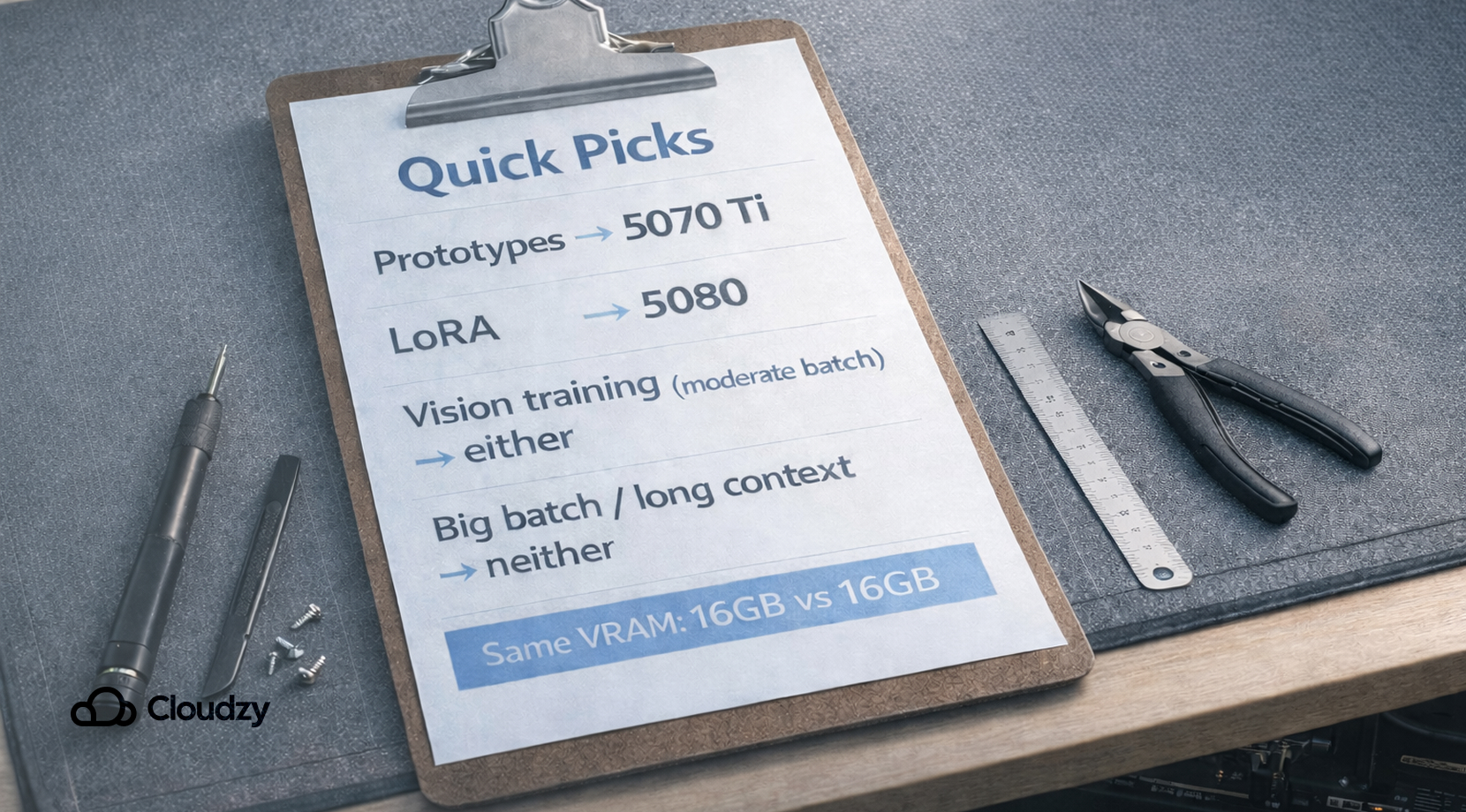

Recomendaciones rápidas según lo que haces

La mayoría no compra GPUs a la ligera. Vemos cuatro perfiles de comprador que se repiten una y otra vez, y la elección entre 5070 Ti y 5080 tiene implicaciones distintas para cada uno.

El experimentador local con LLM

Ejecutas notebooks, cambias ajustes de cuantización y te importa más que "funcione" que el rendimiento perfecto. Para ti, la decisión entre 5070 Ti y 5080 suele reducirse al presupuesto, porque ambas tarjetas se sentirán bien con modelos pequeños e inferencia cuantizada, y las dos tocan el mismo techo de VRAM en cuanto aumentas la longitud de contexto o el tamaño del lote.

El estudiante de posgrado entrenando modelos de visión

Quieres experimentos reproducibles, no reintentos interminables. El coste oculto no es la tarjeta en sí, sino el tiempo que pierdes cuando los entrenamientos fallan en la época 3 porque el dataloader, las augmentaciones y el modelo compiten por memoria.

El ingeniero de startup desplegando inferencia

Te preocupan la latencia extrema y la concurrencia. Una demo para un solo usuario puede verse bien con 16 GB, pero cuando llega el tráfico de producción, la presión de la KV cache devora tu VRAM como una fuga lenta. Para servir modelos, el debate 5070 Ti vs 5080 puede ser una distracción si tu problema real es la capacidad para batching y prompts largos.

El creador que también hace ML

Saltas entre aplicaciones creativas y herramientas de ML, y odias los reinicios, los problemas de drivers y el "cierra Chrome para entrenar". Para ti, la elección entre 5070 Ti y 5080 solo tiene sentido si la GPU forma parte de un flujo de trabajo limpio, no de una estación de trabajo frágil que se cae en cuanto haces multitarea.

Con estos casos en mente, vamos a ser concretos sobre el hardware y por qué el factor limitante es el mismo en los aspectos que importan.

Especificaciones clave para deep learning

La forma más rápida de entender la diferencia entre 5070 Ti y 5080 es ignorar los números de marketing y centrarse en la línea de memoria.

Si quieres ver la hoja de especificaciones completa, aquí tienes una tabla detallada centrada en lo que más afecta al comportamiento de entrenamiento e inferencia. (Las velocidades de reloj y las salidas de pantalla llaman la atención, pero no determinan si tu entrenamiento cabe en memoria.)

| Especificación (escritorio) | RTX 5070 Ti | RTX 5080 | Por qué importa en DL |

| VRAM | 16 GB | 16 GB | La capacidad es el límite estricto para pesos, activaciones y KV cache |

| Tipo de memoria | GDDR7 | GDDR7 | Comportamiento similar; el ancho de banda ayuda, pero la capacidad decide si "cabe o no" |

| Bus de memoria | 256 bits | 256 bits | Limita el ancho de banda agregado; mejora el rendimiento, no el tamaño del modelo |

| Núcleos CUDA | 8,960 | 10,752 | Más potencia de cómputo ayuda con tokens/seg, no con «¿puedo cargarlo?» |

| Potencia típica de la tarjeta | 300 W | 360 W | Más calor y mayor margen en la fuente de alimentación, sin VRAM adicional |

Fuentes oficiales de especificaciones: RTX 5080, Familia RTX 5070

En pocas palabras: la 5080 es la tarjeta más rápida y la 5070 Ti es la más económica. En deep learning, la diferencia se nota principalmente cuando tu carga de trabajo ya cabe en memoria.

A continuación, veremos por qué VRAM se agota tan rápido, incluso en configuraciones que parecen ligeras sobre el papel.

Por qué VRAM se consume tan rápido en deep learning

Quienes vienen del mundo del gaming suelen pensar que VRAM funciona como un pool de texturas. En deep learning, se parece más a una encimera diminuta: no solo necesitas espacio para los ingredientes, sino también para picar, cocinar y emplatar, todo al mismo tiempo.

Esto es lo que suele ocupar VRAM durante una ejecución:

- Pesos del modelo: los parámetros que cargas, a veces en FP16/BF16, a veces cuantizados.

- Activaciones: tensores intermedios guardados para la retropropagación, normalmente el mayor consumidor de memoria durante el entrenamiento.

- Gradientes y estado del optimizador: la sobrecarga del entrenamiento, que puede multiplicar las necesidades de memoria.

- Caché KV: la sobrecarga de inferencia que crece con la longitud del contexto y la concurrencia.

Por eso el debate entre 5070 Ti y 5080 puede parecer discutir sobre potencia de motor mientras remolcas un tráiler demasiado pesado. Puedes tener más caballos, pero la capacidad del enganche sigue siendo el límite.

Una comprobación rápida que usamos en nuestras propias pruebas es registrar tanto la memoria asignada como la reservada en PyTorch. Las notas de memoria CUDA de PyTorch explican el asignador de caché y por qué la memoria puede aparecer como «en uso» en herramientas como nvidia-smi incluso después de liberar los tensores.

Esto nos lleva al punto principal de esta discusión: la mayoría de los fallos en deep learning con 16 GB no se deben a que sea lento en sí, sino a que te quedas sin memoria en el peor momento posible.

Los Primeros Casos de Uso que Marcan la Diferencia entre 5070 Ti y 5080

A continuación se describen los patrones de deep learning que suelen alcanzar primero los límites de memoria en 5070 Ti vs 5080.

LLM con Prompts Largos y Concurrencia Real

Un prompt simple de 2K tokens puede parecer que funciona bien. Añade más contexto, añade batching, añade un segundo usuario, y la caché KV empieza a crecer. Ahí es cuando 5070 Ti vs 5080 llega al mismo resultado: recortar el contexto máximo o reducir el batch size para no colapsar.

Un método de comprobación sencillo:

- Ejecuta tu servidor con el contexto máximo y el batch real.

- Observa VRAM a lo largo del tiempo, no solo al arrancar.

- Anota el momento en que la latencia se dispara y comprueba el uso de memoria en la misma ventana temporal.

Si quieres una solución de monitorización fiable que no se convierta en un proyecto independiente, nuestra guía sobre software de monitorización GPU recoge patrones prácticos de logging por CLI que funcionan bien en ejecuciones reales.

Fine-Tuning con LoRA o QLoRA

Mucha gente dice que "LoRA funciona con 16 GB", y no se equivocan. El problema está en asumir que el resto del pipeline es gratuito. Los buffers de tokenización, los workers del dataloader, el escalado de precisión mixta y los pasos de validación se acumulan muy rápido.

En la práctica, el cuello de botella aquí no es la computación, sino el margen. Si no tienes VRAM de sobra, acabas vigilando las ejecuciones constantemente.

Entrenamiento de Visión con Entradas de Alta Resolución

Los modelos de imagen tienen un modo de fallo traicionero: un pequeño aumento en la resolución, o una augmentación adicional, puede hacerte pasar de estable a OOM de golpe. En 5070 Ti vs 5080, esto se traduce en que el batch size cae a 1 y la acumulación de gradientes convierte el entrenamiento en un bucle a cámara lenta.

Ejecuciones Multimodales en un Solo GPU

El encoder de texto, el encoder de imagen y las capas de fusión pueden funcionar bien; sin embargo, si aumentas la longitud de secuencia o añades un backbone de visión más grande, la acumulación de memoria se vuelve brutal.

"Mi GPU Va Bien, Mi Escritorio No"

Este es el más familiar. Empiezas a entrenar, y entonces el navegador, el IDE y todo lo demás que tienes abierto se apoderan de VRAM, y de repente tu configuración "estable" deja de funcionar. Usuarios en foros se quejan de cerrarlo todo, desactivar los overlays y seguir obteniendo OOM con el mismo modelo que corrieron el día anterior.

Ese patrón aparece constantemente en Debates sobre 5070 Ti vs 5080, también, porque ambas tarjetas comparten el mismo límite de capacidad. Si esto te resulta familiar, la siguiente pregunta es: "¿qué hacemos con ese límite?"

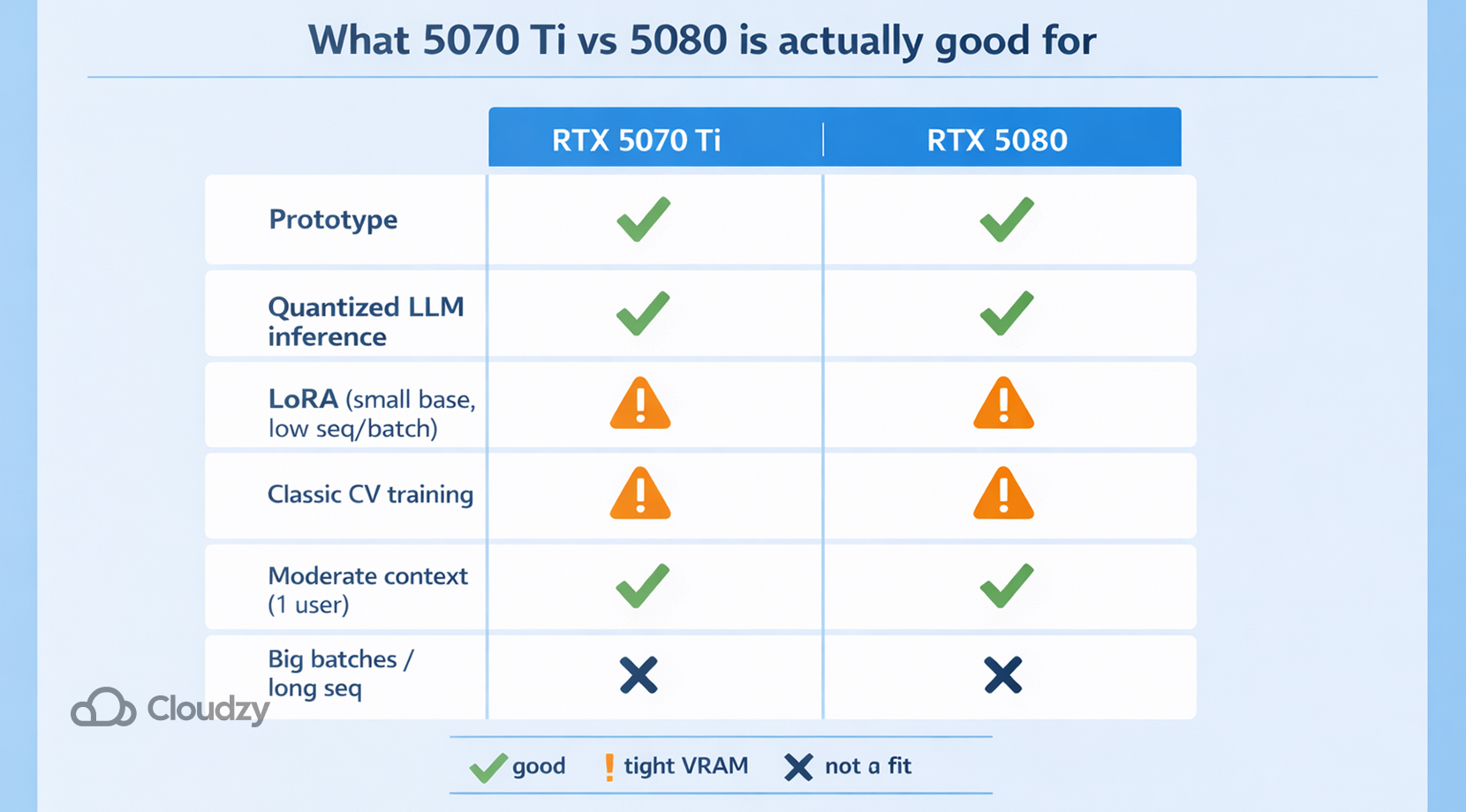

Para qué sirve realmente el 5070 Ti vs 5080

Es fácil criticar los 16 GB en los círculos de ML, pero no son inútiles. Simplemente tienen un alcance limitado.

El 5070 Ti vs 5080 puede ser una opción perfectamente válida para:

- Trabajo con prototipos: experimentos pequeños, ablaciones rápidas y pruebas de cordura.

- Inferencia con LLM cuantizados: modelos más ligeros con contexto moderado, un solo usuario.

- LoRA sobre modelos base más pequeños: siempre que mantengas la longitud de secuencia y el tamaño de lote bajo control.

- Entrenamiento de visión clásica: imágenes de tamaño moderado, backbones moderados y algo más de paciencia.

La clave es que, si tu trabajo se mantiene dentro del límite de memoria, el 5080 generalmente se sentirá más ágil que el 5070 Ti y aprovecharás la capacidad de cómputo adicional.

Pero en cuanto intentes hacer deep learning "en serio", te toparás con problemas de margen de memoria. Así que hablemos de las técnicas que ayudan en ambas tarjetas.

Cómo aprovechar al máximo una VRAM limitada sin que el entrenamiento sea un suplicio

Ninguno de estos trucos es magia. Son simplemente las técnicas que permiten que el 5070 Ti vs 5080 siga siendo útil durante más tiempo.

Empieza midiendo

Antes de tocar los hiperparámetros, obtén el pico de VRAM por paso. En PyTorch, max_memory_allocated() y max_memory_reserved() son formas rápidas de ver qué está haciendo realmente tu ejecución.

Eso te ayuda a responder preguntas como:

- ¿El coste principal viene del modelo en sí o de las activaciones?

- ¿VRAM se dispara durante la validación?

- ¿La fragmentación va aumentando con el tiempo?

Una vez que tienes una línea base, el resto deja de ser tan impredecible.

Reduce la memoria donde sea posible

Un orden de operaciones sencillo que aplicamos:

- Reduce el tamaño del batch hasta que encaje.

- Añade acumulación de gradientes para recuperar el batch efectivo.

- Activa la precisión mixta (BF16/FP16) si tu stack lo permite.

- Añade gradient checkpointing si las activaciones dominan el consumo.

- Solo entonces empieza a ajustar el tamaño del modelo.

Trata la longitud de contexto como un presupuesto

En los transformers, la longitud de contexto es el factor que más problemas genera. Afecta al cómputo de atención y, durante la inferencia, al tamaño del caché KV. Con la 5070 Ti frente a la 5080, lo notarás en cuanto superes unos pocos miles de tokens: VRAM se dispara rápidamente, el throughput cae y, de repente, tienes que reducir el tamaño del batch solo para mantener el sistema en marcha.

Un enfoque recomendado:

- Elige un contexto máximo por defecto con el que puedas operar con margen.

- Crea un segundo perfil para «contexto largo» con un batch más reducido.

- No mezcles ambos mientras depuras.

No confundas el caché de PyTorch con fugas reales

Muchos informes de «fuga de memoria» son en realidad el comportamiento normal del asignador. La documentación de PyTorch indica que el asignador con caché puede mantener memoria reservada incluso después de liberar los tensores, y que empty_cache() principalmente devuelve bloques en caché no utilizados a otras aplicaciones, no al propio PyTorch.

Esto importa porque los usuarios de 5070 Ti y 5080 suelen perder el tiempo persiguiendo fugas fantasma en lugar de las fuentes reales: el tamaño del batch, la longitud de secuencia y la memoria de activaciones.

Estos ajustes hacen que el límite de memoria sea más aprovechable, pero no cambian la realidad de fondo. Si tu proyecto requiere modelos más grandes, contextos más largos o mayor concurrencia, necesitas más VRAM.

¿Necesito capacidad o velocidad entre la 5070 Ti y la 5080?

Una forma de verlo: la velocidad es lo rápido que puedes circular, y la capacidad es cuántos pasajeros puedes llevar. El deep learning depende de ambas, pero la capacidad decide si puedes salir del aparcamiento.

La 5080 puede ofrecer mayor throughput que la 5070 Ti en muchas cargas de trabajo. Pero la comparativa 5070 Ti frente a 5080 no cambia la pregunta de «¿puedo cargarlo y ejecutarlo?», porque ambas llegan a sus límites.

Por eso la gente acaba decepcionada después de una actualización. Nota la mejora de velocidad en pruebas pequeñas, luego ejecuta su carga de trabajo real y choca contra el mismo muro. Solo que el muro llega 30 segundos más tarde.

Por eso, si estás evaluando opciones pensando en deep learning, conviene que determines en qué grupo te encuentras:

- Limitado por velocidad: ya tienes suficiente memoria, solo quieres pasos más rápidos.

- Limitado por capacidad: el modelo no cabe directamente y pierdes tiempo reduciéndolo.

La mayoría de las personas que comparan 5070 Ti vs 5080 para deep learning están en el segundo grupo, aunque aún no lo sepan.

Ahora hablemos de la opción que normalmente ahorra más tiempo: delegar el «trabajo pesado» a una GPU más potente, sin tener que reorganizar todo tu entorno local.

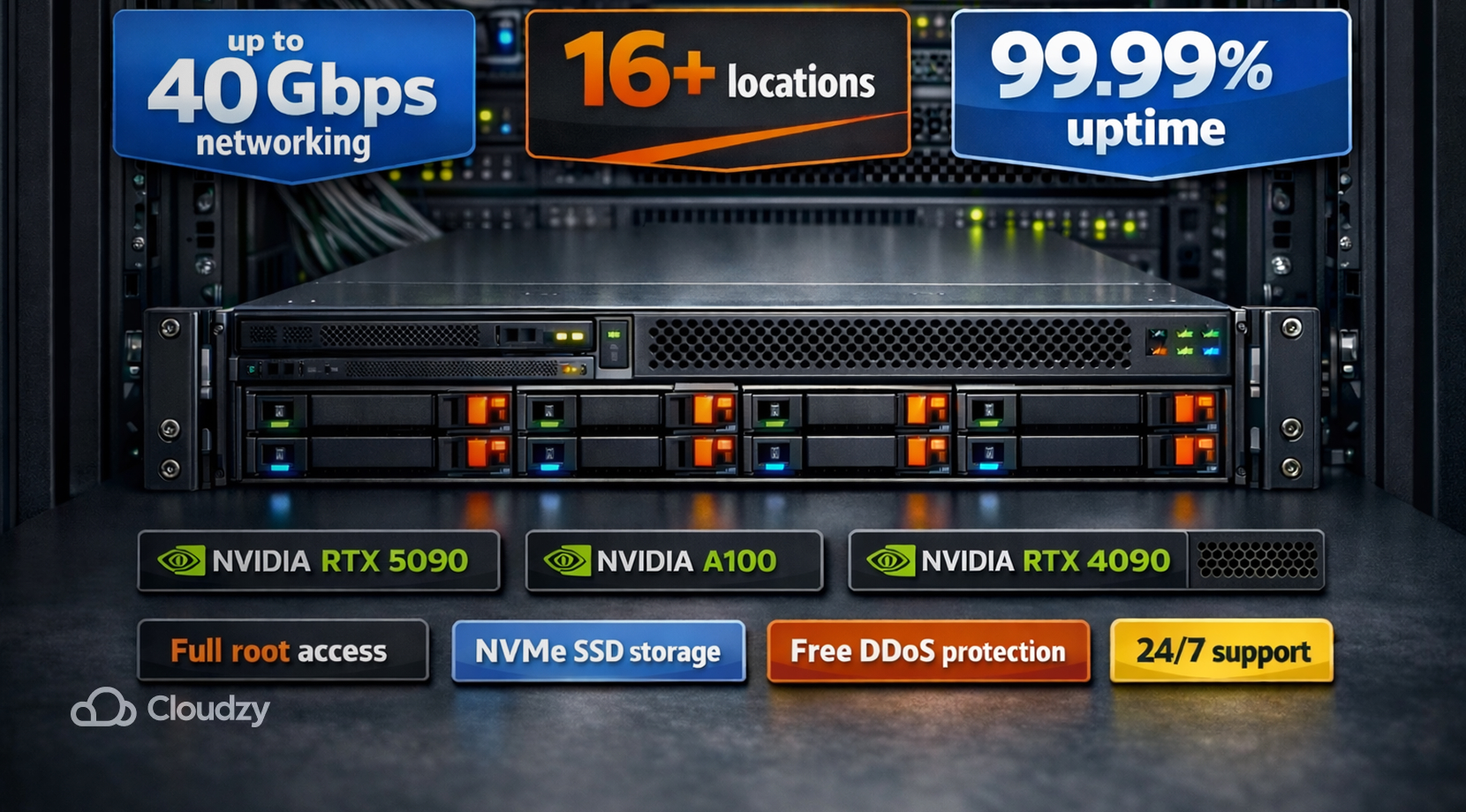

Una solución asequible: usa un VPS GPU para las ejecuciones más exigentes

En nuestro equipo de infraestructura, el patrón más habitual es que la gente hace prototipos en local hasta que llega un punto en el que la comparación 5070 Ti vs 5080 deja de importar, porque el trabajo sencillamente no cabe.

Ese es el momento en el que necesitas acceso a un pool de VRAM mayor para entrenar y hacer pruebas de inferencia reales. Y para eso Cloudzy GPU VPS encaja perfectamente.

Nuestros planes de GPU VPS incluyen opciones NVIDIA como RTX 5090, A100 y RTX 4090, además de acceso root completo, almacenamiento NVMe SSD, red de hasta 40 Gbps, 12 ubicaciones, protección DDoS gratuita, soporte 24/7 y un objetivo de disponibilidad del 99,95 %.

Pero ¿cómo te ayuda esto, ya sea con 5070 Ti vs 5080 o con cualquier otra GPU del mismo nivel? Así:

- Puedes ejecutar tu modelo real y tu perfil de prompts en hardware con más VRAM, de modo que las decisiones quedan claras a partir de tus propios registros.

- Puedes usar tu GPU local para desarrollo y pruebas rápidas, y alquilar la «tarjeta grande» solo cuando el trabajo lo requiera.

Si quieres repasar qué es exactamente un VPS GPUy qué diferencia hay entre acceso dedicado y compartido a una GPU, nuestra guía para principiantes lo explica con claridad.

Y si todavía no tienes claro si tu carga de trabajo necesita una GPU, nuestra comparativa GPU frente a CPU VPS te dará una idea concreta de qué hardware requieren tareas reales como entrenamiento, inferencia, bases de datos y aplicaciones web.

Con la infraestructura resuelta, lo último es elegir un flujo de trabajo que no te haga perder el tiempo.

Un flujo de trabajo sencillo para identificar lo que necesitas

Muchos desarrolladores de ML se quedan atrapados en una elección falsa: comprar la tarjeta de consumo más potente o conformarse con menos. En la práctica, la 5070 Ti vs 5080 puede encajar perfectamente en un flujo de trabajo sensato si la tratas como herramienta de desarrollo local, no como tu stack de producción completo.

Este es un flujo de trabajo que hemos visto funcionar bien:

- Usa tu GPU de 16 GB para programar, depurar y hacer experimentos pequeños.

- Ten preparada una plantilla de entorno con una GPU más potente para ejecuciones remotas.

- Mueve el entrenamiento y las pruebas de inferencia que necesiten más margen a una GPU VPS.

- Monitoriza las ejecuciones y guarda los registros para que los resultados sean reproducibles.

Si quieres profundizar más en cómo elegir la clase de GPU adecuada para trabajo de ML en general, nuestro resumen de las mejores GPUs para machine learning es un buen siguiente paso.

En definitiva, la elección entre 5070 Ti vs 5080 es una decisión de cómputo local, pero escalar deep learning es una decisión de infraestructura. Hablando de escala, si tienes curiosidad sobre cómo una tarjeta de mayor clase cambia el comportamiento real de la IA, nuestro análisis comparativo de H100 vs RTX 4090 es una comparación útil porque vuelve constantemente al mismo principio: primero que encaje la VRAM, luego la velocidad.