Machine learning en de deeltak deep learning vragen enorme rekenkracht, en die kan alleen een GPU leveren. Maar niet elke GPU is geschikt. Dit zijn de beste GPUs voor machine learning, waarom ze onmisbaar zijn, en hoe je de juiste kiest voor jouw project.

Waarom heb ik een GPU nodig voor machine learning?

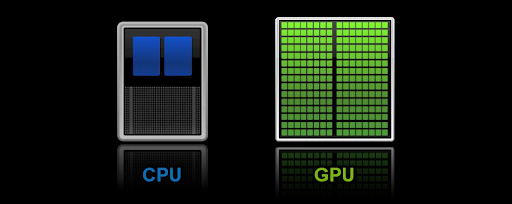

Zoals eerder vermeld heeft machine learning enorme rekenkracht nodig die alleen GPUs kunnen leveren. CPUs werken prima voor kleinschalige toepassingen, maar alles wat zwaarder is dan single-threaded taken of algemene berekeningen leidt al snel tot frustraties en knelpunten. Het grote verschil in rekenkracht komt neer op de parallelle verwerkingscapaciteit van de GPU en het enorme verschil in aantal cores. Een gemiddelde CPU heeft 4 tot 16 cores, terwijl de beste GPUs voor machine learning duizenden cores kunnen hebben, met name tensor-cores die elk tegelijkertijd een klein deel van de berekening afhandelen.

Die parallelle verwerking is de sleutel tot het verwerken van matrix- en lineaire algebraberekeningen, en dat gaat een GPU veel beter af dan een CPU. Daarom zijn GPUs zoveel geschikter voor taken als het trainen van grote machine-learningmodellen. De beste GPU voor machine learning kiezen is echter niet eenvoudig.

Hoe kies je de beste GPU voor AI en DL

De meeste GPUs zijn krachtig genoeg voor standaardtaken, maar machine learning en deep learning vragen een heel ander niveau van rekenkracht en kwaliteit. De vraag is dus: wat maakt een GPU geschikt voor deep learning?

Een goede GPU voor deep learning moet aan de volgende eisen voldoen:

CUDA-cores, tensor-cores en compatibiliteit

AMD en Nvidia bieden de beste GPUs voor machine learning en DL, waarbij de laatste duidelijk de bovenhand heeft. Dit is te danken aan de Tensor- en CUDA-cores van Nvidia. Tensor-cores verwerken berekeningen die veelvoorkomend zijn in AI en machine learning, zoals matrixvermenigvuldigingen en convoluties (gebruikt in diepe neurale netwerken). CUDA-cores stellen de beste GPUs voor AI-training in staat om parallelle verwerking uit te voeren door bewerkingen efficiënt te verdelen over de GPU. GPUs zonder deze twee hebben doorgaans moeite met ML- en DL-workloads.

Dat gezegd hebbende heeft AMD met recente upgrades aan het ROCm-platform en MI-serie accelerators zijn GPUs verbeterd, en je zult ze tegenkomen in onze lijst. Toch blijven de GPUs van Nvidia de beste voor deep learning, dankzij het goed geoptimaliseerde software-ecosysteem en brede framework-ondersteuning (bijv. TensorFlow, PyTorch, JAX). De beste GPUs voor machine learning moeten hoge compatibiliteit bieden met deze ML-frameworks, want een mismatch leidt tot inefficiënties in acceleratie, driver- en bibliotheekondersteuning (bijv. NVIDIA's cuDNN, TensorRT) en toekomstbestendige schaalbaarheid.

Mogelijk heb je ook geen volledige toegang tot tools uit de NVIDIA CUDA-toolkit, zoals GPU-versnelde bibliotheken, een C- en C++-compiler en -runtime, en optimalisatie- en debuggingtools.

VRAM (video-RAM), geheugenstandaard en geheugenbandbreedte

Zoals bij alles wat met computers te maken heeft, is RAM belangrijk - en dat geldt ook voor de beste GPUs voor machine learning en DL. Omdat datasets voor het trainen van machine learning-modellen extreem groot kunnen worden (tot meerdere TB's voor deep learning), moeten de beste GPUs voor machine learning voldoende VRAM hebben voor snelle toegang. Deep learning-modellen hebben namelijk aanzienlijk geheugen nodig om gewichten, activaties en andere tussenliggende gegevens op te slaan tijdens training en inferentie. De beste GPU voor AI-training moet ook een goede geheugenbandbreedte hebben, zodat je grote datasets snel kunt verplaatsen en berekeningen kunt versnellen.

Tot slot is de geheugenstandaard een belangrijke factor bij het kiezen van de beste GPUs voor deep learning. GPUs gebruiken doorgaans GDDR (Graphics Double Data Rate) of HBM (High Bandwidth Memory). Hoewel GDDR-geheugen hoge bandbreedte biedt voor toepassingen zoals machine learning en gaming, gebruiken de beste machine learning GPUs HBM, dat een veel hogere bandbreedte heeft met betere efficiëntie.

| GPU-type | VRAM-capaciteit | Geheugenbandbreedte | Geheugen Standaard | Geschikt voor |

| Instapniveau (bijv. RTX 3060, RTX 4060) | 8GB – 12GB | ~200-300 GB/s | GDDR6 | Kleine modellen, beeldclassificatie, hobbyprojecten |

| Middensegment (bijv. RTX 3090, RTX 4090) | 24GB | ~1.000 GB/s | GDDR6X | Grote datasets, diepe neurale netwerken, transformers |

| High-end AI GPUs (bijv. Nvidia A100, H100, AMD MI300X) | 40GB – 80GB | ~1.600+ GB/s | HBM2 | Grote taalmodellen (LLMs), AI-onderzoek, ML op bedrijfsschaal |

| Ultra high-end GPUs (bijv. Nvidia H100, AMD Instinct MI300X) | 80GB – 256GB | ~2.000+ GB/s | HBM3 | grootschalige AI-training, supercomputing, onderzoek op massale datasets |

Voor wie specifiek werkt aan grote taalmodellen zoals ChatGPT, Cloudzy biedt een ChatGPT-geoptimaliseerde VPS oplossing met het vermogen dat nodig is voor soepele fine-tuning en inferentie.

TFLOPS (teraflops) en floating-point precisie

De prestaties van een GPU worden bepaald door zijn rekenkracht. Die hangt af van drie factoren: TFLOPS, geheugenbandbreedte en floating-point precisie. Geheugenbandbreedte hebben we al besproken bij de beste GPU voor AI-training. Hier lees je wat de andere twee betekenen en waarom ze belangrijk zijn. TFLOPS, oftewel teraflops, is de eenheid die meet hoe snel een GPU complexe berekeningen uitvoert. In plaats van de kloksnelheid van een processor te meten (het aantal cycli per seconde), geeft TFLOPS aan hoeveel biljoen floating-point bewerkingen een GPU per seconde kan uitvoeren. Kort gezegd vertelt TFLOPS je hoe krachtig een GPU is bij rekenintensieve taken.

Floating-point precisie geeft daarentegen aan, zoals de naam al suggereert, hoe nauwkeurig het model kan werken. De beste GPUs voor deep learning gebruiken hogere precisie (bijv. FP32), wat nauwkeurigere berekeningen oplevert maar ten koste gaat van snelheid. Lagere precisie (bijv. FP16) versnelt de verwerking met iets minder nauwkeurigheid, wat voor AI- en deep learning-taken vaak acceptabel is.

Start met bloggen

Start met bloggen

Host je eigen WordPress op hoogwaardige hardware met NVMe-opslag en minimale latentie wereldwijd. Kies je eigen distro.

WordPress VPS instellen| Nauwkeurigheid | Gebruiksscenario | Voorbeeldtoepassingen |

| FP32 (enkele precisie) | Training van deep learning-modellen | Beeldherkenning (ResNet, VGG) |

| TF32 (TensorFloat-32) | Gemengde-precisie training | NLP, aanbevelingssystemen |

| FP16 (Halve Precisie) | Snelle inferentie | Autonoom rijden, spraakherkenning, AI-videoverbeteringen |

In plaats van zwaar te investeren in fysieke hardware, heb je direct toegang tot Cloudzy's Deep Learning GPU VPS, aangedreven door RTX 4090s, geoptimaliseerd voor machine learning en deep learning workloads.

Beste GPUs voor machine learning in 2025

Nu je een goed beeld hebt van wat de beste GPUs voor machine learning moeten bieden, volgt hier onze lijst van de beste GPUs, gerangschikt op tops, geheugenbandbreedte, VRAM en meer.

| GPU | VRAM | Geheugenbandbreedte | Geheugen Standaard | TFLOPS | Zwevendekomma-precisie | Compatibiliteit |

| NVIDIA H100 NVL | 188 GB | 7.8 TB/s | HBM3 | 3,958 | FP64, FP32, FP16 | CUDA, TensorFlow |

| NVIDIA A100 Tensor Core | 80 GB | 2 TB/s | HBM2 | 1,979 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| NVIDIA RTX 4090 | 24 GB | 1.008 TB/s | GDDR6X | 82.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX A6000 Tensor Core | 48 GB | 768 GB/s | GDDR6 | 40 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| NVIDIA GeForce RTX 4070 | 12 GB | 504 GB/s | GDDR6X | 35.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX 3090 Ti | 24 GB | 1.008 TB/s | GDDR6X | 40 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| AMD Radeon Instinct MI300 | 128 GB | 1.6 TB/s | HBM3 | 60 | FP64, FP32, FP16 | ROCm, TensorFlow |

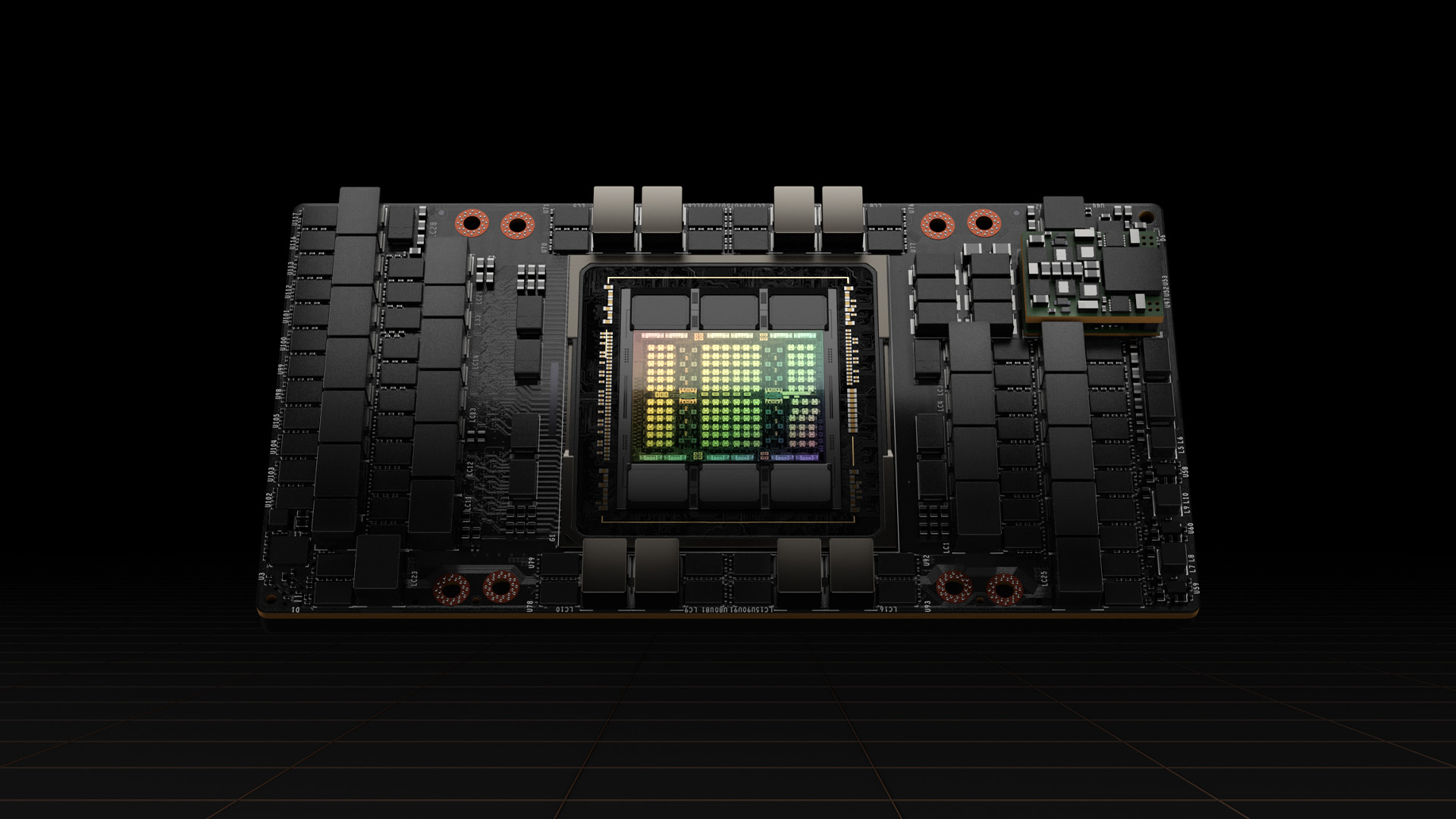

NVIDIA H100 NVL

De beste machine learning GPU, de H100 NVL, levert uitstekende prestaties voor deep learning op schaal en is geoptimaliseerd voor multi-tenant, high-performance workloads.

- Geschikt voor: Geavanceerd AI-onderzoek, grootschalige modeltraining en inferentie.

- Nadeel: Zeer duur en vooral geschikt voor enterprise- of onderzoeksomgevingen.

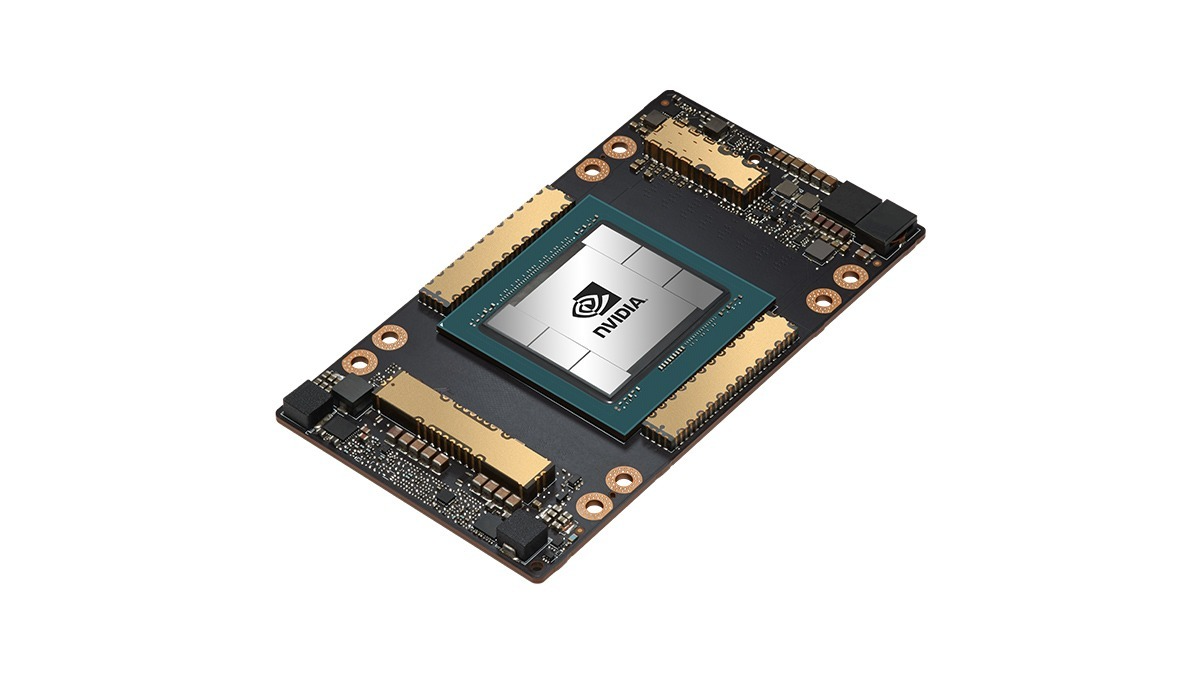

NVIDIA A100 Tensor Core GPU

De A100 levert enorme rekenkracht voor neurale netwerken met 80 GB high-bandwidth geheugen (HBM2), geschikt voor zware workloads.

- Geschikt voor: Grootschalige machine learning-modellen, AI-onderzoek en cloudapplicaties.

- Nadeel: Duur, voornamelijk gericht op enterprise-gebruikers.

NVIDIA RTX 4090

Uitstekend voor zowel gaming als AI-workloads, met 24 GB GDDR6X-geheugen en grote parallelle rekencapaciteit.

- Geschikt voor: Veeleisende ML-taken en AI-onderzoek met extreme rekenkracht.

- Nadeel: Hoog stroomverbruik, hoge kosten en groot formaat.

NVIDIA RTX A6000 Tensor Core GPU

Ondersteunt AI-toepassingen met 48 GB GDDR6-geheugen, goed geschikt voor workstations en professionele creators.

- Geschikt voor: AI-onderzoek, deep learning en high-performance workloads.

- Nadeel: Hoge kosten, doorgaans geschikt voor professionele omgevingen.

NVIDIA GeForce RTX 4070

Goede balans tussen prijs en prestaties met sterke ray-tracing-mogelijkheden, uitgerust met 12 GB GDDR6X

- Geschikt voor: Enthousiastelingen en kleinere bedrijven met gemiddelde machine learning-behoeften.

- Nadeel: Beperkt VRAM voor grotere datasets en zeer grote modellen.

NVIDIA RTX 3090 Ti

NVIDIA RTX 3090 TiHoge geheugencapaciteit (24 GB GDDR6X) en rekenkracht, uitstekend voor het trainen van middelgrote tot grote modellen.

- Geschikt voor: Enthousiastelingen en onderzoekstoepassingen die krachtige AI-verwerking nodig hebben.

- Nadeel: Zeer kostbaar, verbruikt veel stroom, en is voor kleinere projecten vaak overdreven.

AMD Radeon Instinct MI300

Uitstekend geschikt voor AI- en HPC-workloads, met competitieve prestaties.

- Geschikt voor: Machine learning-workloads op AMD-gebaseerde omgevingen.

- Nadeel: Minder bewezen in deep learning vergeleken met NVIDIA, met ondersteuning voor minder frameworks.

Cloudzy's cloud-GPU VPS

Een van de beste GPUs voor machine learning die vandaag beschikbaar is, is zonder twijfel de RTX 4090. Maar hij is duur, jaagt je energierekening omhoog, en door zijn formaat moet je mogelijk overstappen op een groter computerbehuizing of al je onderdelen aanpassen. Kortom, een hoop gedoe. Daarom biedt Cloudzy nu een online GPU voor machine learning aan, zodat jij je nergens zorgen over hoeft te maken. Onze GPU VPS is uitgerust met tot 2 Nvidia RTX 4090 GPUs, 4 TB aan NVMe SSD-opslag, 25 TB per seconde bandbreedte, en 48 vCPUs!

Dit alles tegen betaalbare prijzen, met zowel uurtarieven als maandelijkse pay-as-you-go-facturering en een breed scala aan betaalopties zoals PayPal, Alipay, creditcards (via Stripe), PerfectMoney, Bitcoin en andere cryptocurrencies.

En als laatste: in het ergste geval, als je niet tevreden bent met onze dienst, bieden we een geld-teruggarantie van 14 dagen.

Augmented Reality (AR) cloudplatforms zijn sterk afhankelijk van krachtige GPUs om realtime, meeslepende ervaringen te leveren. Net als GPUs met CUDA- en Tensor-cores onmisbaar zijn voor het trainen van deep learning-modellen, zijn ze even essentieel voor het renderen van complexe AR-omgevingen en het ondersteunen van AI-functies zoals objectherkenning en ruimtelijke mapping. Bij Cloudzy maken onze AR Cloud gebruik van geavanceerde GPU-technologie voor consistente prestaties, lage latency en schaalbaarheid, ideaal voor bedrijven die AR-applicaties op schaal willen uitrollen.

Of je nu AI-applicaties bouwt, modellen traint of onderzoek uitvoert, onze AI VPS-oplossingen zijn ontworpen om de beste GPU-prestaties te leveren tegen een fractie van de gebruikelijke kosten.

Laatste Gedachten

Nu rekenkrachtbehoeften groeien en AI-modellen steeds groter en complexer worden, zullen GPUs zeker een vast onderdeel van ons leven zijn. Het loont dus de moeite om je erin te verdiepen en te begrijpen hoe ze werken.

Daarom raad ik je sterk aan om Tim Dettmers' stuk te lezen over alles wat je moet weten over GPUs, inclusief praktisch advies bij het kiezen van een GPU. Hij heeft een academische achtergrond en is goed thuis in deep learning.