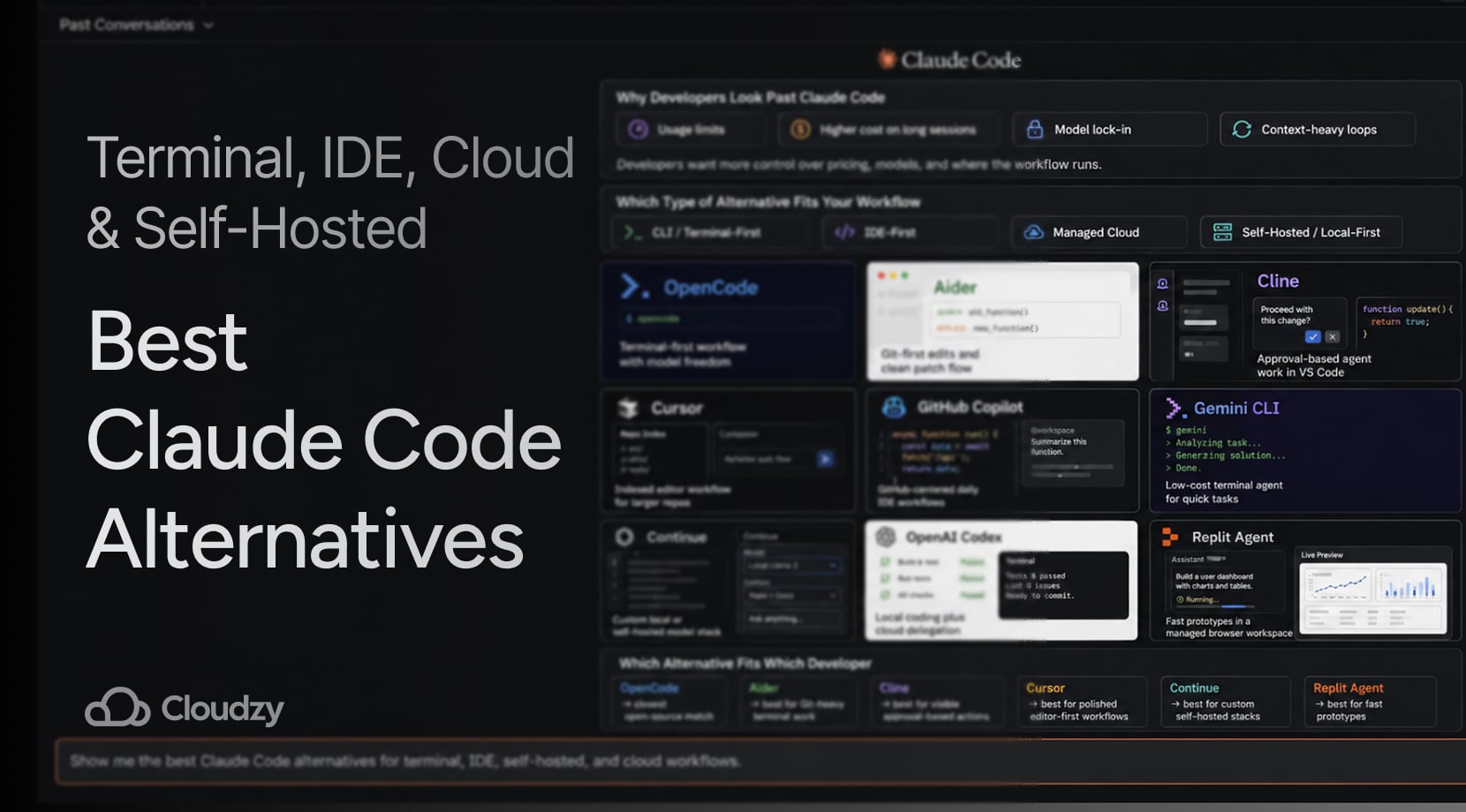

Claude Code to wciąż jeden z najmocniejszych agentów do pisania kodu, ale coraz więcej deweloperów wybiera narzędzia, kierując się dopasowaniem do przepływu pracy, dostępem do modeli i długoterminowym kosztem, zamiast trzymać się jednego dostawcy.

Właśnie dlatego zainteresowanie alternatywami dla Claude Code stale się rozrasta. Dobrą wiadomością jest to, że dostępnych jest wiele solidnych opcji dla użytkowników terminala, deweloperów pracujących głównie w edytorze i osób, które chcą rozwiązania hostowanego samodzielnie.

Szybka odpowiedź

Jeśli chcesz skrótu, to masz go tutaj. Claude Code nadal bardzo dobrze radzi sobie z pracą na całym repozytorium, edycją z poziomu terminala i zadaniami wieloetapowymi. Ale jeśli zależy ci na większym wyborze modeli, niższych kosztach przy rutynowych zadaniach, wygodniejszym przepływie pracy w edytorze lub własnym środowisku, dostępnych jest teraz kilka mocnych alternatyw.

- Najbliższa alternatywa open-source: OpenCode

- Najlepszy przepływ pracy w terminalu z Git: Aider

- Najlepszy agent edytora open-source: Cline

- Najlepszy dopracowany wybór dla IDE: Cursor

- Najlepsza popularna opcja edytora z wieloma modelami: GitHub Copilot

- Najlepsza bezpłatna ścieżka CLI do użytku indywidualnego: Interfejs wiersza poleceń Gemini

- Najlepszy własny stack hostowany samodzielnie: Kontynuuj

- Najlepsza opcja z delegowaniem do chmury: OpenAI Codex

Wielu deweloperów nie szuka jednak jednego bezpośredniego zamiennika. Każdy wie, że warto mieć kilka narzędzi i sięgać po każde z nich do tego rodzaju pracy, do którego najlepiej się nadaje, co jest częstym motywem w postach na Reddicie również

Dlaczego deweloperzy odchodzą od Claude Code

Claude Code zasłużył na swoją reputację. Anthropic zbudował go z myślą o agentycznych przepływach pracy przy kodowaniu, więc potrafi odczytać bazę kodu, edytować pliki, uruchamiać polecenia i pracować z poziomu terminala lub połączonych narzędzi w sposób, który staje się naturalny, gdy już się w to wdrożysz.

Mimo to te same narzekania na cenę i limity użycia wracają wciąż w dyskusjach, nawet po tym czasie. Dostęp do Claude obejmuje teraz ścieżki Pro, Max, Team i Enterprise, przy czym miejsca Premium oferują wyższe limity użycia dla środowisk zespołowych. Jednak każdy, kto korzystał z Claude, wie, że limity kończą się znacznie szybciej, niż można by się spodziewać.

Uzależnienie od jednego dostawcy to drugi poważny problem. Jeśli podoba ci się ten przepływ pracy, ale nie chcesz, żeby całe twoje środowisko było przywiązane do modeli i limitów Anthropic, alternatywy naprawdę wyglądają na rozsądniejszy wybór.

W ostatnich wątkach pojawia się też bardziej irytująca skarga dotycząca długich sesji, które robią się kosztowne, bo narzędzie ciągle przetasza kontekst. Gdy coś się zawiesi lub zapętli, może szybko zmarnować czas i budżet.

Niektóre użytkownicy publikowali analizy pokazujące, że większość tokenów jest zużywana na obsługę kontekstu, a nie na generowanie kodu, podczas gdy inni opisywali przypadki, gdy Claude Code zawieszał się na minuty na promptach, które powinny były być rutynowe.

Żeby być fair, 23 kwietnia 2026 roku, Anthropic przyznało się do problemów i wyjaśniło, że część zgłoszeń dotyczących jakości Claude Code była związana z trzema zmianami na poziomie produktu, a nie z pogorszeniem bazowego modelu. Poprawki weszły w życie 20 kwietnia.

To nie zmienia jednak faktu, że choć niewielu programistów całkowicie rezygnuje z Claude Code, przy takich zdarzeniach każdy rozsądny developer powinien mieć w zanadrzu przynajmniej jedną lub dwie alternatywy — na wszelki wypadek.

Żadne z powyższych nie sprawia, że Claude Code jest złym narzędziem. Oznacza to po prostu, że rynek jest teraz szerszy. Jeśli wiesz już, że podoba ci się podejście agentowe, ale zależy ci na większej kontroli nad cenami lub wyborem modelu, nasz Opencode vs Claude Code porównanie to bardziej szczegółowe zestawienie.

Który typ alternatywy pasuje do twojego workflow

Intensywna praca w terminalu, praca w edytorze i konfiguracje self-hosted kierują programistów ku różnym narzędziom. OpenCode, Aider i Gemini CLI sprawdzają się u osób, które chcą trzymać się blisko powłoki, Cursor i Copilot lepiej pasują do pracy w edytorze, a Continue jest skierowany bardziej do developerów budujących środowisko wokół własnych modeli lub infrastruktury.

Narzędzia CLI i terminal-first

Zostajesz w Git, zostajesz w powłoce i pozwalasz agentowi pracować nad zmianami z tego samego miejsca, w którym już budujesz i testujesz. OpenCode, Aider i Gemini CLI należą do tej kategorii, choć nie działają identycznie — omówimy to w dalszej części.

Narzędzia IDE-first

To rozwiązania dla programistów, którzy chcą mieć narzędzie AI wbudowane w edytor, z którego korzystają na co dzień. Cursor, GitHub Copilot i Cline to główne nazwy w tej kategorii, przy czym Cline mocniej skłania się ku pełnemu zachowaniu agentowemu niż klasyczne narzędzia do uzupełniania kodu. Jeśli twój zespół spędza więcej czasu w zakładkach edytora niż w panelach powłoki, ta kategoria alternatyw dla Claude jest dla ciebie.

Zarządzane platformy chmurowe

Ta grupa jest dla osób, którym bardziej zależy na przejściu od pomysłu do działającej aplikacji niż na lokalnej kontroli czy zachowaniu agenta w obrębie repozytorium. Replit Agent to najlepszy przykład dla takich zastosowań. Warto jednak pamiętać, że choć eliminuje on konieczność konfiguracji, ta wygoda wiąże się z mniejszą kontrolą niż w przypadku ścieżki lokalnej lub self-hosted.

Konfiguracje open-source i self-hosted

Tu OpenCode i Continue robią się naprawdę interesujące. Zyskujesz większą swobodę w zakresie modeli, infrastruktury, prywatności i kosztów, ale też bierzesz na siebie konfigurację i strojenie. Coraz więcej narzędzi obsługuje Protokół kontekstu modelu, co jest jednym z powodów, dla których zamiana środowisk jest dziś łatwiejsza niż rok temu.

Jeśli próbujesz rozróżnić agenta do kodowania od szerszego asystenta self-hosted, nasz Opencode vs OpenClaw kawałek może ci w tym znacznie pomóc.

Porównanie najlepszych alternatyw dla Claude Code

Zanim przyjrzymy się każdemu narzędziu z osobna, warto zobaczyć je wszystkie obok siebie. Poniższa tabela dzieli te narzędzia według workflow, ścieżki self-hosted i głównych kompromisów.

| Narzędzie | Najlepsze dla | Interfejs | Otwarte źródło | Ścieżka lokalna lub self-hosted | Główny kompromis |

| OpenCode | Workflow w stylu Claude Code z dowolnością wyboru modelu | Terminal, IDE, pulpit | Tak | Tak | Mniej dojrzałe niż największe komercyjne platformy |

| Aider | Praca w terminalu oparta głównie na Git | Terminal | Tak | Tak | Bardziej ręczna obsługa niż w przypadku pełnych agentów |

| Cline | Przejrzysta, oparta na zatwierdzeniach praca agenta w VS Code | Środowisko IDE | Tak | Tak | Może generować dużo szumu i kosztów przy większych zadaniach |

| Cursor | Dopracowane środowisko pracy skoncentrowane na edytorze | Środowisko IDE | No | Brak trybu lokalnego | Powiązane z hostowanym produktem edytorskim |

| GitHub Copilot | Popularne przepływy pracy w edytorach i swobodny wybór modelu | IDE, GitHub | No | Hostowane, bez opcji self-hosted | Nie zaprojektowane z myślą o pełnej kontroli lokalnej |

| Interfejs wiersza poleceń Gemini | Eksperymenty w terminalu przy niskim koszcie lub bezpłatnie | Terminal | Tak | Domyślnie bez opcji self-hosted | Dobry stosunek jakości do ceny, ale dla wielu użytkowników mocno powiązane z Google |

| Kontynuuj | Własne lokalne lub self-hosted stosy | IDE, terminal, CI | Tak | Tak | Wymaga więcej konfiguracji niż narzędzia gotowe do użycia od razu |

| OpenAI Codex | Lokalne parowanie i delegowanie do chmury | Terminal, IDE, aplikacja chmurowa | Tak dla CLI | Częściowo | Najmocniejsze elementy opierają się na szerszym ekosystemie OpenAI |

| Agent Replit | Szybkie tworzenie zarządzanych aplikacji | Zintegrowane Środowisko Przeglądarki | No | No | Szybkie dla zarządzanych prototypów, słabsze przy kontroli lokalnego repozytorium |

Najlepsze alternatywy dla Claude Code według typu pracy

Masz już pełny obraz sytuacji – czas na szczegółowe omówienie każdego narzędzia.

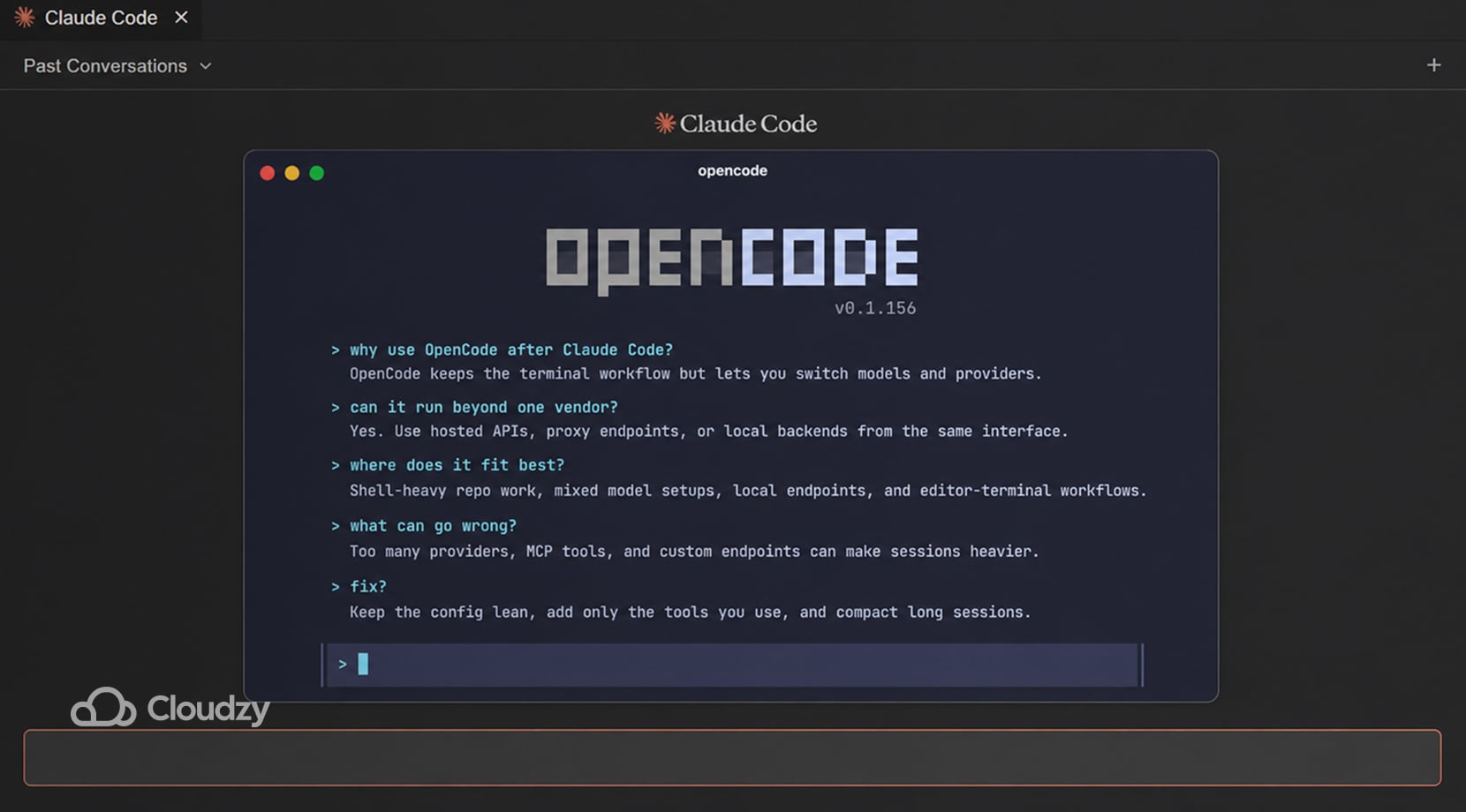

OpenCode

OpenCode sprawdza się u deweloperów, którzy chcą pracować w środowisku zorientowanym na terminal bez uzależniania się od jednego dostawcy. To samo środowisko można podłączyć do hostowanych API, punktów końcowych proxy lub lokalnych backendów, więc zmiana modelu nie wymusza zmiany narzędzi ani nawyków.

W trybie edytora nadal zachowuje się jak agent terminalowy, co odpowiada osobom, które chcą, by powłoka pozostawała centrum pracy.

Szczególnie dobrze sprawdza się w konfiguracjach, gdzie jeden model obsługuje głęboką pracę z repozytorium, inny jest tańszy przy rutynowych zmianach, a lokalny backend jest utrzymywany na potrzeby prywatnych lub niskokosztowych zadań.

Słabym punktem jest rozrost konfiguracji: gdy zaczyna obejmować zbyt wielu dostawców, serwery MCP lub własne punkty końcowe, sesja robi się cięższa, a całość zaczyna wymagać ciągłego porządkowania.

OpenCode'a własna dokumentacja MCP warto pamiętać, że serwery MCP i rozbudowane zestawy narzędzi mogą dodawać dodatkowe definicje narzędzi do kontekstu modelu, co może zwiększyć zużycie tokenów i opóźnienia.

- Dobrze sprawdzi się do intensywna praca z repozytorium w terminalu przy więcej niż jednym dostawcy lub modelu w rotacji

- Przydatny do utrzymywanie jednego interfejsu przy zmiennym backendzie

- Przydatny do łączenie hostowanych API, lokalnych punktów końcowych i pracy w trybie edytor-terminal w jednej konfiguracji

- Zaczyna irytować, gdy konfiguracja rośnie szybciej niż workflow

- Zaczyna irytować, gdy duże zestawy narzędzi MCP dodają zbyt dużo kontekstu do każdego uruchomienia

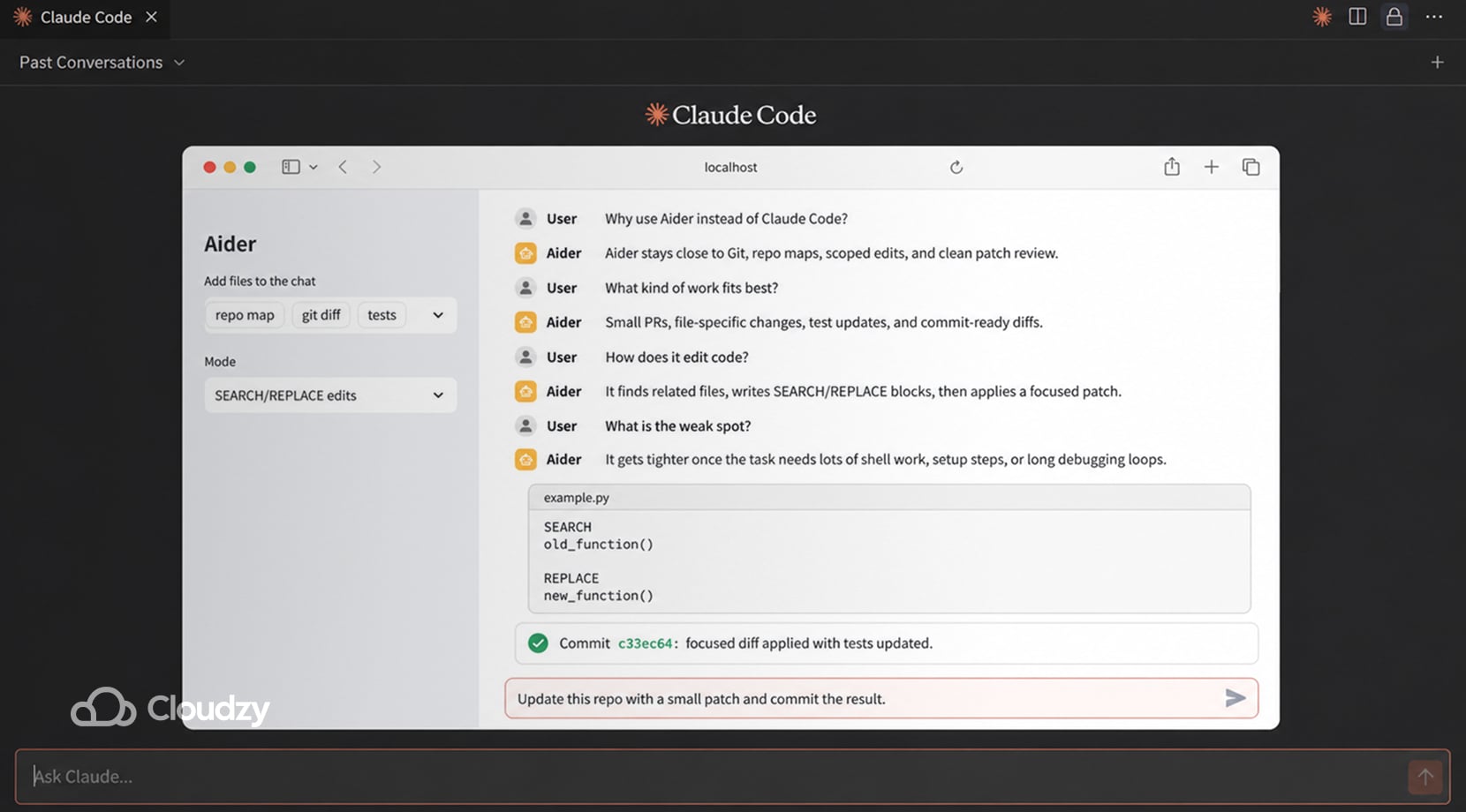

Aider

Aider jest zbudowany wokół map repozytorium, edycji diffów i przepływu patchy przyjaznego dla Git. Wysyła modelowi strukturalne podsumowanie plików i symboli, a następnie stosuje zmiany w stylu wyszukaj-i-zamień zamiast przepisywać całe pliki. W repozytorium z intensywnym procesem recenzji przekłada się to często na mniejsze PR-y, mniej hałaśliwych przepisań i historię commitów, którą łatwiej przejrzeć.

Najlepiej sprawdza się przy ograniczonych zadaniach: takich jak zmień te pliki, popraw tę logikę, zaktualizuj testy i zatwierdź wynik.

Warto jednak pamiętać, że gdy zadanie rozszerza się na konfigurację builda, orkiestrację terminala, sprawdzanie w przeglądarce lub długie pętle debugowania, workflow robi się ciasny, bo Aider trzyma interakcję blisko samej zmiany w kodzie.

- Good fit for repozytoriów z intensywnym użyciem Git, zespołów nastawionych na recenzje kodu i ograniczonych zmian w kodzie.

- Przydatny przy kontekście mapy repozytorium, edycjach opartych na diffach, automatycznych commitach i precyzyjnej kontroli patchy.

- Zaczyna nudzić przy zadaniach, które ciągle przeskakują między kodem, powłoką, konfiguracją i debugowaniem.

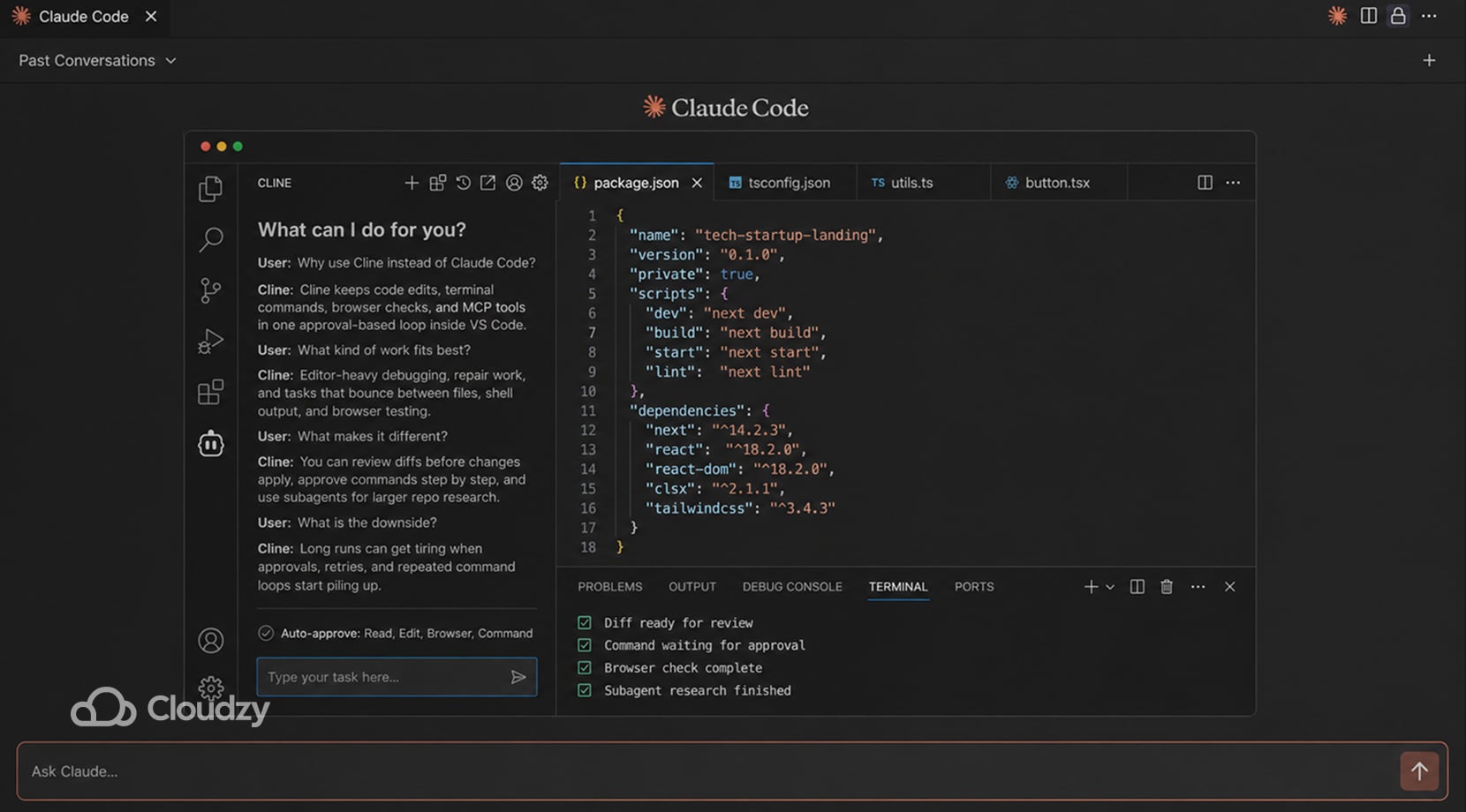

Cline

Cline działa wewnątrz VS Code i łączy edycję plików, polecenia powłoki, akcje przeglądarki oraz narzędzia MCP w jednej pętli opartej na zatwierdzeniach: diffy są pokazywane przed zastosowaniem zmian, a polecenia czekają na pozwolenie.

Obsługuje też subagenty tylko do odczytu, które mogą pomóc przy przeglądaniu repozytorium i równoległej inspekcji. Nie można ich jednak nazwać pełnoprawnymi agentami roboczymi, bo nie mogą stosować patchy, zapisywać plików, korzystać z przeglądarki ani wywoływać narzędzi MCP.

Sprawdza się przy intensywnym debugowaniu w edytorze, gdy praca ciągle przeskakuje między kodem, wyjściem terminala a sprawdzaniem w przeglądarce.

Ta zaleta może stać się wadą: przy dłuższych łańcuchach naprawczych ta sama konfiguracja może zwalniać, gdy uruchomienie zaczyna krążyć przez powtarzające się zatwierdzenia, ponowne próby poleceń lub aplikację patchy.

- Good nadaje się do naprawiania błędów pod nadzorem redaktora, prac serwisowych i sprawdzania w przeglądarce wewnątrz VS Code

- Przydatny przy widocznych diffach, zatwierdzaniu poleceń, narzędziach MCP i subagentach w większych repozytoriach

- Męczy przy długich pętlach z powtarzającymi się potwierdzeniami lub niestabilną obsługą poleceń i wyników

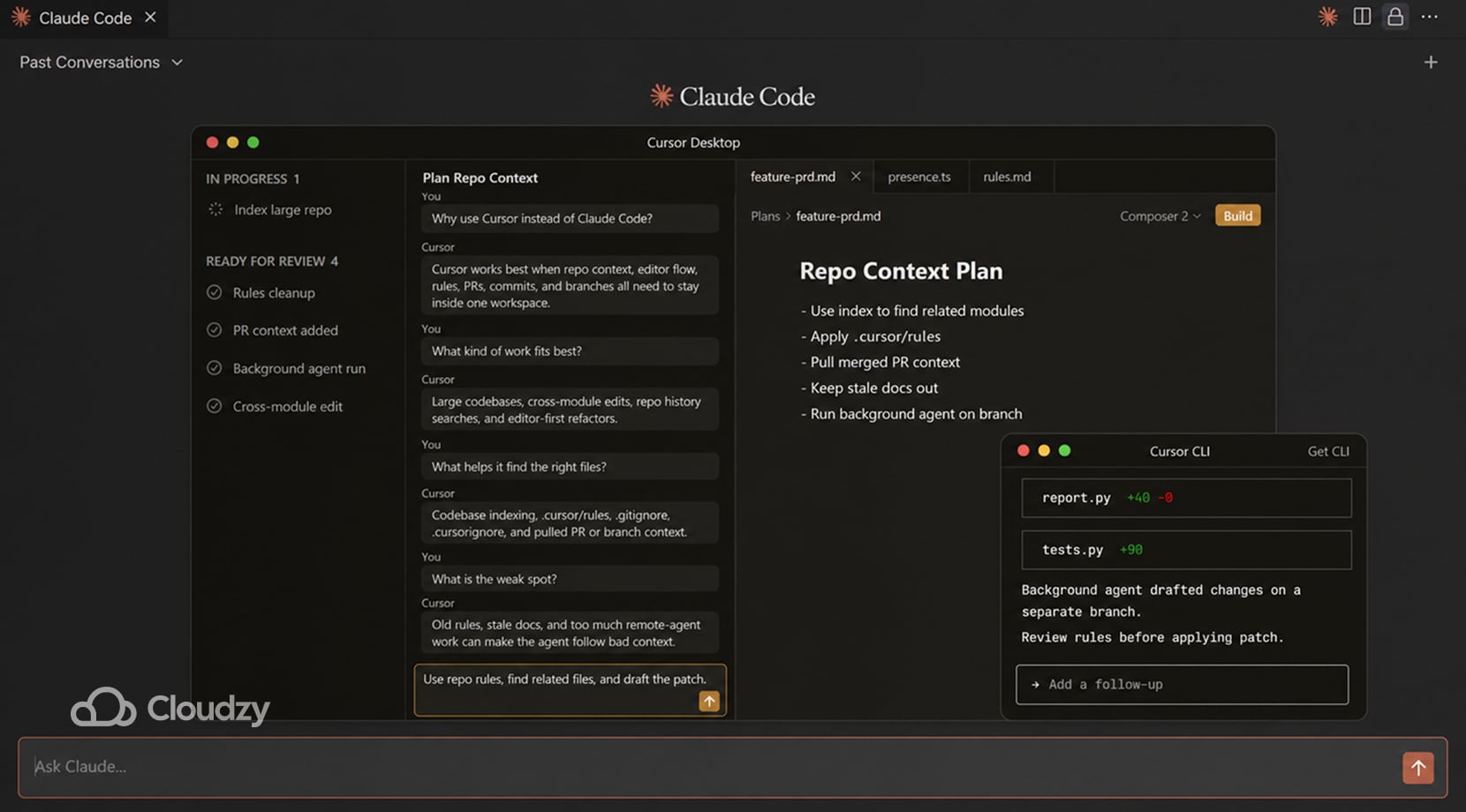

Cursor

Cursor jest stworzony do złożonych repozytoriów - używa przyrostowego indeksowania opartego na drzewach Merkle'a, by utrzymywać semantyczny magazyn wektorów. Obsługuje workspace'y z wieloma korzeniami i wyzwalacze zdarzeń git, ale najlepiej działa, gdy zakres indeksowania jest ręcznie dostrojony przez .cursorignore, tak by liczba plików pozostawała w rozsądnych granicach

Ponadto reguły projektu znajdują się w .cursor/rules, dzięki czemu konwencje i notatki o workflow mogą pozostawać przy repozytorium zamiast tkwić w lokalnych ustawieniach jednej osoby.

W większych bazach kodu eliminuje to przeciąganie plików i powtarzające się prompty w stylu "najpierw przeczytaj te foldery". W efekcie zgrabny plik reguł i czysty indeks sprawdzają się lepiej niż stos starych instrukcji w markdownie.

Z drugiej strony, gdy reguły, pliki AGENTS i doraźne dokumenty kontekstowe zaczynają się nawarstwiać, agent ma więcej materiału do przetworzenia i więcej nieaktualnych wskazówek, o które można się potknąć.

Co więcej, agenci działający w tle w Cursorze idą krok dalej: klonują repozytorium na zdalną maszynę Ubuntu, uruchamiają polecenia instalacji i startu oraz pracują na osobnych gałęziach.

Może to pomóc przy dłuższych zadaniach, ale przenosi też część workflow poza lokalny edytor, do zdalnego środowiska wykonawczego.

- Good nadaje się do pracy w edytorze w repozytoriach z dużą historią, konwencjami lub zmianami obejmującymi wiele modułów.

- Przydatny do indeksowania bazy kodu, wyszukiwania PR, reguł scoped do repozytorium i zdalnych uruchomień w tle.

- Nudzi, gdy repozytorium zapełnia się nieaktualnymi instrukcjami albo workflow opiera się zbyt mocno na zdalnych agentach.

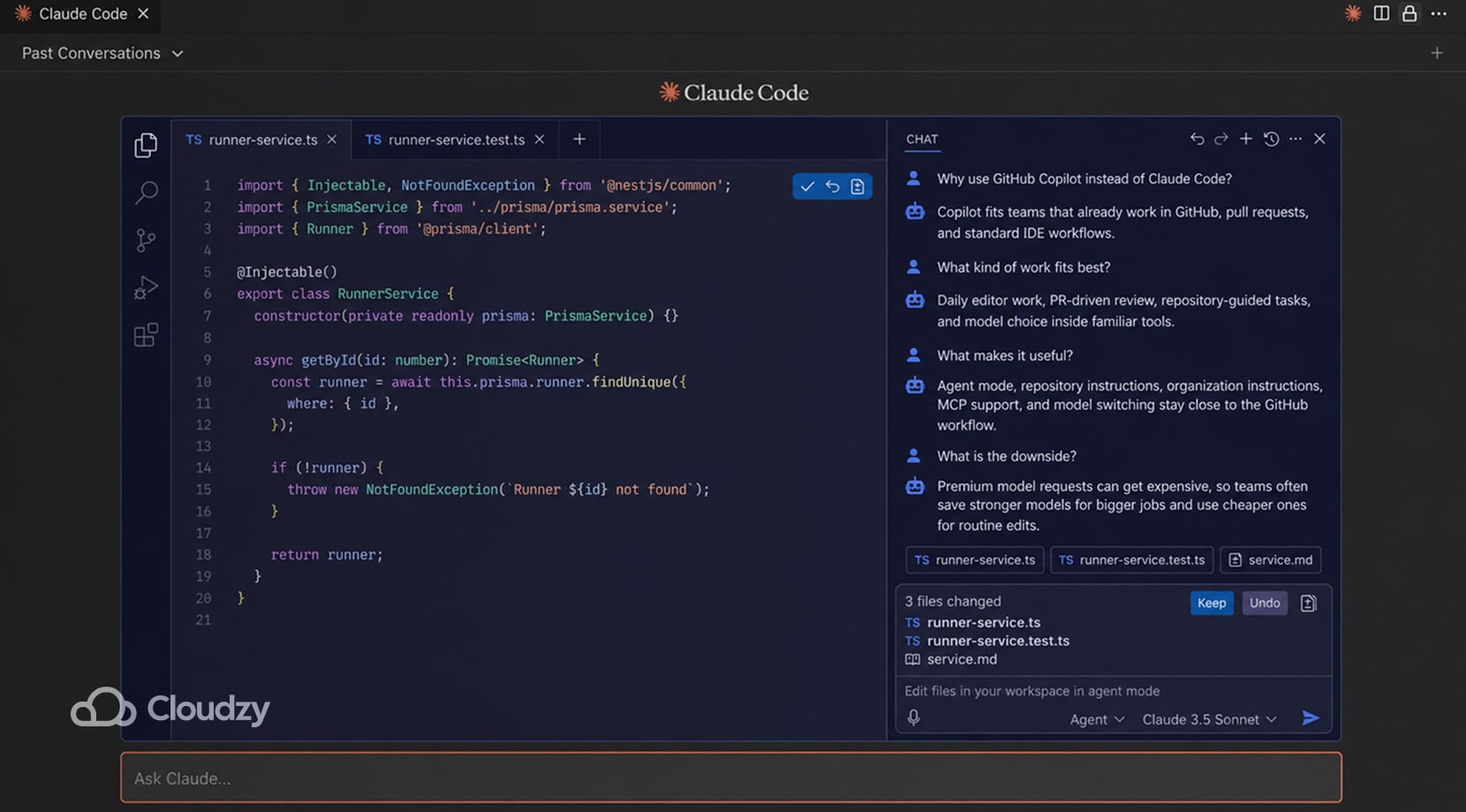

GitHub Copilot

GitHub Copilot pasuje zespołom, które już pracują w GitHub, z pull requestami i standardowymi IDE. Tryb agenta może wybierać pliki, proponować polecenia terminalowe i prowadzić zadanie do końca w narzędziach, z których zespół już korzysta.

Dodatkowo instrukcje repozytorium, instrukcje organizacji, obsługa MCP i przełączanie modeli trzymają większość konfiguracji w tym samym stosie, zamiast pchać ludzi w osobne środowisko do kodowania.

Z czasem jednak większym problemem stają się ceny modeli wewnątrz workflow. Copilot zużywa żądania premium dla mocniejszych modeli, a mnożnik różni się w zależności od modelu. To zmusza zespoły do oszczędzania drogich modeli na większe refaktoryzacje, trudniejsze debugowanie lub dłuższe uruchomienia agentów, a przy mniejszych edycjach i szybkich pytaniach - do korzystania z tańszych domyślnych opcji.

Produkt wciąż dobrze pasuje do pracy mocno osadzonej w GitHub, ale koszty żądań mogą zacząć narzucać nawyki promptowania, gdy użycie rośnie.

- Good nadaje się dla zespołów mocno opartych na GitHub, recenzji opartej na PR i codziennej pracy w edytorze.

- Przydatny do trybu agenta, przełączania modeli, instrukcji repozytorium i trzymania pracy z AI blisko istniejącego workflow GitHub.

- Irytuje, gdy koszt żądań premium zaczyna decydować, który model opłaca się używać przy małych zadaniach.

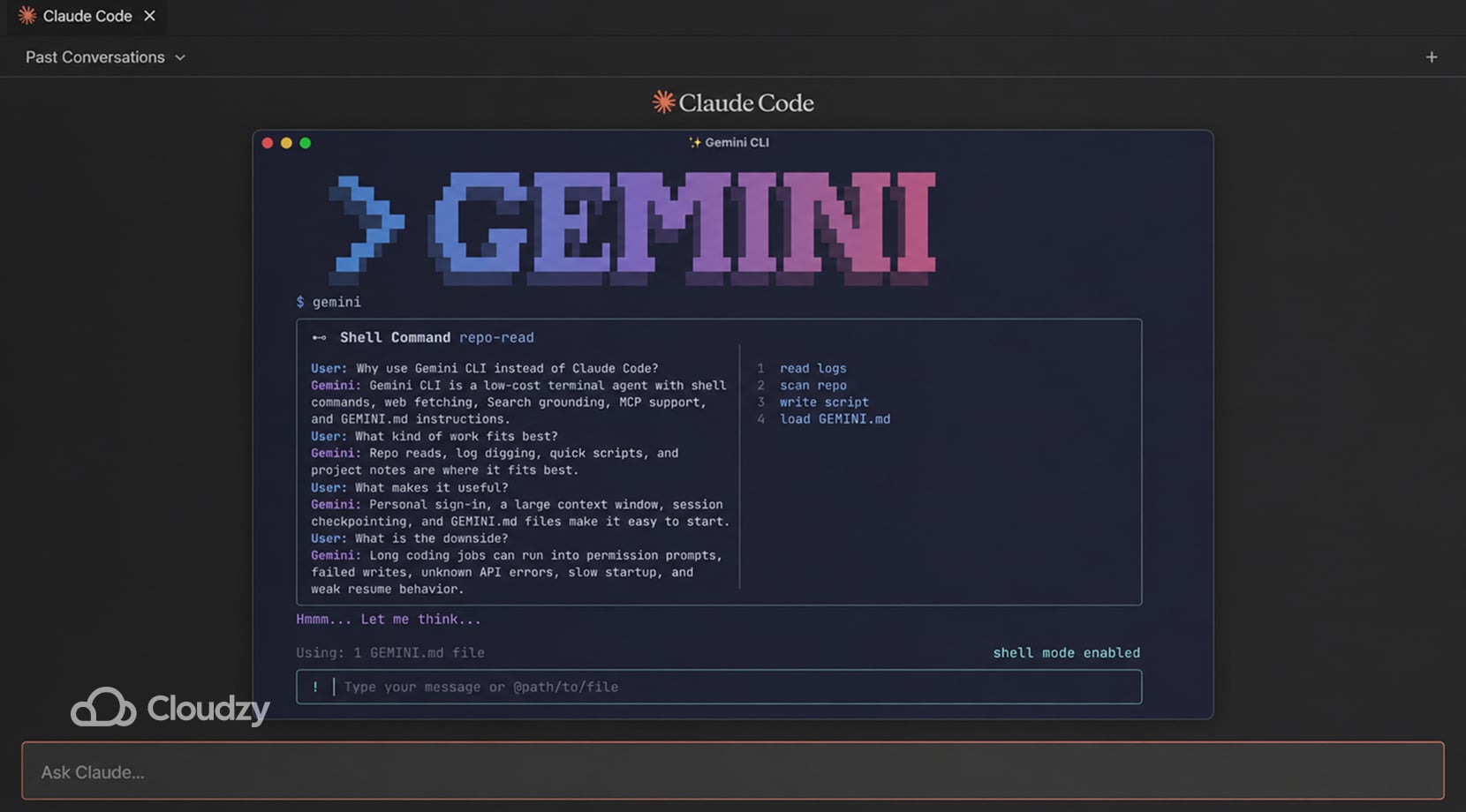

Interfejs wiersza poleceń Gemini

Gemini CLI działa w terminalu i wymaga minimalnej konfiguracji na starcie.

Google udostępnia go jako agent open-source z poleceniami powłoki, pobieraniem stron, gruntowaniem przez Search, obsługą MCP, checkpointowaniem sesji i GEMINI.md pliki, które mogą ładować instrukcje z zakresu globalnego, przestrzeni roboczej i katalogu. Co więcej, osobiste logowanie przez Google obejmuje bezpłatny limit oraz dostęp do modeli Gemini z oknem kontekstowym na milion tokenów. To wszystko sprawia, że narzędzie dobrze sprawdza się przy przeglądaniu repozytoriów, analizie logów, szybkich skryptach i notatkach projektowych.

Niestety, spadek jakości widać przy dłuższych zadaniach programistycznych, gdzie ostatnie raporty użytkownicy zgłaszają powtarzające się monity o uprawnienia, błędy zapisu plików nawet po ich przyznaniu, nieznane błędy API, powolny start, zbyt długi czas wykonywania prostych zadań oraz problemy z poprawnym wznawianiem rozmów.

Duże okno kontekstowe pomaga przy odczycie większej liczby plików, ale nie rekompensuje niestabilnego wykonywania narzędzi ani długich łańcuchów naprawczych.

- Dobre dopasowanie do przeglądania repozytoriów po stronie terminala, analizy logów, jednorazowych skryptów i lżejszych zadań programistycznych.

- Przydatne przy odczycie dużych kontekstów, instrukcjach projektowych GEMINI.md, rozszerzeniach MCP i szybkim dostępie do terminala.

- Traci skuteczność przy dłuższych naprawach obejmujących wiele plików, intensywnym korzystaniu z narzędzi i sesjach wymagających czystego wznawiania.

Kontynuuj

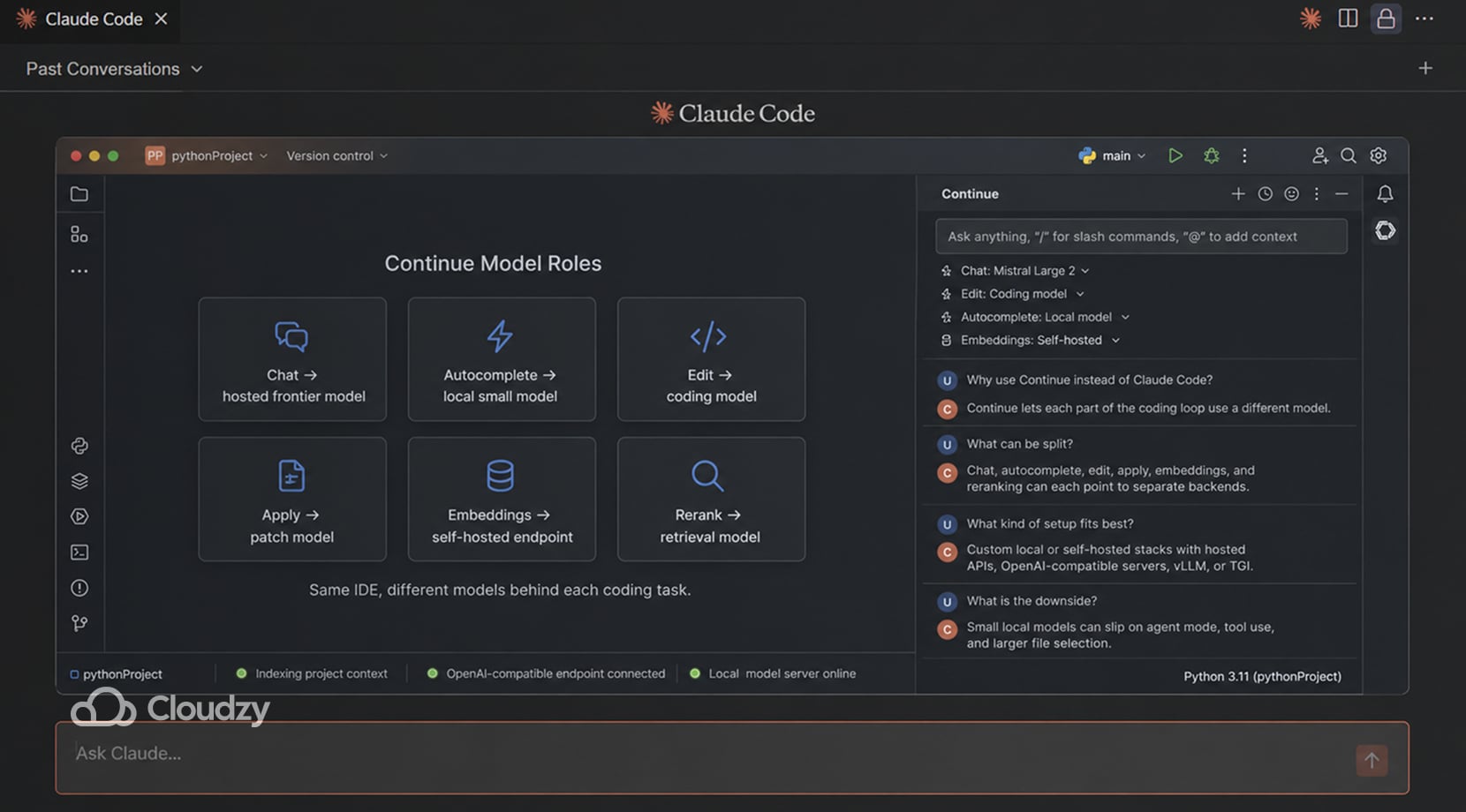

Continue sprawdza się w konfiguracjach, gdzie różne etapy pętli programistycznej wymagają różnych modeli. Pozwala przypisać osobne role dla czatu, autouzupełniania, edycji, aplikowania zmian, embeddingów i rerankingu, a następnie wskazać dla nich hostowane API, serwery kompatybilne z OpenAI lub własne backendy.

Przewodnik po samohostowaniu obejmuje backendy takie jak vLLM, Hugging Face TGI i inne endpointy kompatybilne z OpenAI, dzięki czemu możesz zachować rozszerzenie Continue, zmieniając jednocześnie serwer modelu działający w tle.

Taka konfiguracja jest przydatna w zespołach, które rozkładają pętlę programistyczną na różne modele, na przykład jeden model do czatu, mniejszy do autouzupełniania i kolejny do stosowania edycji lub wyszukiwania wektorowego.

Warto pamiętać, że lokalne stosy oparte na mniejszych modelach do kodowania są mniej wiarygodne w trybie agentowym. Tryb agentowy i korzystanie z narzędzi to zazwyczaj pierwsze miejsca, gdzie zaczynają zawodzić: pojawiają się pominięte kroki, zignorowane narzędzia lub wciągany jest nieprawidłowy kontekst.

Niedawne Dyskusje LocalLLaMA użytkownicy zgłaszają ten sam problem w lokalnych konfiguracjach w stylu Continue. Mniejsze modele radzą sobie z czatem i podstawowymi edycjami, ale tracą niezawodność znacznie szybciej, gdy w grę wchodzi tryb agentowy, wywoływanie narzędzi lub szerszy dostęp do plików.

- Dobre dopasowanie do niestandardowych stosów z osobnymi modelami do czatu, autouzupełniania, edycji i wyszukiwania.

- Przydatne przy serwerach kompatybilnych z OpenAI, samohostowanych endpointach i zmianie dostawców bez modyfikowania przepływu pracy w edytorze.

- Traci skuteczność, gdy lokalny backend jest zbyt mały do obsługi narzędzi, trybu agentowego lub większego zakresu plików.

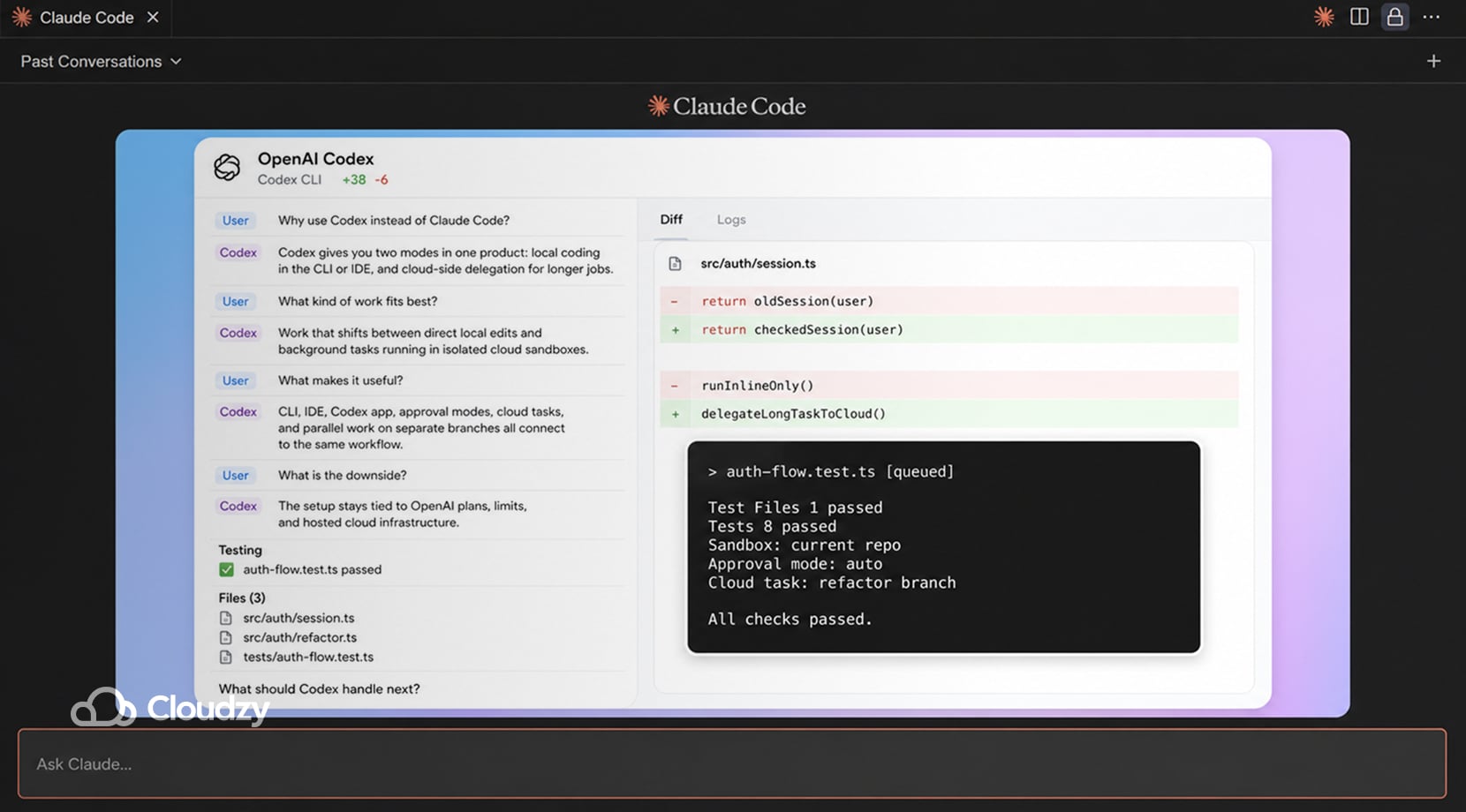

OpenAI Codex

OpenAI Codex sprawdza się u deweloperów, którzy chcą dwóch trybów w jednym produkcie: lokalnego programowania w parach w CLI lub IDE oraz delegowania zadań do chmury przy dłuższych pracach. Aktualna dokumentacja OpenAI umieszcza Codex w CLI, rozszerzeniu IDE, aplikacji Codex i Codex Cloud, gdzie zadania chmurowe działają w izolowanych piaskownicach połączonych z repozytorium, a lokalna praca pozostaje we własnym środowisku.

Co więcej, Codex rozdziela piaskownicowanie od zatwierdzania. Piaskownica kontroluje dostęp do plików i sieci, podczas gdy ustawienia zatwierdzania decydują, kiedy Codex musi wstrzymać się przed uruchomieniem akcji. W trybie zapisu do przestrzeni roboczej Codex może edytować pliki w bieżącej przestrzeni, ale dostęp do sieci i działania poza nią nadal zależą od wybranych ustawień.

Ta konfiguracja sprawdza się w pracy, która stale przeplata bezpośrednie edycje z zadaniami w tle. Lokalna sesja może przejrzeć repozytorium, wprowadzić poprawki i uruchomić polecenia, a zadanie chmurowe może kontynuować dłuższą naprawę lub szkic PR bez konieczności utrzymywania otwartego terminala.

OpenAI rozbudował też Codex o równoległą pracę dzięki aplikacji Codex, wbudowanym worktree i zarządzaniu wieloma agentami.

Zadania chmurowe są przydatne, ale konfiguracja pozostaje uzależniona od planów, limitów i środowiska hostowanego OpenAI. Dla części zespołów to wystarczające rozwiązanie, jednak inne decydują się na ograniczenie Codex wyłącznie do zadań chmurowych i przeniesienie części pętli programistycznej z powrotem do lokalnych narzędzi, aby mieć większą kontrolę nad przebiegiem sesji i jej możliwościami.

- Dobre dopasowanie do lokalnego kodowania połączonego z delegowaniem zadań w tle.

- Przydatne przy trybach zatwierdzania, obsłudze IDE i CLI, piaskownicach w chmurze oraz równoległej pracy przez aplikację.

- Zaczyna uwierać, gdy chcesz, żeby cały workflow działał poza planami, limitami i środowiskiem chmurowym jednego dostawcy.

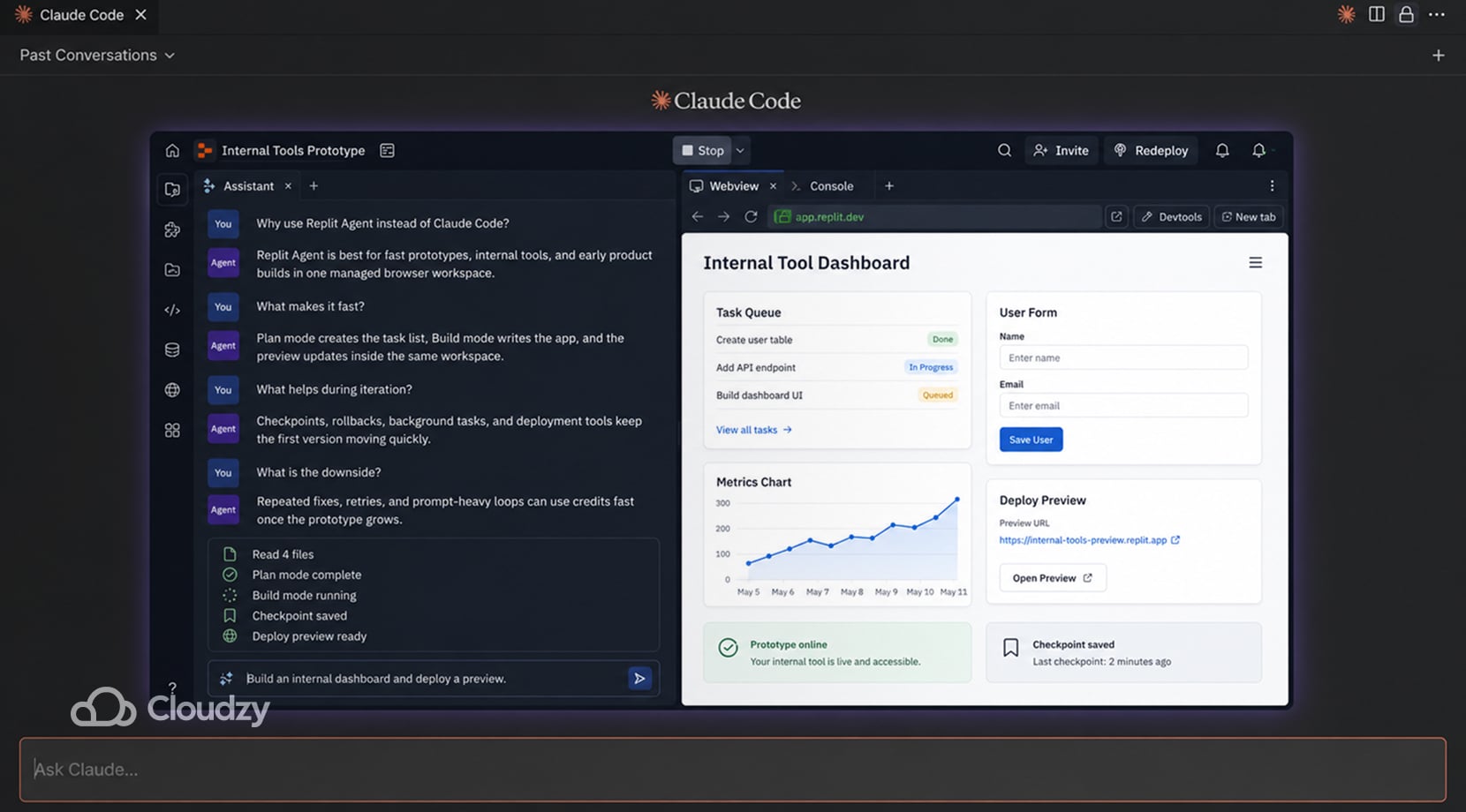

Agent Replit

Replit Agent sprawdza się przy szybkim prototypowaniu, narzędziach wewnętrznych i wczesnych wersjach produktów, gdzie pisanie kodu, hosting i wdrożenie są w jednym miejscu.

Aktualna dokumentacja Replit opisuje tryb Plan do list zadań i pytań o architekturę przed wprowadzeniem zmian w kodzie, tryb Build do implementacji, automatyczne punkty kontrolne i rollbacki oraz system zadań umożliwiający uruchamianie pracy w tle w osobnych wątkach z limitami współbieżności zależnymi od planu.

Łatwo zrozumieć, dlaczego ludzie wciąż do tego wracają: od pomysłu do czegoś klikalnego można dojść bardzo szybko, zwłaszcza gdy projekt jest jeszcze luźno zdefiniowany, a stack nie jest jeszcze ustalony.

Wady zaczynają być odczuwalne, gdy projekt przestaje być surowym prototypem i wymaga wielokrotnych poprawek, intensywnej iteracji opartej na promptach lub pracy wieloagentowej. Replit sprawdza się przy szybkim wystawieniu prototypu online, ale wielokrotne poprawki, intensywna iteracja i praca wieloagentowa mogą szybko windować zużycie kredytów.

Właśnie wtedy zespoły zwykle zaczynają ograniczać prompty i przenosić cięższe prace nad kodem do Cursor, VS Code albo innego lokalnego środowiska, korzystając z Replit nadal do hostingu, demo lub wczesnej walidacji.

- Good pasuje do prototypów, aplikacji wewnętrznych i szybkiej walidacji produktu w zarządzanym środowisku przeglądarkowym.

- Przydatne do planowania przed edycjami, zadań w tle, punktów kontrolnych, rollbacków i szybkiego wystawienia gotowej aplikacji online.

- Robi się kosztowne, gdy workflow zamienia się w mnóstwo ponownych prób, drobnych poprawek lub zapętlonych promptów.

SaaS a narzędzia AI do kodowania hostowane samodzielnie

Sprowadza się to do dwóch pytań: czy chcesz gotowy produkt w chmurze, czy chcesz mieć większą kontrolę nad stackiem? Żeby odpowiedzieć, musisz poważnie zastanowić się, na co te wybory wpływają. Zestawiłem to w tabeli poniżej.

| Czynnik | Narzędzia SaaS | Narzędzia hostowane samodzielnie lub lokalne |

| Czas konfiguracji | Szybko | Wolniej |

| Wybór modelu | Czasem ograniczone, czasem nie | Zazwyczaj szersze, jeśli dobrze to zbudujesz |

| Prywatność i kontrola nad kodem | Zależy od warunków dostawcy | Lepsza kontrola nad środowiskiem uruchomieniowym; prywatność modelu zależy od wybranego backendu |

| Łatwość wdrożenia od pierwszego dnia | Lepszy | Bardziej szorstki |

| Elastyczność w dłuższej perspektywie | Niższy | Wyższy |

| Obciążenie operacyjne | Niski | Do Twojego zarządzania |

Tabela mówi jedno: SaaS jest prostsze na start i na co dzień wymaga od zespołu mniej zachodu. Własna infrastruktura daje więcej swobody w kształtowaniu stacku, sprzętu i wyboru modelu.

Jeśli koszty API zaczynają rosnąć albo Twój zespół potrzebuje stabilniejszego dostępu do mocy obliczeniowej, nasze Zestawienie Cloud GPU i dedykowanego GPU VPS to lepszy następny krok niż kolejne zestawienie narzędzi.

Dlaczego programiści wracają do self-hosted AI w kodowaniu

Programiści, i właściwie większość z nas, mają dość mnożenia subskrypcji, dość ograniczeń jednego dostawcy i dość sytuacji, w której dłuższa sesja może odbić się na budżecie.

Dochodzą do tego kwestie prywatności, szczególnie tam, gdzie nikt nie chce, żeby własnościowy kod trafiał do kilku zewnętrznych serwisów tylko po to, żeby utrzymać jeden przepływ pracy.

Lokalne modele radzą sobie całkiem dobrze w zwykłym czacie, ale praca agentów kodujących stawia przed nimi znacznie większe wymagania. Wywołania narzędzi, długie prompty, niuanse parserów i ograniczenia sprzętowe zaczynają dawać o sobie znać znacznie wcześniej, gdy model musi pracować na wielu plikach i utrzymywać spójność dłuższego zadania.

Mówię o tym wszystkim, żeby dojść do sedna: podejście hybrydowe może być po prostu lepszym wyborem. Programista może korzystać z hostowanego modelu frontier do ciężkiej pracy z repozytorium, z tańszego modelu do powtarzalnych edycji, a z lokalnego lub opartego na VPS środowiska do przepływów wrażliwych na prywatność lub działających ciągle.

Jeśli wciąż rozgryźwasz lokalną stronę środowiska uruchomieniowego, Ollama vs LM Studio to przydatna lektura.

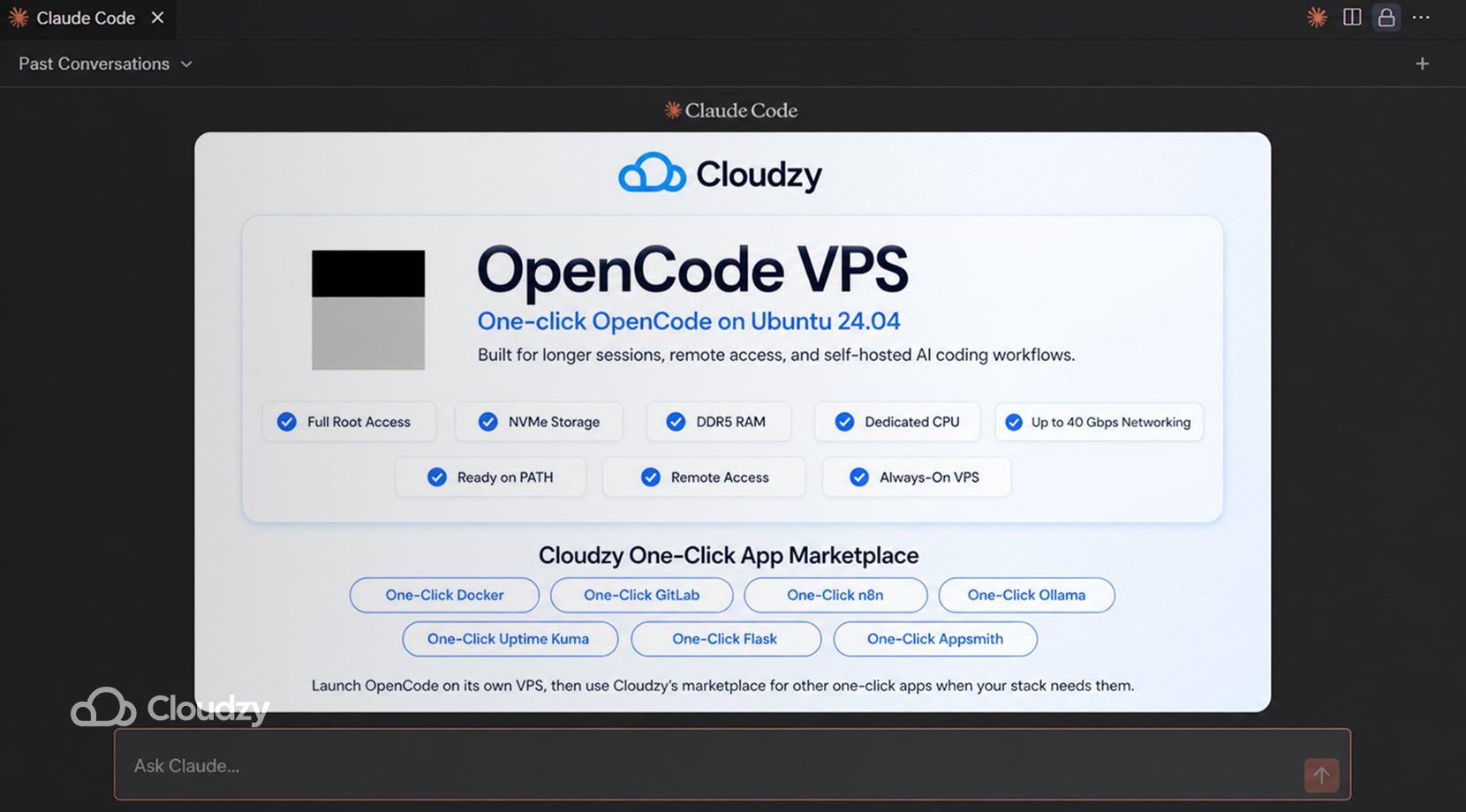

Jak uruchomić alternatywy dla Claude Code na własnej maszynie lub na VPS

Lokalna konfiguracja sprawdza się do pewnego momentu, bo w przypadku mniejszych repozytoriów, krótszych sesji i podstawowych wymagań prywatności laptop może wystarczyć. Jednak gdy sesje się wydłużają lub model musi robić więcej niż tylko rozmawiać, RAM się zapełnia, kontekst jest obcinany, wywołania narzędzi zaczynają się sypać, a zadania trwają znacznie dłużej niż powinny.

Uruchamianie OpenCode na VPS zachowuje self-hosted workflow bez przywiązania do jednego dostawcy i bez upychania wszystkiego na własnej maszynie.

Cloudzy's OpenCode na VPS jednym kliknięciem w zasadzie eliminuje konfigurację, bo OpenCode jest już zainstalowany na Ubuntu 24.04, dodany do PATH i gotowy do pracy, bez tracenia czasu na przygotowywanie środowiska przed właściwą robotą.

To nie tylko oszczędność na konfiguracji. Dostajesz też dłuższe sesje, pracę z wieloma repozytoriami jednocześnie, równoległe zadania i zdalny dostęp bez żadnych zakłóceń, bo maszyna działa cały czas i nie konkuruje z zasobami twojego komputera.

Nasze usługi VPS oferują pełny dostęp root, storage NVMe, RAM DDR5, dedykowane zasoby i networking do 40 Gbps, więc konfiguracja nie stanie się wąskim gardłem tak jak laptop prędzej czy później.

A ponieważ OpenCode to zazwyczaj nie jedyna rzecz, która działa, nasz marketplace pokrywa już większość typowych narzędzi i aplikacji, których możesz potrzebować. Mamy ponad 300 aplikacji do uruchomienia jednym kliknięciem, w tym Docker, GitLab, n8n, Ollama, Uptime Kuma, Flask i Appsmith, więc i tych nie musisz instalować ręcznie!

Które alternatywy pasują do jakich programistów

W tym miejscu jest już jasne, że nie ma jednej najlepszej alternatywy dla Claude Code. Oto moje podsumowanie tego, kto powinien sięgnąć po co:

- Wybierz narzędzie terminal-first, jeśli głównie pracujesz w powłoce: OpenCode, Aider, Gemini CLI lub Codex CLI.

- Wybierz narzędzie editor-first, jeśli większość pracy odbywa się w środowisku w stylu VS Code: Cline, Cursor lub Copilot.

- Wybierz Continue, jeśli głównym celem jest niestandardowa konfiguracja modelu lub backendu.

- Wybierz Replit Agent, jeśli zależy Ci na szybkim prototypowaniu w środowisku zarządzanym, a nie na lokalnej kontroli repozytorium.

Warto jednak pamiętać, że większość programistów korzysta z więcej niż jednego z powyższych narzędzi - tak po prostu wygląda praca w dzisiejszych czasach.

Podsumowanie: najlepsze alternatywy dla Claude Code

Claude Code to wciąż solidne narzędzie, ale nie musi być jedynym w Twoim workflow. Wybór zależy od tego, gdzie odbywa się praca - czy to terminal, edytor, środowisko chmurowe, czy własny stos serwerów.

Dla programistów, którzy chcą OpenCode bez ręcznej konfiguracji serwera, Cloudzy One-Click OpenCode VPS daje gotowe środowisko Ubuntu 24.04 z zainstalowanym OpenCode i możliwością późniejszego dodania pozostałych elementów stosu deweloperskiego.