Wraz z rosnącym zapotrzebowaniem na lokalne LLMy, wielu użytkowników znajduje się w zamieszaniu przy wyborze najpowniejszego rozwiązania, ale używanie ich nie jest takie proste, jak mogłoby się wydawać. Ponieważ niektóre LLMy zużywają sporą moc, a inne jeszcze więcej, wielu woli się im nie zbliżać. Do tego dochodzą długie godziny, które początkujący mogą spędzić, wpatrując się w terminal.

Istnieją jednak dwie prominentne opcje, które sprawiają, że praca jest prostsza. Ollama i LM Studio to dwie z najczęściej używanych platform do uruchamiania lokalnych LLMów. Ale wybór między nimi może być trudny, ponieważ każda z nich obsługuje inne przepływy pracy. Bez dalszych ceregieli, zobaczmy porównanie Ollama vs LM Studio.

Ollama jako narzędzie dla zaawansowanych użytkowników

Jeśli chodzi o uruchamianie lokalnych LLMów, Ollama to solidna opcja dzięki swoim wielu funkcjom. To nie tylko wysoce konfigurowalne narzędzie, ale możesz go też używać bezpłatnie, bo to społecznościowa platforma open-source.

Chociaż Ollama ułatwia uruchamianie lokalnych LLMów, jest to narzędzie oparte na linii poleceń (CLI), więc wciąż wymaga znajomości terminala. Interfejs CLI to ogromny plus dla przepływów pracy developerów ze względu na jego prostotę. Chociaż praca z CLI nie jest łatwa, wymaga mniej czasu do opanowania niż uruchamianie lokalnych LLMów na własną rękę.

Ollama zamienia Twój komputer w lokalny mini-serwer z HTTP API, dając Twoim aplikacjom i skryptom dostęp do jego wielu modeli. Oznacza to, że reaguje na polecenia w taki sam sposób, w jaki robiłby to online LLM, bez przesyłania danych do chmury. A jego API pozwala użytkownikom integrować Ollama i podłączać go do stron internetowych i chatbotów.

Ze względu na swoją naturę CLI, Ollama jest też dość lekki, co zmniejsza zapotrzebowanie na zasoby i skupia się na wydajności. To jednak nie oznacza, że uruchomisz go na przestarzałym komputerze, ale wciąż jest obiecujący dla użytkowników, którzy chcą zmaksymalizować każdy fragment dostępnych zasobów i skierować go do samego modelu LLM.

Biorąc to wszystko pod uwagę, pewnie już się domyślasz, że Ollama skupia się na przepływach pracy developerów, i masz rację. Dzięki łatwa integracji, prywatności lokalnej i projektowaniu skoncentrowanemu na API, to oczywisty wybór, jeśli myślisz jak developer.

W dyskusji Ollama vs LM Studio, Ollama może być bardziej pożądany ze względu na jego rozwój skoncentrowany na API. Jeśli CLI runtime to dla ciebie za dużo nowego, czekaj na lżejszą opcję zaprojektowaną z prostotą obsługi.

LM Studio. Opcja przyjazna dla użytkownika

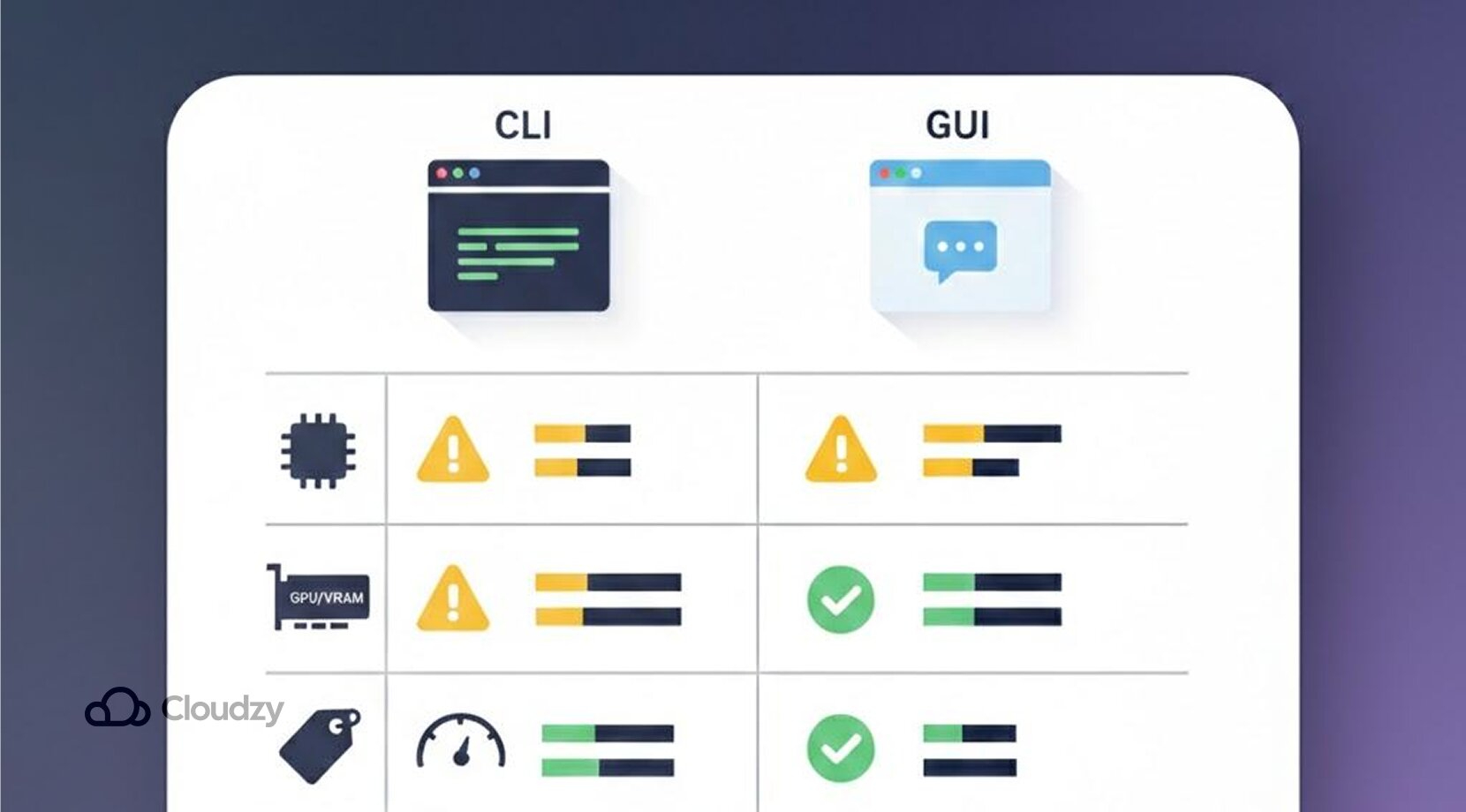

LM Studio stoi w ostrym kontraście do Ollama. Zamiast pełnoprawnego interfejsu CLI, nie wymaga żadnych poleceń terminalowych do uruchomienia, a dzięki interfejsowi GUI (graphical user interface) wygląda jak każda inna aplikacja desktopowa. Dla niektórych początkujących, wybór między Ollama vs LM Studio sprowadza się do prostoty CLI versus GUI.

Podejście LM Studio do usuwania barier technicznych otwiera drzwi do prostej przestrzeni dla każdego użytkownika. Zamiast dodawać i uruchamiać modele z linii poleceń, możesz po prostu korzystać z dostarczonych menu i pisać w polu podobnym do czatu. Wygląda na to, że każdy może używać LM Studio do eksperymentów z lokalnymi LLM, ponieważ wygląda to jak ChatGPT.

Dodatkowo ma wbudowaną przeglądarkę modeli w aplikacji, gdzie użytkownicy mogą odkrywać i wdrażać dowolny model, od lekkich modeli do prostych zadań, aż po zaawansowane do trudniejszych. Ponadto ta przeglądarka oferuje krótkie opisy dostępnych modeli i rekomendowane przypadki użycia, a użytkownicy mogą pobrać modele jednym klikiem.

Chociaż większość modeli jest dostępna za darmo, niektóre mogą zawierać dodatkowe licencje i prawa użytkowania. W niektórych przepływach pracy LM Studio może też oferować lokalny tryb serwera do łatwych integracji, ale jest zaprojektowany głównie wokół prostego interfejsu desktopowego dla początkujących. Biorąc to wszystko pod uwagę, porównajmy Ollama i LM Studio obok siebie.

Istotne obserwacje. Ollama vs LM Studio

Zanim pójdziemy dalej, trzeba wspomnieć o jednym krytycznym zagadnieniu. fraza "Ollama vs LM Studio" może sugerować, że jeden jest obiektywnie lepszy od drugiego, ale to nie cała historia, ponieważ są przeznaczone dla różnych odbiorców. Oto szybkie porównanie Ollama vs LM Studio.

| Funkcja | Ollama | LM Studio |

| Łatwość użytkowania | Mniej przyjazny na start, wymaga znajomości terminala | Przyjazny dla początkujących, wymaga dużo klikania myszą |

| Obsługa modelu | Wiele popularnych otwartych modeli. gpt-oss, gemma 3, qwen 3 | Dokładnie to samo co Ollama. gpt-oss, gemma3, qwen3 |

| dostosowanie | Wysoko konfigurowalny, łatwo integruje się przez API | Mniej swobody, dostosuj wspólne ustawienia za pomocą przełączników/suwaków |

| Wymagania sprzętowe | To zależy. większe modele są wolniejsze bez wystarczającej mocy | Znowu zależy od rozmiaru modelu i twojego sprzętu |

| Prywatność | Świetna prywatność domyślnie bez dodatkowych zewnętrznych API | Czaty pozostają lokalne. aplikacja wciąż kontaktuje się z serwerami w celu aktualizacji i wyszukiwania/pobierania modeli. |

| Użytkowanie offline | W pełni obsługuje pracę offline po pobraniu modeli | Również świetnie offline po pobraniu modeli |

| Dostępne platformy | Linux, Windows, macOS | Linux, Windows, macOS |

- Zaawansowane modele. problem z zasobami sprzętowymi: Większość osób chętnie korzystałaby z większego i bardziej wydajnego modelu, gdy tylko jest to możliwe. Uruchamianie ich na typowym laptopie może jednak prowadzić do poważnych problemów, ponieważ większe modele wymagają znacznie więcej RAM i VRAM. To może oznaczać wolne odpowiedzi, ograniczoną długość kontekstu lub całkowity brak możliwości załadowania modelu.

- Problemy z baterią: Uruchamianie LLM lokalnie może szybko wyczerpać baterię podczas intensywnego obciążenia. Prowadzi to do skrócenia czasu pracy baterii, a na dodatek turbiny i radiatory generują bardzo głośny hałas.

Ollama vs LM Studio: pobieranie modeli

Kolejny aspekt porównania Ollama vs LM Studio to ich różne podejścia do pobierania modeli. Jak wspomniano wcześniej, Ollama nie instaluje lokalnych LLM jednym kliknięciem. Zamiast tego musisz użyć jego natywnego terminala i linii poleceń. Polecenia są jednak proste do zrozumienia.

Oto szybki sposób na uruchomienie modeli w Ollama.

- Pobierz swój ulubiony model wpisując ollama pull gpt-oss lub dowolny inny wybrany model (nie zapomnij dodać tagu, który możesz wybrać z biblioteki).

Przykład: ollama pull gpt-oss:20b - Możesz wtedy uruchomić model za pomocą polecenia ollama run gpt-oss

- Można dodać też dodatkowe narzędzia. Na przykład Claude'a możesz dodać za pomocą ollama launch claude

Jeśli terminale i polecenia nie są Twoją specjalnością, spróbuj LM Studio. Nie musisz nic wpisywać w terminal, aby zacząć pracować i pobierać modele. Po prostu przejdź do wbudowanego menedżera pobrań i wyszukaj LLM za pomocą słów kluczowych takich jak Llama lub Gemma.

Alternatywnie możesz wpisać pełne Hugging Face URL w pasku wyszukiwania.

Istnieje również opcja dostępu do karty odkrywania z dowolnego miejsca za pomocą ⌘ + 2 na Macu lub Ctrl + 2 na Windows / Linux.

Ollama: wyższa prędkość

Czasami dla użytkowników i firm liczy się tylko szybkość. Okazuje się, że porównując Ollama vs LM Studio pod względem szybkości, Ollama jest szybszy, choć wynik może się różnić w zależności od konfiguracji i sprzętu.

W przypadku jednego użytkownika na subreddicie r/ollama, Ollama przetwarzał szybciej niż LM Studio.

To nie jest twierdzenie bez podstaw, ponieważ użytkownik przetestował zarówno Ollama jak i LM Studio, uruchamiając qwen2.5:1.5b pięć razy i obliczając średnią liczbę tokenów na sekundę.

Ollama vs LM Studio: wydajność i wymagania sprzętowe

Wydajność to obszar, w którym Ollama vs LM Studio zależy bardziej od sprzętu niż od interfejsu. Doświadczenie lokalnych LLM po raz pierwszy to coś zupełnie innego niż chmurowe LLM, do których jesteśmy przyzwyczajeni. To daje poczucie niezależności mieć LLM tylko dla siebie, aż do momentu, gdy napakatasz się na ograniczenia wydajności.

Biorąc pod uwagę, jak wzrosły ceny RAM i VRAM w ciągu ostatnich kilku lat, bardzo trudno jest wyposażyć swoją maszynę w wystarczającą moc do uruchamiania dużych LLM.

Popularne modele wymagają zwykle 24-64GB RAM

Tak, dobrze słyszysz. Wymagania sprzętowe nie przesądzają o wygranej w porównaniu Ollama vs LM Studio. Jeśli chcesz płynnego doświadczenia podczas uruchamiania popularnych średnich lub dużych modeli bez spowolnień czy awarii, najlepszym rozwiązaniem jest zainstalowanie 24-64GB RAM. W większości przypadków jednak nawet ta ilość RAM staje się niewystarczająca przy dłuższym kontekście i ciężarnych obciążeniach.

Możesz uruchomić mniejsze, tak zwane skwantyzowane modele na 8-16GB RAM, ale nie uzyskasz takiej samej wygody i wydajności jak w przypadku większych, a poza tym będą pewne kompromisy w jakości i szybkości. Niestety RAM to nie jedyny problem; inne komponenty muszą być również wydajne.

Mocne GPU to podstawa do utrzymania spokoju

Choć modele mogą działać na CPUs, twoja karta graficzna wciąż odgrywa kluczową rolę. Bez szybkiego GPU i dużej ilości VRAM będziesz mieć do czynienia z powolnym generowaniem tokena, długimi opóźnieniami dla dłuższych odpowiedzi i szybko stanie się to nie do zniesienia.

Nie wieszaj sobie zbyt dużych nadziei, bo nawet potężny RTX 5070Ti czy RTX 5080 to za mało do poważnego deep learningu. Dla некоторых konfiguracji z kontekstem 60k+, sam Ollama wymaga około 23GB VRAM, czyli znacznie więcej niż typowe 16GB VRAM z tych GPUs.

Wybieranie czegoś poniżej tej mocy to też astronomicznie drogi wydatek. Jeśli cena nie jest dla ciebie problemem, wciąż są rzeczy Opcje GPU do rozważenia przy uruchamianiu lokalnych LLMs.

Teraz możesz być zdezorientowany, jak złożyć maszynę wystarczająco potężną do uruchamiania większych lokalnych modeli LLM. To punkt zwrotny dla wielu osób, które rozważają inne rozwiązanie.

Jedną z alternatyw, którą rozważają entuzjaści, jest korzystanie z maszyn wirtualnych z solidnym, wstępnie zainstalowanym sprzętem. Korzystanie z VPS (wirtualnego serwera prywatnego) to świetny sposób na połączenie swojego domowego laptopa lub innego urządzenia z prywatnym serwerem do wyboru, ze wszystkimi wymaganymi komponentami już gotowymi.

Jeśli VPS brzmi dla ciebie jak dobre rozwiązanie, zdecydowanie polecamy Ollama VPSCloudzy, gdzie pracujesz w czystym środowisku. Już zawiera Ollama, więc możesz od razu zacząć pracę z lokalnymi LLMs z pełną prywatnością. Dostępne 12 lokalizacji, 99,95% niezawodność i wsparcie 24/7. Zasoby są obfite: dedykowane VCPUs, DDR5 pamięć i NVMe magazyn na łączu do 40 Gbps.

Ollama vs LM Studio: Kto potrzebuje czego

Jak wspomnieliśmy, obie platformy są wysoko funkcjonalne i żadna nie jest lepsza, ale jest haczyk. Każda pasuje do innego sposobu pracy, więc zależy od twoich potrzeb.

Wybierz Ollama do automatyzacji i rozwoju

Twój cel przy Ollama nie jest tylko rozmowa z modelem, ale użycie go jako komponentu wewnątrz innego projektu. Ollama jest idealny do:

- Deweloperzy budowania produktów takich jak chatboty, copiloty i inne rozwiązania wymagające deep learningu

- Przepływów pracy obejmujących masową automatyzację, na przykład skryptów podsumowujących raporty czy generowania szkiców według harmonogramu

- Zespoły które wymagają spójnych wersji modelu w każdym środowisku

- Każdy użytkownik szukający podejścia API-first, aby inne narzędzia mogły się łączyć z modelami regularnie

Ostatecznie, jeśli chcesz, aby modele były niezawodne dla twoich aplikacji, Ollama może być twoim najlepszym wyborem.

LM Studio to łatwiejszy sposób na eksplorację lokalnych LLMs

Jeśli chcesz eksplorować lokalne konfiguracje AI bez technicznych komplikacji, LM Studio to zdecydowanie lepszy wybór.

Ogólnie LM Studio sprawdza się lepiej do:

- Początkujący którzy boją się terminala i linii poleceń

- Pisarze, twórcy lub studenci którzy potrzebują prostego chatu z pomocą AI

- Osoby, które testują różne rozwiązania szukając szybkiego porównania modeli, aby znaleźć swoją niszę

- Każdy, kto dopiero uczy się pisać prompty i chce dostosowywać ustawienia bez wpisywania poleceń

Krótko mówiąc, jeśli chcesz pobrać i natychmiast rozpocząć pracę z lokalnymi LLM, LM Studio spełni Twoje potrzeby.

Ollama vs LM Studio: Ostateczna rekomendacja

Jeśli pominiesz hype wokół rywalizacji między Ollama i LM Studio, to co naprawdę się liczy, to Twoja codzienna praca, zależna od przepływu pracy i możliwości sprzętu.

Ollama ogólnie:

- Elastyczne i skoncentrowane na deweloperach

Podczas gdy LM Studio to:

- Dostępne dla początkujących z dedykowanym interfejsem

Oba wymagają potężnego i drogiego sprzętu, aby działać płynnie. Wielu ludzi nie stać na uruchamianie dużego lokalnego LLM na własną rękę. Dlatego jeśli chcesz uruchamiać zaawansowane modele bez obciążania sprzętu, rozważ wypróbowanie Ollama na dedykowanym GPU VPSPoniżej znajduje się kilka typowych pytań dotyczących Ollama vs LM Studio.