Eğer karar veriyorsanız H100 vs RTX 4090 AI için kullanacaksanız, çoğu "benchmark" sonucunun modeliniz ve önbelleğiniz gerçekten VRAM'ye sığmadan bir önemi olmadığını unutmayın. RTX 4090, 24 GB sınırı içinde kalan tek GPU iş yükleri için ideal noktadır.

H100 ise daha büyük modellere, yüksek eş zamanlılığa, çok kullanıcılı izolasyona veya bellek yönetimiyle daha az uğraşmaya ihtiyaç duyduğunuzda başvuracağınız seçenektir.

Konuyu iş yüklerine göre ele alacağım, benchmark türlerini göstereceğim ve kendi ortamınızda uygulayabileceğiniz hızlı bir test planı sunacağım.

Hızlı Yanıt: AI İş Yükleri İçin H100 ile RTX 4090 Karşılaştırması

H100 büyük model eğitimi ve ciddi servis ihtiyaçları için öne çıkar; geniş HBM havuzları, çok yüksek bellek bant genişliği, NVLink ve yalıtım için MIG sunar. RTX 4090 "tek GPU hızında daha iyi fiyat istiyorum" durumu için daha uygun bir seçenek; yüklerin 24 GB'a sığdığı ve sürekli taviz vermek zorunda kalmadığınız sürece. Özellikler ve platform avantajları bunu oldukça net biçimde ortaya koyuyor.

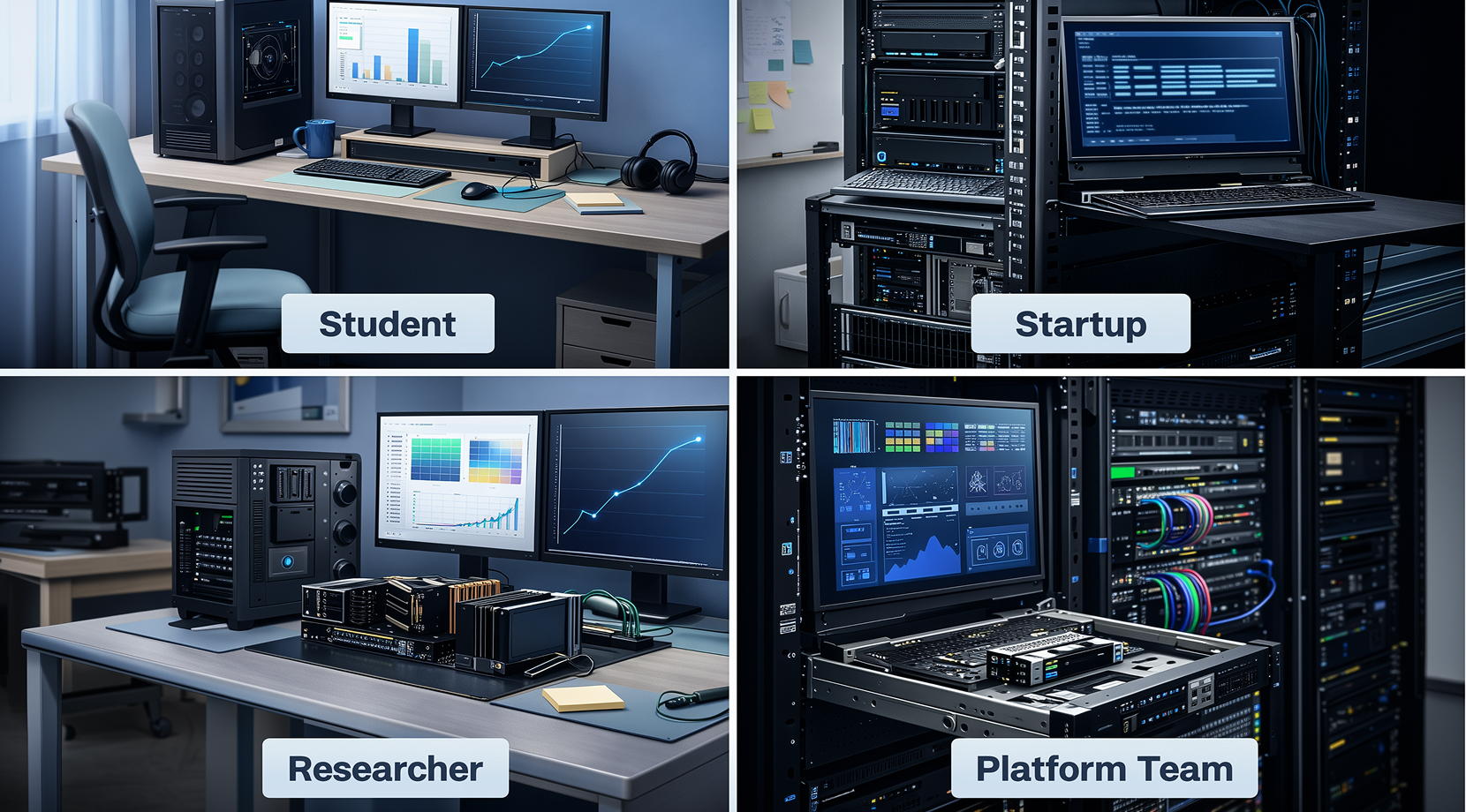

Kullanım senaryosuna göre hızlı seçim listesi:

- Yerel LLM Geliştirici (Solo Geliştirici / Öğrenci): VRAM darboğaz olmaya başlayana kadar RTX 4090.

- Startup ML Mühendisi (MVP Yayınlıyor): Erken aşama servis ve ince ayar için RTX 4090; kararlı eşzamanlılık veya daha büyük modellere ihtiyaç duyduğunuzda H100.

- Uygulamalı Araştırmacı (Yoğun Deneyler): OOM hataları, batch sınırları veya uzun bağlamlarla sürekli karşılaşıyorsanız H100.

- Üretim / Platform Ekibi (Çok Kiracılı Servis): MIG dilimleme, daha yüksek kapasite payı ve daha istikrarlı ölçekleme için H100.

Bu çerçeveyle, makalenin geri kalanı gerçek hayatta karşılaşılan sınırlamalara ve benchmark sonuçlarının bu sınırlamalarla nasıl örtüştüğüne odaklanıyor.

Göz Önünde Bulundurulması Gereken Tek Benchmark Sorusu: VRAM'ye Ne Sığdırılabilir?

Hakkındaki tartışmaların büyük çoğunluğu H100 vs RTX 4090 teknik olarak birer VRAM tartışmasıdır. LLM çalışmalarında VRAM, ağırlıklar, aktivasyonlar eğitim sırasında, optimizer durumları eğitimde tüketilir, KV önbelleği çıkarım sırasında ise. Bu sonuncusu, bağlam uzunluğu ve eşzamanlılıkla birlikte büyüdüğü için insanların pek beklemediği şeydir.

Aşağıdaki tablo kasıtlı olarak genel düzeyde tutulmuştur; kesin sığma durumu çerçeveye, hassasiyete ve ek yüke göre değişir.

"Sorunsuz sığar mı?" sorusuna genel bir bakış:

| İş Yükü | RTX 4090'de Tipik Tek GPU Gerçeği (24 GB) | H100'de Tipik Tek GPU Gerçeği (80-94 GB) |

| 7B LLM çıkarımı (FP16 / BF16) | Genellikle iyi | Rahat boşluk |

| 13B LLM çıkarımı | Çoğunlukla sınırda, bağlama göre değişir | Genellikle iyi |

| 70B sınıf çıkarım | Yoğun kuantizasyon/offload gerektirir | Çok daha gerçekçi |

| SD/SDXL çıkarımı + küçük batch | Genellikle iyi | Yeterli, üstelik daha fazla toplu işlem kapasitesiyle |

| Daha yüksek eş zamanlılıkla servis | KV önbellek baskısı hızlı ortaya çıkıyor | Daha fazla alan, yük altında daha kararlı |

Daha geniş bir GPU kısa listesi istiyorsanız (yalnızca bu ikisiyle sınırlı kalmadan), yaygın AI GPU'lerin VRAM ve bellek bant genişliğini karşılaştıran 2025'te Makine Öğrenmesi İçin En İyi GPU'lar handy bir başvuru tablosudur.

İş yükünüzün uygun olduğunu öğrendikten sonra, performansın ne kadar "akıcı" hissettireceğini belirleyen bir sonraki faktör bellek bant genişliğidir.

Bant Genişliği: HBM'in Farkı Nereden Geliyor

AI performans tartışmalarının büyük bölümü hesaplama zirvelerine odaklanır; ancak transformer mimarileri bellek hareketi konusunda son derece hassastır. H100'nin avantajı, büyük HBM havuzlarını çok yüksek bellek bant genişliğiyle bir araya getirmesi; buna platform tarafında NVLink bant genişliği ve MIG bölümlendirmesi de ekleniyor.

Teknik Özellikleri Anlık Görüntü

Teknik özellikler sizin için GPU seçmez; ama aynı iş yükünün bir kartta neden rahat, diğerinde neden sıkışık hissettirdiğini açıklar. Bu karşılaştırma, LLM eğitimi, çıkarımı ve servis davranışını en çok etkileyen faktörleri gösteriyor.

| Spesifikasyon | H100 (SXM / NVL) | RTX 4090 |

| VRAM | 80 GB / 94 GB | 24 GB |

| Bellek Bant Genişliği | 3,35–3,9 TB/s | GDDR6X (kapasite sınırlaması 24 GB'de) |

| Ara bağlantı | NVLink + PCIe Gen5 | PCIe (tüketici platformu) |

| Çok Örnek | 7'ye kadar MIG örneği | Yok |

Teknik özellikler referansları: NVIDIA H100, NVIDIA RTX 4090.

Pratikte bu ne anlama geliyor:

- Toplu iş boyutunu veya bağlam uzunluğunu artırmaya çalışıyorsanız, H100 ödün vermek zorunda kalmadan daha uzun süre kararlı kalır.

- Aynı anda çok sayıda istek sunuyorsanız, H100'nin daha fazla "bellek nefes alanı" olduğundan kuyruk gecikmesi sorunlarıyla daha geç karşılaşırsınız.

- İş yükünüz çoğunlukla tek kullanıcı, tek model ve mütevazı bağlamdan oluşuyorsa 4090 çoğu zaman hızlı ve tatmin edici hissettirir.

Bant genişliği, kapsamlı kıyaslamanın yerini tutmaz. Sadece iki GPU'nin dar bir testte neden birbirine yakın göründüğünü, gerçek yük altında ise neden birbirinden ayrıştığını açıklar.

Güvenilir H100 - RTX 4090 Kıyaslamaları

Her kıyaslama aynı değildir; "benim sonuçlarım senininkiyle uyuşmuyor" tartışmasının bu kadar sık yaşanmasının nedeni de budur. H100 vs RTX 4090kıyaslamaları iki gruba ayırmak işe yarar:

- A Grubu (topluluk odaklı): llama.cpp-style tokens/sec tests and simple inference scripts.

- B Grubu (standartlaştırılmış test paketleri): Tekrarlanabilir kurallara odaklanan MLPerf Training ve MLPerf Inference tarzı sonuçlar.

Llama.cpp Tarzı Çıkarım Anlık Görüntüsü

Bu, insanların evde çalıştırıp üç gün tartıştığı türden bir test. Pek çok geliştiricinin kullandığı "gerçek bir araç zincirini" yansıttığı için değerlidir; ancak fit ve hassasiyeti göz ardı ederseniz sonuçları yanlış yorumlamak da kolaydır.

Kamuya açık llama.cpp tarzı karşılaştırmalar, RTX 4090'nin küçük modellerde ve quantize çalıştırmalarda oldukça iyi performans gösterdiğini ortaya koyuyor; ancak daha yüksek hassasiyetteki büyük modeller VRAM sınırını kolayca aşıyor.

Beklemeniz gereken tablo şu:

| Model | GPU | Tipik Sonuç |

| 7B sınıfı | RTX 4090 | Yüksek token/sn, tek kullanıcılı çıkarımda sorunsuz akış |

| 13B sınıfı | RTX 4090 | Hâlâ iyi, ancak bağlam uzunluğu ve yük artmaya başlıyor |

| 70B sınıfı | RTX 4090 | Agresif quantization veya offload olmadan düzgün sığmıyor |

| 70B sınıfı | H100 | Bellekte tutmak ve kararlı biçimde servis etmek çok daha gerçekçi |

Bu tablonun amacı '4090 kötü' ya da 'H100 sihirli' demek değil. Asıl mesele şu: VRAM sınırı bellekte ne kadar tutabileceğinizi belirliyor, bu da hız, kararlılık ve uğraşacağınız ayar miktarını doğrudan etkiliyor.

Sistemi ayakta tutmak için sürekli bağlam uzunluğunu kırpıyorsanız, bu karşılaştırma artık teorik olmaktan çıkmıştır.

MLPerf'in Forum Benchmark'larına Kattığı Şey

MLPerf, 'rastgele scriptler ve sezgiler' ile binlerce dolarlık kararlar alınamayacağı için var. MLCommons, zamanla yeni nesil üretken yapay zeka iş yükleri ekledi; MLPerf ise sonuçları farklı sistemler arasında karşılaştırılabilir kılmak için tasarlandı.

Eğitim tarafında, NVIDIA'nın MLPerf Training v5.1 raporu, satıcıların eğitim süresini, gönderim ortamının ayrıntılarını ve uyduğu benchmark kurallarını nasıl raporladığına dair iyi bir örnek.

Bu alan kendi özel promptlarınızın nasıl davranacağını söylemez; ama sistem düzeyinde ölçekleme ve 'bu donanım sınıfının kurallı koşullarda nasıl performans gösterdiği' konusunda sizi gerçekçi bir zemine oturtur.

Şimdi satın alma kararlarını en çok etkileyen konuya geçelim: işi bitirmek için harcanan zaman ve para.

Maliyet, Zaman ve Fırsat Maliyeti

Çok fazla H100 vs RTX 4090 Kararlar çoğunlukla 'satın alma fiyatı mı, kiralama fiyatı mı?' çerçevesinde ele alınır. Oysa bu nadiren doğru çerçevedir. Daha doğru soru şu: Kullanılabilir bir model üretmek kaç saatinizi alıyor ve kısıtlamalarla boğuşmak ne kadar zamanınızı çalıyor?

Üç yaygın senaryo, bu dengeleri oldukça net biçimde gösteriyor.

Küçük ile Orta Boy Modellerde Haftalık İnce Ayar

Çalıştırmalarınız sürekli taviz vermeden 24 GB içinde kalıyorsa, 4090 yolu harika hissettiriyor. Hızla iterasyon yaparsınız, cluster zamanı planlamanıza gerek kalmaz, kurulumunuz sade olur. Ama her çalıştırma 'batch'i düşür, bağlamı kes, tekrar dene'ye dönüşüyorsa, yüksek maliyetine karşın H100 çok daha mantıklı bir seçenek haline gelir.

Gerçek Eşzamanlılıkla Servis Etmek

Eş zamanlı istekler KV önbellek baskısını hızla artırır. İşte bu noktada H100'nin fazladan kapasitesi ve platform kontrolleri karşılığını verir; özellikle öngörülebilir gecikme süreleri ihtiyacınız varsa.

GPU sunucusunun dağıtımınız için doğru seçim olup olmadığına henüz karar vermediyseniz, GPU VPS ile CPU VPS Karşılaştırması karşılaştırması, yanlış şeyi optimize etmeye zaman harcamadan önce iş yükünü altyapı türüyle eşleştirmek için işe yarar bir yöntemdir.

Son Teslim Tarihi Olan Büyük Eğitim İşleri

Tek kişi, tek makine sınırını aşmaya başladığınızda, odaklanmak isteyeceğiniz şey sıradan ama kritik konulardır: kararlı ortamlar, daha az hata modu ve temelde bakıcılık olan işlere harcanan daha az zaman. H100 tam olarak bunun için tasarlandı.

Bu bölümden sonra hâlâ kararsızsanız, yapılacak bir sonraki şey daha fazla okumak değil. Sürücü uyumsuzlukları ve çok kullanıcılı iş yükleri dahil olmak üzere stack'inizin pratikte nasıl davrandığına bakmaktır.

Yazılım ve Operasyon: Sürücüler, Kararlılık, Çok Kullanıcılı Ortamlar ve Destek

Benchmark grafiklerinin büyük çoğunluğunun atladığı kısım burasıdır; oysa günlük hayatın önemli bir parçasıdır.

RTX 4090, birçok AI iş akışı için erişilebilir ve hızlı olduğundan popülerdir. Dezavantajı şudur: kullanım senaryonuz büyüdüğünde, paylaşımlı ve çok kiracılı ortamlar için tasarlanmamış bellek tavanları ve ölçeklendirme kalıplarıyla karşılaşma olasılığınız artar.

H100 kümeler için yapılandırılmıştır. MIG, platform ekipleri için büyük bir avantajdır; tek bir GPU'yi izole dilimlere bölmenizi sağlar, bu da 'gürültülü komşu' sorunlarını azaltır ve kapasite planlamasını çok daha kolaylaştırır. NVIDIA'nın resmi H100 teknik özelliklerine göre form faktörüne bağlı olarak 7'ye kadar MIG örneği desteklenmektedir.

İş yükünüz kişisel ve yerel ise 4090 tarafında uzun süre mutlu kalabilirsiniz. İş yükünüz çok kullanıcılı ve müşteriye yönelikse, H100 daha güvenli tercih.

Peki genel olarak kim ne almalı?

İş Yükünüz İçin Hangisini Seçmelisiniz

İçin H100 vs RTX 4090, doğru seçim nihayetinde en büyük engellerinizi ortadan kaldıran seçenektir.

Yerel LLM Geliştiricisi (Bireysel / Öğrenci)

Çoğunlukla 7B-13B aralığında çalışıyorsanız, quantize inference yapıyorsanız, RAG ile denemeler yapıyorsanız veya SDXL üzerinde çalışıyorsanız RTX 4090'yi seçin. Bellekle uğraşmaya, asıl geliştirmekten daha fazla zaman harcamaya başladığınızda geçiş yapın.

Startup ML Mühendisi (MVP Yayına Alıyor)

MVP'niz tek bir model ise, trafiği orta düzeydeyse ve belleğe rahatlıkla sığıyorsa 4090 güçlü bir başlangıçtır. Ani yükler altında kararlı gecikme süresi, daha yüksek eş zamanlılık veya sunucu başına birden fazla iş yükü gerekiyorsa H100 daha sorunsuz bir yoldur.

Uygulamalı Araştırmacı (Çok Sayıda Deney Yapıyor)

Batch boyutunu küçültmek veya hassasiyet ayarlarıyla uğraşmak gibi tavizlere sık sık zorlanıyorsanız, H100 size daha temiz deneyler ve daha az başarısız çalışma sağlar.

Prodüksiyon / Platform Ekibi (Çok Kiracılı Servis)

H100 açık tercih; MIG desteği ve daha fazla kapasitesi kapasite planlamasını kolaylaştırır ve bir şeyler patladığında hasarı sınırlar.

Donanıma harcama yapmaya henüz hazır değilseniz, kiralama en mantıklı bir sonraki adımdır.

Pratik Bir Orta Yol: Önce GPU Kiralayın, Sonra Karara Varın

En kesin yanıtı almanın yolu H100 vs RTX 4090 çalıştırmak için senin modeliniz, senin istemler ve senin her iki donanım sınıfında bağlam uzunluğunu test edip ardından yük altında token/sn hızını ve kuyruk gecikmesini karşılaştırmaktır.

Bu yüzden tam olarak şunu geliştirdik: Cloudzy GPU VPS, bir GPU sunucusunu bir dakikadan kısa sürede ayağa kaldırabilir, tam root erişimiyle kendi kurulumunuzu yapabilir ve başkasının benchmark sonuçlarına dayanarak tahmin yürütmekten kurtulabilirsiniz.

GPU VPS planlarımızda şunları elde edersiniz:

- Adanmış NVIDIA GPU'ler (RTX 4090 ve A100 sınıfı seçenekler dahil), böylece gürültülü komşu etkisiyle sonuçlarınız saptırılmaz.

- 40 Gbps'e kadar ağ bağlantısı tüm GPU planlarında, bu da veri seti indirmeleri, çok düğümlü iş akışları ve dosyaların hızlı taşınması için ciddi bir avantaj.

- NVMe SSD depolama, artı DDR5 RAM ve tüm kademelerde yüksek frekanslı CPU seçenekleri; bu sayede sunucunun geri kalanı GPU'yi yavaşlatmaz.

- DDoS koruması ve bir %99,95 uptime, uzun süreli işler rastgele ağ dalgalanmaları yüzünden sekteye uğramaz.

- Saatlik faturalandırma (kısa benchmark denemeleri için kullanışlı) ve bir 14 günlük para iade garantisi düşük riskli testler için.

Önce bir RTX 4090 planında aynı benchmark listesini çalıştırın, ardından daha büyük bağlamlar, daha yüksek eşzamanlılık veya daha büyük modellere geçtiğinizde A100 sınıfı bir planda tekrarlayın. Bundan sonra, H100 vs RTX 4090 arasındaki seçim çoğunlukla kendi loglarınızdan kendiliğinden netleşir.

Benchmark Kontrol Listesi: 30 Dakikada Kendi Testinizi Çalıştırın

Savunabileceğiniz bir karar vermek istiyorsanız, kullanmayı planladığınız yapıdan şu dört sayıyı alın:

- Tokens/saniye hedef bağlam uzunluğunda

- 95. yüzdelik gecikme süresi beklenen eşzamanlılık düzeyinde

- VRAM sürü alanı en yoğun aşamada

- Tamamlanan çalışma başına maliyet başlangıçtan artifakt'a kadar

vLLM ile minimal bir smoke test şöyle görünür:

pip install vllm transformers accelerate

python -m vllm.entrypoints.api_server \

--model meta-llama/Llama-3-8B-Instruct \

--dtype float16 \

--max-model-len 8192Gerçekte ne kiraladığınızı net olarak görmek istiyorsanız, GPU VPS Nedir? başlıklı yazımız adanmış GPU erişimi, vGPU paylaşımı ve plan seçmeden önce nelere dikkat etmeniz gerektiğini açıklıyor.