Với nhu cầu ngày càng tăng về LLM cục bộ, nhiều người dùng cảm thấy bối rối khi lựa chọn công cụ phù hợp nhất, nhưng việc sử dụng chúng không đơn giản như bạn nghĩ. Vì chúng tiêu tốn năng lượng khá nhiều, có cái thì nhiều hơn, nên nhiều người không muốn gần gũi với chúng, chứ chưa nói đến hàng giờ mà các người mới bắt đầu phải dành để nhìn chằm chằm vào hộp terminal.

Tuy nhiên, có hai ứng cử viên nổi bật giúp mọi thứ trở nên đơn giản hơn. Ollama và LM Studio là hai nền tảng được sử dụng rộng rãi nhất với hiệu suất cao để chạy LLM cục bộ. Nhưng việc lựa chọn giữa hai nền tảng này có thể rất khó khăn, vì mỗi nền tảng được thiết kế để phục vụ các quy trình làm việc khác nhau. Không dài dòng nữa, chúng ta hãy xem cuộc so sánh giữa Ollama vs LM Studio.

Ollama là công cụ dành cho các chuyên gia am hiểu công nghệ

Nếu nói về việc chạy LLM cục bộ, Ollama là một lựa chọn mạnh mẽ nhờ vào nhiều tính năng của nó. Không chỉ cấu hình cao mà bạn còn có thể sử dụng nó hoàn toàn miễn phí, vì nó là một nền tảng mã nguồn mở được hỗ trợ bởi cộng đồng.

Mặc dù Ollama giúp chạy LLM cục bộ trở nên đơn giản hơn, nhưng nó ưu tiên CLI (giao diện dòng lệnh), vì vậy nó vẫn yêu cầu một số kiến thức về terminal. Ưu tiên CLI là một điểm cộng lớn cho các quy trình phát triển vì tính đơn giản của nó. Mặc dù không phải là công việc dễ dàng để làm việc với CLI, nhưng nó ít tốn thời gian để hiểu so với việc chạy LLM cục bộ trên chính máy của bạn.

Ollama biến máy tính cá nhân của bạn thành một máy chủ mini cục bộ với một HTTP API, cho phép các ứng dụng và tập lệnh của bạn truy cập vào nhiều mô hình của nó, điều này có nghĩa là nó phản hồi các yêu cầu giống như cách một LLM trực tuyến sẽ làm, mà không gửi dữ liệu của bạn lên cloud. Chưa kể API của nó cho phép người dùng tích hợp Ollama và kết nối nó vào các trang web và chatbot.

Do bản chất CLI của nó, Ollama cũng khá nhẹ, giúp nó tiêu tốn ít tài nguyên hơn và tập trung hơn vào hiệu suất. Tuy nhiên, điều này không có nghĩa là bạn có thể chạy nó trên một máy tính cũ kỹ, nhưng nó vẫn đầy hứa hẹn cho những người dùng muốn tối đa hóa từng phần tài nguyên và chuyển hướng nó cho chính mô hình LLM.

Với tất cả những điều nói trên, bạn có thể đã đoán rằng Ollama tập trung rất nhiều vào các quy trình phát triển, và bạn đúng. Nhờ tích hợp dễ dàng, quyền riêng tư cục bộ và thiết kế ưu tiên API, nó là một sự lựa chọn rõ ràng nếu bạn có tư duy hướng tới nhà phát triển.

Trong cuộc tranh luận Ollama vs LM Studio, Ollama có thể được ưa thích hơn do thiết kế ưu tiên API của nó. Nếu CLI runtime quá xa lạ với bạn, hãy ở lại để tìm hiểu một tùy chọn nhẹ hơn được thiết kế với sự dễ sử dụng trong tâm trí.

LM Studio: Một lựa chọn thân thiện với người dùng

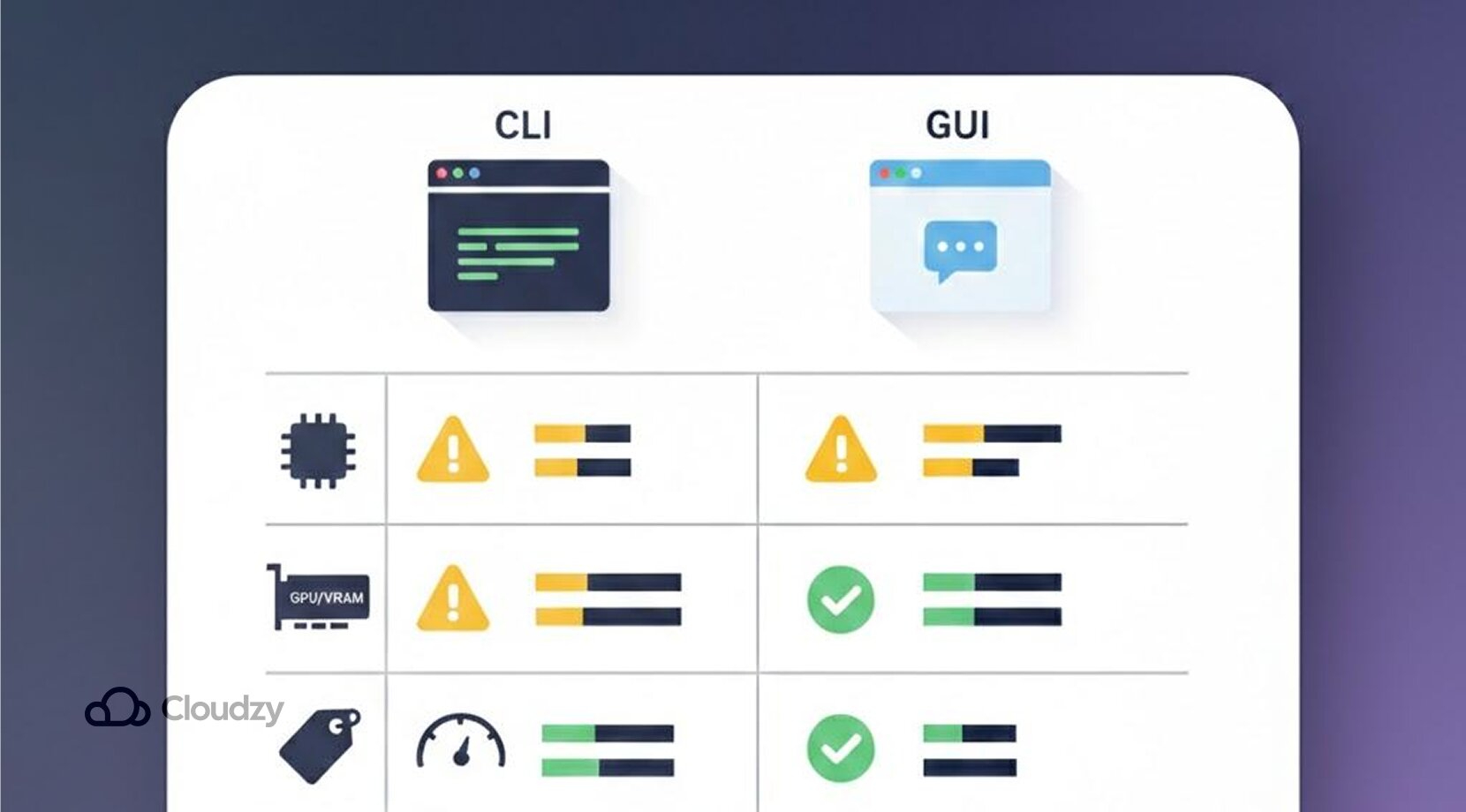

LM Studio tạo thành sự tương phản rõ nét với Ollama. Thay vì là một giao diện CLI toàn chức năng, nó không yêu cầu bất kỳ lệnh terminal nào để chạy, và vì nó được trang bị GUI (giao diện đồ họa), nó trông giống như bất kỳ ứng dụng máy tính để bàn nào khác. Đối với một số người mới bắt đầu, Ollama vs LM Studio cuối cùng là chọn giữa sự đơn giản của CLI và GUI.

Phương pháp của LM Studio để loại bỏ các rào cản kỹ thuật giúp ích rất nhiều trong việc tạo ra một không gian đơn giản cho bất kỳ người dùng nào. Thay vì thêm và chạy mô hình bằng dòng lệnh, bạn có thể chỉ cần sử dụng các menu được cung cấp và gõ vào một hộp giống như trò chuyện. Có vẻ như bất kỳ ai cũng có thể sử dụng LM Studio để thử nghiệm với LLM cục bộ, vì nó trông giống như ChatGPT.

Nó thậm chí còn đi kèm với một trình duyệt mô hình trong ứng dụng gọn gàng, nơi người dùng có thể khám phá và triển khai bất kỳ mô hình nào mà họ thích, từ những mô hình nhẹ nhàng dành cho các hoạt động bình thường, cho đến những mô hình nặng nề cho những nhiệm vụ khó hơn. Hơn nữa, trình duyệt này cung cấp những mô tả ngắn gọn về các mô hình có sẵn và các trường hợp sử dụng được khuyến nghị, và cho phép người dùng tải xuống mô hình chỉ bằng một cú nhấp chuột.

Mặc dù hầu hết các mô hình có thể tải xuống miễn phí, một số có thể bao gồm các giấy phép và quyền sử dụng bổ sung. Đối với một số quy trình làm việc, LM Studio cung cấp chế độ máy chủ cục bộ để tích hợp dễ dàng, nhưng nó được thiết kế chủ yếu xung quanh giao diện máy tính để bàn thân thiện với người mới bắt đầu. Dù sao, hãy so sánh Ollama và LM Studio cạnh nhau.

Những Nhận Xét Đáng Chú Ý: Ollama so với LM Studio

Trước khi tiếp tục, cần phải đề cập một vấn đề quan trọng: cụm từ "Ollama so với LM Studio" có thể gợi ý rằng cái này tốt hơn cái kia một cách khách quan, nhưng đó không phải là toàn bộ câu chuyện, vì chúng được thiết kế cho các đối tượng khác nhau. Đây là một so sánh nhanh Ollama so với LM Studio.

| Tính năng | Ollama | LM Studio |

| Dễ sử dụng | Ít thân thiện khi mới bắt đầu, cần kiến thức về dòng lệnh | Thân thiện với người mới, cần bấm chuột khá nhiều |

| Hỗ trợ mô hình | Nhiều mô hình mở phổ biến: gpt-oss, gemma 3, qwen 3 | Giống như Ollama: gpt-oss, gemma3, qwen3 |

| tùy chỉnh | Có thể tùy chỉnh cao, dễ dàng tích hợp thông qua API | Tự do hạn chế, điều chỉnh cài đặt phổ biến qua nút bật tắt hoặc thanh trượt |

| Yêu cầu phần cứng | Tùy thuộc vào độ lớn của mô hình và phần cứng của bạn | Lại tùy thuộc vào kích thước mô hình và phần cứng của bạn |

| Quyền riêng tư | Bảo mật tuyệt vời theo mặc định, không có API bên ngoài bổ sung | Các cuộc trò chuyện ở cục bộ, nhưng ứng dụng vẫn liên hệ với máy chủ để cập nhật và tìm kiếm/tải xuống mô hình |

| Sử dụng ngoại tuyến | Hỗ trợ đầy đủ chế độ ngoại tuyến sau khi tải xuống mô hình | Cũng xuất sắc khi ngoại tuyến sau khi mô hình được tải xuống |

| Các nền tảng có sẵn | Linux, Windows, macOS | Linux, Windows, macOS |

- Mô hình nâng cao gây sức ép phần cứng: Hầu hết mọi người sẽ chọn một mô hình lớn hơn, khả năng hơn khi có thể. Tuy nhiên, chạy chúng trên hầu hết các máy tính xách tay có thể gây ra các vấn đề nghiêm trọng, vì các mô hình lớn hơn tiêu thụ nhiều RAM và VRAM hơn. Điều này có thể dẫn đến phản hồi chậm, độ dài ngữ cảnh hạn chế hoặc mô hình không tải được hoàn toàn.

- Vấn đề pin: Chạy LLMs cục bộ có thể nhanh chóng làm cạn pin dưới tải nặng. Điều này có thể dẫn đến pin giảm, không kể đến tiếng ồn khó chịu từ quạt và tản nhiệt.

Ollama so với LM Studio: Tải Mô Hình

Một khía cạnh khác của Ollama so với LM Studio là cách tiếp cận khác nhau của chúng để tải mô hình. Như đã đề cập trước đó, Ollama không cài đặt LLMs cục bộ chỉ bằng một cú nhấp chuột. Thay vào đó, bạn cần sử dụng hộp dòng lệnh gốc và các lệnh để làm điều đó. Tuy nhiên, các lệnh rất dễ hiểu.

Dưới đây là cách nhanh để chạy mô hình trên Ollama.

- Tải mô hình yêu thích của bạn bằng cách gõ ollama pull gpt-oss hoặc bất kỳ mô hình nào khác bạn thích (Đừng quên bao gồm thẻ, bạn có thể chọn từ thư viện).

Ví dụ: ollama pull gpt-oss:20b - Sau đó, bạn có thể chạy mô hình bằng lệnh ollama run gpt-oss

- Bạn có thể thêm các công cụ lập trình khác. Chẳng hạn, bạn có thể thêm Claude bằng ollama launch claude

Nếu bạn không quen với terminal và các lệnh command, hãy thử LM Studio. Bạn không cần nhập gì vào terminal để nó hoạt động và tải các model. Chỉ cần cuộn sang phần trình tải model tích hợp sẵn và tìm kiếm LLMs bằng các từ khóa như Llama hoặc Gemma.

Hoặc bạn có thể nhập toàn bộ Hugging Face URLs vào thanh tìm kiếm.

Thậm chí còn có tùy chọn để truy cập tab khám phá từ bất kỳ đâu bằng cách nhấn ⌘ + 2 trên Mac, hoặc Ctrl + 2 trên Windows / Linux.

Ollama: Vượt trội về Tốc độ

Đôi khi tốc độ là tất cả những gì người dùng và các doanh nghiệp cần. Hóa ra, khi so sánh Ollama và LM Studio về tốc độ, Ollama nhanh hơn, nhưng điều đó vẫn có thể thay đổi tùy theo các cấu hình và thiết bị phần cứng khác nhau.

Trong trường hợp của một người dùng Reddit trên subreddit r/ollama, Ollama xử lý nhanh hơn LM Studio.

Không phải là một tuyên bố vô cơ sở, bởi vì người dùng đã kiểm tra cả Ollama và LM Studio bằng cách chạy qwen2.5:1.5b năm lần và tính trung bình token trên giây.

Ollama so với LM Studio: Hiệu suất và Yêu cầu Phần cứng

Hiệu suất là nơi cuộc so sánh Ollama với LM Studio trở thành vấn đề về phần cứng hơn là giao diện. Trải nghiệm các LLMs cục bộ lần đầu tiên chắc chắn khác so với các LLMs trên đám mây mà chúng ta vẫn sử dụng. Cảm giác sở hữu một LLM riêng là rất tuyệt vời, cho đến khi bạn gặp phải vấn đề về hiệu suất.

Xét đến cách giá của RAM và VRAM đã tăng vọt trong những năm qua, việc trang bị máy tính của bạn với đủ sức mạnh để chạy các LLMs lớn là khá khó khăn.

Các Model Phổ biến Có xu hướng Goble lên tới 24-64GB của RAM

Vâng, bạn nghe đúng rồi. Yêu cầu phần cứng không phải là về việc ai sẽ thắng trong cuộc so sánh Ollama với LM Studio. Nếu bạn muốn trải nghiệm mượt mà khi chạy các model vừa đến lớn phổ biến mà không có hiện tượng chậm hay lỗi, cách tốt nhất là cài đặt 24-64GB của RAM. Tuy nhiên, trong hầu hết các trường hợp, ngay cả lượng RAM này cũng trở nên vô liên quan với context dài hơn và khối lượng công việc nặng hơn.

Tuy nhiên, bạn có thể chạy các model nhỏ hơn, thường được gọi là các model được lượng tử hóa, trên 8-16GB của RAM, nhưng bạn không nhận được cùng mức độ tiện nghi hoặc hiệu suất như các model lớn hơn, chưa kể đến những sự đánh đổi về chất lượng và tốc độ. Thật không may, RAM không phải là vấn đề duy nhất; các thành phần khác cũng phải mạnh mẽ.

Các GPUs Mạnh là Nền tảng để Giữ Sự Bực dọc ở Mức Tối thiểu

Mặc dù các model có thể chạy trên các CPUs, đơn vị xử lý đồ họa của bạn vẫn đóng vai trò quan trọng trong việc hỗ trợ model của bạn. Nếu không có một GPU nhanh và một lượng lớn VRAM, bạn sẽ trải nghiệm việc tạo token từng cái một chậm chạp, độ trễ dài cho các phản hồi dài hơn, và mọi thứ sẽ nhanh chóng trở nên không thể chịu đựng được.

Đừng kỳ vọng quá cao vì thậm chí còn RTX 5070Ti cũng như RTX 5080 cũng không đủ cho deep learning nghiêm túc. Đó là vì với một số thiết lập context 60k+, chính Ollama đề cập ~23GB VRAM, cao hơn nhiều so với thông thường 16GB VRAM mà bạn nhận được từ các GPUs đó.

Going cho bất kỳ phạm vi sức mạnh nào trên đó cũng cực kỳ đắt đỏ. Nếu giá không phải là điều bạn lo lắng, vẫn còn một số Tùy chọn GPU cần xem xét khi chạy các LLMs cục bộ.

Đến bây giờ, bạn có thể đã bối rối về cách lắp ráp một máy đủ mạnh để chạy các model LLM cục bộ lớn hơn. Đây là điểm chuyển giao cho nhiều người khi họ cân nhắc một giải pháp khác.

Một cách tiếp cận thay thế mà những người đam mê xem xét là sử dụng các máy ảo có phần cứng mạnh mẽ, được cài đặt sẵn. Sử dụng VPS (máy chủ riêng ảo), chẳng hạn, là một cách tuyệt vời để kết nối máy tính xách tay tại nhà hoặc phần cứng cá nhân khác với máy chủ riêng mà bạn chọn, với tất cả các điều kiện tiên quyết đã được thiết lập.

Nếu sử dụng VPS có vẻ là giải pháp phù hợp với bạn, chúng tôi thực sự khuyên bạn nên dùng Cloudzy's Ollama VPS, nơi bạn có thể làm việc trong một môi trường sạch sẽ. Nó đi kèm với Ollama được cài sẵn, vì vậy bạn có thể bắt đầu ngay lập tức làm việc với các LLMs cục bộ với quyền riêng tư hoàn toàn. Giá cả hợp lý với 12 vị trí, uptime 99,95% và hỗ trợ 24/7. Tài nguyên dồi dào, với các VCPUs chuyên dụng, bộ nhớ DDR5 và lưu trữ NVMe qua đường truyền tốc độ tới 40 Gbps.

Ollama vs LM Studio: Ai Cần Cái Nào

Như đã nói, cả hai nền tảng đều hoạt động tốt, và không có nền tảng nào ưu tiên hơn, nhưng đây là điểm mấu chốt. Mỗi nền tảng phù hợp với một loại quy trình làm việc khác nhau, vì vậy tất cả phụ thuộc vào những gì bạn cần.

Chọn Ollama cho Tự Động Hóa và Phát Triển

Mục tiêu của bạn khi sử dụng Ollama không chỉ là trò chuyện với một mô hình, mà là sử dụng nó như một thành phần bên trong một dự án khác. Ollama lý tưởng cho:

- Nhà phát triển xây dựng sản phẩm như chatbot, copilot và các sản phẩm khác yêu cầu học sâu

- Quy trình làm việc liên quan đến rất nhiều tự động hóa, như kịch bản tóm tắt báo cáo hoặc tạo bản nháp theo lịch trình

- Các đội muốn các phiên bản mô hình nhất quán trong bất kỳ môi trường nào

- Bất kỳ người dùng nào tìm kiếm một cách tiếp cận ưu tiên API, để các công cụ khác có thể kết nối với các mô hình thường xuyên

Cuối cùng, nếu bạn muốn các mô hình đáng tin cậy cho ứng dụng của mình, Ollama có thể là lựa chọn tốt nhất của bạn.

LM Studio là Tùy Chọn Dễ Dàng Hơn để Tiếp Cận LLMS Cục Bộ

Nếu bạn đang tìm cách khám phá các thiết lập AI cục bộ mà không gặp rắc rối kỹ thuật, LM Studio chắc chắn là lựa chọn tốt hơn.

Nói chung, LM Studio tốt hơn cho:

- Những người mới bắt đầu những người sợ terminal và dòng lệnh của nó

- Nhà văn, người sáng tạo hoặc sinh viên những người cần một hộp trò chuyện đơn giản như hỗ trợ AI

- Những người thử các tùy chọn khác nhau, tìm cách so sánh nhanh chóng các mô hình khác nhau để tìm thị trường riêng của họ

- Bất kỳ ai mới bắt đầu làm quen với cách nhắc lệnh và muốn điều chỉnh cài đặt mà không cần gõ

Tóm lại, nếu bạn muốn tải xuống và bắt đầu ngay lập tức với các LLMs cục bộ, hãy để LM Studio đáp ứng nhu cầu của bạn.

Ollama vs LM Studio: Khuyến nghị cuối cùng

Nếu bỏ qua các tranh cãi xung quanh cuộc so sánh giữa Ollama và LM Studio, điều thực sự quan trọng là trải nghiệm hàng ngày của bạn, dựa trên quy trình làm việc và khả năng của phần cứng.

Ollama nói chung là:

- Linh hoạt và được thiết kế cho developers

Khi LM Studio là:

- Phù hợp với người mới bắt đầu nhờ giao diện GUI chuyên dụng

Cả hai đều cần phần cứng nặng, tốn kém để hoạt động trơn tru. Nhiều người không có điều kiện để chạy một LLM lớn trên máy cục bộ của riêng họ. Vì vậy, nếu bạn muốn chạy các mô hình nâng cao mà không lo lắng về phần cứng, hãy thử Ollama trên một GPU VPS chuyên dụngDưới đây là một số câu hỏi phổ biến về Ollama vs LM Studio.