Strojové učení a jeho podoblast, hluboké učení, vyžadují obrovský výpočetní výkon, který dokáží poskytnout pouze GPU. Ne každý GPU ale postačí – proto jsme sestavili přehled nejlepších GPU pro strojové učení, vysvětlili, proč jsou nezbytné, a ukázali, jak vybrat ten správný pro váš projekt.

Proč potřebuji GPU pro strojové učení?

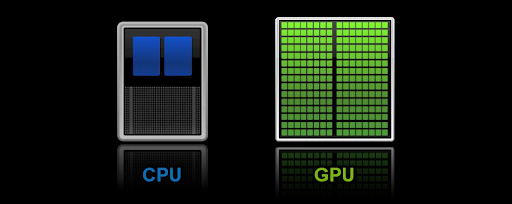

Jak jsme zmínili, strojové učení vyžaduje výpočetní výkon, který dokáží poskytnout pouze GPU. CPU sice postačí pro menší aplikace, ale u úloh náročnějších než jednovláknové nebo obecné výpočty narazíte rychle na výkonnostní limity. Klíčový rozdíl spočívá v paralelním zpracování: zatímco běžný CPU má 4 až 16 jader, nejlepší GPU pro strojové učení jich mají tisíce – zejména tensor jádra, z nichž každé zpracovává část výpočtu současně.

Právě paralelní zpracování je důvod, proč GPU zvládají maticové operace a výpočty lineární algebry daleko lépe než CPU, a proto jsou tak vhodné pro trénování velkých modelů strojového učení. Vybrat ten správný GPU pro strojové učení ale není jednoduché.

Jak vybrat nejlepší GPU pro AI a hluboké učení

Většina GPU dnes zvládne běžné úlohy bez problémů. Strojové učení a hluboké učení však kladou na hardware podstatně vyšší nároky. Otázka tedy zní: co dělá dobrý GPU pro hluboké učení?

Dobrý GPU pro hluboké učení by měl splňovat tyto požadavky a vlastnosti:

CUDA jádra, Tensor jádra a kompatibilita

AMD a Nvidia nabízejí nejlepší GPUs pro strojové učení a hluboké učení, přičemž Nvidia má výrazný náskok. Důvodem jsou Tensor a CUDA jádra Nvidia. Tensor jádra zpracovávají výpočty běžné v AI a strojovém učení, jako jsou maticové násobení a konvoluce (používané v hlubokých neuronových sítích). CUDA jádra umožňují nejlepším GPUs pro trénování AI provádět paralelní zpracování tím, že efektivně distribuují operace napříč GPU. GPUs bez těchto dvou typů jader si s úlohami ML a hlubokého učení obvykle těžko poradí.

AMD nicméně v poslední době vylepšil platformu ROCm a akcelerátory řady MI, což jeho GPUs posunulo vpřed – a proto se objeví i v našem přehledu. GPUs od Nvidia jsou ale stále nejlepší volbou pro hluboké učení díky dobře optimalizovanému softwarovému ekosystému a široké podpoře frameworků (např. TensorFlow, PyTorch, JAX). Nejlepší GPUs pro strojové učení by měly být plně kompatibilní s těmito ML frameworky, protože nesoulad může vést k neefektivní akceleraci, problémům s podporou ovladačů a knihoven (např. NVIDIA cuDNN, TensorRT) a horší připravenosti do budoucna.

Také nemusíte mít plný přístup k nástrojům z NVIDIA CUDA Toolkitu, jako jsou GPU-akcelerované knihovny, kompilátor a runtime pro C a C++, nebo nástroje pro optimalizaci a ladění.

VRAM (video RAM), paměťový standard a paměťová propustnost

Jako u čehokoli spojeného s počítači hraje RAM důležitou roli – a nejlepší GPUs pro strojové učení a hluboké učení nejsou výjimkou. Datasety pro trénování modelů strojového učení mohou být enormně velké (u hlubokého učení klidně několik TB), takže nejlepší GPUs pro strojové učení potřebují dostatek VRAM pro rychlý přístup k datům. Modely hlubokého učení totiž vyžadují značnou paměť pro ukládání vah, aktivací a dalších mezivýsledků během trénování i inference. Nejlepší GPU pro trénování AI by měl mít také slušnou paměťovou šířku pásma, aby bylo možné pohybovat s velkými datovými sadami a urychlovat výpočty.

V neposlední řadě je při výběru nejlepších GPUs pro hluboké učení důležitý paměťový standard. GPUs používají typicky paměti GDDR (Graphics Double Data Rate) nebo HBM (High Bandwidth Memory). Zatímco GDDR paměti nabízejí vysokou šířku pásma pro úlohy jako strojové učení nebo hraní her, nejlepší GPUs pro strojové učení využívají HBM, která dosahuje výrazně vyšší šířky pásma s lepší energetickou účinností.

| Typ GPU | Kapacita VRAM | Propustnost paměti | Paměť Standard | Nejlepší pro |

| Vstupní třída (např. RTX 3060, RTX 4060) | 8GB – 12GB | ~200–300 GB/s | GDDR6 | Malé modely, klasifikace obrazu, hobby projekty |

| Střední třída (např. RTX 3090, RTX 4090) | 24GB | ~1 000 GB/s | GDDR6X | Velké datové sady, hluboké neuronové sítě, transformery |

| Výkonné AI GPUs (např. Nvidia A100, H100, AMD MI300X) | 40GB – 80GB | ~1 600+ GB/s | HBM2 | Velké jazykové modely (LLMs), výzkum v oblasti AI, ML na podnikové úrovni |

| Špičkové GPUs (např. Nvidia H100, AMD Instinct MI300X) | 80GB – 256GB | ~2 000+ GB/s | HBM3 | Rozsáhlé trénování AI, superpočítání, výzkum na masivních datových sadách |

Pro ty, kteří pracují konkrétně na velkých jazykových modelech jako ChatGPT, Cloudzy nabízí VPS optimalizované pro ChatGPT řešení s výkonem potřebným pro plynulé dolaďování a inferenci.

TFLOPS (teraflopy) a přesnost plovoucí řádové čárky

Výkon GPU se měří jeho výpočetním výkonem, který závisí na třech faktorech: TFLOPS, paměťové šířce pásma a přesnosti plovoucí desetinné čárky. Paměťovou šířku pásma jsme už probrali v kontextu nejlepšího GPU pro trénování AI. Zde jsou ostatní dva faktory a jejich význam. TFLOPS, neboli teraflopsy, je jednotka měřící rychlost, s jakou GPU zvládá složité výpočty. Místo taktovací frekvence procesoru (počtu cyklů za sekundu) měří TFLOPS počet bilionů operací s plovoucí desetinnou čárkou, které GPU provede za sekundu. Jednoduše řečeno, TFLOPS říká, jak výkonný GPU je při výpočetně náročných úlohách.

Přesnost plovoucí desetinné čárky naproti tomu, jak název napovídá, určuje míru přesnosti, kterou GPU modelu umožní udržet. Nejlepší GPUs pro hluboké učení používají vyšší přesnost (např. FP32), která zajišťuje přesnější výpočty, ale za cenu nižšího výkonu. Nižší přesnost (např. FP16) výpočty urychluje s mírně sníženou přesností, což je pro úlohy AI a hlubokého učení často přijatelné.

Začít blogovat

Začít blogovat

Provozujte WordPress na vlastním hardwaru špičkové třídy s úložištěm NVMe a minimální latencí po celém světě. Vyberte si svoji oblíbenou distribuci.

Získejte WordPress VPS| Přesnost | Případ použití | Příklady aplikací |

| FP32 (Jednoduchá přesnost) | Trénování modelů hlubokého učení | Rozpoznávání obrazu (ResNet, VGG) |

| TF32 (TensorFloat-32) | Trénování se smíšenou přesností | NLP, doporučovací systémy |

| FP16 (Poloviční přesnost) | Rychlé odvozování | Autonomní řízení, rozpoznávání řeči, AI vylepšování videa |

Místo vysokých investic do fyzického hardwaru můžete okamžitě přistupovat k Hluboké učení GPU VPS od Cloudzy, poháněno RTX 4090s, optimalizováno pro úlohy strojového a hlubokého učení.

Nejlepší GPU pro strojové učení v roce 2025

Teď když víte, co by nejlepší GPUy pro strojové učení měly nabízet, přinášíme náš seznam nejlepších GPUů seřazených podle výkonu, šířky pásma paměti, VRAM a dalších parametrů.

| GPU | VRAM | Propustnost paměti | Paměť Standard | TFLOPS | Přesnost s plovoucí desetinnou čárkou | Kompatibilita |

| NVIDIA H100 NVL | 188 GB | 7.8 TB/s | HBM3 | 3,958 | FP64, FP32, FP16 | CUDA, TensorFlow |

| NVIDIA A100 Tensor Core | 80 GB | 2 TB/s | HBM2 | 1,979 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| NVIDIA RTX 4090 | 24 GB | 1.008 TB/s | GDDR6X | 82.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX A6000 Tensor Core | 48 GB | 768 GB/s | GDDR6 | 40 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| NVIDIA GeForce RTX 4070 | 12 GB | 504 GB/s | GDDR6X | 35.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX 3090 Ti | 24 GB | 1.008 TB/s | GDDR6X | 40 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| AMD Radeon Instinct MI300 | 128 GB | 1.6 TB/s | HBM3 | 60 | FP64, FP32, FP16 | ROCm, TensorFlow |

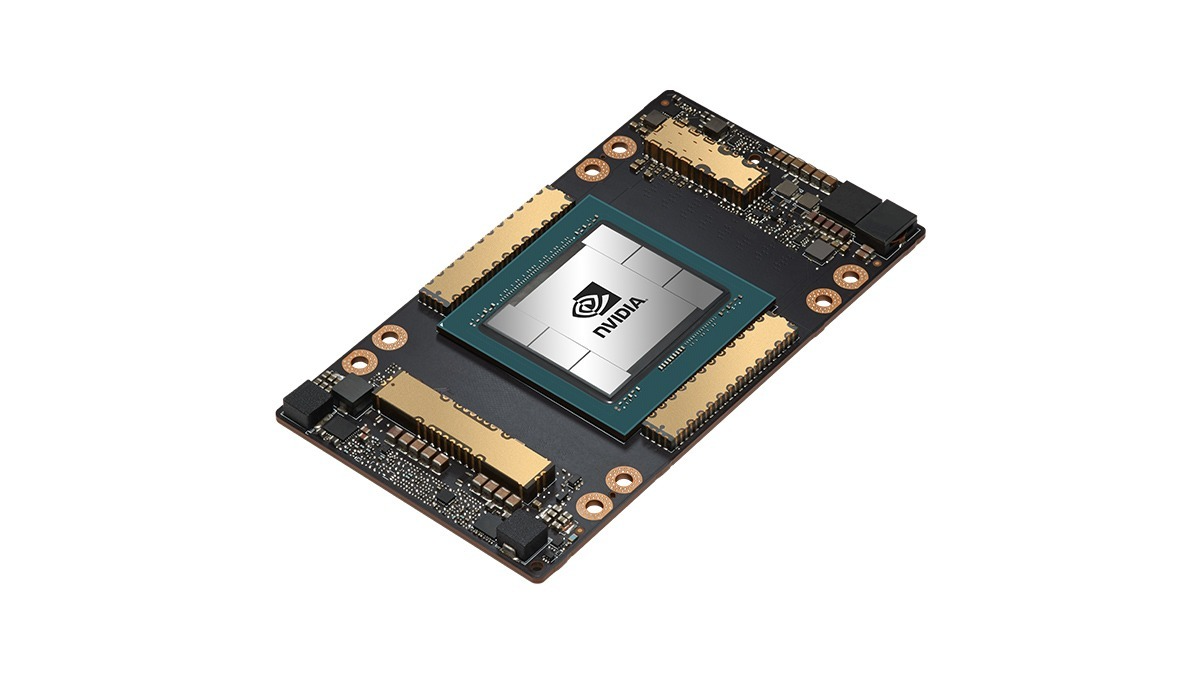

NVIDIA H100 NVL

Nejlepší GPU pro strojové učení, H100 NVL, nabízí výjimečný výkon pro hluboké učení ve velkém měřítku, optimalizovaný pro multi-tenant a vysoce výkonné úlohy.

- Nejlepší pro: Špičkový AI výzkum, trénink rozsáhlých modelů a inference.

- Nevýhoda: Velmi vysoká cena, primárně určeno pro podniková nebo výzkumná prostředí.

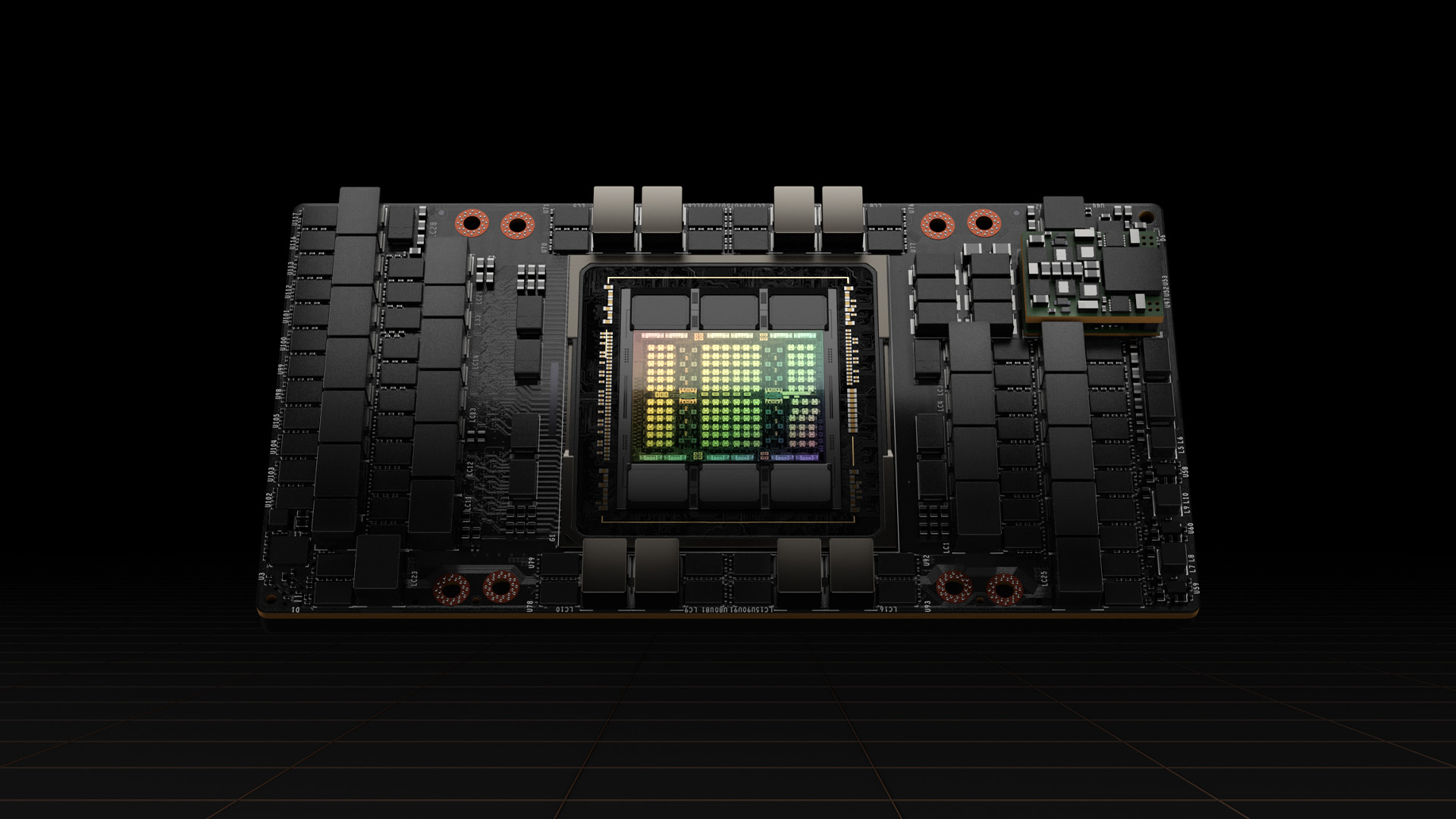

NVIDIA A100 Tensor Core GPU

A100 přináší masivní výkon pro neuronové sítě s 80 GB vysokopásmové paměti (HBM2) a hodí se pro náročné výpočetní úlohy.

- Nejlepší pro: Rozsáhlé modely strojového učení, AI výzkum a cloudové aplikace.

- Nevýhoda: Vysoká cena, zaměřeno především na podniky.

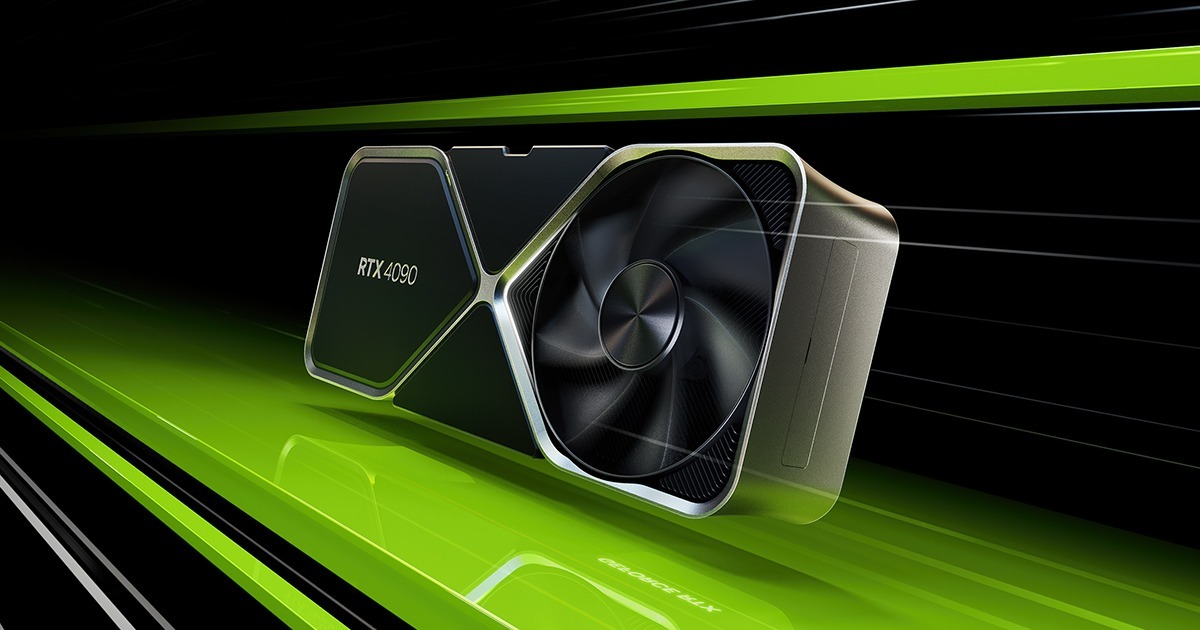

NVIDIA RTX 4090

Vynikající pro hraní her i AI úlohy – disponuje 24 GB paměti GDDR6X a výraznou kapacitou paralelního zpracování.

- Nejlepší pro: Náročné ML úlohy a AI výzkum vyžadující extrémní výpočetní výkon.

- Nevýhoda: Vysoká spotřeba energie, vysoká cena a velké rozměry.

NVIDIA RTX A6000 Tensor Core GPU

Podporuje AI aplikace díky 48 GB paměti GDDR6, vhodné pro pracovní stanice a profesionální tvůrce.

- Nejlepší pro: AI výzkum, hluboké učení a výkonnostně náročné úlohy.

- Nevýhoda: Vysoká cena, typicky určeno pro profesionální prostředí.

NVIDIA GeForce RTX 4070

Goý poměr ceny a výkonu se silnými možnostmi ray tracingu – disponuje 12 GB paměti GDDR6X

- Nejlepší pro: Nadšenci a menší firmy se středně náročnými potřebami v oblasti strojového učení.

- Nevýhoda: Omezené VRAM pro větší datové sady a velmi velké modely.

NVIDIA RTX 3090 Ti

NVIDIA RTX 3090 Ti – vysoká paměťová kapacita (24 GB GDDR6X) a výpočetní výkon, ideální pro trénování středně velkých až velkých modelů.

- Nejlepší pro: Nadšenci a výzkumné aplikace s vysokými nároky na výkon AI.

- Nevýhoda: Velmi drahé, energeticky náročné a pro menší projekty zbytečně předimenzované.

AMD Radeon Instinct MI300

Skvělé pro AI a HPC úlohy s výkonným hardwarem za konkurenceschopnou cenu.

- Nejlepší pro: Úlohy strojového učení na sestavách postavených kolem AMD.

- Nevýhoda: V oblasti hlubokého učení méně rozšířená než NVIDIA, s podporou menšího počtu frameworků.

Cloudové GPU VPS od Cloudzy

Jeden z nejlepších GPU pro strojové učení, který je dnes k dispozici, je bezpochyby RTX 4090. Je ale drahý, zvýší vám účty za elektřinu a jeho rozměry vás možná donutí pořídit větší počítačovou skříň nebo vyměnit ostatní komponenty. Prostě zbytečná bolest hlavy. Proto v Cloudzy nabízíme online GPU pro strojové učení, abyste se o nic z toho nemuseli starat. Náš GPU VPS je vybaven až 2 Nvidia RTX 4090 GPU, 4 TB NVMe SSD úložiště, šířkou pásma 25 TB za sekundu a 48 vCPU!

Vše za dostupné ceny s možností platby po hodinách nebo měsíčně, bez závazků. Na výběr máte z řady platebních metod: PayPal, Alipay, platební karty (přes Stripe), PerfectMoney, Bitcoin a další kryptoměny.

A v nejhorším případě – pokud nebudete s naší službou spokojeni, nabízíme 14denní záruku vrácení peněz!

Platformy pro rozšířenou realitu (AR) v cloudu jsou do značné míry závislé na vysokovýkonné GPUs pro poskytování zážitků v reálném čase s vysokou mírou ponoření. Stejně jako jsou GPU s jádry CUDA a Tensor nezbytné pro trénování modelů hlubokého učení, jsou stejně důležité i pro renderování složitých AR prostředí a podporu funkcí řízených AI, jako je rozpoznávání objektů a prostorové mapování. Ve společnosti Cloudzy naše AR Cloud Technologie GPU zajišťuje vysoký výkon, nízkou latenci a plynulý provoz i při rostoucí zátěži – díky tomu je ideální volbou pro nasazení AR aplikací ve větším měřítku.

Ať už vyvíjíte AI aplikace, trénujete modely, nebo provádíte výzkum, naše Řešení AI VPS jsou navrženy tak, aby poskytovaly nejlepší výkon GPU za zlomek obvyklých nákladů.

Závěrečné myšlenky

S rostoucími nároky na výpočetní výkon a stále většími a komplexnějšími AI modely budou GPUs nepochybně nedílnou součástí našeho života. Vyplatí se proto o nich více dozvědět a pochopit, jak fungují a co vlastně jsou.

Proto vám důrazně doporučuji, abyste se podívali na Tim Dettmers' článek o všem, co potřebujete vědět o GPU, včetně praktických rad při výběru GPU. Autor má akademické ocenění i hluboké znalosti v oblasti deep learningu.