Se stai decidendo H100 vs RTX 4090 Per AI, ricorda che la maggior parte dei 'benchmark' non conta finché il tuo modello e cache non si adattano effettivamente a VRAM. RTX 4090 è il punto ideale per lavori single-GPU che rimangono entro 24 GB.

H100 è quello che usi quando hai bisogno di modelli più grandi, concorrenza più alta, isolamento multi-utente, o meno tempo speso in compromessi di memoria.

Te lo spiego per workload, mostro tipi di benchmark, poi ti do un piano di test veloce che puoi eseguire sulla tua infrastruttura.

Risposta Rapida: H100 vs RTX 4090 per AI Workloads

H100 vince per training di modelli grandi e serving serio perché offre grandi pool HBM, bandwidth di memoria molto alta, NVLink, e MIG per l'isolamento. RTX 4090 è migliore per 'ho bisogno di grande velocità single-GPU a un prezzo migliore' finché il tuo workload si adatta a 24 GB senza compromessi costanti. Specifiche e feature della piattaforma rendono questo abbastanza diretto.

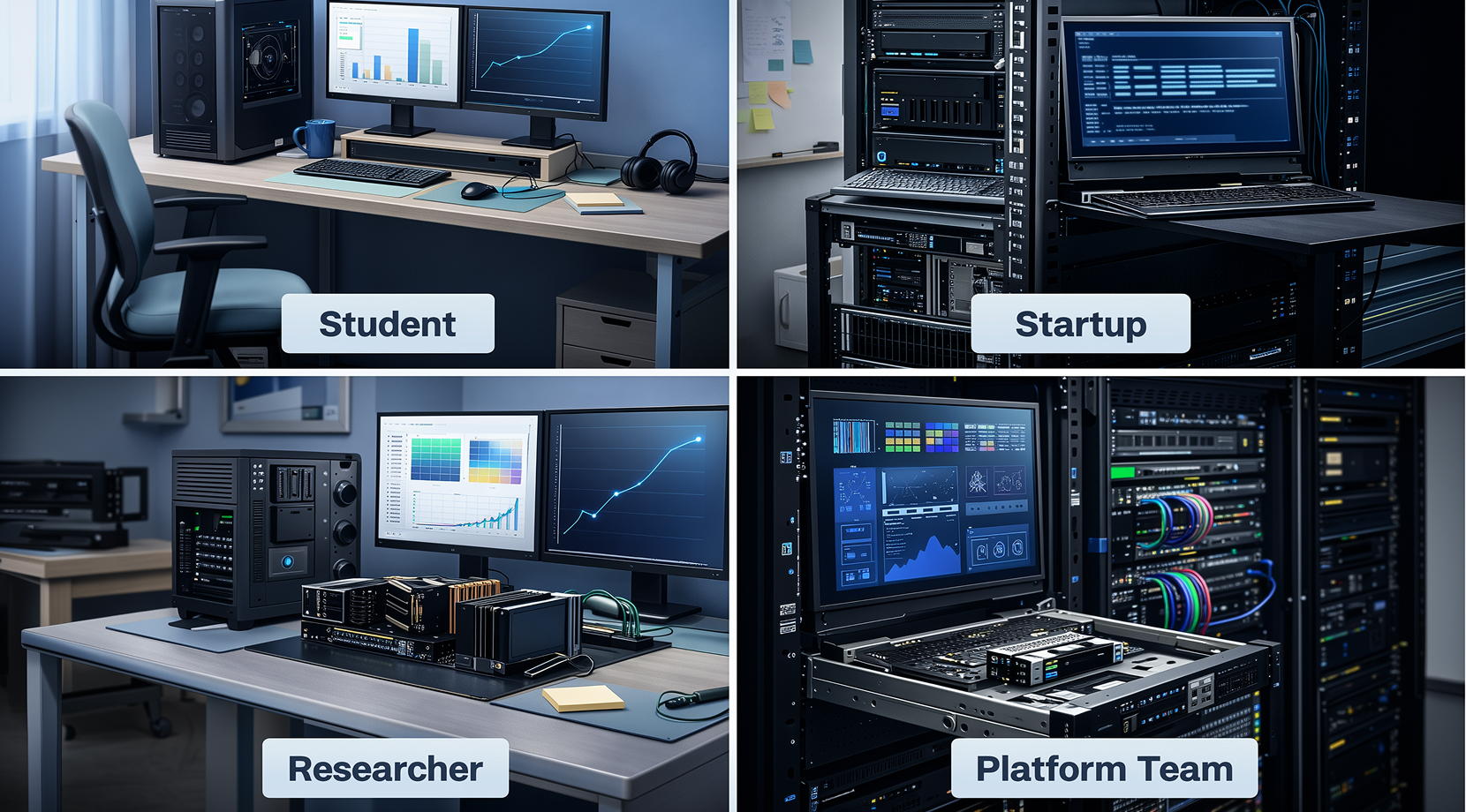

Ecco la lista rapida per profilo:

- Local LLM Developer (Solo Dev / Studente): RTX 4090 finché VRAM non diventa il collo di bottiglia.

- Ingegnere ML in una startup (lancio di un MVP): RTX 4090 per serving e fine-tuning early-stage, H100 una volta che hai bisogno di concorrenza stabile o modelli più grandi.

- Applied Researcher (Molti Esperimenti): H100 se continui a incontrare OOM, limiti di batch, o contesti lunghi.

- Team di Produzione / Piattaforma (Multi-Tenant): H100 per slicing MIG, più margine e scaling più fluido.

Con questa prospettiva, il resto dell'articolo riguarda i limiti che le persone incontrano nella pratica e come i numeri dei benchmark si allineano con essi.

L'Unica Domanda sul Benchmark da Considerare: Cosa Deve Stare in VRAM?

La maggior parte delle discussioni su H100 vs RTX 4090 sono tecnicamente argomenti di VRAM. Nel lavoro LLM, VRAM viene consumato da pesi, attivazioni durante l'addestramento, stati optimizer durante l'addestramento, e da cache KV durante l'inferenza. Quest'ultimo è quello che la gente non si aspetta davvero, perché cresce con la lunghezza del contesto e la concorrenza.

La tabella sottostante è volutamente sintetica perché l'adattamento esatto dipende dal framework, dalla precisione e dall'overhead.

Ecco la visione "entra senza problemi?":

| Carico di lavoro | Realtà Tipica Single-GPU su RTX 4090 (24 GB) | Realtà Tipica Single-GPU su H100 (80–94 GB) |

| Inferenza LLM 7B (FP16 / BF16) | Di solito va bene | Margine di manovra confortevole |

| Inferenza LLM 13B | Spesso stretto, dipende dal contesto | Di solito va bene |

| Inferenza di classe 70B | Richiede quantizzazione pesante/offload | Molto più realistico |

| Inferenza SD/SDXL + batch piccolo | Di solito va bene | Va bene, più margine per il batch |

| Serving con concorrenza più alta | La pressione della KV cache si vede subito | Più spazio, più stabile sotto carico |

Se vuoi una lista più ampia di GPU (non solo questi due), il nostro riepilogo su Migliori GPU per il machine learning nel 2025 è una tabella di riferimento utile per VRAM e larghezza di banda della memoria su GPU AI comuni.

Una volta che sai che il tuo carico di lavoro entra, la cosa successiva che determina quanto "fluido" sia il risultato è la larghezza di banda della memoria.

Larghezza di Banda: Perché HBM Fa la Differenza

Molte discussioni sulle prestazioni di AI si concentrano sui picchi di calcolo, ma i transformer sono estremamente sensibili al movimento della memoria. Il vantaggio di H100 è che abbina pool HBM grandi a larghezza di banda della memoria molto elevata, più larghezza di banda NVLink e partitioning MIG dal lato piattaforma.

Panoramica delle Specifiche

Le specifiche non sceglieranno per te l'GPU, ma spiegano perché lo stesso carico di lavoro risulta facile su una scheda e stretto su un'altra. Questo snapshot mostra cosa influisce di più sul comportamento di training, inference e serving di LLM.

| Specifica | H100 (SXM / NVL) | RTX 4090 |

| VRAM | 80 GB / 94 GB | 24 GB |

| Larghezza di banda della memoria | 3,35–3,9 TB/s | GDDR6X (limitato dalla capacità a 24 GB) |

| Interconnessione | NVLink + PCIe Gen5 | PCIe (piattaforma consumer) |

| Istanze multiple | Fino a 7 istanze MIG | Non disponibile |

Riferimenti specifiche NVIDIA H100, NVIDIA RTX 4090.

Come si traduce nella pratica:

- Se stai cercando di aumentare la dimensione del batch o la lunghezza del contesto, H100 tende a rimanere stabile più a lungo prima di essere costretto a fare compromessi.

- Se stai servendo molte richieste contemporaneamente, H100 ha più "spazio di respiro per la memoria", quindi non subisci latenza di coda instabile così rapidamente.

- Se il tuo lavoro è principalmente single-user, single-model, contesto modesto, la 4090 spesso risulta veloce e soddisfacente.

La larghezza di banda non sostituisce un buon benchmarking, però. Spiega solo perché due GPUs possono sembrare vicini in un test ristretto, poi divergere sotto carico reale.

Benchmark affidabili H100 vs RTX 4090

I benchmark non sono tutti uguali, e questo spiega perché "i miei numeri non corrispondono ai tuoi" accade costantemente. Per H100 vs RTX 4090, è utile dividere i benchmark in due categorie:

- Categoria A (feel della comunità): llama.cpp-style tokens/sec tests and simple inference scripts.

- Categoria B (suite standardizzate): Risultati nello stile MLPerf Training e MLPerf Inference, che si concentrano su regole ripetibili.

Snapshot di Inference nello Stile Llama.cpp

Questo è il tipo di test che le persone eseguono a casa, poi discutono per tre giorni. È utile perché riflette una "toolchain reale" che molti developer usano, ma è anche facile fraintenderlo se ignori il fit e la precisione.

Confronti pubblici nello stile llama.cpp mostrano RTX 4090 che si comporta molto bene su modelli più piccoli ed esecuzioni quantizzate, mentre i modelli grandi a precisione superiore superano il limite VRAM.

Ecco il pattern che dovresti aspettarti:

| Modello | GPU | Risultato Tipico |

| classe 7B | RTX 4090 | Molti token/sec, inference single-user fluida |

| classe 13B | RTX 4090 | Ancora buono, ma il contesto e l'overhead cominciano a importare |

| classe 70B | RTX 4090 | Non entra pulitamente senza quant/offload aggressivo |

| classe 70B | H100 | Molto più realistico mantenerlo residente e servirlo affidabilmente |

Il punto di questa tabella non è "la 4090 è cattiva" o "H100 è magica". È che il limite VRAM decide quanto puoi mantenere residente, e questo influisce su velocità, stabilità e la quantità di tuning che dovrai fare.

Se stai costantemente riducendo la lunghezza del contesto solo per stare in piedi, quello è il momento in cui questo confronto smette di essere teorico.

Cosa aggiunge MLPerf ai benchmark dei forum

MLPerf esiste perché "script casuali e sensazioni" non funzionano quando stai per spendere diverse migliaia di dollari. MLCommons ha aggiunto carichi di lavoro più recenti nello stile della AI generativa nel tempo, e MLPerf è progettato per rendere i risultati più comparabili tra sistemi.

Sul lato dell'addestramento, il rapporto di NVIDIA su MLPerf Training v5.1 è un buon esempio di come i vendor riportano il tempo di addestramento con dettagli sull'ambiente di test e le regole di benchmark che seguono.

Questo test non ti dirà come i tuoi prompt privati si comportano, ma è una verifica di coerenza per il scaling a livello di sistema e "come questa classe di hardware si comporta secondo le regole".

Passiamo ora alla parte che influisce più sui tuoi acquisti, cioè il tempo e il denaro speso per completare il lavoro.

Costo, Tempo e Costo Opportunità

Molto H100 vs RTX 4090 le decisioni vengono inquadrate come "prezzo di acquisto vs prezzo di affitto". Raramente è il frame giusto. Un frame migliore è: quante ore ti servono per produrre un modello che puoi davvero usare, e quanto tempo perdi lottando contro i vincoli?

Tre scenari comuni mostrano i compromessi in modo abbastanza chiaro.

Fine-Tuning Settimanale su Modelli Piccoli e Medi

Se le tue esecuzioni restano sotto 24 GB senza compromessi costanti, il percorso 4090 è fantastico. Iteri velocemente, non devi prenotare tempo del cluster, e il tuo setup è semplice. Se ogni esecuzione diventa "riduci il batch, taglia il contesto, riprova", H100 è un'idea molto più sensata, nonostante il costo più alto.

Serving Con Concorrenza Reale

La concorrenza aumenta velocemente la pressione della cache KV. È qui che lo spazio disponibile di H100 e i controlli della piattaforma ripagano, specialmente se hai bisogno di latenza prevedibile.

Se stai ancora decidendo se un server GPU è la forma giusta per il tuo deployment, il nostro GPU VPS vs CPU VPS breakdown è un modo utile per mappare il carico di lavoro al tipo di infrastruttura prima di spendere tempo ottimizzando la cosa sbagliata.

Lavori di Addestramento Più Grandi Con Deadline

Non appena inizi a scalare oltre una persona e una macchina, le cose noiose sono quelle su cui vuoi concentrarti: ambienti stabili, meno modalità di errore, e meno tempo sprecato in quello che è fondamentalmente babysitting. È il tipo di cosa per cui H100 è progettato.

Se sei ancora indeciso dopo questa sezione, il passo successivo non è leggere di più. È guardare come il tuo stack si comporta in pratica, inclusa la friction dei driver e i carichi di lavoro multi-utente.

Software e Ops: Driver, Stabilità, Multi-Utente e Supporto

Questa è la parte che la maggior parte dei grafici di benchmark salta, ma è una grossa fetta della vita quotidiana.

RTX 4090 è popolare perché è accessibile e veloce per molti flussi di lavoro AI. Il compromesso è che una volta che il tuo caso d'uso cresce, è più probabile che tu incontri limiti di memoria e pattern di scaling che non sono costruiti per ambienti condivisi e multi-tenant.

H100 è costruito per cluster. MIG è fondamentale per i team di piattaforma perché ti consente di suddividere un GPU in sezioni isolate, il che riduce i problemi di "noisy neighbor" e semplifica notevolmente la pianificazione della capacità. Le specifiche ufficiali NVIDIA di H100 indicano fino a 7 istanze MIG a seconda del fattore di forma.

Se il tuo carico di lavoro è personale e locale, puoi stare tranquillo con il lato 4090 per molto tempo. Se il tuo carico di lavoro è multi-utente e rivolto ai clienti, H100 è la scelta più sicura.

Allora, in sintesi, chi dovrebbe comprare cosa?

Quale Dovresti Scegliere per il Tuo Carico di Lavoro

Per H100 vs RTX 4090, la scelta giusta è quella che elimina i tuoi ostacoli maggiori.

Developer Locale LLM (Solo Dev / Studente)

Scegli RTX 4090 se lavori principalmente nella fascia 7B–13B, esegui inferenza quantizzata, sperimenti con RAG, o lavori su SDXL. Passa a qualcosa di più potente una volta che passi più tempo a gestire i limiti di memoria che non a costruire quello che ti eri prefissato.

ML Engineer di Startup (Lancio di un MVP)

Se il tuo MVP è un singolo modello con traffico moderato e rientra comodamente, 4090 è un buon punto di partenza. Se hai bisogno di latenza stabile in caso di picchi, concorrenza più alta, o più carichi di lavoro per host, H100 è il percorso più tranquillo.

Ricercatore Applicato (Molti Esperimenti)

Se sei costantemente costretto a compromessi come ridurre la batch size o fare acrobazie di precisione, H100 ti garantisce esperimenti più puliti e meno run falliti.

Team di Produzione / Piattaforma (Serving Multi-Tenant)

H100 è la scelta ovvia, principalmente perché MIG e lo spazio aggiuntivo semplificano la pianificazione della capacità e riducono sostanzialmente l'impatto quando qualcosa va in picco.

Se ancora non vuoi investire in hardware, il noleggio è la mossa successiva migliore.

Un Percorso Intermedio Pratico: Affitta GPUs Prima, Poi Investi

Il modo più diretto per chiarire la situazione H100 vs RTX 4090 è eseguire tuo modello, tuo prompt e tuo context length su entrambe le classi di hardware, poi confronta tokens/sec e tail latency sotto carico.

Esattamente per questo Cloudzy GPU VPS, così puoi ottenere un box GPU in meno di un minuto, installare il tuo stack con accesso root completo, e smettere di indovinare sulla base dei benchmark di altri.

Ecco cosa ottieni sui nostri piani GPU VPS:

- NVIDIA GPUs Dedicati (incluse opzioni RTX 4090 e A100) così i tuoi risultati non risentono di noisy neighbors.

- Fino a 40 Gbps di networking su tutti i piani GPU, il che è importante per pull di dataset, workflow multi-nodo, e spostamento veloce di artefatti.

- NVMe SSD di storage, più DDR5 RAM e opzioni CPU ad alta frequenza su tutti i livelli, in modo che il resto del box non rallenti GPU.

- Protezione DDoS e un 99.95% di disponibilità, così i lavori lunghi non vengono compromessi da problemi di connessione casuali.

- Fatturazione oraria (utile per test benchmark veloci) e un Garanzia soddisfatti o rimborsati di 14 giorni per test a basso rischio.

Esegui la stessa checklist di benchmark su un piano RTX 4090, poi ripeti su un piano A100 quando aumenti il contesto, la concorrenza o le dimensioni del modello. Dopo di che, la scelta tra H100 vs RTX 4090 di solito diventa ovvia dai tuoi stessi log.

Checklist di Benchmark: Esegui il Tuo in 30 Minuti

Se vuoi una decisione che puoi difendere, raccogli quattro numeri dallo stack esatto che intendi utilizzare:

- Token/sec alla tua lunghezza di contesto target

- latenza p95 alla concorrenza prevista

- Spazio VRAM disponibile durante la fase di picco

- Costo per esecuzione completata dall'inizio all'artefatto

Un test minimo con vLLM ha questo aspetto:

pip install vllm transformers accelerate

python -m vllm.entrypoints.api_server \

--model meta-llama/Llama-3-8B-Instruct \

--dtype float16 \

--max-model-len 8192Se vuoi capire chiaramente cosa stai realmente affittando, il nostro articolo su Cos'è un GPU VPS? spiega la differenza tra accesso GPU dedicato, condivisione vGPU, e cosa controllare prima di scegliere un piano.