Se il tuo piano è acquistare una nuova GPU per smettere di vedere errori di memoria esaurita, 5070 Ti vs 5080 è il dibattito sbagliato. Entrambe le schede hanno 16 GB di VRAM, e questo limite di capacità si presenta nel deep learning prima di quanto la maggior parte delle persone si aspetti.

La 5080 è più veloce, ma raramente ti permette di eseguire un modello significativamente più grande. In pratica, finisci comunque per ridurre la batch size, accorciare la context length, oppure scaricarlo sulla memoria di sistema RAM solo per mantenere i run attivi.

Per questo motivo, questo articolo è un'analisi genuina e realistica della 5070 Ti vs 5080 per il deep learning, più una serie di opzioni che funzioneranno se il tuo obiettivo è allenare, fine-tunare o servire modelli senza limitazioni costanti di VRAM.

Se leggi solo una cosa, leggi la sezione delle specifiche e la sezione "capacità vs velocità": sono le due che ti impediscono di comprare la scheda sbagliata.

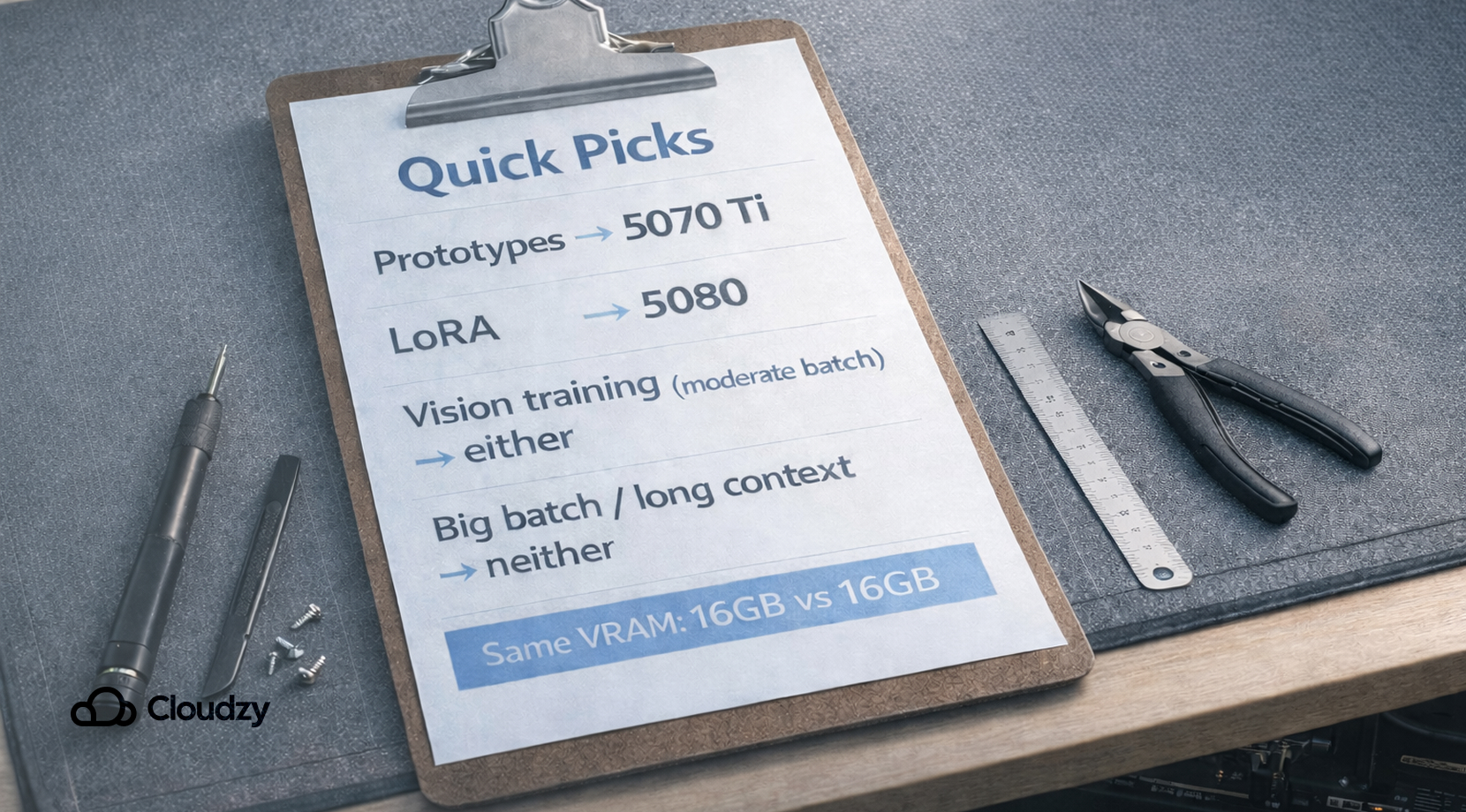

Scelte rapide in base a quello che fai

La maggior parte delle persone non compra gli GPU a caso. Vediamo quattro mentalità di acquirenti che si ripetono costantemente, e la scelta 5070 Ti vs 5080 cade diversamente per ognuno.

Lo sperimentatore locale con LLM

Usi notebook, cambi le impostazioni di quantizzazione, e ti importa più che "funzioni" che della velocità effettiva. Per te, la scelta 5070 Ti vs 5080 di solito è decisa dal budget, perché entrambe le schede funzionano bene su modelli piccoli e inferenza quantizzata, poi entrambe colpiscono lo stesso limite di VRAM una volta che aumenti la context length o la batch size.

Lo studente di dottorato che allena modelli visivi

Vuoi esperimenti ripetibili, non tentativi infiniti. Il costo nascosto non è la scheda stessa; è il tempo che perdi quando i run falliscono all'epoca 3 perché il dataloader, gli augmentation e il modello competono tutti per la memoria.

L'ingegnere di startup che mette in produzione l'inferenza

Ti importa della latenza di coda e della concorrenza. Una demo single-user può sembrare ottima su 16 GB, poi arriva il traffico di produzione, e la pressione della KV cache consuma il tuo VRAM come una perdita lenta. Per il serving, la scelta 5070 Ti vs 5080 può essere una distrazione se il tuo vero problema è la capacità per il batching e i prompt lunghi.

Il creator che fa anche ML

Passi da app creative a tool ML, e odi i riavvii, i problemi di driver e "chiudi Chrome per allenare". Per te, la scelta 5070 Ti vs 5080 ha senso solo se l'GPU è parte di un flusso di lavoro pulito, non una workstation fragile che crolla la seconda che fai multitasking.

Con questi scenari in mente, andiamo ai dettagli concreti dell'hardware e al motivo per cui il fattore limitante è lo stesso nei punti che contano.

Specifiche ad alta priorità per il deep learning

Il modo più veloce per capire 5070 Ti vs 5080 è ignorare i numeri di marketing e concentrarsi sulla riga della memoria.

Se vuoi una visualizzazione completa del foglio tecnico, ecco una tabella dettagliata che si concentra su quello che influisce di più sul comportamento di training e inferenza. (Le velocità di clock e gli output video sono affascinanti, ma non decidono se il tuo run entra.)

| Specifiche (Desktop) | RTX 5070 Ti | RTX 5080 | Perché Appare nei Download |

| VRAM | 16 GB | 16 GB | La capacità è il muro duro per i pesi, le attivazioni e la KV cache |

| Tipo di Memoria | GDDR7 | GDDR7 | Comportamento simile, la larghezza di banda aiuta, ma la capacità decide "entra o non entra" |

| Bus di memoria | 256-bit | 256-bit | Limita la larghezza di banda aggregata; aiuta il throughput, non la dimensione del modello |

| Core CUDA | 8,960 | 10,752 | Più compute aiuta con token/sec, non "riesco a caricarlo" |

| Potenza tipica della scheda | 300 W | 360 W | Più calore e spazio PSU, niente VRAM extra |

Fonti ufficiali per le specifiche: RTX 5080, famiglia RTX 5070

Fondamentalmente, la 5080 è la scheda più veloce, la 5070 Ti è quella più economica. Nel deep learning, la differenza si nota soprattutto dopo che il tuo carico di lavoro già non rientra più.

Adesso vedremo perché VRAM si esaurisce così in fretta, anche su configurazioni che sulla carta sembrano leggere.

Perché VRAM Si Esaurisce Così Velocemente nel Deep Learning

Chi viene dal gaming spesso pensa che VRAM sia come una texture pool. Nel deep learning, è più come un piano di lavoro strettissimo in cucina. Non ti serve solo spazio per gli ingredienti, ti serve spazio per tritare, cuocere e impiattare, tutto nello stesso momento.

Ecco cosa di solito occupa VRAM durante un'esecuzione:

- Pesi del modello: i parametri che carichi, a volte in FP16/BF16, a volte quantizzati.

- Attivazioni: i tensor intermedi salvati per il backprop, di solito il vero divoratore di memoria durante l'addestramento.

- Gradienti e stato dell'ottimizzatore: il sovraccarico di addestramento che può moltiplicare le necessità di memoria.

- cache KV: il sovraccarico di inferenza che cresce con la lunghezza del contesto e della concorrenza.

Per questo confrontare 5070 Ti vs 5080 può sembrare come discutere della potenza del motore mentre stai trainando un rimorchio troppo pesante. Puoi avere più cavalli vapore, ma il gancio di traino rimane il collo di bottiglia.

Un veloce "come verificarlo" che usiamo nei nostri test è registrare sia la memoria allocata che quella riservata in PyTorch. Le note sulla memoria CUDA di PyTorch spiegano il caching allocator e perché la memoria può sembrare "usata" in strumenti come nvidia-smi anche dopo che i tensor sono liberati.

Questo ci porta al punto principale di questa discussione, ovvero che la maggior parte dei fallimenti nel deep learning su 16 GB non è perché è lento, di per sé, ma perché finisci in OOM nel momento peggiore possibile.

I Primi Carichi di Lavoro Che Mandano in Crisi 5070 Ti vs 5080

Sotto sono elencati i pattern di deep learning che di solito superano i limiti di memoria prima su 5070 Ti vs 5080.

Serving LLM con Prompt Lunghi e Concorrenza Reale

Un singolo prompt a 2K token può sembrare ok. Aggiungi un contesto più lungo, aggiungi batching, aggiungi un secondo utente, e la KV cache inizia a salire. È allora che 5070 Ti vs 5080 crolla nello stesso esito, dove devi limitare il contesto massimo o ridurre la dimensione del batch per sopravvivere.

Un metodo di verifica semplice:

- Esegui il tuo server con il tuo contesto massimo reale e il batch.

- Controlla VRAM nel tempo, non solo all'avvio.

- Nota il punto in cui la latenza impenna, poi verifica l'uso della memoria nella stessa finestra.

Se vuoi un setup di monitoraggio affidabile che non diventi un progetto in sé, la nostra guida su software di monitoraggio GPU copre pattern di logging CLI pratici che funzionano bene su esecuzioni reali.

Fine-Tuning LoRA o QLoRA

Molti dicono che «LoRA funziona con 16 GB», e non hanno torto. Il rischio è assumere che il resto della pipeline sia gratis. Buffer di tokenizzazione, worker del dataloader, scaling a precisione mista e step di validazione si accumulano rapidamente.

In pratica, il collo di bottiglia non è il calcolo quanto lo spazio disponibile. Se non hai RAM libera, finisci a monitorare costantemente gli addestramenti.

Addestramento di Vision con Input ad Alta Risoluzione

I modelli di visione hanno una modalità di fallimento subdola: un piccolo aumento di risoluzione o un'augmentation in più ti può portare da stabile a OOM. Su 5070 Ti vs 5080, questo si manifesta come batch size che crolla a 1, poi gradient accumulation trasforma l'addestramento in un loop al rallentatore.

Esecuzioni Multimodali su una Singola GPU

Text encoder + image encoder + fusion layer possono andare bene; ma se aumenti la sequence length o aggiungi un vision backbone più grande, l'accumulo di memoria diventa brutale.

«La Mia GPU Va Bene, il Mio Desktop Non Va»

È la più riconoscibile. Inizi l'addestramento, poi il browser, l'IDE e tutto quello che stai usando catturano RAM, e improvvisamente la tua config «stabile» è rotta. Persone nei forum si lamentano di chiudere tutto, disabilitare overlay, e comunque incappare in OOM con lo stesso modello di ieri.

Quel pattern appare costantemente in Discussioni su 5070 Ti vs 5080, perché entrambe le schede hanno lo stesso limite di capacità. Se questi suonano familiari, la domanda successiva è «cosa possiamo fare per superare il limite?»

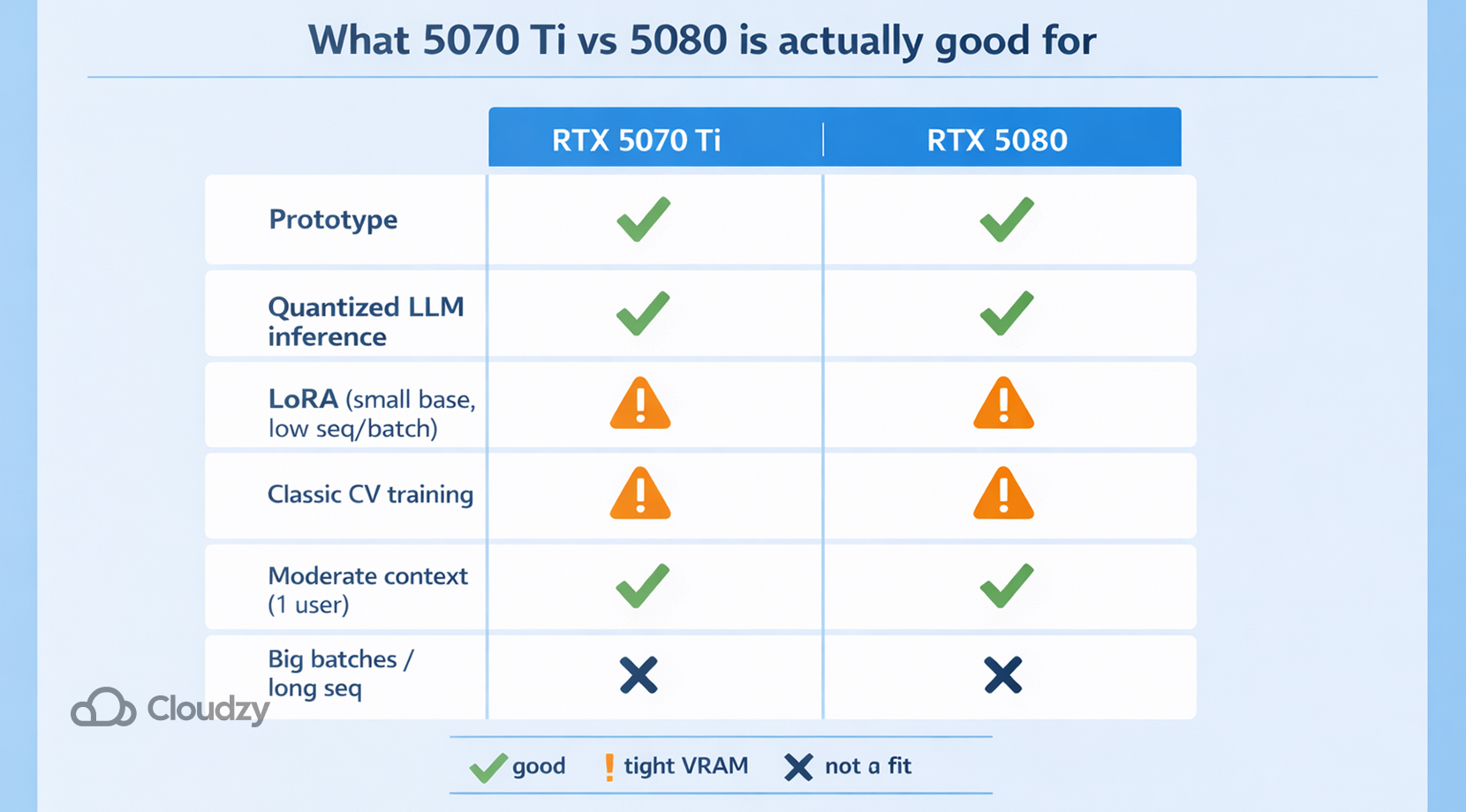

Per Cosa 5070 Ti vs 5080 Sono Adatti

È facile disprezzare 16 GB negli ambienti ML, ma non è inutile. È solo limitato.

5070 Ti vs 5080 può essere un setup totalmente valido per:

- Lavoro di prototipazione: piccoli esperimenti, ablazioni veloci, sanity check.

- Inferenza di modelli quantizzati: modelli più piccoli con contesto moderato, singolo utente.

- LoRA su modelli base più piccoli: finché mantieni sequence length e batch sotto controllo.

- Addestramento di vision classico: dimensioni di immagine moderate, backbone moderate, più pazienza.

Il punto è: se il tuo lavoro rimane dentro il limite di memoria, 5080 di solito si sente più veloce di 5070 Ti, e apprezzerai il calcolo extra.

Ma nel momento in cui provi a fare deep learning «serio», ti colpiranno problemi di spazio disponibile. Quindi parliamo di tattiche che aiutano su entrambe le schede.

Come Sfruttare al Massimo VRAM Senza Rendere la Formazione Insostenibile

Nessuno di questi trick è magia. Sono solo le mosse che permettono a 5070 Ti vs 5080 di rimanere utili più a lungo.

Inizia con le Misurazioni

Prima di toccare gli iperparametri, ottieni il picco di VRAM per passo. In PyTorch, max_memory_allocated() e max_memory_reserved() sono modi rapidi per capire cosa sta realmente facendo il tuo run.

Questo ti aiuta a rispondere a domande come:

- Il modello stesso è il costo principale, o le attivazioni?

- VRAM si impenna durante la validazione?

- La frammentazione sta aumentando nel tempo?

Una volta che hai una baseline, il resto diventa meno casuale.

Riduci la Memoria Dove Possibile

Una semplice sequenza che usiamo:

- Diminuisci la batch size finché non rientra.

- Aggiungi l'accumulo dei gradienti per recuperare la batch size effettiva.

- Attiva la precisione mista (BF16/FP16) se il tuo stack lo supporta.

- Aggiungi il checkpointing dei gradienti se le attivazioni dominano.

- Solo allora inizia a toccare la dimensione del modello.

Tratta la Lunghezza del Contesto Come un Budget

Per i transformer, la lunghezza del contesto è quello che causerà i maggiori problemi. Influisce sul calcolo dell'attenzione e, per l'inference, sulla dimensione della KV cache. Su 5070 Ti vs 5080, lo noterai non appena superi qualche migliaio di token mentre VRAM sale rapidamente, il throughput cala e improvvisamente devi ridurre la batch size solo per stare al passo.

Un approccio consigliato:

- Scegli un contesto massimo di default che puoi eseguire con margine.

- Crea un secondo profilo per "long context", con batch più bassa.

- Non mescolare i due mentre esegui il debug.

Non Confondere la Cache di PyTorch con Vere Memory Leak

Molti report di "memory leak" sono in realtà comportamenti dell'allocator. La documentazione di PyTorch menziona che l'allocator con caching può mantenere la memoria riservata anche dopo che i tensor sono stati liberati, e empty_cache() nella maggior parte dei casi rilascia i blocchi in cache non utilizzati ad altre app, non a PyTorch stesso.

È importante perché gli utenti di 5070 Ti vs 5080 spesso si distraggono con perdite fantasma invece di concentrarsi sulle vere fonti di perdita: dimensione del batch, lunghezza della sequenza e memoria di attivazione.

Questi aggiustamenti rendono utilizzabile il loro limite di memoria, ma non cambiano la realtà di base. Se il tuo progetto richiede modelli più grandi, contesti più lunghi o concorrenza più alta, hai bisogno di più VRAM.

Ho Bisogno di Capacità o Velocità tra 5070 Ti vs 5080

Un modo di vederla è che la velocità è quanto velocemente puoi guidare, mentre la capacità è quanti passeggeri puoi portare. Il deep learning tiene conto di entrambe, ma è la capacità che decide se puoi uscire dal parcheggio, prima di tutto.

L'5080 può erogare un throughput più alto rispetto al 5070 Ti in molti carichi di lavoro. Ma il confronto 5070 Ti vs 5080 non cambia il fatto che tu possa caricarlo ed eseguirlo, perché entrambi raggiungono i loro limiti.

Per questo motivo le persone rimangono deluse dopo un upgrade. Sentono il salto di velocità nei test piccoli, poi provano il loro vero carico di lavoro e si scontrano con lo stesso muro. Il muro arriva solo 30 secondi dopo.

Quindi se stai cercando pensando al deep learning, è utile decidere in quale categoria rientri:

- Limitato in velocità: già ci stai dentro, vuoi solo passi più veloci.

- Limitato dalla capacità: non ci stai dentro chiaramente, e passi tempo a ridurre il problema.

La maggior parte delle persone che ricercano 5070 Ti vs 5080 per il deep learning sono nella seconda categoria, anche se non lo sanno ancora.

Parliaamo ora dell'opzione che solitamente fa risparmiare più tempo: delegare il "lavoro pesante" a un GPU più grande, senza ricostruire tutta la tua infrastruttura locale.

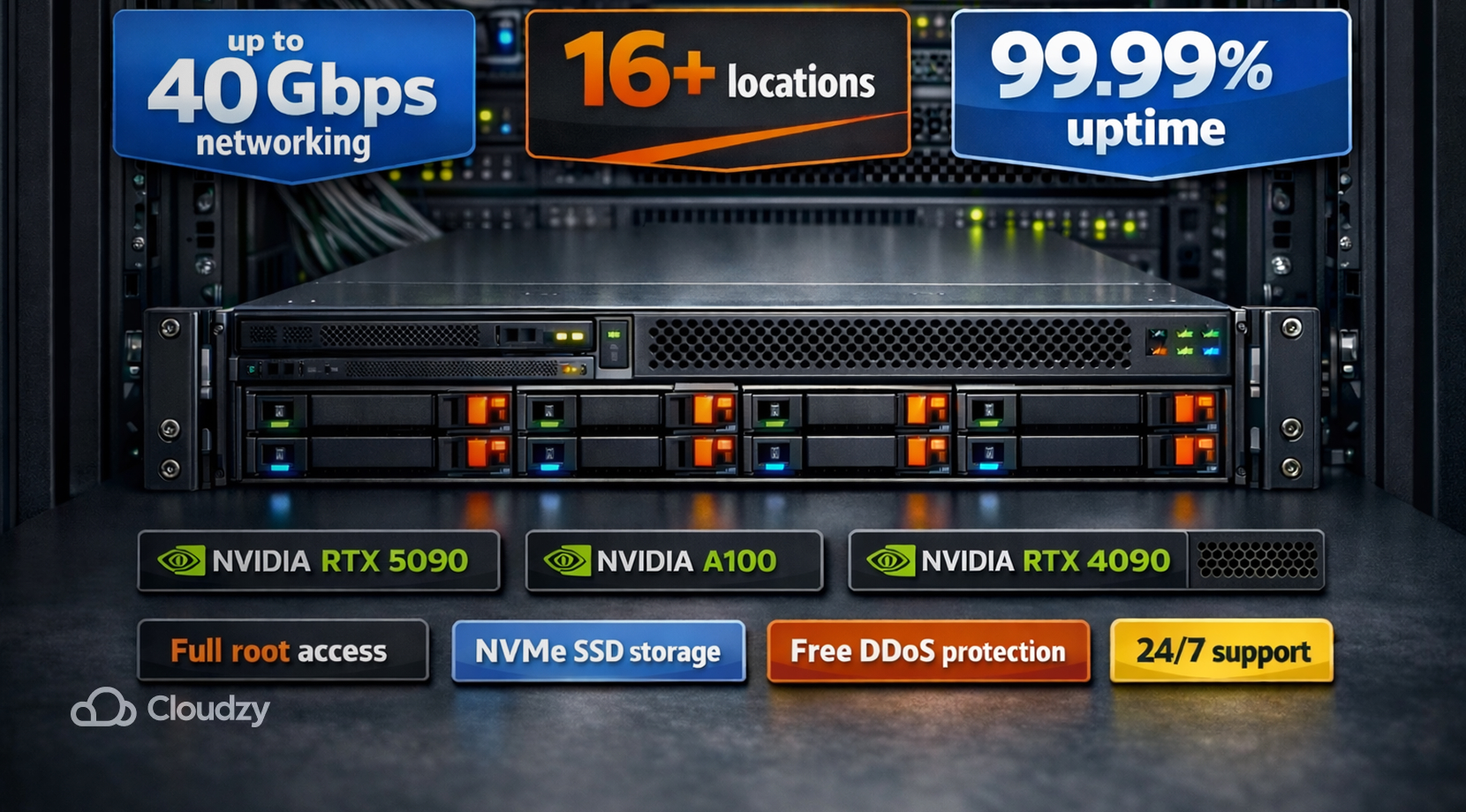

Una Soluzione Conveniente: Usa un Server GPU VPS per Carichi Pesanti

Nel nostro team infrastrutturale, il pattern più comune che vediamo è che le persone prototipano localmente, poi raggiungono un punto dove 5070 Ti vs 5080 non importa più, perché il lavoro semplicemente non ci sta.

Quello è il momento in cui vuoi accesso a un pool VRAM più grande per l'addestramento e per test di serving realistici. È esattamente dove Cloudzy GPU VPS è una scelta perfetta.

I nostri piani GPU VPS includono opzioni NVIDIA come RTX 5090, A100 e RTX 4090, oltre ad accesso root completo, storage NVMe SSD, connettività fino a 40 Gbps, 12 location, protezione DDoS gratuita, supporto 24/7 e un target di uptime 99.95%.

Ma come ti aiuta, sia che sia 5070 Ti vs 5080, o qualsiasi altro GPU dello stesso livello? Bene:

- Puoi eseguire il tuo vero modello e profile dei prompt su hardware con più VRAM, così le decisioni diventano ovvie dai tuoi stessi log.

- Puoi mantenere il tuo GPU locale per sviluppo e test veloci, poi noleggiare la "scheda grossa" solo per i lavori pesanti.

Se vuoi un ripasso veloce su cosa sia realmente un GPU VPS, e cosa significhi GPU dedicato vs accesso condiviso, la nostra guida per principianti lo spiega in linguaggio semplice.

E se ancora non sei sicuro se hai bisogno di un GPU per il tuo carico di lavoro, il nostro GPU contro CPU VPS Il confronto ti darà una visione chiara di quali hardware richiedono davvero compiti come training, inference, database e applicazioni web.

Una volta sistemata l'infrastruttura, l'ultimo passo è scegliere un workflow che non ti faccia perdere tempo.

Un Workflow Semplice per Capire Cosa Ti Serve

Molti sviluppatori ML si trovano davanti a una scelta falsa: comprare una scheda consumer più potente o fare compromessi. In realtà, 5070 Ti vs 5080 può ancora rientrare in un workflow ragionevole se la usi come strumento di sviluppo locale, non come stack di produzione completo.

Ecco un workflow che ha funzionato bene:

- Usa la tua GPU da 16 GB per coding, debug e piccoli esperimenti.

- Tieni pronto un template di ambiente con una "GPU grande" per esecuzioni remote.

- Sposta i test di training e serving che richiedono più memoria su una GPU VPS.

- Monitora le esecuzioni e salva i log, così i risultati rimangono riproducibili.

Se vuoi approfondire la scelta della giusta classe di GPU per il lavoro ML in generale, la nostra rassegna delle migliori GPU per machine learning è un buon prossimo passo.

In sintesi, 5070 Ti vs 5080 è una scelta di calcolo locale, ma il deep learning su scala è una scelta infrastrutturale. A proposito di scala, se sei curioso di sapere come una scheda di classe più grande cambia il comportamento reale dell'AI, il nostro H100 vs RTX 4090 benchmark confronto è utile perché torna sempre allo stesso tema: VRAM adatta prima, poi velocità.