Als je aan het kiezen bent H100 versus RTX 4090 voor AI: houd er rekening mee dat de meeste "benchmarks" er niet toe doen totdat je model en cache daadwerkelijk in VRAM passen. RTX 4090 is de ideale keuze voor werk op een enkele GPU dat binnen 24 GB blijft.

H100 is waar je naar grijpt zodra je grotere modellen nodig hebt, meer gelijktijdige gebruikers, isolatie per gebruiker, of minder tijd wilt besteden aan geheugenbeheer.

Ik bespreek het per workload, laat zien welke soorten benchmarks relevant zijn en geef je daarna een concreet testplan dat je op je eigen omgeving kunt uitvoeren.

Kort antwoord: H100 vs RTX 4090 voor AI-workloads

H100 wint voor het trainen van grote modellen en serieuze inferentie, dankzij grote HBM-pools, zeer hoge geheugenbandwijdte, NVLink en MIG voor isolatie. RTX 4090 is beter als je "hoge snelheid per GPU voor een betere prijs" nodig hebt, zolang je workload past binnen 24 GB zonder voortdurende compromissen. De specificaties en platformfuncties maken de keuze vrij duidelijk.

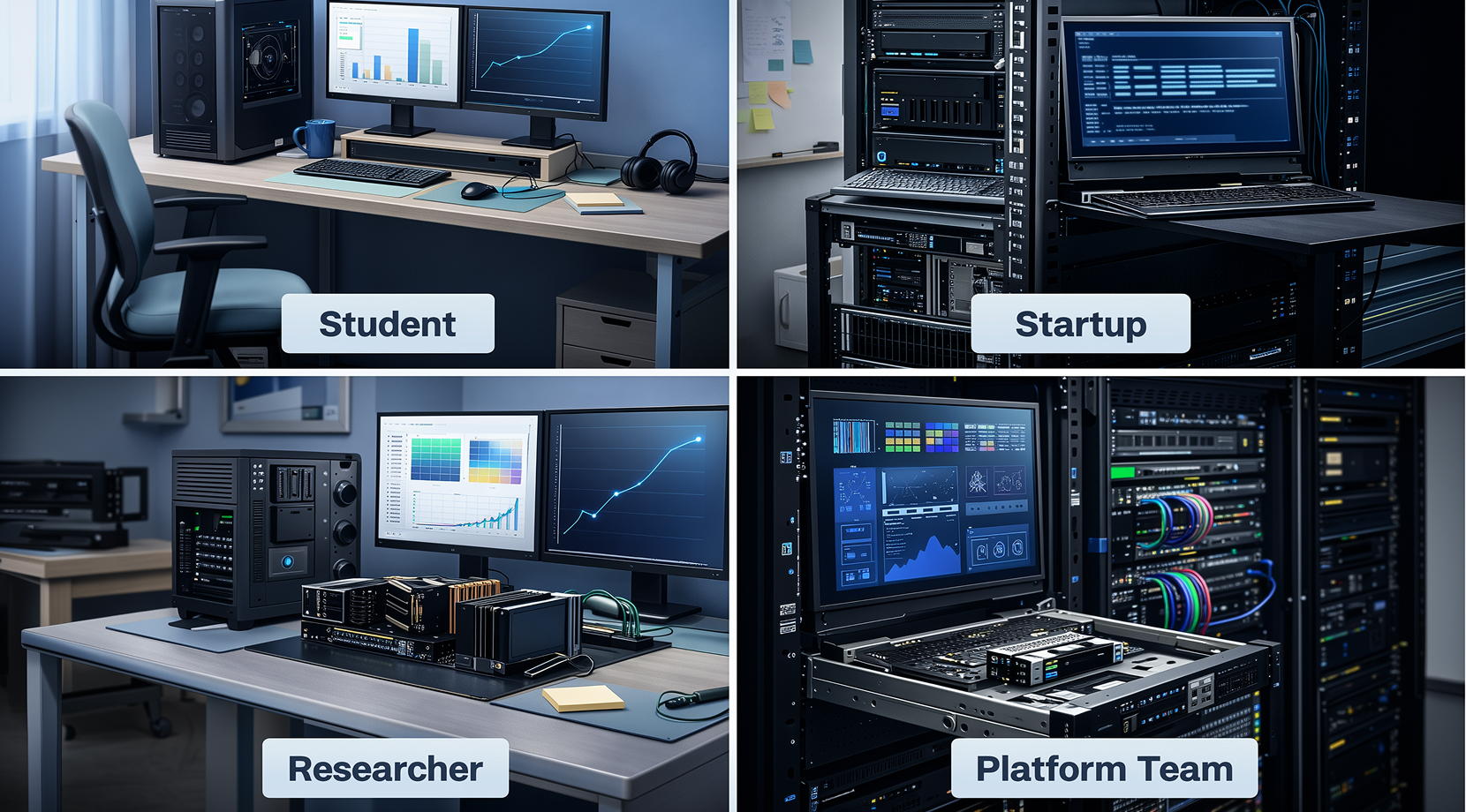

Hier is een snelle keuzegids per type gebruiker:

- Lokale LLM-ontwikkelaar (solo dev / student): RTX 4090 totdat VRAM de bottleneck wordt.

- ML-engineer bij een startup (MVP uitbrengen): RTX 4090 voor vroege inferentie en fine-tuning, H100 zodra je stabiele concurrentie of grotere modellen nodig hebt.

- Toegepast onderzoeker (veel experimenten): H100 als je steeds tegen OOM-fouten, batch-limieten of lange contexten aanloopt.

- Productie- / platformteam (multi-tenant serving): H100 voor MIG-slicing, meer headroom en soepelere schaalbaarheid.

Met dat kader in gedachten gaat de rest van dit artikel over de beperkingen die mensen in de praktijk tegenkomen, en hoe de benchmarkresultaten daarmee overeenkomen.

De enige benchmarkvraag die ertoe doet: wat moet er in VRAM passen?

De meeste discussies over H100 versus RTX 4090 zijn technisch gezien VRAM-discussies. Bij LLM-werk wordt VRAM opgeslokt door gewichten, activeringen tijdens training, optimalisatorstatussen tijdens training, en de KV-cache tijdens inferentie. Die laatste verrast mensen vaak, omdat hij groeit met contextlengte en gelijktijdige verzoeken.

De onderstaande tabel is bewust globaal gehouden, omdat de exacte fit afhankelijk is van het framework, de precisie en de overhead.

Dit is het overzicht vanuit het perspectief "past het zonder problemen?":

| Werkbelasting | Typische single-GPU-realiteit op RTX 4090 (24 GB) | Typische single-GPU-realiteit op H100 (80–94 GB) |

| 7B LLM-inferentie (FP16 / BF16) | Meestal prima | Comfortabele speelruimte |

| 13B LLM-inferentie | Vaak krap, afhankelijk van context | Meestal prima |

| 70B-klasse inferentie | Vereist zware quantisatie of offloading | Veel realistischer |

| SD/SDXL inferentie + kleine batch | Meestal prima | Prima, plus meer ruimte voor grotere batches |

| Serving met hogere gelijktijdigheid | KV-cachedruk wordt snel zichtbaar | Meer ruimte, stabieler onder belasting |

Als je een bredere GPU-shortlist wilt (niet alleen deze twee), biedt onze vergelijking van de Beste GPUs voor machine learning in 2025 is een handig referentieoverzicht voor VRAM en geheugenbandbreedte bij gangbare AI GPUs.

Als je weet dat je workload past, is geheugenbandbreedte het volgende dat bepaalt hoe 'soepel' het aanvoelt.

Bandbreedte: waarom HBM anders aanvoelt

Veel AI-prestatiediscussies draaien om rekenpiekwaarden, maar transformers zijn extreem gevoelig voor geheugenverkeer. Het voordeel van H100 is de combinatie van grote HBM-pools met zeer hoge geheugenbandbreedte, plus NVLink-bandbreedte en MIG-partitionering op platformniveau.

Specificaties Overzicht

Specificaties kiezen de GPU niet voor je, maar ze leggen wel uit waarom dezelfde workload op de ene kaart makkelijk aanvoelt en op de andere krap. Dit overzicht laat zien wat het meeste invloed heeft op LLM-training, inferentie en serving-gedrag.

| Specificatie | H100 (SXM / NVL) | RTX 4090 |

| VRAM | 80 GB / 94 GB | 24 GB |

| Geheugenbandbreedte | 3,35–3,9 TB/s | GDDR6X (capaciteit beperkt tot 24 GB) |

| Interconnectie | NVLink + PCIe Gen5 | PCIe (consumentenplatform) |

| Multi-instantie | Tot 7 MIG-instanties | Niet beschikbaar |

Specificatie referenties: NVIDIA H100, NVIDIA RTX 4090.

Wat dit in de praktijk betekent:

- Als je de batchgrootte of contextlengte wilt vergroten, blijft H100 doorgaans langer stabiel voordat je compromissen moet sluiten.

- Als je veel gelijktijdige verzoeken afhandelt, heeft H100 meer 'geheugenruimte', waardoor je minder snel last krijgt van onvoorspelbare staartlatentie.

- Als je werk voornamelijk bestaat uit een enkele gebruiker, een enkel model en een bescheiden context, voelt de 4090 vaak snel en bevredigend.

Bandbreedte vervangt goede benchmarking niet. Het legt alleen uit waarom twee GPUs op een smalle test vergelijkbaar lijken, maar uit elkaar lopen onder echte belasting.

Betrouwbare H100 vs RTX 4090 benchmarks

Niet alle benchmarks zijn gelijk, en dat is precies waarom 'mijn cijfers kloppen niet met die van jou' zo vaak voorkomt. Voor H100 versus RTX 4090, helpt het om benchmarks in twee categorieën te verdelen:

- Categorie A (community-gebaseerd): llama.cpp-style tokens/sec tests and simple inference scripts.

- Categorie B (gestandaardiseerde suites): MLPerf Training- en MLPerf Inference-resultaten, gericht op herhaalbare methodes.

Llama.cpp-stijl inferentie-snapshot

Dit is het soort test dat mensen thuis uitvoeren en daarna drie dagen over discussiëren. Het is nuttig omdat het een 'echte toolchain' weerspiegelt die veel developers gebruiken, maar het is ook makkelijk verkeerd te lezen als je fit en precisie negeert.

Publieke llama.cpp-vergelijkingen laten zien dat RTX 4090 het erg goed doet bij kleinere modellen en gekwantiseerde runs, terwijl grote modellen bij hogere precisie het plafond van RAM ruimschoots overtreffen.

Dit is het patroon dat je kunt verwachten:

| Model | GPU | Typisch Resultaat |

| 7B-klasse | RTX 4090 | Hoge tokens/sec, soepele inferentie voor één gebruiker |

| 13B-klasse | RTX 4090 | Nog steeds goed, maar context en overhead beginnen een rol te spelen |

| 70B-klasse | RTX 4090 | Past niet zonder agressieve kwantisatie of offloading |

| 70B-klasse | H100 | Veel realistischer om resident te houden en betrouwbaar te serveren |

Het punt van deze tabel is niet 'RTX 4090 slecht' of 'H100 magisch'. Het gaat erom dat het plafond van RAM bepaalt hoeveel je resident kunt houden, en dat heeft invloed op snelheid, stabiliteit en hoeveel configuratiewerk je kwijt bent.

Als je voortdurend de contextlengte moet inkorten om het systeem draaiende te houden, is dit vergelijking op dat punt niet meer theoretisch.

Wat MLPerf toevoegt dat forumbenchmarks niet bieden

MLPerf bestaat omdat 'willekeurige scripts en onderbuikgevoel' niet werkt als je een beslissing van duizenden dollars neemt. MLCommons heeft nieuwere generatieve AI-workloads geleidelijk toegevoegd, en MLPerf is ontworpen om resultaten beter vergelijkbaar te maken tussen systemen.

Aan de trainingskant is NVIDIA's MLPerf Training v5.1-rapport een goed voorbeeld van hoe leveranciers trainingstijd rapporteren, inclusief details over de testomgeving en de benchmarkregels die ze volgen.

Dit zegt niets over hoe je eigen prompts zich gedragen, maar het is een goede controle voor schaalbaarheid op systeemniveau en hoe deze klasse hardware presteert onder gestandaardiseerde regels.

Laten we het nu hebben over het deel dat aankoopbeslissingen het meest beïnvloedt: de tijd en het geld die het kost om het werk af te ronden.

Kosten, tijd en opportuniteitskosten

Veel H100 versus RTX 4090 Beslissingen worden vaak geframed als 'aankoopprijs versus huurprijs'. Dat is zelden het juiste perspectief. Een beter perspectief is: hoeveel uur kost het je om een bruikbaar model te produceren, en hoeveel tijd verlies je aan het omzeilen van beperkingen?

Drie veelvoorkomende scenario's maken de afwegingen duidelijk.

Wekelijks fine-tunen op kleine tot middelgrote modellen

Als je runs binnen 24 GB blijven zonder voortdurende compromissen, werkt het RTX 4090-pad prima. Je itereert snel, hoeft geen clustertijd in te plannen en de opzet is eenvoudig. Als elke run uitdraait op 'lagere batch, kortere context, opnieuw proberen', is H100 een veel verstandigere keuze, ondanks de hogere kosten.

Serveren met echte gelijktijdigheid

Gelijktijdigheid verhoogt de KV-cachedruk snel. Dit is waar de extra ruimte en platformcontroles van H100 zich terugbetalen, zeker als je voorspelbare latency nodig hebt.

Als je nog twijfelt of een GPU-server überhaupt de juiste keuze is voor jouw deployment, biedt onze GPU VPS vs. CPU VPS breakdown een handige manier om workloads aan het juiste infrastructuurtype te koppelen, voordat je tijd steekt in het optimaliseren van de verkeerde dingen.

Grotere trainingsjobs met deadlines

Zodra je verder schaalt dan één persoon en één machine, wil je je richten op de saaie maar cruciale zaken: stabiele omgevingen, minder foutmodi, en minder tijd kwijt aan wat neerkomt op babysitting. Dat is precies waarvoor H100 is ontworpen.

Als je na dit onderdeel nog steeds twijfelt, is de volgende stap niet meer lezen. Het is kijken hoe jouw stack zich in de praktijk gedraagt, inclusief driverproblemen en multi-user workloads.

Software en operaties: drivers, stabiliteit, multi-user en ondersteuning

Dit is het deel dat de meeste benchmarkgrafieken overslaan, maar het is een groot deel van het dagelijks leven.

RTX 4090 is populair omdat het toegankelijk en snel is voor veel AI-workflows. Het nadeel is dat naarmate je use case groeit, je vaker tegen grenzen aanloopt op het gebied van geheugenlimieten en schaalmethoden die niet zijn gebouwd voor gedeelde, multi-tenant omgevingen.

H100 is gebouwd voor clusters. MIG is een grote troef voor platformteams, omdat je daarmee één GPU kunt opdelen in geïsoleerde segmenten. Dat vermindert 'noisy neighbor'-problemen en maakt capaciteitsplanning een stuk eenvoudiger. NVIDIA's officiële H100-specificaties vermelden tot 7 MIG-instanties, afhankelijk van de vormfactor.

Als jouw workload persoonlijk en lokaal is, kun je nog lang prima uit de voeten met een 4090. Als jouw workload multi-user en klantgericht is, is H100 de verstandigere keuze.

Dus, wie moet wat kiezen?

Welke kies je voor jouw workload

Voor H100 versus RTX 4090, de juiste keuze is uiteindelijk de keuze die jouw grootste obstakels wegneemt.

Lokale LLM-ontwikkelaar (solo dev / student)

Kies RTX 4090 als je voornamelijk in het bereik van 7B–13B zit, gekwantiseerde inferentie uitvoert, met RAG experimenteert of aan SDXL werkt. Stap over zodra je meer tijd besteedt aan het omzeilen van geheugenlimieten dan aan het bouwen van wat je eigenlijk wilde bouwen.

ML-engineer bij een startup (MVP lanceren)

Als jouw MVP één model is met gemiddeld verkeer dat er comfortabel in past, is een 4090 een sterke start. Als je stabiele latency onder pieken nodig hebt, hogere gelijktijdigheid, of meerdere workloads per host, is H100 de rustiger route.

Toegepast onderzoeker (veel experimenten)

Als je regelmatig gedwongen wordt tot compromissen, zoals het verkleinen van de batchgrootte of precisieacrobatiek, geeft H100 je schonere experimenten en minder mislukte runs.

Productie- en platformteam (multi-tenant serving)

H100 is de voor de hand liggende keuze, vooral omdat MIG en meer ruimte capaciteitsplanning eenvoudiger maken en de schade beperken als er iets piekt.

Als je nog geen hardware wilt aanschaffen, is huren de logische volgende stap.

Een praktische tussenweg: huur eerst GPUs, dan beslis je

De meest directe manier om dit te bepalen H100 versus RTX 4090 is om uit te voeren jouw model, jouw prompts en jouw contextlengte op beide hardwareklassen, en vergelijk daarna tokens/sec en staartlatentie onder belasting.

Precies daarom hebben we Cloudzy GPU VPSgebouwd, zodat je binnen een minuut een GPU-server hebt, je stack installeert met volledige root-toegang, en stopt met gissen op basis van andermans benchmarks.

Dit krijg je bij onze GPU VPS-plannen:

- Toegewezen NVIDIA GPUs (inclusief opties op RTX 4090- en A100-niveau), zodat je resultaten niet afwijken door lawaaierige buren.

- Tot 40 Gbps netwerken op alle GPU-plannen, wat een groot voordeel is voor het ophalen van datasets, workflows met meerdere nodes en het snel verplaatsen van artefacten.

- NVMe SSD opslag, plus DDR5 RAM en hoge-frequentie CPU-opties op alle niveaus, zodat de rest van de server de GPU niet vertraagt.

- DDoS-bescherming en een 99,95% uptime, zodat langdurige taken niet worden verstoord door willekeurig internetruis.

- Uurbilling (handig voor korte benchmark-sprints) en een 14 dagen geld-terug-garantie voor testen met weinig risico.

Voer de benchmark-checklist eerst uit op een RTX 4090-plan, en herhaal dit op een A100-plan zodra je grotere contexten, hogere gelijktijdigheid of grotere modellen gebruikt. Daarna wordt de keuze tussen H100 versus RTX 4090 vaak vanzelf duidelijk uit je eigen logs.

Benchmark-checklist: voer hem in 30 minuten zelf uit

Als je een beslissing wilt die je kunt onderbouwen, haal dan vier getallen op uit de exacte stack die je gaat uitrollen:

- Tokens/sec bij je gewenste contextlengte

- p95 latentie bij je verwachte gelijktijdigheid

- VRAM-ruimte tijdens de zwaarste fase

- Kosten per voltooide run van start tot artefact

Een minimale rooktest met vLLM ziet er zo uit:

pip install vllm transformers accelerate

python -m vllm.entrypoints.api_server \

--model meta-llama/Llama-3-8B-Instruct \

--dtype float16 \

--max-model-len 8192Als je een duidelijk beeld wilt van wat je precies huurt, legt onze post over Wat is een GPU VPS? het verschil uit tussen toegewezen GPU-toegang, vGPU-deling en wat je moet controleren voordat je een plan kiest.