Als je een nieuwe GPU wil kopen om af te zijn van out-of-memory-fouten, is de discussie 5070 Ti vs 5080 niet de juiste. Beide kaarten hebben 16 GB VRAM, en die capaciteitslimiet wordt bij deep learning eerder een knelpunt dan de meeste mensen verwachten.

De 5080 is sneller, maar daarmee kun je zelden een significant groter model draaien. In de praktijk moet je nog steeds de batchgrootte verkleinen, de contextlengte inkorten, of naar systeemgeheugen RAM offloaden om trainingsruns gaande te houden.

Daarom is dit artikel een eerlijke, realistische vergelijking van 5070 Ti vs 5080 voor deep learning, aangevuld met alternatieven die passen als je modellen wil trainen, fine-tunen of serveren zonder constant tegen VRAM-limieten aan te lopen.

Als je maar één ding leest, lees dan de specificatiesectie en de sectie 'capaciteit vs snelheid'. Dat zijn de twee die voorkomen dat je de verkeerde keuze maakt.

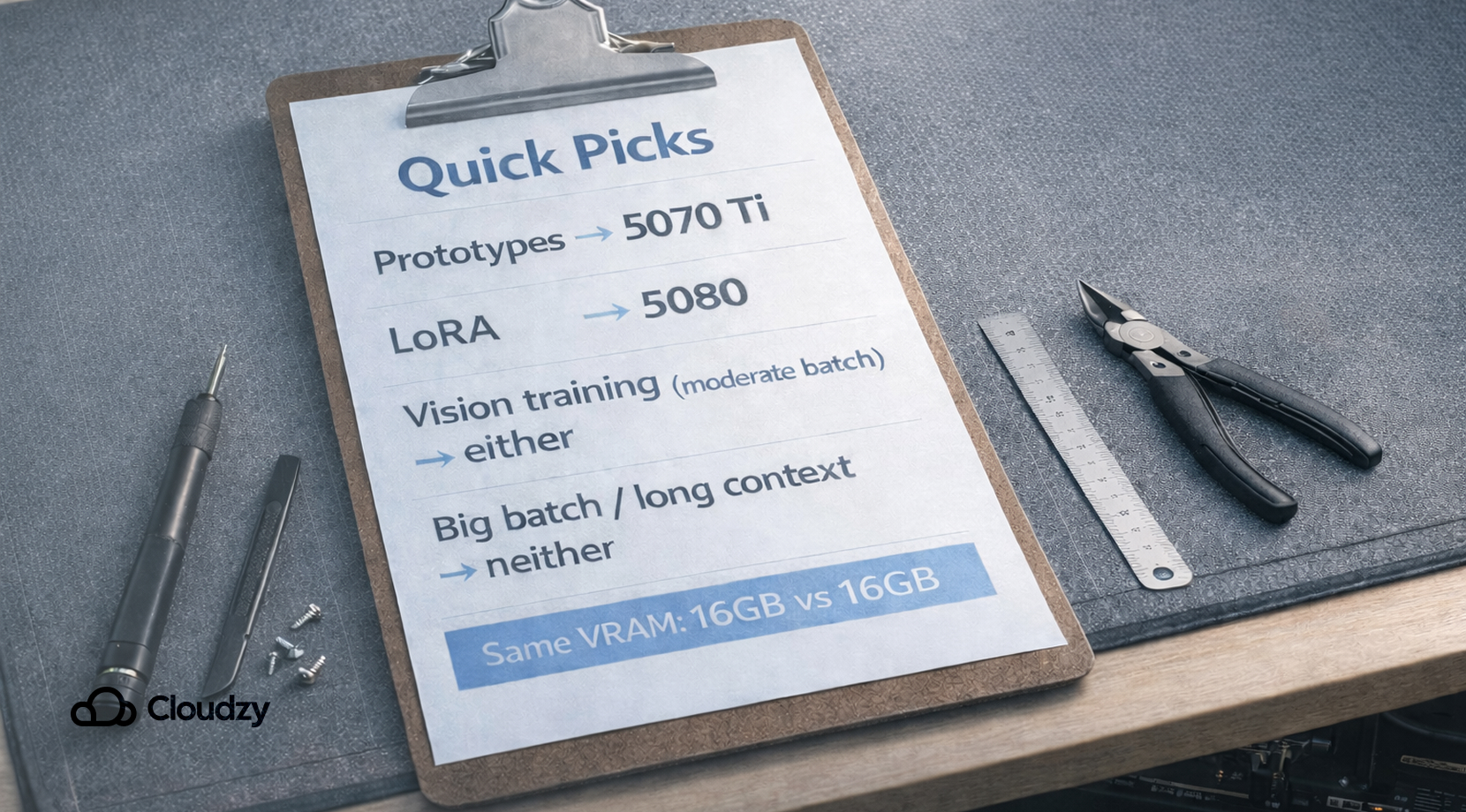

Snelle keuze op basis van wat je doet

De meeste mensen kopen geen GPUs op goed geluk. We zien steeds vier denkpatronen terugkomen bij kopers, en de keuze tussen 5070 Ti vs 5080 pakt voor elk anders uit.

De Lokale LLM Hobbyist

Je draait notebooks, experimenteert met quantization-instellingen, en geeft meer om 'het werkt' dan om maximale doorvoer. Bij jou wordt 5070 Ti vs 5080 meestal bepaald door budget, want beide kaarten voelen prima aan op kleine modellen en gekwantiseerde inferentie. Daarna lopen ze allebei tegen hetzelfde VRAM-plafond aan zodra je de contextlengte of batch size opschroeft.

De Promovendus Die Vision Models Traint

Je wilt herhaalbare experimenten, geen eindeloze herhalingen. De verborgen kostenpost is niet de kaart zelf, maar de tijd die je verliest wanneer runs mislukken bij epoch 3 omdat de dataloader, augmentaties en het model allemaal om geheugen strijden.

De Startup-engineer Die Inference Uitrolt

Jij let op tail latency en concurrency. Een single-user demo ziet er prima uit met 16 GB, maar zodra productieverkeer aankomt, vreet KV cache-druk je VRAM als een langzaam lek leeg. Voor serving kan 5070 Ti vs 5080 een afleiding zijn als je echte probleem capaciteit is voor batching en lange prompts.

De Creator Die Ook Aan ML Doet

Je schakelt voortdurend tussen creatieve apps en ML-tooling, en je hebt een hekel aan reboots, driver-problemen en 'sluit Chrome om te trainen.' Voor jou heeft de keuze tussen 5070 Ti vs 5080 alleen zin als de GPU past in een overzichtelijke workflow, en niet een wankele workstation is die omvalt zodra je multitaskt.

Met die gevallen in gedachten: laten we concreet kijken naar de hardware en waarom de beperkende factor op de plekken die ertoe doen steeds dezelfde is.

Belangrijkste Specs voor Deep Learning

De snelste manier om 5070 Ti vs 5080 te begrijpen: negeer de marketingcijfers en kijk alleen naar de geheugenregel.

Wil je het volledige spec-overzicht? Hier is een gedetailleerde tabel die zich richt op wat het meeste invloed heeft op trainings- en inferentiegedrag. (Kloksnelheden en displayuitgangen vallen op, maar bepalen niet of je run past.)

| Specificatie (Desktop) | RTX 5070 Ti | RTX 5080 | Waarom het in DL verschijnt |

| VRAM | 16 GB | 16 GB | Capaciteit is de harde grens voor weights, activaties en KV cache |

| Geheugentype | GDDR7 | GDDR7 | Vergelijkbaar gedrag, bandwidth helpt, maar capaciteit bepaalt 'past het of niet' |

| Geheugenbus | 256-bits | 256-bits | Beperkt de totale bandwidth; helpt doorvoer, niet de modelgrootte |

| CUDA-kernen | 8,960 | 10,752 | Meer rekenkracht helpt tokens/sec, niet 'kan ik het laden' |

| Typisch Boardvermogen | 300 W | 360 W | Meer warmte en PSU-marge, geen extra VRAM |

Officiële bronnen voor specs: RTX 5080, RTX 5070-familie

Kort gezegd: de 5080 is de snellere kaart, de 5070 Ti de goedkopere. Voor deep learning wordt het verschil pas zichtbaar nadat je workload al past.

Vervolgens kijken we naar waarom VRAM zo snel verdwijnt, zelfs op setups die er op papier licht uitzien.

Waarom VRAM Zo Snel Wordt Verbruikt in Deep Learning

Mensen die gewend zijn aan gaming denken vaak dat VRAM werkt als een textuurbuffer. In deep learning lijkt het meer op een krappe keukentafel. Je hebt niet alleen ruimte nodig voor de ingrediënten, maar ook om te snijden, te koken en op te dienen, allemaal tegelijk.

Dit staat er doorgaans in VRAM tijdens een run:

- Modelgewichten: de parameters die je inlaadt, soms in FP16/BF16, soms gekwantiseerd.

- Activaties: tussentijdse tensors opgeslagen voor backprop, doorgaans de grootste geheugenvreter bij training.

- Gradiënten en optimizer-toestand: trainingsoverhead die het geheugengebruik flink kan vermenigvuldigen.

- KV-cache: inferentieoverhead die toeneemt met contextlengte en gelijktijdige verzoeken.

Dit is waarom het vergelijken van een 5070 Ti met een 5080 kan aanvoelen als ruziën over motorvermogen terwijl je een te zwaar aanhangewagen trekt. Meer pk's helpen je niet als de trekhaakbelasting de bottleneck is.

Een snelle controle die we in onze eigen tests gebruiken: log zowel het toegewezen als het gereserveerde geheugen in PyTorch. De CUDA-geheugennotities van PyTorch leggen de caching-allocator uit en verklaren waarom geheugen als 'in gebruik' kan verschijnen in tools zoals nvidia-smi, zelfs nadat tensors zijn vrijgegeven.

En dat brengt ons bij het kernpunt: de meeste deep learning-fouten op 16 GB komen niet doordat het traag is, maar doordat je op het slechtst mogelijke moment een OOM-fout krijgt.

De eerste workloads die de grens verleggen bij 5070 Ti vs 5080

Hieronder staan de deep learning-patronen die bij 5070 Ti vs 5080 doorgaans als eerste tegen de geheugenlimieten aanlopen.

LLM Serving met lange prompts en echte gelijktijdigheid

Een enkele prompt van 2K tokens kan er prima uitzien. Voeg langere context toe, voeg batching toe, voeg een tweede gebruiker toe, en de KV-cache begint te groeien. Dat is het moment waarop 5070 Ti vs 5080 op hetzelfde uitkomt: je kapt de maximale context af of verlaagt de batchgrootte om het vol te houden.

Een eenvoudige controlemethode:

- Start je server met je echte maximale context en batch.

- Houd VRAM in de gaten over tijd, niet alleen bij het opstarten.

- Noteer het punt waarop de latentie piekt en controleer dan het geheugengebruik in hetzelfde tijdvenster.

Als je een betrouwbare monitoringopzet wilt die geen project op zichzelf wordt, behandelt onze gids over GPU-monitoringsoftware praktische CLI-logging-patronen die goed werken in echte runs.

LoRA of QLoRA fine-tuning

Veel mensen zeggen dat 'LoRA werkt op 16 GB', en dat klopt. De valkuil is aannemen dat de rest van je pipeline gratis meekomt. Tokenisatiebuffers, dataloader-workers, mixed precision-schaling en validatiestappen stapelen zich snel op.

In de praktijk zit de bottleneck hier niet zozeer in rekenkracht als wel in marge. Zonder vrij VRAM ben je voortdurend runs aan het bewaken.

Visiontraining met hoge-resolutie-invoer

Beeldmodellen hebben een verraderlijke faalwijze: een kleine verhoging van de resolutie of een extra augmentatie kan je van stabiel naar OOM doen omslaan. Op 5070 Ti vs 5080 uit dit zich als een batchgrootte die terugvalt naar 1, waarna gradient accumulation je training in een trage loop verandert.

Multimodaal draaien op één GPU

Text encoder + image encoder + fusion layers kunnen prima werken, maar zodra je de sequentielengte verhoogt of een groter vision backbone toevoegt, loopt het geheugengebruik snel uit de hand.

Mijn GPU Is Prima, Mijn Desktop Niet

Dit is de meest herkenbare situatie. Je begint met trainen, dan grijpen je browser, IDE en wat je nog meer draait VRAM, en ineens is je 'stabiele' configuratie kapot. Mensen op forums klagen dat ze alles hebben afgesloten, overlays hebben uitgeschakeld, en toch OOM-fouten krijgen op hetzelfde model dat ze gisteren nog prima draaiden.

Dat patroon duikt steeds weer op in 5070 Ti vs 5080 discussies, ook, omdat beide kaarten dezelfde capaciteitslimiet hebben. Als dit bekend klinkt, is de volgende vraag: "wat doen we aan die limiet?"

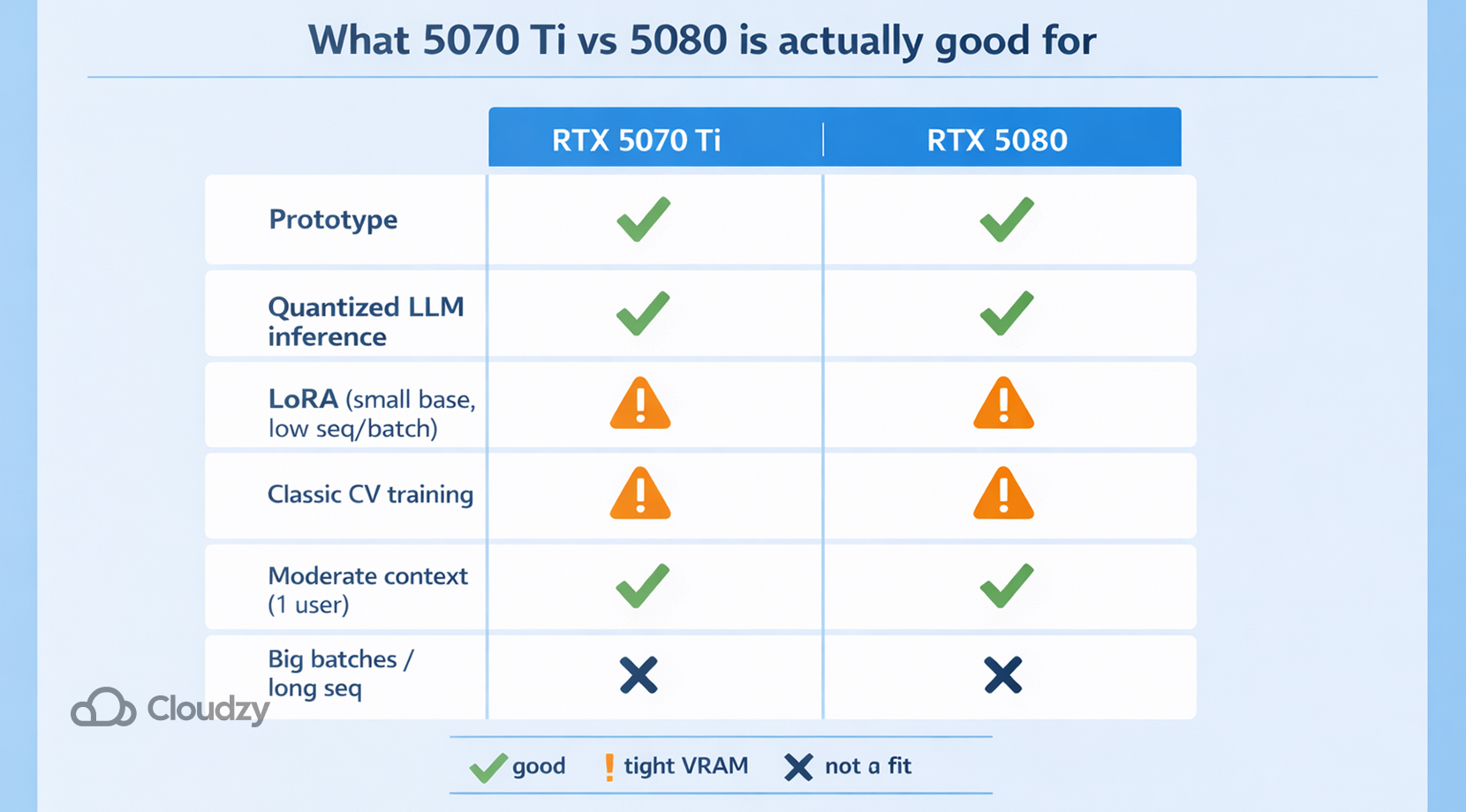

Waar de 5070 Ti vs 5080 Actually Good voor geschikt is

16 GB afkraken is makkelijk in ML-kringen, maar het is niet nutteloos. Het is gewoon beperkt.

5070 Ti vs 5080 kan prima werken voor:

- Prototypewerk: kleine experimenten, snelle ablaties en snelle verificaties.

- Gekwantiseerde LLM inferentie: kleinere modellen met een gematigd contextvenster, voor één gebruiker.

- LoRA op kleinere basismodellen: zolang je de sequentielengte en batchgrootte onder controle houdt.

- Klassieke vision-training: gematigde afbeeldingsgroottes, gematigde backbones, meer geduld.

Het punt is: als je werk binnen de geheugenlimiet blijft, zal de 5080 doorgaans sneller aanvoelen dan de 5070 Ti, en profiteer je van de extra rekenkracht.

Maar zodra je 'serieus' aan deep learning begint, loop je al snel tegen geheugenproblemen aan. Laten we dus kijken welke aanpak op beide kaarten werkt.

Hoe We Het Meeste Halen Uit Beperkte VRAM Zonder Het Trainen Ondragelijk Te Maken

Geen van deze trucs is magie. Het zijn gewoon de stappen die ervoor zorgen dat je 5070 Ti vs 5080 langer bruikbaar blijft.

Begin met meten

Bepaal eerst het maximale VRAM-getal per stap voordat je hyperparameters aanpast. In PyTorch, max_memory_allocated() en max_memory_reserved() zijn snelle manieren om te zien wat je run werkelijk doet.

Dat helpt je vragen te beantwoorden zoals:

- Is het model zelf de grootste kostenpost, of zijn het de activaties?

- Piekt VRAM tijdens validatie?

- Loopt fragmentatie langzaam op in de loop van de tijd?

Zodra je een baseline hebt, wordt de rest minder giswerk.

Bespaar geheugen waar mogelijk

Een eenvoudige volgorde die wij hanteren:

- Verlaag de batch size totdat het past.

- Voeg gradient accumulation toe om je effectieve batch te herstellen.

- Schakel mixed precision (BF16/FP16) in als je stack dat ondersteunt.

- Voeg gradient checkpointing toe als activaties het meeste geheugen innemen.

- Pas daarna pas aan de modelgrootte.

Behandel contextlengte als een budget

Bij transformers is contextlengte het onderdeel dat de meeste problemen veroorzaakt. Het beïnvloedt de attention-berekeningen en, bij inferentie, de KV cache-grootte. Bij de 5070 Ti versus de 5080 merk je dit zodra je een paar duizend tokens overschrijdt: VRAM stijgt snel, de doorvoer daalt, en je bent plotseling de batch size aan het terugschroeven om het draaiende te houden.

Een aanbevolen benadering:

- Stel een standaard maximale contextlengte in die je met voldoende marge kunt draaien.

- Maak een tweede profiel voor lange context met een lagere batch size.

- Meng de twee niet terwijl je aan het debuggen bent.

Verwar PyTorch-cache niet met echte geheugenlekken

Veel meldingen van 'geheugenlekken' zijn eigenlijk normaal allocatorgedrag. De documentatie van PyTorch vermeldt dat de caching allocator geheugen gereserveerd kan houden nadat tensors zijn vrijgegeven, en empty_cache() ongebruikte gecachte blokken grotendeels teruggeeft aan andere applicaties, niet aan PyTorch zelf.

Dit is belangrijk omdat gebruikers die de 5070 Ti met de 5080 vergelijken zich vaak laten afleiden door schijnbare lekken, terwijl de werkelijke oorzaken elders liggen: batch size, sequentielengte en activatiegeheugen.

Deze aanpassingen maken de geheugenlimiet beter bruikbaar, maar veranderen de onderliggende realiteit niet. Als je project grotere modellen, langere contexten of hogere gelijktijdigheid vereist, heb je simpelweg meer VRAM nodig.

Heb ik capaciteit of snelheid nodig: 5070 Ti versus 5080

Je kunt het zo bekijken: snelheid bepaalt hoe snel je rijdt, capaciteit bepaalt hoeveel passagiers je meeneemt. Bij deep learning tellen beide, maar capaciteit bepaalt of je überhaupt de parkeerplaats af kunt.

De 5080 levert bij veel workloads een hogere doorvoer dan de 5070 Ti. Maar de keuze tussen 5070 Ti en 5080 verandert niets aan de vraag 'kan ik het laden en uitvoeren', want beide bereiken hun limiet.

Dat is waarom mensen teleurgesteld zijn na een upgrade. Ze merken de snelheidswinst bij kleine tests, maar zodra ze hun echte workload draaien, lopen ze tegen dezelfde muur aan. De muur komt alleen 30 seconden later.

Als je dus aan het shoppen bent met deep learning in gedachten, helpt het om te bepalen in welke categorie je valt:

- Snelheidsbeperkt: je past al, je wilt alleen snellere stappen.

- Capaciteitsbeperkt: je past er niet goed in, en je besteedt tijd aan het verkleinen van het probleem.

De meeste mensen die onderzoek doen naar 5070 Ti vs 5080 voor deep learning zitten in de tweede categorie, ook al beseffen ze dat nog niet.

Laten we het nu hebben over de optie die doorgaans de meeste tijd bespaart: het 'zware werk' uitbesteden aan een grotere GPU, zonder je hele werkwijze om een nieuwe lokale rig heen te bouwen.

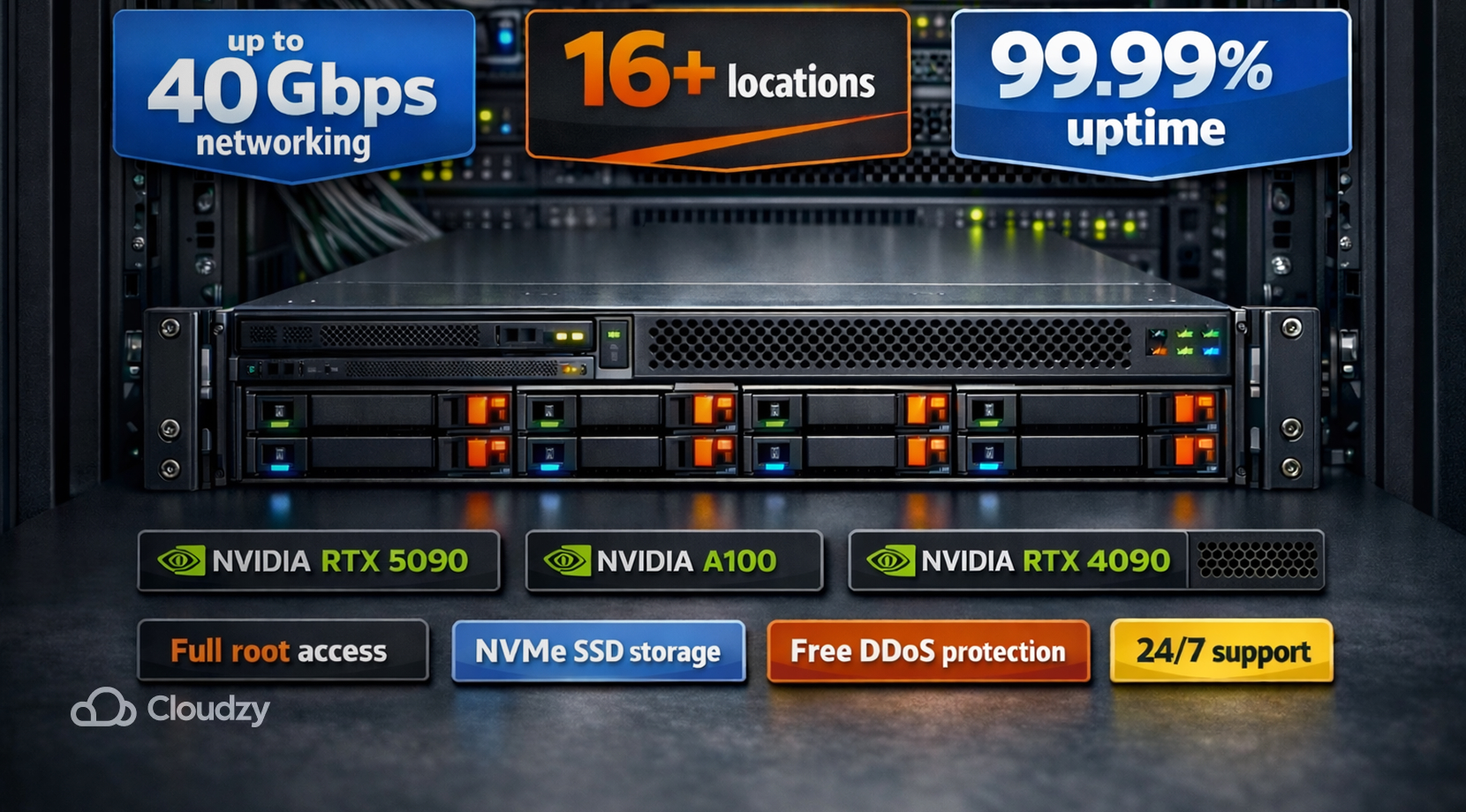

Een betaalbare oplossing: gebruik een GPU VPS voor zware workloads

In ons infra-team zien we het vaakst dat mensen lokaal prototypen, tot ze een punt bereiken waarop 5070 Ti vs 5080 er niet meer toe doet, omdat het werk simpelweg niet past.

Dat is het moment waarop je toegang wilt tot een grotere VRAM-pool voor training en realistische serving-tests. Precies daar komt Cloudzy GPU VPS is een perfecte match.

Onze GPU VPS-abonnementen bevatten NVIDIA-opties zoals RTX 5090, A100 en RTX 4090, plus volledige root-toegang, NVMe SSD-opslag, tot 40 Gbps netwerk, 12 locaties, gratis DDoS-bescherming, 24/7 support en een uptime-doelstelling van 99,95%.

Maar hoe helpt dit jou, of het nu 5070 Ti vs 5080 is of een andere GPU op hetzelfde niveau? Wel:

- Je kunt je echte model en promptprofiel draaien op hardware met meer VRAM, zodat de beslissingen vanzelf duidelijk worden uit je eigen logs.

- Je kunt je lokale GPU gebruiken voor ontwikkeling en snelle tests, en de 'grote kaart' alleen huren voor de zware klussen.

Als je een snelle opfrisser wilt over wat een GPU VPS precies is, en wat het verschil is tussen toegewijd en gedeelde GPU-toegang, legt onze beginnersgids het in gewone taal uit.

En als je nog niet zeker weet of je überhaupt een GPU nodig hebt voor jouw workload, geeft onze GPU versus CPU VPS vergelijking een goed beeld van welke hardware echte taken zoals training, inferentie, databases en webapps vereisen.

Nu de infrastructuur is geregeld, is het laatste stuk het kiezen van een werkwijze die geen tijd verspilt.

Een eenvoudige werkwijze om te bepalen wat je nodig hebt

Veel ML-developers raken vast in een valse keuze: de grotere consumentenkaart kopen of het ermee doen. In de praktijk kan 5070 Ti vs 5080 nog steeds deel uitmaken van een verstandige werkwijze, zolang je het ziet als je lokale dev-tool en niet als je volledige productiestack.

Dit is een werkwijze die in de praktijk goed werkt:

- Gebruik je 16 GB GPU voor codering, debugging en kleine experimenten.

- Houd een omgevingssjabloon voor een 'grote GPU' klaar voor externe runs.

- Verplaats training en serving-tests die meer ruimte nodig hebben naar een GPU-server.

- Monitor runs en sla logs op, zodat resultaten reproduceerbaar zijn.

Als je dieper wilt ingaan op het kiezen van de juiste GPU-klasse voor ML-werk in het algemeen, is ons overzicht van de beste GPU's voor machine learning een goede volgende stap.

Uiteindelijk is 5070 Ti vs 5080 een keuze voor lokale rekenkracht, maar deep learning op schaal is een infrastructuurkeuze. Als je nieuwsgierig bent hoe een grotere GPU-klasse het echte AI-gedrag verandert, is onze H100 vs RTX 4090 benchmark vergelijking nuttig, omdat hij steeds terugkomt op hetzelfde thema: VRAM-fit eerst, dan snelheid.