Machine learning i jego gałąź, deep learning, wymagają ogromnej mocy obliczeniowej, którą mogą zapewnić tylko GPU. Jednak nie każda GPU się nada – oto zestawienie najlepszych GPU do machine learning, wyjaśnienie, dlaczego są niezbędne, oraz wskazówki, jak wybrać właściwą do swojego projektu.

Dlaczego Potrzebuję GPU do Machine Learning?

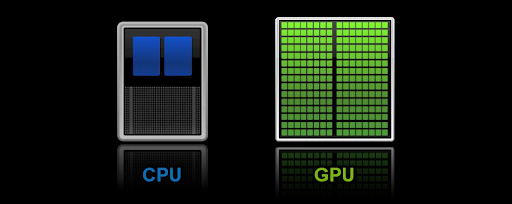

Jak wspomniano wcześniej, machine learning wymaga ogromnej mocy obliczeniowej, którą mogą zapewnić tylko GPU. CPU sprawdzą się przy mniejszych aplikacjach, ale przy zadaniach cięższych niż jednowątkowe obliczenia ogólnego przeznaczenia szybko staną się wąskim gardłem. Kluczowa różnica w mocy obliczeniowej wynika z możliwości równoległego przetwarzania przez GPU oraz znacznie większej liczby rdzeni. Typowa CPU ma od 4 do 16 rdzeni, natomiast najlepsze GPU do machine learning mogą mieć tysiące rdzeni – w szczególności rdzeni tensor – z których każdy obsługuje jednocześnie niewielką część obliczeń.

To właśnie równoległe przetwarzanie sprawia, że operacje na macierzach i obliczenia z zakresu algebry liniowej idą GPU znacznie lepiej niż CPU – dlatego GPU są o wiele lepszym wyborem do zadań takich jak trenowanie dużych modeli machine learning. Wybór najlepszej GPU do machine learning nie jest jednak prosty.

Jak Wybrać Najlepszą GPU do AI i Deep Learning

Większość GPU radzi sobie z typowymi zadaniami bez problemu. Machine learning i deep learning stawiają jednak poprzeczkę znacznie wyżej. Nasuwa się więc pytanie: co decyduje o tym, że dana GPU nadaje się do deep learning?

Dobra GPU do deep learning powinna cechować się następującymi właściwościami i funkcjami:

Rdzenie CUDA, Rdzenie Tensor i Kompatybilność

AMD i Nvidia oferują najlepsze GPUs do uczenia maszynowego i DL, przy czym ta druga marka wypada wyraźnie lepiej. Zawdzięcza to rdzeniom Tensor i CUDA. Rdzenie Tensor obsługują obliczenia typowe dla AI i uczenia maszynowego, takie jak mnożenia macierzy i sploty (stosowane w głębokich sieciach neuronowych). Rdzenie CUDA umożliwiają natomiast przetwarzanie równoległe, efektywnie rozdzielając operacje między jednostki GPU. Karty bez tych dwóch typów rdzeni zazwyczaj słabo radzą sobie z zadaniami ML i DL.

Warto jednak dodać, że niedawne ulepszenia platformy ROCm i akceleratorów z serii MI przez AMD poprawiły możliwości jej GPUs, dlatego znajdziesz je na naszej liście. GPUs od Nvidia nadal jednak dominują w deep learningu, głównie dzięki dobrze zoptymalizowanemu ekosystemowi oprogramowania i szerokiemu wsparciu frameworków (np. TensorFlow, PyTorch, JAX). Najlepsze GPUs do uczenia maszynowego powinny być w pełni kompatybilne z tymi frameworkami ML, ponieważ niezgodność może prowadzić do problemów z akceleracją, sterownikami i bibliotekami (np. cuDNN, TensorRT od NVIDIA), a także ograniczać możliwości rozwoju w przyszłości.

Możesz też nie mieć pełnego dostępu do narzędzi z zestawu NVIDIA CUDA, takich jak biblioteki akcelerowane przez GPU, kompilator i środowisko uruchomieniowe C i C++ czy narzędzia do optymalizacji i debugowania.

VRAM (Video RAM), Standard Pamięci i Przepustowość Pamięci

Jak w przypadku każdego sprzętu komputerowego, RAM ma ogromne znaczenie, i nie inaczej jest przy wyborze najlepszych GPUs do uczenia maszynowego i DL. Ponieważ zbiory danych do trenowania modeli mogą być bardzo duże (w przypadku deep learningu nawet kilka TB), najlepsze GPUs powinny dysponować odpowiednią ilością VRAM, by zapewnić szybki dostęp do danych. Modele deep learningowe potrzebują znacznej ilości pamięci do przechowywania wag, aktywacji i innych danych pośrednich podczas treningu i inferencji. Ważna jest też przepustowość pamięci, która umożliwia sprawne przesyłanie dużych zbiorów danych i przyspiesza obliczenia.

Istotnym kryterium wyboru najlepszych GPUs do deep learningu jest też standard pamięci. Karty graficzne korzystają zazwyczaj z pamięci GDDR (Graphics Double Data Rate) lub HBM (High Bandwidth Memory). GDDR oferuje wysoką przepustowość przydatną m.in. w uczeniu maszynowym i grach, jednak najlepsze GPUs do ML stosują pamięć HBM, która zapewnia znacznie wyższą przepustowość przy lepszej efektywności energetycznej.

| Typ GPU | Pojemność VRAM | Przepustowość pamięci | Pamięć Standardowa | Najlepsze dla |

| Klasa wejściowa (np. RTX 3060, RTX 4060) | 8GB – 12GB | ~200-300 GB/s | GDDR6 | Małe modele, klasyfikacja obrazów, projekty hobbystyczne |

| Klasa średnia (np. RTX 3090, RTX 4090) | 24GB | ~1000 GB/s | GDDR6X | Duże zbiory danych, głębokie sieci neuronowe, transformery |

| Wysokiej klasy GPUs do AI (np. Nvidia A100, H100, AMD MI300X) | 40GB – 80GB | ~1600+ GB/s | HBM2 | Duże modele językowe (LLMs), badania AI, ML na poziomie korporacyjnym |

| Najwyższa klasa GPUs (np. Nvidia H100, AMD Instinct MI300X) | 80GB – 256GB | ~2000+ GB/s | HBM3 | Trenowanie AI na dużą skalę, superkomputery, badania na ogromnych zbiorach danych |

Dla tych, którzy pracują konkretnie nad dużymi modelami językowymi, takimi jak ChatGPT, Cloudzy oferuje VPS zoptymalizowany pod ChatGPT rozwiązanie z mocą niezbędną do płynnego fine-tuningu i inferencji.

TFLOPS (Teraflopsy) i Precyzja Zmiennoprzecinkowa

Wydajność GPU mierzy się przede wszystkim mocą obliczeniową, która zależy od trzech czynników: TFLOPS, przepustowości pamięci i precyzji zmiennoprzecinkowej. Przepustowość pamięci omówiliśmy już w kontekście najlepszych GPUs do trenowania AI. Wyjaśnijmy więc pozostałe dwa. TFLOPS, czyli teraflopy, to jednostka mierząca szybkość, z jaką GPU wykonuje złożone obliczenia. W przeciwieństwie do taktowania procesora (liczba cykli na sekundę), TFLOPS pokazuje, ile bilionów operacji zmiennoprzecinkowych GPU może wykonać na sekundę. Krótko mówiąc, TFLOPS mówi ci, jak wydajna jest karta przy zadaniach wymagających intensywnych obliczeń matematycznych.

Precyzja zmiennoprzecinkowa wskazuje natomiast, jak dokładne obliczenia może utrzymywać model. Najlepsze GPUs do deep learningu obsługują wyższą precyzję (np. FP32), która zapewnia dokładniejsze wyniki, lecz kosztem wydajności. Niższa precyzja (np. FP16) przyspiesza przetwarzanie przy nieznacznie zmniejszonej dokładności, co w zadaniach AI i deep learningu jest zazwyczaj akceptowalne.

Zacznij blogowanie

Zacznij blogowanie

Hostuj WordPress na wysokiej jakości sprzęcie z pamięcią masową NVMe i minimalnym opóźnieniem na całym świecie. Wybierz swój ulubiony system.

Pobierz WordPress VPS| Dokładność | Przypadek użycia | Przykładowe Aplikacje |

| FP32 (Pojedyncza Precyzja) | Trenowanie modeli deep learningowych | Rozpoznawanie obrazów (ResNet, VGG) |

| TF32 (TensorFloat-32) | Trenowanie z mieszaną precyzją | NLP, systemy rekomendacji |

| FP16 (Półprecyzja) | Szybka wnioskowanie | Autonomiczna jazda, rozpoznawanie mowy, poprawa jakości wideo z użyciem AI |

Zamiast inwestować duże środki we własny sprzęt, możesz natychmiast uzyskać dostęp do Głębokie uczenie na Cloudzy GPU VPS, zasilane przez RTX 4090s, zoptymalizowane pod kątem zadań z zakresu uczenia maszynowego i głębokiego uczenia.

Najlepsze GPU do Machine Learning w 2025 roku

Teraz, gdy wiesz już, czego szukać w najlepszych GPUach do uczenia maszynowego, oto nasza lista — uszeregowana według wydajności obliczeniowej, przepustowości pamięci, VRAM i innych parametrów.

| GPU | VRAM | Przepustowość pamięci | Pamięć Standardowa | TFLOPS | Precyzja zmiennoprzecinkowa | Zgodność |

| NVIDIA H100 NVL | 188 GB | 7.8 TB/s | HBM3 | 3,958 | FP64, FP32, FP16 | CUDA, TensorFlow |

| NVIDIA A100 Tensor Core | 80 GB | 2 TB/s | HBM2 | 1,979 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| NVIDIA RTX 4090 | 24 GB | 1.008 TB/s | GDDR6X | 82.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX A6000 Tensor Core | 48 GB | 768 GB/s | GDDR6 | 40 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| NVIDIA GeForce RTX 4070 | 12 GB | 504 GB/s | GDDR6X | 35.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX 3090 Ti | 24 GB | 1.008 TB/s | GDDR6X | 40 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| AMD Radeon Instinct MI300 | 128 GB | 1.6 TB/s | HBM3 | 60 | FP64, FP32, FP16 | ROCm, TensorFlow |

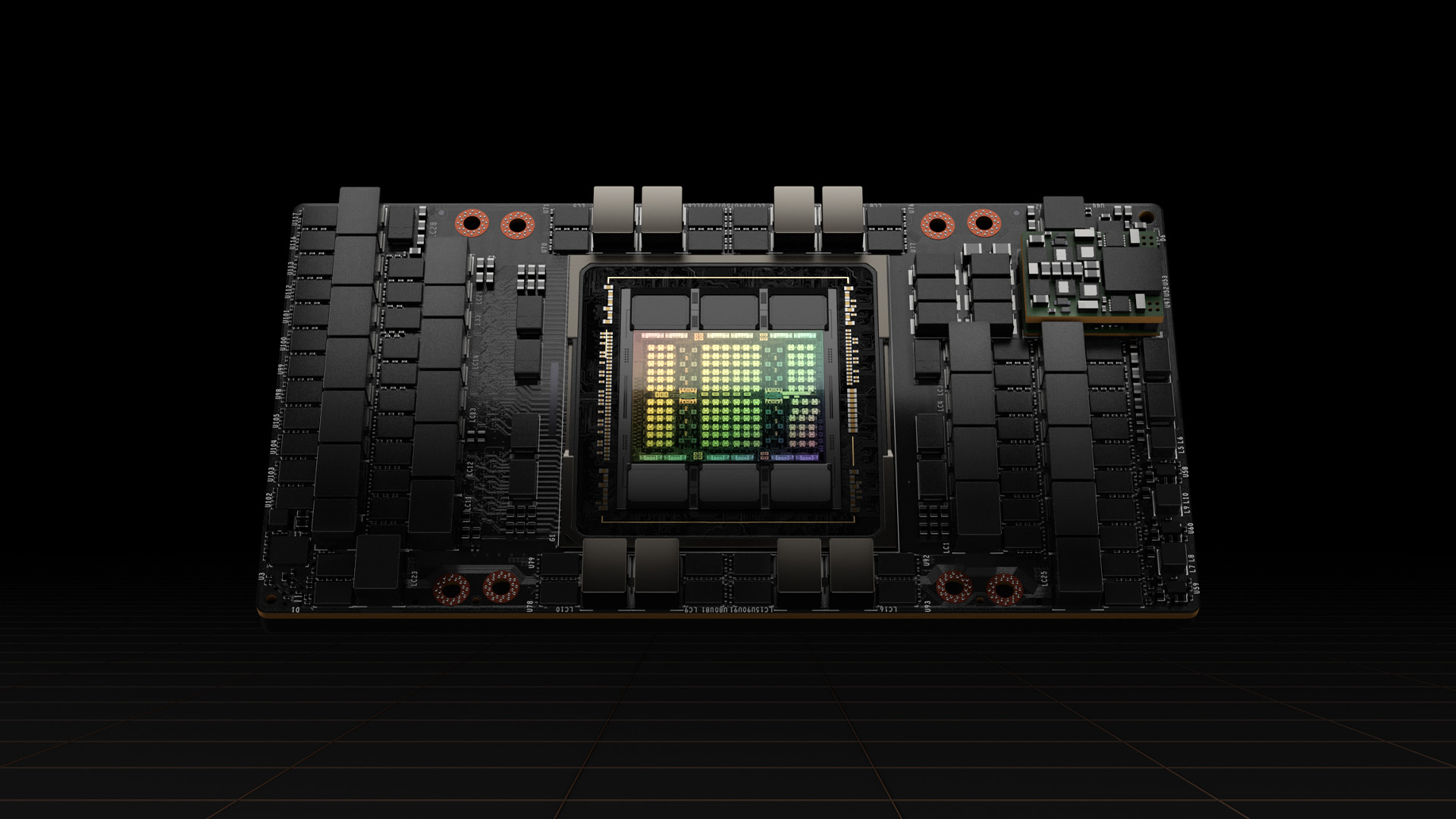

NVIDIA H100 NVL

Najlepszy GPU do uczenia maszynowego, H100 NVL, zapewnia wyjątkową wydajność przy głębokim uczeniu na dużą skalę. Zoptymalizowany pod kątem środowisk wielodostępnych i wymagających obliczeniowo zadań.

- Najlepsze dla: Zaawansowane badania nad AI, trening modeli na dużą skalę i wnioskowanie.

- Wada: Bardzo wysoki koszt — przeznaczony głównie dla środowisk korporacyjnych lub badawczych.

NVIDIA A100 Tensor Core GPU

A100 oferuje ogromną moc obliczeniową dla sieci neuronowych dzięki 80 GB pamięci o wysokiej przepustowości (HBM2) — odpowiedni do najbardziej wymagających zadań.

- Najlepsze dla: Duże modele uczenia maszynowego, badania nad AI i aplikacje chmurowe.

- Wada: Wysoki koszt — skierowany głównie do firm i dużych organizacji.

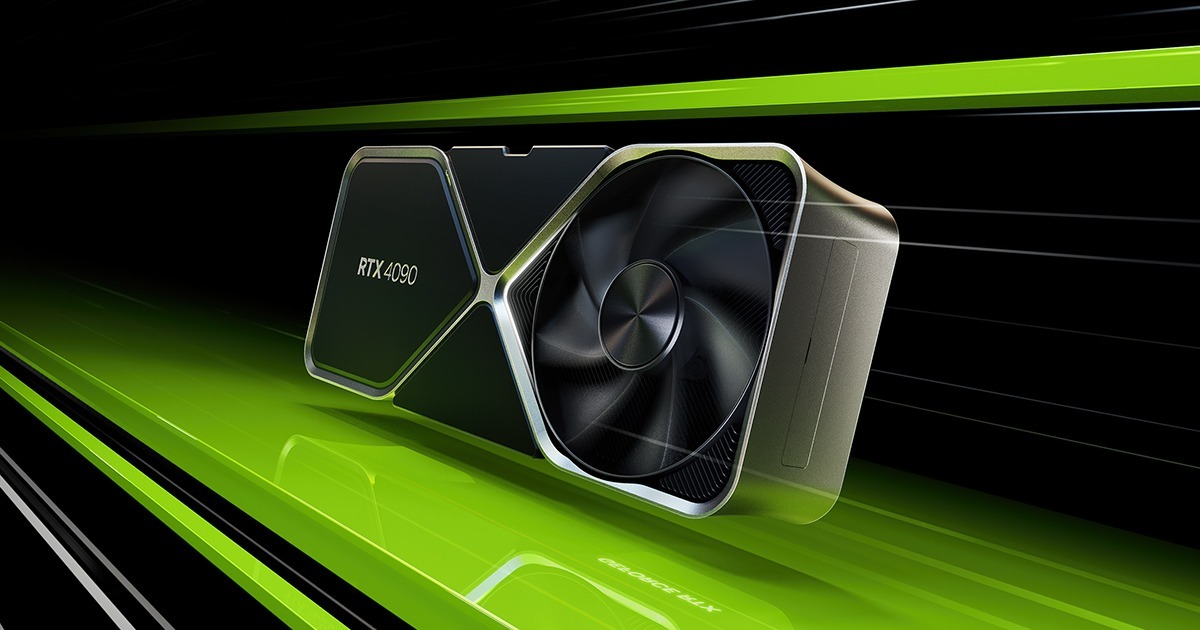

NVIDIA RTX 4090

Doskonały zarówno do gier, jak i zadań AI. Wyposażony w 24 GB pamięci GDDR6X i dużą zdolność do przetwarzania równoległego.

- Najlepsze dla: Zaawansowane zadania ML i badania nad AI wymagające dużej mocy obliczeniowej.

- Wada: Wysokie zużycie energii, wysoki koszt i duże wymiary.

NVIDIA RTX A6000 Tensor Core GPU

Obsługuje aplikacje AI dzięki 48 GB pamięci GDDR6 — dobrze dopasowany do stacji roboczych i profesjonalnych twórców.

- Najlepsze dla: Badania nad AI, głębokie uczenie i wymagające obliczeniowo zadania.

- Wada: Wysoki koszt — typowo przeznaczony dla środowisk profesjonalnych.

NVIDIA GeForce RTX 4070

Goodny stosunek ceny do wydajności z mocnymi możliwościami ray tracingu i 12 GB pamięci GDDR6X

- Najlepsze dla: Entuzjaści i mniejsze firmy o średnich potrzebach w zakresie uczenia maszynowego.

- Wada: Ograniczona VRAM dla większych zbiorów danych i bardzo dużych modeli.

NVIDIA RTX 3090 Ti

NVIDIA RTX 3090 TiDuża pojemność pamięci (24 GB GDDR6X) i wysoka moc obliczeniowa — idealna do trenowania modeli średniej i dużej wielkości.

- Najlepsze dla: Entuzjaści i zastosowania badawcze wymagające wydajnego przetwarzania AI.

- Wada: Wysoki koszt, duże zużycie energii i często zbyt duża wydajność jak na mniejsze projekty.

AMD Radeon Instinct MI300

Dobry wybór do zadań AI i HPC, z konkurencyjną wydajnością.

- Najlepsze dla: Obciążenia uczenia maszynowego w konfiguracjach opartych na AMD.

- Wada: Mniej ugruntowana pozycja w deep learningu niż NVIDIA, mniejsza liczba obsługiwanych frameworków.

Chmurowe GPU VPS od Cloudzy

Jednym z najlepszych GPU do uczenia maszynowego dostępnych dziś jest bez wątpienia RTX 4090. Jest jednak drogi, znacząco podnosi rachunki za prąd, a jego rozmiar może zmusić do wymiany obudowy komputera lub przebudowy całego zestawu. To mnóstwo problemów - właśnie dlatego w Cloudzy oferujemy teraz GPU online do uczenia maszynowego, żebyś nie musiał martwić się żadnym z tych zagadnień. Nasz GPU VPS jest wyposażony w do 2 GPU Nvidia RTX 4090, 4 TB pamięci masowej NVMe SSD, przepustowość 25 TB na sekundę i 48 vCPU!

Wszystko w przystępnych cenach z rozliczeniem godzinowym i miesięcznym w modelu płatności za użycie, a także szeroką gamą metod płatności: PayPal, Alipay, karty kredytowe (przez Stripe), PerfectMoney, Bitcoin i inne kryptowaluty.

Na koniec: w najgorszym przypadku, jeśli nie będziesz zadowolony z naszej usługi, oferujemy 14-dniową gwarancję zwrotu pieniędzy.

Platformy chmury Rzeczywistości Rozszerzonej (AR) w dużej mierze opierają się na wydajnych GPU do dostarczania doświadczeń w czasie rzeczywistym. Podobnie jak GPU z rdzeniami CUDA i Tensor są kluczowe przy trenowaniu modeli deep learningowych, są one równie ważne przy renderowaniu złożonych środowisk AR i obsłudze funkcji opartych na AI, takich jak rozpoznawanie obiektów i mapowanie przestrzenne. W Cloudzy nasze AR Cloud wykorzystują zaawansowaną technologię GPU, zapewniając wysoką wydajność, niskie opóźnienia i elastyczność - co czyni je idealnym wyborem dla firm wdrażających aplikacje AR na dużą skalę.

Niezależnie od tego, czy tworzysz aplikacje AI, trenujesz modele, czy prowadzisz badania, nasze Rozwiązania AI VPS są zaprojektowane tak, aby zapewniać najwyższą wydajność GPU w ułamku standardowego kosztu.

Ostateczne Przemyślenia

Wraz z rosnącym zapotrzebowaniem na moc obliczeniową i coraz większymi oraz bardziej złożonymi modelami AI, GPU z pewnością staną się integralną częścią naszego życia. Warto więc zapoznać się z ich działaniem i zrozumieć, czym są.

Dlatego gorąco polecam zajrzeć do Tim Dettmers- artykułu o wszystkim, co warto wiedzieć o GPU, wraz z praktycznymi wskazówkami dotyczącymi wyboru GPU. Autor jest zarówno naukowo wyróżniony, jak i doskonale obeznany z deep learningiem.