Pokud se rozhodujete H100 versus RTX 4090 Pro AI platí, že většina „benchmarků" nehraje roli, dokud se váš model a cache skutečně nevejdou do VRAM. RTX 4090 je ideální volbou pro práci na jednom GPU, která se vejde do 24 GB.

H100 je volba, když potřebujete větší modely, vyšší souběžnost, izolaci více uživatelů nebo chcete strávit méně času laděním paměti.

Rozeberu vám to podle typu zatížení, ukážu vám, jaké benchmarky existují, a pak vám dám rychlý plán testů, které si můžete spustit na své infrastruktuře.

Rychlý přehled: H100 vs RTX 4090 pro AI úlohy

H100 vyniká při trénování velkých modelů a jejich nasazování, protože nabízí velké HBM paměť, velmi vysokou šířku pásma paměti, NVLink a MIG pro izolaci. RTX 4090 je lepší pro "Potřebuji výborný výkon jednoho GPU za lepší cenu" pokud se váš workload vejde do 24 GB bez neustálých kompromisů. Specifikace a funkcionalita platformy jsou v tom poměrně jasné.

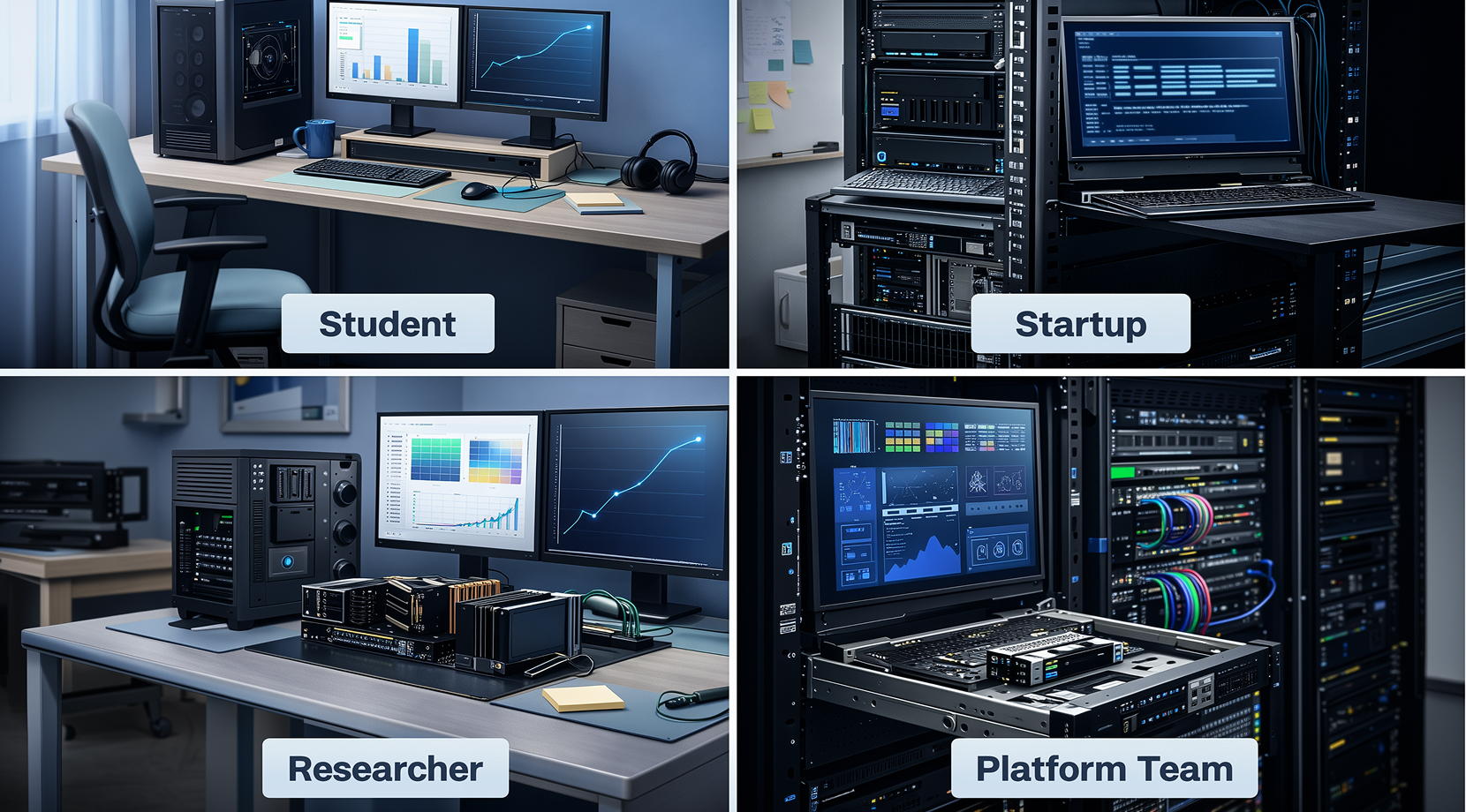

Tady je rychlý seznam podle typu uživatele:

- Lokální vývojář LLM (samotný vývojář / student): RTX 4090 dokud se VRAM nestane úzkým místem.

- ML inženýr ve startupu (vývoj MVP): RTX 4090 pro počáteční nasazování a ladění modelů, H100 jakmile potřebujete stabilní souběžnost nebo větší modely.

- Prováděcí výzkumný pracovník (spoustu experimentů): H100 pokud neustále narazíte na OOM, limity dávek nebo dlouhé kontexty.

- Produkční / platformní tým (pronajímání více tenantů): H100 pro dělení MIG, větší rezervu a plynulejší škálování.

S tímto rámcem se zbytek tohoto článku zabývá limity, se kterými se lidé setkávají v praxi, a tím, jak se benchmarkové výsledky shodují s realitou.

Jediná benchmark otázka, kterou stojí za to zvážit: Co se musí vejít do VRAM?

Většina diskusí o H100 versus RTX 4090 jsou technicky argumenty o VRAM. Při LLM práci se VRAM zabírá váhy, aktivace během tréninku, stavy optimizéru během trénování a KV mezipaměť během inference. Ta poslední je ta, kterou lidé obvykle nečekají, protože roste s délkou kontextu a souběžností.

Tabulka níže je záměrně vysokoúrovňová, protože přesné rozdělení závisí na framework, přesnosti a overheadu.

Tady je pohled "vejde se to bez problémů?":

| Pracovní zatížení | Typická realita jednoho GPU na RTX 4090 (24 GB) | Typická realita jednoho GPU na H100 (80–94 GB) |

| Inference modelu LLM o velikosti 7B (FP16 / BF16) | Obvykle v pořádku | Pohodlný prostor |

| Inference modelu LLM o velikosti 13B | Často těsné, závisí na kontextu | Obvykle v pořádku |

| Inference v třídě 70B | Vyžaduje silnou kvantizaci/offload | Mnohem reálističtější |

| SD/SDXL inference + malé dávky | Obvykle v pořádku | Dostačující, plus více prostoru pro dávkové zpracování |

| Obsluha s vyšší souběžností | Tlak KV cache se zobrazuje rychle | Více místa, větší stabilita pod zátěží |

Pokud chcete širší seznam GPU (ne jen tyto dva), podívejte se na náš Nejlepší GPU pro strojové učení v roce 2025 je praktická referenční tabulka pro VRAM a šířku pásma paměti napříč běžnými AI GPU.

Jakmile víte, že vaše zatížení vyhovuje, dál už záleží hlavně na šířce pásma paměti, která určuje, jak plynule se všechno chová.

Šířka pásma: Proč se HBM chová jinak

Velká část diskuzí o výkonu AI se točí kolem výpočetních špiček, ale transformery jsou extrémně citlivé na přenosy dat v paměti. Výhoda H100 spočívá v kombinaci velkých HBM zásobníků s velmi vysokou paměťovou propustností, doplněnou o NVLink propustnost a MIG dělení na straně platformy.

Přehled specifikací

Specifikace vám GPU nezvolí automaticky, ale vysvětlují, proč stejná úloha na jedné kartě funguje snadno a na druhé je těsná. Tento přehled ukazuje, co nejvíc ovlivňuje chování LLM při trénování, inferencí a servírování.

| Specifikace | H100 (SXM / NVL) | RTX 4090 |

| VRAM | 80 GB / 94 GB | 24 GB |

| Propustnost paměti | 3,35–3,9 TB/s | GDDR6X (kapacita omezena na 24 GB) |

| Mezipropojeníí | NVLink + PCIe Gen5 | PCIe (spotřebitelská platforma) |

| Vícenásobná instance | Až 7 instancí MIG | Není k dispozici |

Spec reference: NVIDIA H100, NVIDIA RTX 4090.

Co to znamená v praxi:

- Když zvyšujete velikost dávky nebo délku kontextu, H100 zůstává stabilní déle, než se dostanete do situace, kdy musíte dělat kompromisy.

- Pokud zpracováváte mnoho požadavků najednou, H100 vám dává více prostoru pro paměť, takže se nesetkáte s nestabilní latencí v ocasech tak rychle.

- Pokud váš projekt běží především na jednoho uživatele, jednoho modelu a pracuje s menším kontextem, RTX 4090 vám bude připadat rychlá a stačí vám.

Šířka pásma ale nestojí za dobrý benchmark. Vysvětluje jen, proč si dva GPU mohou být podobní v úzkém testu, aby se pak v reálném zatížení lišili.

Spolehlivé porovnání výkonu H100 vs RTX 4090

Benchmarky nejsou všechny stejné, a proto se neustále stává, že "moje čísla neodpovídají tvým". Proto H100 versus RTX 4090, je užitečné rozdělit benchmark na dvě varianty:

- Lane A (komunita na první místě): llama.cpp-style tokens/sec tests and simple inference scripts.

- Linka B (standardizované sady): Výsledky v souladu s MLPerf Training a MLPerf Inference, které se zaměřují na opakovatelná pravidla.

Snímek inferenční analýzy ve stylu Llama.cpp

Tímto testem si lidé experimentují doma a pak o něm tři dny hádají. Je užitečný, protože odráží řetězec nástrojů, který používá mnoho vývojářů, ale snadno se dá špatně interpretovat, když ignorujete kontext a přesnost.

Veřejná srovnění ve stylu llama.cpp RTX 4090 vypadá velmi dobře na menších modelech a kvantovaných spuštěních, zatímco velké modely s vyšší přesností snadno překročí limit VRAM.

Zde je vzor, který byste měli očekávat:

| Model | GPU | Typický výsledek |

| třída 7B | RTX 4090 | Vysoký počet tokenů za sekundu, plynulá inference pro jednoho uživatele |

| Třída 13B | RTX 4090 | Stále dobré, ale kontext a overhead začínají hrát roli |

| třída 70B | RTX 4090 | Bez agresivní kvantizace nebo offloadingu se to nevejde čistě |

| třída 70B | H100 | Mnohem realističtější ponechat v paměti a provozovat spolehlivě |

Smyslem tabulky není "4090 je špatná" nebo "H100 je magic". Jde o to, že limit VRAM určuje, kolik můžete ponechat v paměti, a to ovlivňuje rychlost, stabilitu a množství seřizování, které budete dělat.

Pokud neustále zkracujete délku kontextu jen abyste přežili, v tu chvíli se toto srovnání přestává být teoretické.

Co přidává MLPerf oproti benchmarkům na fórech

MLPerf existuje proto, že "náhodné skripty a dohadování" nefunguje, jakmile se rozhodujete o nákupu za tisíce dolarů. MLCommons přidal novější generativní AI workloady postupem času a MLPerf je navržen tak, aby byly výsledky lépe srovnatelné mezi systémy.

Na straně trénování zpráva NVIDIA MLPerf Training v5.1 je dobrým příkladem, jak prodejci hlásí čas na trénování s detaily o prostředí podání a pravidlech benchmarku, která dodržují.

Tato oblast vám neřekne, jak se vaše soukromé prompty chovají, ale je to kontrola rozumnosti pro škálování na úrovni systému a "jak si tato třída hardwaru vede podle pravidel".

Teď si pojďme pohovořit o částí, která nejvíce ovlivňuje nákupy, a tou je čas a peníze strávené na dokončení práce.

Náklady, čas a oportunitní náklady

Hodně H100 versus RTX 4090 rozhodnutí se často rámují jako "nákupní cena vs cena pronájmu". To je zřídka správný rámec. Lepší rámec je: kolik hodin vám trvá vytvořit model, který můžete skutečně používat, a kolik času ztrácíte bojem s omezeními?

Tři běžné scénáře ukazují kompromisy velmi jasně.

Týdenní doladění na malých až středně velkých modelech

Pokud vaše spuštění zůstanete v 24 GB bez neustálých kompromisů, cesta s 4090 se zdá skvělá. Iterujete rychle, nepotřebujete plánovat čas na clusteru a vaše nastavení je jednoduché. Pokud se každé spuštění obrátí na "snížit batch, zkrátit kontext, zkusit znovu", H100 je mnohem rozumnější volba, navzdory vyšším nákladům.

Skutečná souběžnost na vysoké úrovni

Souběžnost rychle zvyšuje tlak na KV cache. Tady se hodí rezerva výkonu H100 a možnosti nastavení platformy, zvlášť když potřebujete předvídatelnou latenci.

Pokud si nejste jistí, zda je server GPU vůbec správný pro vaše nasazení, náš GPU VPS vs. CPU VPS přehled vám pomůže namapovat zátěž na správný typ infrastruktury, než strávíte čas optimalizací věci, která to nezaslouží.

Větší trénovací úlohy s termíny

Jakmile překročíte fázi jednoho člověka a jednoho serveru, chcete se soustředit na věci, které se opravdu počítají: stabilní prostředí, méně chyb, méně času straveného hlídáním infrastruktury. To je přesně to, na co je H100 navržen.

Pokud si nejste jistí ani po této sekci, dalším krokem není další čtení. Podívejte se, jak se vaše zásobník chová v praxi, včetně kompatibility ovladačů a víceúživatelských zátěží.

Software a provoz: ovladače, stabilita, víceúživatelské prostředí a podpora

To je část, kterou graf srovnávajících benchmarků obvykle přeskakuje, ale je to velká část každodenního provozu.

RTX 4090 je oblíbená, protože je přístupná a rychlá pro řadu úloh AI. Kompromis je ten, že když vaše potřeby rostou, spíše narazíte na omezení paměti a omezení škálování, která nejsou navržena pro sdílená, víceklientská prostředí.

H100 je stavěna pro clustery. MIG je velkým přínosem pro platformní týmy, protože vám umožní rozdělit jeden GPU na izolované části, čímž snížíte problémy s "hlučnými sousedy" a zjednodušíte plánování kapacity. Oficiální specifikace H100 od NVIDIA uvádí až 7 instancí MIG v závislosti na formátu.

Pokud je vaše zátěž osobní a lokální, můžete s řadou 4090 fungovat dlouhodobě. Pokud je vaše zátěž víceúživatelská a určená zákazníkům, H100 je bezpečnější cesta.

Takže, v souhrnu, kdo by měl koupit co?

Kterou byste měli vybrat pro vaši zátěž

Pro H100 versus RTX 4090, správná volba je nakonec ta, která vám odstraní největší překážky.

Lokální tvůrce s LLM (samostatný vývojář / student)

Vyberte si RTX 4090, pokud pracujete převážně v rozsahu 7B–13B, spouštíte kvantizované odvozování, experimentujete s RAG nebo pracujete na SDXL. Přejděte na vyšší model, až budete trávit více času řešením paměti než budováním toho, co jste si původně vytyčili.

Startup ML inženýr (nasazování MVP)

Pokud je vaše MVP jeden model s mírným provozem a pohodlně se vejde, 4090 je skvělý začátek. Pokud potřebujete stabilní latenci při špičkách, vyšší souběžnost nebo více zátěží na jeden host, H100 je klidnější volba.

Aplikovaný výzkumný pracovník (spoustu experimentů)

Pokud jste často nuceni dělat kompromisy, jako zmenšení velikosti dávky nebo řešit problémy s přesností, H100 vám umožní čistší experimenty a méně neúspěšných pokusů.

Produkční tým / platformní tým (vícetenantní obsluha)

H100 je jednoznačná volba, především proto, že MIG a vyšší rezerva výkonu zjednodušují plánování kapacity a v podstatě omezují rozsah dopadů při náhlém nárůstu.

Pokud stále nechcete kupovat hardware, pronájem je nejlepší další krok.

Praktická střední cesta: Nejdřív si pronajměte GPU, potom se rozhodněte

Nejčistší způsob, jak si být jistý H100 versus RTX 4090 je spuštění tvůj model, tvůj příkazy a tvůj délku kontextu na obou třídách hardwaru, pak porovnejte tokeny za sekundu a latenci chvostu pod zátěží.

Proto jsme vytvořili Cloudzy GPU VPS, protože si můžete obstarat server GPU za méně než minutu, nainstalovat si svůj stack s plným přístupem root a nemusíte se spoléhat na benchmark od někoho jiného.

Co dostanete s našimi plány GPU a VPS:

- Dedikované GPU NVIDIA GPU (včetně možností třídy RTX 4090 a A100), aby se vaše výsledky neposunuly kvůli rušným sousedům.

- Síťování až 40 Gbps na všech plánech GPU, což je důležité při stahování datasetů, workflow na více uzlech a rychlém přesunu artefaktů.

- NVMe SSD úložiště, plus DDR5 RAM a vysokofrekvenční možnosti CPU na všech úrovních, aby zbytek serveru nebrzdil GPU.

- DDoS ochrana a 99,95% dostupnost, aby dlouhé úlohy nezemřely náhodným internetovým šumem.

- Hodinová fakturace (praktické pro krátké benchmarkové sprouty) a 14denní záruka vrácení peněz pro testování bez rizika.

Spusťte stejný benchmark nejdřív na plánu RTX 4090, pak jej zopakujte na plánu třídy A100, až budete pracovat s většími kontexty, vyšší souběžností nebo většími modely. Po té se volba mezi H100 versus RTX 4090 obvykle vyjasní z vašich vlastních logů.

Benchmark checklist: Spusťte si ho za 30 minut

Pokud chcete rozhodnutí, které si můžete obhájit, sesbírejte čtyři čísla ze stacku, který opravdu budete nasazovat:

- Tokeny/sec na vaší cílové délce kontextu

- latence p95 na vaší očekávané souběžnosti

- Volný VRAM během vrcholové fáze

- Náklady na jeden dokončený běh od startu do artefaktu

Minimální zkušební test s vLLM vypadá takto:

pip install vllm transformers accelerate

python -m vllm.entrypoints.api_server \

--model meta-llama/Llama-3-8B-Instruct \

--dtype float16 \

--max-model-len 8192Pokud chcete vědět, co si opravdu pronajímáte, náš příspěvek Co je GPU VPS? vysvětluje rozdíl mezi dedikovaným přístupem GPU, sdílením vGPU a tím, co si ověřit před výběrem plánu.