Pokud si chcete pořídit nový GPU, abyste se zbavili chyb nedostatku paměti, spor 5070 Ti vs 5080 vás nevyřeší. Obě karty mají 16 GB VRAM a toto kapacitní omezení se v hlubokém učení projeví dříve, než většina lidí čeká.

5080 je rychlejší, ale jen zřídka vám umožní provozovat výrazně větší model. V praxi stejně skončíte u zmenšování velikosti dávky, zkracování délky kontextu nebo přesouvání dat do systémové RAM jen proto, aby běh vůbec dokončil.

Proto je tento článek věcným a realistickým pohledem na 5070 Ti vs 5080 pro hluboké učení, doplněným o přehled možností, které vám vyhovují, pokud chcete modely trénovat, dolaďovat nebo nasazovat bez neustálých omezení VRAM.

Pokud si přečtete jen dvě části, přečtěte si sekci se specifikacemi a sekci "kapacita vs rychlost" - právě ty vám zabrání koupit špatnou věc.

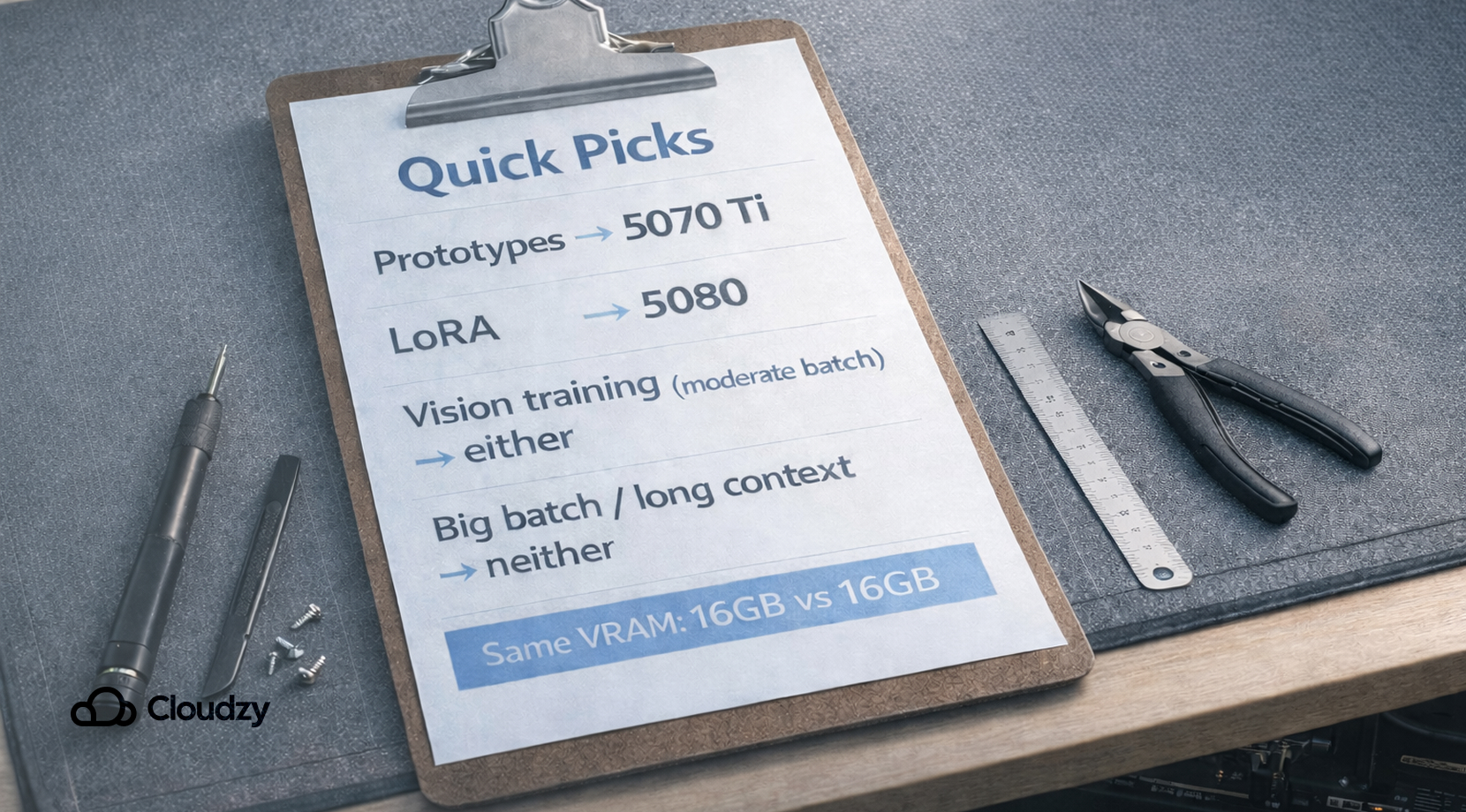

Rychlý přehled podle vašeho použití

Většina lidí si GPUs nekupuje jen tak od boku. Opakovaně vídáme čtyři typy kupujících a srovnání 5070 Ti vs 5080 každý z nich vnímá jinak.

Domácí bastlíř s LLM

Spouštíš notebooky, ladíš nastavení kvantizace a důležitější než maximální propustnost je, aby to prostě běželo. U tebe rozhoduje ve srovnání 5070 Ti vs 5080 většinou rozpočet – na malých modelech a kvantizovaném inferencu se obě karty chovají podobně a obě narazí na stejný strop VRAM, jakmile zvýšíš délku kontextu nebo velikost dávky.

Doktorand trénující modely počítačového vidění

Potřebuješ opakovatelné experimenty, ne nekonečné opakování. Skrytá cena není karta samotná, ale čas, který ztratíš, když běh selže ve třetí epoše, protože dataloader, augmentace a model všichni soupeří o paměť.

Startup inženýr nasazující inference

Záleží ti na tail latency a souběžnosti. Jednouživatelská ukázka může na 16 GB vypadat skvěle, pak přijde produkční provoz a tlak KV cache ti VRAM pomalu sežere. Pro serving může být srovnání 5070 Ti vs 5080 vedlejší téma, pokud tvůj skutečný problém je kapacita pro dávkování a dlouhé prompty.

Kreativec, který dělá i ML

Přeskakuješ mezi kreativními aplikacemi a ML nástroji a nesnášíš restarty, problémy s ovladači a hlášky "zavři Chrome, aby šlo trénovat". Pro tebe má srovnání 5070 Ti vs 5080 smysl jen tehdy, pokud je GPU součástí funkčního workflow, ne křehké pracovní stanice, která se rozpadne, jakmile začneš multitaskovat.

S těmito případy v paměti se podíváme na konkrétní hardware a na to, proč je omezující faktor ve všech důležitých situacích stejný.

Nejdůležitější parametry pro deep learning

Nejrychlejší způsob, jak pochopit srovnání 5070 Ti vs 5080, je ignorovat marketingová čísla a soustředit se na paměťový řádek.

Pokud chceš kompletní přehled specifikací, tady je podrobná tabulka zaměřená na to, co nejvíce ovlivňuje chování při trénování a inferencu. (Taktovací frekvence a výstupy displeje zaujmou, ale nerozhodují o tom, jestli tvůj běh do paměti vejde.)

| Specifikace (Desktop) | RTX 5070 Ti | RTX 5080 | Proč se zobrazuje v DL |

| VRAM | 16 GB | 16 GB | Kapacita je pevnou hranicí pro váhy, aktivace a KV cache |

| Typ paměti | GDDR7 | GDDR7 | Podobné chování – šířka pásma pomáhá, ale kapacita rozhoduje o tom, jestli se vše vejde, nebo ne |

| Paměťová sběrnice | 256bitový | 256bitový | Omezuje souhrnnou šířku pásma; pomáhá propustnosti, ne velikosti modelu |

| CUDA jádra | 8,960 | 10,752 | Více výpočetního výkonu zvyšuje počet tokenů za sekundu, ne to, jestli model vůbec načteš |

| Typický příkon desky | 300 W | 360 W | Více tepla a nároků na zdroj, žádná extra VRAM |

Oficiální zdroje specifikací: RTX 5080, RTX 5070 rodina

Jednoduše řečeno: 5080 je rychlejší karta, 5070 Ti je levnější. V deep learningu se rozdíl projevuje hlavně tehdy, když se tvá zátěž do paměti vejde.

Dále se podíváme na to, proč VRAM mizí tak rychle, i na sestavách, které na papíře vypadají nenáročně.

Proč deep learning VRAM tak rychle pohltí

Lidé přicházející z gamingu si VRAM často představují jako pool textur. V deep learningu je to spíš jako stísněná kuchyňská linka. Nepotřebuješ jen místo pro suroviny, potřebuješ místo na krájení, vaření i servírování – všechno najednou.

Co typicky zabírá VRAM během běhu:

- Váhy modelu: parametry modelu, někdy ve formátu FP16/BF16, někdy kvantizované.

- Aktivace: mezilehlé tenzory ukládané pro zpětné šíření, obvykle největší žrout paměti při trénování.

- Gradienty a stav optimizéru: režie trénování, která může násobit nároky na paměť.

- KV mezipaměť: režie inference, která roste s délkou kontextu a souběžností.

Proto srovnání 5070 Ti vs 5080 občas připomíná hádku o výkonu motoru, když táhnete přívěs s příliš velkou hmotností. Více koní pod kapotou nezachrání situaci, když táhná spojka není na takovou zátěž stavěná.

Rychlý způsob, jak to ověřit - používáme ho i při vlastním testování - je logovat alokovanou i rezervovanou paměť v PyTorch. Poznámky PyTorch ke CUDA paměti vysvětlují, jak funguje caching alokátor a proč nástroje jako nvidia-smi mohou paměť zobrazovat jako "použitou" i po uvolnění tenzorů.

To nás přivádí k hlavnímu bodu: většina selhání hlubokého učení na 16 GB není způsobena pomalostí jako takovou, ale tím, že vám OOM nastane v nejhorší možnou chvíli.

První úlohy, které odhalí rozdíl 5070 Ti vs 5080

Níže jsou vzory hlubokého učení, které narážejí na limity paměti jako první - při srovnání 5070 Ti vs 5080.

Provoz LLM s dlouhými prompty a skutečnou souběžností

Jediný prompt o 2K tokenech může vypadat v pořádku. Přidejte delší kontext, dávkování a druhého uživatele a KV cache začne rychle růst. V tu chvíli se rozdíl 5070 Ti vs 5080 stírá - výsledek je stejný: omezíte maximální kontext nebo snížíte velikost dávky, abyste vůbec přežili.

Jednoduchá metoda ověření:

- Spusťte server s maximálním kontextem a dávkou, jaké reálně používáte.

- Sledujte VRAM průběžně, nejen při startu.

- Zaznamenejte okamžik, kdy skokově vzroste latence, a ve stejném časovém okně zkontrolujte využití paměti.

Pokud chcete spolehlivé monitorovací řešení, které se samo nestane dalším projektem, náš průvodce na téma monitorovací software GPU popisuje praktické vzory CLI logování, které fungují dobře při reálných bězích.

Doladění pomocí LoRA nebo QLoRA

Spousta lidí říká, že "LoRA funguje na 16 GB", a nemají pravdu - ale past spočívá v tom, že zbytek pipeline považují za zadarmo. Tokenizační buffery, pracovníci dataloaderu, škálování smíšené přesnosti a validační kroky se mohou velmi rychle nakumulovat.

V praxi tu není bottleneck ve výpočtech, ale v rezervě. Pokud nemáte volnou VRAM, skončíte u hlídání tréninkových běhů.

Trénování vizuálních modelů s vysokým rozlišením vstupů

Modely pro zpracování obrazu mají záludný způsob selhání: malý nárůst rozlišení nebo přidání jedné augmentace vás může přepnout ze stabilního běhu přímo do OOM. Na 5070 Ti vs 5080 se to projeví tak, že velikost dávky klesne na 1 a gradient accumulation promění trénování v záběr ze zpomaleného záznamu.

Multimodální provoz na jednom GPU

Textový enkodér + obrazový enkodér + fúzní vrstvy mohou fungovat bez problémů – jakmile ale zvýšíte délku sekvence nebo přidáte větší vizuální backbone, spotřeba paměti rapidně roste.

Moje GPU je v pořádku, můj desktop není

Tohle je nejběžnější problém. Začneš trénovat, pak prohlížeč, IDE a další spuštěné aplikace začnou zabírat VRAM, a najednou je tvoje „stabilní" konfigurace rozbitá. Lidé na fórech stěžují si, že zavřeli všechno, vypnuli překryvy, a přesto dostávají OOM na stejném modelu, který včera běžel bez problémů.

Tento vzor se neustále opakuje v Diskuse o 5070 Ti vs 5080, a to proto, že obě karty narážejí na stejný kapacitní limit. Pokud vám to připadá povědomé, přirozeně vyvstává otázka: co s tím limitem dělat?

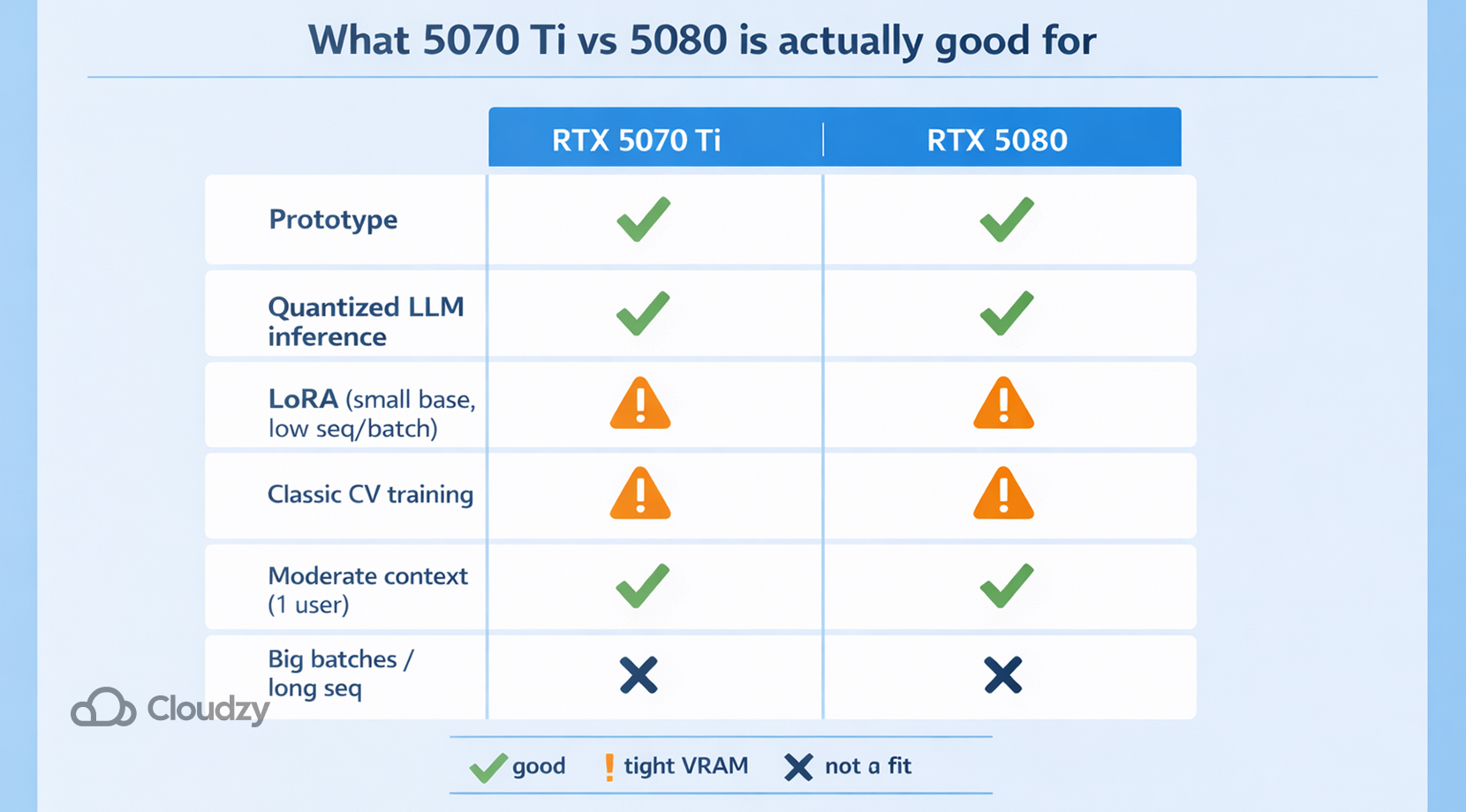

K čemu se hodí 5070 Ti vs 5080

V ML komunitě se na 16 GB snadno útočí, ale není to k ničemu. Jen má svoje limity.

5070 Ti vs 5080 je zcela vhodná volba pro:

- Prototypová práce: malé experimenty, rychlé ablace a základní ověření funkčnosti.

- Kvantizovaná inference LLM: menší modely s průměrnou délkou kontextu, jeden uživatel.

- LoRA na menších základních modelech: pokud udržíte délku sekvence a velikost dávky pod kontrolou.

- Klasické trénování vizuálních modelů: střední velikosti obrázků, střední páteřní sítě, více trpělivosti.

Podstata je v tom, že pokud vaše práce nepřekračuje limit paměti, 5080 bude většinou svižnější než 5070 Ti a oceníte i vyšší výpočetní výkon.

Jakmile se ale pustíte do „skutečného" hlubokého učení, narazíte na problémy s nedostatkem paměti. Pojďme si tedy probrat postupy, které pomohou u obou karet.

Jak naplno využít omezený VRAM a přitom nezničit trénink

Žádný z těchto triků není kouzlo. Jsou to prostě postupy, díky kterým zůstane srovnání 5070 Ti vs 5080 užitečné co nejdéle.

Začněte měřením

Než začneš ladit hyperparametry, zjisti maximální číslo VRAM na krok. V PyTorch, max_memory_allocated() a max_memory_reserved() jsou rychlé způsoby, jak zjistit, co váš běh skutečně dělá.

To vám pomůže odpovědět na otázky jako:

- Je hlavním nákladem samotný model, nebo aktivace?

- Skočí VRAM během validace?

- Roste fragmentace postupně v čase?

Jakmile máte základní linii, zbytek je méně náhodný.

Ušetřete paměť, kde to jde

Jednoduchý postup, který používáme:

- Snižte velikost dávky, dokud se vejde.

- Přidejte gradient accumulation, abyste obnovili efektivní velikost dávky.

- Zapněte mixed precision (BF16/FP16), pokud to váš stack podporuje.

- Přidejte gradient checkpointing, pokud dominují aktivace.

- Teprve pak začněte měnit velikost modelu.

Zacházejte s délkou kontextu jako s rozpočtem

U transformerů je délka kontextu to, co způsobí nejvíc problémů. Ovlivňuje výpočet attention a při inferenci také velikost KV cache. Na 5070 Ti vs 5080 to pocítíte v momentě, kdy přesáhnete pár tisíc tokenů: VRAM rychle vyskočí, propustnost klesne a vy najednou snižujete velikost dávky jen proto, abyste udrželi provoz.

Doporučený přístup:

- Zvolte výchozí maximální délku kontextu, se kterou máte dostatečnou rezervu.

- Vytvořte druhý profil pro "dlouhý kontext" s nižší velikostí dávky.

- Při ladění tyto dva profily nemíchejte.

Nezaměňujte PyTorch cache s reálnými úniky paměti

Spousta hlášení o "únicích paměti" jsou ve skutečnosti jen chování alokátoru. Dokumentace PyTorch uvádí, že caching alokátor může držet paměť rezervovanou i po uvolnění tensorů a empty_cache() většinou vrací nevyužité bloky cache jiným aplikacím, ne zpět do PyTorch.

To je důležité, protože uživatelé 5070 Ti vs 5080 se často zaměstnají hledáním zdánlivých úniků místo těch skutečných, kterými jsou velikost dávky, délka sekvence a paměť aktivací.

Tyto úpravy zpřístupní dostupný limit paměti, ale nemění základní realitu. Pokud váš projekt vyžaduje větší modely, delší kontexty nebo vyšší souběžnost, potřebujete více VRAM.

Potřebuji kapacitu nebo rychlost: 5070 Ti vs 5080

Dá se na to dívat tak, že rychlost je to, jak rychle můžete jet, a kapacita je to, kolik cestujících vezmete. Deep learning záleží na obojím, ale kapacita rozhoduje o tom, jestli vůbec vyjedete z parkoviště.

5080 zvládne v mnoha úlohách vyšší propustnost než 5070 Ti. Ale srovnání 5070 Ti vs 5080 nezmění otázku "zvládnu to načíst a spustit", protože oba narážejí na své limity.

Proto lidé po upgradu bývají zklamaní. Při jednoduchých testech výkon pocítí, ale jakmile spustí skutečnou zátěž, narazí na stejnou zeď. Jen o 30 sekund později.

Pokud tedy přemýšlíte nad deep learningem, je dobré si nejdřív ujasnit, do které skupiny patříte:

- Omezeno na rychlost: data se vám vejdou do paměti, chcete jen rychlejší výpočty.

- Kapacitou omezeno: data se vám nevejdou a musíte trávit čas zmenšováním problému.

Většina lidí, kteří porovnávají 5070 Ti vs 5080 pro deep learning, patří do druhé skupiny, i když si to ještě neuvědomují.

Teď se pojďme podívat na možnost, která nejčastěji šetří nejvíce času: přesunout těžkou práci na výkonnější GPU, aniž byste museli přestavovat celé své lokální prostředí.

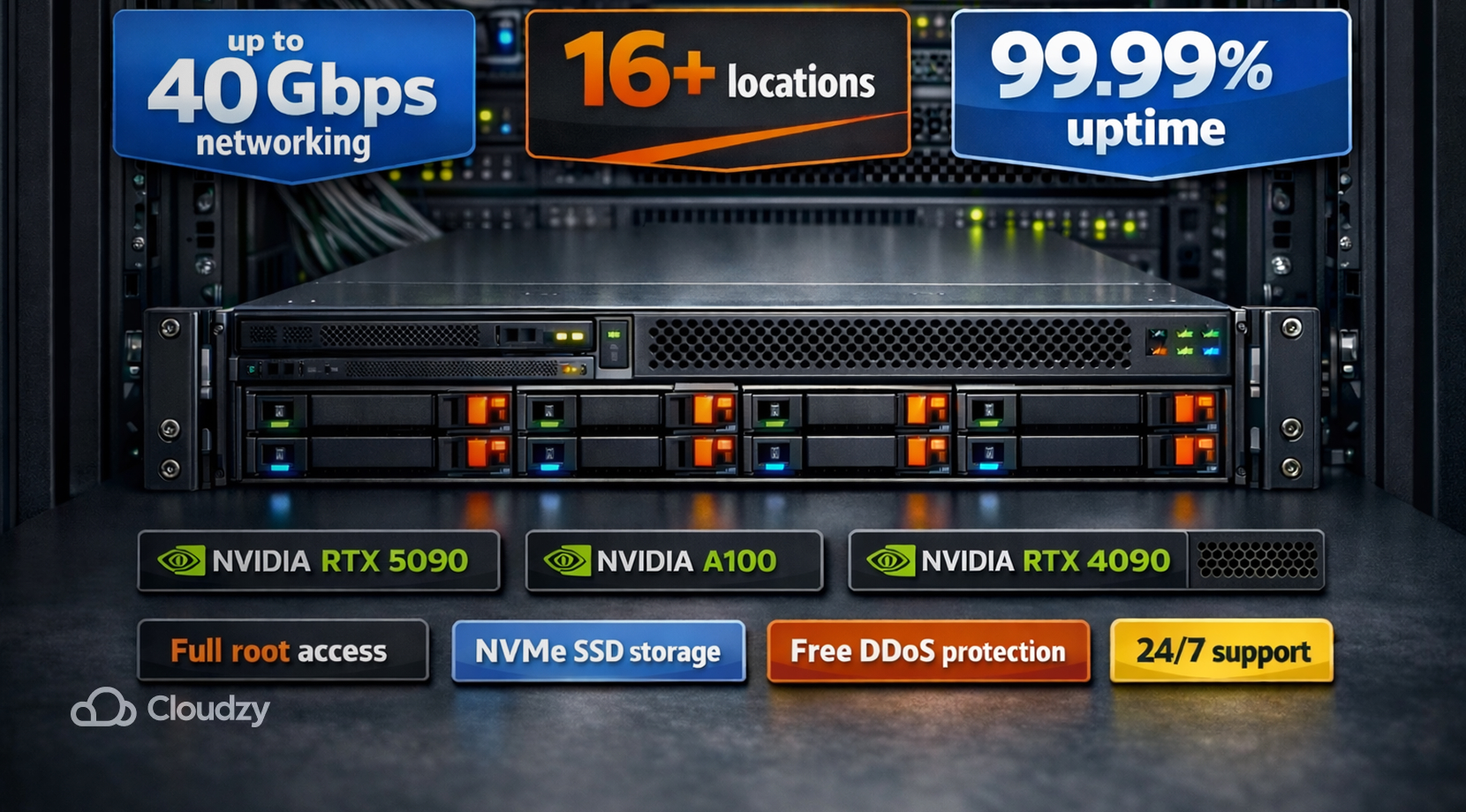

Dostupné řešení: použijte GPU VPS pro náročné úlohy

V našem infrastrukturním týmu nejčastěji vidíme, že lidé prototypují lokálně, a pak přijde moment, kdy srovnání 5070 Ti vs 5080 přestane být relevantní, protože data prostě do paměti nevejdou.

To je okamžik, kdy potřebujete přístup k většímu VRAM poolu pro trénování i realistické testy inference. A přesně tam nastupuje Cloudzy GPU VPS je čistý výběr.

Naše plány GPU VPS zahrnují NVIDIA karty jako RTX 5090, A100 a RTX 4090, plný přístup root, úložiště NVMe SSD, síť až 40 Gbps, 12 lokací, ochranu DDoS zdarma, podporu 24/7 a cílovou dostupnost 99,95 %.

Jak vám to ale pomůže, ať už jde o 5070 Ti vs 5080 nebo jakýkoli jiný GPU na podobné úrovni? Takhle:

- Svůj skutečný model i promptový profil můžete spustit na hardwaru s větším VRAM, takže rozhodnutí bude jasné z vašich vlastních logů.

- Lokální GPU si ponechejte pro vývoj a rychlé testy a výkonnější kartu si pronajímejte jen na náročné úlohy.

Pokud si chcete rychle osvěžit, co to GPU VPS vlastně jea co znamená dedikovaný GPU oproti sdílenému přístupu, náš průvodce pro začátečníky to vysvětluje srozumitelně.

A pokud si nejste jistí, zda vůbec pro vaši zátěž GPU potřebujete, naše srovnání GPU vs CPU VPS vám dá jasnou představu o tom, jaký hardware skutečně vyžadují úlohy jako trénování, inference, databáze nebo webové aplikace.

Jakmile máte infrastrukturu vyřešenou, zbývá poslední krok: zvolit workflow, který vám nebude zbytečně plýtvat časem.

Jednoduchý workflow, který vám pomůže zjistit, co potřebujete

Spousta ML vývojářů uvízne ve falešné volbě: koupit výkonnější spotřebitelskou kartu, nebo trpět. V praxi může 5070 Ti vs 5080 stále dávat smysl, pokud ji budete brát jako lokální nástroj pro vývoj, a ne jako celý produkční stack.

Workflow, který se nám osvědčil:

- Využijte svých 16 GB GPU na kódování, ladění a menší experimenty.

- Mějte připravenou šablonu prostředí s výkonným GPU pro vzdálené spouštění.

- Přesuňte tréninky a testy inference, které potřebují větší výkon, na dedikovaný GPU server.

- Sledujte průběh a ukládejte logy – výsledky tak budou vždy opakovatelné.

Pokud hledáte podrobnějšího průvodce výběrem správné třídy GPU pro ML obecně, podívejte se na náš přehled nejlepší GPUs pro strojové učení je dobrým dalším krokem.

Takže nakonec, 5070 Ti vs 5080 je volba pro lokální výpočty, ale škálování hlubokého učení je otázka infrastruktury. Pokud vás zajímá, jak větší třída karet mění reálné chování AI, podívejte se na náš H100 vs RTX 4090 benchmark Rozbor je užitečným srovnáním, protože se stále vrací ke stejnému tématu: nejprve vhodnost VRAM, pak rychlost.