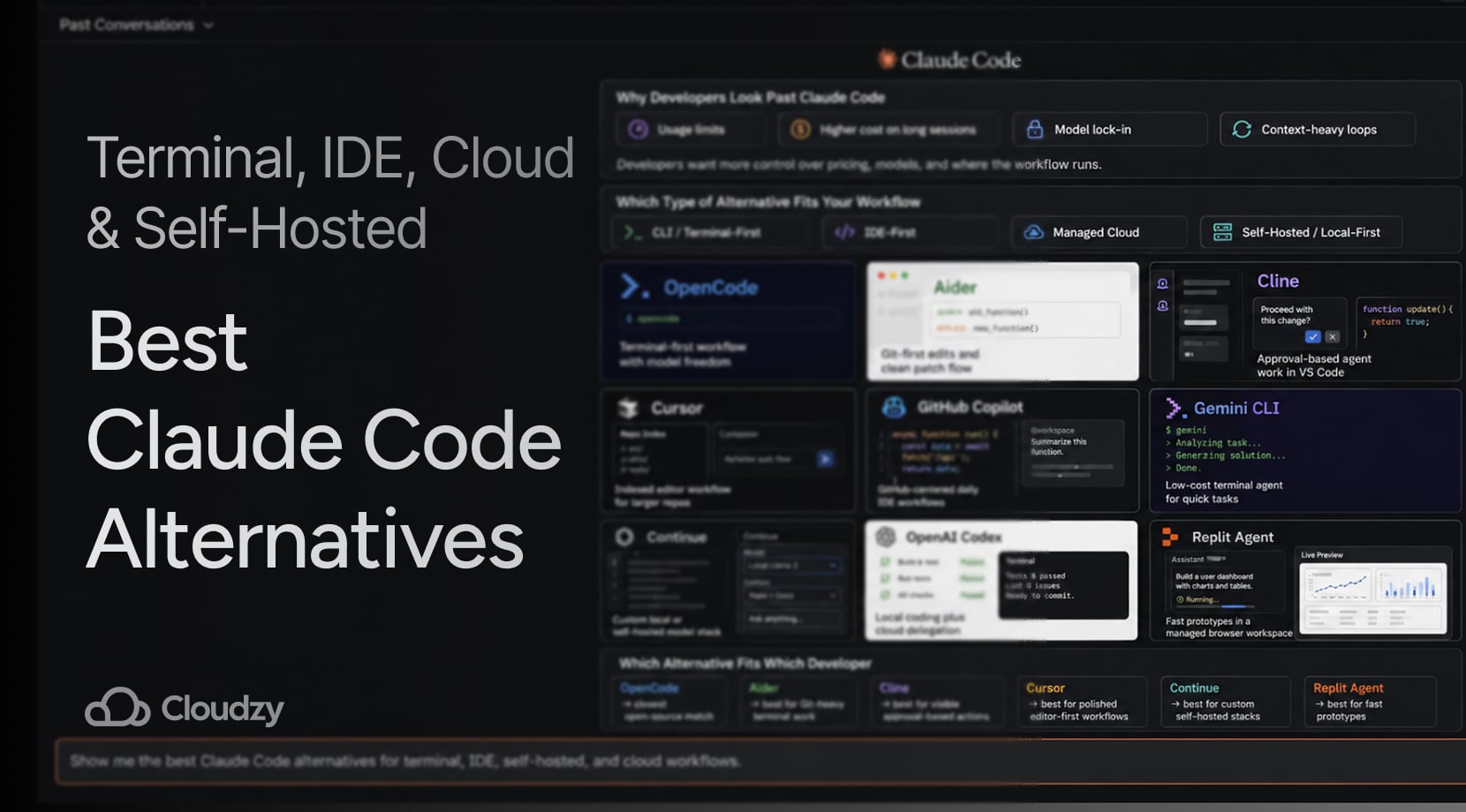

Claude Code er stadig en af de stærkeste kodningsagenter derude, men mange udviklere vælger nu værktøjer baseret på workflow, modeladgang og langsigtede omkostninger i stedet for at holde fast ved en enkelt leverandør.

Det er derfor interessen for Claude Code-alternativer fortsætter med at vokse. Det gode nyt er, at der findes masser af anstændige muligheder for terminalbrugere, editor-fokuserede udviklere og folk, der ønsker en selvhostet løsning.

Hurtigt svar

Hvis du vil have den korte version først, her er den. Claude Code er stadig meget god til arbejde på tværs af repositories, terminalbaserede ændringer og flertrinsprojekter. Men hvis du ønsker flere modelvalg, lavere udgifter til rutinearbejde, en mere brugervenlig editor-oplevelse eller en selvhostet opsætning, findes der nu flere stærke muligheder.

- Nærmeste open source-alternativ: OpenCode

- Bedste Git-first terminalworkflow: Aider

- Bedste open source-editor agent: Cline

- Bedste polerede IDE-first mulighed: Cursor

- Bedste almindelige multi-model editor-mulighed: GitHub Copilot

- Bedste gratis CLI-vej til enkeltmandsanvendelse: Gemini CLI

- Bedste brugerdefinerede selvhostede stack: Fortsæt

- Bedste cloud-delegering: OpenAI Codex

Mange udviklere skifter dog ikke til en direkte erstatning. Enhver udvikler ved, at du skal have et par værktøjer ved hånden og bruge hver enkelt til det arbejde, det håndterer bedst, hvilket er et tilbagevendende tema på Reddit-tråde ligeledes.

Hvorfor udviklere ser forbi Claude Code

Claude Code fik sin ry af en grund. Anthropic byggede det omkring agentbaserede kodningsworkflows, så det kan læse en kodebase, redigere filer, køre kommandoer og arbejde fra terminalen eller tilsluttede værktøjer på en måde, der føles naturlig når du først vænner dig til det.

Alligevel bliver de samme klager over pris og brugerandele ved med at dukke op, selv efter al denne tid. Claude-adgang omfatter nu Pro, Max, Team og Enterprise-veje, hvor Premium-sæder giver højere forbrug i teamomgivelser. Men alle, der har brugt Claude, ved, at grænser nås meget hurtigere end forventet.

Låsning er det andet store punkt. Hvis du kan lide workflowet, men ikke vil have hele din opsætning bundet til Anthropic-modeller og Anthropic-grænser, virker alternativer helt klart som smartere muligheder.

Der er også en mere irriterende klage i nylige tråde om lange sessioner, der bliver dyre fordi værktøjet hele tiden trækker kontekst rundt, og når noget staller eller sætter sig i loop, kan det spilde tid og budget på kort tid.

Nogle brugere har offentliggjort revisioner viser, at det meste af tokenforbruget går til konteksthåndtering i stedet for kodeudgang, mens andre har beskrevet Claude Code sidder fast i minutvis på prompts, der burde være rutine.

For at være ærlig, den 23. april 2026, Anthropic adresserede problemerne og sagde, at nogle Claude Code-kvalitetsrapporter var knyttet til tre produktændringer, ikke en dårligere basemodel, og at rettelserne var live fra 20. april.

Men det betyder ikke, at mange udviklere fuldt skifter fra Claude Code. Med sådanne begivenheder bør enhver smart udvikler have mindst et eller to alternativer til Claude Code i baglommen, bare for en sikkerheds skyld.

Alt dette betyder ikke, at Claude Code er et dårligt værktøj. Det betyder bare, at markedet er bredere nu. Hvis du allerede ved, at du godt kan lide agent-stilen, men ønsker mere kontrol over priser eller modelvalg, er vores Opencode mod Claude Code sammenligning sammenligningen, der passer tightest.

Hvilken type alternativ passer til dit workflow

Terminal-tungt arbejde, editor-tungt arbejde og selvhostede opsætninger trækker udviklere mod forskellige alternativer. OpenCode, Aider og Gemini CLI passer til folk, der vil blive i shell'en, Cursor og Copilot passer bedre til editor-ledet arbejde, og Continue er mere for udviklere, der bygger omkring deres egne modeller eller infrastruktur.

CLI- og terminalfokuserede værktøjer

Du bliver i Git, forbliver i shell'en, og lader agenten arbejde gennem ændringer på samme sted, hvor du allerede bygger og tester. OpenCode, Aider og Gemini CLI sidder her, selvom de ikke opfører sig helt ens, hvilket vi diskuterer senere.

Editor-fokuserede værktøjer

Disse passer til udviklere, der ønsker et AI-værktøj inde i editoren, de bruger hele dagen. Cursor, GitHub Copilot og Cline er hovednavnene her, selvom Cline læner sig mere til fuld agent-adfærd end klassiske completion-værktøjer. Hvis dit hold lever inde i editor-faner mere end shell-panes, er denne kategori af Claude-alternativer, hvor du skal hen.

Administrerede cloud-platforme

Denne gruppe er for folk, der bekymrer sig mere om at komme fra idé til arbejdende app end om lokal kontrol eller repo-lokal agent-adfærd. Replit Agent er det bedste eksempel på sådan opgaver. Selvom det fjerner setupfriktion, kommer den bekvemmelighed med mindre kontrol end en lokal eller selvhosted vej.

Open source- og selvhostede opsætninger

Det er her, OpenCode og Continue bliver mere interessante. Du får mere frihed over modeller, infrastruktur, privatliv og omkostningsstruktur, men du påtager dig også setup- og tuningsarbejde. Flere værktøjer taler nu Modelkontekstprotokol, hvilket er en grund til, at at skifte frameworke er lettere end for et år siden.

Hvis du prøver at sortere forskellen mellem en coding-agent og en bredere selvhosted assistent, kan vores Opencode mod OpenClaw stykke hjælpe dig meget mere.

Claude Code-alternativer sammenlignet

Før vi går ind i hvert værktøj ordentligt, hjælper det at se feltet side om side. Tabellen nedenfor deler disse værktøjer baseret på workflow, selvhosted vej og hovedtavslutninger.

| Værktøj | Bedst til | Grænseflade | Åben kildekode | Lokal eller selvhosted vej | Vigtigste kompromis |

| OpenCode | Claude Code-lignende workflows med modelfrihед | Terminal, IDE, skrivebord | Ja | Ja | Mindre modenhed end de største kommercielle løsninger |

| Aider | Git-tungt terminalarbejde | Terminal | Ja | Ja | Føles mere manuelt end fuldautomatiske agenter |

| Cline | Synlige, godkendelsesbaserede agentopgaver i VS Code | Udvikler-IDE | Ja | Ja | Kan blive støjfuldt og dyrt ved større opgaver |

| Cursor | Poleret editor-først kodeskriving | Udvikler-IDE | No | Ingen lokal-først løsning | Bundet til et hosted editor-produkt |

| GitHub Copilot | Mainstream editor-workflows og modelvalg | IDE, GitHub | No | Hosted, ikke selv-hostet | Ikke bygget omkring fuld lokal kontrol |

| Gemini CLI | Lave eller gratis terminaleksperimenter | Terminal | Ja | Ikke selv-hostet som standard | Stærk værdi, men Google-centreret for mange brugere |

| Fortsæt | Brugerdefinerede lokale eller selv-hostede stacks | IDE, terminal, CI | Ja | Ja | Kræver mere opsætning end plug-and-play værktøjer |

| OpenAI Codex | Lokalt samarbejde plus cloud-delegering | Terminal, IDE, cloud-app | Ja til CLI | Delvis | Bedste dele afhænger af OpenAIs bredere stack |

| Replit Agent | Hurtigt managed app-oprettelse | Browser-IDE | No | No | Hurtigt til managed prototyper, svagere til repo-lokal kontrol |

Top Claude Code-alternativer efter workflow

Du har alt det, du skal bruge – her er værktøjerne et for et.

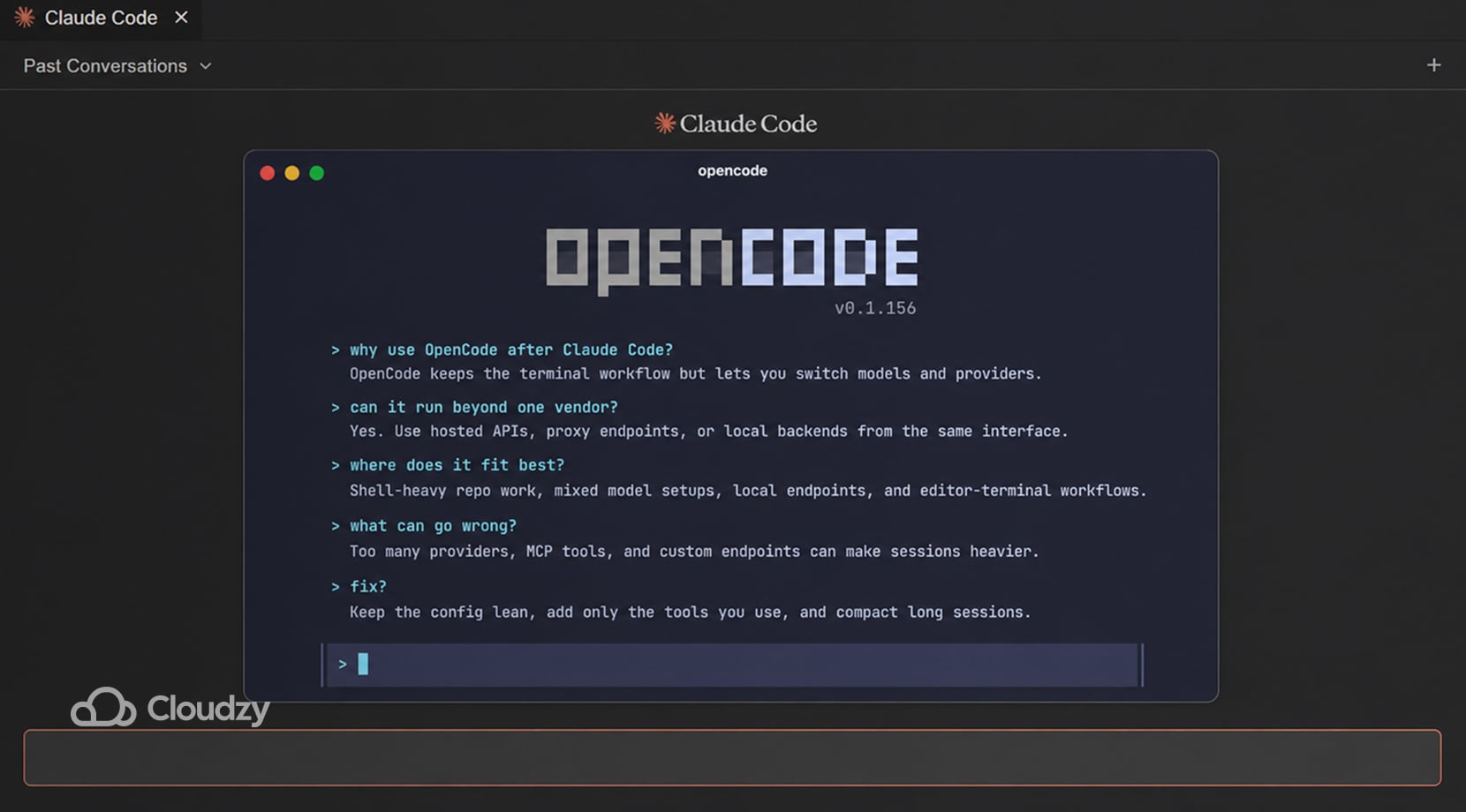

OpenCode

OpenCode passer til udviklere, der vil blive i terminalen uden at binde sig til én provider. Det samme setup kan pege på hosted APIs, proxy endpoints eller lokale backends, så du kan skifte model uden at skifte værktøjer eller rutiner.

Men selv i editorbrug føles det stadig som en terminalagent, hvilket passer til folk, der vil have shell'en i centrum af arbejdet.

Det virker særligt godt, når én model håndterer dybt repo-arbejde, en anden er billigere til rutineændringer, og en lokal backend ligger parat til private eller billige opgaver.

Svagpunktet er rodet, for når configgen vokser til at inkludere for mange providere, MCP-servere eller custom endpoints, bliver sessionen tung, og setupet kræver konstant oprydning.

OpenCode's egne MCP docs MCP-servere og brede værktøjsflader kan tilføje ekstra værktøjsdefinitioner til modelkonteksten, hvilket kan øge tokenforbruget og latency.

- Good er velegnet til shell-tungt repo-arbejde med mere end én provider eller model i rotation

- Nyttigt til at bevare samme interface mens du skifter backend bag ved

- Nyttigt til at blande hosted APIs, lokale endpoints og editor-terminal-brug i ét setup

- Bliver irriterende når configgen vokser hurtigere end workflowet

- Bliver irriterende når store MCP-værktøjssæt tilføjer for meget kontekst til hver kørsel

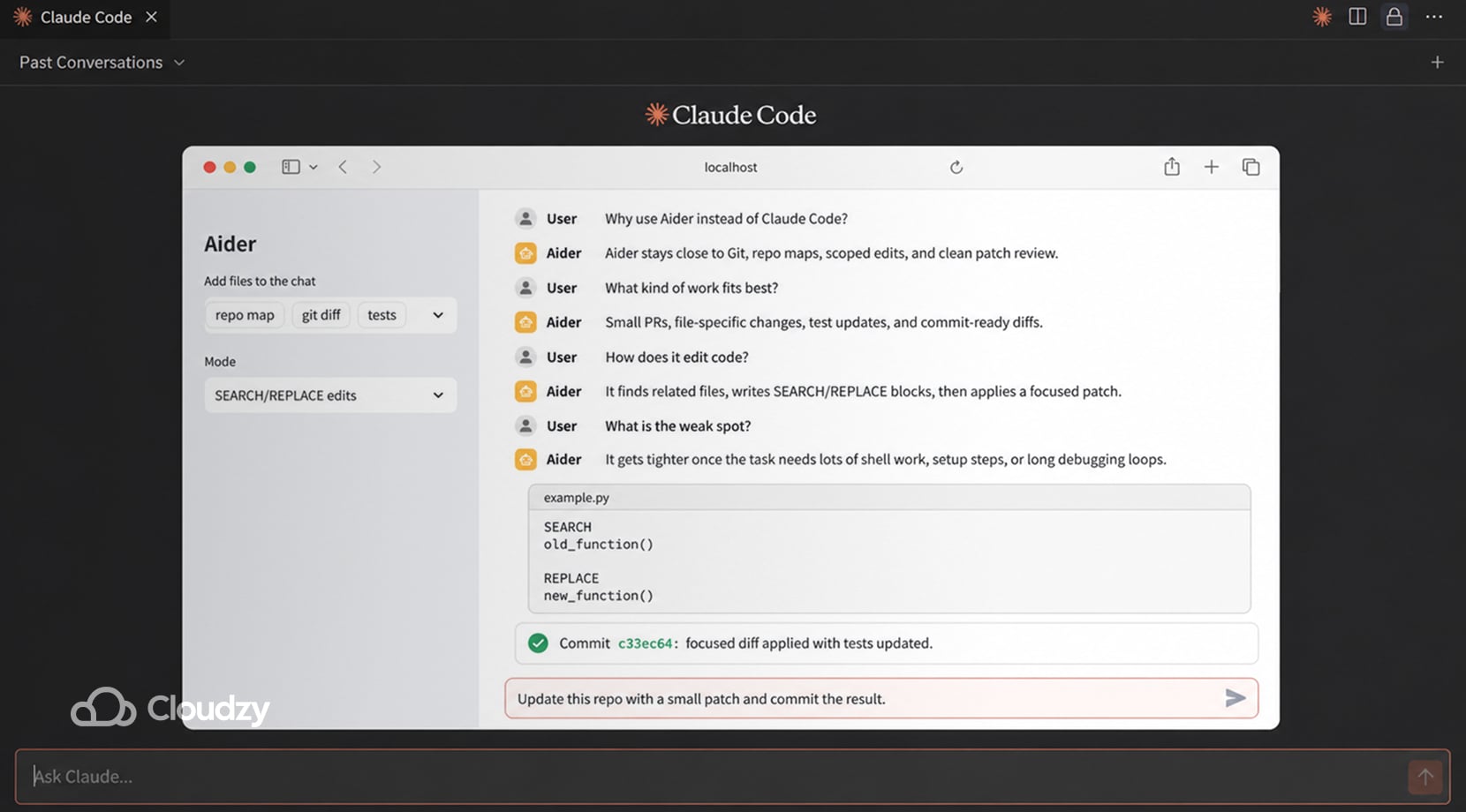

Aider

Aider er bygget omkring repo-maps, diff-edits og Git-venlig patch-flow. Det sender modellen et strukturelt sammendrag af filer og symboler, og anvender derefter search-and-replace-lignende ændringer i stedet for at omskrive hele filer. I review-tunge repos giver det ofte mindre PRs, færre støjende omskrivninger og en commit-historie, der er lettere at inspicere.

Det virker bedst på afgrænsede opgaver – ting som at redigere disse filer, ændre denne logik, opdatere testene og committe resultatet.

Men vær opmærksom på, at når opgaven strækker sig til build-setup, terminalorkestrering, browserkontrroller eller lange debuggingsløkker, bliver workflowet strammere, fordi Aider holder interaktionen tæt på selve kodeændringen.

- Good er velegnet til Git-tunge repos, review-drevne teams og afgrænsede kodeændringer.

- Brugbar til repo-map kontekst, diff-baserede edits, auto-commits og strammere patch-kontrol.

- Bliver kedeligt ved opgaver, der hopper rundt mellem kode, shell, setup og debugging.

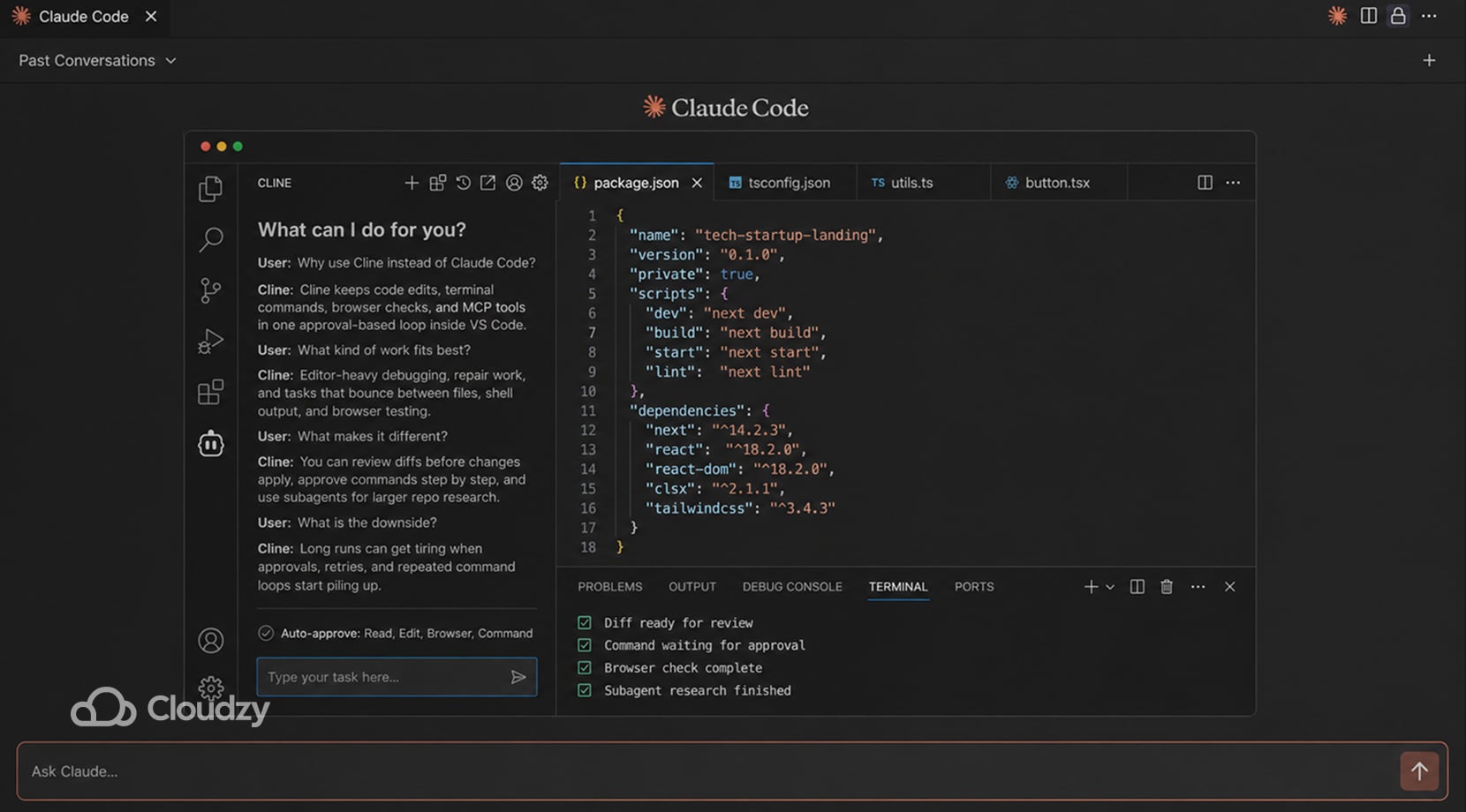

Cline

Cline kører inden i VS Code og holder filredigering, shell-kommandoer, browserhandlinger og MCP-værktøjer i samme godkendelsesdrevne loop, med diffs vist før ændringer anvendes og kommandoer sat på pause til du godkender dem.

Det understøtter også skrivebeskyttede subagenter, som kan hjælpe med repo-undersøgelse og parallel inspektion. Men de kan ikke helt beskrives som fulde worker agents, da de ikke kan anvende patches, skrive filer, bruge browseren eller kalde MCP-værktøjer.

Det passer til editor-tungt debugging, hvor arbejdet konstant springer mellem kode, terminaloutput og browsercheck.

Den styrke kan blive en svaghed. Ved længere fejlretningskæder kan det samme setup blive langsommere, når kørslen begynder at cirkulere gennem gentagne godkendelser, kommandoforsøg eller patchinstallation.

- Good passer til editor-styret fejlfiksering, reparationsarbejde og browserunderstøttede check inden for VS Code

- Brugbar til synlige diffs, kommandogodkendelse, MCP-værktøjer og subagenterne på større repositories

- Bliver trægt på lange løkker med gentagne bekræftelser eller ustabile kommando- og outputbehandlinger

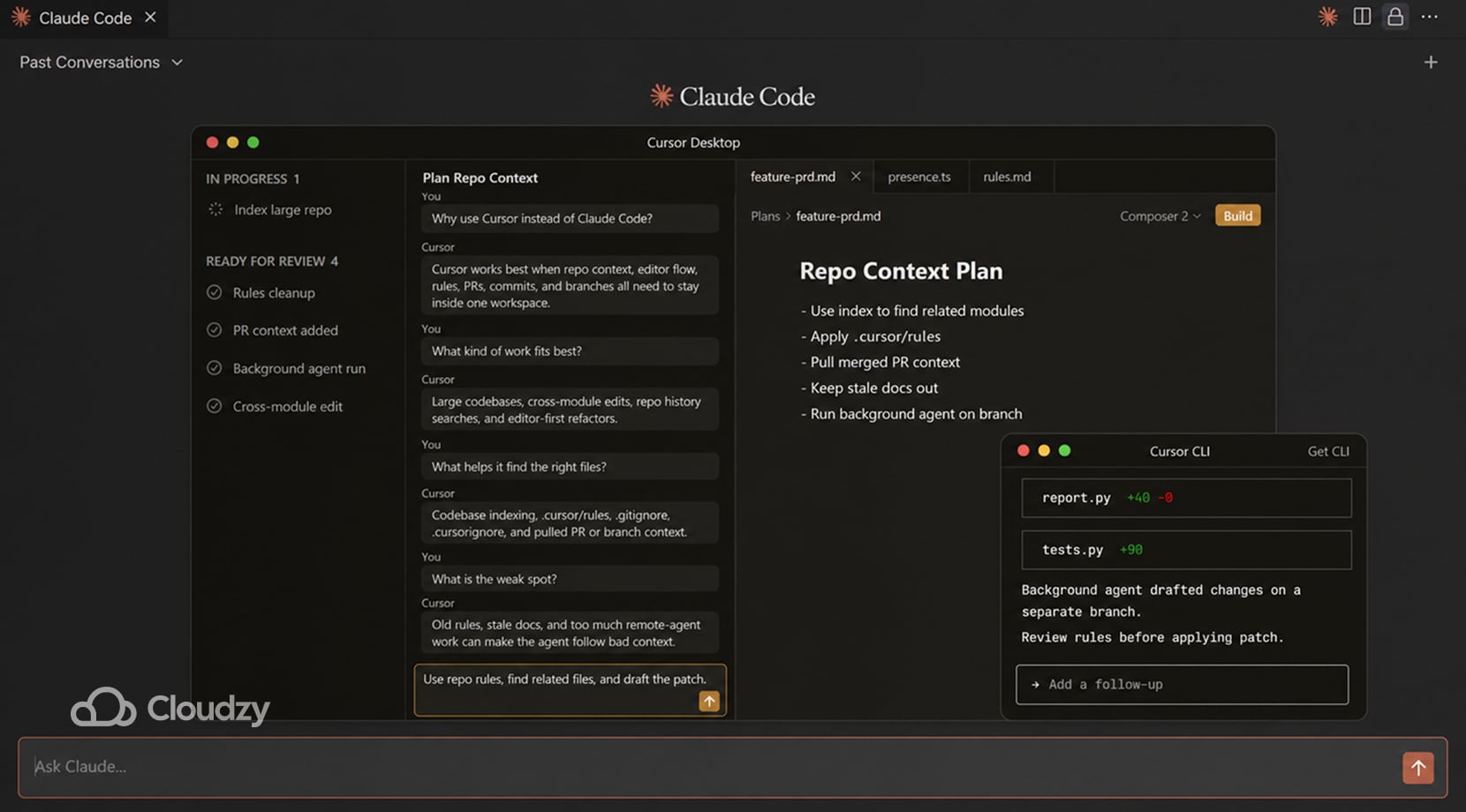

Cursor

Cursor er bygget til komplekse repositories, hvor det bruger Merkle-tree-baseret inkrementel indeksering til at vedligeholde et semantisk vektorlager. Selvom det understøtter multi-root workspaces og git-event-triggers, er dets effektivitet størst, når det indekserede område manuelt justeres via .cursorignore for at blive inden for håndterbare filantal

Desuden lever projektregler i .cursor/rules, så konventioner og workflow-noter kan blive med repositoryet i stedet for at sidde i én persons lokale indstillinger.

I større kodbaser reducerer det filetrækninger og gentagne 'læs disse mapper først'-prompter. Som resultat holder en slank regelsfil og et rent indeks bedre stand end en bunke gamle markdown-instruktioner.

I modsætning hertil, når regler, AGENTS-filer og ad hoc-kontekstdokumenter begynder at stakke sig op, har agenten mere materiale at behandle og mere forældet vejledning at snuble over.

Desuden presser Cursors baggrundsagenter tingene længere ved at klone repositoryet til en fjern Ubuntu-maskine, køre installations- og startkommandoer og arbejde på separate branches.

Det kan hjælpe med længere jobs, men det flytter også en del af arbejdsprocessen ud af den lokale editor og ind i fjernudførelse.

- Good passer til editor-styret arbejde i repositories med meget historie, konventioner eller cross-module-ændringer.

- Brugbar til kodbases-indeksering, PR-søgning, repository-omfattede regler og fjerne baggrundsafviklinger.

- Bliver kedsommeligt, når repositoryet fyldes med forældede instruktioner, eller arbejdsprocessen læner sig for tungt på fjernagenter.

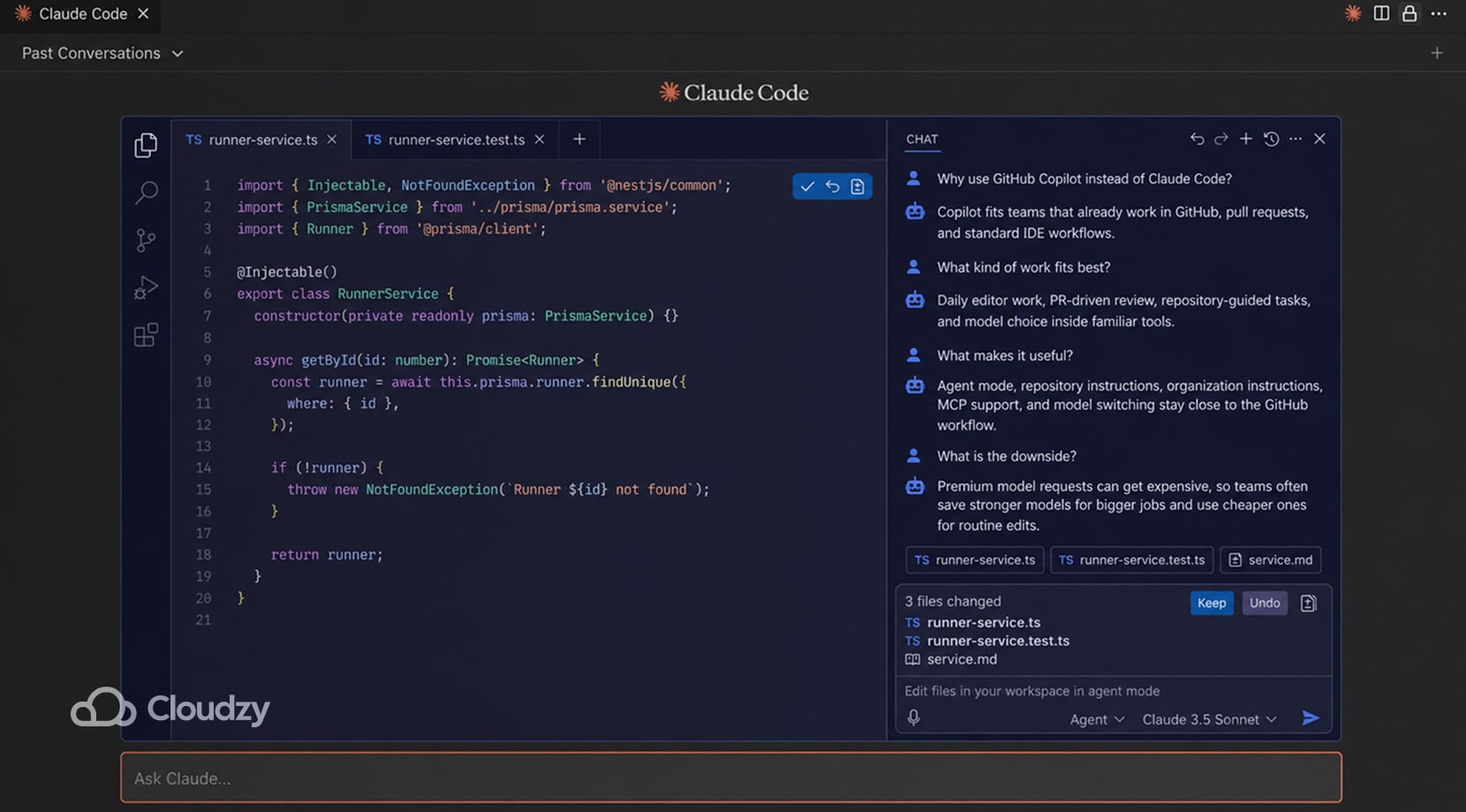

GitHub Copilot

GitHub Copilot passer til teams, der allerede arbejder ud af GitHub, pull requests og standard-IDEer. Agent-tilstand kan vælge filer, foreslå terminalkommandoer og fortsætte med arbejde gennem en opgave inden for værktøjer, som teamet allerede bruger.

Derudover holder repository-instruktioner, organisations-instruktioner, MCP-support og modelskift meget af opsætningen inden for den samme stack i stedet for at tvinge mennesker ind i et separat kodningselskab.

Problemet efter et stykke tid er dog modelprissætning inden for arbejdsprocessen. Copilot bruger premium-anmodninger til stærkere modeller, og multiplikatoren ændres efter model. Det presser teams til at spare de dyre modeller til større refactoreringer, sværere debugging eller længere agentafviklinger, og derefter vende tilbage til billigere standarder for mindre redigeringer og hurtige spørgsmål.

Produktet passer stadig pænt til GitHub-tung arbejde, men anmodningsomkostningerne kan tvinge promptingvaner ind i et hjørne, når brugen går op.

- Good passer til GitHub-tunge teams, PR-drevet gennemgang og editor-baseret dagligt arbejde.

- Brugbar til agent-tilstand, modelskifte, repository-instruktioner og holde AI-arbejde tæt på den eksisterende GitHub-arbejdsproces.

- Bliver irriterende, når omkostningen til premium-anmodninger begynder at afgøre, hvilken model der er værd at bruge til små jobs.

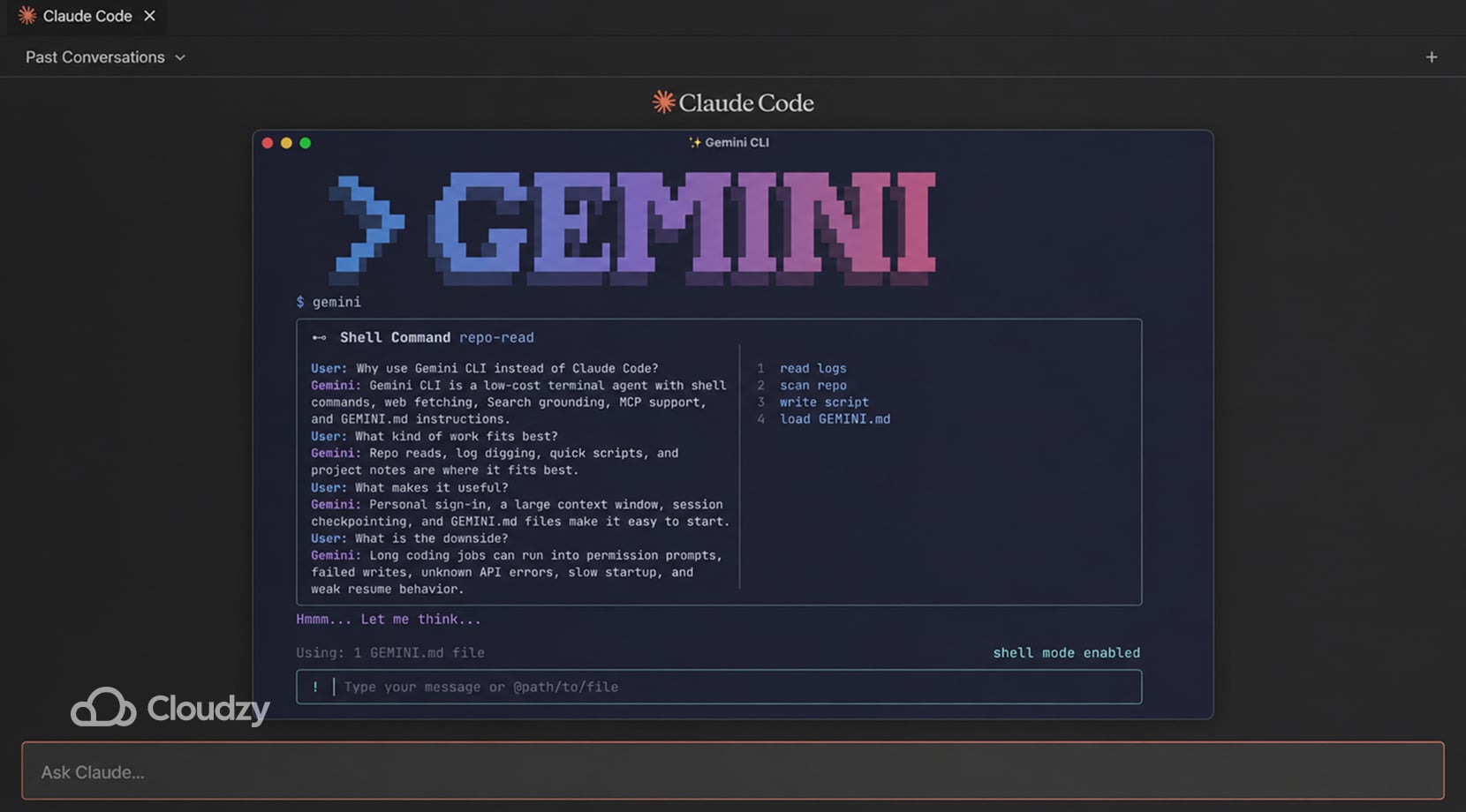

Gemini CLI

Gemini CLI kører i terminalen og kræver meget lidt opsætning for at komme i gang.

Google leverer det som en open source agent med shell-kommandoer, webhentning, søgegrunding, MCP-understøttelse, sessionskakpunkter og GEMINI.md filer, der kan indlæse instruktioner fra globalt scope, workspace og directory-scope. Det bliver endnu bedre med personlig Google-login, som også inkluderer en gratis kvota og adgang til Gemini-modeller med en kontekstvindue på 1 million tokens. Det gør det brugbart til læsning af repos, loggennemgang, hurtige scripts og projektnotes.

Desværre viser problemerne sig på længere kodeopgaver, hvor seneste rapporter der beskrives gentagne tilladelsesspørgsmål, filfejl selv efter tilladelser blev åbnet, ukendte API-fejl, langsom opstart, simple opgaver, der tager alt for lang tid, og samtaler, der ikke genoptages pænt.

Et stort kontekstvindue hjælper med at læse flere filer, men det kompenserer ikke for usikker værktøjskørsel eller længere reparationskæder.

- Good passer til shell-sideredo-læsning, logs, engangscripts og lettere kodeopgaver.

- Brugbart til læsning med stort kontekstvindue, GEMINI.md projektinstruktioner, MCP-udvidelser og hurtig terminaladgang.

- Klarer sig dårligt ved længere filer-reparationsarbejde, gentagen værktøjsbrug og sessioner, der kræver pæn genoptagelsesadfærd.

Fortsæt

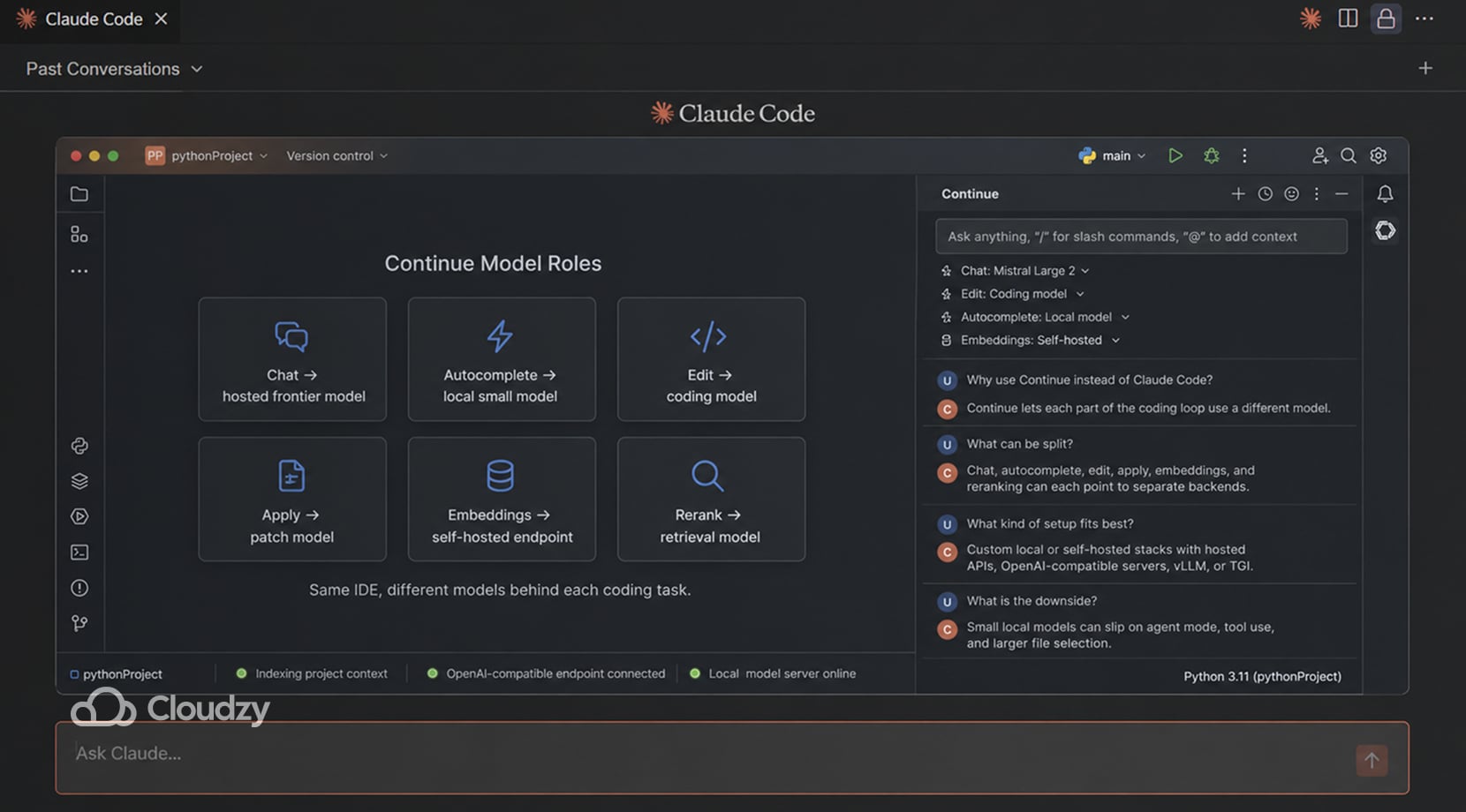

Continue passer til opsætninger, hvor forskellige dele af kodningscyklussen kræver forskellige modeller. Det lader dig tildele separate roller for chat, autofuldførelse, redigering, anvendelse, embeddings og omrangering, og derefter pege disse roller mod hostede APIs, OpenAI-kompatible servere eller selvhostede backends.

Dens selvhostingguide dækker backends som vLLM, Hugging Face TGI og andre OpenAI-kompatible endepunkter, så du kan holde Continue-udvidelsen på plads, mens du skifter modelserveren bag den.

Denne opsætning er nyttig i teams, der opdeler kodningscyklussen på tværs af forskellige modeller, for eksempel én model til chat, en mindre til autofuldførelse og en anden til redigeringsanvendelse eller vektorsøgning.

Husk dog, at lokale stakke bygget omkring mindre kodningsmodeller er sværere at stole på til agentarbejde. Agent-tilstand og værktøjsbrug er normalt de første steder, hvor de begynder at skride, med manglende trin, sprunget værktøjer eller forkert hentet kontekst.

Nylig LocalLLaMA diskussioner nævner det samme problem i Continue-lignende lokale opsætninger. Mindre modeller kan håndtere chat og grundlæggende redigeringer, men de mister pålidelighed meget hurtigere, når agent-tilstand, værktøjskald eller bredere filadgang bliver involveret.

- Good passer til tilpassede stakke med separate modeller til chat, autofuldførelse, redigering og søgning.

- Brugbart til OpenAI-kompatible servere, selvhostede endepunkter og udskiftning af udbydere uden at udskifte editor-arbejdsgangen.

- Klarer sig dårligt, når den lokale backend er for lille til værktøjsbrug, agent-tilstand eller større filvalg.

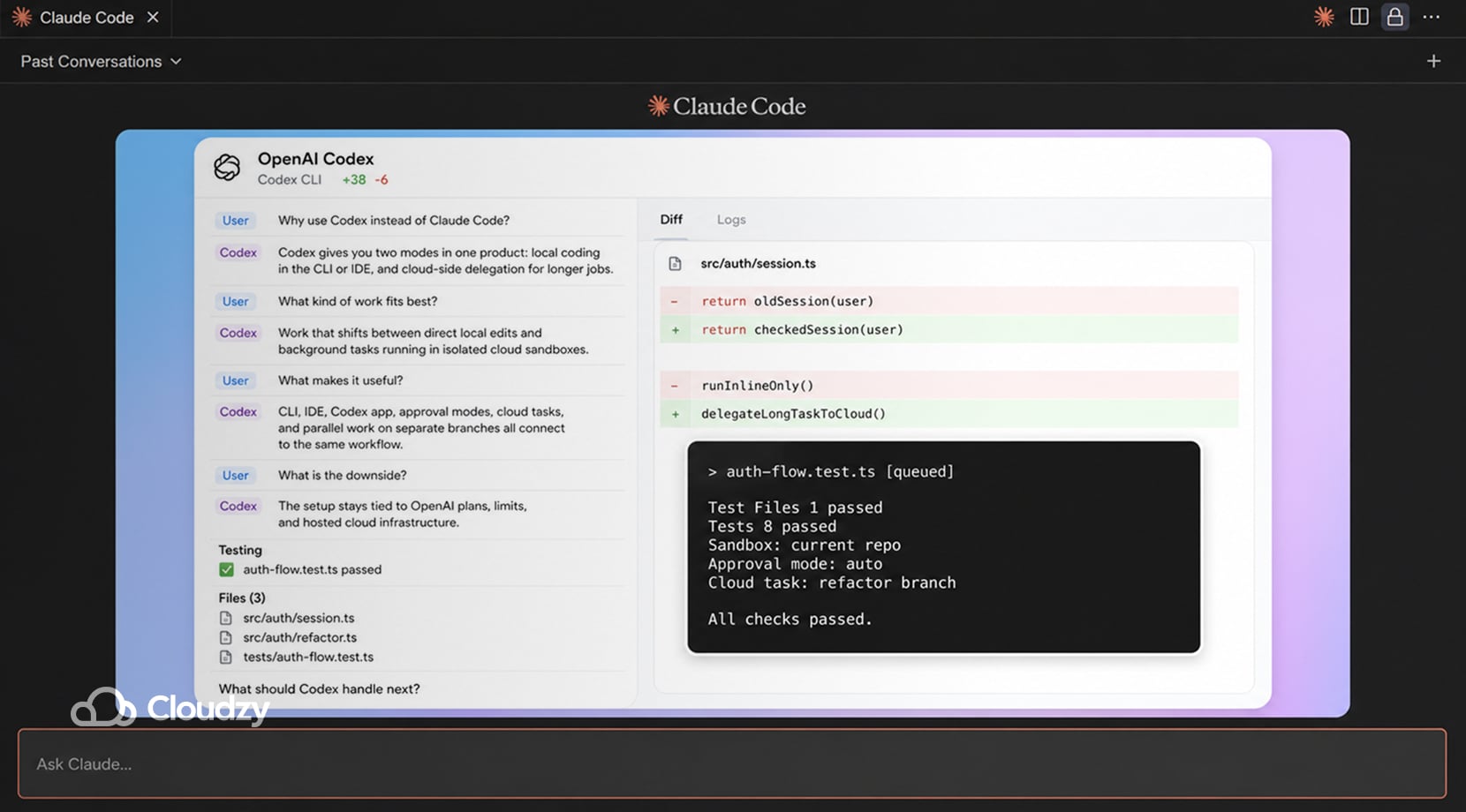

OpenAI Codex

OpenAI Codex passer til udviklere, der ønsker to tilstande i ét produkt: lokalt pair-programming i CLI eller IDE og cloud-delegation til længere jobs. OpenAI's aktuelle dokumentation placerer Codex i CLI, IDE-udvidelse, Codex app og Codex Cloud, med skytask, der kører i isolerede sandkasser forbundet til et repo, og lokalt arbejde, der forbliver i dit eget miljø.

Desuden adskiller Codex sandboxing fra godkendelser. Sandkassen styrer fil- og netværksadgang, mens godkendelsesindstillinger bestemmer, hvornår Codex skal pause før udførelse af en handling. I en workspace-write-opsætning kan Codex redigere i det aktuelle workspace, men netværksadgang og out-of-workspace-handlinger afhænger stadig af de valgte indstillinger.

Denne opsætning passer til arbejde, der konstant skifter mellem direkte redigeringer og baggrundsopgaver. En lokal session kan inspicere repoen, reparere filer og køre kommandoer, derefter kan en cloud-opgave fortsætte gennem en længere rettelse eller PR-udkast uden at holde terminalen åben.

OpenAI har også presset Codex længere ind i parallelt arbejde med Codex-appen, indbyggede worktrees og multi-agent-ledelse.

Cloud-opgaver er nyttige, men opsætningen forbliver bundet til OpenAI's planer, grænser og hostede miljø. Det er fint for nogle teams, men andre ender med at beholde Codex til cloud-sidearbejde alene mens de flytter delen af kodningssløjfen tilbage til lokale værktøjer, så de får tættere kontrol over, hvordan sessionen kører, og hvor langt de kan presse den.

- Good egnet til lokal kodning plus uddelegeret baggrundskørsel.

- Brugbar til godkendelsestilstande, IDE- og CLI-dækning, cloud-sandkasser og parallel arbejde via appen.

- Bliver træls, hvis du vil have hele arbejdsgangen uden for én leverandørs planer, begrænsninger og cloud-miljø.

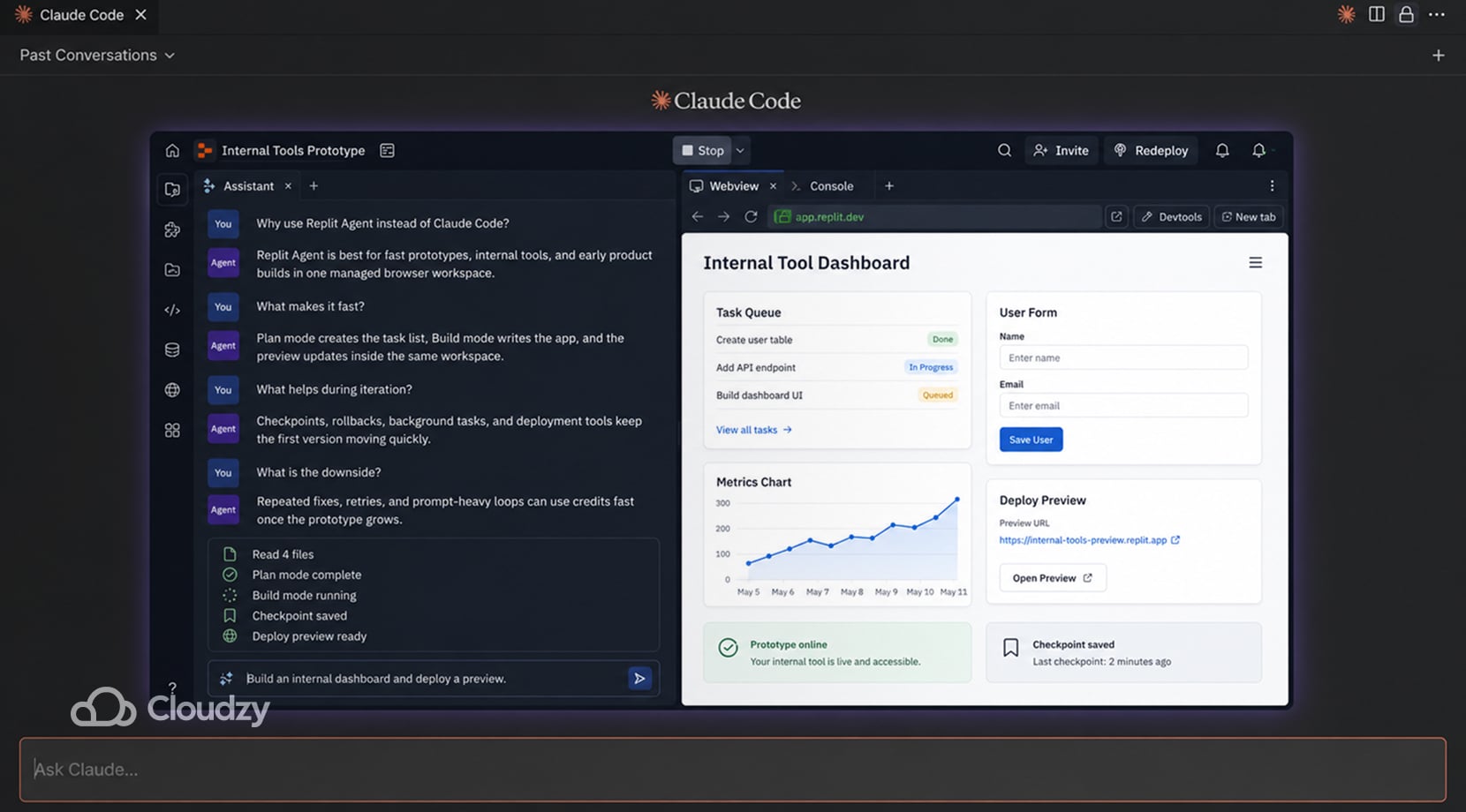

Replit Agent

Replit Agent passer til hurtigt prototypework, interne værktøjer og tidlig produktopbygning, hvor kodning, hosting og deployment ligger ét sted.

Replits aktuelle dokumentation viser Plan-tilstand til opgavelister og arkitekturspørgsmål før kodeændringer, Build-tilstand til implementering, automatiske checkpoints og rollbacks, og et opgavesystem, der kan køre baggrundskørsel i separate tråde med plandefinerede grænser for samtidighed.

Det er let at se, hvorfor folk bliver ved med at prøve det; du kan komme fra idé til noget, du kan klikke på, meget hurtigt, især hvis arbejdet stadig er udefinieret, og stacken ikke er fastlagt endnu.

Ulempen bliver tydelig, når projektet ikke længere er en grov prototype og kræver gentagne rettelser, meget prompt-drevet iteration eller multi-agent-arbejde. Replit er stærk til at få en prototype online hurtigt, men gentagne rettelser, prompt-drevet iteration og multi-agent-arbejde kan drive kreditter op hurtigt..

Det er som regel, når teams begynder at spare på prompts og flytter det tungere kodningsarbejde til Cursor, VS Code eller en anden lokal opsætning, mens de stadig bruger Replit til hosting, demo eller tidlig validering.

- Good egnet til prototyper, interne apps og hurtig produktvalidering i et administreret browser-arbejdsområde.

- Brugbar til planlægning før redigeringer, baggrundstasks, checkpoints, rollbacks og at få en deploybar app online hurtigt.

- Bliver dyrt, når arbejdsgangen bliver til masser af gennemprøvinger, små rettelser eller gentagne prompt-loops.

SaaS vs selvhostet AI-kodningsværktøjer

Forenklet: du stilles over for to spørgsmål: vil du have et hostedt produkt, eller vil du eje mere af stacken? For at svare på det skal du alvorligt overveje, hvad disse valg påvirker, og det har jeg fremhævet i tabellen herunder.

| Faktor | SaaS-værktøjer | Self-Hosted eller Local-First Tools |

| Opsætningstid | Hurtig | Langsommere |

| Modelvalg | Nogle gange bred, nogle gange låst | Normalt bredere, hvis du bygger det rigtigt |

| Privatliv og kodekontrol | Afhænger af leverandørens vilkår | Bedre kontrol over runtime; model-privatliv afhænger af den backend, du vælger |

| Brugervendelighed fra dag ét | Bedre | Grovere |

| Fleksibilitet på lang sigt | Lavere | Højere |

| Driftsbyrde | Lav | Dit at administrere |

Hvad tabellen siger, er, at SaaS er nemmere at komme i gang med og normalt stiller mindre krav til teamet fra dag til dag. En self-hosted opsætning giver dig mere plads til at forme stacken, hardwaren og modelvejene.

Hvis udgifterne til API begynder at stige, eller dit team har brug for mere stabil adgang til computing, så er vores Cloud GPU versus Dedicated GPU VPS sammenligning et bedre næste skridt end endnu en værktøjsoversigt.

Hvorfor Self-Hosted AI-kodning bliver ved med at tiltrække udvikler

Udvikler - og faktisk de fleste af os - bliver træt af at stable abonnementer på hinanden, træt af at leve inden for én leverandørs grænser, og træt af at være nervøs for, at hver længere session kunne blive til et budgetproblem.

Privatlivsbetænkeligheder dukker også op her, især hvor folk ikke ønsker proprietær kode sendt til flere eksterne tjenester bare for at holde én arbejdsgang ved live.

Lokale modeller kan klare sig fint nok i chat, men kodningsagent-arbejde lægger mere pres på dem. Værktøjskald, lange prompter, parser-særheder og hardwarebegrænsninger begynder alle at dukke op meget hurtigere, når modellen skal arbejde på tværs af filer og holde en længere opgave sammen.

Jeg siger alt det for at komme til pointen: en hybrid tilgang er sandsynligvis det bedre valg. En udvikler kan bruge en hostet frontier-model til svært repo-arbejde, en billigere model til gentagne redigeringer, og en lokal eller VPS-baseret setup til privatlivsfølsom eller altid-på-arbejdsgang.

Hvis du stadig arbejder på det lokale runtime-aspekt af det valg, så er vores Ollama versus LM Studio sammenligning en brugbar omvej.

Sådan kører du Claude Code-alternativer på din egen maskine eller en VPS

En lokal setup fungerer fint op til et punkt, fordi en bærbar computer kan være nok til mindre repos, kortere sessioner og grundlæggende privatlivsbehov. Men når sessioner bliver længere, eller modellen skal gøre mere end at chatte, fyldes RAM, konteksten bliver skåret ned, værktøjskald går i stykker, og jobs begynder at tage meget længere tid end de burde.

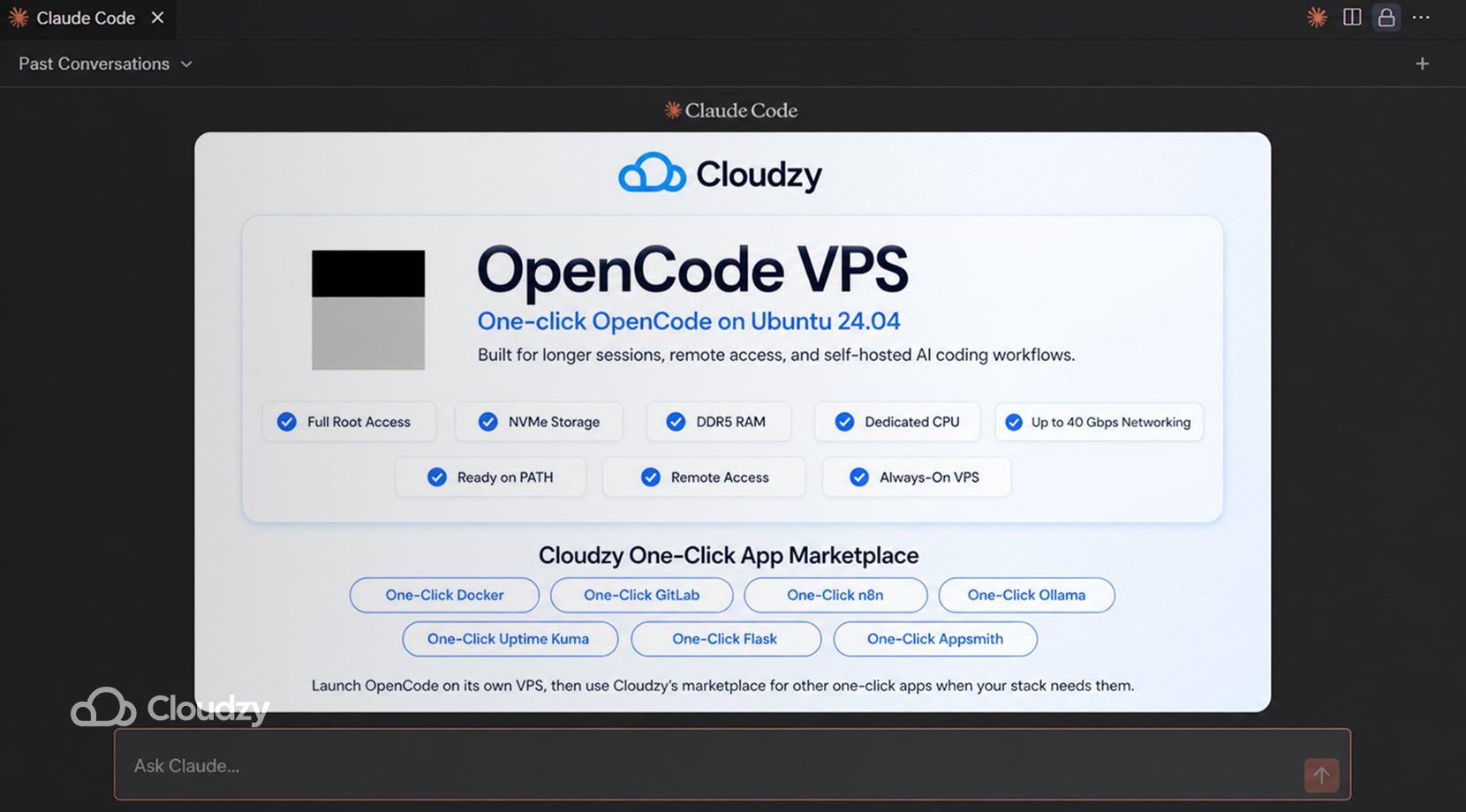

At køre OpenCode på en VPS holder den self-hosted-arbejdsgang intakt uden at binde den til én leverandør eller presse den ned på din egen maskine.

Cloudzy's Et-klik OpenCode VPS fjerner stort set opsætningsdelen, da OpenCode allerede er installeret på Ubuntu 24.04, tilføjet til din PATH og klar til brug, så du bruger ikke tid på at få miljøet i en brugbar tilstand før du udfører egentligt arbejde.

Det, du får, er ikke blot et hop over opsætningen, men også længere sessioner, flere repos, parallelt arbejde og fjernaccess, alt uden problemer, fordi maskinen altid er tændt og ikke konkurrerer med dine lokale ressourcer.

Det er fordi vores VPS-tjenester alle kommer med fuld root-adgang, NVMe-lagerplads, DDR5 RAM, dedikerede ressourcer og op til 40 Gbps netværk, så din setup ikke bliver en flaskehals for arbejdsgangen, som en bærbar computer til sidst gør.

Og da OpenCode normalt ikke er det eneste, der kører, vores markedsplads dækker allerede mange af de sædvanlige værktøjer og apps, du kunne have brug for. Vi har over 300 et-klik-apps, herunder dem som Docker, GitLab, n8n, Ollama, Uptime Kuma, Flask og Appsmith, så du behøver ikke at installere dem manuelt heller!

Hvilke alternativer passer til hvilke udvikler

På dette punkt er det klart, at der ikke er ét bedste alternativ til Claude Code, så her er et resumé af, hvad jeg mener er en klar liste over, hvem der skal bruge hvilket alternativ:

- Vælg et terminalfokuseret værktøj, hvis du arbejder mest fra shell: OpenCode, Aider, Gemini CLI eller Codex CLI.

- Vælg et editor-først værktøj hvis det meste arbejde foregår i VS Code-lignende workflows: Cline, Cursor eller Copilot.

- Vælg Continue hvis målet er en brugerdefineret model/backend-setup.

- Vælg Replit Agent hvis målet er hurtig prototyping med managed hosting i stedet for lokal repo-kontrol.

Det sagt skal du være klar over at de fleste vil bruge mere end ét af værktøjerne ovenfor, fordi sådan fungerer tingene i dag.

Afsluttende tanker om de bedste Claude Code-alternativer

Claude Code er stadig stærk, men det behøver ikke længere at være det eneste værktøj i workflowet. Det bedre valg afhænger af hvor arbejdet foregår: terminal, editor, cloud workspace eller self-hosted stack.

For udvikler som ønsker OpenCode uden manuel serveropsætning, Cloudzy's One-Click OpenCode VPS giver dig et klar Ubuntu 24.04 miljø med OpenCode allerede installeret, plus plads til at tilføje resten af din dev stack senere.