Med den stigende efterspørgsel efter lokale LLMs finder mange brugere sig selv i tvivl når de skal vælge den mest passende, men at bruge dem er ikke så enkelt som du måske tror. Fordi nogle kræver pæn strøm, nogle mere end andre, foretrækker mange slet ikke at komme nær dem, og dertil kommer de mange timer som nybegyndere måske bruger på at stirre på terminalvinduet.

Der er dog to fremtrædende muligheder som gør livet nemmere. Ollama og LM Studio er to af de mest brugte platforme til at køre lokale LLMs med stærk ydeevne. Men at vælge mellem de to kan være svært, fordi de hver især er designet til forskellige workflows. Lad os se på konkurrencen omkring Ollama vs LM Studio.

Ollama som et teknisk værktøj for eksperter

Når det gælder lokale LLM-runtime, er Ollama et stærkt valg takket være dets mange funktioner. Det er ikke kun meget konfigurerbart, men du kan også få adgang til det gratis, da det er en community-backed open-source platform.

Selvom Ollama gør det lettere at køre lokale LLMs, er det CLI-første (command line interface), så det kræver stadig nogle terminal-kendskaber. At være CLI-første er en stor fordel for udviklerworkflows på grund af dens enkelhed. Selvom det ikke er let at arbejde med en CLI, tager det mindre tid at forstå sammenlignet med at køre lokale LLMs på egen hånd.

Ollama implementerer din personlige computer som en lokal miniserver med en HTTP API, som giver dine apps og scripts adgang til dets mange modeller. Det betyder at den reagerer på kommandoer på samme måde som en online LLM ville, uden at sende dine data til skyen. Og dertil kommer at dets API gør det muligt for brugere at integrere Ollama og tilslutte det til websites og chatbots.

På grund af sin CLI-karakter er Ollama også ret let, hvilket gør den mindre ressourcekrævende og mere ydelses-fokuseret. Det betyder dog ikke at du kan køre den på en gammel computer, men det er stadig lovende for brugere som ønsker at få maksimalt ud af ressourcerne og fokusere dem på LLM-modellen selv.

Når alt det er sagt kan du måske gætte at Ollama er stærkt fokuseret på udviklerworkflows, og det stemmer. Takket være dens nemme integration, lokal privathed og API-først design er det et åbenlyst valg hvis du har en udvikler-mindset.

I debatten Ollama vs LM Studio kan Ollama være at foretrække på grund af dets API-først udvikling. Hvis en CLI-runtime virker for ukendt for dig, så bliv her for et letere alternativ designet med brugervenlighed i tankerne.

LM Studio: En brugervenlig mulighed

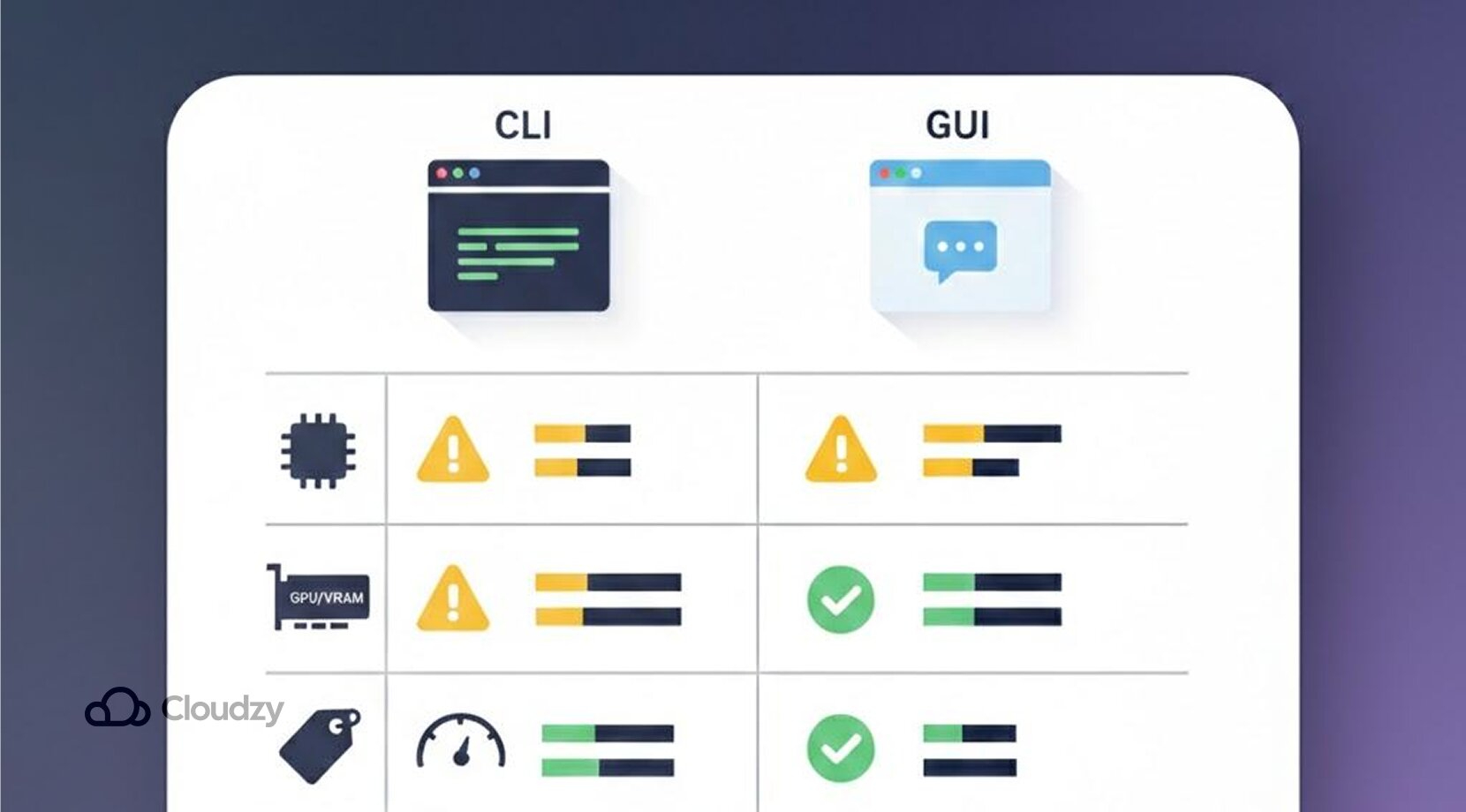

LM Studio står i stærk kontrast til Ollama. I stedet for at være et fuldt CLI-interface kræver det ingen terminalkommandoer at køre, og fordi det er udstyret med et GUI (graphical user interface), ser det ud som enhver anden desktop-app. For nogle nybegyndere kommer Ollama vs LM Studio ned til CLI-enkelhed vs et GUI.

LM Studios tilgang til at fjerne tekniske barrierer går langt hen ad vejen til at give et simpelt område for enhver bruger. I stedet for at tilføje og køre modeller med kommandolinjer kan du bare bruge de menuer som er tilgængelige og skrive i en chat-lignende boks. Det virker som om enhver kan bruge LM Studio til at eksperimentere med lokale LLMs, fordi det ligner ChatGPT.

Det kommer endda med en pæn in-app model-browser hvor brugere kan opdage og implementere enhver model som de ønsker, fra lette modeller til casual brug op til kraftfulde modeller til sværere opgaver. Derudover giver denne browser korte beskrivelser af tilgængelige modeller og anbefalede use cases, og tillader brugere at downloade modeller med et enkelt klik.

De fleste modeller kan downloades gratis, men nogle kan have yderligere licenser og brugsrettigheder. For nogle arbejdsgange kan Ollama også tilbyde lokal servermodus til nemme integrationer, men det er primært designet omkring et brugervenligt desktop-grænseflade for begyndere. Men lad os alligevel se på både Ollama og LM Studio side ved side.

Vigtige iagttagelser: Ollama vs LM Studio

Før vi går videre, skal vi nævne en kritisk pointe: udtrykket "Ollama vs LM Studio" kunne tyde på, at den ene er objektivt bedre end den anden, men det er ikke hele billedet, da de er rettet mod forskellige brugere. Her er et hurtigt overblik over Ollama vs LM Studio.

| Funktion | Ollama | LM Studio |

| Brugervenlig | Mindre brugervenlig fra start, kræver terminalviden | Begyndervenlig, kræver meget museklik |

| Modelunderstøttelse | Mange populære open-weight modeller: gpt-oss, gemma 3, qwen 3 | Helt det samme som Ollama: gpt-oss, gemma3, qwen3 |

| tilpasning | Meget tilpasselig, integreres nemt via API | Mindre frihed, justér almindelige indstillinger via knapper og skydere |

| Hardwarekrav | Det afhænger af det; større modeller er langsommere uden tilstrækkelig hardware | Igen afhængigt af modelstørrelse og din egen hardware |

| Privatliv | Rigtig godt privatliv som standard, ingen yderligere eksterne API | Chats forbliver lokale, men appen kontakter stadig servere for opdateringer og model-søgning/download. |

| Offline-brug | Fuldt offlineunderstøttelse efter download af modeller | Også fremragende offline når modeller er downloadet |

| Tilgængelige platforme | Linux, Windows, macOS | Linux, Windows, macOS |

- Avancerede modeller: hardwareproblem: Næsten alle ville vælge en større, mere potent model når det er muligt. Men at køre dem på de fleste bærbare computere kan forårsage alvorlige problemer, da større modeller kræver meget mere RAM og VRAM. Det kan betyde langsomme svar, begrænset kontekstlængde eller at modellen slet ikke indlæses.

- Batteriproblemer: At køre LLMs lokalt kan hurtigt dræne dit batteri under høj belastning. Det kan føre til reduceret batterilevetid, for ikke at nævne den irriterende støj fra ventilatorer og køleribber.

Ollama vs LM Studio: Download af modeller

Et andet aspekt af Ollama vs LM Studio er deres forskellige tilgange til at hente modeller. Som nævnt tidligere installerer Ollama ikke lokale LLMs med et enkelt klik. I stedet skal du bruge dets native terminalvindue og kommandolinjer til det. Kommandoerne er dog nemme at forstå.

Her er en hurtig måde at køre modeller på Ollama.

- Download din yndlingsmodel ved at skrive ollama pull gpt-oss eller en anden model efter eget valg (husk at medtage et tag, som du kan vælge fra biblioteket).

Eksempel: ollama pull gpt-oss:20b - Du kan derefter køre modellen med kommandoen ollama run gpt-oss

- Du kan også tilføje yderligere kodningsværktøjer. Du kan for eksempel tilføje Claude med ollama launch claude

Hvis terminaler og kommandoer ikke er det, du er vant til, så prøv LM Studio. Du behøver ikke skrive noget i terminalen for at få det til at virke og hente modeller. Scroll blot til dens indbyggede modeldownloader og søg efter LLMs ved hjælp af nøgleord som Llama eller Gemma.

Alternativt kan du indtaste fulde Hugging Face URLs i søgfeltet.

Der er endda en mulighed for at få adgang til fanen Discover fra hvor som helst ved at trykke ⌘ + 2 på Mac, eller Ctrl + 2 på Windows / Linux.

Ollama: Overlegen hastighed

Nogle gange er hastighed det eneste, der betyder noget for brugere og virksomheder. Det viser sig, at når man taler om Ollama versus LM Studio med hensyn til hastighed, er Ollama hurtigere, men det kan stadig variere mellem forskellige konfigurationer og hardwareopsætninger.

I tilfældet med en Reddit-bruger i subredditen r/ollamabehandlede Ollama hurtigere end LM Studio.

Det er ikke en ubegrundet påstand, for brugeren testede både Ollama og LM Studio ved at køre qwen2.5:1.5b fem gange og beregnede det gennemsnitlige antal tokens pr. sekund.

Ollama versus LM Studio: Ydeevne og hardwarekrav

Ydeevne er hvor Ollama versus LM Studio handler mere om hardware end UI. At opleve lokale LLMs for første gang er bestemt noget helt tredje sammenlignet med de cloud LLMs, vi er vant til. Det føles givende at have en LLM helt for dig selv, indtil du rammer en ydelsesvæg.

I betragtning af at priserne på RAM og VRAM er steget enormt de seneste år, er det ret svært at udstytte maskinen med nok kraft til at køre store LLMs.

Populære modeller optager typisk 24-64GB RAM

Ja, du hørte rigtigt. Hardwarekrav handler ikke om hvem der vinder i Ollama versus LM Studio. Hvis du ønsker en problemfri oplevelse, når du kører populære mellem- til store modeller uden nedgange eller fejl, er dit bedste bud at installere 24-64GB RAM. I de fleste tilfælde bliver selv denne mængde RAM imidlertid irrelevant med længere kontekst og tungere arbejdsbelastninger.

Du kan dog køre mindre, ofte kaldet kvantificerede modeller, på 8-16GB RAM, men du får ikke samme fordele eller ydeevne som med de større, uden at nævne at der stadig vil være nogle kvalitets- og hastighedstab. Desværre er RAM ikke det eneste problem; andre komponenter skal også være kraftige.

Kraftige GPUs er en hjørnesten for at holde frustrationen på afstand

Selvom modeller kan køre på CPUs, spiller dit grafikkort stadig en nøglerolle i at muliggøre din model. Uden et hurtigt GPU og en stor mængde VRAM vil du opleve langsom token-for-token-generering, lange forsinkelser for længere svar, og alt bliver hurtigt uudholdelig.

Skab ikke falske håb, for ikke engang RTX 5070Ti eller RTX 5080 er nok til seriøs deep learning. Det er fordi Ollama selv for nogle 60k+ kontekst-setups nævner cirka 23GB VRAM, hvilket er meget mere end de typiske 16GB VRAM, du får fra disse GPUs.

At opgradere til noget, der ligger over det kraftinterval, er også astronomisk dyrt. Hvis pris ikke er noget, du bekymrer dig om, er der stadig nogle ting GPU-indstillinger at overveje, når du kører lokale LLMs.

Nu er du måske blevet usikker på, hvordan du samler en maskine, der er stærk nok til at køre større lokale LLM-modeller. Dette er vendepunktet for mange mennesker, da de overvejer en anderledes løsning.

En alternativ tilgang, som entusiaster overvejer, er at bruge virtuelle maskiner med kraftig, forudinstalleret hardware. At bruge en VPS (virtual private server) er for eksempel en fremragende måde at forbinde din hjemmepc eller anden personlig hardware til en privat server efter eget valg, med alle forudsætninger allerede installeret.

Hvis du synes, at VPS lyder som en god løsning, anbefaler vi på det bestemteste Cloudzy's Ollama VPS, hvor du kan arbejde i et rent shell. Det kommer med Ollama præinstalleret, så du kan gå i gang med at arbejde med lokale LLMs med fuldstændig privathed. Det er prisvenligt med 12 lokationer, 99,95% oppetid og 24/7-support. Ressourcerne er rigeligt, med dedikerede VCPUs, DDR5 hukommelse og NVMe lagerplads via en forbindelse på op til 40 Gbps.

Ollama vs LM Studio: Hvem skal bruge hvad

Som sagt tidligere er begge platforme yderst funktionelle, og ingen er at foretrække fremfor den anden. Men her kommer det vigtige: de er designet til forskellige arbejdsgange, så det afhænger af hvad du skal bruge det til.

Vælg Ollama til automatisering og udvikling

Når du bruger Ollama, handler det ikke kun om at chatte med en model, men om at bruge den som en komponent i et større projekt. Ollama er ideelt til:

- Udviklere at bygge produkter som chatbots, copilots og andre løsninger baseret på deep learning

- arbejdsgange, der kræver omfattende automatisering såsom scripts, der opsummerer rapporter, eller generering af kladder på baggrund af tidsplan

- Hold som ønsker ensartede modelversioner i ethvert miljø

- enhver bruger, der gerne vil have en API-først tilgang så andre værktøjer kan forbinde sig til modeller løbende

I sidste ende, hvis du ønsker, at modeller skal være pålidelige for dine apps, er Ollama måske dit bedste valg.

LM Studio er det lettere valg til lokale LLMs

Hvis du vil udforske lokale AI-opsætninger uden teknisk besvær, er LM Studio helt klart det bedre valg.

Generelt set er LM Studio bedre til:

- Begyndere som er nervøse for terminalen og dens kommandolinjer

- Forfattere, kreative folk eller studerende som har brug for simpel chatbot-lignende AI-assistance

- mennesker, der afprøver forskellige muligheder som hurtigt vil sammenligne forskellige modeller for at finde deres egen niche

- enhver, der lige er ved at vænne sig til at skrive prompts og gerne vil justere indstillinger uden at skulle skrive kode

Kort sagt: hvis du bare vil downloade og øjeblikkeligt komme i gang med lokale LLMs, vil LM Studio løse dine behov.

Ollama vs LM Studio: Vores anbefaling

Hvis du ser bort fra debatten om Ollama og LM Studio, handler det i praksis om din daglige arbejdsgang og hvad dit hardware kan præstere.

Ollama er generelt:

- Fleksibel og udviklervenlig

Mens LM Studio er:

- Tilgængelig for nybegyndere med dedikeret GUI

Begge kræver kraftfuldt og dyrt hardware for at køre problemfrit. De fleste har ikke mulighed for at køre store lokale LLM modeller på egen hånd. Derfor hvis du vil køre avancerede modeller uden at presse dit hardware til det yderste, prøv Ollama på en dedikeret GPU VPSNedenfor er hyppigt stillede spørgsmål om Ollama vs LM Studio.