Machine learning og dens underkategori, deep learning, kræver en betydelig mængde computerkraft, som kun kan leveres af GPU. Men ikke enhver GPU duer, så her er de bedste GPU til machine learning, hvorfor de er nødvendige, og hvordan du vælger den rigtige til dit projekt.

Hvorfor har jeg brug for en GPU til machine learning?

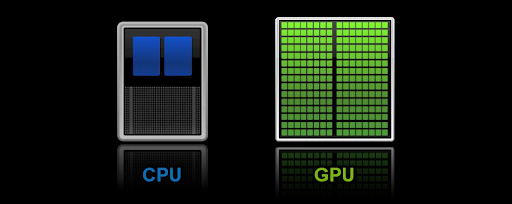

Som nævnt tidligere kræver machine learning meget kraft, som kun GPU kan levere, og selvom CPU fungerer fint til mindre applikationer, vil alt der er tungere end enkelt-trådede opgaver eller generel databehandling kun skabe frustrationer og flaskehalse. Den betydelige forskel i computerkraft kommer ned til GPU's parallel processeringsevne og den store forskel i antallet af kerner. En typisk CPU har måske 4 til 16 kerner, mens de bedste GPU til machine learning kan have tusinder af kerner, især tensor-kerner, som hver kan håndtere en lille del af beregningen på samme tid.

Denne parallelle processering er nøglen til at håndtere matrix- og lineæralgebraberegninger meget bedre end CPU, hvilket er grunden til at GPU er så meget bedre til opgaver som træning af store machine learning-modeller. Men at vælge de bedste GPU til machine learning er ikke let.

Sådan vælger du den bedste GPU til AI og DL

De fleste GPU er kraftfulde nok til typiske opgaver; men machine learning og deep learning kræver et helt tredje niveau af kraft og kvalitet. Så spørgsmålet bliver: Hvad gør en god GPU til deep learning?

En god GPU til deep learning bør have følgende egenskaber og funktioner:

Cuda-kerner, Tensor-kerner og kompatibilitet

AMD og Nvidia tilbyder de bedste GPU til machine learning og DL, hvor sidstnævnte ligger foran. Det skyldes Nvidia's Tensor- og CUDA-kerner. Tensor-kerner håndterer beregninger, som er almindelige inden for AI og machine learning, såsom matrixmultiplikationer og konvolutioner (brugt i dybe neurale netværk). CUDA-kerner tillader på den anden side de bedste GPU til AI-træning at udføre parallel processering ved effektivt at distribuere operationer på tværs af GPU. GPU uden disse to har typisk svært ved ML- og DL-arbejdsbyrder.

Det sagt har AMD's seneste opgraderinger af ROCm-platformen og MI-serieacceleratorerne forbedret dens GPU, og du vil se dem på vores liste. Men Nvidia's GPU er stadig de bedste GPU til deep learning på grund af deres veltilpassede softwareøkosystem og omfattende framework-support (f.eks. TensorFlow, PyTorch, JAX). De bedste GPU til machine learning bør have høj kompatibilitet med disse ML-frameworks, da et misforhold kan føre til ineffektivitet i acceleration, driver- og biblioteksstøtte (f.eks. NVIDIA's cuDNN, TensorRT) og samlet fremtidssikret skalabilitet.

Du har muligvis heller ikke fuld adgang til værktøjer leveret gennem NVIDIA CUDA's toolkit, såsom GPU-accelererede biblioteker, en C- og C++-compiler og runtime, samt optimerings- og fejlfindingsværktøjer.

VRAM (video-RAM), hukommelsestandard og hukommelsesbåndbredde

Som med alt computerforbundet er RAM vigtig, og det samme gælder for de bedste GPUs til machine learning og deep learning. Da datasæt til træning af machine learning-modeller kan blive ekstremt store (op til flere terabyte for deep learning), bør de bedste GPUs til machine learning have rigelig VRAM for hurtig adgang. Det skyldes, at deep learning-modeller kræver betydelig hukommelse til at lagre vægte, aktiviseringer og andre mellemresultater under træning og inferens. De bedste GPUs til AI-træning bør også have anstændig hukommelsesbåndbredde, så du kan flytte rundt på disse store datasæt og fremskynde beregninger.

Til sidst er hukommelsesstandarden en vigtig faktor, når man vælger de bedste GPUs til deep learning. GPUs er typisk GDDR (Graphics Double Data Rate) eller HBM (High Bandwidth Memory). Mens GDDR-hukommelse tilbyder høj båndbredde til ting som machine learning og gaming, bruger de bedste machine learning GPUs HBMs, som har meget højere båndbredde med bedre effektivitet.

| GPU-type | VRAM-kapacitet | Hukommelsesbåndbredde | Hukommelse Standard | Bedst til |

| Indgangsniveau (f.eks. RTX 3060, RTX 4060) | 8GB – 12GB | ~200-300 GB/s | GDDR6 | Små modeller, billedklassificering, hobbyprojekter |

| Mellemklasse (f.eks. RTX 3090, RTX 4090) | 24GB | ~1.000 GB/s | GDDR6X | Store datasæt, dybe neurale netværk, transformere |

| High-end AI GPUs (f.eks. Nvidia A100, H100, AMD MI300X) | 40GB – 80GB | ~1.600+ GB/s | HBM2 | Store sprogmodeller (LLMs), AI-forskning, machine learning på virksomhedsniveau |

| Ekstra high-end GPUs (f.eks. Nvidia H100, AMD Instinct MI300X) | 80GB – 256GB | ~2.000+ GB/s | HBM3 | Storskaleret AI-træning, supercomputing, forskning på massive datasæt |

For dem, der specifikt arbejder på store sprogmodeller som ChatGPT, Cloudzy tilbyder en ChatGPT-optimeret VPS løsning med den kraft, der er nødvendig til problemfri finjustering og inferens.

TFLOPS (Teraflops) og floating-point-præcision

Naturligvis måles GPU-ydeevne ved dens processorkraft. Dette afhænger af tre faktorer: TFLOPS, hukommelsesåndbredde og floating-point-præcision. Vi har allerede diskuteret hukommelsesåndbredde til de bedste GPUs til AI-træning; her er, hvad hver af de to andre betyder, og hvorfor det er vigtig. TFLOPS, eller Teraflops, er enheden, der måler, hvor hurtigt en GPU håndterer komplekse beregninger. Således måler TFLOPS, i stedet for at måle en processors urfrekvens (hvor mange cyklusser en processor gennemfører pr. sekund), hvor mange billioner floating-point-operationer en GPU kan udføre pr. sekund. Kort sagt fortæller TFLOPS dig, hvor kraftfuld en GPU er til at håndtere matematikkrævende opgaver.

Floating-point-præcision viser imidlertid, som navnet antyder, niveauet af nøjagtighed, som GPU vil tillade modellen at opretholde. De bedste GPUs til deep learning bruger højere præcision (f.eks. FP32), som giver mere nøjagtige beregninger, men på bekostning af ydeevne. Lavere præcision (f.eks. FP16) fremskynder behandlingen med lidt reduceret nøjagtighed, hvilket ofte er acceptabelt for AI- og deep learning-opgaver.

Start Blog

Start Blog

Self-host din WordPress på hardware af høj klasse med NVMe-lagerplads og minimal latenstid verden over. Vælg dit yndlingsoperativsystem.

Få WordPress VPS| Præcision | Brugssituation | Eksempler på anvendelser |

| FP32 (enkelt præcision) | Deep learning-modeltrænig | Billedgenkendelse (ResNet, VGG) |

| TF32 (TensorFloat-32) | Blandet-præcisions-træning | NLP, anbefalingssystemer |

| FP16 (Halv Præcision) | Hurtig inferens | Autonome køretøjer, stemmegenkendelse, AI-videoforbedring |

I stedet for at investere meget i fysisk hardware kan du øjeblikkeligt få adgang til Cloudzy's Deep Learning GPU VPS, drevet af RTX 4090s, optimeret til machine learning- og deep learning-arbejdsbelastninger.

Bedste GPU til machine learning i 2025

Nu hvor du har et godt overblik over, hvad de bedste GPUer til machine learning bør have, her er vores liste over de bedste GPUer rangeret efter ydeevne, hukommelsesbåndbredde, hukommelsestype osv.

| GPU | VRAM | Hukommelsesbåndbredde | Hukommelse Standard | TFLOPS | Flydende-komma-præcision | Kompatibilitet |

| NVIDIA H100 NVL | 188 GB | 7.8 TB/s | HBM3 | 3,958 | FP64, FP32, FP16 | CUDA, TensorFlow |

| NVIDIA H100 Tensor Core | 80 GB | 2 TB/s | HBM2 | 1,979 | FP64, FP32, FP16 | CUDA, cuDNN, TensorRT |

| NVIDIA RTX 4090 | 24 GB | 1.008 TB/s | GDDR6X | 82.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA A100 Tensor Core | 48 GB | 768 GB/s | GDDR6 | 40 | FP64, FP32, FP16 | CUDA, cuDNN, TensorRT |

| NVIDIA GeForce RTX 4070 | 12 GB | 504 GB/s | GDDR6X | 35.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX 3090 Ti | 24 GB | 1.008 TB/s | GDDR6X | 40 | FP64, FP32, FP16 | CUDA, cuDNN, TensorRT |

| AMD Radeon Instinct MI300 | 128 GB | 1.6 TB/s | HBM3 | 60 | FP64, FP32, FP16 | ROCm, TensorFlow |

NVIDIA H100 NVL

Den bedste machine learning GPU, H100 NVL, leverer eksceptionel ydeevne til deep learning i stor skala, optimeret til multi-tenant workloads med høj ydeevne.

- Bedst til: Avanceret AI-forskning, træning af storskala-modeller og inferens.

- Ulempe: Meget dyr og primært egnet til enterprise-miljøer eller forskningsfaciliteter.

NVIDIA A100 Tensor Core GPU

H100 leverer massiv ydeevne til neurale netværk med 80 GB højbåndsbredde-hukommelse (HBM2), velegnet til tunge workloads.

- Bedst til: Storskala machine learning-modeller, AI-forskning og cloud-baserede applikationer.

- Ulempe: Dyr, primært rettet mod virksomheder.

NVIDIA RTX 4090

Fremragende til både gaming og AI-workloads med 24 GB GDDR6X-hukommelse og massiv parallel computing-kapacitet.

- Bedst til: High-end ML-opgaver og AI-forskning, der kræver ekstrem computerkraft.

- Ulempe: Strømkrævende, høj pris og stort fysisk omfang.

NVIDIA RTX A6000 Tensor Core GPU

Understøtter AI-applikationer med 48 GB GDDR6-hukommelse, velegnet til arbejdsstationer og professionelle skabere.

- Bedst til: AI-forskning, deep learning og high-performance workloads.

- Ulempe: Høj pris, typisk egnet til professionelle miljøer.

NVIDIA GeForce RTX 4070

God balance mellem pris og ydeevne med stærke ray-tracing-muligheder, 12 GB GDDR6X-hukommelse.

- Bedst til: Entusiaster og mindre virksomheder med ML-behov på mellemniveau.

- Ulempe: Begrænset hukommelse til større datasæt og meget store modeller.

NVIDIA RTX 3090 Ti

NVIDIA RTX 3090 TiHøj hukommelseskapacitet (24 GB GDDR6X) og beregningskraft, perfekt til træning af mellem- til store modeller.

- Bedst til: Entusiaster og forskning inden for AI-behandling, der kræver høj beregningskraft.

- Ulempe: Meget dyr, forbruger meget strøm, og kan være overkill for mindre projekter.

AMD Radeon Instinct MI300

Fremragende til AI- og HPC-arbejdsbelastninger med konkurrencedygtig ydeevne.

- Bedst til: Machine learning-arbejdsbelastninger på AMD-fokuserede opsætninger.

- Ulempe: Mindre etableret inden for deep learning sammenlignet med NVIDIA, færre understøttede frameworks.

Cloudzy's cloud-GPU VPS

En af de bedste GPU'er til machine learning, der findes i dag, er uden tvivl RTX 4090. Det er bare dyrt, det løber op i høje elregninger, og størrelsen kan tvinge dig til at opgradere computerkabinettet eller ændre på alt muligt. Det er besværligt, og det er derfor, vi på Cloudzy nu tilbyder en online GPU til machine learning, så du ikke behøver at bekymre dig om noget af det. Vores GPU VPS er udstyret med op til 2 Nvidia RTX 4090 GPU'er, 4 TB NVMe SSD lagerplads, 25 TB pr. sekund båndbredde og 48 vCPU'er!

Alt til overkommelige priser med både time- og månedlig pay-as-you-go fakturering samt en bred vifte af betalingsmuligheder som PayPal, Alipay, kreditkort (via Stripe), PerfectMoney, Bitcoin og andre kryptovalutaer.

Endelig tilbyder vi en 14-dages pengene-tilbage-garanti, hvis du ikke er tilfreds med vores service!

Augmented Reality (AR)-cloudplatforme er i høj grad afhængige af højtydende GPU'er for at levere realtids-, immersive oplevelser. På samme måde som GPU'er med CUDA og Tensor cores er afgørende for træning af deep learning-modeller, er de lige så vigtige for rendering af komplekse AR-miljøer og understøttelse af AI-drevne funktioner som objektgenkendelse og rumslig kortlægning. På Cloudzy udstyrer vores AR Cloud GPU-teknologi for at sikre stabil ydeevne, lav latenstid og skalerbarhed, hvilket gør det ideelt til virksomheder, der ønsker at udrulde AR-applikationer i stor skala.

Uanset om du bygger AI-applikationer, træner modeller eller udfører forskning, er vores AI VPS-løsninger designet til at levere den bedste GPU-ydeevne til en brøkdel af den normale pris.

Afsluttende tanker

Med stigende behov for beregningskraft og AI-modeller, der bliver større og mere komplekse, vil GPU'er helt sikkert blive en integreret del af vores liv. Så det er bedst at sætte sig ind i dem og forstå, hvordan de fungerer og hvad de er.

Det er grunden til, at jeg stærkt anbefaler, at du tager et kig på Tim Dettmers's artikel om alt, hvad du bør vide om GPU'er, og nogle praktiske tips, når du vælger en GPU. Han er både akademisk anerkendt og velbevandret inden for deep learning.