Con la crescente domanda di LLM locali, molti utenti si trovano confusi nella scelta di quello più adatto, ma usarli non è semplice come potrebbe sembrare. Essendo moderatamente affamati di risorse, alcuni più di altri, molti preferiscono starne alla larga, senza contare le molte ore che i principianti potrebbero passare a fissare il terminale.

Ci sono tuttavia due candidati di spicco che semplificano le cose. Ollama e LM Studio sono due delle piattaforme più utilizzate con performance all'avanguardia per eseguire LLM locali. Ma scegliere tra i due può rivelarsi difficile, poiché ognuno è progettato per serve workflow diversi. Senza ulteriori preamboli, analizziamo il confronto tra Ollama e LM Studio.

Ollama come Strumento Sofisticato per Esperti

Per quanto riguarda gli esecutori di LLM locali, Ollama è un'opzione forte grazie alle sue molte funzionalità. Non solo è altamente configurabile, ma puoi anche accedervi gratuitamente, poiché è una piattaforma open-source supportata dalla comunità.

Sebbene Ollama renda più semplice eseguire LLM locali, è incentrato sulla CLI (command line interface), quindi richiede ancora un po' di conoscenza del terminale. Essere incentrato sulla CLI è un grande vantaggio per i workflow di sviluppo grazie alla sua semplicità. Sebbene non sia facile lavorare con una CLI, è meno dispendioso in termini di tempo capire come funziona rispetto a eseguire LLM locali da soli.

Ollama utilizza il tuo computer personale come mini-server locale con una API HTTP, dando alle tue app e script accesso ai suoi molti modelli, il che significa che risponde ai prompt allo stesso modo di un LLM online, senza inviare i tuoi dati al cloud. Per non parlare del fatto che la sua API consente agli utenti di integrare Ollama e inserirlo in siti web e chatbot.

Grazie alla sua natura CLI, Ollama è anche abbastanza leggero, rendendolo meno esigente in termini di risorse e più orientato alla performance. Questo, tuttavia, non significa che tu possa eseguirlo su un computer datato, ma è comunque promettente per gli utenti che vogliono sfruttare al massimo ogni risorsa e dedicarla al modello LLM stesso.

Detto questo, potresti aver già intuito che Ollama è fortemente orientato ai workflow di sviluppo, e hai ragione. Grazie alla sua facile integrazione, privacy locale e design incentrato sulla API, è la scelta ovvia se sei più orientato verso una mentalità da developer.

Nel dibattito Ollama vs LM Studio, Ollama potrebbe essere più preferibile grazie al suo sviluppo incentrato sulla API. Se una runtime CLI ti risulta troppo estranea, continua a leggere per un'opzione più leggera progettata con la facilità d'uso in mente.

LM Studio: Un'Opzione Intuitiva

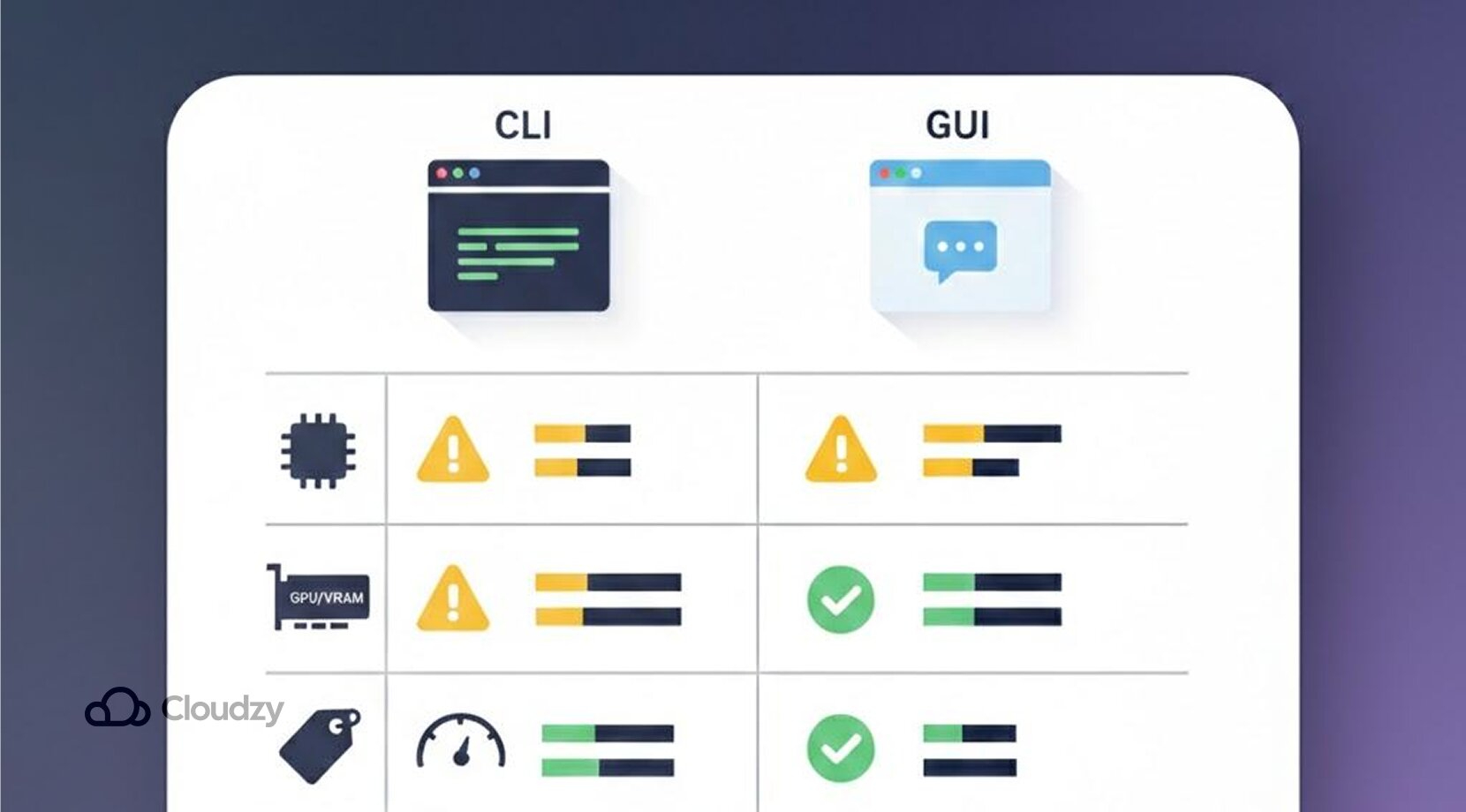

LM Studio contrasta notevolmente con Ollama. Invece di essere un'interfaccia CLI completa, non richiede alcun comando di terminale per funzionare, e poiché è dotato di una GUI (graphical user interface), assomiglia a qualsiasi altra app desktop. Per alcuni principianti, Ollama vs LM Studio si riduce a semplicità CLI vs GUI.

L'approccio di LM Studio nel rimuovere le barriere tecniche va molto lontano nel fornire uno spazio semplice per qualsiasi utente. Invece di aggiungere ed eseguire modelli con righe di comando, puoi semplicemente usare i menu forniti e digitare in una casella simile a una chat. Sembra che chiunque possa usare LM Studio per sperimentare LLM locali, poiché ha un'interfaccia intuitiva come ChatGPT.

Viene inoltre fornito con un pratico browser modelli integrato in cui gli utenti possono scoprire e distribuire qualsiasi modello che preferiscono, dai modelli leggeri pensati per azioni casuali, fino a quelli più potenti per compiti più impegnativi. Inoltre, questo browser fornisce brevi descrizioni dei modelli disponibili e dei casi di uso consigliati, e consente agli utenti di scaricare i modelli con un singolo clic.

Anche se la maggior parte dei modelli sono gratuiti, alcuni potrebbero includere licenze aggiuntive e diritti di utilizzo specifici. Per certi flussi di lavoro, LM Studio offre anche una modalità server locale per integrazioni semplici, ma è pensato principalmente per una UI desktop intuitiva destinata ai principianti. Detto questo, mettiamo a confronto Ollama e LM Studio.

Confronto notevole: Ollama vs LM Studio

Prima di andare avanti, c'è un punto critico da chiarire: la frase "Ollama vs LM Studio" potrebbe suggerire che uno sia oggettivamente migliore dell'altro, ma non è così. Sono progettati per utenti diversi. Ecco un rapido confronto tra Ollama e LM Studio.

| Funzione | Ollama | LM Studio |

| Facilità d'uso | Meno intuitivo inizialmente, richiede conoscenza del terminale | Adatto ai principianti, richiede molti clic del mouse |

| Supporto modelli | Molti modelli open-weight popolari: gpt-oss, gemma 3, qwen 3 | Esattamente gli stessi di Ollama: gpt-oss, gemma3, qwen3 |

| personalizzazione | Altamente personalizzabile, si integra facilmente via API | Meno libertà, regola le impostazioni comuni tramite pulsanti/slider |

| Requisiti hardware | Dipende: i modelli più grandi sono più lenti senza hardware adeguato | Ancora, dipende dalla dimensione del modello e dal tuo hardware |

| Privacy | Eccellente privacy per impostazione predefinita, nessun API esterno aggiuntivo | Le chat rimangono locali, ma l'app contatta ancora i server per aggiornamenti e ricerca/download di modelli. |

| Utilizzo offline | Supporta completamente la modalità offline dopo il download dei modelli | Altrettanto eccellente offline una volta scaricati i modelli |

| Piattaforme disponibili | Linux, Windows, macOS | Linux, Windows, macOS |

- Modelli avanzati, problemi hardware: Chiunque preferirebbe un modello più grande e capace quando possibile. Eseguirli sulla maggior parte dei laptop, però, può causare seri problemi, poiché i modelli più grandi consumano più RAM e VRAM. Questo significa risposte lente, lunghezza del contesto limitata, o il modello che non si carica affatto.

- Problemi di batteria: Eseguire LLMs localmente può scaricare rapidamente la batteria sotto carico pesante. Questo riduce l'autonomia e inoltre i ventilatori e il dissipatore di calore faranno rumore.

Ollama vs LM Studio: Scaricare modelli

Un altro aspetto del confronto Ollama vs LM Studio è il loro approccio diverso al download dei modelli. Come detto, Ollama non installa LLMs locali con un solo clic. Invece, devi usare il suo terminale nativo e comandi da riga di comando. I comandi, però, sono semplici da capire.

Ecco come eseguire modelli su Ollama.

- Scarica il tuo modello preferito digitando ollama pull gpt-oss o qualsiasi altro modello che preferisci. Non dimenticare di includere un tag, che puoi scegliere dalla libreria.

Esempio: ollama pull gpt-oss:20b - Puoi poi eseguire il modello con il comando ollama run gpt-oss

- Puoi aggiungere anche altri strumenti di codifica. Ad esempio, puoi aggiungere Claude con ollama launch claude

Se non sei abituato a terminali e comandi, prova LM Studio. Non devi digitare nulla nel terminale per farlo funzionare e scaricare modelli. Scorri semplicemente fino allo strumento di download integrato e cerca LLMs usando parole chiave come Llama o Gemma.

In alternativa, puoi inserire i Hugging Face URLs completi nella barra di ricerca.

C'è persino un'opzione per accedere alla scheda discover da qualsiasi punto premendo ⌘ + 2 su Mac, oppure Ctrl + 2 su Windows / Linux.

Ollama: superiore in termini di velocità

A volte la velocità è l'unica cosa che conta per gli utenti e le aziende. Risulta che, quando si confronta Ollama con LM Studio in termini di velocità, Ollama è più veloce, anche se questo potrebbe variare a seconda delle diverse configurazioni e setup hardware.

Nel caso di un utente Reddit nel subreddit r/ollama, Ollama ha elaborato più velocemente di LM Studio.

Non è un'affermazione senza fondamento, perché l'utente ha testato sia Ollama che LM Studio eseguendo qwen2.5:1.5b cinque volte e calcolando la media di token al secondo.

Ollama vs LM Studio: Prestazioni e Requisiti Hardware

Le prestazioni nel confronto Ollama vs LM Studio dipendono più dall'hardware che dall'interfaccia. Provare i LLMs locali per la prima volta è decisamente diverso dai LLMs nel cloud a cui siamo abituati. Sentirti padrone di un LLM tutto per te è emozionante, finché non raggiungi il limite di prestazioni.

Considerando come i prezzi di RAM e VRAM sono schizzati alle stelle negli ultimi anni, è piuttosto difficile equipaggiare il tuo computer con abbastanza potenza per eseguire LLMs grandi.

I Modelli Popolari Tendono a Gobble up 24-64GB di RAM

Sì, hai letto bene. I requisiti hardware non riguardano chi vince nel confronto Ollama vs LM Studio. Se desideri un'esperienza fluida durante l'esecuzione di modelli da medi a grandi senza rallentamenti o errori, la tua migliore opzione è installare 24-64GB di RAM. Nella maggior parte dei casi, tuttavia, anche quella quantità di RAM diventa irrilevante con contesti più lunghi e carichi di lavoro più pesanti.

Puoi comunque eseguire modelli più piccoli, spesso chiamati quantizzati, su 8-16GB di RAM, ma non ottieni lo stesso comfort o le stesse prestazioni di quelli più grandi, per non parlare dei compromessi di qualità e velocità. Sfortunatamente, RAM non è l'unico problema. Anche gli altri componenti devono essere robusti.

GPUs Potenti sono Fondamentali per Evitare Frustrazioni

Sebbene i modelli possano funzionare su CPUs, la tua unità di elaborazione grafica gioca comunque un ruolo chiave nell'esecuzione del modello. Senza un GPU veloce e una grande quantità di VRAM, sperimenterai una generazione di token lenta, lunghi ritardi per risposte più lunghe, e tutto diventa rapidamente insostenibile.

Non illuderti perché nemmeno il potente RTX 5070Ti né l'RTX 5080 è sufficiente per il deep learning serio. Questo perché per alcuni setup con contesto di 60k+, Ollama stesso menziona ~23GB di VRAM, molto più dei soliti 16GB di VRAM che ottieni da quei GPUs.

Going per qualsiasi cosa al di sopra di questa fascia di potenza è anche astronomicamente costoso. Se il prezzo non è una preoccupazione per te, ci sono ancora alcuni Opzioni GPU da considerare durante l'esecuzione di LLMs locali.

A questo punto, potresti essere confuso su come assemblare un computer abbastanza potente per eseguire modelli LLM locali più grandi. Questo è il punto di svolta per molte persone che considerano una soluzione diversa.

Un approccio alternativo che gli entusiasti considerano è l'uso di macchine virtuali con hardware robusto e preinstallato. Ad esempio, usare un VPS (server privato virtuale) è un ottimo modo per connettere il tuo laptop domestico o altro hardware personale a un server privato di tua scelta, con tutti i prerequisiti già configurati.

Se utilizzare VPS ti sembra una buona soluzione, allora ti consigliamo vivamente Cloudzy's Ollama VPS, dove puoi lavorare in un ambiente pulito. Viene fornito con Ollama preinstallato, quindi puoi iniziare subito a lavorare con LLMs locali con privacy completa. È conveniente con 12 posizioni, uptime del 99,95% e supporto 24/7. Le risorse sono abbondanti, con VCPUs dedicati, memoria DDR5 e storage NVMe su un collegamento fino a 40 Gbps.

Ollama vs LM Studio: Chi ha bisogno di cosa

Come detto prima, entrambe le piattaforme sono molto funzionali e nessuna è preferibile, ma c'è un però. Ognuna è adatta a un workflow diverso, quindi dipende da cosa ti serve.

Scegli Ollama per l'automazione e lo sviluppo

Il tuo obiettivo quando usi Ollama non è solo chattare con un modello, ma usarlo come componente all'interno di un altro progetto. Ollama è ideale per:

- Sviluppatori creare prodotti come chatbot, copilot e altri prodotti che richiedono deep learning

- Workflow che richiedono molta automazione, come script per riassumere report o generare bozze in programma

- Team che hanno bisogno di versioni di modelli consistenti in qualsiasi ambiente

- Chiunque cerchi un approccio API-first, in modo che altri strumenti possano connettersi ai modelli regolarmente

Alla fine, se vuoi che i modelli siano affidabili per le tue app, Ollama potrebbe essere la scelta migliore.

LM Studio è l'opzione più semplice per iniziare con LLMs locali

Se cerchi di esplorare configurazioni di AI locale senza complicazioni tecniche, LM Studio è decisamente l'opzione migliore.

In generale, LM Studio è migliore per:

- Principianti chi ha paura del terminale e dei suoi comandi

- Scrittori, creator o studenti che hanno bisogno di una semplice chat con assistenza IA

- Persone che provano diverse opzioni, cercando di confrontare velocemente vari modelli per trovare il loro settore

- Chiunque stia iniziando a capire come fare prompt e vuole regolare le impostazioni senza digitare

Insomma, se vuoi scaricare e iniziare subito con LLMs locali, LM Studio farà al caso tuo.

Ollama vs LM Studio: La nostra raccomandazione finale

Se ignori il clamore intorno alla competizione tra Ollama e LM Studio, quello che conta davvero è l'esperienza quotidiana, basata sul tuo flusso di lavoro e sui limiti dell'hardware.

Ollama in generale:

- Flessibile e orientato agli sviluppatori

Mentre LM Studio è:

- Accessibile ai principianti con un'interfaccia grafica dedicata

Entrambi richiedono hardware potente e costoso per funzionare bene. Molte persone non hanno la possibilità di far girare un grande LLM locale autonomamente. Per questo motivo, se vuoi eseguire modelli avanzati senza stressare il tuo hardware, considera di provare Ollama su un GPU VPS dedicatoI notice the text provided is incomplete: ". Below are" Could you please provide the full text you'd like me to translate to Italian? That way I can give you an accurate translation. domande comuni su Ollama vs LM Studio.