機械学習とその部門である深層学習には、GPUによってのみ提供できる膨大な計算能力が必要です。ただし、どのGPUでもよいわけではないので、機械学習に最適なGPU、それらが必要な理由、そしてプロジェクトに適切なものを選ぶ方法をここに示します。

機械学習になぜGPUが必要なのか?

前述の通り、機械学習にはGPUのみが提供できる膨大な電力が必要です。小規模なアプリケーションではCPUでも十分ですが、シングルスレッドのタスクや汎用計算よりも重い処理は、フラストレーションとボトルネックをもたらすだけです。計算能力の大きな差は、GPUの並列処理能力とコア数の大きな差に起因しています。典型的なCPUは4〜16コアを持つかもしれませんが、機械学習に最適なGPUは数千のコアを持つ可能性があり、特にTensorコア(それぞれ計算の小さな部分を同時に処理できる)です。

この並列処理は、行列と線形代数の計算をCPUよりもはるかに効率よく処理するための鍵です。このため、大規模な機械学習モデルの訓練などのタスクにはGPUがはるかに優れています。しかし、機械学習に最適なGPUを選ぶことは簡単ではありません。

AIと深層学習に最適なGPUの選び方

ほとんどのGPUは一般的なタスクを処理するのに十分な性能を持っていますが、機械学習と深層学習にはさらに高いレベルの性能と品質が必要です。残された質問は:深層学習に適したGPUとは何か?

深層学習に適したGPUには、以下の資質と機能が必要です:

CUDAコア、Tensorコア、互換性

AMDとNvidiaは機械学習とDLに最適なGPUを提供します。後者が特に優れています。これはNvidiaのTensorとCUDAコアのおかげです。TensorコアはAIと機械学習で一般的な計算(行列乗算や深いニューラルネットワークで使用される畳み込み)を処理します。一方、CUDAコアは、AI訓練に最適なGPUが、GPU全体に操作を効率的に分散することで並列処理を実行することを可能にします。これら2つがないGPUは、通常、MLとDLのワークロードで苦労します。

とはいえ、AMDのROCmプラットフォームとMIシリーズアクセラレータへの最近のアップグレードはそのGPUを改善しており、当社のリストに掲載されます。しかし、NvidiaのGPUは依然として深層学習に最適なGPUであり、その理由はよく最適化されたソフトウェアエコシステムと広範なフレームワークサポート(例:TensorFlow、PyTorch、JAX)です。機械学習に最適なGPUは、これらのMLフレームワークとの高い互換性を持つべきです。不一致は加速の非効率性、ドライバーとライブラリサポート(例:NVIDIAのcuDNN、TensorRT)、および全体的な将来性のあるスケーラビリティを招く可能性があります。

NVIDIA CUDA ツールキットを通じて提供される GPU アクセラレーテッド ライブラリ、C および C++ コンパイラーとランタイム、最適化およびデバッグ ツールなどのツールへのフルアクセスがない場合があります。

VRAM(ビデオRAM)、メモリ規格、メモリ帯域幅

コンピューター関連では何でもそうですが、RAM は重要です。機械学習と深層学習に最適な GPU にも同じことが当てはまります。機械学習モデルの訓練用データセットは非常に大きくなる可能性があります (深層学習の場合、複数 TB に達する可能性があります)。そのため、機械学習に最適な GPU は、高速アクセスのために十分な VRAM を備えている必要があります。深層学習モデルは、訓練と推論中に重み、活性化、その他の中間データを保存するために大量のメモリが必要だからです。AI 訓練に最適な GPU は、これらの大規模データセットを移動させ、計算を高速化するために、適切なメモリ帯域幅も備えている必要があります。

最後に、メモリ標準は深層学習に最適な GPU を選択する際の重要な要素です。GPU は通常、GDDR (Graphics Double Data Rate) または HBM (High Bandwidth Memory) です。GDDR メモリは機械学習やゲームなど向けに高い帯域幅を提供しますが、機械学習に最適な GPU は、はるかに高い帯域幅と優れた効率を備えた HBM を使用しています。

| GPU タイプ | VRAM容量 | メモリ帯域幅 | メモリ標準 | 最適な用途 |

| エントリーレベル (RTX 3060、RTX 4060 など) | 8GB – 12GB | ~200-300 GB/s | GDDR6 | 小規模モデル、画像分類、趣味のプロジェクト |

| ミッドレンジ (RTX 3090、RTX 4090 など) | 24GB | ~1,000 GB/s | GDDR6X | 大規模データセット、深層ニューラル ネットワーク、トランスフォーマー |

| ハイエンド AI GPU (Nvidia A100、H100、AMD MI300X など) | 40GB – 80GB | ~1,600+ GB/秒 | HBM2 | 大規模言語モデル (LLM)、AI 研究、エンタープライズレベルの機械学習 |

| 超ハイエンド GPU (Nvidia H100、AMD Instinct MI300X など) | 80GB – 256GB | ~2,000+ GB/秒 | HBM3 | 大規模な AI 訓練、スーパーコンピューティング、膨大なデータセットでの研究 |

特に次のように取り組んでいるユーザーの場合: ChatGPT のような大規模言語モデル、Cloudzyが提供する ChatGPT 最適化 VPS スムーズなファインチューニングと推論に必要なパワーを備えたソリューション。

TFLOPS(テラフロップス)と浮動小数点精度

当然のことながら、GPU の性能は処理能力によって測定されます。これは TFLOPS、メモリ帯域幅、浮動小数点精度の 3 つの要素に依存しています。AI 訓練に最適な GPU 向けのメモリ帯域幅については既に説明しましたので、ここでは他の 2 つが何を意味するのか、そしてなぜそれが重要なのかを説明します。TFLOPS (テラフロップス) は、GPU がどのくらい速く複雑な計算を処理するかを測定する単位です。つまり、プロセッサーのクロック速度 (プロセッサーが 1 秒間に完了するサイクル数) を測定するのではなく、TFLOPS は GPU が 1 秒間に実行できる浮動小数点演算が何兆回かを測定しています。簡潔に言うと、TFLOPS は GPU が数学計算量が多いタスクをどの程度処理できるかを示します。

一方、浮動小数点精度は、その名の通り、GPU がモデルで維持できる精度のレベルを示しています。深層学習に最適な GPU は、より高い精度 (FP32 など) を使用しており、より正確な計算を提供しますが、パフォーマンスコストがかかります。低い精度 (FP16 など) は精度をわずかに低下させながら処理を高速化し、これは AI や深層学習タスクでよく受け入れられています。

ブログを始める

ブログを始める

WordPress をハイエンドハードウェア上で自己ホストしてください。NVMe ストレージを備えており、世界中で最小限のレイテンシーを実現します。お好みのディストロを選択できます。

WordPress VPS を取得する| 精度 | ユースケース | 使用例 |

| FP32(単精度) | 深層学習モデルの訓練 | 画像認識 (ResNet、VGG) |

| TF32 (TensorFloat-32) | 混合精度訓練 | 自然言語処理、推奨システム |

| FP16(半精度) | 高速推論 | 自動運転、音声認識、AI ビデオ強化 |

物理ハードウェアに大きく投資する代わりに、すぐにアクセスできます Cloudzy の Deep Learning GPU VPS。RTX 4090 で駆動、機械学習と深層学習のワークロード向けに最適化されています。

2025年の機械学習に最適なGPU

機械学習に最適なGPUの特徴が分かったところで、ピーク性能、メモリ帯域幅、VRAMなどでランク付けしたGPUのリストを紹介します。

| GPU | VRAM | メモリ帯域幅 | メモリ標準 | TFLOPS | 浮動小数点精度 | 互換性 |

| NVIDIA H100 NVL | 188 GB | 7.8 TB/s | HBM3 | 3,958 | FP64, FP32, FP16 | CUDA、TensorFlow |

| NVIDIA A100 Tensor Core | 80 GB | 2 TB/s | HBM2 | 1,979 | FP64, FP32, FP16 | CUDA、TensorFlow、PyTorch |

| NVIDIA RTX 4090 | 24 GB | 1.008 TB/s | GDDR6X | 82.6 | FP32, FP16 | CUDA、TensorFlow |

| NVIDIA RTX A6000 Tensor Core | 48 GB | 768 GB/s | GDDR6 | 40 | FP64, FP32, FP16 | CUDA、TensorFlow、PyTorch |

| NVIDIA GeForce RTX 4070 | 12 GB | 504 GB/s | GDDR6X | 35.6 | FP32, FP16 | CUDA、TensorFlow |

| NVIDIA RTX 3090 Ti | 24 GB | 1.008 TB/s | GDDR6X | 40 | FP64, FP32, FP16 | CUDA、TensorFlow、PyTorch |

| AMD Radeon Instinct MI300 | 128 GB | 1.6 TB/s | HBM3 | 60 | FP64, FP32, FP16 | ROCm、TensorFlow |

NVIDIA H100 NVL

最高性能の機械学習GPU「H100 NVL」は、マルチテナント環境での大規模深層学習に特化し、高性能なワークロードに最適化されています。

- 最適な用途: 最先端のAI研究、大規模モデルトレーニング、推論処理。

- 欠点: 非常に高額で、エンタープライズレベルまたは研究機関向けです。

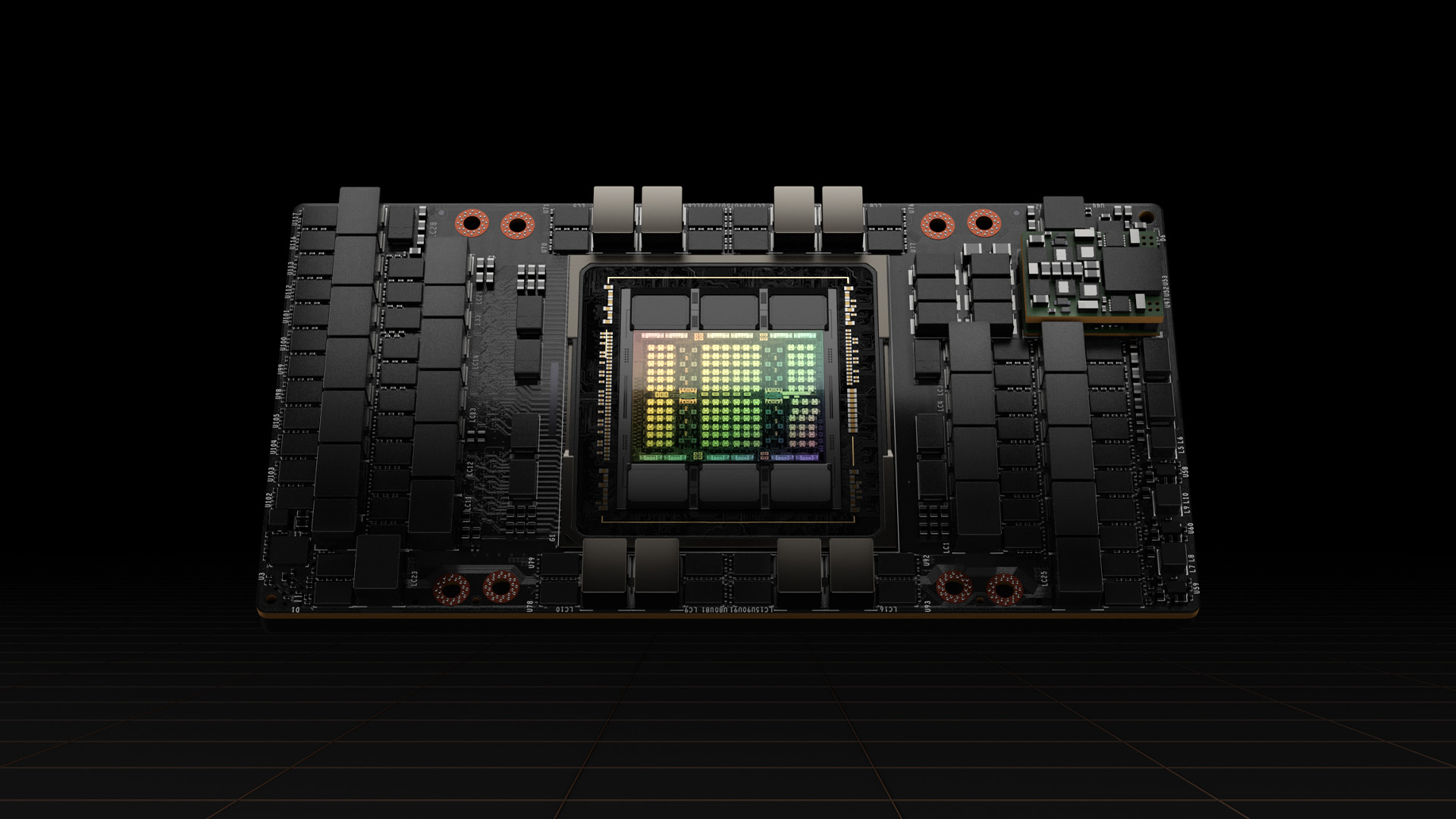

NVIDIA A100 Tensor Core GPU

A100は80 GBの高帯域幅メモリ(HBM2)を搭載し、ニューラルネットワーク向けに強力な性能を発揮します。重いワークロード処理に適しています。

- 最適な用途: 大規模機械学習モデル、AI研究、クラウドベースのアプリケーション。

- 欠点: 高額で、主にエンタープライズ向けです。

NVIDIA RTX 4090

ゲーミングとAIの両方のワークロードに優れ、24 GBのGDDR6Xメモリと強力な並列計算能力を備えています。

- 最適な用途: 高度なML処理とAI研究、極度の計算力が必要なタスク。

- 欠点: 消費電力が大きく、高額で、サイズも大きいです。

NVIDIA RTX A6000 テンサーコア GPU

48 GBのGDDR6メモリを搭載し、AI機能をサポートします。ワークステーションとプロフェッショナル向けの用途に最適です。

- 最適な用途: AI研究、深層学習、高性能ワークロード。

- 欠点: 高額で、専門的な環境向けです。

NVIDIA GeForce RTX 4070

Goは価格と性能のバランスが取れており、12 GBのGDDR6Xメモリで強力なレイトレーシング機能を備えています。

- 最適な用途: 中規模な機械学習ニーズを持つ愛好家や小規模企業。

- 欠点: 大規模データセットと超大型モデル向けのVRAMが限定的です。

NVIDIA RTX 3090 Ti

NVIDIA RTX 3090 Ti。高いメモリ容量(24 GB GDDR6X)と演算能力を備えており、中規模から大規模のモデル学習に最適です。

- 最適な用途: 強力なAI処理が必要な研究者やエンスージアスト向け。

- 欠点: 非常に高額で、電力消費が多く、小規模プロジェクトには過剰性能な場合があります。

AMD Radeon Instinct MI300

AIとHPCワークロードに優れており、競争力のあるパフォーマンスを発揮します。

- 最適な用途: AMD中心のセットアップでのマシンラーニングワークロード。

- 欠点: NVIDIAと比べてディープラーニングでの実績が少なく、対応するフレームワークが限定的です。

CloudzyのクラウドGPU VPS

今日、機械学習に最適なGPUの1つは確実にRTX 4090です。ただし、非常に高額で、電気代が増加し、サイズが大きいためコンピュータケースの大型化やパーツの変更を余儀なくされることがあります。厄介な問題があります。だからこそ、Cloudzyでは機械学習向けオンラインXQNT0011ZZを提供しており、こうした心配がありません。当社の GPU VPS は最大2つのNvidia RTX 4090 GPU、4 TBのNVMe SSDストレージ、25 TB/秒の帯域幅、48 vCPUを備えています。

すべて手頃な価格で、時間単位と月単位の従量課金制から選べます。PayPal、Alipay、クレジットカード(Stripe経由)、PerfectMoney、Bitcoin、その他の暗号資産など、豊富な支払いオプションもご用意しています。

万が一当サービスにご不満の場合は、14日間の返金保証をご用意しています。

拡張現実(AR)クラウドプラットフォームは 高性能なGPU に大きく依存して、リアルタイムで没入感のある体験を提供しています。CUDAとTensorコアを備えたGPUがディープラーニングモデルの学習に不可欠であるのと同様に、複雑なAR環境のレンダリングと物体認識や空間マッピングなどのAI駆動機能のサポートに不可欠です。Cloudzyでは、当社の AR Cloud は最先端のGPU技術を活用して、シームレスなパフォーマンス、低遅延、スケーラビリティを確保し、大規模でAR アプリケーションをデプロイしたい企業に最適です。

AIアプリケーションの構築、モデルの学習、研究の実施など、当社の AI VPSソリューション は通常価格の数分の一で最高のGPUパフォーマンスを実現するよう設計されています。

最後に

計算能力の需要が高まり、AIモデルがより大規模で複雑になるにつれて、GPUは間違いなく私たちの生活に欠かせない存在になります。だからこそ、それらについて学び、どのように機能し何であるかを理解することが重要です。

だから、ぜひご一読ください。 ティム・デットマーズのGPUに関するすべての情報と、GPU選びの実践的なアドバイスについて。彼は学位も取得しており、ディープラーニングに精通しています。