Nu lokale LLM's steeds populairder worden, weten veel gebruikers niet goed welke ze moeten kiezen. Maar ze gebruiken is ook niet zo eenvoudig als het lijkt. Ze vragen relatief veel rekenkracht, sommige meer dan andere, waardoor veel mensen er liever niet aan beginnen. Beginners kunnen bovendien uren naar de terminal staren voordat ze er grip op krijgen.

Er zijn echter twee uitgesproken kandidaten die het leven een stuk eenvoudiger maken. Ollama en LM Studio zijn twee van de meest gebruikte platforms voor het draaien van lokale LLM's, elk met uitstekende prestaties. Kiezen tussen de twee is niet altijd eenvoudig, want ze zijn elk ontworpen voor andere workflows. Laten we zonder verder oponthoud kijken naar Ollama vs LM Studio.

Ollama: een tool voor technisch onderlegde gebruikers

Als het gaat om lokale LLM-runners is Ollama een sterke keuze dankzij zijn uitgebreide mogelijkheden. Het is sterk configureerbaar en gratis beschikbaar als community-gedreven open-sourceplatform.

Hoewel Ollama het draaien van lokale LLM's vereenvoudigt, is het CLI-first (command line interface), wat enige kennis van de terminal vereist. Dat CLI-first karakter is een groot voordeel voor ontwikkelworkflows vanwege de eenvoud. Werken met een CLI is geen triviale zaak, maar het is minder tijdrovend dan lokale LLM's volledig zelf opzetten.

Ollama maakt van je eigen computer een lokale miniserver met een HTTP API, waardoor je apps en scripts toegang krijgen tot de vele beschikbare modellen. Het reageert op prompts zoals een online LLM dat zou doen, zonder je data naar de cloud te sturen. Bovendien stelt de API gebruikers in staat om Ollama te integreren in websites en chatbots.

Door zijn CLI-karakter is Ollama ook lichtgewicht: minder resource-intensief en meer gericht op prestaties. Dat betekent niet dat je het op een verouderde computer kunt draaien, maar het is veelbelovend voor gebruikers die elke beschikbare resource willen benutten en direct naar het LLM-model willen sturen.

Na alles wat hierboven staat, zul je al hebben geraden dat Ollama sterk gericht is op ontwikkelworkflows, en dat klopt. Dankzij de eenvoudige integratie, lokale privacy en API-first opzet is het een logische keuze als je een developer-mindset hebt.

In het Ollama vs LM Studio-debat kan Ollama de voorkeur verdienen vanwege zijn API-first aanpak. Als een CLI-runtime je te ver gaat, lees dan verder voor een lichtere optie die is ontworpen met gebruiksgemak als uitgangspunt.

LM Studio: een gebruiksvriendelijke optie

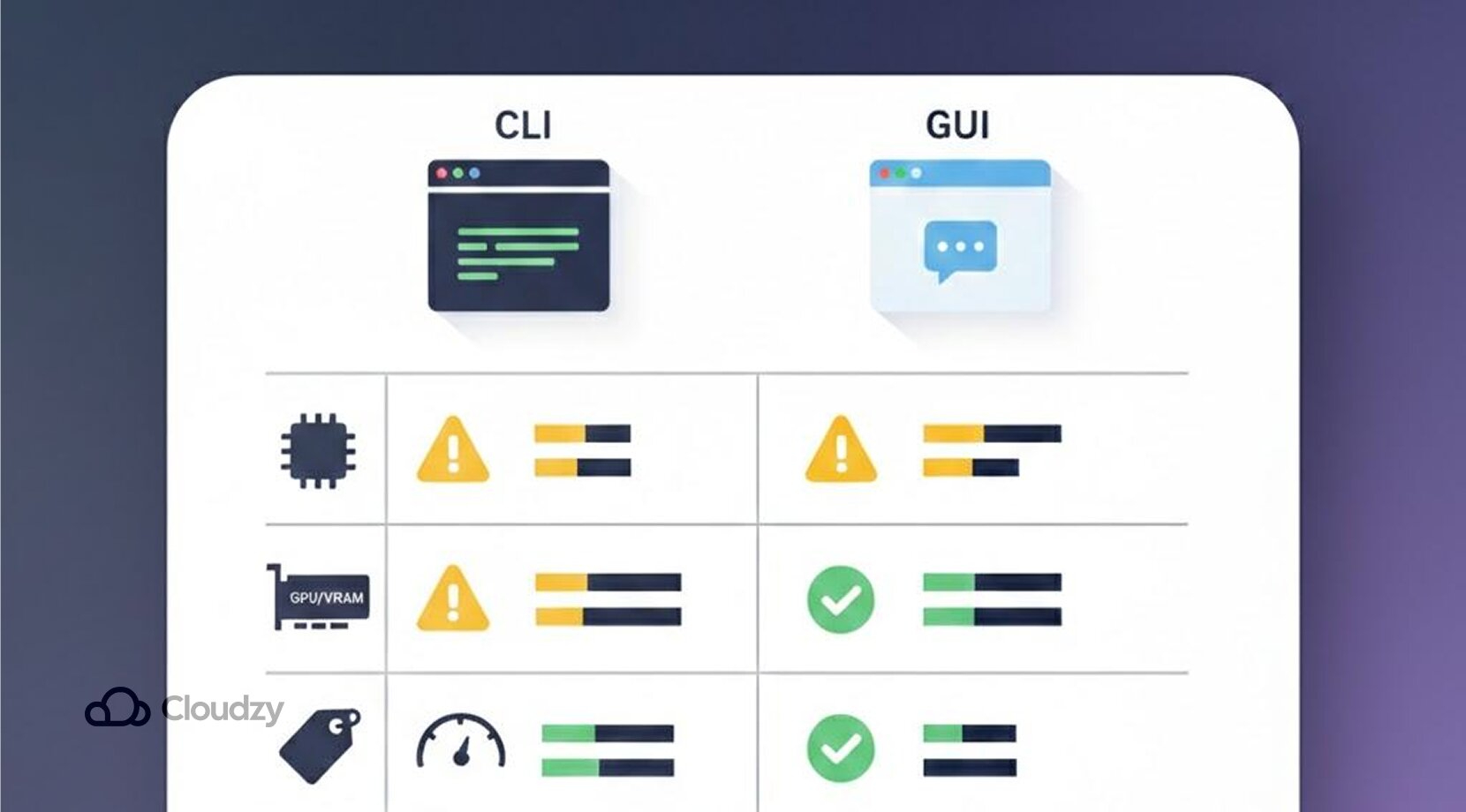

LM Studio staat in schril contrast met Ollama. In plaats van een volwaardige CLI-interface te zijn, vereist het geen enkele terminalcommando om te draaien. Het beschikt over een GUI (graphical user interface) en ziet eruit als elke andere desktopapp. Voor beginners draait Ollama vs LM Studio vaak neer op: CLI-eenvoud tegenover een GUI.

LM Studio verlaagt de technische drempel aanzienlijk en biedt een toegankelijke omgeving voor elke gebruiker. In plaats van modellen via de commandoregel toe te voegen en te starten, gebruik je gewoon de meegeleverde menu's en typ je in een chatachtig tekstvak. LM Studio ziet er zo vertrouwd uit als ChatGPT, zodat vrijwel iedereen er meteen mee uit de voeten kan.

Het beschikt zelfs over een handige ingebouwde modelbrowser waarmee gebruikers modellen kunnen ontdekken en starten naar keuze, van lichte modellen voor alledaagse taken tot zware modellen voor veeleisende opdrachten. De browser toont korte beschrijvingen van beschikbare modellen en aanbevolen toepassingen, en laat gebruikers modellen met één klik downloaden.

De meeste modellen zijn gratis te downloaden, maar sommige kunnen aanvullende licentie- en gebruiksvoorwaarden hebben. Voor bepaalde workflows biedt LM Studio ook een lokale servermodus voor eenvoudige integraties, maar de focus ligt primair op een toegankelijke desktop-UI voor beginners. Maar laten we nu Ollama en LM Studio naast elkaar leggen.

Belangrijke observaties: Ollama vs LM Studio

Voordat we verder gaan, moet één belangrijk punt worden benoemd: de formulering "Ollama vs LM Studio" kan de indruk wekken dat de ene objectief beter is dan de andere, maar zo simpel is het niet. Ze zijn bedoeld voor verschillende doelgroepen. Hier volgt een beknopt overzicht van Ollama vs LM Studio.

| Functie | Ollama | LM Studio |

| Gebruiksgemak | Minder toegankelijk in het begin, vereist kennis van de terminal | Beginnersvriendelijk, werkt volledig met muisklikken |

| Modelondersteuning | Veel populaire open-weight modellen, gpt-oss, gemma 3, qwen 3 | Hetzelfde als Ollama. gpt-oss, gemma3, qwen3 |

| aanpassing | Zeer aanpasbaar, integreert eenvoudig via API | Minder vrijheid, pas veelgebruikte instellingen aan via schakelaars en schuifregelaars |

| Hardwarevereisten | Dat hangt ervan af; grotere modellen zijn trager zonder voldoende hardware | Ook hier geldt: afhankelijk van de modelgrootte en je eigen hardware |

| Privacy | Standaard goede privacy, geen extra externe API | Chats blijven lokaal; de app maakt wel verbinding met servers voor updates en het zoeken en downloaden van modellen. |

| Offline gebruik | Volledig offline te gebruiken na het downloaden van modellen | Ook prima offline zodra modellen zijn gedownload |

| Beschikbare platforms | Linux, Windows, macOS | Linux, Windows, macOS |

- Zware hardware vereist voor geavanceerde modellen: Wie de kans heeft, kiest al snel voor een groter en krachtiger model. Op de meeste laptops kan dat echter serieuze problemen veroorzaken, omdat grotere modellen meer RAM- en VRAM-vermogen vragen. Dit kan leiden tot trage antwoorden, een beperkte contextlengte of een model dat helemaal niet laadt.

- Batterijtproblemen: Het lokaal draaien van LLMs kan je batterij bij intensief gebruik snel leegzuigen. Dit verkort de levensduur van je batterij en zorgt voor het vervelende geraas van ventilatoren en koellichamen.

Ollama vs LM Studio: modellen ophalen

Een ander verschil tussen Ollama en LM Studio is de manier waarop ze modellen ophalen. Zoals eerder vermeld installeert Ollama geen lokale LLMs met één klik. In plaats daarvan gebruik je het ingebouwde terminalvenster en opdrachtregels. Die opdrachten zijn overigens eenvoudig te begrijpen.

Zo start je snel een model op Ollama.

- Haal je favoriete model op door ollama pull gpt-oss in te typen, of een ander model naar keuze. Vergeet niet een tag op te geven; die kun je kiezen uit de bibliotheek.

Voorbeeld: ollama pull gpt-oss:20b - Je kunt het betreffende model vervolgens starten met het commando ollama run gpt-oss

- Je kunt ook aanvullende programmeerhulpmiddelen toevoegen. Claude voeg je bijvoorbeeld toe met ollama launch claude

Werk je liever niet met terminals en opdrachten, probeer dan LM Studio. Je hoeft niets in een terminal te typen om ermee aan de slag te gaan en modellen te downloaden. Blader gewoon naar de ingebouwde modeldownloader en zoek naar LLMs met trefwoorden zoals Llama of Gemma.

Je kunt ook volledige Hugging Face URLs invoeren in de zoekbalk.

Er is zelfs een optie om het ontdektabblad overal te openen door te drukken op ⌘ + 2 op Mac, of Ctrl + 2 op Windows / Linux.

Ollama: sneller dan de rest

Soms is snelheid het enige wat telt, voor gebruikers én bedrijven. Als het gaat om Ollama vs LM Studio op het gebied van snelheid, wint Ollama. Dat gezegd hebbende, kan het verschil variëren afhankelijk van de configuratie en hardware.

Een Reddit-gebruiker in de r/ollama subreddit verwerkte Ollama sneller dan LM Studio.

Dat is geen ongegronde bewering: de gebruiker testte zowel Ollama als LM Studio door qwen2.5:1.5b vijf keer uit te voeren en berekende het gemiddeld aantal tokens per seconde.

Ollama vs LM Studio: Prestaties en hardwarevereisten

Als het gaat om prestaties, draait de vergelijking tussen Ollama en LM Studio meer om hardware dan om de interface. Lokale LLMs voor het eerst gebruiken is een heel andere ervaring dan de cloud-LLMs waar we aan gewend zijn. Het voelt geweldig om een LLM helemaal voor jezelf te hebben, totdat je tegen een prestatielimiet aanloopt.

Omdat de prijzen van RAM en VRAM de afgelopen jaren enorm zijn gestegen, is het behoorlijk moeilijk om je machine krachtig genoeg uit te rusten om grote LLMs te draaien.

Populaire modellen verbruiken al snel 24-64 GB RAM

Je leest het goed. Bij Ollama vs LM Studio gaat het bij hardwarevereisten niet om wie wint. Wil je populaire middelgrote tot grote modellen soepel draaien zonder vertragingen of fouten, dan heb je 24-64 GB RAM nodig. In de meeste gevallen schiet zelfs die hoeveelheid tekort bij langere context en zwaardere workloads.

Je kunt kleinere, zogenaamde gekwantiseerde modellen draaien op 8-16 GB RAM, maar dan lever je in op kwaliteit en prestaties vergeleken met de grotere modellen. Er zullen altijd wisselwerken zijn op het gebied van kwaliteit en snelheid. RAM is bovendien niet het enige knelpunt: ook de overige componenten moeten sterk genoeg zijn.

Een krachtige GPU is essentieel om frustratie te voorkomen

Hoewel modellen op CPUs kunnen draaien, speelt je grafische processor nog steeds een belangrijke rol. Zonder een snelle GPU en voldoende VRAM krijg je trage token-voor-token generatie, lange wachttijden bij langere antwoorden, en de ervaring wordt al snel ondraaglijk.

Maak je geen illusies, want zelfs de RTX 5070Ti en de RTX 5080 zijn niet krachtig genoeg voor serieus deep learning. Voor sommige setups met 60.000+ context noemt Ollama zelf ongeveer 23 GB VRAM als vereiste, wat aanzienlijk meer is dan de typische 16 GB VRAM die je met die GPUs krijgt.

Alles met meer vermogen is ook astronomisch duur. Als prijs geen probleem is, zijn er nog andere GPU-opties waarmee je rekening moet houden bij het draaien van lokale LLMs.

Op dit punt vraag je je misschien af hoe je een machine samenstelt die krachtig genoeg is voor grotere lokale LLM-modellen. Dit is het moment waarop veel mensen beginnen te kijken naar een andere aanpak.

Een alternatief dat veel enthousiastelingen overwegen, is het gebruik van virtuele machines met vooraf geïnstalleerde krachtige hardware. Een VPS (virtual private server) is bijvoorbeeld een uitstekende manier om je thuislaptop of andere persoonlijke hardware te koppelen aan een privéserver naar keuze, met alle benodigde software al klaar.

Als een VPS een goede oplossing klinkt, raden we je van harte aan om Cloudzy's Ollama VPSte bekijken, waar je in een schone shell kunt werken. Ollama is vooraf geïnstalleerd, zodat je direct aan de slag kunt met lokale LLMs en volledige privacy hebt. De service is betaalbaar, beschikbaar op 12 locaties, met 99,95% uptime en 24/7 support. Resources zijn ruim voorhanden: dedicated VCPUs, DDR5 geheugen en NVMe opslag via een verbinding tot 40 Gbps.

Ollama vs LM Studio: wie heeft wat nodig

Zoals eerder gezegd zijn beide platforms goed bruikbaar en is geen van de twee objectief beter. Maar hier zit het verschil: elk platform past bij een ander type workflow, dus de keuze hangt af van wat jij nodig hebt.

Kies Ollama voor automatisering en ontwikkeling

Je doel bij het gebruik van Ollama is niet alleen chatten met een model, maar het inzetten als onderdeel van een groter project. Ollama is ideaal voor:

- Ontwikkelaars het bouwen van producten zoals chatbots, copilots en andere toepassingen die deep learning vereisen

- Workflows met veel automatisering, zoals scripts die rapporten samenvatten of die op vaste tijden concepten genereren

- Teams die consistente modelversies in elke omgeving vereisen

- Elke gebruiker die een API-first aanpak wil, zodat andere tools regelmatig verbinding kunnen maken met modellen

Als je modellen betrouwbaar wilt hebben voor je applicaties, is Ollama waarschijnlijk je beste keuze.

LM Studio is de eenvoudigere manier om lokale LLMs te verkennen

Wil je lokale AI-omgevingen verkennen zonder technische rompslomp, dan is LM Studio duidelijk de betere optie.

Over het algemeen is LM Studio beter voor:

- Beginners die de terminal en opdrachtregel liever vermijden

- Schrijvers, creatieven of studenten die simpelweg een chat-interface als AI-hulp nodig hebben

- Mensen die graag verschillende opties uitproberen, om snel meerdere modellen te vergelijken en te ontdekken wat bij hen past

- Iedereen die nog begint met prompting en instellingen wil aanpassen zonder te typen

Wil je lokale LLMs downloaden en meteen aan de slag, dan is LM Studio wat je nodig hebt.

Ollama vs LM Studio: definitief advies

Los van alle ophef rond de vergelijking tussen Ollama en LM Studio gaat het uiteindelijk om je dagelijkse ervaring, bepaald door je workflow en de grenzen van je hardware.

Ollama is in het algemeen:

- Flexibel en gericht op developers

Terwijl LM Studio is:

- Toegankelijk voor beginners met een eigen GUI

Beide vereisen zware, dure hardware om soepel te draaien. Niet iedereen heeft de mogelijkheid om een groot lokaal LLM zelfstandig te draaien. Daarom geldt: als je geavanceerde modellen wilt draaien zonder je hardware te overbelasten, overweeg dan Ollama op een dedicated GPU VPSHieronder zijn veelgestelde vragen over Ollama vs LM Studio.