Jeśli się zastanawiasz H100 vs RTX 4090 W przypadku AI pamiętaj, że większość "benchmarków" nie ma znaczenia, dopóki Twój model i cache faktycznie się zmieszczą w VRAM. RTX 4090 to idealne rozwiązanie do pracy na pojedynczym GPU, która mieści się w 24 GB.

H100 to escolha na hora que você precisa de modelos maiores, mais concorrência, isolamento multi-usuário ou quer gastar menos tempo fazendo acrobacias com memória.

Podzielę to na typy obciążeń, pokażę różne benchmarki, a potem dam ci szybki plan testów, który możesz uruchomić na swoim systemie.

Szybka odpowiedź: H100 kontra RTX 4090 dla AI

H100 wygrywa w trenowaniu dużych modeli i poważnym wdrażaniu dzięki ogromnym puli HBM, bardzo wysokiemu przepustowości pamięci, NLink i MIG do izolacji. RTX 4090 jest lepszy dla 'potrzebuję świetnej prędkości jednoprocesora GPU za lepszą cenę', o ile twoje obciążenie zmieści się w 24 GB bez stałych kompromisów. Specyfikacja i możliwości platformy robią to całkiem proste.

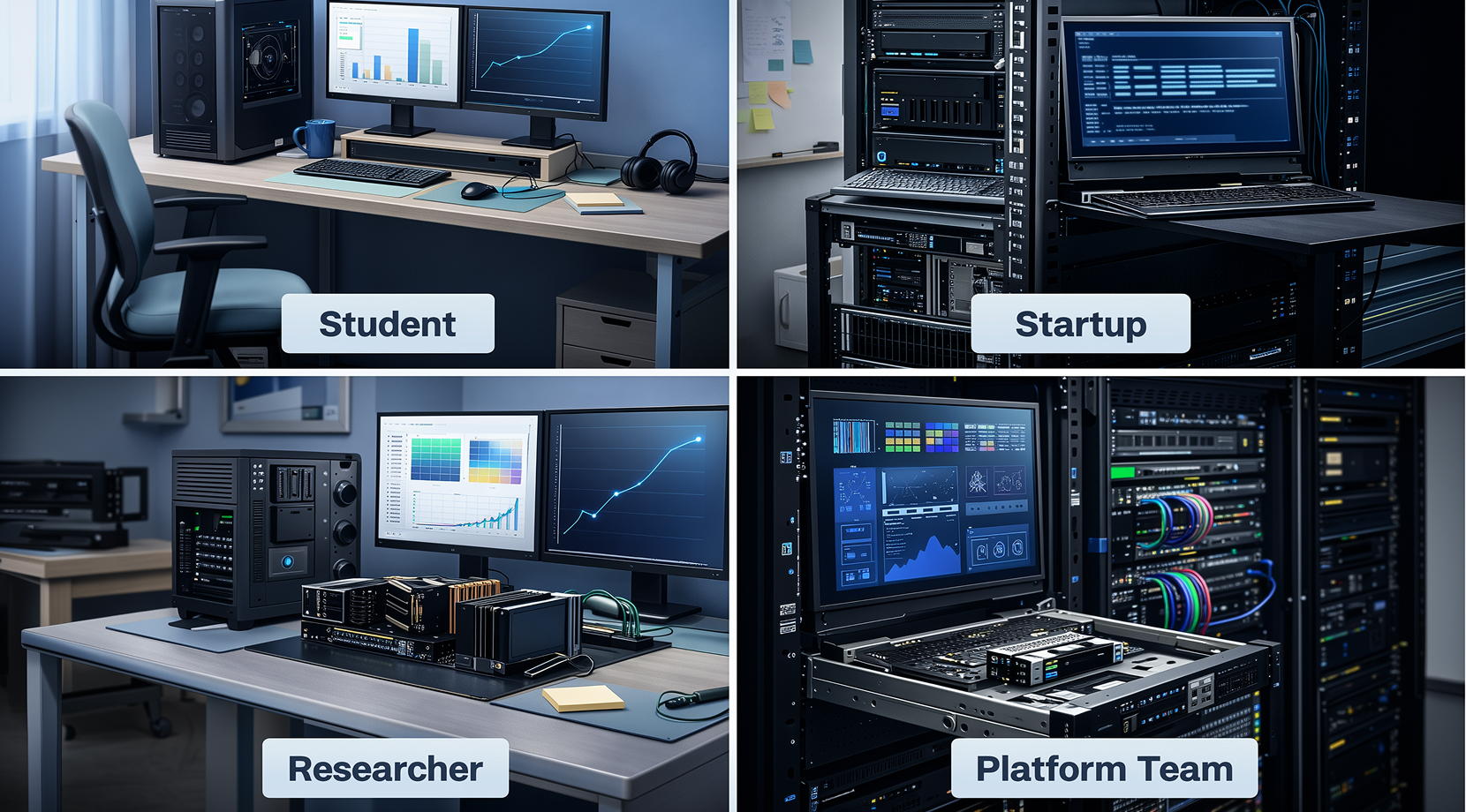

Oto szybka lista wyboru po personach:

- Lokalny deweloper LLM (solo/student): RTX 4090, dopóki VRAM nie stanie się wąskim gardłem.

- Inżynier ML w startucie (wdrażam MVP): RTX 4090 do wczesnego wdrażania i dostrajania, H100 jak tylko będziesz potrzebować stabilną wspódzielność lub większe modele.

- Badacz stosowany (dużo eksperymentów): H100, jeśli ciągle trafiasz na OOM, limity batch'y lub długie konteksty.

- Zespół produkcji/platformy (wielodostępowe wdrażanie): H100 do dzielenia MIG, większej rezerwy i płynniejszego skalowania.

Z tym podejściem, reszta artykułu to rzeczywiste ograniczenia, na które trafiają ludzie, i jak wyniki benchmarków się z nimi zgadzają.

Jedyne pytanie o benchmark do rozważenia: Co musi się zmieścić w VRAM?

Większość dyskusji o H100 vs RTX 4090 to technicznie dyskusje o VRAM. W pracy LLM, VRAM jest zajmowany przez wagi, aktywacje podczas szkolenia, stany optymalizatora w trenowaniu, a Pamięć podręczna KV podczas wnioskowania. To ostatnie jest tym, którego ludzie naprawdę nie oczekują, bo rośnie z długością kontekstu i wspódzielnością.

Tabela poniżej celowo trzyma się wysokiego poziomu, bo dokładne zmieszczenie zależy od frameworku, precyzji i overhead'u.

Oto widok 'zmieści się bez dramatów':

| Obciążenie pracą | Typowa rzeczywistość jednoprocesora GPU na RTX 4090 (24 GB) | Typowa rzeczywistość jednoprocesora GPU na H100 (80–94 GB) |

| Wnioskowanie 7B LLM (FP16 / BF16) | Zwykle w porządku | Wygodne zapasy |

| Wnioskowanie LLM 13B | Często napięte, zależy od kontekstu | Zwykle w porządku |

| wnioskowanie klasy 70B | Wymaga poważnej kwantyzacji/offloadu | Dużo bardziej realistyczne |

| SD/SDXL inference + małe batche | Zwykle w porządku | Dobrze, plus więcej miejsca na większe batche |

| Serwowanie z wyższą równoczesnością | Presja cache'a KV pokazuje się szybko | Więcej miejsca, bardziej stabilne pod obciążeniem |

Jeśli chcesz szerszą listę GPU (nie tylko te dwie), nasza analiza Najlepsze GPU do Machine Learning w 2025 roku to przydatna tabela odniesienia dla RAM i przepustowości pamięci na popularne GPU.

Kiedy już wiesz, że twoje obciążenie się zmieści, kolejnym czynnikiem decydującym o tym, jak "sprawnie" to działa, jest przepustowość pamięci.

Przepustowość: Dlaczego HBM Robi Różnicę

Większość rozmów o wydajności AI skupia się na szczytach mocy obliczeniowej, ale transformery są niezwykle wrażliwe na przepływy danych. Przewagę H100 stanowi połączenie dużych puli HBM z bardzo wysoką przepustowością pamięci, plus przepustowość NVLink i partycjonowanie MIG na stronie platformy.

Przegląd specyfikacji

Specyfikacje nie wybiorą GPU za ciebie, ale wyjaśniają, dlaczego to samo obciążenie czuje się łatwe na jednej karcie, a ciasne na drugiej. Ten przegląd pokazuje, co najbardziej wpływa na treninowanie, inference i zachowanie serwowania LLM.

| Specyfikacja | H100 (SXM / NVL) | RTX 4090 |

| VRAM | 80 GB / 94 GB | 24 GB |

| Przepustowość pamięci | 3,35–3,9 TB/s | GDDR6X (ograniczona pojemność do 24 GB) |

| Połączenie międzysystemowe | NVLink + PCIe Gen5 | PCIe (platforma konsumencka) |

| Wielowystąpienie | Do 7 instancji MIG | Niedostępne |

Odniesienia specyfikacji: NVIDIA H100, NVIDIA RTX 4090.

Co to oznacza w praktyce:

- Jeśli próbujesz zwiększyć rozmiar batcha lub długość kontekstu, H100 zwykle pozostaje stabilna dłużej, zanim będziesz zmuszony do kompromisów.

- Jeśli serwujesz wiele żądań jednocześnie, H100 ma więcej "przestrzeni oddychania pamięci", więc nie dostajesz niskiej latencji ogonowej tak szybko.

- Jeśli twoja praca to głównie jeden użytkownik, jeden model, umiarkowany kontekst, RTX 4090 zwykle czuje się szybka i satysfakcjonująca.

Przepustowość nie zastępuje dobrego benchmarkingu. Wyjaśnia tylko, dlaczego dwa GPU mogą wyglądać podobnie na wąskim teście, a potem się rozbiegają pod rzeczywistym obciążeniem.

Wiarygodne Benchmarki H100 vs RTX 4090

Benchmarki nie są takie same, dlatego "moje liczby nie zgadzają się z twoimi" zdarza się ciągle. Dla H100 vs RTX 4090, warto podzielić benchmarki na dwa tory:

- Tor A (czucie społeczności): llama.cpp-style tokens/sec tests and simple inference scripts.

- Tor B (zestandaryzowane zestawy): Wyniki w stylu MLPerf Training i MLPerf Inference, które skupiają się na powtarzalnych regułach.

Snapshot Inference w Stylu Llama.cpp

To test, który ludzie uruchamiają w domu, a potem dyskutują o nim trzy dni. Jest przydatny, bo odzwierciedla rzeczywisty toolchain, który wielu developerów używa. Ale łatwo go źle zinterpretować, jeśli zignorujesz dopasowanie i precyzję.

Publiczne porównania w stylu llama.cpp RTX 4090 radzi sobie doskonale na mniejszych modelach i przy uruchomieniach ze skwantyzowaniem, podczas gdy duże modele z wyższą precyzją znacznie przewyższają limit VRAM.

Oto co powinieneś się spodziewać:

| Model | GPU | Typowy wynik |

| klasa 7B | RTX 4090 | Wysoka przepustowość tokenów na sekundę, płynne wnioskowanie dla jednego użytkownika |

| Klasa 13B | RTX 4090 | Wciąż solidnie, ale kontekst i narzuty zaczynają się liczyć |

| klasa 70B | RTX 4090 | Nie da się tego dopasować bez agresywnej kwantyzacji lub offloadu |

| klasa 70B | H100 | Znacznie bardziej realistyczne utrzymywanie zasobów lokalnie i niezawodne serwowanie |

Celem tej tabeli nie jest udowodnienie, że "4090 jest zły" ani że "H100 to magia". Chodzi o to, że limit VRAM decyduje o tym, ile danych możesz trzymać w pamięci jednocześnie, a to bezpośrednio wpływa na szybkość, stabilność i ilość konfiguracji, którą będziesz musiał wykonać.

Jeśli ciągle musisz zmniejszać długość kontekstu, żeby utrzymać serwer przy życiu, to właśnie wtedy ta porównanie przestaje być teoretyczne.

Co MLPerf dodaje w porównaniu z benchmarkami na forach

MLPerf powstał, bo "losowe skrypty i intuicja" to za mało, gdy podejmuje się decyzję warte kilka tysięcy dolarów. MLCommons dodał nowoczesne obciążenia oparte na generatywnej AI w miarę upływu czasu, a MLPerf został zaprojektowany, aby wyniki były bardziej porównywalne między systemami.

Po stronie szkolenia, Raport NVIDIA MLPerf Training v5.1 to dobry przykład tego, jak dostawcy raportują czas szkolenia z uwzględnieniem szczegółów środowiska testowego i reguł benchmarku, które stosują.

Ten tryb nie pokaże ci, jak zachowują się twoje prywatne prompty, ale to test sprawdzający skalowanie na poziomie systemu i wydajność tej klasy sprzętu w zadanych warunkach.

Przejdźmy teraz do najważniejszej dla Ciebie kwestii: ile czasu poświęcisz i ile zapłacisz, zanim ukończysz swoją pracę.

Koszt, czas i utracone możliwości

Wiele H100 vs RTX 4090 Decyzje są często przedstawiane jako „cena zakupu kontra cena wynajmu". To rzadko właściwe podejście. Lepiej zadać sobie inne pytanie: ile godzin zajmuje ci stworzenie modelu, który faktycznie działa, i ile czasu tracisz na walkę z ograniczeniami?

Trzy typowe scenariusze pokazują te różnice bardzo wyraźnie.

Cotygodniowe dostrajanie małych i średnich modeli

Jeśli Twoje eksperymenty mieszczą się w 24 GB bez ciągłych kompromisów, wybór 4090 wydaje się świetny. Iterujesz szybko, nie musisz rezerwować czasu na klastrze, a konfiguracja jest prosta. Jeśli każde uruchomienie zamienia się w "zmniejsz batch, skróć kontekst, spróbuj ponownie", H100 to znacznie rozsądniejszy wybór, mimo wyższego kosztu.

Serwowanie z Rzeczywistą Współbieżnością

Współbieżność szybko zwiększa obciążenie KV cache. Tu wychodzą na jaw przepustowość H100 i kontrole platformy, szczególnie jeśli potrzebujesz przewidywalnego opóźnienia.

Jeśli wciąż zastanawiasz się, czy serwer GPU w ogóle pasuje do Twojego wdrożenia, GPU VPS vs CPU VPS jest przydatnym sposobem, by dopasować obciążenie do typu infrastruktury, zanim poświęcisz czas na optymalizowanie nie tego, co trzeba.

Większe Zadania Treningowe z Terminem

Jak tylko skalujesz poza jedną osobę i jedną maszynę, nudne rzeczy to właśnie to, na czym powinieneś się skupić: stabilne środowiska, mniej trybów awarii, mniej czasu poświęconego na coś, co to jest w zasadzie opieka. Do tego stworzony jest H100.

Jeśli po tej sekcji wciąż się wahasz, następnym krokiem nie jest czytanie. To obserwacja zachowania Twojego stosu w praktyce, łącznie z problemami sterowników i wielouużytkownikowymi obciążeniami.

Oprogramowanie i Operacje: Sterowniki, Stabilność, Wieloużytkownikowość i Wsparcie

To część, którą większość wykresów benchmarkowych pomija, ale zajmuje spory kawałek codziennego życia.

RTX 4090 jest popularne, bo jest dostępne i szybkie dla wielu workflow AI. Kompromis polega na tym, że gdy Twój przypadek użytkownika się rozwija, większe szanse, że trafisz na ograniczenia pamięci i wzorce skalowania, które nie są zbudowane dla środowisk współdzielonych i wielodostępowych.

H100 zbudowany jest na klastry. MIG to duża sprawa dla zespołów platformy, bo pozwala podzielić jeden GPU na izolowane części, co zmniejsza problemy z "hałaśliwym sąsiadem" i ułatwia planowanie pojemności. Oficjalne specyfikacje H100 od NVIDIA wymienią do 7 instancji MIG w zależności od formy.

Jeśli Twoje obciążenie jest osobiste i lokalne, możesz żyć szczęśliwie po stronie 4090 przez długi czas. Jeśli Twoje obciążenie jest wieloużytkownikowe i skierowane do klientów, H100 to bezpieczniejsza droga.

Podsumowując, kto powinien kupić co?

Którą Wybrać dla Twojego Obciążenia

Dla H100 vs RTX 4090, prawidłowy wybór to ten, który usuwa Twoje największe przeszkody.

Lokalny Builder LLM (Solo Dev / Student)

Wybierz RTX 4090, jeśli pracujesz głównie w zakresie 7B–13B, uruchamiasz wnioskowanie skwantyzowane, eksperymentujesz z RAG lub pracujesz nad SDXL. Przejdź wyżej, gdy poświęcasz więcej czasu na pracę wokół pamięci niż na budowanie tego, co zamierzałeś.

Startup ML Engineer (Wdrażanie MVP)

Jeśli Twoje MVP to pojedynczy model o umiarkowanym ruchu i bez problemu się mieści, 4090 to mocny start. Jeśli potrzebujesz stabilnego opóźnienia przy wzrostach, wyższej współbieżności lub wielu obciążeń na hoście, H100 to spokojniejsza droga.

Applied Researcher (Wiele Eksperymentów)

Jeśli jesteś często zmuszany do kompromisów takich jak zmniejszanie rozmiaru batcha lub gimnastyka precyzji, H100 daje Ci czystsze eksperymenty i mniej martwych uruchomień.

Production / Platform Team (Serwowanie Wielodostępowe)

H100 to łatwy wybór, głównie dlatego że MIG i wyższa przepustowość ułatwiają planowanie pojemności i zasadniczo zmniejszają zasięg awarii, gdy coś wzrośnie.

Jeśli wciąż nie chcesz zaangażować pieniędzy w hardware, wynajem to najlepszy następny krok.

Praktyczne podejście: Wynajmij najpierw GPU, potem się zdecyduj

Najczystszy sposób na uzyskanie pewności H100 vs RTX 4090 polega na uruchomieniu Twój model, Twój podpowiedzi i Twój długość kontekstu na obu klasach sprzętu, a potem porównaj tokeny na sekundę i opóźnienie ogona pod obciążeniem.

Dlatego właśnie zbudowaliśmy Cloudzy GPU VPS, bo serwer GPU możesz mieć w poniżej minutę, zainstalować swój stos z pełnym dostępem root i przestać zgadywać na podstawie czyjchś benchmarków.

Oto co otrzymujesz w naszych planach GPU VPS:

- Dedykowane NVIDIA GPU (w tym opcje z serii RTX 4090 i A100), więc twoje wyniki nie będą zniekształcane przez hałasliwe sąsiednie maszyny.

- Do 40 Gbps sieci na wszystkich planach GPU, co ma znaczenie przy pobieraniu zbiorów danych, przepływach pracy wielowęzłowych i szybkim przesyłaniu artefaktów.

- Storage NVMe SSD, plus DDR5 RAM oraz opcje szybkich CPU na wszystkich poziomach, żeby reszta serwera nie przeciągnęła GPU w dół.

- Ochrona przed atakami DDoS i a 99,95% czasu dostępności, więc długie zadania nie zostaną zniszczone przez losowe zaburzenia internetu.

- Rozliczenie godzinowe (przydatne do krótkich serii benchmarków) i 14-dniowa gwarancja zwrotu pieniędzy do testów bez ryzyka.

Uruchom tę samą listę kontrolną benchmarku na planie RTX 4090, potem powtórz na planie A100-class, gdy przejdziesz do większych kontekstów, wyższej współbieżności czy większych modeli. Potem wybór między H100 vs RTX 4090 zwykle staje się oczywisty na podstawie twoich własnych logów.

Lista kontrolna benchmarku: Zrób test sam w 30 minut

Jeśli chcesz decyzję, którą potrafisz uzasadnić, pobierz cztery liczby z dokładnie tego stosu, który planujesz wysłać:

- Tokeny/s przy docelowej długości kontekstu

- opóźnienie p95 przy oczekiwanej współbieżności

- Dostępna pamięć VRAM podczas najbardziej obciążonego okresu

- Koszt na wykonane uruchomienie od startu do artefaktu

Minimalny test smoke z vLLM wygląda tak:

pip install vllm transformers accelerate

python -m vllm.entrypoints.api_server \

--model meta-llama/Llama-3-8B-Instruct \

--dtype float16 \

--max-model-len 8192Jeśli chcesz jasno wiedzieć, co dokładnie wynajmujesz, nasz artykuł na Czym jest GPU VPS? wyjaśnia różnicę między dedykowanym dostępem do GPU, dzielonym vGPU i na co zwrócić uwagę przed wyborem planu.