Jeśli planujesz kupić nowy GPU, żeby pozbyć się błędów braku pamięci, spór między 5070 Ti a 5080 to nieodpowiedni punkt wyjścia. Obie karty mają po 16 GB VRAM, a ten limit pojawia się w głębokim uczeniu szybciej, niż większość osób się spodziewa.

5080 jest szybszy, ale rzadko pozwala uruchamiać istotnie większe modele. W praktyce i tak skończy się na zmniejszaniu rozmiaru batcha, skracaniu długości kontekstu lub przenoszeniu danych do pamięci systemowej, żeby w ogóle utrzymać działające uruchomienie.

Dlatego ten artykuł to rzetelne, realistyczne spojrzenie na 5070 Ti vs 5080 w kontekście głębokiego uczenia, uzupełnione o zestaw opcji dla tych, których celem jest trenowanie, dostrajanie lub serwowanie modeli bez ciągłych ograniczeń VRAM.

Jeśli masz przeczytać tylko jedną rzecz, przeczytaj sekcję ze specyfikacjami i sekcję "pojemność vs szybkość" - to one uchronią Cię przed zakupem niewłaściwej karty.

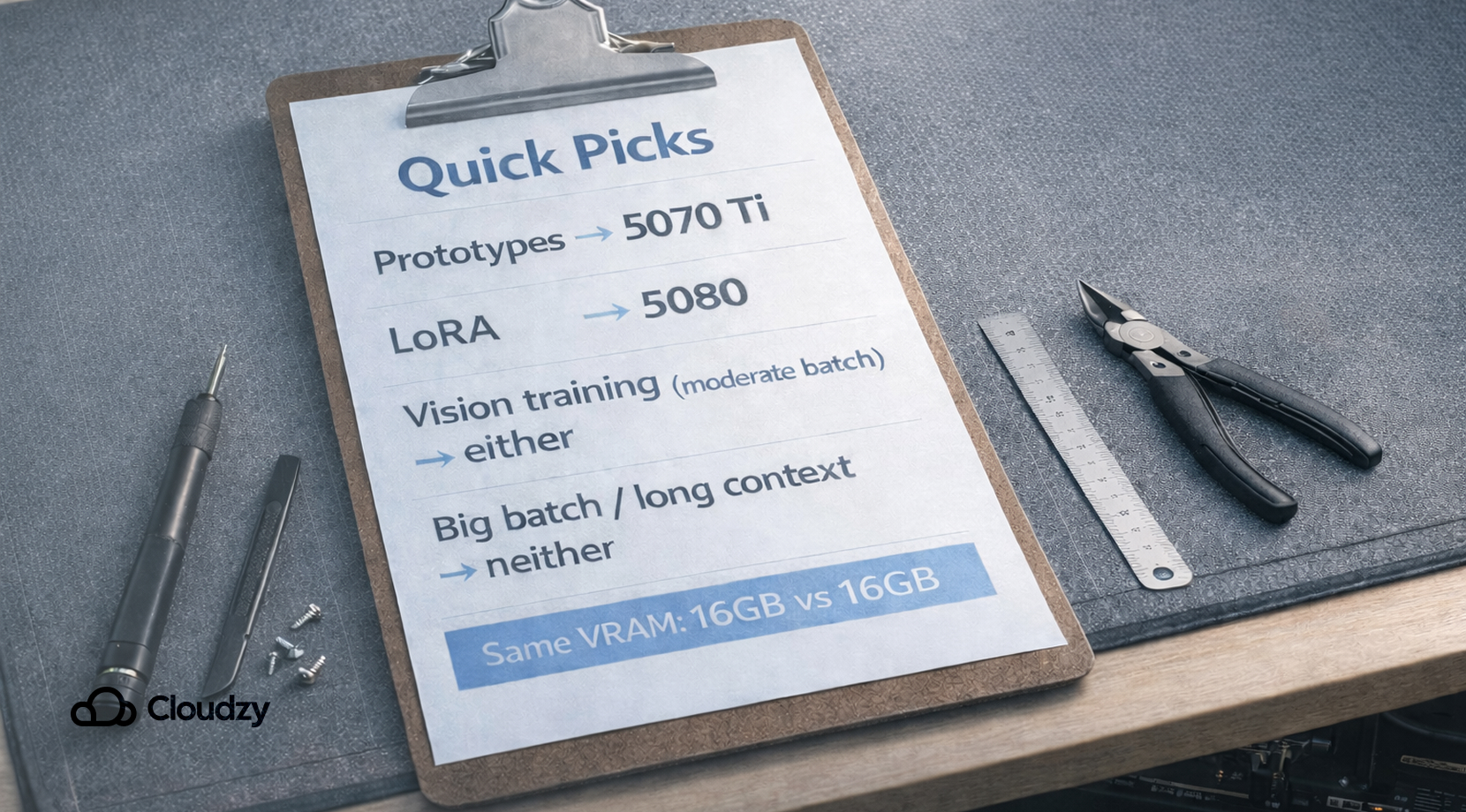

Szybki dobór według zastosowania

Nikt nie kupuje GPUs bez zastanowienia. Widzimy cztery typowe podejścia kupujących, które pojawiają się raz po raz, a wybór między 5070 Ti a 5080 wygląda inaczej w każdym z nich.

Lokalny majsterkowicz z LLM

Uruchamiasz notebooki, zmieniasz ustawienia kwantyzacji i bardziej zależy ci na tym, żeby coś działało, niż na idealnej przepustowości. Dla ciebie wybór między 5070 Ti a 5080 sprowadza się zwykle do budżetu, bo obie karty dobrze sprawdzą się na małych modelach i kwantyzowanym wnioskowaniu. Obie też trafią w ten sam sufit VRAM, gdy zwiększysz długość kontekstu lub rozmiar wsadu.

Doktorant trenujący modele wizyjne

Zależy ci na powtarzalnych eksperymentach, nie na niekończących się ponownych uruchomieniach. Ukryty koszt to nie sama karta, lecz czas, który tracisz, gdy przebiegi kończą się niepowodzeniem w epoce 3, bo dataloader, augmentacje i model rywalizują o pamięć.

Inżynier startupowy wdrażający wnioskowanie

Zależy ci na opóźnieniach ogonowych i współbieżności. Demo dla jednego użytkownika może świetnie działać na 16 GB, ale gdy pojawia się ruch produkcyjny, presja KV cache zjada VRAM jak powolny wyciek. Przy serwowaniu modeli wybór między 5070 Ti a 5080 może być drugorzędny, jeśli prawdziwym problemem jest pojemność dla batchingu i długich promptów.

Twórca, który zajmuje się też ML

Przeskakujesz między aplikacjami kreatywnymi a narzędziami ML i nie znosisz restartów, problemów ze sterownikami ani zasady "zamknij Chrome, żeby trenować". Dla ciebie wybór między 5070 Ti a 5080 ma sens tylko wtedy, gdy GPU jest częścią przejrzystego workflow, a nie kruchej stacji roboczej, która wysypuje się przy każdym multitaskingu.

Mając te przypadki w głowie, przyjrzyjmy się konkretnie sprzętowi i temu, dlaczego czynnik ograniczający jest ten sam tam, gdzie naprawdę ma to znaczenie.

Kluczowe parametry dla deep learningu

Najszybszy sposób na zrozumienie różnicy między 5070 Ti a 5080 to zignorowanie liczb marketingowych i skupienie się na pojemności pamięci.

Jeśli chcesz pełnego zestawienia specyfikacji, poniżej znajdziesz szczegółową tabelę skupiającą się na tym, co najbardziej wpływa na zachowanie podczas treningu i wnioskowania. (Taktowania i wyjścia displayowe robią wrażenie, ale nie decydują o tym, czy twój przebieg się zmieści.)

| Specyfikacja (Pulpit) | RTX 5070 Ti | RTX 5080 | Dlaczego Pojawia Się w Pobieraniu |

| VRAM | 16 GB | 16 GB | Pojemność to twarda granica dla wag, aktywacji i KV cache |

| Typ pamięci | GDDR7 | GDDR7 | Podobne zachowanie, przepustowość pomaga, ale pojemność decyduje: "mieści się czy nie" |

| Magistrala Pamięci | 256-bitowy | 256-bitowy | Ogranicza łączną przepustowość; poprawia throughput, nie rozmiar modelu |

| Rdzenie CUDA | 8,960 | 10,752 | Większa moc obliczeniowa pomaga przy tokenach/s, nie przy pytaniu "czy w ogóle to załaduję" |

| Typowe pobory mocy płyty | 300 W | 360 W | Więcej ciepła i zapasu PSU, bez dodatkowego VRAM |

Oficjalne źródła specyfikacji: RTX 5080, Rodzina RTX 5070

Krótko mówiąc: 5080 to szybsza karta, 5070 Ti to tańsza. W deep learningu różnica ujawnia się głównie wtedy, gdy twoje obciążenie już się mieści.

Następnie przyjrzymy się temu, dlaczego VRAM znika tak szybko, nawet w konfiguracjach wyglądających lekko na papierze.

Dlaczego VRAM znika tak szybko w deep learningu

Osoby przychodzące z gamingu często myślą o VRAM jak o puli tekstur. W deep learningu przypomina to bardziej ciasny blat kuchenny. Potrzebujesz miejsca nie tylko na składniki, ale też na krojenie, gotowanie i serwowanie, wszystko jednocześnie.

Oto co zazwyczaj zajmuje VRAM podczas przebiegu:

- Wagi modelu: parametry, które ładujesz — czasem w FP16/BF16, czasem skwantyzowane.

- Aktywacje: tensory pośrednie zapisywane na potrzeby propagacji wstecznej — zazwyczaj to one najbardziej pożerają pamięć podczas trenowania.

- Gradienty i stan optymalizatora: narzut związany z treningiem, który może wielokrotnie zwiększać zapotrzebowanie na pamięć.

- Pamięć podręczna KV: narzut obliczeniowy wnioskowania, który rośnie wraz z długością kontekstu i poziomem współbieżności.

Dlatego właśnie spór o 5070 Ti kontra 5080 przypomina kłótnię o moc silnika, gdy ciągniesz za ciężką przyczepę. Możesz mieć więcej koni mechanicznych, ale ograniczeniem i tak pozostaje dopuszczalna masa holowania.

Szybki sposób, którego używamy we własnych testach: loguj zarówno przydzieloną, jak i zarezerwowaną pamięć w PyTorch. Dokumentacja pamięci CUDA w PyTorch wyjaśnia działanie alokatora z pamięcią podręczną i to, dlaczego pamięć może wyglądać na „zajętą" w narzędziach takich jak nvidia-smi, nawet po zwolnieniu tensorów.

To prowadzi nas do sedna sprawy: większość problemów z deep learningiem na 16 GB nie wynika z tego, że jest wolno, ale z tego, że w najgorszym możliwym momencie dostajesz OOM.

Pierwsze zadania, przy których 5070 Ti odpada na tle 5080

Poniżej znajdziesz wzorce deep learningu, które najczęściej pierwsze napotykają na limity pamięci – porównanie 5070 Ti i 5080.

LLM Obsługa długich promptów i rzeczywistej współbieżności

Pojedynczy prompt o długości 2K tokenów może działać bez zarzutu. Dodaj dłuższy kontekst, wsadowanie i drugiego użytkownika, a cache KV zaczyna rosnąć. Wtedy różnica między 5070 Ti a 5080 przestaje mieć znaczenie - obie karty zmuszają do skrócenia kontekstu lub zmniejszenia rozmiaru wsadu, żeby w ogóle dać radę.

Prosta metoda sprawdzania:

- Uruchom serwer z prawdziwym maksymalnym kontekstem i rozmiarem wsadu.

- Obserwuj VRAM w czasie, nie tylko przy starcie.

- Zanotuj punkt, w którym opóźnienie skacze, a następnie sprawdź użycie pamięci w tym samym oknie czasowym.

Jeśli chcesz wdrożyć monitoring, który nie zamieni się w osobny projekt, zapoznaj się z naszym przewodnikiem na temat Oprogramowanie monitorujące GPU omawia praktyczne wzorce logowania przez CLI, które sprawdzają się w rzeczywistych środowiskach.

Dostrajanie modeli metodą LoRA lub QLoRA

Wiele osób mówi, że "LoRA działa na 16 GB" i nie mylą się. Pułapka polega na założeniu, że reszta pipeline'u nie zajmuje zasobów. Bufory tokenizacji, procesy dataloadera, skalowanie precyzji mieszanej oraz kroki walidacji mogą bardzo szybko się sumować.

W praktyce wąskim gardłem jest tu marża, nie moc obliczeniowa. Jeśli nie masz wolnych VRAM, musisz pilnować każdego uruchomienia z osobna.

Trenowanie modeli wizji na obrazach wysokiej rozdzielczości

Modele obrazów mają podstępny tryb awarii: mały wzrost rozdzielczości albo dodatkowa augmentacja potrafi przerzucić cię ze stabilnego treningu prosto w OOM. Na 5070 Ti kontra 5080 objawia się to tak, że batch size spada do 1, a gradient accumulation zamienia trening w pętlę w zwolnionym tempie.

Multimodalne modele działają na jednym GPU

Enkoder tekstu + enkoder obrazu + warstwy fuzji to zazwyczaj nie problem, ale gdy zwiększysz długość sekwencji albo dodasz większy szkielet wizyjny, pamięć zaczyna pękać w szwach.

Moja karta graficzna jest w porządku, mój komputer stacjonarny nie

To najbardziej znajoma sytuacja. Zaczynasz trenować model, a przeglądarka, IDE i inne uruchomione aplikacje zajmują VRAM, i nagle twoja "stabilna" konfiguracja przestaje działać. Ludzie na forach narzekają, że pozamykali wszystko, wyłączyli nakładki i wciąż dostają OOM na tym samym modelu, który wczoraj działał bez problemu.

Ten schemat pojawia się nieustannie w Dyskusje 5070 Ti vs 5080, też, ponieważ obie karty mają ten sam limit pojemności. Jeśli brzmi to znajomo, następne pytanie brzmi: „co zrobić z tym limitem?"

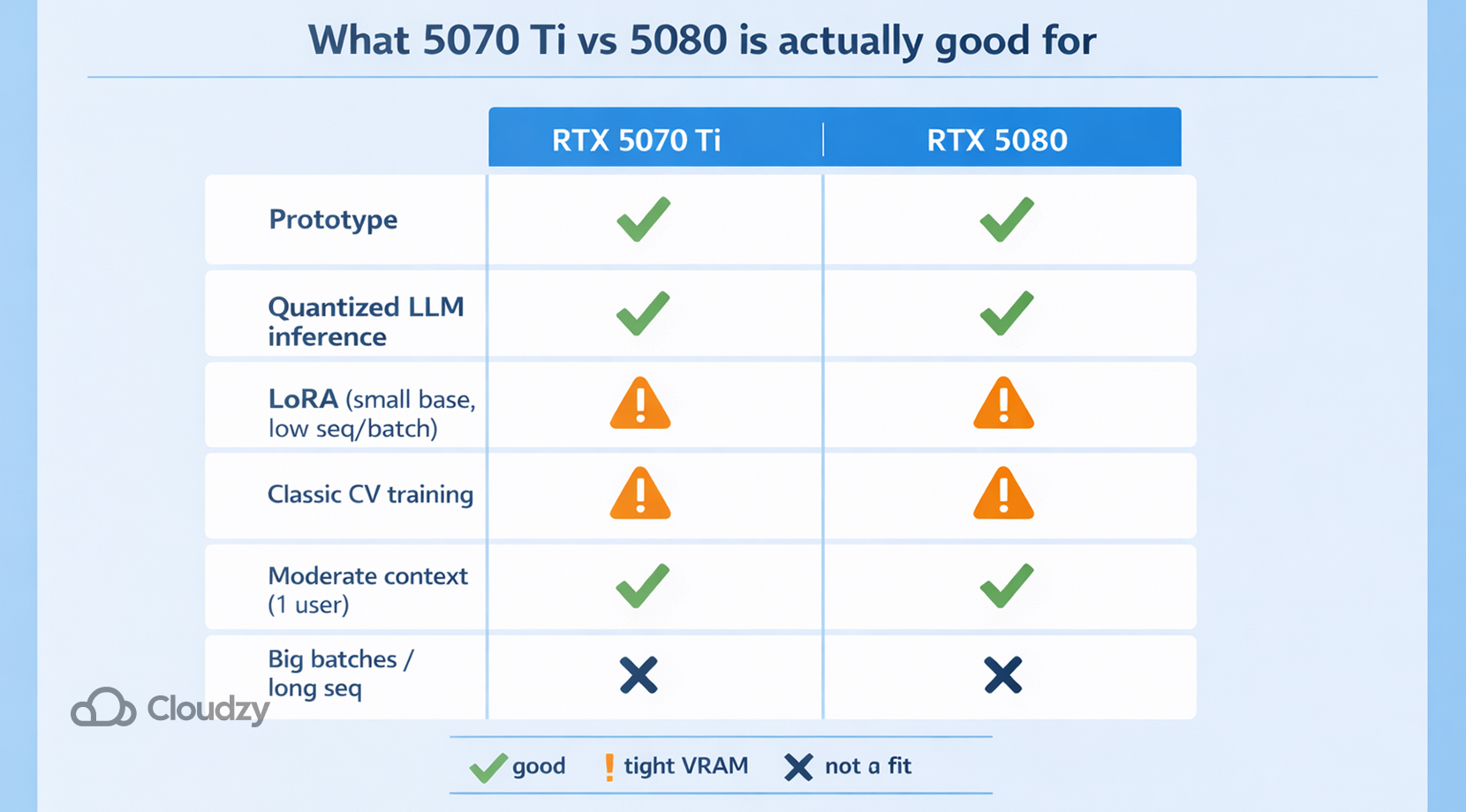

Do czego nadaje się 5070 Ti, a do czego 5080

Łatwo wyśmiewać 16 GB w środowiskach ML, ale to nie jest bezużyteczne. Po prostu wąskie zastosowanie.

5070 Ti vs 5080 to całkowicie sensowny wybór do:

- Prace prototypowe: małe eksperymenty, szybkie ablacje i testy poprawności.

- Wnioskowanie kwantyzowane LLM: mniejsze modele z umiarkowanym kontekstem, jeden użytkownik.

- LoRA na mniejszych modelach bazowych: o ile kontrolujesz długość sekwencji i rozmiar batcha.

- Klasyczne trenowanie modeli wizyjnych: umiarkowane rozmiary obrazów, umiarkowane sieci bazowe, więcej cierpliwości.

Chodzi o to, że jeśli twoja praca mieści się w limicie pamięci, 5080 zazwyczaj będzie działać sprawniej niż 5070 Ti i zyskasz dodatkową moc obliczeniową.

Ale w momencie, gdy spróbujesz wykonywać "poważne" zadania deep learningowe, natkniesz się na problemy z brakiem pamięci. Omówmy więc taktyki, które pomagają na obu kartach.

Jak wyciągamy maksimum z ograniczonego VRAM, nie zamieniając trenowania w koszmar

Żaden z tych trików nie jest magią. To po prostu zestaw kroków, które pozwalają 5070 Ti i 5080 dłużej zachować przydatność.

Zacznij od pomiaru

Zanim zaczniesz dostosowywać hiperparametry, zmierz szczytową wartość VRAM na krok. W PyTorch, max_memory_allocated() i max_memory_reserved() to szybki sposób na sprawdzenie, co naprawdę dzieje się podczas działania.

To pomaga odpowiedzieć na pytania takie jak:

- Czy głównym kosztem jest sam model, czy aktywacje?

- Czy VRAM gwałtownie rośnie podczas walidacji?

- Czy fragmentacja stopniowo narasta z czasem?

Gdy masz punkt odniesienia, reszta staje się mniej nieprzewidywalna.

Ogranicz zużycie pamięci tam, gdzie to możliwe

Prosta kolejność kroków, której używamy:

- Zmniejszaj rozmiar batcha, aż zmieści się w pamięci.

- Dodaj gradient accumulation, żeby odzyskać efektywny rozmiar batcha.

- Włącz mixed precision (BF16/FP16), jeśli twój stack to obsługuje.

- Dodaj gradient checkpointing, jeśli aktywacje dominują.

- Dopiero wtedy zacznij bawić się rozmiarem modelu.

Traktuj długość kontekstu jak budżet

W przypadku transformerów długość kontekstu to czynnik, który sprawi najwięcej problemów. Wpływa na obliczenia atencji, a przy inferencji - na rozmiar KV cache. Na 5070 Ti vs 5080 odczujesz to natychmiast po przekroczeniu kilku tysięcy tokenów: VRAM gwałtownie skacze, przepustowość spada i nagle ograniczasz rozmiar batcha tylko po to, żeby utrzymać się w pionie.

Zalecane podejście:

- Wybierz domyślny maksymalny kontekst, który możesz uruchomić z zapasem.

- Stwórz drugi profil dla trybu "długiego kontekstu" z mniejszym batchem.

- Nie mieszaj obu podczas debugowania.

Nie myl PyTorch cache z prawdziwymi wyciekami pamięci

Wiele raportów o "wyciekach pamięci" to w rzeczywistości zachowanie alokatora. Dokumentacja PyTorch wspomina, że alokator z cache może przetrzymywać zarezerwowaną pamięć nawet po zwolnieniu tensorów, a empty_cache() nieużywane bloki cache trafiają głównie z powrotem do innych aplikacji, nie do samego PyTorch.

Ma to znaczenie, bo użytkownicy porównujący 5070 Ti vs 5080 często tracą czas na tropienie pozornych wycieków, zamiast skupić się na prawdziwych źródłach problemów: rozmiarze batcha, długości sekwencji i pamięci aktywacji.

Te zmiany sprawiają, że dostępny limit pamięci jest lepiej wykorzystany, ale nie zmieniają podstawowej rzeczywistości. Jeśli twój projekt wymaga większych modeli, dłuższych kontekstów lub większej współbieżności, potrzebujesz więcej VRAM.

Czego potrzebuję bardziej w porównaniu 5070 Ti vs 5080: pojemności czy szybkości?

Można to ująć tak: szybkość to tempo jazdy, a pojemność to liczba pasażerów, których możesz zabrać. Deep learning potrzebuje obu, ale pojemność decyduje o tym, czy w ogóle wyjedziesz z parkingu.

5080 może oferować wyższą przepustowość niż 5070 Ti w wielu workloadach. Jednak porównanie 5070 Ti vs 5080 nie zmienia odpowiedzi na pytanie "czy dam radę to załadować i uruchomić", bo oba osiągają swoje limity.

Dlatego właśnie ludzie czują się rozczarowani po wymianie sprzętu. Małe testy pokazują poprawę, ale przy prawdziwym obciążeniu trafiają na ten sam mur. Tyle że teraz mur pojawia się 30 sekund później.

Jeśli więc rozważasz zakup z myślą o deep learningu, warto najpierw określić, do której grupy należysz:

- Ograniczone prędkością: już mieścisz się w limicie, chcesz tylko szybszych kroków.

- Ograniczona pojemność: nie mieścisz się i tracisz czas na przycinanie problemu.

Większość osób porównujących 5070 Ti vs 5080 pod kątem deep learningu należy do tej drugiej grupy, nawet jeśli jeszcze o tym nie wie.

Porozmawiajmy teraz o opcji, która najczęściej oszczędza najwięcej czasu: przeniesieniu "ciężkich zadań" na większy GPU, bez przebudowywania całego środowiska wokół nowego lokalnego zestawu.

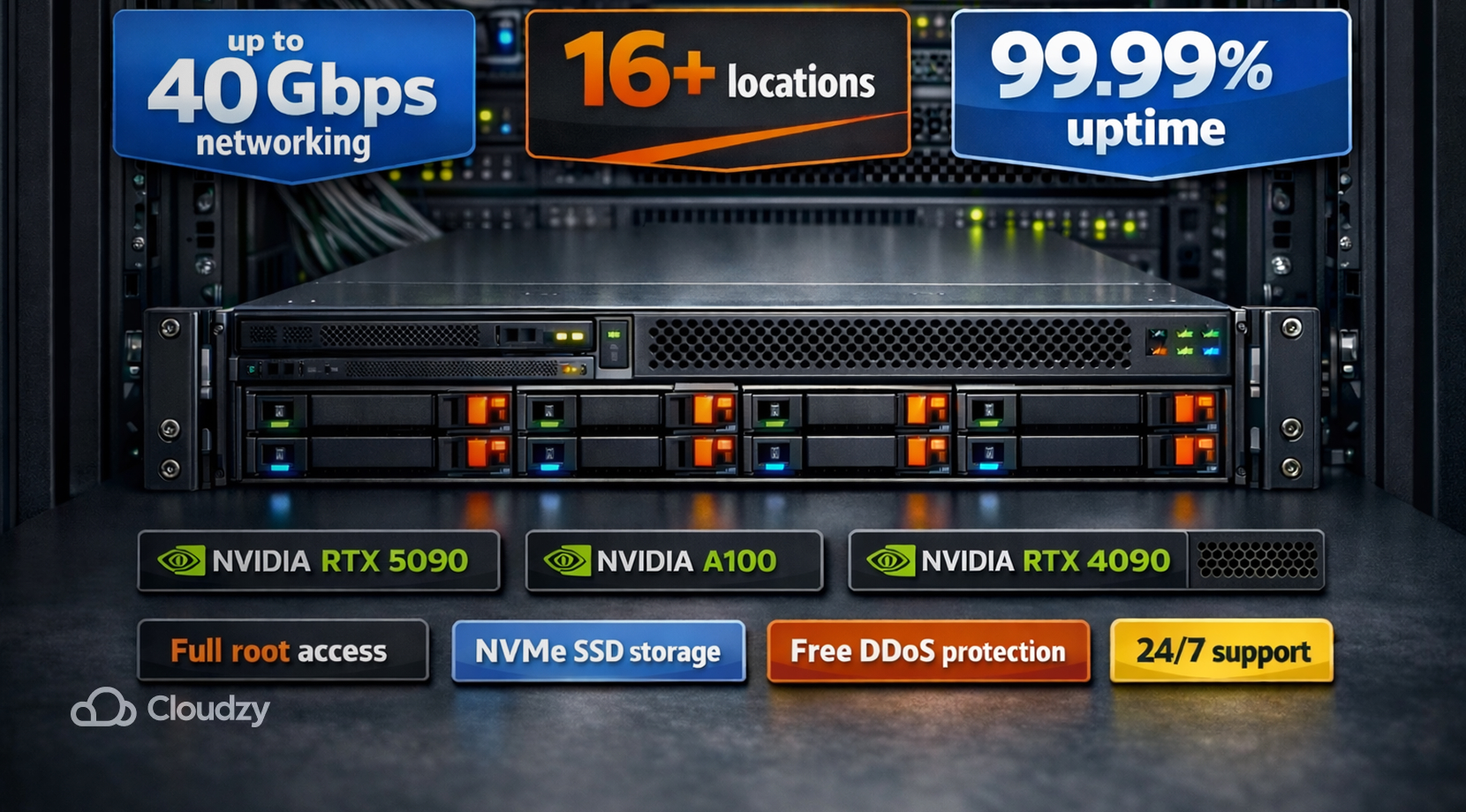

Przystępne rozwiązanie: użyj VPS GPU do wymagających zadań

W naszym zespole infrastrukturalnym najczęściej obserwujemy ten sam schemat: ludzie prototypują lokalnie, a potem docierają do punktu, w którym porównanie 5070 Ti vs 5080 przestaje mieć znaczenie, bo zadanie po prostu nie mieści się w pamięci.

W tym momencie potrzebujesz dostępu do większej puli VRAM - do trenowania i do realistycznych testów inferencji. I tu pojawia się Cloudzy GPU VPS jest czystym rozwiązaniem.

Nasze plany GPU VPS obejmują opcje NVIDIA takie jak RTX 5090, A100 i RTX 4090, a także pełny dostęp root, pamięć NVMe SSD, sieć do 40 Gbps, 12 lokalizacji, bezpłatną ochronę DDoS, wsparcie 24/7 i cel dostępności na poziomie 99,95%.

Jak to pomaga w przypadku 5070 Ti vs 5080 lub innego GPU na tym samym poziomie? Otóż:

- Możesz uruchomić swój prawdziwy model i profil promptów na sprzęcie z większą ilością VRAM, dzięki czemu decyzje stają się oczywiste na podstawie własnych logów.

- Możesz zachować lokalny GPU do developmentu i szybkich testów, a "duże karty" wynajmować tylko do ciężkich zadań.

Jeśli chcesz szybko przypomnieć sobie, czym właściwie jest VPS GPU, i co oznacza różnica między dedykowanym a współdzielonym dostępem do GPU, nasz przewodnik dla początkujących wyjaśnia to prostym językiem.

A jeśli nadal nie jesteś pewien, czy w ogóle potrzebujesz GPU do swojego obciążenia, nasze porównanie VPS GPU vs CPU da ci konkretny obraz tego, jakie zadania - trenowanie, inferencja, bazy danych, aplikacje webowe - wymagają jakiego sprzętu.

Gdy infrastruktura jest już ustalona, pozostaje ostatni krok: wybrać workflow, który nie marnuje twojego czasu.

Prosty workflow, który pomoże ci określić, czego potrzebujesz

Wielu twórców projektów ML wpada w pułapkę fałszywego wyboru: albo kupić mocniejszą kartę konsumencką, albo się męczyć. W praktyce 5070 Ti vs 5080 może być częścią sensownego workflow, jeśli traktujesz tę kartę jako lokalne narzędzie developerskie, a nie cały stack produkcyjny.

Oto workflow, który w praktyce dobrze się sprawdza:

- Używaj swojego 16 GB GPU do kodowania, debugowania i małych eksperymentów.

- Trzymaj gotowy szablon środowiska "dużego GPU" do zdalnych uruchomień.

- Przenieś testy trenowania i serwowania wymagające dodatkowych zasobów na GPU VPS.

- Monitoruj uruchomienia i zapisuj logi, żeby wyniki były powtarzalne.

Jeśli chcesz dokładniej zapoznać się z wyborem odpowiedniej klasy GPU do zadań ML, zapoznaj się z naszym zestawieniem najlepsze GPUs do uczenia maszynowego to dobry kolejny krok.

Ostatecznie wybór między 5070 Ti a 5080 to decyzja dotycząca lokalnych obliczeń, ale skalowanie głębokiego uczenia to już kwestia infrastruktury. Jeśli zastanawiasz się, jak karty wyższej klasy wpływają na rzeczywiste zachowanie modeli AI, sprawdź nasz H100 vs RTX 4090 benchmark zestawienie jest przydatne, bo wciąż powraca do tego samego motywu VRAM – najpierw dopasowanie, potem szybkość.