Yerel LLM kullanımına olan talep giderek artıyor ve hangi seçeneğin en uygun olduğuna karar vermek çoğu kullanıcı için kafa karıştırıcı olabiliyor. Üstelik bu araçları kullanmak göründüğü kadar basit değil. Kaynak tüketimi göz ardı edilemeyecek kadar yüksek olduğundan, pek çok kullanıcı bu araçlara yaklaşmak istemiyor. Yeni başlayanların terminal ekranında saatlerce vakit geçirmesi de cabası.

Bununla birlikte, işleri kolaylaştıran iki öne çıkan seçenek var: Ollama ve LM Studio. Her ikisi de yerel LLM çalıştırmak için en yaygın kullanılan platformlar arasında yer alıyor ve performans açısından oldukça güçlü. Ancak her biri farklı iş akışlarına hitap ettiğinden aralarında seçim yapmak zorlaşabiliyor. Daha fazla uzatmadan Ollama ile LM Studio karşılaştırmasına geçelim.

Uzmanlara Yönelik Teknik Bir Araç Olarak Ollama

Yerel LLM çalıştırma söz konusu olduğunda Ollama, sunduğu zengin özellikler sayesinde güçlü bir tercih. Yüksek düzeyde yapılandırılabilir olmasının yanı sıra, topluluk destekli açık kaynaklı bir platform olduğundan ücretsiz erişilebiliyor.

Ollama, yerel LLM çalıştırmayı kolaylaştırıyor; ancak öncelikli olarak CLI tabanlı (komut satırı arayüzü) bir araç olduğundan temel terminal bilgisi gerektiriyor. CLI öncelikli yapısı, sadeliği sayesinde geliştirme iş akışları için büyük bir avantaj. CLI ile çalışmak başlangıçta kolay olmasa da yerel LLM'yi sıfırdan kurup yönetmeye kıyasla öğrenme süreci çok daha kısa.

Ollama, bilgisayarınızı HTTP API'ye sahip yerel bir mini sunucu gibi kullanır. Bu sayede uygulamalarınız ve scriptleriniz, platformun pek çok modeline erişebilir. Yani verilerinizi buluta göndermeden, online bir LLM'nin sorulara verdiği gibi yanıtlar alırsınız. Üstelik API, kullanıcıların Ollama'yi web sitelerine ve chatbot'lara entegre etmesine de imkân tanıyor.

CLI tabanlı yapısı sayesinde Ollama oldukça hafif çalışır: kaynak tüketimi düşük, performans odaklı. Bu, eski bir bilgisayarda sorunsuz çalışacağı anlamına gelmiyor elbette; ancak mevcut kaynakların tamamını LLM modeline aktarmak isteyenler için makul bir seçenek.

Tüm bunlar göz önüne alındığında, Ollama'nin geliştirme iş akışlarına güçlü biçimde odaklandığını tahmin etmiş olmalısınız ve bu doğru. Kolay entegrasyonu, yerel gizliliği ve API öncelikli tasarımı sayesinde geliştirici odaklı bir yaklaşım benimseyen kullanıcılar için açık ara en mantıklı seçim.

Ollama ile LM Studio karşılaştırmasında Ollama, API öncelikli geliştirme yapısıyla öne çıkabilir. CLI ortamı size yabancı geliyorsa, kullanım kolaylığı ön planda tutulan daha erişilebilir bir seçenek için okumaya devam edin.

LM Studio: Kullanıcı Dostu Bir Seçenek

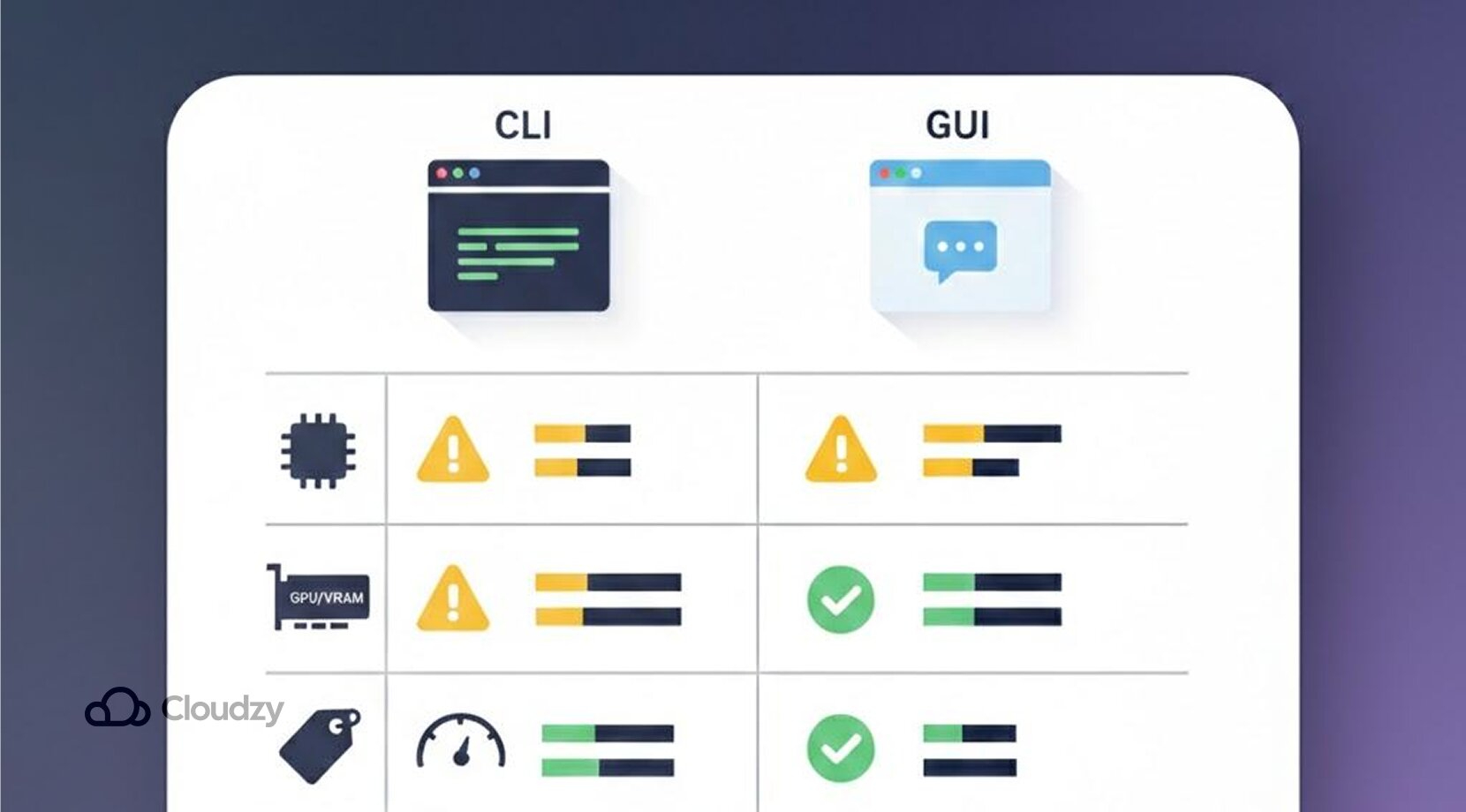

LM Studio, Ollama'den belirgin biçimde ayrılır. Tam anlamıyla bir CLI arayüzü olmak yerine herhangi bir terminal komutu gerektirmez; GUI (grafiksel kullanıcı arayüzü) ile donatıldığından tıpkı sıradan bir masaüstü uygulaması gibi görünür. Bazı yeni kullanıcılar için Ollama ile LM Studio arasındaki tercih, CLI'ın sadeliği ile GUI'nin erişilebilirliği arasındaki seçime indirgenebilir.

LM Studio'nun teknik engelleri ortadan kaldırma yaklaşımı, her kullanıcı için sade bir deneyim sunuyor. Modelleri komut satırıyla ekleyip çalıştırmak yerine menüleri kullanabilir, sohbet benzeri bir kutuya yazarak etkileşime geçebilirsiniz. ChatGPT'ye benzer bir his verdiğinden, neredeyse herkesin yerel LLM'lerle kolayca denemeler yapabileceği bir ortam sunuyor.

Platform, kullanıcıların modelleri keşfedip doğrudan çalıştırabildiği düzenli bir uygulama içi model tarayıcısıyla geliyor. Bu tarayıcıda gündelik kullanıma yönelik hafif modellerden ağır görevler için tasarlanmış güçlü modellere kadar geniş bir yelpaze mevcut. Bunun yanı sıra mevcut modeller için kısa açıklamalar ve önerilen kullanım senaryoları sunuluyor; modeller tek tıklamayla indirilebiliyor.

Modellerin büyük çoğunluğu ücretsiz indirilse de bir kısmı ek lisans veya kullanım koşulları içerebilir. LM Studio, bazı iş akışları için kolay entegrasyona olanak tanıyan yerel sunucu modu da sunuyor; ancak platform esas olarak yeni başlayanlar için tasarlanmış, kullanımı kolay bir masaüstü arayüzü etrafında şekillendirilmiş. Tüm bunları söyledikten sonra, şimdi Ollama ile LM Studio'yu yan yana karşılaştıralım.

Dikkat Çekici Gözlemler: Ollama ile LM Studio Karşılaştırması

Daha ileriye geçmeden önce önemli bir noktanın altını çizmek gerekiyor: 'Ollama ile LM Studio karşılaştırması' ifadesi, birinin nesnel olarak daha iyi olduğunu çağrıştırabilir; ancak durum böyle değil. İki platform farklı kullanıcı kitlelerine hitap etmek üzere tasarlanmış. İşte hızlı bir Ollama ile LM Studio özeti.

| Özellik | Ollama | LM Studio |

| Kullanım kolaylığı | İlk başta daha az erişilebilir, terminal bilgisi gerektirir | Yeni başlayanlara uygun, yalnızca birkaç tıklamayla kullanılabilir |

| Model desteği | Pek çok popüler açık ağırlıklı model: gpt-oss, gemma 3, qwen 3 | Ollama ile aynı modeller: gpt-oss, gemma3, qwen3 |

| özelleştirme | Son derece özelleştirilebilir, API aracılığıyla kolayca entegre edilir | Daha az esneklik sunar; ayarlar geçiş düğmeleri ve kaydırıcılarla yapılır |

| Donanım gereksinimleri | Bu, modelin boyutuna bağlıdır; yeterli donanım olmadan büyük modeller yavaş çalışır | Yine model boyutuna ve donanımınıza bağlı |

| Gizlilik | Varsayılan olarak güçlü gizlilik; ek harici API gerekmez | Sohbetler yerel kalır; ancak uygulama güncellemeler ve model arama/indirme için sunucularla iletişim kurar. |

| Çevrimdışı kullanım | Modeller indirildikten sonra tamamen çevrimdışı çalışır | Modeller indirildikten sonra çevrimdışı kullanımda da oldukça başarılı |

| Mevcut platformlar | Linux, Windows, macOS | Linux, Windows, macOS |

- Gelişmiş modellerin donanım yükü: Mümkün olduğunda daha büyük ve daha yetenekli bir model tercih etmek neredeyse herkesin ilk seçeneğidir. Ancak büyük modelleri çoğu dizüstü bilgisayarda çalıştırmak ciddi sorunlara yol açabilir; çünkü bu modeller daha fazla RAM ve VRAM tüketir. Sonuç olarak yavaş yanıt süreleri, kısıtlı bağlam uzunluğu veya modelin hiç yüklenmemesi gibi durumlarla karşılaşabilirsiniz.

- Pil sorunları: LLM'leri yerel olarak çalıştırmak, yoğun kullanımda pilinizi hızla tüketebilir. Bu durum pil ömrünü kısaltır; üstelik fanların ve soğutucunun çıkardığı rahatsız edici gürültüyü de göz ardı etmek mümkün değildir.

Ollama - LM Studio Karşılaştırması: Model İndirme

Ollama ile LM Studio arasındaki bir diğer farklılık, model indirme yaklaşımlarıdır. Daha önce de belirtildiği gibi, Ollama yerel LLM'leri tek tıklamayla yüklemiyor. Bunun yerine, yerleşik terminal ve komut satırını kullanmanız gerekiyor. Komutlar ise oldukça sade ve anlaşılır.

Ollama üzerinde model çalıştırmanın hızlı bir yolu aşağıdadır.

- Favori modelinizi indirmek için ollama pull gpt-oss yazın ya da tercih ettiğiniz başka bir model adı kullanın (Kütüphaneden seçebileceğiniz bir etiket eklemeyi unutmayın).

Örnek: ollama pull gpt-oss:20b - Ardından modeli çalıştırmak için ollama run gpt-oss komutunu kullanabilirsiniz.

- Ek geliştirici araçları da eklenebilir. Örneğin Claude'u ollama launch claude komutuyla ekleyebilirsiniz.

Terminal ve komutlar sizin için alışılmış değilse, LM Studio'yu bir deneyin. Modelleri indirmeye ve kullanmaya başlamak için herhangi bir terminale bir şey yazmanıza gerek yok. Yerleşik model indiriciye geçin ve Llama ya da Gemma gibi anahtar kelimelerle LLM arayın.

Alternatif olarak, arama çubuğuna tam Hugging Face URL'leri girebilirsiniz.

Dilediğiniz yerden keşfet sekmesine erişmek için tuşuna basmanız da mümkündür. ⌘ + 2 Mac üzerinde veya Ctrl + 2 Windows / Linux üzerinde.

Ollama: Hız Konusunda Öne Çıkıyor

Bazı kullanıcılar ve işletmeler için hız her şeyden önce gelir. Ollama ile LM Studio'yu hız açısından karşılaştırdığımızda, Ollama daha hızlı çıkıyor; ancak bu sonuç farklı yapılandırma ve donanım kurulumlarına göre değişebilir.

r/ollama subreddit'indeki bir Reddit kullanıcısının deneyimine göre, Ollama, LM Studio'dan daha hızlı işlem yaptı.

Bu iddia temelsiz değil; kullanıcı hem Ollama hem de LM Studio'yu qwen2.5:1.5b modelini beşer kez çalıştırarak test etti ve saniyedeki ortalama token sayısını hesapladı.

Ollama ve LM Studio: Performans ve Donanım Gereksinimleri

Ollama ile LM Studio arasındaki performans farkı, arayüzden çok donanıma bağlıdır. Yerel LLM'leri ilk kez deneyimlemek, alıştığımız bulut tabanlı LLM'lerden oldukça farklı bir his. Bir LLM'yi tamamen kendinize ait olarak kullanmak güçlendirici geliyor, ta ki performans duvarına çarpana kadar.

Son birkaç yılda RAM ve VRAM fiyatlarının büyük ölçüde artmasıyla birlikte, büyük LLM modellerini çalıştıracak güce sahip bir makine kurmak oldukça zorlaştı.

Popüler Modeller Genellikle 24-64 GB RAM Gobble Eder

Doğru duydunuz. Ollama ve LM Studio arasındaki rekabette belirleyici olan donanım gereksinimlerinin hangisinin kazandığı değil. Popüler orta ve büyük ölçekli modelleri yavaşlama veya hata olmadan sorunsuz çalıştırmak istiyorsanız en iyi seçenek 24-64 GB RAM yüklemektir. Ancak çoğu durumda, daha uzun bağlam ve ağır iş yüklerinde bu miktardaki RAM bile yetersiz kalır.

8-16 GB RAM ile nicelleştirilmiş (quantized) olarak adlandırılan daha küçük modelleri çalıştırabilirsiniz; ancak büyük modellerin sunduğu konfor ve performansı yakalayamazsınız, üstelik bazı kalite ve hız tavizleri de kaçınılmaz olur. Ne yazık ki sorun yalnızca RAM ile sınırlı değil; diğer bileşenlerin de yeterince güçlü olması gerekiyor.

Güçlü GPU'ler, Hayal Kırıklığını Önlemenin Temel Koşuludur

Modeller CPU üzerinde çalışabilse de grafik işlemci birimi, modelinizin performansında kritik bir rol oynar. Hızlı bir GPU ve yeterli VRAM olmadan token üretimi yavaş ilerler, uzun yanıtlarda ciddi gecikmeler yaşanır ve her şey çok geçmeden katlanılmaz bir hal alır.

Çok da umutlanmayın, zira güçlü RTX 5070Ti ve RTX 5080 bile ciddi derin öğrenme görevleri için yeterli değil. Bunun nedeni şu: 60 bin token ve üzeri bağlam uzunluklarında Ollama'nin kendisi yaklaşık 23 GB VRAM gerektirdiğini belirtiyor; bu da söz konusu GPU'lerde standart olarak gelen 16 GB VRAM'nin çok üzerinde.

Bu güç aralığının ötesine geçmek ise astronomik maliyetler anlamına gelir. Bütçe sizin için sorun değilse bile yerel LLM çalıştırırken göz önünde bulundurmanız gereken bazı GPU seçenekleri noktalar var.

Büyük yerel LLM modellerini çalıştıracak kadar güçlü bir makine nasıl kurulur sorusu bu noktada kafa karıştırıcı hale gelebilir. Pek çok kişi için bu, farklı bir çözümü değerlendirmeye başladıkları dönüm noktasıdır.

Meraklıların göz attığı bir alternatif yöntem, güçlü ve önceden yapılandırılmış donanıma sahip sanal makineler kullanmaktır. Örneğin bir VPS (sanal özel sunucu) kullanmak, ev dizüstü bilgisayarınızı veya kişisel donanımınızı tüm ön koşulları hazır gelecek şekilde seçtiğiniz özel bir sunucuya bağlamanın pratik bir yoludur.

VPS kullanmak size iyi bir çözüm gibi görünüyorsa Cloudzy'nin Ollama VPShizmetini ciddi şekilde tavsiye ederiz; temiz bir kabukta çalışmaya başlayabilirsiniz. Ollama önceden yüklü gelir, böylece yerel LLM'lerle tam gizlilik içinde hemen çalışmaya başlayabilirsiniz. 12 konum, %99,95 çalışma süresi ve 7/24 destek ile uygun fiyatlı bir seçenektir. Özel VCPU'ler, DDR5 bellek ve 40 Gbps'a kadar bağlantı hızı üzerinden NVMe depolama ile kaynaklar oldukça yeterlidir.

Ollama ve LM Studio: Kim Hangisini Kullanmalı

Daha önce de belirtildiği gibi her iki platform da son derece işlevseldir ve birini diğerine tercih etmek için net bir neden yok. Ancak işin püf noktası şu: Her biri farklı bir iş akışına uygundur, dolayısıyla hangisini seçeceğiniz ihtiyacınıza göre değişir.

Otomasyon ve Geliştirme İçin Ollama'yi Tercih Edin

Ollama kullanırken amacınız yalnızca bir modelle sohbet etmek değil, onu başka bir projenin bileşeni olarak kullanmaktır. Ollama şunlar için idealdir:

- Geliştiriciler chatbot, copilot ve derin öğrenme gerektiren diğer ürünleri geliştirenler

- Yoğun otomasyon içeren iş akışları, rapor özetleme betikleri veya zamanlanmış taslak oluşturma gibi

- Takımlar her ortamda tutarlı model sürümleri isteyenler

- API öncelikli bir yaklaşım arayanlar, diğer araçların modellere düzenli olarak bağlanabilmesi için

Sonuç olarak, uygulamalarınız için güvenilir modeller istiyorsanız Ollama sizin için doğru seçenek olabilir.

LM Studio, Yerel LLM'lere Başlamak İçin Daha Kolay Seçenek

Teknik karmaşayla uğraşmadan yerel AI kurulumlarını keşfetmek istiyorsanız LM Studio kesinlikle daha iyi bir seçenektir.

Genel olarak LM Studio şunlar için daha uygundur:

- Yeni Başlayanlar terminalden ve komut satırından uzak durmak isteyenler

- Yazarlar, içerik üreticileri veya öğrenciler basit bir sohbet arayüzü gibi AI desteğine ihtiyaç duyanlar

- Farklı seçenekleri deneyen kişiler, kendi kullanım alanlarını bulmak için çeşitli modelleri hızlıca karşılaştırmak isteyenler

- Komut yazmaya yeni başlayanlar ve ayarları yazarak değil, arayüzden yapmak isteyenler

Kısacası, yerel LLM'leri indirip hemen kullanmaya başlamak istiyorsanız LM Studio ihtiyacınızı karşılar.

Ollama ve LM Studio: Son Değerlendirme

Ollama ile LM Studio arasındaki rekabet etrafındaki gürültüyü bir kenara bırakırsanız, asıl önemli olan günlük deneyiminizdir; iş akışınız ve donanım sınırlarınız belirleyicidir.

Ollama genel olarak:

- Esnek ve geliştirici odaklı

LM Studio şu şekildedir:

- Özel bir arayüzle yeni başlayanlar için de erişilebilir

İkisi de sorunsuz çalışmak için güçlü ve pahalı donanım gerektirir. Büyük bir yerel LLM'yi kendi başına çalıştırma imkanı herkesin elinde değildir. Bu nedenle, donanımınızı zorlamadan gelişmiş modeller çalıştırmak istiyorsanız bir özel GPU VPSAşağıda yer alan Ollama ile LM Studio hakkında sık sorulan bazı sorular.