S rostoucí poptávkou po lokálních LLMs se mnozí uživatelé cítí zmatení při výběru toho správného, ale jejich používání není tak jednoduché, jak by se mohlo zdát. Jelikož jsou poměrně energeticky náročné, někdy více než jindy, mnoho lidí se jim raději vyhýbá. Nemluvě o hodinách, které si začátečníci odpracují zíráním na terminál.

Existují ale dva hlavní kandidáti, kteří situaci zjednodušují. Ollama a LM Studio jsou dvě z nejpoužívanějších platforem pro spouštění lokálních LLMs s vysokým výkonem. Volba mezi nimi ale není jednoduchá, jelikož každá je navržena pro jiné pracovní postupy. Pojďme se podívat na srovnění Ollama vs LM Studio.

Ollama jako nástroj pro technicky zdatné uživatele

Ollama je silná volba pro spouštění lokálních LLMs díky svým mnoha funkcím. Je nejen vysoce konfigurován, ale také k němu máte bezplatný přístup, jelikož jde o komunitu podporovanou open-source platformu.

Ačkoli Ollama usnadňuje spouštění lokálních LLMs, je to CLI-first (rozhraní příkazového řádku), takže stále vyžaduje znalost terminálu. To je obrovská výhoda pro vývojové pracovní postupy díky své jednoduchosti. Práce s CLI není snadná, ale zvládat ji je méně časově náročné než spouštět lokální LLMs na vlastní pěst.

Ollama používá váš osobní počítač jako místní mini-server s HTTP API, což dává vašim aplikacím a skriptům přístup k jeho mnoha modelům. To znamená, že reaguje na příkazy stejně jako online LLM, bez toho, aby vaše data odeslala do cloudu. A API také uživatelům umožňuje integrovat Ollama a připojit jej k webovým stránkám a chatbotům.

Kvůli své CLI povaze je Ollama také poměrně lehký, takže spotřebovává méně prostředků a zaměřuje se na výkon. To však neznamená, že jej můžete spustit na starém počítači, ale pro ty, kteří chtějí vytěžit maximum z dostupných prostředků a věnovat je samotnému modelu LLM, je to stále slibná možnost.

S tím vším řečeno, asi jste si už všimli, že Ollama je silně zaměřený na vývojové pracovní postupy, a máte pravdu. Díky snadné integraci, místní ochraně soukromí a návrhu s ohledem na API je to jasná volba, pokud myslíte jako vývojář.

V diskusi Ollama vs LM Studio může být Ollama výhodnější kvůli svému vývoji zaměřenému na API. Pokud vám CLI runtime přijde příliš cizí, počkejte na lehčí alternativu navrženu s fokusem na jednoduchost.

LM Studio: Uživatelsky přívětivá volba

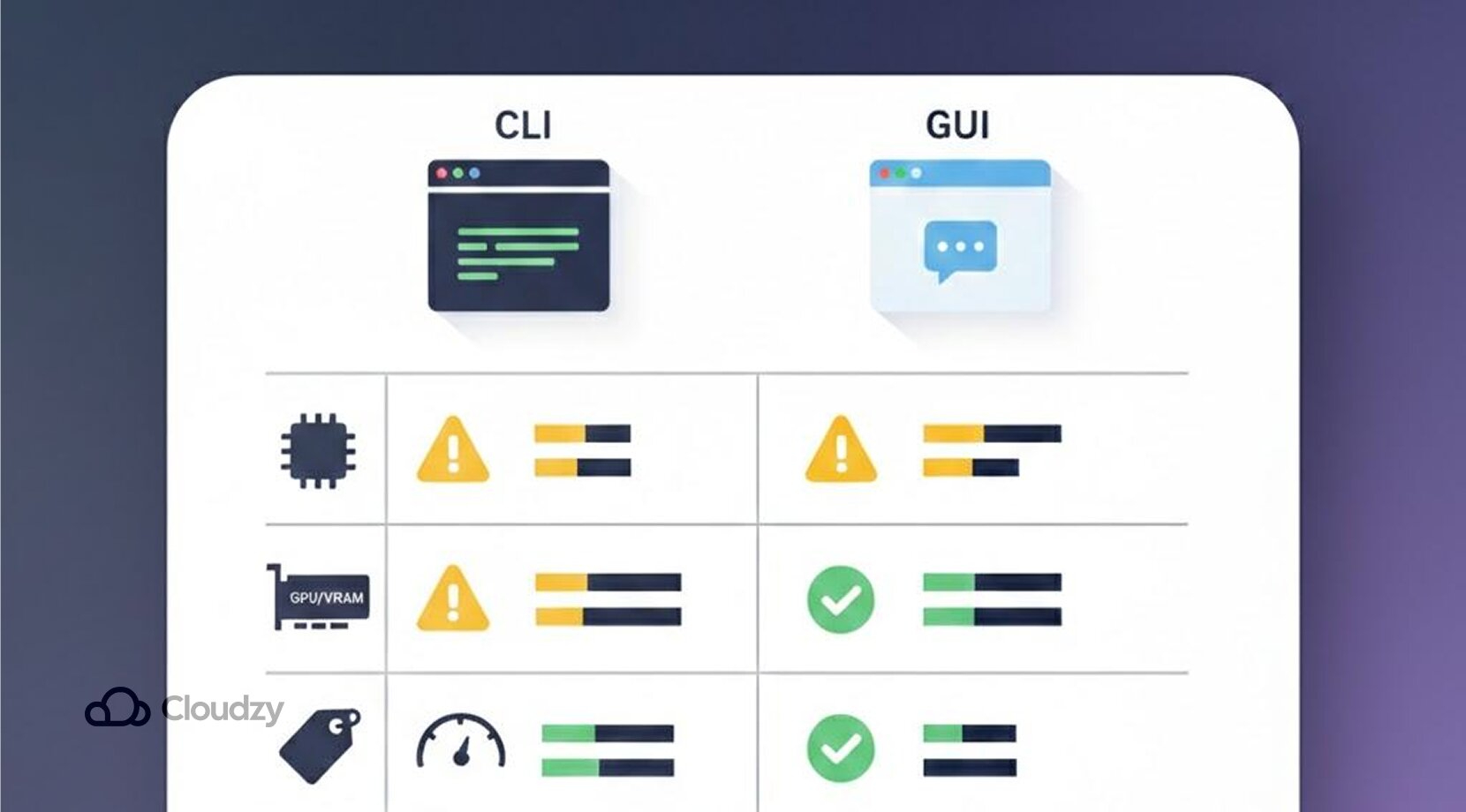

LM Studio se výrazně liší od Ollama. Místo plnohodnotného CLI rozhraní nevyžaduje žádné příkazy v terminálu a protože je vybaveno GUI (grafickým uživatelským rozhraním), vypadá jako libovolná jiná desktopová aplikace. Pro některé začátečníky se volba mezi Ollama a LM Studio svádí na jednoduchost CLI vs GUI.

Přístup LM Studio k odstranění technických překážek vytváří jednoduchý prostor pro každého. Místo přidávání a spouštění modelů pomocí příkazů můžete jednoduše použít dostupné nabídky a psát do pole podobného chatu. Zdá se, že s LM Studio může každý experimentovat s místními LLM, protože vypadá stejně jako ChatGPT.

Dokonce obsahuje pohodlný prohlížeč modelů přímo v aplikaci, kde mohou uživatelé objevovat a nasazovat libovolný model, od lehkých verzí pro běžné úkoly až po výkonné verze pro náročnější práci. Navíc vám tento prohlížeč zobrazí krátké popisy dostupných modelů a doporučené případy použití a umožňuje stáhnout modely jediným kliknutím.

Přestože jsou většina modelů ke stažení zdarma, některé mohou zahrnovat další licence a práva na používání. U některých pracovních postupů vám LM Studio může poskytnout místní serverový režim pro snadnou integraci, ale je primárně navržen kolem jednoduchého desktopového rozhraní pro začátečníky. Ale pojďme se podívat na Ollama a LM Studio vedle sebe.

Zajímavá pozorování: Ollama vs LM Studio

Než budeme pokračovat, musím zmínit jednu kritickou věc: fráze "Ollama vs LM Studio" by mohla naznačovat, že jeden je objektivně lepší než druhý, ale není to tak jednoduché, protože jsou určeny pro různé skupiny uživatelů. Zde je rychlý přehled Ollama vs LM Studio.

| Funkce | Ollama | LM Studio |

| Snadné použití | Na začátku méně přívětivý, vyžaduje znalost terminálu | Vhodný pro začátečníky, vyžaduje hodně klikání myší |

| Podpora modelů | Mnoho populárních open-source modelů: gpt-oss, gemma 3, qwen 3 | Stejné jako Ollama: gpt-oss, gemma3, qwen3 |

| přizpůsobení | Vysoce přizpůsobitelný, snadná integrace přes API | Méně svobody, nastavujete běžné parametry pomocí přepínačů a posuvníků |

| Požadavky na hardware | Záleží na tom; větší modely bez dostatečného hardwaru běží pomaleji | Opět záleží na velikosti modelu a vašem hardwaru |

| Soukromí | Skvělá ochrana soukromí ve výchozím stavu bez dodatečného externího API | Chaty zůstávají místní, aplikace ale stále kontaktuje servery pro aktualizace a vyhledávání/stahování modelů. |

| Offline používání | Plná podpora offline režimu po stažení modelů | Také vynikající offline režim po stažení modelů |

| Dostupné platformy | Linux, Windows, macOS | Linux, Windows, macOS |

- Pokročilé modely - problém s hardwarem: Větší a výkonnější modely by si běžně vybral kdokoliv, kdyby to bylo možné. Spouštět je na běžných noteboocích ale může způsobit vážné problémy, protože větší modely vyžadují více RAM a VRAM. To znamená pomalé odpovědi, omezenou délku kontextu nebo úplné selhání načtení modelu.

- Problémy s baterií: Spouštění LLMů lokálně vám může rychle vyprázdnit baterii při vysokém zatížení. To vede ke zkrácené výdrži baterie a navíc k nepříjemnému zvuku, který vydávají ventilátory a chladič.

Ollama vs LM Studio: Stahování modelů

Dalším aspektem porovnání Ollama vs LM Studio jsou jejich rozdílné přístupy ke stahování modelů. Jak jsme se zmínili dříve, Ollama neinstaluje lokální LLMy jedním kliknutím. Místo toho musíte použít jeho vestavěný terminál a příkazový řádek. Příkazy jsou ale jednoduché na pochopení.

Zde je rychlý způsob, jak spouštět modely na Ollama.

- Stáhněte si oblíbený model příkazem ollama pull gpt-oss nebo jakýkoliv jiný model, který si vyberete (nezapomeňte přidat tag, který si vyberete z knihovny).

Příklad: ollama pull gpt-oss:20b - Poté můžete model spustit příkazem ollama run gpt-oss

- Můžete také přidat další kódovací nástroje. Například Claude přidáte příkazem ollama launch claude

Pokud nejste zvyklí na terminály a příkazy, zkuste LM Studio. Abyste mohli začít pracovat a stahovat modely, nemusíte nic psát do žádného terminálu. Jednoduše se podívejte do jeho vestavěného stahování modelů a hledejte LLMy podle klíčových slov jako Llama nebo Gemma.

Případně můžete do vyhledávacího pole zadat úplné Hugging Face URLy.

Máte také možnost přistupovat k kartě discover odkudkoliv stisknutím ⌘ + 2 na Macu, nebo Ctrl + 2 na Windows / Linux.

Ollama: Lepší na rychlost

Někdy je pro uživatele a podniky důležitá jen rychlost. Pokud jde o porovnání Ollama vs LM Studio z hlediska rychlosti, Ollama je rychlejší, ale to se může lišit v závislosti na různých konfiguracích a hardwarovém vybavení.

Jeden uživatel z subredditu r/ollamahlásil, že Ollama zpracovává rychleji než LM Studio.

Není to bezpodstavné tvrzení, protože uživatel testoval Ollama i LM Studio spuštěním qwen2.5:1.5b pětkrát a vypočítal průměrný počet tokenů za sekundu.

Ollama vs LM Studio: Výkon a hardwarové požadavky

Výkon Ollama vs LM Studio se více týká hardwaru než uživatelského rozhraní. Zažít lokální LLMy poprvé je určitě něco jiného než cloudové LLMy, na které jsme zvyklí. Cítí se skvěle mít LLM jen pro sebe, dokud nenarazíte na limit výkonu.

Vzhledem k tomu, jak ceny RAM a VRAM v posledních letech vzrostly, je poměrně obtížné vybavit váš počítač dostatečným výkonem na spuštění velkých LLMů.

Populární modely obvykle spotřebují 24-64 GB RAM

Ano, správně jste slyšeli. Hardwarové požadavky nejsou o tom, která strana vyhraje v porovnání Ollama vs LM Studio. Chcete-li hladký zážitek při spouštění populárních středních až velkých modelů bez zpomalení nebo chyb, nejlepší je nainstalovat 24-64 GB RAM. Ve většině případů se ale i taková kapacita RAM stane irelevantní s delším kontextem a těžšími úlohami.

Můžete ovšem spouštět menší, tzv. kvantované modely na 8-16 GB RAM, ale nedostanete stejný komfort nebo výkon jako u větších verzí, a navíc dojde k určitým kompromisům v kvalitě a rychlosti. Bohužel RAM není jediný problém; i ostatní komponenty musí být spolehlivé.

Výkonné GPUy jsou základem pro bezfrustační zážitek

Přestože se modely mohou spouštět na CPUs, grafická karta stále hraje zásadní roli. Bez rychlého GPU a dostatku VRAM se setkáte s pomalým generováním tokenu, dlouhými prodlevami a rychle to bude neúnosné.

Nerada bychom vám zkazili náladu, ale ani ty nejmocnější RTX 5070Ti ani RTX 5080 nestačí pro vážné hluboké učení. Některé konfigurace s 60k+ kontextem vyžadují podle Ollama zhruba 23GB VRAM, což je výrazně více než typických 16GB VRAM z těchto GPUs.

Going čehokoli výkonnějšího je astronomicky drahý. Pokud vás cena netrápí, stejně je potřeba zvážit Možnosti GPU při provozování místních LLMs.

Pokud si nejste jistí, jak sestavit stroj dostatečně výkonný na místní LLM modely, zde přichází zlomový okamžik. Mnozí lidé si v tomto bodě začnou hledat jiné řešení.

Jednou z alternativ, kterou zvažují nadšenci, je používání virtuálních strojů s robustním a předinstalovaným hardware. Virtuální privátní server (VPS) vám umožňuje připojit svůj domácí laptop nebo jiný osobní hardware k privátnímu serveru podle vašeho výběru, s veškerou potřebnou konfigurací.

Pokud se vám VPS líbí jako řešení, doporučujeme vám Cloudzy Ollama VPS, kde pracujete v čistém prostředí. Máte Ollama předinstalovaný, takže hned začnete s místními LLMs v úplném soukromí. Je to dostupné se 12 lokacemi, 99,95% dostupností a 24/7 podporou. Zdroje jsou hojné: vyhrazené VCPUs, DDR5 paměť a NVMe úložiště přes odkaz až 40 Gbps.

Ollama vs LM Studio: Kdo potřebuje co

Obě platformy jsou vysoce funkční a ani jedna není lepší. Ale tady je háček. Každá se hodí pro jiný typ práce, takže záleží na tom, co potřebujete.

Zvolte Ollama pro automatizaci a vývoj

Váš cíl s Ollama není jen chatovat s modelem, ale používat jej jako komponentu v jiném projektu. Ollama je ideální pro:

- Vývojáři tvorbu produktů jako chatboti, copiloti a další aplikace vyžadující hlubokého učení

- Pracovní toky zahrnující masivní automatizaci, například skripty na sumarizaci zpráv nebo generování konceptů podle plánu

- Týmy které vyžadují konzistentní verze modelů v jakémkoli prostředí

- Každý, kdo chce API-first přístup, aby se ostatní nástroje mohly připojovat k modelům běžně

Pokud chcete, aby modely byly spolehlivé pro vaše aplikace, Ollama je nejlepší volba.

LM Studio je jednodušší možnost pro místní LLMs

Pokud chcete prozkoumat místní AI bez technických starostí, LM Studio je rozhodně lepší volba.

LM Studio se obecně hodí lépe pro:

- Začátečníci kteří se bojí terminálu a jeho příkazového řádku

- Pisatelé, tvůrci nebo studenti kteří potřebují jednoduchou chatovací asistenci s AI

- Lidé, kteří zkoušejí různé možnosti, chtějí rychle porovnat různé modely a najít si své místo

- Kdokoliv, kdo se teprve učí psát prompty a chce měnit nastavení bez psaní příkazů

Stručně: chcete-li si stáhnout a hned začít pracovat s lokálními LLM, LM Studio vám to umožní.

Ollama vs LM Studio: Závěrečné doporučení

Když si odbočíte hype kolem soutěže mezi Ollama a LM Studio, na tom, co opravdu záleží, je vaše každodenní práce — postavená na vašem workflows a možnostech hardware.

Ollama je obecně:

- Flexibilní a orientované na vývojáře

Zatímco LM Studio je:

- Přístupné pro začátečníky s dedikovaným GUI

Obě varianty potřebují výkonný a drahý hardware, aby fungovaly hladce. Mnoho lidí si nemůže dovolit provozovat rozsáhlý lokální LLM sami. Proto chcete-li spouštět pokročilé modely bez zatěžování svého hardware, zkuste Ollama na dedikovaném GPU VPSNíže je časté otázky o Ollama vs LM Studio.