L'apprentissage automatique et son sous-domaine, l'apprentissage profond, exigent une puissance de calcul considérable que seuls les GPU peuvent fournir. Mais tous les GPU ne se valent pas. Voici les meilleurs GPU pour le machine learning, pourquoi ils sont indispensables, et comment choisir celui qui correspond à votre projet.

Pourquoi ai-je besoin d'un GPU pour le machine learning ?

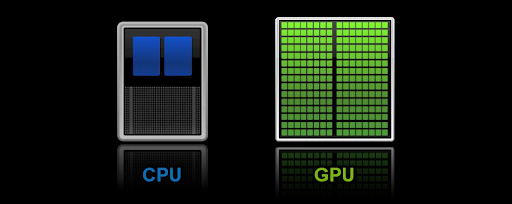

Comme mentionné précédemment, le machine learning réclame une puissance de calcul que seuls les GPU peuvent offrir. Les CPU conviennent pour des applications légères, mais dès que les tâches dépassent le traitement monothread ou le calcul généraliste, ils deviennent un goulot d'étranglement. Cette différence s'explique par la capacité de traitement parallèle des GPU et par leur nombre de cœurs bien supérieur. Un CPU typique dispose de 4 à 16 cœurs, tandis que les meilleurs GPU pour le machine learning en comptent des milliers, notamment des tensor cores, chacun traitant une fraction du calcul en parallèle.

Ce traitement parallèle est ce qui rend les GPU bien plus efficaces que les CPU pour les calculs matriciels et d'algèbre linéaire, notamment pour l'entraînement de grands modèles de machine learning. Pour autant, choisir le bon GPU n'est pas une décision simple.

Comment choisir le meilleur GPU pour l'IA et le DL

La plupart des GPU gèrent sans peine les tâches courantes, mais le machine learning et l'apprentissage profond exigent un niveau de puissance et de qualité bien plus élevé. La vraie question est donc : qu'est-ce qui fait un bon GPU pour le deep learning ?

Un bon GPU pour le deep learning doit réunir les caractéristiques suivantes :

CUDA Cores, Tensor Cores et compatibilité

AMD et Nvidia proposent les meilleurs GPU pour le machine learning et le DL, avec une nette avance pour Nvidia grâce à ses Tensor Cores et CUDA Cores. Les Tensor Cores accélèrent les opérations typiques de l'IA et du machine learning, comme les multiplications matricielles et les convolutions utilisées dans les réseaux de neurones profonds. Les CUDA Cores, quant à eux, permettent un traitement parallèle en distribuant efficacement les opérations sur l'ensemble du GPU. Les GPU dépourvus de ces deux types de cœurs peinent généralement avec les charges de travail ML et DL.

Cela dit, les récentes améliorations de AMD sur la plateforme ROCm et les accélérateurs de la série MI ont renforcé ses GPU, que vous retrouverez dans notre sélection. Les GPU de Nvidia restent néanmoins les meilleurs pour le deep learning, grâce à un écosystème logiciel bien optimisé et une prise en charge étendue des frameworks (par ex. TensorFlow, PyTorch, JAX). Les meilleurs GPU pour le machine learning doivent être hautement compatibles avec ces frameworks ML : une incompatibilité peut nuire à l'accélération, au support des pilotes et bibliothèques (par ex. cuDNN et TensorRT de NVIDIA), ainsi qu'à la pérennité du système.

Vous n'aurez pas non plus accès complet aux outils fournis par le toolkit NVIDIA CUDA, comme les bibliothèques accélérées GPU, le compilateur et le runtime C/C++, ainsi que les outils d'optimisation et de débogage.

VRAM (mémoire vidéo), standard mémoire et bande passante mémoire

Comme pour tout ce qui touche à l'informatique, RAM est un facteur clé, et cela vaut aussi pour les meilleures GPU dédiées au machine learning et au deep learning. Les jeux de données utilisés pour l'entraînement des modèles peuvent atteindre des volumes très élevés (plusieurs TB pour le deep learning), donc les meilleures GPU pour le machine learning doivent disposer de suffisamment de VRAM pour un accès rapide. Les modèles de deep learning ont besoin d'une mémoire importante pour stocker les poids, les activations et les données intermédiaires pendant l'entraînement et l'inférence. La meilleure GPU pour l'entraînement AI doit également offrir une bande passante mémoire suffisante pour déplacer ces grands volumes de données et accélérer les calculs.

Enfin, le standard mémoire est un critère important pour choisir les meilleures GPU pour le deep learning. Les GPU utilisent généralement de la mémoire GDDR (Graphics Double Data Rate) ou HBM (High Bandwidth Memory). Si la mémoire GDDR offre une bande passante élevée adaptée au machine learning et au gaming, les meilleures GPU pour le machine learning utilisent de la HBM, qui combine une bande passante nettement supérieure et une meilleure efficacité.

| Type de GPU | Capacité VRAM | Bande passante mémoire | Standard mémoire | Idéale pour |

| Entrée de gamme (ex. : RTX 3060, RTX 4060) | 8GB – 12GB | ~200-300 GB/s | GDDR6 | Petits modèles, classification d'images, projets personnels |

| Milieu de gamme (ex. : RTX 3090, RTX 4090) | 24GB | ~1 000 GB/s | GDDR6X | Grands jeux de données, réseaux de neurones profonds, transformers |

| GPU AI haut de gamme (ex. : Nvidia A100, H100, AMD MI300X) | 40GB – 80GB | ~1 600+ GB/s | HBM2 | Grands modèles de langage (LLM), recherche AI, ML en production |

| GPU très haut de gamme (ex. : Nvidia H100, AMD Instinct MI300X) | 80GB – 256GB | ~2 000+ GB/s | HBM3 | Entraînement AI à grande échelle, supercalcul, recherche sur des jeux de données massifs |

Pour ceux qui travaillent spécifiquement sur des grands modèles de langage comme ChatGPT, Cloudzy propose une VPS GPU optimisée pour ChatGPT solution avec la puissance nécessaire pour un fine-tuning et une inférence fluides.

TFLOPS (téraflops) et précision virgule flottante

Les performances d'un GPU se mesurent avant tout par sa puissance de calcul, qui dépend de trois facteurs : les TFLOPS, la bande passante mémoire et la précision en virgule flottante. Nous avons déjà abordé la bande passante mémoire dans notre guide sur les meilleurs GPU pour l'entraînement IA. Voici ce que signifient les deux autres critères et pourquoi ils comptent. Les TFLOPS (Teraflops) mesurent la vitesse à laquelle un GPU traite des calculs complexes. Contrairement à la fréquence d'horloge d'un processeur (le nombre de cycles par seconde), les TFLOPS indiquent combien de billions d'opérations en virgule flottante un GPU peut effectuer par seconde. En clair : plus les TFLOPS sont élevés, plus le GPU est puissant pour les tâches de calcul intensif.

La précision en virgule flottante, comme son nom l'indique, détermine le niveau de précision que le GPU permet au modèle de conserver. Les meilleurs GPU pour le deep learning utilisent une précision élevée (par exemple FP32), ce qui garantit des calculs plus exacts, au prix d'un certain coût en performance. Une précision réduite (par exemple FP16) accélère le traitement avec une légère perte de précision, ce qui est généralement acceptable pour les tâches d'IA et de deep learning.

Commencer à bloguer

Commencer à bloguer

Hébergez vous-même votre WordPress sur du matériel de premier ordre, avec un stockage NVMe et une faible latence partout dans le monde. Choisissez votre distribution préférée.

Obtenir WordPress VPS| Précision | Cas d'usage | Exemples d'applications |

| FP32 (précision simple) | Entraînement de modèles de deep learning | Reconnaissance d'images (ResNet, VGG) |

| TF32 (TensorFloat-32) | Entraînement en précision mixte | NLP, systèmes de recommandation |

| FP16 (demi-précision) | Inférence rapide | Conduite autonome, reconnaissance vocale, amélioration vidéo par IA |

Au lieu d'investir massivement dans du matériel physique, accédez instantanément aux VPS GPU Deep Learning de Cloudzy, propulsées par des RTX 4090 et optimisées pour les charges de travail en machine learning et deep learning.

Les meilleurs GPU pour le machine learning en 2025

Maintenant que vous savez ce que les meilleurs GPU pour le machine learning doivent offrir, voici notre sélection classée par TFLOPS, bande passante mémoire, VRAM, etc.

| GPU | VRAM | Bande passante mémoire | Standard mémoire | TFLOPS | Précision en virgule flottante | Compatibilité |

| NVIDIA H100 NVL | 188 GB | 7.8 TB/s | HBM3 | 3,958 | FP64, FP32, FP16 | CUDA, TensorFlow |

| NVIDIA A100 Tensor Core | 80 GB | 2 TB/s | HBM2 | 1,979 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| NVIDIA RTX 4090 | 24 GB | 1.008 TB/s | GDDR6X | 82.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX A6000 Tensor Core | 48 GB | 768 GB/s | GDDR6 | 40 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| NVIDIA GeForce RTX 4070 | 12 GB | 504 GB/s | GDDR6X | 35.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX 3090 Ti | 24 GB | 1.008 TB/s | GDDR6X | 40 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| AMD Radeon Instinct MI300 | 128 GB | 1.6 TB/s | HBM3 | 60 | FP64, FP32, FP16 | ROCm, TensorFlow |

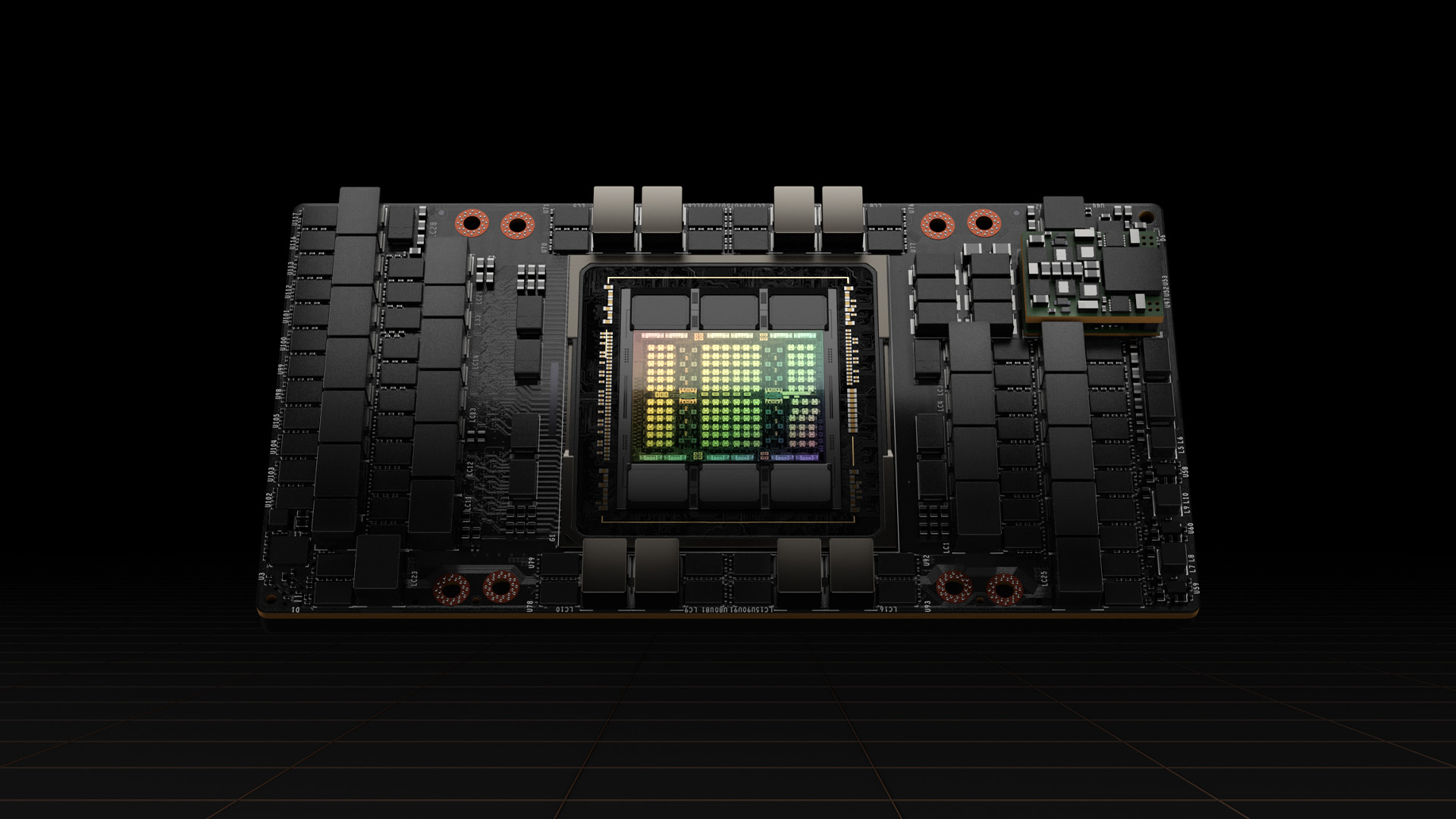

NVIDIA H100 NVL

La H100 NVL est la GPU la plus performante pour le machine learning. Elle offre des performances exceptionnelles pour le deep learning à grande échelle, optimisée pour les charges de travail multi-tenant à haute performance.

- Idéal pour : Recherche avancée en IA, entraînement de modèles à grande échelle et inférence.

- Inconvénient : Très coûteuse et principalement adaptée aux environnements de recherche ou aux entreprises.

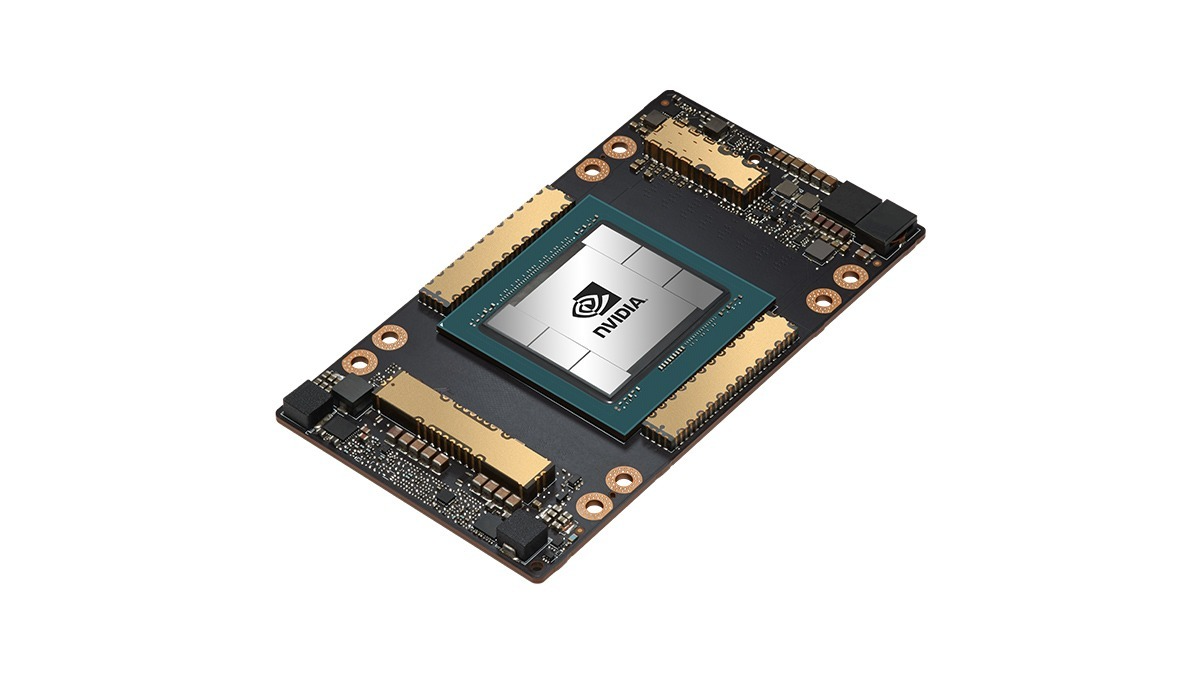

NVIDIA A100 Tensor Core GPU

La A100 offre des performances massives pour les réseaux de neurones, avec 80 GB de mémoire à haute bande passante (HBM2), adaptée aux charges de travail intensives.

- Idéal pour : Modèles de machine learning à grande échelle, recherche en IA et applications cloud.

- Inconvénient : Coûteuse, principalement destinée aux entreprises.

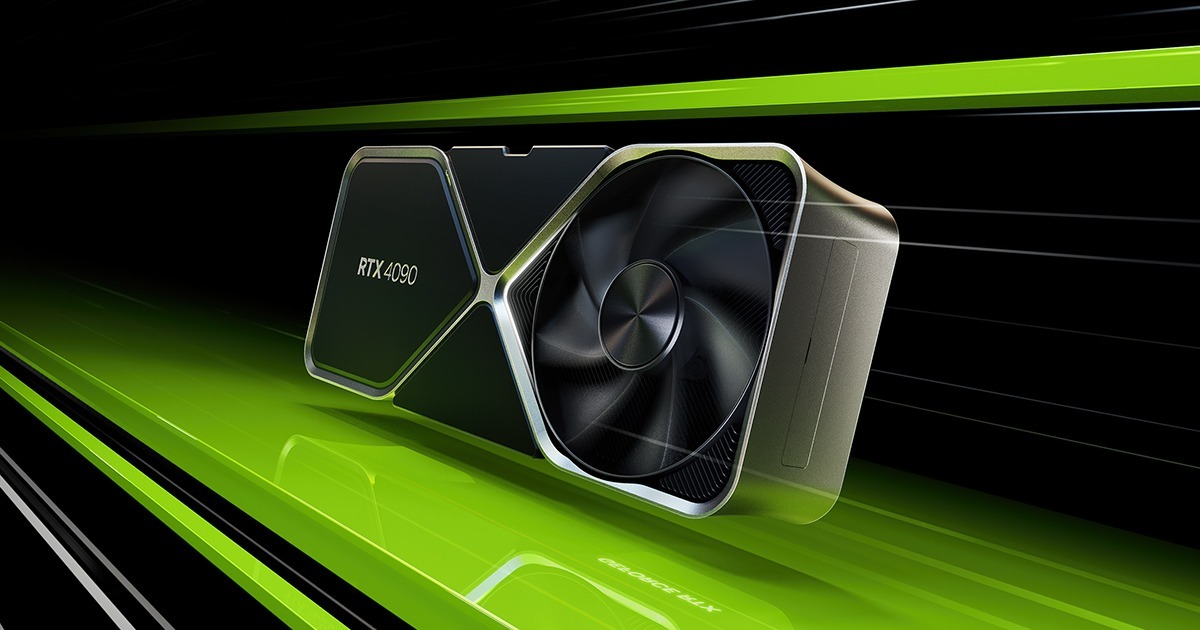

NVIDIA RTX 4090

Idéale pour le gaming comme pour les charges de travail IA, avec 24 GB de mémoire GDDR6X et une capacité de calcul parallèle élevée.

- Idéal pour : Tâches ML avancées et recherche en IA nécessitant une puissance de calcul extrême.

- Inconvénient : Consommation électrique élevée, coût important et encombrement significatif.

NVIDIA RTX A6000 GPU à cœurs tensoriels

Prend en charge les applications IA avec 48 GB de mémoire GDDR6, bien adaptée aux stations de travail et aux créateurs professionnels.

- Idéal pour : Recherche en IA, deep learning et charges de travail à haute performance.

- Inconvénient : Coût élevé, généralement adaptée aux environnements professionnels.

NVIDIA GeForce RTX 4070

Goon rapport qualité-prix avec de solides capacités de ray-tracing, 12 GB de GDDR6X

- Idéal pour : Passionnés et petites entreprises avec des besoins modérés en machine learning.

- Inconvénient : VRAM limité pour les grands ensembles de données et les très grands modèles.

NVIDIA RTX 3090 Ti

NVIDIA RTX 3090 TiGrande capacité mémoire (24 GB GDDR6X) et puissance de calcul élevée, idéale pour entraîner des modèles de taille moyenne à grande.

- Idéal pour : Passionnés et applications de recherche nécessitant une puissance de traitement AI importante.

- Inconvénient : Coût élevé, consommation énergétique importante, et souvent surdimensionné pour les petits projets.

AMD Radeon Instinct MI300

Excellente pour les charges de travail AI et HPC, avec des performances compétitives.

- Idéal pour : Charges de travail de machine learning sur des configurations centrées sur AMD.

- Inconvénient : Moins bien établie en deep learning que NVIDIA, avec moins de frameworks supportés.

Cloud GPU VPS de Cloudzy

Le RTX 4090 est sans conteste l'un des meilleurs GPU pour le machine learning disponibles aujourd'hui. Cependant, il est coûteux, fera grimper votre facture d'électricité, et son encombrement pourrait vous obliger à passer à un boîtier plus grand ou à revoir l'ensemble de votre configuration. C'est une vraie contrainte, c'est pourquoi nous proposons chez Cloudzy un GPU en ligne pour le machine learning, afin que vous n'ayez plus à vous soucier de tout cela. Notre GPU VPS est équipé de jusqu'à 2 GPU RTX 4090 Nvidia, 4 TB de stockage SSD NVMe, 25 TB par seconde de bande passante et 48 vCPU !

Le tout à des prix accessibles, avec une facturation à l'heure ou au mois selon vos besoins, ainsi qu'un large choix de modes de paiement : PayPal, Alipay, cartes de crédit (via Stripe), PerfectMoney, Bitcoin et autres cryptomonnaies.

Enfin, dans le pire des cas, si notre service ne vous convient pas, nous offrons une garantie de remboursement de 14 jours.

Les plateformes cloud de réalité augmentée (AR) reposent largement sur des GPU haute performance pour offrir des expériences immersives en temps réel. Tout comme les GPU dotés de cœurs CUDA et Tensor sont indispensables à l'entraînement de modèles de deep learning, ils sont tout aussi essentiels pour le rendu d'environnements AR complexes et pour alimenter des fonctionnalités pilotées par l'AI, comme la reconnaissance d'objets et la cartographie spatiale. Chez Cloudzy, nos AR Cloud utilisent une technologie GPU avancée pour garantir des performances optimales, une faible latence et une bonne capacité à monter en charge, ce qui en fait une solution idéale pour les entreprises souhaitant déployer des applications AR à grande échelle.

Que vous développiez des applications AI, entraîniez des modèles ou meniez des travaux de recherche, nos solutions AI VPS sont conçues pour offrir les meilleures performances GPU à une fraction du coût habituel.

Conclusion

Avec des besoins en puissance de calcul en constante augmentation et des modèles AI de plus en plus grands et complexes, les GPU feront inévitablement partie intégrante de notre quotidien. Mieux vaut donc se documenter sur leur fonctionnement et comprendre ce qu'ils sont.

C'est pourquoi je vous recommande vivement de consulter Tim Dettmers' article sur tout ce qu'il faut savoir sur les GPUs, avec des conseils pratiques pour choisir un GPU. Il est à la fois reconnu académiquement et très expérimenté en deep learning.