Если вы выбираете H100 против RTX 4090 для AI, имейте в виду: большинство «бенчмарков» не имеют значения, пока ваша модель и кэш реально не помещаются в VRAM. RTX 4090 — оптимальный выбор для работы на одном GPU, если задачи укладываются в 24 GB.

H100 нужен, когда вам требуются более крупные модели, высокая степень параллелизма, изоляция нескольких пользователей или меньше времени на жонглирование памятью.

Разберу всё по типам задач, покажу виды бенчмарков, а затем дам быстрый план тестирования, который можно запустить на вашем стеке.

Коротко: H100 vs RTX 4090 для AI-задач

H100 выигрывает при обучении крупных моделей и серьёзном инференсе: большие пулы HBM, очень высокая пропускная способность памяти, NVLink и MIG для изоляции. RTX 4090 лучше подходит тем, кому нужна отличная скорость на одном GPU по разумной цене — при условии, что рабочая нагрузка умещается в 24 GB без постоянных компромиссов. Характеристики и возможности платформы делают выбор очевидным.

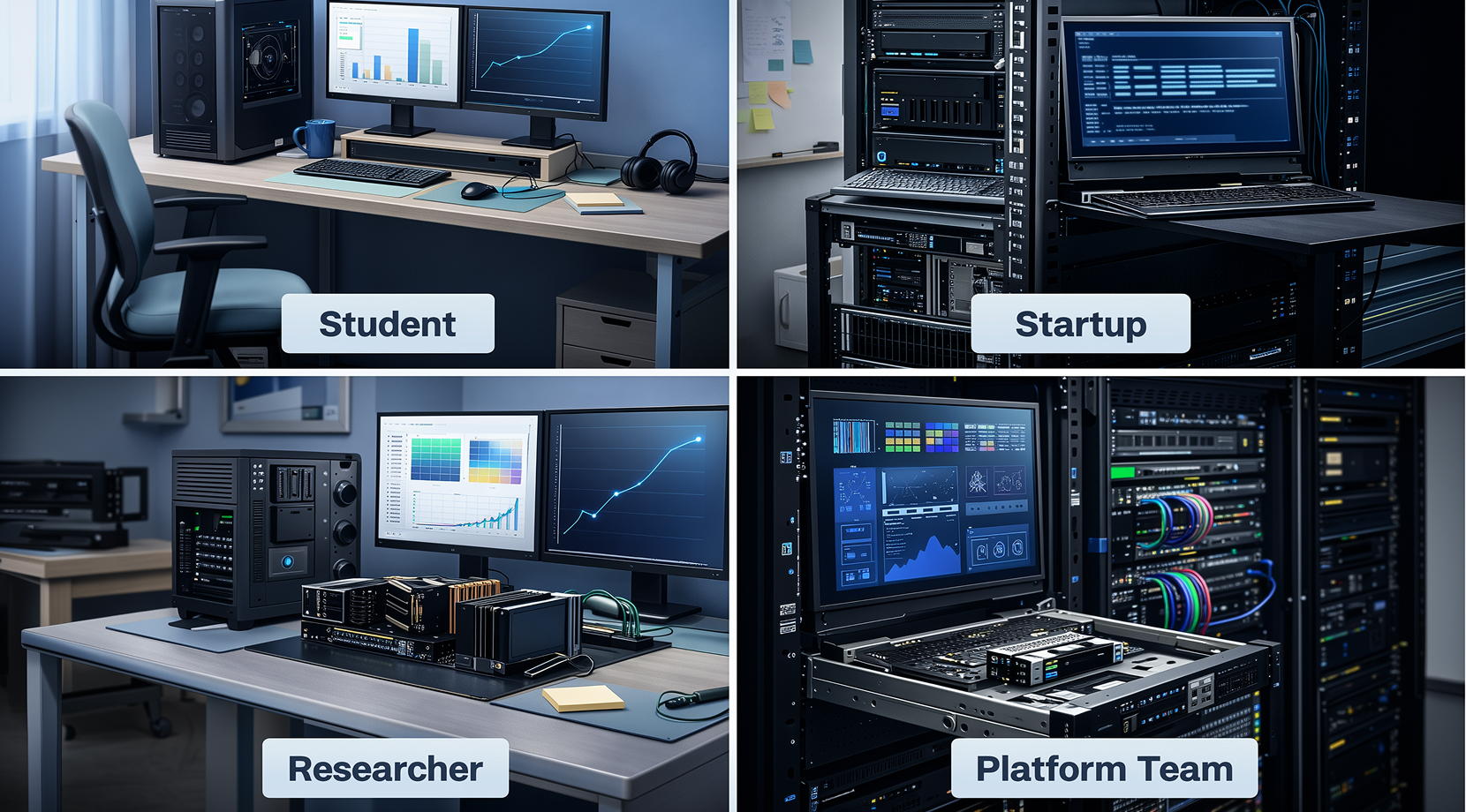

Быстрый выбор по типу пользователя:

- Локальный разработчик LLM (соло / студент): RTX 4090, пока VRAM не становится узким местом.

- ML-инженер в стартапе (запуск MVP): RTX 4090 для раннего инференса и дообучения, H100 — когда нужны стабильный параллелизм или более крупные модели.

- Прикладной исследователь (много экспериментов): H100, если вы постоянно упираетесь в OOM, ограничения батчей или длинные контексты.

- Продакшн / платформенная команда (мультитенантный инференс): H100 для MIG-слайсинга, большего запаса по ресурсам и более плавного масштабирования.

С этим пониманием остальная часть статьи посвящена ограничениям, с которыми люди сталкиваются на практике, и тому, как цифры из бенчмарков соотносятся с реальностью.

Единственный вопрос по бенчмаркам: что должно помещаться в VRAM?

Большинство дискуссий о H100 против RTX 4090 по сути сводятся к спорам о VRAM. В задачах LLM память съедается весовые коэффициенты, активации в процессе обучения, состояния оптимизатора при обучении, и Кэш KV при инференсе. Последний пункт обычно застаёт врасплох: он растёт вместе с длиной контекста и числом одновременных запросов.

Таблица ниже намеренно обобщённая — точные цифры зависят от фреймворка, точности вычислений и накладных расходов.

Взгляд с позиции «влезет без проблем?»:

| Задача | Типичная реальность одного GPU на RTX 4090 (24 GB) | Типичная реальность одного GPU на H100 (80–94 GB) |

| Инференс 7B LLM (FP16 / BF16) | Как правило, нормальное | Запас памяти достаточный |

| Инференс 13B LLM | Часто впритык, зависит от контекста | Как правило, нормальное |

| Инференс класса 70B | Требует агрессивного квантования или выгрузки | Значительно реалистичнее |

| Инференс SD/SDXL + небольшой батч | Как правило, нормальное | Нормально, плюс больший запас под батч |

| Обслуживание при высокой параллельности | Давление KV cache проявляется быстро | Больше памяти — стабильнее под нагрузкой |

Если нужен более широкий шортлист GPU (не только эти два), наш обзор Лучшие GPU для машинного обучения в 2025 году — удобная справочная таблица по VRAM и пропускной способности памяти для распространённых AI GPU.

Когда вы убедились, что задача подходит, следующее, что определяет «комфортность» работы — это пропускная способность памяти.

Пропускная способность: почему HBM ощущается иначе

Большинство разговоров о производительности в AI крутятся вокруг пиков вычислений, но трансформеры крайне чувствительны к операциям с памятью. Преимущество H100 в том, что большие пулы HBM сочетаются с очень высокой пропускной способностью памяти, а на уровне платформы добавляются NVLink и MIG-партиционирование.

Краткие характеристики

Характеристики не выберут GPU за вас, но объяснят, почему одна и та же задача на одной карте выполняется легко, а на другой — с трудом. Этот обзор показывает, что сильнее всего влияет на обучение, инференс и обслуживание запросов на LLM.

| Параметр | H100 (SXM / NVL) | RTX 4090 |

| VRAM | 80 GB / 94 GB | 24 GB |

| Пропускная способность памяти | 3,35–3,9 TB/s | GDDR6X (ограничен объёмом: 24 GB) |

| Интерконнект | NVLink + PCIe Gen5 | PCIe (потребительская платформа) |

| Мультиэкземплярность | До 7 MIG-экземпляров | Нет данных |

Источники характеристик: NVIDIA H100, NVIDIA RTX 4090.

Что это означает на практике:

- Если вы хотите увеличить размер батча или длину контекста, H100 дольше держится без вынужденных компромиссов.

- При обслуживании множества одновременных запросов у H100 больше «запаса по памяти» — хвостовые задержки нарастают медленнее.

- Если у вас преимущественно одиночные пользователи, одна модель и скромный контекст, 4090 зачастую работает быстро и без нареканий.

Пропускная способность не заменяет нормальное бенчмаркирование. Она просто объясняет, почему два GPU выглядят одинаково на узком тесте, а под реальной нагрузкой расходятся.

Достоверные бенчмарки H100 vs RTX 4090

Бенчмарки бывают разные — именно поэтому ситуация «мои цифры не совпадают с вашими» встречается постоянно. Для H100 против RTX 4090удобно разделить бенчмарки на два типа:

- Направление A (сообщество): llama.cpp-style tokens/sec tests and simple inference scripts.

- Направление B (стандартизированные наборы тестов): Результаты в стиле MLPerf Training и MLPerf Inference, ориентированные на воспроизводимые правила.

Тест на инференс в стиле Llama.cpp

Именно такие тесты запускают дома, а потом спорят о результатах три дня. Это полезно, потому что отражает реальный стек инструментов, который используют многие разработчики. Но результаты легко трактовать неверно, если не учитывать точность и совместимость модели.

Публичные сравнения в стиле llama.cpp показывают, что RTX 4090 отлично справляется с небольшими моделями и квантизированными запусками, тогда как большие модели в высокой точности упираются в потолок VRAM.

Вот чего следует ожидать:

| Модель | GPU | Типичный результат |

| Класс 7B | RTX 4090 | Высокая скорость генерации токенов, комфортный инференс для одного пользователя |

| Класс 13B | RTX 4090 | Всё ещё хорошо, но контекст и накладные расходы начинают иметь значение |

| Класс 70B | RTX 4090 | Не помещается без агрессивной квантизации или выгрузки |

| Класс 70B | H100 | Гораздо реалистичнее держать модель в памяти и обслуживать запросы стабильно |

Смысл этой таблицы не в том, что «4090 плохой» или «H100 творит чудеса». Дело в другом: потолок VRAM определяет, сколько можно держать в памяти, а это напрямую влияет на скорость, стабильность и количество ручных настроек.

Если вы постоянно урезаете длину контекста только ради того, чтобы всё не рухнуло, именно в этот момент сравнение перестаёт быть теоретическим.

Что даёт MLPerf, чего нет у форумных бенчмарков

MLPerf появился потому, что «случайные скрипты и интуиция» не работают, когда вы принимаете решение на несколько тысяч долларов. MLCommons со временем добавил новые задачи в стиле генеративного ИИ, а MLPerf создан так, чтобы результаты можно было сравнивать между разными системами.

По части обучения моделей отчёт NVIDIA по MLPerf Training v5.1 — хороший пример того, как вендоры публикуют время обучения с деталями о среде тестирования и используемых правилах бенчмарка.

Этот сценарий не покажет, как ведут себя ваши конкретные промпты, но он позволяет проверить масштабирование на уровне системы и понять, как данный класс оборудования работает в штатных условиях.

Теперь поговорим о том, что сильнее всего влияет на выбор при покупке: времени и деньгах, которые уходят на доведение работы до результата.

Стоимость, время и упущенные возможности

Многие H100 против RTX 4090 решения часто формулируют как «цена покупки против стоимости аренды». Это редко правильная постановка вопроса. Правильнее спросить: сколько часов нужно, чтобы получить модель, с которой можно реально работать, и сколько времени сгорает в борьбе с ограничениями?

Три типичных сценария наглядно показывают, где что выгоднее.

Еженедельный файн-тюнинг на небольших и средних моделях

Если ваши запуски укладываются в 24 GB без постоянных компромиссов, вариант с 4090 будет отличным выбором. Итерации идут быстро, не нужно бронировать время в кластере, и всё устроено просто. Если же каждый запуск превращается в «уменьши батч, обрежь контекст, попробуй снова», H100 — куда более разумное решение, несмотря на более высокую стоимость.

Инференс с реальной конкурентностью

Конкурентность быстро создаёт давление на KV-кеш. Именно здесь запас памяти H100 и средства управления платформой себя оправдывают, особенно если вам нужна предсказуемая задержка.

Если вы ещё не решили, подходит ли сервер GPU по форм-фактору и характеристикам для вашего развёртывания, наш GPU VPS против CPU VPS разбор поможет соотнести рабочую нагрузку с типом инфраструктуры, прежде чем тратить время на оптимизацию не того компонента.

Крупные задачи обучения с жёсткими сроками

Как только вы выходите за рамки одного человека и одной машины, в центре внимания оказываются скучные, но важные вещи: стабильные окружения, меньше точек отказа и меньше времени, которое уходит на слежку за процессами. Именно для этого и создан H100.

Если после этого раздела у вас всё ещё нет ясности, следующий шаг — не читать дальше, а посмотреть, как ваш стек ведёт себя на практике: какие проблемы возникают с драйверами и как всё работает при многопользовательской нагрузке.

Программная часть и эксплуатация: драйверы, стабильность, многопользовательский режим и поддержка

Это то, что большинство бенчмарк-таблиц обходят стороной, хотя в повседневной работе это занимает значительное место.

RTX 4090 популярен потому, что он доступен по цене и быстр для многих AI-задач. Обратная сторона: когда ваши задачи вырастают, вы начинаете упираться в ограничения по памяти и в паттерны масштабирования, не рассчитанные на shared-окружения с несколькими арендаторами.

H100 создан для кластеров. MIG — это серьёзный инструмент для платформенных команд: он позволяет разделить один GPU на изолированные срезы, что снижает проблему «шумных соседей» и существенно упрощает планирование ёмкости. Официальные спецификации NVIDIA для H100 допускают до 7 MIG-инстансов в зависимости от форм-фактора.

Если ваша нагрузка локальная и только для себя, 4090 будет отличным выбором на долгое время. Если нагрузка многопользовательская и обращена к клиентам, H100 — более надёжный путь.

Итак, кому что стоит выбирать?

Что выбрать под вашу задачу

По H100 против RTX 4090, правильный выбор — тот, который устраняет ваши главные препятствия.

Локальный разработчик на LLM (соло / студент)

Выбирайте RTX 4090, если работаете с моделями в диапазоне 7B–13B, запускаете квантизированный инференс, экспериментируете с RAG или работаете с SDXL. Переходите на более мощную конфигурацию, когда начинаете тратить больше времени на борьбу с нехваткой памяти, чем на саму задачу.

Инженер по ML в стартапе (выпускает MVP)

Если ваш MVP — это одна модель с умеренной нагрузкой и она вписывается в ресурсы, 4090 — хорошая отправная точка. Если нужна стабильная задержка при пиках, высокий параллелизм или несколько рабочих процессов на одном хосте, H100 — более предсказуемый выбор.

Прикладной исследователь (много экспериментов)

Если вы постоянно идёте на компромиссы — урезаете размер батча или жонглируете точностью вычислений — H100 даст вам более чистые эксперименты и меньше холостых прогонов.

Производственные команды / команды платформы (мультиарендное обслуживание)

H100 — очевидный выбор: MIG и больший запас ресурсов упрощают планирование мощностей и сужают зону поражения при внезапных пиках нагрузки.

Если вы пока не готовы вкладываться в железо, аренда — оптимальный следующий шаг.

Разумный компромисс: сначала арендуйте GPU, затем принимайте решение

Самый простой способ разобраться H100 против RTX 4090 работает на ваш модель, ваш запросы и ваш длину контекста на обоих классах железа, затем сравните токены/сек и хвостовую задержку под нагрузкой.

Именно поэтому мы создали Cloudzy GPU VPS, потому что поднять GPU можно меньше чем за минуту, установить нужный стек с полным root-доступом и перестать ориентироваться на чужие бенчмарки.

Вот что входит в наши тарифы GPU VPS:

- Выделенные серверы NVIDIA GPU (включая варианты класса RTX 4090 и A100) — ваши результаты не будут искажены из-за шумных соседей.

- До 40 Gbps сеть для всех тарифов GPU — это существенно при загрузке датасетов, многоузловых рабочих процессах и быстром перемещении артефактов.

- NVMe SSD хранилище, плюс DDR5 RAM и высокочастотная CPU на всех тарифах — чтобы остальные компоненты не тянули GPU вниз.

- защита DDoS и Аптайм 99,95%, чтобы длительные задачи не прерывались из-за случайных сбоев сети.

- Почасовая оплата (удобно для коротких нагрузочных тестов) и Возврат в течение 14 дней для тестирования с низким риском.

Сначала запустите тот же набор тестов на плане RTX 4090, затем повторите на плане класса A100 — когда начнёте работать с большими контекстами, высокой параллельностью или более крупными моделями. После этого выбор между H100 против RTX 4090 обычно становится очевидным из ваших собственных логов.

Чеклист для бенчмарков: проведите своё тестирование за 30 минут

Если вы хотите принять обоснованное решение, получите четыре ключевых числа на том стеке, который собираетесь запускать в продакшн:

- Токенов/сек при целевой длине контекста

- Задержка p95 при ожидаемой параллельности

- Запас VRAM в пиковой фазе нагрузки

- Стоимость одного полного запуска от старта до артефакта

Минимальный smoke-тест с vLLM выглядит так:

pip install vllm transformers accelerate

python -m vllm.entrypoints.api_server \

--model meta-llama/Llama-3-8B-Instruct \

--dtype float16 \

--max-model-len 8192Если хотите чётко понять, за что именно платите, наш материал о Что такое GPU VPS? подробно объясняет разницу между выделенным доступом к GPU, разделяемым vGPU и на что обратить внимание при выборе плана.