С ростом спроса на локальные LLM многие пользователи теряются при выборе подходящего варианта — и это неудивительно, ведь работа с ними не так проста, как кажется. Они требуют заметных ресурсов, одни больше, другие меньше, поэтому многие предпочитают держаться от них подальше. Не говоря уже о часах, которые новички могут провести, уставившись в терминал.

Тем не менее есть два заметных инструмента, которые упрощают жизнь. Ollama и LM Studio — одни из самых популярных платформ для запуска локальных LLM с высокой производительностью. Выбрать между ними непросто, поскольку каждый рассчитан на свой рабочий процесс. Давайте разберём, что стоит за противостоянием Ollama vs LM Studio.

Ollama — инструмент для технически подготовленных пользователей

Среди инструментов для запуска локальных LLM Ollama выделяется богатым набором возможностей. Он хорошо настраивается и при этом полностью бесплатен — это проект с открытым исходным кодом, поддерживаемый сообществом.

Ollama упрощает запуск локальных LLM, однако работает в первую очередь через CLI (интерфейс командной строки), поэтому базовые знания терминала всё же необходимы. CLI-подход — большой плюс для рабочих процессов разработки благодаря своей простоте. Да, освоить командную строку непросто, но это всё равно быстрее, чем запускать локальные LLM самостоятельно с нуля.

Ollama превращает ваш компьютер в локальный мини-сервер с HTTP API, предоставляя приложениям и скриптам доступ ко множеству моделей. Это значит, что он отвечает на запросы так же, как онлайн-LLM, не отправляя данные в облако. Кроме того, API позволяет интегрировать Ollama в сайты и чат-боты.

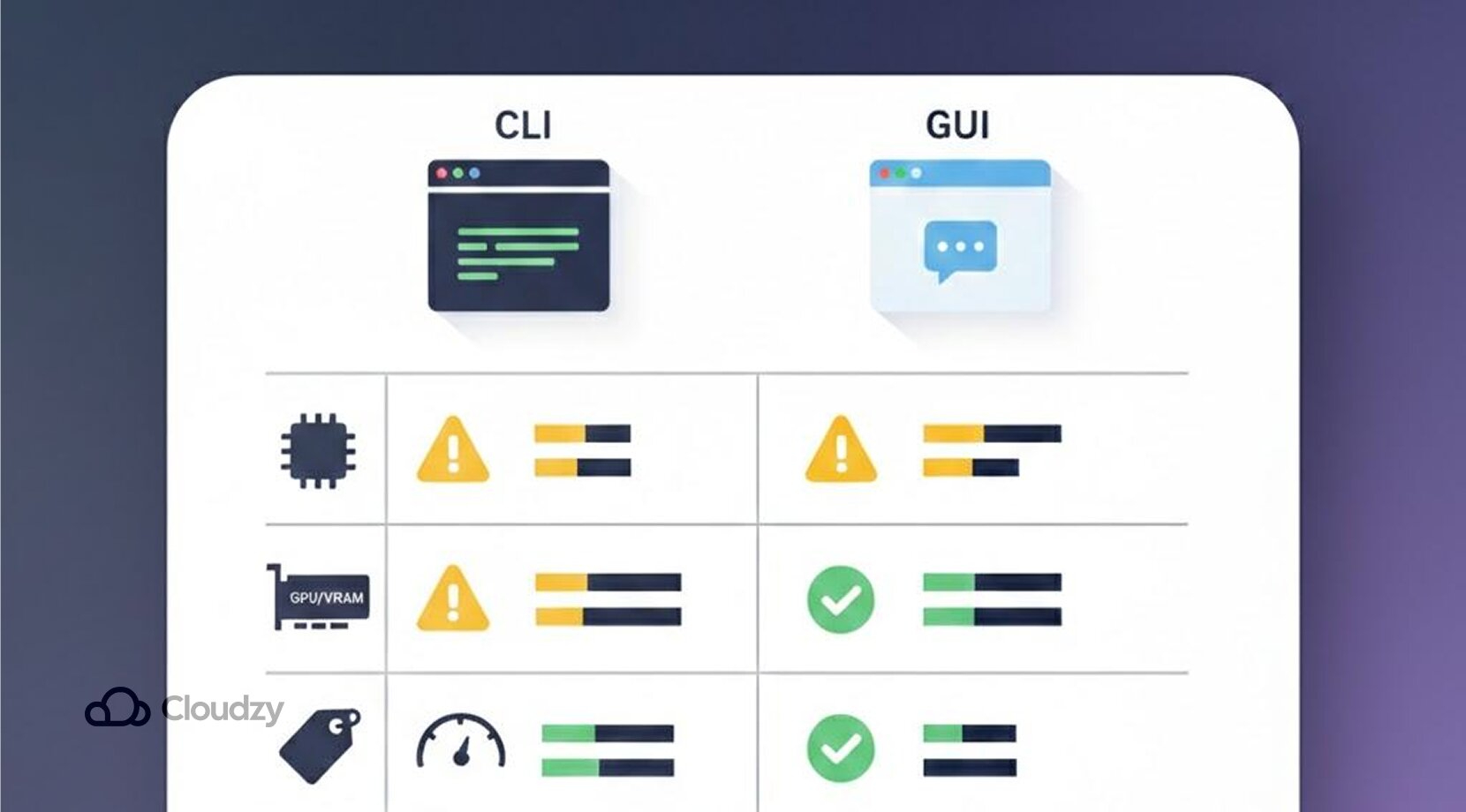

Благодаря своей CLI-природе Ollama довольно легковесен: он потребляет меньше ресурсов и сосредоточен на производительности. Это, впрочем, не означает, что его можно запустить на слабом железе, но всё же даёт определённые преимущества тем, кто хочет направить максимум ресурсов непосредственно на модель LLM.

Из всего сказанного уже ясно, что Ollama ориентирован прежде всего на рабочие процессы разработки — и это действительно так. Благодаря простой интеграции, локальной приватности и дизайну с упором на API, выбор очевиден для тех, кто мыслит как разработчик.

В споре Ollama vs LM Studio Ollama может оказаться предпочтительнее благодаря приоритету API в разработке. Если CLI-среда кажется вам чем-то чужеродным — продолжайте читать: впереди более лёгкий вариант, созданный с упором на удобство использования.

LM Studio: удобный вариант для широкой аудитории

LM Studio разительно отличается от Ollama. Вместо полноценного CLI-интерфейса он не требует никаких команд терминала и выглядит как обычное настольное приложение — благодаря графическому интерфейсу (GUI). Для многих новичков выбор между Ollama vs LM Studio сводится к простоте CLI против удобства GUI.

LM Studio последовательно устраняет технические барьеры, создавая простое пространство для любого пользователя. Вместо добавления и запуска моделей через командную строку здесь используются обычные меню и поле ввода в стиле чата. Всё выглядит настолько привычно, что LM Studio для работы с локальными LLM ощущается почти так же, как ChatGPT.

В приложении есть встроенный браузер моделей, где можно найти и загрузить любую понравившуюся модель — от лёгких для повседневных задач до тяжёлых для требовательной работы. Браузер содержит краткие описания доступных моделей и рекомендуемые сценарии использования, а загрузить любую из них можно в один клик.

Большинство моделей доступны бесплатно, хотя для некоторых могут действовать дополнительные лицензии и условия использования. Для ряда сценариев LM Studio также поддерживает режим локального сервера для удобной интеграции, однако в основе своей он ориентирован на простой настольный интерфейс для начинающих. Но, сказав всё это, давайте сравним Ollama и LM Studio напрямую.

Ключевые наблюдения: Ollama vs LM Studio

Прежде чем двигаться дальше, важно сделать одно уточнение: формулировка «Ollama vs LM Studio» может создать впечатление, что один из них объективно лучше другого, но это не так — они рассчитаны на разную аудиторию. Вот краткое сравнение Ollama и LM Studio.

| Характеристика | Ollama | LM Studio |

| Удобство использования | Менее дружелюбен к новичкам, требует базовых знаний терминала | Удобен для начинающих, всё управление через интерфейс |

| Поддержка моделей | Многие популярные модели с открытыми весами: gpt-oss, gemma 3, qwen 3 | То же, что и Ollama: gpt-oss, gemma3, qwen3 |

| Гибкость настройки | Широкие возможности настройки, легко интегрируется через API | Меньше гибкости, основные параметры регулируются переключателями и ползунками |

| Требования к железу | Зависит от модели: крупные модели работают медленнее при нехватке ресурсов | Также зависит от размера модели и вашего железа |

| Конфиденциальность | Высокий уровень приватности по умолчанию, без лишних внешних API | Переписка хранится локально; приложение всё равно обращается к серверам для обновлений и поиска или загрузки моделей. |

| Работа без интернета | Полностью поддерживает офлайн-режим после загрузки моделей | Также отлично работает офлайн после загрузки моделей |

| Доступные платформы | Linux, Windows, macOS | Linux, Windows, macOS |

- Требования к железу для продвинутых моделей: Крупные модели с более широкими возможностями привлекательны, но запускать их на большинстве ноутбуков проблематично: они требуют значительно больше RAM и VRAM. Это может выражаться в медленных ответах, ограниченном контекстном окне или отказе модели загружаться вовсе.

- Расход батареи: Локальный запуск LLMs под нагрузкой быстро разряжает аккумулятор. Это сокращает время автономной работы, а постоянный шум вентиляторов и радиатора добавляет неудобств.

Ollama vs LM Studio: загрузка моделей

Ещё одно принципиальное различие между Ollama и LM Studio — подход к загрузке моделей. Как уже упоминалось, Ollama не устанавливает локальные LLMs одним кликом. Вместо этого нужно использовать встроенный терминал и вводить команды вручную. Сами команды, впрочем, простые и понятные.

Вот быстрый способ запускать модели на Ollama.

- Загрузите нужную модель командой ollama pull gpt-oss или любую другую по вашему выбору (не забудьте указать тег — их можно найти в библиотеке).

Пример: ollama pull gpt-oss:20b - Запустить выбранную модель можно командой ollama run gpt-oss

- Можно подключить и другие инструменты. Например, Claude добавляется командой ollama launch claude

Если терминалы и команды — не ваш конёк, попробуйте LM Studio. Он не требует никаких команд: просто откройте встроенный загрузчик моделей и найдите нужные LLM по ключевым словам вроде Llama или Gemma.

Также можно вводить полные названия Hugging Face URL в строку поиска.

Есть и быстрый способ открыть вкладку обнаружения из любого места — нажмите ⌘ + 2 на Mac или Ctrl + 2 на Windows / Linux.

Ollama: преимущество в скорости

Для многих пользователей и компаний скорость стоит на первом месте. Если сравнивать Ollama и LM Studio по этому параметру, Ollama работает быстрее — хотя результат может варьироваться в зависимости от конфигурации и железа.

Один из пользователей Reddit в сабреддите r/ollamaподтвердил: Ollama обрабатывает запросы быстрее, чем LM Studio.

И это не голословное утверждение: пользователь запустил qwen2.5:1.5b по пять раз в каждом инструменте и подсчитал среднее количество токенов в секунду.

Ollama и LM Studio: производительность и требования к железу

В вопросе производительности сравнение Ollama и LM Studio сводится скорее к железу, чем к интерфейсу. Локальные LLM — это совсем другой опыт по сравнению с облачными, к которым мы привыкли. Приятно иметь LLM только для себя, пока не упрёшься в потолок производительности.

Учитывая, как сильно выросли цены на RAM и VRAM за последние годы, оснастить свою машину достаточной мощностью для запуска крупных LLM становится всё сложнее.

Популярные модели легко занимают 24–64 ГБ RAM

Именно так. Требования к железу — это не вопрос того, кто победит в противостоянии Ollama и LM Studio. Если вы хотите комфортно запускать популярные модели среднего и крупного размера без зависаний и сбоев, рассчитывайте на 24–64 ГБ RAM. Правда, даже этого объёма может не хватить при длинном контексте или тяжёлых задачах.

Квантизированные модели можно запускать и на 8–16 ГБ RAM, но ни по удобству, ни по производительности они не сравнятся с полноразмерными. К тому же придётся идти на компромисс по качеству и скорости. И RAM — не единственное узкое место: остальные компоненты тоже должны быть на уровне.

Мощный GPU — основа стабильной работы

Модели можно запускать и на CPU, но графический процессор по-прежнему играет ключевую роль. Без быстрого GPU и достаточного объёма VRAM вы получите медленную пословную генерацию, долгое ожидание при длинных ответах — и работа быстро станет невыносимой.

Не стоит обнадёживаться, потому что даже RTX 5070Ti и RTX 5080 недостаточно для серьёзного глубокого обучения. Дело в том, что для некоторых конфигураций с контекстом 60k+ сам Ollama указывает на потребность ~23 GB VRAM, что значительно превышает типичные 16 GB VRAM, которые дают такие GPU.

Going для всего, что выходит за рамки этого диапазона мощности, обходится астрономически дорого. Но даже если цена вас не останавливает, есть ещё несколько вариантов GPU для запуска локальных LLM.

К этому моменту у вас, вероятно, возник вопрос: как собрать машину, достаточно мощную для запуска крупных локальных моделей LLM? Именно здесь многие приходят к другому решению.

Один из альтернативных подходов, который рассматривают энтузиасты, - использование виртуальных машин с готовым, заранее настроенным железом. Например, VPS (виртуальный выделенный сервер) позволяет подключить домашний ноутбук или другое личное устройство к частному серверу по вашему выбору, где уже есть всё необходимое.

Если VPS кажется вам подходящим решением, мы настоятельно рекомендуем обратить внимание на Ollama ВПСот Cloudzy: чистая оболочка, Ollama уже предустановлен - можно сразу приступать к работе с локальными LLM при полной конфиденциальности. Доступная цена, 12 локаций, аптайм 99.95% и поддержка 24/7. Ресурсов в достатке: выделенные VCPU, память DDR5 и хранилище NVMe на канале до 40 Gbps.

Ollama против LM Studio: кому что подходит

Как уже было сказано, обе платформы хорошо справляются со своими задачами, и ни одну нельзя назвать универсально лучшей. Главное другое: каждая рассчитана на свой тип работы, поэтому всё зависит от ваших потребностей.

Выбирайте Ollama для автоматизации и разработки

Работая с Ollama, вы используете модель не просто для общения, а как компонент внутри другого проекта. Ollama подходит для:

- Разработчики создания продуктов - чат-ботов, копайлотов и других решений, требующих глубокого обучения

- задач с интенсивной автоматизацией, например скриптов для формирования сводок отчётов или генерации черновиков по расписанию

- команд, которым нужны единые версии моделей в любом окружении

- пользователей, которым нужен подход на основе API, чтобы другие инструменты могли регулярно обращаться к моделям

Если вам нужно, чтобы модели стабильно работали в ваших приложениях, Ollama - очевидный выбор.

LM Studio - более простой способ начать работу с локальными LLM

Если вы хотите запустить локальный AI без лишних сложностей, LM Studio — очевидный выбор.

В целом LM Studio лучше подходит для:

- Новички кто боится терминала и командной строки

- Писателей, авторов и студентов, кому нужен простой чат-интерфейс для работы с AI

- Тех, кто пробует разные варианты, чтобы быстро сравнить несколько моделей и найти подходящую

- Тех, кто только осваивает промпты и хочет менять настройки без ввода команд

Если вы хотите скачать и сразу начать работать с локальными LLMs, LM Studio справится с этим без лишних усилий.

Ollama vs LM Studio: итоговая рекомендация

Если отвлечься от споров о превосходстве Ollama над LM Studio, главное — это ваш повседневный опыт: рабочий процесс и возможности железа.

Ollama в целом:

- Гибкий, ориентированный на разработчиков

Тогда как LM Studio:

- Доступен новичкам благодаря удобному графическому интерфейсу

Обоим инструментам нужно мощное и дорогостоящее железо для комфортной работы. Далеко не у всех есть возможность держать большую локальную LLM на своей машине. Поэтому, если хотите запускать продвинутые модели без нагрузки на собственное железо, попробуйте Ollama на выделенном GPU VPS. Ниже — ответы на частые вопросы о Ollama vs LM Studio.