Hvis du er ved at beslutte H100 mod RTX 4090 til AI skal du huske på, at de fleste "benchmarks" betyder ikke meget, før din model og cache rent faktisk passer i GPU-hukommelsen. En standard GPU er det ideelle valg for single-GPU arbejde, der holder sig inden for 24 GB.

En high-end GPU er hvad du tager fat i, når du har brug for større modeller, højer concurrency, multi-user isolation, eller mindre tid brugt på hukommelsesoptimeringer.

Jeg går through efter arbejdsbyrder, viser benchmark-typer, og giver dig så en hurtig testplan, du kan køre på din egen stack.

Hurtigt svar: High-end GPU vs standard GPU til AI-arbejdsbyrder

H100 vinder ved large-model træning og seriøs serving, fordi den har store HBM-pools, meget høj hukommelsesbåndbredde, NVLink og MIG til isolation. RTX 4090 er bedre til "jeg har brug for stor single-GPU hastighed til en bedre pris", så længe din arbejdsbyrde passer ind i 24 GB uden konstante kompromiser. Specs og platformfunktioner gør dette ret enkelt.

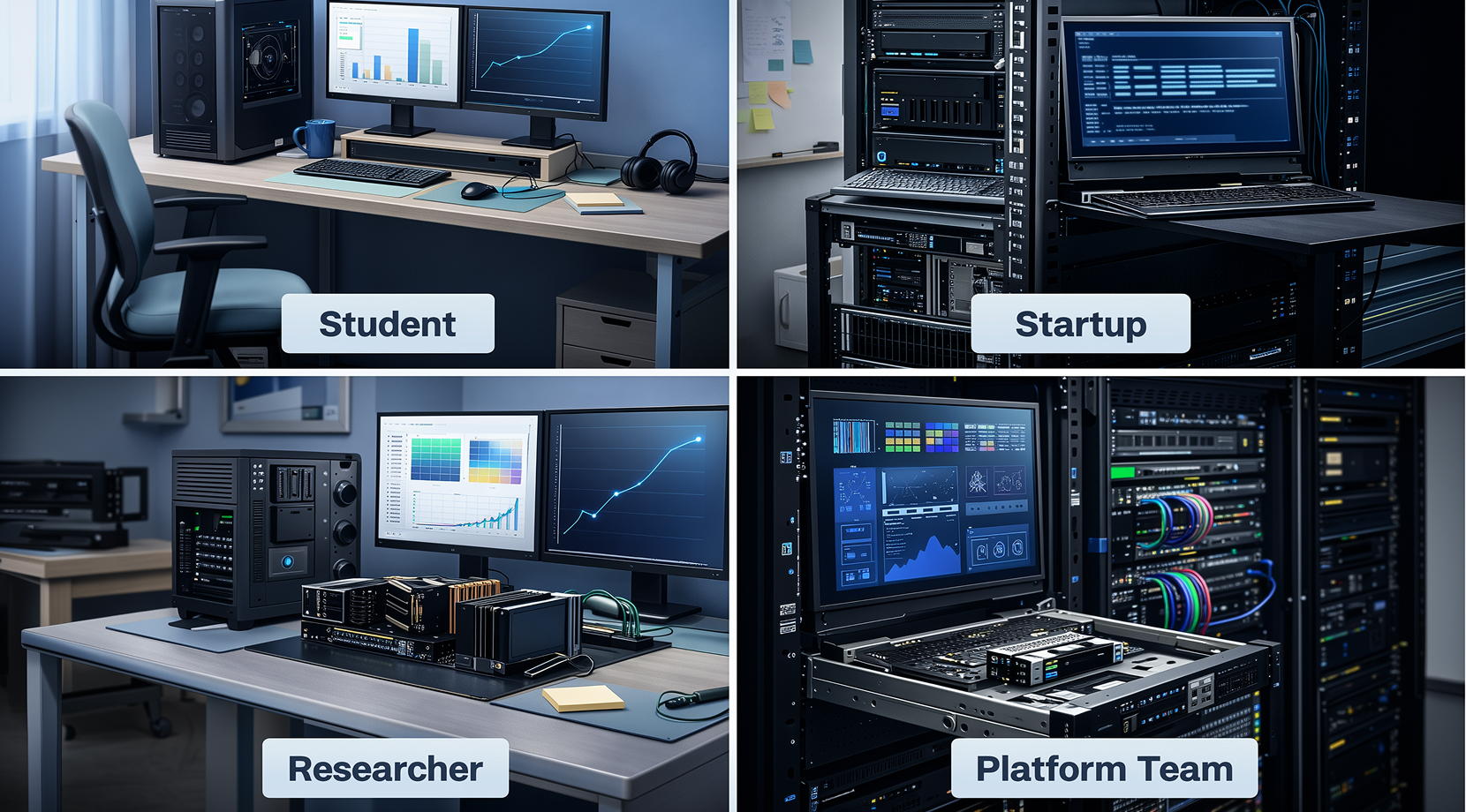

Her er det hurtige valglist efter brugerprofil:

- Lokal GPU-udvikler (solo udvikler / studerende): Standard GPU, indtil GPU-hukommelsen bliver flaskehalsen.

- Startup ML-ingeniør (shipper en MVP): Standard GPU til early-stage serving og fine-tuning, high-end GPU når du har brug for stabil concurrency eller større modeller.

- Anvendt forsker (mange eksperimenter): High-end GPU hvis du konstant rammer hukommelsesproblemer, batch-grænser eller lange kontekster.

- Produktions- / Platformhold (multi-tenant service): H100 til MIG-opdeling, større buffer og jævnere skalering.

Med den rammesat ting på plads handler resten af artiklen om de begrænsninger, som folk støder på i praksis, og hvordan benchmarkmålene stemmer overens med dem.

Det eneste benchmarkspørgsmål, du skal overveje: Hvad skal passe i VRAM?

De fleste diskussioner om H100 mod RTX 4090 handler teknisk set om VRAM-argumenter. I LLM-arbejde bliver VRAM optaget af vægte, aktiviseringer under træning, optimereringsstilstande under træning, og KV-cache under inferens. Det sidste er det, som folk ikke rigtig forventer, fordi det vokser med kontekstlængde og samtidighed.

Tabellen herunder er bevidst højtflyvende, fordi det præcise fit afhænger af framework, præcision og overhead.

Her er visningen "passer det uden drama?":

| Arbejdsbyrde | Typisk enkelt-GPU-virkelighed på RTX 4090 (24 GB) | Typisk enkelt-GPU-virkelighed på H100 (80-94 GB) |

| 7B LLM-inferens (FP16 / BF16) | Normalt fint | Komfortabel spillerum |

| 13B LLM-inferens | Ofte stramt, afhænger af kontekst | Normalt fint |

| 70B-klasse inferens | Kræver massiv kvantisering/offload | Langt mere realistisk |

| SD/SDXL-inferens + lille batch | Normalt fint | Fint, plus mere batch-buffer |

| Service med højere samtidighed | KV-cache-pres viser sig hurtigt | Mere plads, mere stabilt under belastning |

Hvis du vil have en bredere GPU-shortlist (ikke kun disse to), er vores oversigt over Bedste GPU til machine learning i 2025 en praktisk referencetabel for VRAM og hukommelsesbredde på tværs af almindelige AI GPU'er.

Når du ved, at din workload passer, er det næste, der bestemmer, hvor "glat" det føles, hukommelsesbredde.

Båndbredde: Hvorfor HBM føles anderledes

Meget af diskussionen om AI-ydelse fokuserer på beregningstoppe, men transformere er ekstremt følsomme over for hukommelsesflytning. H100's fordel er, at det kombinerer store HBM-pools med meget høj hukommelsesbredde, plus NVLink-båndbredde og MIG-partitionering på platformsiden.

Specifikationer Øjebliksbillede

Specifikationer vil ikke vælge GPU for dig, men de forklarer, hvorfor den samme arbejdsbelastning føles letgennem på ét kort og stram på det andet. Dette øjebliksbillede viser, hvad der påvirker LLM træning, inferens og serving-adfærd mest.

| Specifikation | H100 (SXM / NVL) | RTX 4090 |

| VRAM | 80 GB / 94 GB | 24 GB |

| Hukommelsesbåndbredde | 3,35–3,9 TB/s | GDDR6X (kapacitetsbegrænset ved 24 GB) |

| Forbindelse | NVLink + PCIe Gen5 | PCIe (forbrugerplatform) |

| Multi-instans | Op til 7 MIG-instanser | Ikke tilgængelig |

Specifikationer: NVIDIA H100, NVIDIA RTX 4090.

Sådan ser det ud i praksis:

- Hvis du prøver at øge batch-størrelse eller kontekstlængde, forbliver H100 stabil længere, før du bliver tvunget til at træffe afvejninger.

- Hvis du serverer mange anmodninger på samme tid, har H100 mere "memory breathing room", så du ikke får problematisk tail latency så hurtigt.

- Hvis dit arbejde primært er enkeltbrugertilstand, enkeltmodel, beskeden kontekst, føles 4090 ofte hurtigt og tilfredsstillende.

Båndbredde erstatter ikke ordentligt benchmarking. Den forklarer blot, hvorfor to GPUs kan se tæt på under en snæver test, men derefter divergerer under reelle belastninger.

Pålidelige H100 vs RTX 4090 benchmarks

Benchmarks er ikke alle ens, og det er grunden til, at "mine tal matcher ikke dine" sker konstant. For H100 mod RTX 4090, hjælper det at opdele benchmarks i to spor:

- Spor A (community-følelse): llama.cpp-style tokens/sec tests and simple inference scripts.

- Spor B (standardiserede serier): MLPerf Training og MLPerf Inference-stilresultater, der fokuserer på gentagne regler.

Llama.cpp-stilinferensøjebliksbillede

Dette er den slags test, som folk kører hjemmefra, og derefter diskuterer i tre dage. Det er brugbart, fordi det afspejler en "rigtig toolchain", som mange developers bruger, men det er også let at misfortolke, hvis du ignorerer pasform og præcision.

Offentlige llama.cpp-stilsammenligninger viser RTX 4090 performer meget godt på mindre modeller og kvantiserede kørsler, mens store modeller med højere præcision suser forbi VRAM loftet.

Her er det mønster, du bør forvente:

| Model | GPU | Typisk resultat |

| 7B-klasse | RTX 4090 | Høj tokens/sec, glat enkeltbrugerferen inferens |

| 13B-klasse | RTX 4090 | Stadig god, men kontekst og overhead begynder at påvirke |

| 70B-klasse | RTX 4090 | Passer ikke rent uden aggressiv kvantisering/offload |

| 70B-klasse | H100 | Meget mere realistisk at holde resident og serve pålideligt |

Pointen med denne tabel er ikke "4090 dårlig" eller "H100 magi". Det er, at VRAM loftet bestemmer, hvor meget du kan holde resident, og det påvirker hastighed, stabilitet og mængden af justering, du skal lave.

Hvis du konstant beskærer kontekstlængde bare for at blive ved, det er det øjeblik, denne sammenligning holder op med at være teoretisk.

Hvad MLPerf bringer, som forumsbenchmarks ikke gør

MLPerf eksisterer, fordi "tilfældige scripts og mavefornemmelser" ikke holder stik, når du skal træffe beslutninger for tusindvis af dollars. MLCommons har tilføjet moderne AI-workloads over tid, og MLPerf er designet til at gøre resultater mere sammenlignelige på tværs af systemer.

På træningssiden, NVIDIA's MLPerf Training v5.1 write-up er et godt eksempel på, hvordan leverandører rapporterer træningtid med detaljer om indsendelsesmiljøet og de benchmarkregler, de følger.

Dette felt fortæller dig ikke, hvordan dine private prompts opfører sig, men det er en grundlæggende kontrol af systemskalering og hvordan denne klasse hardware yder sig under disse betingelser.

Lad os nu snakke om det, der påvirker købet mest: tiden og pengene du bruger på at få arbejdet færdigt.

Pris, tid og alternativomkostninger

Meget H100 mod RTX 4090 beslutninger bliver ofte formuleret som "købesum versus leje." Det er sjældent det rigtige udgangspunkt. Et bedre spørgsmål er: hvor mange timer skal du bruge på at få en model, der faktisk virker, og hvor meget tid skal du spilde på at arbejde omkring begrænsninger?

Tre almindelige scenarier viser afvejningerne meget tydeligt.

Ugentlig finjustering på små og mellemstore modeller

Hvis dine kørsler holder sig under 24 GB uden konstante kompromiser, føles RTX 4090-løsningen rigtig godt. Du itererer hurtigt, du behøver ikke planlægge klyngetid, og dit setup er enkelt. Hvis hver kørsel bliver til "reduce batch size, cut context, retry", er H100 en meget mere fornuftig idé, selvom prisen er højere.

Ægte samtidighed, altid klar

Høj samtidighed presser KV-cachen hurtigt. Det er her H100's kapacitet og platformens kontrolmuligheder gør en forskel – især hvis du skal have forudsigelig latenstid.

Hvis du stadig er usikker på, om en GPU server passer til dit deployment, kan vores GPU VPS vs CPU VPS en opgørelsessmethod giver dig overblik over workload og infrastruktur, så du undgår at bruge tid på at optimere det forkerte.

Større Træningsjob Med Deadline

Når du først skalerer ud over en enkelt person og en enkelt server, er det de kedelige ting, du gerne vil fokusere på - stabile miljøer, færre fejltilstande og mindre tid brugt på det, der grundlæggende er babypasseri. Det er præcis det, H100 er designet til.

Hvis du stadig er usikker efter dette afsnit, er næste skridt ikke mere læsning. Det er at se, hvordan din stack fungerer i praksis, herunder driverfriktion og fler-bruger-arbejdsbelastninger.

Software og drift: drivere, stabilitet, multi-bruger og support

Det er den del, som de fleste benchmarks springer over, men det er en stor del af hverdagen.

RTX 4090 er populært, fordi det er tilgængeligt og hurtigt til mange AI-workflows. Prisen er, at når dit use case vokser, er det mere sandsynligt, at du løber ind i begrænsninger omkring hukommelseslofter og skaleringsmønstre, der ikke er designet til delte, multi-tenant-miljøer.

H100 er bygget til klynger. MIG er en stor fordel for platformteams, fordi det giver dig mulighed for at opdele én GPU i isolerede segmenter, hvilket mindsker problemer med støjende naboer og gør kapacitetsplanlægning betydeligt lettere. NVIDIAs officielle H100-specifikationer angiver op til 7 MIG-instanser afhængigt af formfaktoren.

Hvis din opgave er personlig og lokal, kan du sagtens klare dig længe med 4090'eren. Hvis din opgave skal håndtere mange brugere og kunder, er H100 det mere sikre valg.

Så hvad skal man vælge?

Hvilken skal du vælge til dit arbejdsbehov

Til H100 mod RTX 4090, det rigtige valg er i sidste ende det, som fjerner dine største forhindringer.

Lokalt LLM-miljø (Solo-udvikler / studerende)

Vælg RTX 4090 hvis du primært arbejder i 7B-13B-området, kører kvantiseret inferens, eksperimenterer med RAG, eller arbejder på SDXL. Upgrade når du bruger mere tid på at arbejde omkring hukommelse end på at bygge det, du gerne vil bygge.

Startup ML Engineer (Launching an MVP)

Hvis din MVP er en enkelt model med moderat trafik og den passer fint, er RTX 4090 et solidt udgangspunkt. Hvis du skal have stabil latency under trafiktop, højere concurrency eller flere arbejdsbelastninger pr. host, er H100 det mere rolige valg.

Forsker (Mange eksperimenter)

Hvis du ofte må gå på kompromis med at reducere batch-størrelse eller justere præcision, giver H100 dig renere eksperimenter og færre ødelagte kørsler.

Production / Platform Team (Delt hosting til flere kunder)

H100 er det oplagte valg, primært fordi MIG og større buffer gør kapacitetsplanlægning enklere og reducerer påvirkningen, når belastningen stiger.

Hvis du ikke er klar til at investere i hardware, er leje det bedste alternativ.

En praktisk mellemvej: Lej GPUs først, derefter forpligt dig

Den reneste måde at få styr på det H100 mod RTX 4090 er at køre din model, din prompts og din kontekstlængde på begge hardwareklasser, og sammenlign derefter tokens/sekund og slutresponstid under belastning.

Det er præcis derfor, vi byggede Cloudzy GPU VPS, da du kan få en GPU box på under et minut, installere din stack med fuld root-adgang og stoppe med at gætte baseret på andres benchmarks.

Sådan ser det ud på vores GPU VPS planer:

- Dedikerede NVIDIA GPUs (herunder RTX 4090 og A100-class muligheder) så dine resultater ikke påvirkes af støj fra naboservere.

- Op til 40 Gbps netværk på alle GPU-planer, hvilket betyder meget for dataudtræk, multi-node-workflows og hurtig flytning af artifacts.

- NVMe SSD lagring, plus DDR5 RAM og høj-frekvens CPU-muligheder på alle niveauer, så resten af systemet ikke bremser GPU.

- DDoS-beskyttelse og en 99,95% oppetid, så længere jobs ikke bliver ødelagt af tilfældig internetstøj.

- Timebetaling (praktisk til korte benchmark-seancer) og et 14-dages pengene-tilbage-garanti til lav-risiko-test.

Kør samme benchmark-checklist på en RTX 4090-plan først, gentag derefter på en A100-klasse plan når du arbejder med større kontekster, højere samtidighed eller større modeller. Herefter bliver valget mellem H100 mod RTX 4090 normalt klart ud fra dine egne logs.

Benchmark-checklist: Lav din egen på 30 minutter

Hvis du vil have en beslutning du kan forsvare, så grib fire tal fra den præcis stack du planlægger at bruge:

- Tokens/sek ved din målkontekstlængde

- p95-latens ved din forventede samtidighed

- VRAM-buffer under den varmeste fase

- Omkostning per færdiggjort kørsel fra start til artifact

Et minimalt smoke test med vLLM ser sådan ud:

pip install vllm transformers accelerate

python -m vllm.entrypoints.api_server \

--model meta-llama/Llama-3-8B-Instruct \

--dtype float16 \

--max-model-len 8192Hvis du gerne vil have en klar idé om hvad du egentlig lejer, så tjek vores indlæg om Hvad er en GPU VPS? som forklarer forskellen mellem dedikeret GPU-adgang, vGPU-deling, og hvad du skal checke før du vælger en plan.