Hvis din plan er at købe et nyt GPU for at undgå out-of-memory fejl, er diskussionen 5070 Ti mod 5080 off-topic. Begge kort har 16 GB VRAM, og den kapacitetsbegrænsning dukker op i deep learning hurtigere end de fleste forventer.

5080 er hurtigere, men den lader dig sjældent køre en meningsfuldt større model. I praksis ender du stadig med at reducere batch-størrelse, skære i kontekstlængde eller aflaste til system RAM bare for at holde kørsler i gang.

Derfor er dette stykke et ægte, realistisk blik på 5070 Ti mod 5080 til deep learning, plus en række muligheder der passer, hvis dit mål er at træne, fine-tune eller serve modeller uden konstante VRAM begrænsninger.

Hvis du ikke læser andet, læs spec-sektionen og "kapacitet mod hastighed"-sektionen; de er de to der holder dig fra at købe det forkerte.

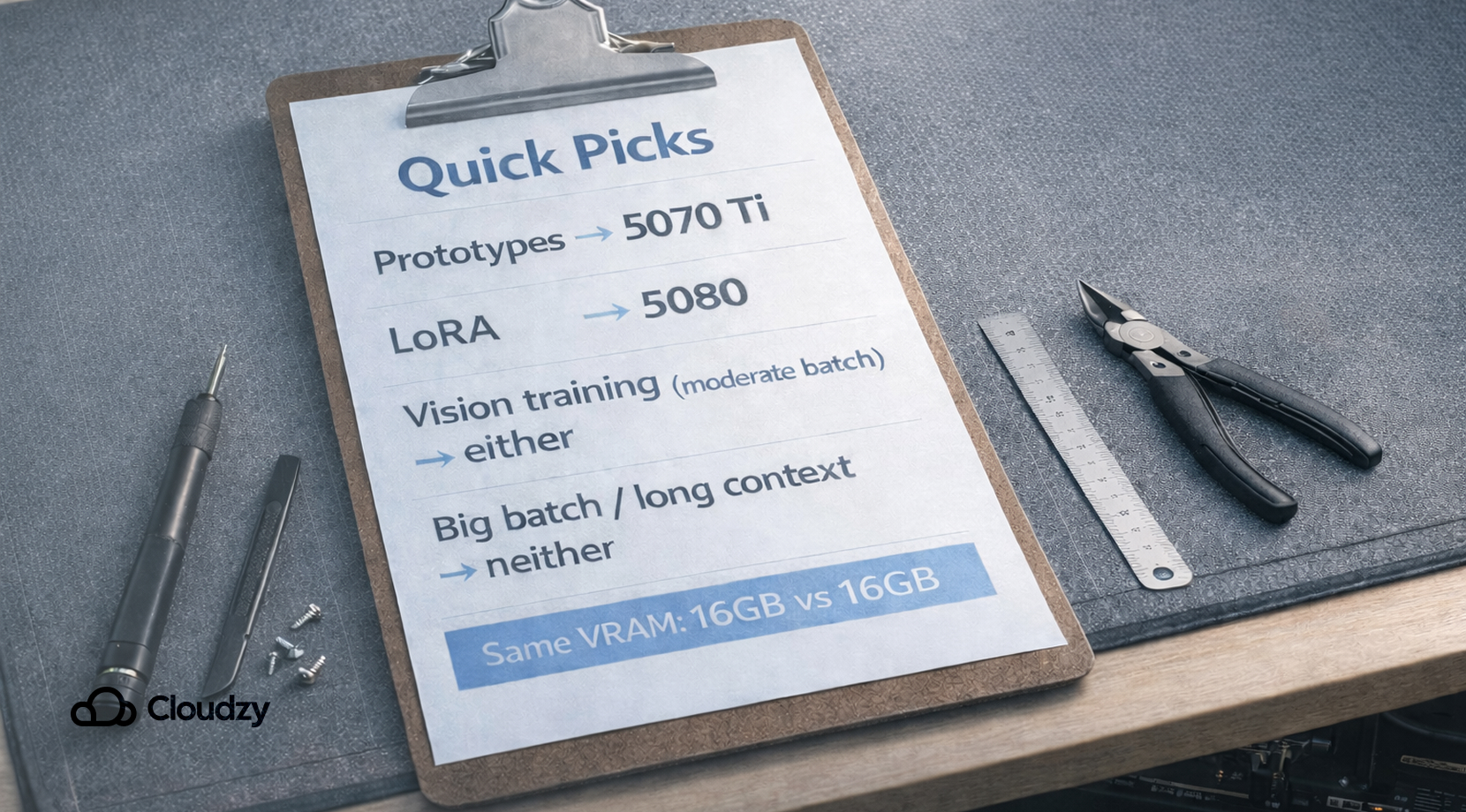

Hurtige valg baseret på hvad du laver

De fleste køber ikke GPUs på må og få. Vi ser fire almindelige køberindsatser dukke op igen og igen, og 5070 Ti mod 5080 lander forskelligt for hver enkelt.

Den lokale LLM-eksperimentalist

Du kører notebooks, skifter kvantiseringsindstillinger og bekymrer dig mere om "det kører" end perfekt gennemstrømning. For dig er 5070 Ti mod 5080 normalt afgjort af budget, fordi begge kort føles fine på små modeller og kvantiseret inferens, så rammer begge samme VRAM loft når du presser kontekstlængde eller batch-størrelse.

Ph.d.-studerende der træner vision-modeller

Du vil have gentagne eksperimenter, ikke endeløse forsøg. Den skjulte pris er ikke kortet selv; det er den tid du mister når kørsler fejler ved epoch 3 fordi dataloaderen, augmenteringer og modellen alle konkurrerer om hukommelse.

Startup-ingeniøren der deployer inferens

Du bekymrer dig om tail latency og concurrency. En enkeltbrugerdemo kan se fantastisk ud på 16 GB, så kommer produktionstrafik, og KV cache-pres tærer på din VRAM som et langsomt leak. Til serving kan 5070 Ti mod 5080 være en distraktione hvis dit virkelige problem er kapacitet til batching og lange prompts.

Skaberen som også laver ML

Du hopper mellem kreative apps og ML-værktøjer, og du hader genstarter, driver-hovedpine og "luk Chrome for at træne". For dig giver 5070 Ti mod 5080 kun mening hvis GPU er en del af et rent arbejdsflow, ikke en skrøbelig arbejdsstation der bryder sammen øjeblikket du multitasker.

Med disse tilfælde in mente, lad os blive konkrete om hardwaren og hvorfor den begrænsende faktor er den samme på de steder der betyder noget.

Højtprioriterede specs til deep learning

Den hurtigste måde at forstå 5070 Ti mod 5080 på er at ignorere marketingtallene og fokusere på hukommelseslinjen.

Hvis du vil have det fulde spec sheet-synspunkt, her er en detaljeret tabel der fokuserer på hvad der påvirker trænings- og inferenceatfærd mest. (Klokfrekvenser og displayudgange er øjnefaldende, men de bestemmer ikke om din kørsel passer.)

| Specifikationer (Desktop) | RTX 5070 Ti | RTX 5080 | Hvorfor det vises i DL |

| VRAM | 16 GB | 16 GB | Kapacitet er den hårde mur for vægte, aktiveringar og KV cache |

| Hukommelsestype | GDDR7 | GDDR7 | Lignende opførsel, båndbredde hjælper, men kapacitet bestemmer "passer eller ej" |

| Hukommelsebus | 256-bit | 256-bit | Begrænser aggregeret båndbredde; hjælper gennemstrømning, ikke modelstørrelse |

| CUDA-kerner | 8,960 | 10,752 | Mere beregningskraft hjælper tokens/sek, ikke "kan jeg indlæse det" |

| Typisk korteffekt | 300 W | 360 W | Mere varme og strømforsyningsplads, ingen ekstra VRAM |

Officielle kilder til specs: RTX 5080, RTX 5070-familien

Kort sagt er 5080 det hurtigere kort, 5070 Ti er det billigere. I deep learning bliver forskellen først tydelig, når din workload allerede fylder hele kortet.

Dernæst skal vi se på, hvorfor VRAM forsvinder så hurtigt, selv på setups der på papiret ser lette ud.

Hvorfor VRAM bliver opbrugt så hurtigt i Deep Learning

Folk der kommer fra gaming tror ofte at VRAM fungerer som en tekstur-buffer. I deep learning er det mere som et tynget køkkenbord. Du skal ikke bare have plads til ingredienserne, du skal have plads til at hakke, koge og anrette alt på samme tid.

Her er hvad der typisk bruger plads på VRAM under en kørsel:

- Modelgewichte: de parametre du loader, nogle gange i FP16/BF16, nogle gange komprimeret.

- Aktiviseringer: mellemliggende tensorer gemt til backprop, som regel den store hukommelsessluger under træning.

- Gradienter og optimizer-tilstand: trænings-overhead som kan fordoble hukommelsekravet.

- KV-cache: inferens-overhead som vokser med kontekstlængde og antal samtidige forespørgsler.

Derfor føles 5070 Ti mod 5080 som at diskutere motoreffekt når du trækker en trailer der er for tung. Du kan have mere kraft, men tilkoblingen er stadig flaskehalsen.

En hurtig metode vi bruger selv til at tjekke det er at logge både allokeret og reserveret hukommelse i PyTorch. PyTorch's CUDA hukommelses-noter forklarer cache-allokatoren og hvorfor hukommelse kan se 'brugt' ud i værktøjer som nvidia-smi selv efter tensorer er frigivet.

Det bringer os til hovedpunktet i denne diskussion: at de fleste deep learning-fejl på 16 GB ikke sker fordi det er langsomt, men fordi du får OOM på det værst mulige tidspunkt.

De Første Workloads Der Brækker 5070 Ti mod 5080

Nedenfor er de deep learning-mønstre som typisk rammer hukommelseslimitter først på 5070 Ti mod 5080.

LLM Serving med Lange Prompts og Reel Concurrency

En enkelt prompt med 2K tokens kan se fine ud. Tilføj længere kontekst, tilføj batching, tilføj en anden bruger, og KV cache begynder at stige. Så kollapserer 5070 Ti mod 5080 til samme resultat, hvor du enten må begrænse max kontekst eller reducere batch-størrelse for at overleve.

En simpel tjek-metode:

- Kør din server med din virkelige max kontekst og batch.

- Overvåg VRAM over tid, ikke bare ved opstart.

- Noter det punkt hvor latency springer op, og check så hukommelse på samme tidspunkt.

Hvis du vil have et pålideligt monitorings-setup som ikke bliver et projekt i sig selv, dækker vores guide om GPU monitoring-software praktiske CLI logging-mønstre som virker godt på virkelige kørsler.

LoRA eller QLoRA Fine-Tuning

Mange siger, at "LoRA fungerer på 16 GB", og de har ikke uret. Fælden er at antage, at resten af dit pipeline er gratis. Tokenization buffers, dataloader workers, mixed precision scaling og validationstrin kan opstakle sig meget hurtigt.

I praksis er flaskehals her ikke beregning, men margin. Uden ekstra VRAM ender du med at passe på dine træningskørsler.

Vision Training med højtopløselige input

Image models har en skjult fejltilstand, hvor en lille stigning i opløsning eller en ekstra augmentation kan få dig fra stabil til OOM. På 5070 Ti mod 5080 viser det sig som batch size, der kollapser til 1, og derefter gradient accumulation, der gør dit training til en slow-motion loop.

Multimodal kørsler på en GPU

Text encoder plus image encoder plus fusion layers kan være fint, men hvis du øger sequence length eller tilføjer et større vision backbone, er memory stacking brutal.

"Min GPU er fin, min desktop er ikke"

Dette er det mest relatbare. Du starter træningen, så griber din browser, IDE og andet du kører VRAM, og pludselig er din "stabile" config brudt. Folk på fora klager over at lukke alt, deaktivere overlays og stadig ramme OOM på samme model, de kørte i går.

Dette mønster dukker konstant op i 5070 Ti mod 5080 diskussioner, også fordi begge kort sidder ved samme capacity limit. Hvis disse lyder velkendt, er næste spørgsmål "hvad gør vi ved grænsen?"

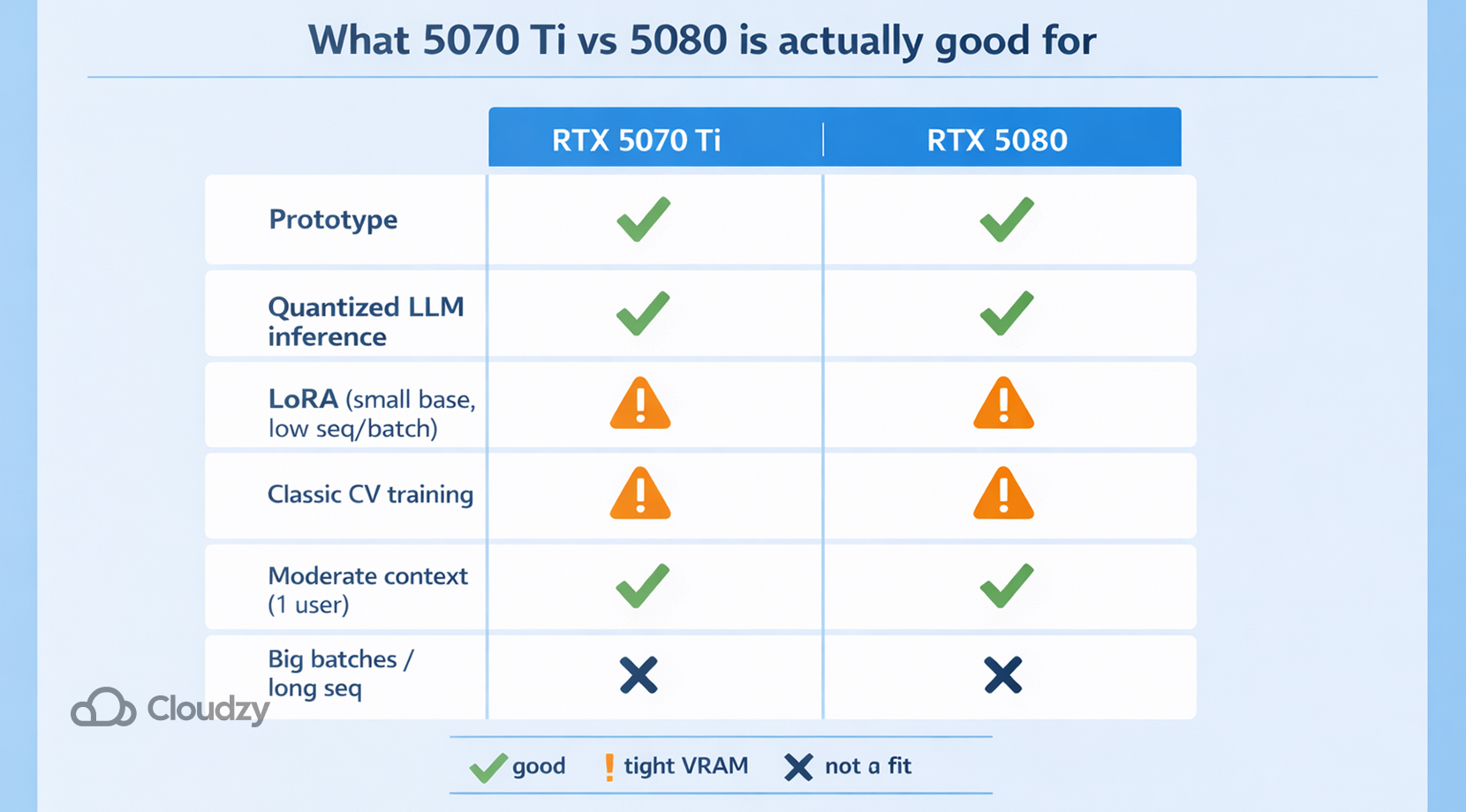

Hvad 5070 Ti mod 5080 er Actually Good for

Det er let at hakke på 16 GB i ML-kredse, men det er ikke ubrugeligt. Det er bare snævert.

5070 Ti mod 5080 kan være et helt fint setup til:

- Prototypeudvikling: små eksperimenter, hurtige ablationer og sanity checks.

- Quantized LLM inferens: mindre modeller med moderat kontekst, enkelt bruger.

- LoRA på mindre base modeller: så længe du holder sequence length og batch under kontrol.

- Klassisk vision training: moderate billedstørrelser, moderate backbones, mere tålmodighed.

Pointen er, at hvis dit arbejde holder sig inden for memory limit, vil 5080 normalt føles mere responsiv end 5070 Ti, og du vil nyde den ekstra compute.

Men øjeblikket du prøver at lave "seriøs" deep learning, rammes du af memory headroom problemer. Så lad os tale om taktikker, der hjælper på begge kort.

Sådan Udvider Du Begrænset VRAM Uden at Gøre Træningen til Mareridt

Ingen af disse tricks er magi. Det er bare de bevægelser, der får 5070 Ti vs 5080 til at være brugbare længere.

Start med Måling

Før du ændrer hyperparametre, få et peak VRAM-tal pr. step. I PyTorch, max_memory_allocated() og max_memory_reserved() er hurtige måder at se hvad dit run rent faktisk gør.

Det hjælper dig med at besvare spørgsmål som:

- Er selve modellen hovedomkostningen, eller er det aktiveringer?

- Stiger VRAM under validering?

- Vokser fragmentering over tid?

Når du har et baseline, bliver resten mindre tilfældig.

Reducer Hukommelse Hvor Det Er Muligt

En simpel "rækkefølge af operationer", som vi bruger:

- Reducer batch-størrelse, til det passer.

- Tilføj gradient-akkumulering for at få tilbage din effektive batch.

- Slå blandet præcision til (BF16/FP16), hvis din stack understøtter det.

- Tilføj gradient checkpointing, hvis aktiveringer dominerer.

- Først derefter skal du begynde at ændre modelstørrelse.

Behandl Kontekstlængde Som et Budget

For transformers er kontekstlængde det, der vil forårsage mest bøvl. Det påvirker attention-beregning og, for inferens, KV cache-størrelse. På 5070 Ti vs 5080 mærker du det det samme øjeblik, du går over nogle tusinde tokens, fordi VRAM stiger hurtigt, throughput falder, og pludselig reducerer du batch-størrelsen bare for at blive oppe.

En anbefalet tilgang:

- Vælg en standard maksimal kontekst, som du kan køre med margin.

- Opret en anden profil for "lang kontekst", lavere batch.

- Bland ikke de to mens du fejlfinder.

Forveksle Ikke PyTorch Cache med Rigtige Hukommelsesbrist

Mange "hukommelseshuller" er egentlig allocator-adfærd. PyTorch's dokumentation nævner, at caching-allocatoren kan beholde hukommelse reserveret selv efter tensors er frigivet, og empty_cache() frigiver for det meste ubrugte cachede blokke tilbage til andre apps, ikke tilbage til PyTorch selv.

Det vigtige her er, at brugere af 5070 Ti versus 5080 ofte bliver distraheret af fantastiske læk i stedet for de rigtige kilder til hukommelseslækage: batch-størrelse, sekvens-længde og aktiveringshukommelse.

Disse justeringer gør deres hukommelsesgræns brugbar, men ændrer ikke på grundlæggende virkelighed. Hvis dit projekt kræver større modeller, længere kontekster eller højere samtidighed, har du brug for mere VRAM.

Har jeg Brug for Kapacitet eller Hastighed Mellem 5070 Ti versus 5080

Du kan se det sådan: hastighed er hvor hurtigt du kan køre, og kapacitet er hvor mange passagerer du kan tage med. Deep learning har brug for begge dele, men kapacitet afgør, om du overhovedet kan komme ud af parkeringspladsen.

5080 kan levere højere gennemstrømning end 5070 Ti i mange arbejdsbelastninger. Men 5070 Ti versus 5080 ændrer ikke på "kan jeg loade det og køre det", fordi begge rammer deres grænser.

Derfor bliver folk skuffet efter en opgradering. De føler hastighedsforbedringen i små test, derefter prøver de deres rigtige arbejdsbelastning og rammer samme væg. Væggen dukker bare op 30 sekunder senere.

Så hvis du handler med deep learning i tankerne, hjælper det at bestemme hvilken gruppe du tilhører:

- Hastighedsbegrænset: du passer allerede, du ønsker bare hurtigere trin.

- Kapacitetsbegrænset: du passer ikke helt, og du bruger tid på at krympe problemet.

De fleste personer, der undersøger 5070 Ti versus 5080 til deep learning, er i anden gruppe, selvom de måske ikke er klar over det endnu.

Lad os nu tale om den løsning, der normalt sparer mest tid: at aflaste det "store arbejde" til en større GPU, uden at omstrukturere hele dit setup omkring en ny lokal maskine.

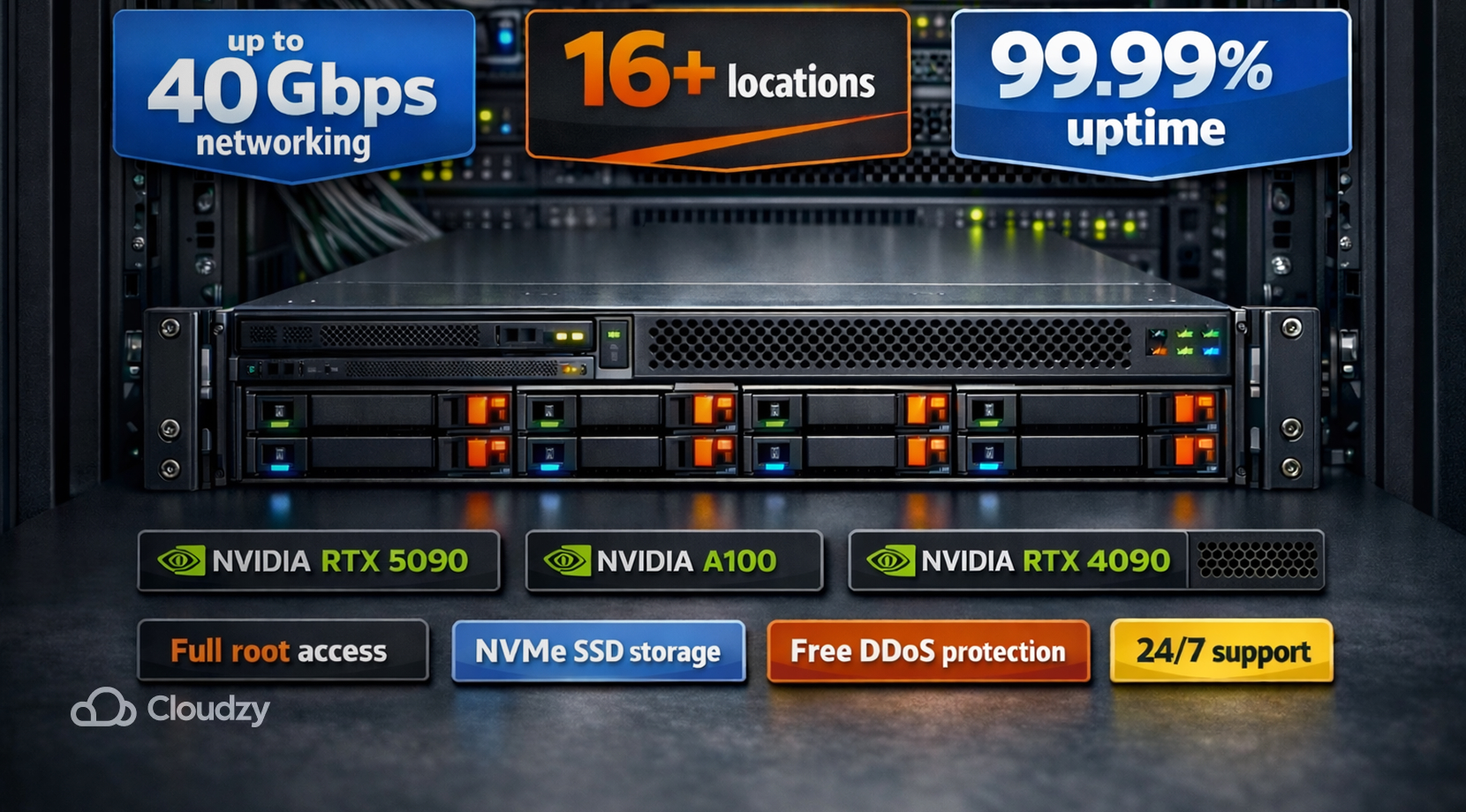

En Overkommelig Løsning: Brug en GPU VPS til Tunge Job

I vores infrastruktur-team ser vi, at det mest almindelige mønster er, at folk prototyper lokalt, og så rammer de et punkt hvor 5070 Ti versus 5080 ikke betyder noget mere, fordi arbejdet simpelthen ikke passer.

Det er øjeblikket, hvor du ønsker adgang til en større VRAM-pulje til træning og realistiske serving-test. Det er præcis hvor Cloudzy GPU VPS er en god match.

Vores GPU VPS-planer inkluderer NVIDIA-muligheder såsom RTX 5090, A100 og RTX 4090, plus fuld root-adgang, NVMe SSD-lager, op til 40 Gbps netværk, 12 lokationer, gratis DDoS-beskyttelse, 24/7-support og et 99,95% oppetidsmål.

Men hvordan hjælper det dig, enten 5070 Ti versus 5080, eller enhver anden GPU på samme niveau? Ja:

- Du kan køre din rigtige model og prompt-profil på hardware med mere VRAM, så beslutningerne bliver åbenlyse fra dine egne logs.

- Du kan beholde din lokale GPU til udvikling og hurtige test, derefter leje "det store kort" kun til de tunge job.

Hvis du vil have en hurtig genopfriskning på hvad en GPU VPS faktisk er, og hvad dedikeret GPU versus delt adgang betyder, forklarer vores begyndervejledning det i klart sprog.

Og hvis du stadig ikke er sikker på, om du har brug for en GPU overhovedet til din arbejdsbelastning, har vi GPU versus CPU VPS En sammenligning giver dig et klart billede af, hvad rigtige opgaver som træning, inferens, databaser og webapps kræver af hardware.

Når infrastrukturen er på plads, handler det sidste stykke om at vælge et arbejdsflow, der ikke spiller tid bort.

Et simpelt arbejdsflow til at finde ud af, hvad du har brug for

Mange ML-udvikler står i et falsk valg mellem at købe det større forbrugerkort eller lide under det. I praksis kan 5070 Ti mod 5080 stadig være del af et fornuftigt arbejdsflow, hvis du bruger det som dit lokale udviklerværktøj, ikke som din hele produktionsstak.

Her er et arbejdsflow, som vi har set fungere godt:

- Brug dit 16 GB GPU til kode, debugging og små eksperimenter.

- Hold en "stort GPU"-miljøskabelon klar til fjerne kørsler.

- Flyt trænings- og servingstests, der har brug for mere plads, til en GPU VPS.

- Overvåg kørsler og gem logs, så resultater kan gentages.

Hvis du gerne vil have et dybere blik på at vælge den rigtige klasse GPU til ML-arbejde generelt, er vores oversigt over bedste GPUs til maskinlæring et brugbart næste skridt.

Så i sidste ende er 5070 Ti mod 5080 et lokalt beregningsvalg, men deep learning-skalering er et infrastrukturvalg. Når vi taler om skalering, hvis du er nysgerrig på, hvordan en større kortklasse ændrer rigtig AI-adfærd, er vores H100 vs RTX 4090 benchmark-sammenligning analyse et brugbart sammenligningsgrundlag, fordi det hele tiden vender tilbage til samme tema med VRAM-tilpasning først, derefter hastighed.