Si vous hésitez entre H100 contre RTX 4090 pour l'AI, gardez à l'esprit que la plupart des « benchmarks » n'ont aucune importance tant que votre modèle et votre cache ne tiennent pas réellement en VRAM. RTX 4090 est le choix idéal pour le travail sur un seul GPU qui reste sous les 24 GB.

H100 s'impose dès que vous avez besoin de modèles plus grands, d'une concurrence plus élevée, d'une isolation multi-utilisateurs, ou que vous voulez arrêter de jongler avec la mémoire.

Je vais décomposer ça par type de charge de travail, présenter les catégories de benchmarks, puis vous donner un plan de test rapide que vous pouvez lancer sur votre propre stack.

Réponse rapide : H100 vs RTX 4090 pour les charges de travail AI

H100 l'emporte pour l'entraînement de grands modèles et la mise en production intensive : il offre de grands pools HBM, une bande passante mémoire très élevée, NVLink et MIG pour l'isolation. RTX 4090 est le meilleur choix quand vous voulez une vitesse élevée sur un seul GPU à un meilleur prix, à condition que votre charge de travail tienne dans 24 GB sans compromis constants. Les specs et les fonctionnalités de la plateforme rendent ce choix assez clair.

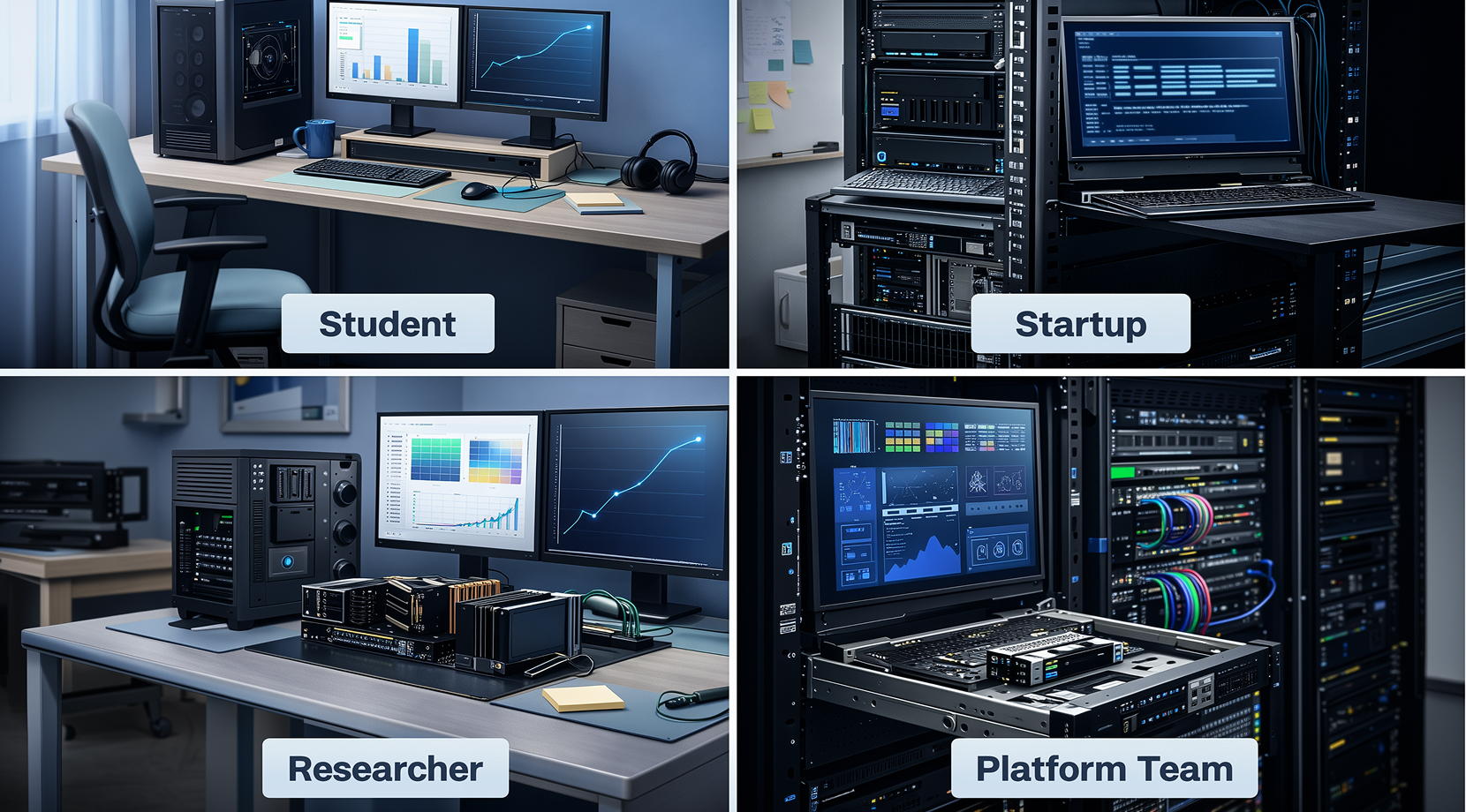

Voici la sélection rapide par profil :

- Développeur local de LLM (dev solo / étudiant) : RTX 4090 jusqu'à ce que la VRAM devienne le goulot d'étranglement.

- Ingénieur ML en startup (mise en production d'un MVP) : RTX 4090 pour les premières phases de mise en production et de fine-tuning, H100 dès que vous avez besoin d'une concurrence stable ou de modèles plus grands.

- Chercheur appliqué (beaucoup d'expérimentations) : H100 si vous rencontrez régulièrement des erreurs OOM, des limites de batch ou des contextes trop longs.

- Équipe production / plateforme (mise en production multi-locataires) : H100 pour le découpage MIG, une marge plus grande et une montée en charge plus fluide.

Avec ce cadrage, le reste de cet article porte sur les limites que les gens rencontrent concrètement, et sur la façon dont les chiffres des benchmarks s'y alignent.

La seule question de benchmark qui compte : qu'est-ce qui doit tenir en VRAM ?

La plupart des discussions sur H100 contre RTX 4090 sont en réalité des débats autour de la VRAM. Dans le travail LLM, la VRAM est consommée par poids, activations pendant l'entraînement, états de l'optimiseur pendant l'entraînement, et le Cache KV pendant l'inférence. Ce dernier est celui que les gens n'anticipent pas vraiment, car il augmente avec la longueur du contexte et la concurrence.

Le tableau ci-dessous est volontairement synthétique, car l'ajustement exact dépend du framework, de la précision et des surcharges.

Voici la vue "est-ce que ça tient sans friction ?" :

| Charge de travail | Réalité typique sur RTX 4090 (24 Go) pour un seul GPU | Réalité typique sur H100 (80–94 Go) pour un seul GPU |

| Inférence LLM 7B (FP16 / BF16) | Généralement correcte | Marge confortable |

| Inférence LLM 13B | Souvent juste, dépend du contexte | Généralement correcte |

| Inférence de classe 70B | Nécessite une quantification/déchargement important | Bien plus réaliste |

| Inférence SD/SDXL + petit batch | Généralement correcte | Correct, avec plus de marge pour les batchs |

| Service avec une concurrence élevée | La pression du cache KV se ressent rapidement | Plus de marge, plus stable en charge |

Si vous souhaitez une sélection plus large de GPU (pas seulement ces deux-là), notre comparatif des Les meilleurs GPU pour le machine learning en 2025 est un tableau de référence pratique pour VRAM et la bande passante mémoire sur les GPU AI courants.

Une fois que vous savez que votre charge de travail convient, c'est la bande passante mémoire qui détermine à quel point l'exécution se sent fluide.

Bande passante : pourquoi la HBM change tout

Les discussions sur les performances en IA se concentrent souvent sur les pics de calcul, mais les transformers sont extrêmement sensibles aux mouvements de données en mémoire. L'avantage de la H100 est de combiner de grands pools HBM avec une bande passante mémoire très élevée, complétée par la bande passante NVLink et le partitionnement MIG côté plateforme.

Caractéristiques techniques

Les caractéristiques techniques ne choisiront pas la GPU à votre place, mais elles expliquent pourquoi la même charge de travail semble facile sur une carte et à l'étroit sur l'autre. Ce récapitulatif présente ce qui influence le plus le comportement d'entraînement, d'inférence et de service de la LLM.

| Caractéristique | H100 (SXM / NVL) | RTX 4090 |

| VRAM | 80 GB / 94 GB | 24 GB |

| Bande passante mémoire | 3,35–3,9 To/s | GDDR6X (capacité limitée à 24 Go) |

| Interconnexion | NVLink + PCIe Gen5 | PCIe (plateforme grand public) |

| Multi-instance | Jusqu'à 7 instances MIG | Non disponible |

Références techniques : NVIDIA H100, NVIDIA RTX 4090.

Ce que cela signifie concrètement :

- Si vous cherchez à augmenter la taille des lots ou la longueur du contexte, la H100 reste stable plus longtemps avant que vous deviez faire des compromis.

- Si vous traitez de nombreuses requêtes simultanément, la H100 offre plus de marge en mémoire, ce qui retarde l'apparition de latences élevées imprévisibles.

- Si votre usage est principalement mono-utilisateur, mono-modèle, avec un contexte modeste, la 4090 sera souvent rapide et satisfaisante.

La bande passante ne remplace pas des benchmarks sérieux pour autant. Elle explique simplement pourquoi deux GPU peuvent sembler proches sur un test limité, puis diverger nettement sous charge réelle.

Benchmarks fiables : H100 vs RTX 4090

Les benchmarks ne se valent pas tous, et c'est pour ça que « mes chiffres ne correspondent pas aux vôtres » revient si souvent. Pour H100 contre RTX 4090, il est utile de diviser les benchmarks en deux catégories :

- Voie A (esprit communautaire) : llama.cpp-style tokens/sec tests and simple inference scripts.

- Voie B (suites standardisées) : Résultats de type MLPerf Training et MLPerf Inference, axés sur des règles reproductibles.

Instantané d'inférence style llama.cpp

C'est le genre de test que les gens font chez eux, puis débattent pendant trois jours. Il est utile parce qu'il reflète une "vraie chaîne d'outils" utilisée par beaucoup de développeurs, mais il est aussi facile de mal l'interpréter si on ignore l'adéquation et la précision.

Les comparaisons publiques de style llama.cpp montrent que la RTX 4090 s'en tire très bien sur les petits modèles et les exécutions quantisées, tandis que les grands modèles à haute précision dépassent largement les limites de la VRAM.

Voici ce à quoi vous devez vous attendre :

| Modèle | GPU | Résultat typique |

| Classe 7B | RTX 4090 | Tokens/sec élevé, inférence fluide pour un utilisateur unique |

| Classe 13B | RTX 4090 | Correct, mais le contexte et les surcharges commencent à peser |

| Classe 70B | RTX 4090 | Ne tient pas proprement sans quantisation ou déchargement agressif |

| Classe 70B | H100 | Bien plus réaliste à maintenir en mémoire et à servir de manière fiable |

Ce tableau ne dit pas "la 4090 est mauvaise" ou "la H100 est magique". Il dit que le plafond de la VRAM détermine ce que vous pouvez garder en mémoire, ce qui influe sur la vitesse, la stabilité, et le temps que vous passerez à bricoler.

Si vous réduisez constamment la longueur du contexte juste pour tenir, c'est à ce moment-là que cette comparaison cesse d'être théorique.

Ce que MLPerf apporte que les benchmarks de forum n'offrent pas

MLPerf existe parce que "des scripts aléatoires et des impressions" ne suffisent plus quand vous prenez une décision à plusieurs milliers de dollars. MLCommons a ajouté des charges de travail IA générative de nouvelle génération au fil du temps, et MLPerf est conçu pour rendre les résultats plus comparables entre systèmes.

Du côté de l'entraînement, le compte rendu MLPerf Training v5.1 de NVIDIA est un bon exemple de la façon dont les éditeurs communiquent le temps d'entraînement, avec des détails sur l'environnement de soumission et les règles de benchmark appliquées.

Ce test ne vous dira pas comment se comportent vos prompts privés, mais il sert de vérification de base pour le scaling au niveau système et pour comprendre comment cette catégorie de matériel se comporte sous contraintes.

Parlons maintenant de ce qui influe le plus sur les décisions d'achat : le temps et l'argent nécessaires pour mener le travail à terme.

Coût, temps et coût d'opportunité

Beaucoup d' H100 contre RTX 4090 les décisions sont souvent réduites à "prix d'achat vs prix de location". C'est rarement le bon angle. Mieux vaut se demander : combien d'heures faut-il pour produire un modèle réellement utilisable, et combien de temps perdez-vous à contourner des limitations ?

Trois scénarios courants illustrent assez clairement ces compromis.

Fine-tuning hebdomadaire sur des modèles petits à moyens

Si vos entraînements tiennent dans 24 GB sans compromis constants, la 4090 convient parfaitement. Vous itérez vite, vous n'avez pas à planifier du temps sur un cluster, et la configuration reste simple. Si chaque run devient un exercice de "réduire le batch, couper le contexte, recommencer", la H100 est une option bien plus sensée, malgré le coût plus élevé.

Inférence avec vraie concurrence

La concurrence fait monter rapidement la pression sur le cache KV. C'est là que la marge mémoire et les contrôles de la H100 portent leurs fruits, surtout si vous avez besoin d'une latence prévisible.

Si vous n'avez pas encore décidé si un serveur GPU est la bonne architecture pour votre déploiement, notre GPU VPS par rapport à CPU VPS analyse est une bonne façon de faire correspondre la charge de travail au type d'infrastructure avant de passer du temps à optimiser au mauvais endroit.

Entraînements plus lourds avec des échéances

Dès que vous dépassez le cadre d'une personne, une machine, ce qui compte c'est l'essentiel : des environnements stables, moins de points de défaillance, et moins de temps perdu à gérer des problèmes qui relèvent de la surveillance basique. C'est exactement pour ça que la H100 a été conçue.

Si vous hésitez encore après cette section, la prochaine étape n'est pas de continuer à lire. C'est d'observer comment votre stack se comporte en pratique, notamment les frictions liées aux drivers et les charges multi-utilisateurs.

Logiciel et ops : drivers, stabilité, multi-utilisateurs et support

C'est la partie que la plupart des benchmarks ignorent, mais elle représente une grande part du quotidien.

La RTX 4090 est populaire parce qu'elle est accessible et rapide pour de nombreux workflows IA. Le revers de la médaille : dès que votre usage grandit, vous risquez de vous heurter à des limites mémoire et à des contraintes de scaling qui ne sont pas prévues pour des environnements partagés et multi-tenants.

La H100 est conçue pour les clusters. MIG est un atout majeur pour les équipes plateforme : il permet de diviser une GPU en tranches isolées, ce qui réduit les problèmes de "voisin bruyant" et simplifie considérablement la planification de capacité. Les spécifications officielles NVIDIA pour la H100 indiquent jusqu'à 7 instances MIG selon le facteur de forme.

Si votre charge de travail est personnelle et locale, vous pouvez très bien vous en sortir avec une 4090 pendant longtemps. Si elle est multi-utilisateurs et orientée clients, la H100 est le choix le plus sûr.

Alors, en résumé, qui devrait choisir quoi ?

Quelle option choisir selon votre charge de travail

Pour H100 contre RTX 4090, le bon choix est en définitive celui qui lève vos principaux obstacles.

Développeur LLM en local (solo / étudiant)

Optez pour RTX 4090 si vous travaillez principalement avec des modèles 7B–13B, de l'inférence quantifiée, du RAG, ou SDXL. Passez au niveau supérieur quand vous passez plus de temps à contourner les limites mémoire qu'à avancer sur votre projet.

Ingénieur ML en startup (lancement d'un MVP)

Si votre MVP repose sur un modèle unique avec un trafic modéré et que les ressources suffisent largement, la 4090 est un excellent point de départ. Si vous avez besoin d'une latence stable sous les pics de charge, d'une meilleure concurrence ou de plusieurs charges de travail sur le même hôte, la H100 est le choix le plus serein.

Chercheur appliqué (beaucoup d'expérimentations)

Si vous vous retrouvez souvent à faire des compromis — réduire la taille des batchs ou jongler avec la précision — H100 vous offre des expériences plus propres et moins de runs avortés.

Production / Platform Team (Serving Multi-Locataires)

H100 s'impose assez naturellement : le MIG et la marge de capacité supplémentaire simplifient la planification des ressources et limitent l'impact quand une charge pic se produit.

Si vous n'êtes pas encore prêt à investir dans du matériel, la location est la meilleure option.

Une voie intermédiaire pragmatique : louez des GPU d'abord, puis engagez-vous

La façon la plus claire de trancher H100 contre RTX 4090 consiste à faire tourner vos modèle, vos invites, et vos longueur de contexte sur les deux types de matériel, puis comparer les tokens/sec et la latence de queue sous charge.

C'est exactement pour ça qu'on a créé Cloudzy GPU VPS, car vous pouvez obtenir un serveur GPU en moins d'une minute, installer votre stack avec un accès root complet, et arrêter de vous fier aux benchmarks des autres.

Voici ce qui est inclus dans nos formules GPU VPS :

- GPU NVIDIA dédiés (y compris les options de classe RTX 4090 et A100) pour que vos résultats ne soient pas faussés par des voisins bruyants.

- Réseau jusqu'à 40 Gbps sur tous les plans GPU, ce qui fait une vraie différence pour les téléchargements de datasets, les workflows multi-nœuds et le transfert rapide d'artefacts.

- Stockage NVMe SSD, en plus DDR5 RAM et des options CPU haute fréquence sur tous les niveaux, pour que le reste de la configuration ne bride pas le GPU.

- Protection DDoS et un 99,95 % de disponibilité, afin que les tâches longues ne soient pas interrompues par des instabilités réseau aléatoires.

- Facturation à l'heure (pratique pour des tests de performance ponctuels) et un Remboursement sous 14 jours pour des tests à faible risque.

Exécutez d'abord la même liste de vérifications sur un plan RTX 4090, puis recommencez sur un plan de type A100 lorsque vous travaillez avec des contextes plus larges, une concurrence plus élevée ou des modèles plus volumineux. Après cela, le choix entre H100 contre RTX 4090 devient généralement évident à partir de vos propres logs.

Liste de vérifications pour le benchmark : effectuez la vôtre en 30 minutes

Si vous voulez une décision que vous pouvez justifier, récupérez quatre métriques depuis la configuration exacte que vous prévoyez de déployer :

- Jetons/sec à la longueur de contexte cible

- Latence p95 à la concurrence attendue

- Marge VRAM pendant la phase la plus intensive

- Coût par exécution complète du début à l'artefact

Un test de fumée minimal avec vLLM ressemble à ceci :

pip install vllm transformers accelerate

python -m vllm.entrypoints.api_server \

--model meta-llama/Llama-3-8B-Instruct \

--dtype float16 \

--max-model-len 8192Si vous voulez comprendre ce que vous louez réellement, notre article sur Qu'est-ce qu'un VPS GPU ? explique la différence entre l'accès GPU dédié, le partage vGPU, et ce qu'il faut vérifier avant de choisir un plan.