Si vous envisagez d'acheter un nouveau GPU pour ne plus voir d'erreurs de mémoire insuffisante, le débat 5070 Ti vs 5080 n'est pas le bon. Les deux cartes embarquent 16 Go de VRAM, et cette limite de capacité se fait ressentir en deep learning plus tôt que la plupart des gens ne le pensent.

La 5080 est plus rapide, mais elle vous permet rarement de faire tourner un modèle significativement plus grand. En pratique, vous finissez quand même par réduire la taille des lots, tronquer la longueur de contexte ou décharger sur la RAM système pour maintenir les exécutions en vie.

C'est pourquoi cet article propose une analyse honnête et réaliste de la 5070 Ti vs 5080 pour le deep learning, ainsi qu'une sélection d'options adaptées si votre objectif est d'entraîner, d'affiner ou de servir des modèles sans être constamment limité par la VRAM.

Si vous ne lisez qu'une seule chose, lisez la section sur les caractéristiques techniques et celle sur la « capacité vs vitesse » : ce sont les deux qui vous éviteront d'acheter la mauvaise carte.

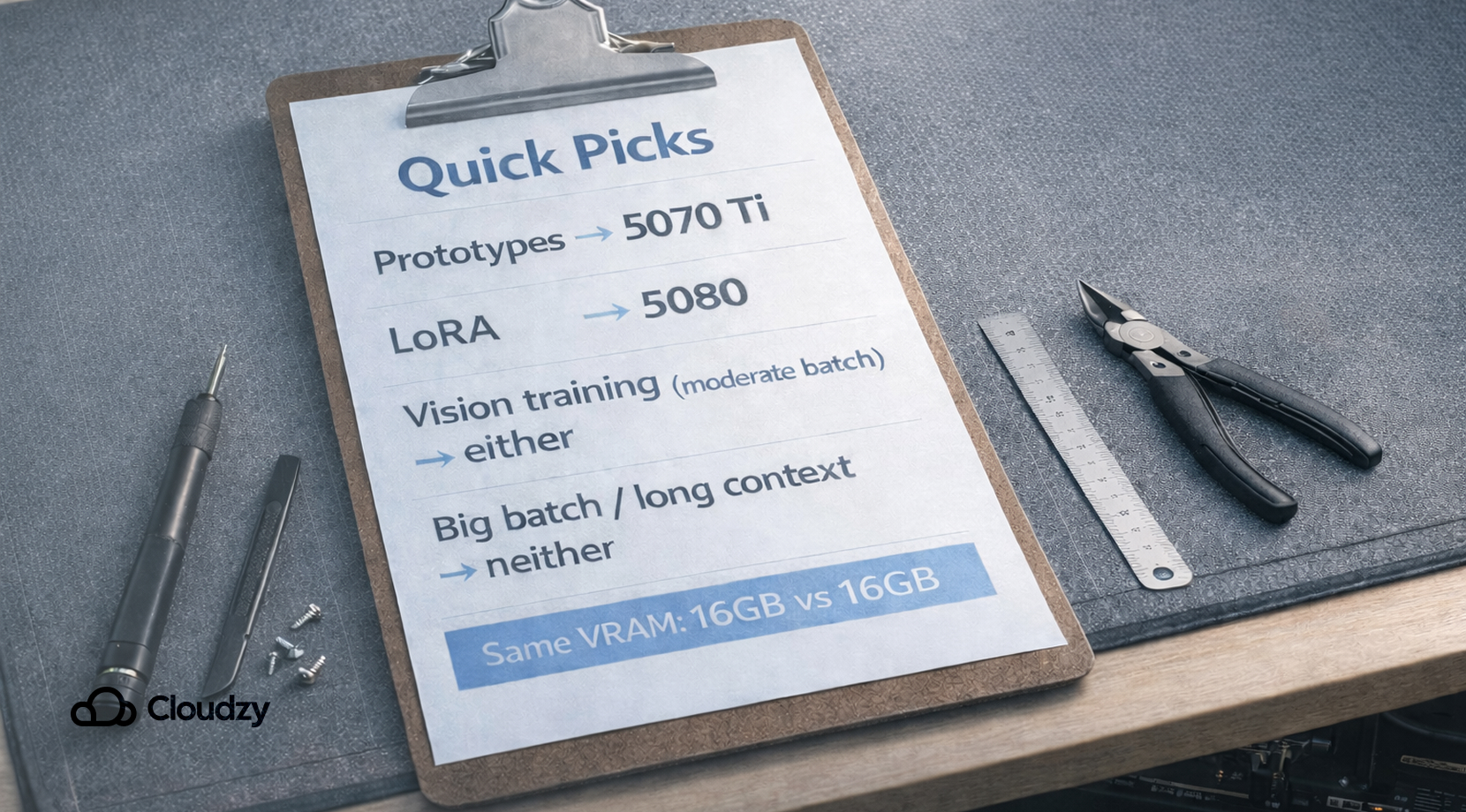

Sélection rapide selon votre usage

La plupart des gens n'achètent pas des GPU au hasard. On observe quatre profils d'acheteurs qui reviennent sans cesse, et le choix 5070 Ti vs 5080 ne se pose pas de la même façon pour chacun.

L'amateur de LLM en local

Vous lancez des notebooks, jouez avec les paramètres de quantification, et ce qui compte pour vous c'est que ça tourne, pas le débit optimal. Dans ce cas, le choix 5070 Ti vs 5080 se fait généralement selon le budget : les deux cartes se comportent bien sur les petits modèles et l'inférence quantifiée, et toutes deux atteignent le même plafond VRAM dès que vous augmentez la longueur du contexte ou la taille des batchs.

L'étudiant en master qui entraîne des modèles de vision

Vous avez besoin d'expériences reproductibles, pas de relances interminables. Le coût caché, ce n'est pas la carte elle-même : c'est le temps perdu quand les runs échouent à l'époque 3 parce que le dataloader, les augmentations et le modèle se disputent tous la mémoire.

L'ingénieur startup qui déploie de l'inférence

Vous êtes attentif à la latence de queue et à la concurrence. Une démo mono-utilisateur peut sembler impeccable avec 16 GB, puis le trafic de production arrive et la pression du KV cache grignote votre VRAM comme une fuite lente. Pour le serving, le débat 5070 Ti vs 5080 peut devenir une distraction si votre vrai problème est la capacité pour le batching et les longs prompts.

Le créateur qui fait aussi du ML

Vous passez constamment des applications créatives aux outils ML, et vous n'avez aucune patience pour les redémarrages, les problèmes de drivers ou le "ferme Chrome pour lancer l'entraînement". Pour vous, le choix 5070 Ti vs 5080 n'a de sens que si la GPU s'intègre dans un workflow fluide, pas dans une station de travail fragile qui lâche dès que vous faites tourner plusieurs choses à la fois.

Ces profils posés, passons au concret : le matériel, et pourquoi le facteur limitant est le même là où ça compte vraiment.

Spécifications clés pour le deep learning

La meilleure façon de comprendre le choix 5070 Ti vs 5080, c'est d'ignorer les chiffres marketing et de se concentrer sur la ligne mémoire.

Pour une vue complète des spécifications, voici un tableau détaillé centré sur ce qui influence réellement le comportement à l'entraînement et à l'inférence. (Les fréquences d'horloge et les sorties d'affichage attirent l'œil, mais ce n'est pas eux qui décident si votre run passe.)

| Spécification (Desktop) | RTX 5070 Ti | RTX 5080 | Impact sur le DL |

| VRAM | 16 GB | 16 GB | La capacité est le plafond absolu pour les poids, les activations et le KV cache |

| Type de mémoire | GDDR7 | GDDR7 | Comportement similaire, la bande passante aide, mais c'est la capacité qui décide si ça rentre ou non |

| Bus mémoire | 256 bits | 256 bits | Limite la bande passante agrégée ; améliore le débit, pas la capacité à charger le modèle |

| Cœurs CUDA | 8,960 | 10,752 | Plus de puissance de calcul améliore les tokens/s, pas la capacité à charger le modèle |

| Consommation typique | 300 W | 360 W | Plus de chaleur et de marge côté alimentation, sans VRAM supplémentaire |

Sources officielles pour les spécifications : RTX 5080, Famille RTX 5070

En résumé : la 5080 est la carte la plus rapide, la 5070 Ti est la moins chère. En deep learning, la différence ne se manifeste vraiment qu'une fois que votre workload tient déjà en mémoire.

Voyons ensuite pourquoi VRAM s'épuise aussi vite, même sur des configurations qui semblent légères sur le papier.

Pourquoi VRAM se remplit si vite en deep learning

Les habitués du gaming ont tendance à voir VRAM comme un pool de textures. En deep learning, c'est plutôt un plan de travail trop petit. Il ne s'agit pas juste de stocker les ingrédients : il faut aussi de la place pour couper, cuire et dresser, tout en même temps.

Voici ce qui occupe généralement VRAM pendant une exécution :

- Poids du modèle: les paramètres chargés, parfois en FP16/BF16, parfois quantifiés.

- Activations: les tenseurs intermédiaires sauvegardés pour la rétropropagation, souvent le plus gros consommateur à l'entraînement.

- Gradients et état de l'optimiseur: la surcharge liée à l'entraînement, qui peut démultiplier les besoins en mémoire.

- Cache KV: la surcharge liée à l'inférence, qui croît avec la longueur du contexte et la concurrence.

C'est pourquoi le débat 5070 Ti vs 5080 ressemble à une dispute sur la puissance moteur quand la remorque est déjà trop lourde. Plus de chevaux ne changent rien si la capacité d'attelage reste le facteur limitant.

Une vérification rapide que nous utilisons dans nos propres tests : journaliser à la fois la mémoire allouée et la mémoire réservée dans PyTorch. Les notes CUDA sur la mémoire de PyTorch expliquent le fonctionnement de l'allocateur de cache et pourquoi la mémoire peut apparaître comme « utilisée » dans des outils comme nvidia-smi même après la libération des tenseurs.

Ce qui nous amène au cœur du sujet : la plupart des échecs en deep learning sur 16 Go ne viennent pas d'une lenteur intrinsèque, mais d'un OOM qui survient au pire moment possible.

Les premières charges de travail qui font craquer le 5070 Ti face au 5080

Voici les cas d'usage en deep learning qui atteignent les limites mémoire en premier sur 5070 Ti vs 5080.

LLM avec longs prompts et concurrence réelle

Un prompt unique à 2 000 tokens peut sembler gérable. Ajoutez un contexte plus long, du batching, un second utilisateur, et le KV cache commence à grimper. C'est là que 5070 Ti et 5080 convergent vers le même résultat : vous plafonnez le contexte ou réduisez la taille des batchs pour tenir.

Une méthode de vérification simple :

- Lancez votre serveur avec votre contexte maximal réel et votre batch.

- Surveillez VRAM dans le temps, pas seulement au démarrage.

- Repérez le moment où la latence s'emballe, puis vérifiez l'utilisation mémoire sur la même fenêtre.

Si vous cherchez une configuration de monitoring fiable qui ne se transforme pas en projet à part entière, notre guide sur Logiciel de surveillance GPU présente des patterns de logging CLI pratiques qui fonctionnent bien en conditions réelles.

Fine-tuning LoRA ou QLoRA

Beaucoup affirment que « LoRA fonctionne sur 16 Go », et ce n'est pas faux. Le piège, c'est de supposer que le reste de votre pipeline ne coûte rien. Les buffers de tokenisation, les workers du dataloader, le scaling en précision mixte et les étapes de validation s'accumulent très vite.

En pratique, le goulot d'étranglement n'est pas tant le calcul que la marge disponible. Sans VRAM de réserve, vous passez vos runs à surveiller en permanence.

Entraînement de modèles de vision avec des entrées haute résolution

Les modèles d'images ont un mode de défaillance sournois : une légère augmentation de résolution, ou une augmentation supplémentaire, peut faire basculer un run stable en OOM. Sur 5070 Ti vs 5080, cela se traduit par un batch size qui s'effondre à 1, puis par un gradient accumulation qui transforme l'entraînement en boucle au ralenti.

Runs multimodaux sur un seul GPU

Encodeur texte + encodeur image + couches de fusion peuvent fonctionner correctement ; en revanche, si vous augmentez la longueur de séquence ou ajoutez un backbone vision plus lourd, l'empilement mémoire devient brutal.

« Mon GPU tient la charge, mon desktop non »

C'est le cas le plus courant. Vous lancez l'entraînement, puis votre navigateur, votre IDE et les autres processus actifs consomment du VRAM, et soudain votre configuration « stable » plante. Sur les forums, des utilisateurs se plaignent de tout fermer, de désactiver les overlays, et de se retrouver quand même en OOM avec le même modèle qui tournait la veille.

Ce pattern revient constamment dans Discussions 5070 Ti vs 5080, également, car les deux cartes partagent la même limite de capacité. Si tout cela vous semble familier, la question suivante est : "que faire face à cette limite ?"

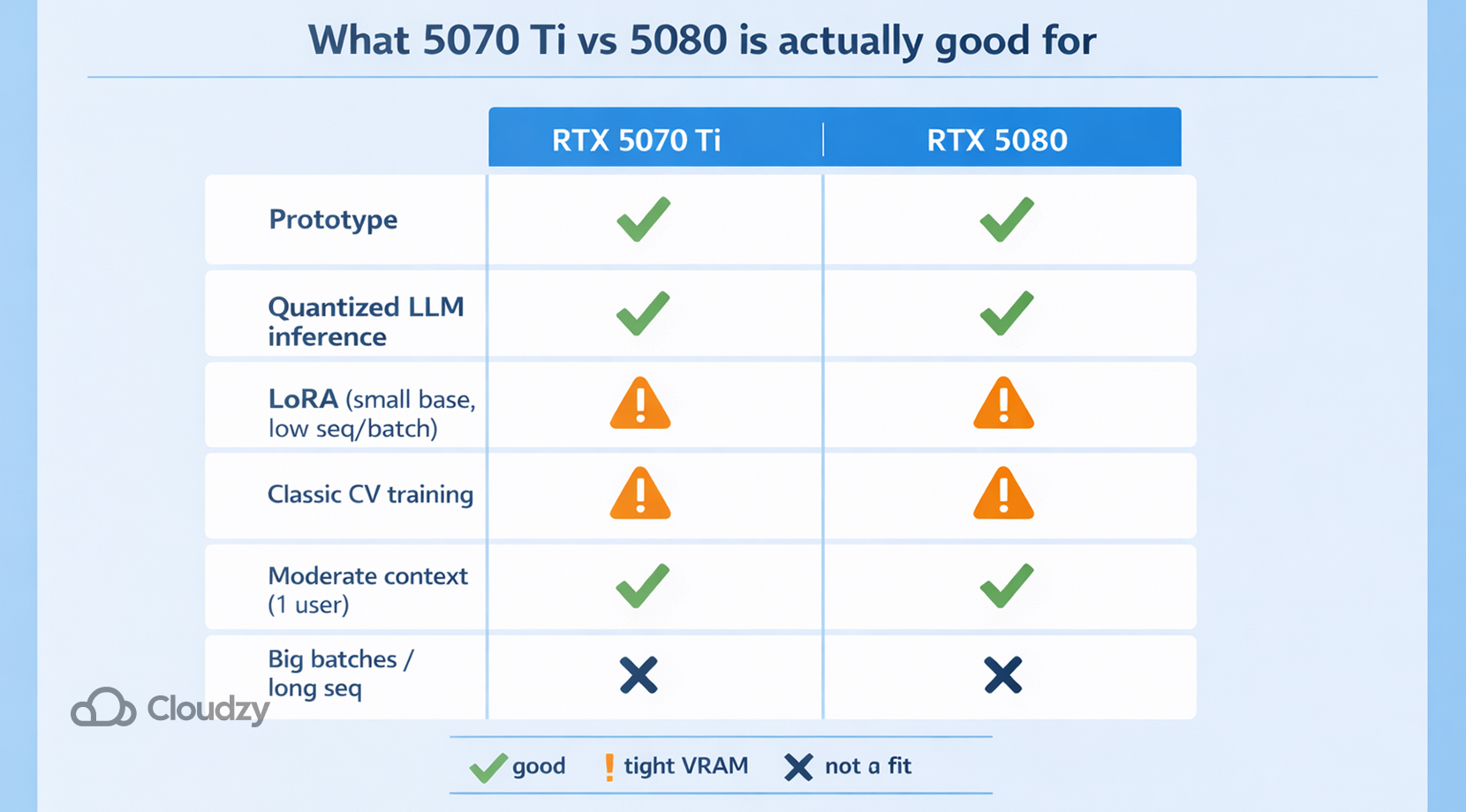

À quoi servent réellement le 5070 Ti et le 5080

Critiquer les 16 Go en ML est facile, mais cette configuration n'est pas inutile pour autant. Elle est juste limitée à certains usages.

Le 5070 Ti vs 5080 peut tout à fait convenir pour :

- Travaux de prototypage: petites expériences, ablations rapides et vérifications de base.

- Inférence LLM quantifiée: modèles légers avec un contexte modéré, utilisateur unique.

- LoRA sur des modèles de base de petite taille: à condition de garder la longueur de séquence et la taille du batch sous contrôle.

- Entraînement vision classique: tailles d'images modérées, backbones modérés, plus de patience requise.

En résumé : si votre travail reste dans les limites de la mémoire, le 5080 sera généralement plus réactif que le 5070 Ti, et vous profiterez de la puissance de calcul supplémentaire.

Mais dès que vous tentez un deep learning "sérieux", vous vous heurterez à des problèmes de mémoire disponible. Voyons donc les tactiques utiles sur ces deux cartes.

Comment tirer le maximum d'un VRAM limité sans rendre l'entraînement pénible

Aucune de ces astuces n'est magique. Ce sont simplement les techniques qui permettent au 5070 Ti et au 5080 de rester utilisables plus longtemps.

Commencer par mesurer

Avant de toucher aux hyperparamètres, relevez le pic de VRAM par étape. Dans PyTorch, max_memory_allocated() et max_memory_reserved() sont des moyens rapides de voir ce que votre run consomme réellement.

Cela vous aide à répondre à des questions comme :

- Le modèle lui-même est-il le principal poste de coût, ou ce sont les activations ?

- VRAM monte-t-il en pic pendant la validation ?

- La fragmentation augmente-t-elle progressivement avec le temps ?

Une fois que vous avez une référence de base, le reste devient moins aléatoire.

Réduire la mémoire autant que possible

Un "ordre des opérations" simple que nous utilisons :

- Réduire la taille du batch jusqu'à ce qu'elle rentre.

- Ajouter la gradient accumulation pour retrouver votre batch effectif.

- Activer la précision mixte (BF16/FP16) si votre stack le permet.

- Ajouter le gradient checkpointing si les activations dominent.

- Ce n'est qu'ensuite qu'on touche à la taille du modèle.

Traiter la longueur de contexte comme un budget

Pour les transformers, la longueur de contexte est ce qui cause le plus de problèmes. Elle influe sur le calcul de l'attention et, pour l'inférence, sur la taille du KV cache. Avec la 5070 Ti vs 5080, vous le remarquez dès que vous dépassez quelques milliers de tokens : VRAM grimpe rapidement, le débit chute, et vous vous retrouvez à réduire la taille du batch juste pour rester opérationnel.

Approche recommandée :

- Choisissez un contexte maximum par défaut que vous pouvez exécuter avec de la marge.

- Créez un second profil pour le "contexte long", avec un batch plus petit.

- Ne mélangez pas les deux pendant vos sessions de débogage.

Ne pas confondre le cache PyTorch avec de vraies fuites mémoire

Beaucoup de rapports de "fuite mémoire" correspondent en réalité au comportement de l'allocateur. La documentation de PyTorch indique que l'allocateur de cache peut conserver de la mémoire réservée même après la libération des tenseurs, et que empty_cache() libère surtout les blocs en cache inutilisés vers d'autres applications, et non vers PyTorch lui-même.

Ce point est important, car les utilisateurs qui comparent la 5070 Ti vs 5080 se laissent souvent distraire par des fuites fantômes plutôt que par les vraies causes : taille du batch, longueur des séquences et mémoire des activations.

Ces ajustements rendent votre limite mémoire plus exploitable, mais ils ne changent pas la réalité fondamentale. Si votre projet exige des modèles plus grands, des contextes plus longs ou une concurrence plus élevée, il vous faut plus de VRAM.

Faut-il privilégier la capacité ou la vitesse entre la 5070 Ti et la 5080 ?

On peut voir les choses ainsi : la vitesse, c'est à quelle allure vous pouvez rouler ; la capacité, c'est combien de passagers vous pouvez embarquer. Le deep learning a besoin des deux, mais c'est la capacité qui détermine si vous pouvez quitter le parking.

La 5080 offre un débit supérieur à la 5070 Ti sur de nombreuses charges de travail. Mais la comparaison 5070 Ti vs 5080 ne change rien à la question "puis-je le charger et l'exécuter" : les deux atteignent leurs limites.

C'est pour ça que les gens sont déçus après une mise à niveau. Ils ressentent le gain de vitesse sur de petits tests, puis ils lancent leur vraie charge de travail et se heurtent au même mur. Le mur arrive juste 30 secondes plus tard.

Donc, si vous cherchez une carte pour le deep learning, il est utile de déterminer dans quelle catégorie vous vous trouvez :

- Limité par la vitesse: votre modèle tient déjà en mémoire, vous voulez juste des itérations plus rapides.

- Limité par la capacité: votre modèle ne tient pas proprement, et vous passez du temps à le réduire.

La plupart des personnes qui comparent la 5070 Ti et la 5080 pour le deep learning sont dans la deuxième catégorie, même si elles ne l'ont pas encore réalisé.

Parlons maintenant de l'option qui fait généralement gagner le plus de temps : déléguer le "gros travail" à une GPU plus puissante, sans tout réorganiser autour d'une nouvelle machine locale.

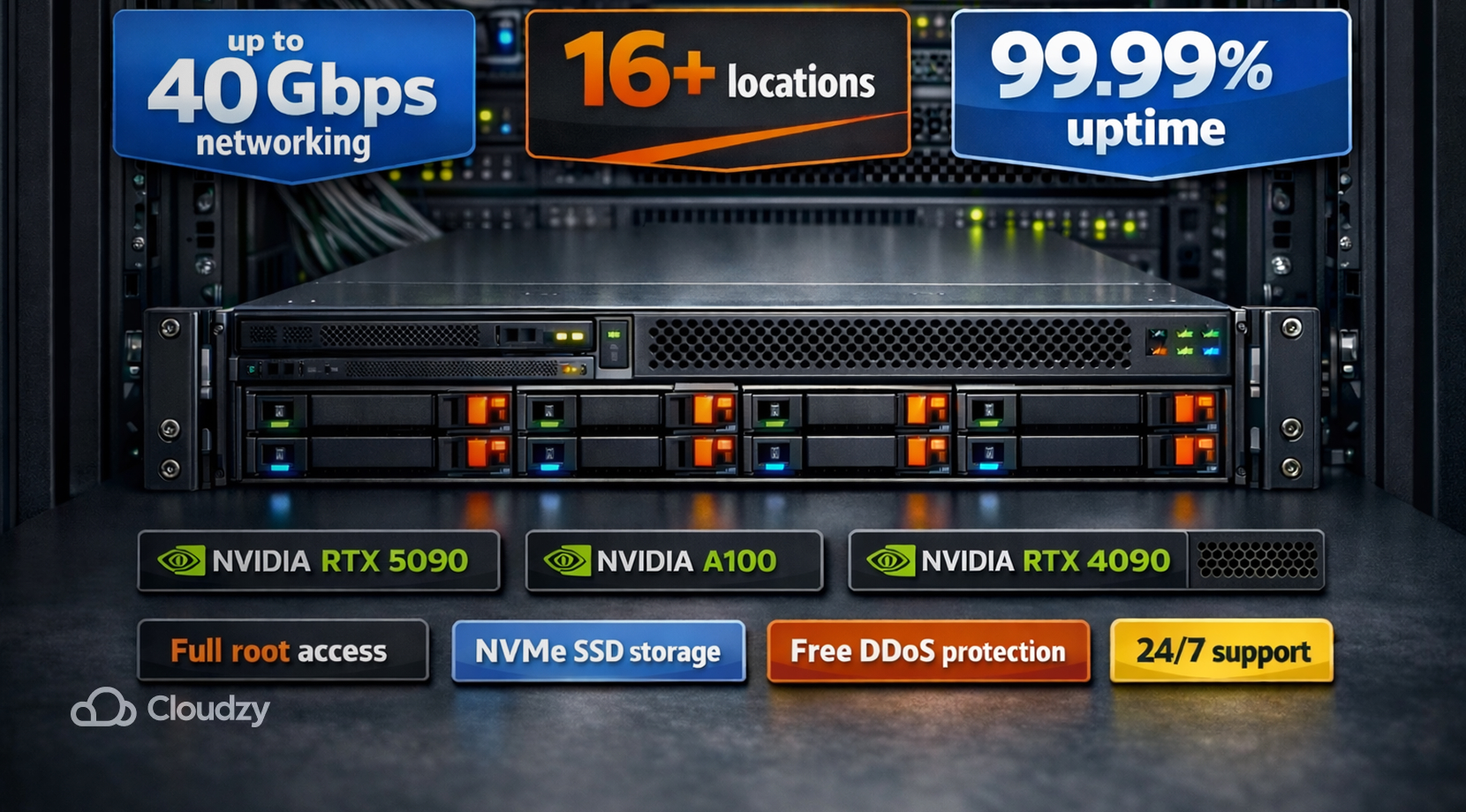

Une solution abordable : utiliser un VPS GPU pour les entraînements lourds

Dans notre équipe infrastructure, le schéma le plus courant est que les gens prototypent en local, puis arrivent à un stade où la question 5070 Ti vs 5080 ne se pose plus, parce que le modèle ne tient tout simplement plus en mémoire.

C'est à ce moment-là qu'il faut accéder à un pool VRAM plus grand pour l'entraînement et les tests de serving réalistes. C'est exactement là que Cloudzy GPU VPS est la bonne réponse.

Nos offres GPU VPS incluent des options NVIDIA comme RTX 5090, A100 et RTX 4090, ainsi qu'un accès root complet, du stockage NVMe SSD, un réseau jusqu'à 40 Gbps, 12 emplacements, une protection DDoS gratuite, un support 24/7 et un objectif de disponibilité à 99,95 %.

Mais en quoi cela vous aide-t-il, que ce soit pour choisir entre la 5070 Ti et la 5080, ou pour toute autre GPU du même niveau ? Voici ce que ça change :

- Vous pouvez exécuter votre modèle réel et votre profil de prompts sur du matériel avec plus de VRAM, ce qui rend les décisions évidentes à partir de vos propres logs.

- Vous pouvez garder votre GPU locale pour le développement et les tests rapides, puis louer la "grosse carte" uniquement pour les entraînements intensifs.

Si vous voulez une remise à niveau rapide sur ce qu'est réellement un VPS GPU, et ce que signifient GPU dédiée vs accès partagé, notre guide pour débutants l'explique en langage clair.

Et si vous n'êtes toujours pas sûr d'avoir besoin d'une GPU pour votre charge de travail, notre comparatif GPU vs VPS CPU vous donnera une idée précise de quelles tâches concrètes - entraînement, inférence, bases de données, applications web - nécessitent quel type de matériel.

Une fois l'infrastructure réglée, il reste à choisir un flux de travail qui ne vous fait pas perdre de temps.

Un workflow simple pour identifier ce dont vous avez besoin

Beaucoup de développeurs ML se retrouvent face à un faux choix : acheter la carte grand public la plus puissante ou se résigner à souffrir. En pratique, le débat 5070 Ti vs 5080 garde tout son sens si vous considérez votre carte locale comme un outil de développement, pas comme une stack de production complète.

Voici un workflow qui fonctionne bien en pratique :

- Utilisez votre GPU 16 GB pour coder, déboguer et mener de petites expériences.

- Gardez un modèle d'environnement « grand GPU » prêt pour les exécutions distantes.

- Déplacez les entraînements et tests de serving qui nécessitent de la marge vers un GPU VPS.

- Surveillez vos exécutions et enregistrez les logs pour que les résultats soient reproductibles.

Pour un examen plus approfondi du choix de la bonne catégorie de GPU pour les travaux ML en général, notre comparatif des meilleurs GPU pour le machine learning est une bonne prochaine étape.

En définitive, le choix 5070 Ti vs 5080 relève du calcul local, mais passer à l'échelle en deep learning est un choix d'infrastructure. Si vous souhaitez voir comment une catégorie de carte supérieure change concrètement le comportement d'un modèle IA, notre benchmark H100 vs RTX 4090 offre une comparaison utile, car il revient constamment au même principe : la capacité VRAM d'abord, la vitesse ensuite.