A gépi tanulás egyik legfontosabb, ha nem a legfontosabb aspektusa a pontos és megbízható előrejelzések elérése. Az ilyen célokra alkalmazott innovatív módszer, amely az utóbbi időben egyre nagyobb figyelmet kap, a Bootstrap Aggregating, amelyet a gépi tanulásban bagging-nak neveznek. Ez a cikk a gépi tanulásban alkalmazott bagging-ot, a bagging és boosting közötti különbségeket, egy bagging-osztályozó például működését, a bagging működésének menetét, valamint a gépi tanulásban alkalmazott bagging előnyeit és hátrányait tárgyalja.

Mi az a bagging a gépi tanulásban?

Ez a két kép az egyetlen relevánsan használt a népszerű cikkekben, egyik vagy mindkettő felhasználható (az egyik itt, a másik máshol), ha a Design csapat Cloudzy-verziót készít belőlük.

Mit az a Bagging?

Képzeld el, hogy egy tárgy súlyát próbálod megtippelni több ember becslése alapján. Egyénileg a tippek jelentősen eltérhetnek egymástól, de az összes becslés átlagolásával sokkal megbízhatóbb értékhez jutsz. Ez a bagging lényege: több modell kimenetét kombinálod, hogy pontosabb és stabilabb előrejelzést kapj.

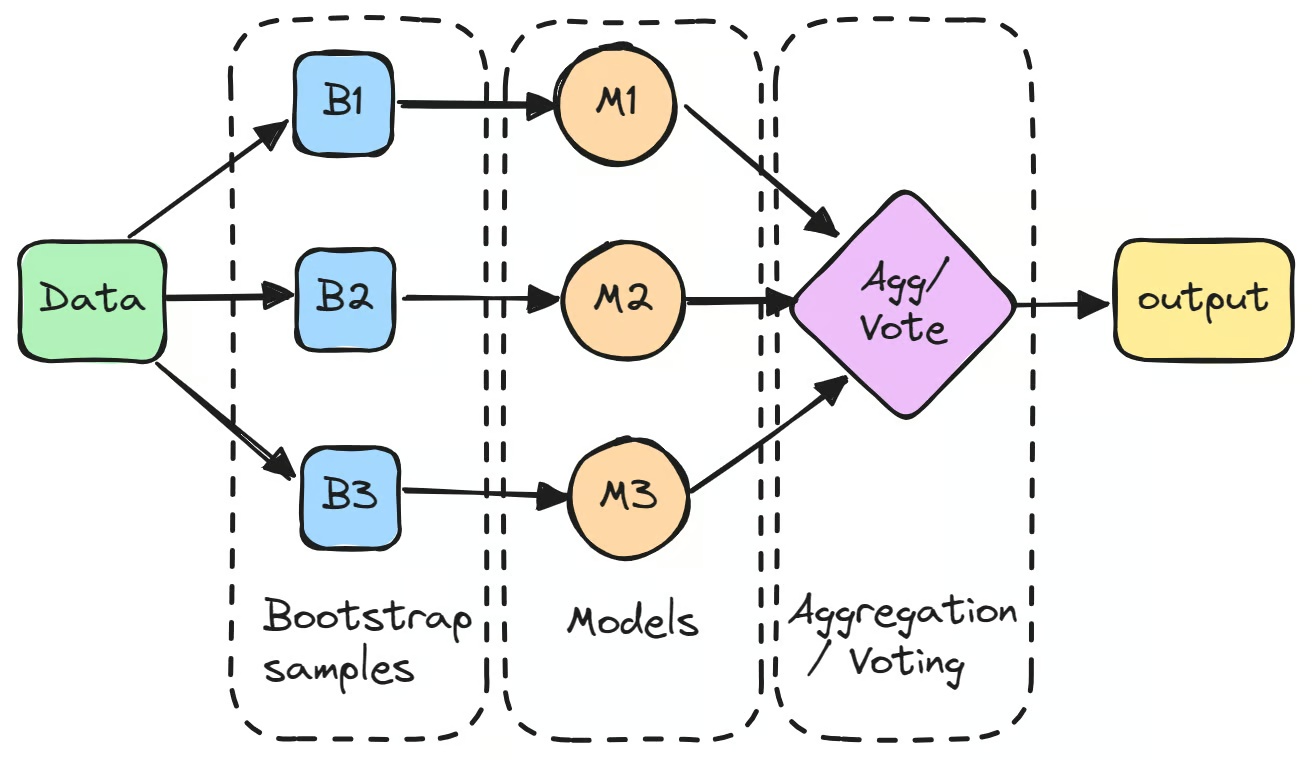

A folyamat az eredeti adathalmaz több részhalmaza létrehozásával kezdődik bootstappelés révén, amely visszatevéses véletlen mintavételezés. Az egyes részhalmazokat felhasznál egy-egy modell független tanítására.

Ezeket az egyedi modelleket gyakran „gyenge tanulóknak" nevezik, és önmagukban nem teljesítenek megfelelően a magas szórás miatt. Azonban amikor az előrejelzéseiket aggregálod – általában átlagolással regressziós feladatoknál vagy többségi szavazással osztályozásnál – az összevont eredmény gyakran túlszárnyalja bármelyik önálló modell teljesítményét.

A bagging klasszikus példája a Random Forest algoritmus, amely döntési fák egy halmazát építi fel az előrejelzési pontosság javítása érdekében. Ugyanakkor ne keverd össze a baggingot a gépi tanulás boostingjával, amely másként működik: az eltolódás csökkentésére szekvenciálisan tanít modelleket, míg a bagging párhuzamosan tanít, hogy a szórást csökkentse.

Mind a bagging, mind a boosting a gépi tanulásban a modellek teljesítményét javítja, de a modell viselkedésének más aspektusaira célznak.

Miért hasznos a bagging?

A bagging egyik fő előnye a gépi tanulásban a szóráscsökkentés képessége, amely segít a modelleknek jobb általánosítást mutatni az eddig nem látott adatokon. A bagging különösen előnyös olyan algoritmusoknál, amelyek érzékenyek a tanítóadatok ingadozására, például a döntési fáknál.

Az overfitting megelőzésével stabilabb és megbízhatóbb modellt biztosít. Ha a baggingot és a boostingot hasonlítod össze a gépi tanulásban, a bagging a szórás csökkentésére fókuszál párhuzamos modelltranzakciók során, míg a boosting az eltolódás csökkentésére törekszik szekvenciális tanítással.

A bagging egy gépi tanulási példája a pénzügyi kockázat-előrejelzésben látható, ahol több döntési fa tanul különböző történelmi piaci adatok részhalmazaiból. Az előrejelzések aggregálásával a bagging egy robusztusabb előrejelzési modellt hoz létre, amely csökkenti az egyedi modellhibák hatását.

Lényegében a gépi tanulás baggingje több modell kollektív tudására támaszkodik, hogy olyan előrejelzéseket szolgáltasson, amelyek pontosabbak és megbízhatóbbak, mint az egyedi modellekből származó eredmények.

Hogyan működik a bagging a gépi tanulásban: lépésről lépésre

A bagging modellteljesítmény-javító hatásának teljes megértéséhez bontsuk le a folyamatot lépésről lépésre.

Több bootstrap minta készítése az adathalmazból

A gépi tanulás baggingje első lépése az eredeti adathalmaz több új részhalmazának létrehozása bootstappelés segítségével. Ez a technika az adatok visszatevéses véletlen mintavételezését jelenti, így egyes adatpontok több alkalommal is megjelenhetnek ugyanabban a részhalmazban, míg mások egyáltalán nem. Ez azért szükséges, hogy mindegyik modell az adat egy kicsit eltérő verziójával tanuljon.

Külön modell tanítása az egyes mintákon

Az egyes bootstrap mintákat ezután egy-egy külön modell tanítására használjuk, jellemzően ugyanolyan típusút, például döntési fákat. Ezeket a modelleket gyakran „alapmodelleknek" vagy "gyenge tanulóknak" hívjuk, és a megfelelő részhalmazokon függetlenül tanítjuk. A bagging osztályozó egy klasszikus példája a Random Forest algoritmusban használt döntési fa, amely sok bagging alapú modell gerincét képezi. Bár az egyes modellek egyénileg nem teljesíthetnek jól, mindegyik egyedi meglátásokat nyújt az adott tanítóadatok alapján.

Az előrejelzések aggregálása

A modellek tanítása után előrejelzéseiket aggregálod a végső kimenet előállítása érdekében.

- Regressziós feladatoknál az előrejelzéseket átlagolod, csökkentve a modell szórását.

- Osztályozási feladatoknál a végső előrejelzést többségi szavazás határozza meg, ahol a legtöbb modell által előrejelzett osztály kerül kiválasztásra. Ez a módszer stabilabb előrejelzést nyújt, mint egy önálló modell kimenete.

Végső előrejelzés

Több modell előrejelzésének kombinálásával a bagging csökkenti bármelyik modell hibájának hatását, javítva az általános pontosságot. Ez az aggregálási folyamat az, ami a baggingot különösen hatékony technikává teszi, különösen olyan gépi tanulási feladatoknál, ahol magas szórású modelleket, például döntési fákat használnak. Hatékonyan simítja ki az egyes modellpredikciók inkonzisztenciáit, erősebb végső modellel eredményezve.

Bár a bagging hatékony az előrejelzések stabilizálásában, néhány dolog figyelembe veendő: az overfitting kockázata, ha az alapmodellek túl összetettek, annak ellenére, hogy a bagging az általános célja ennek csökkentése.

Számítási szempontból drága, ezért az alapmodellszám módosítása vagy hatékonyabb ensemble módszerek megfontolása segíthet, és a megfelelő hardware kiválasztása ML és DL feladatokhoz mindig fontos.

Gondoskodj az alapmodellek közötti sokféleségről a jobb eredményekért, és ha kiegyensúlyozatlan adatokkal dolgozol, az olyan technikák, mint a SMOTE, hasznosak lehetnek a bagging alkalmazása előtt, hogy elkerüld a rossz teljesítményt a kisebbségi osztályoknál.

Bagging alkalmazásai

Most már, hogy megismerkedtünk a bagging működésével, ideje megnézni, hol és hogyan alkalmazzák a valós világban. A bagging számos iparágban honosodott meg, és segít a predikciók pontosságának és stabilitásának javításában összetett forgatókönyvek esetén. Nézzünk meg néhány leginkább hatásos alkalmazást:

- Osztályozás és regresszió: A bagging széles körben használt módszer osztályozók és regresszorok teljesítményének javítására, mivel csökkenti a szóródást és megelőzi a túltanulást. Például a baggingot alkalmazó Random Forests hatékonyak képosztályozási és prediktív modellezési feladatokra.

- Anomália detektálása: Olyan területeken, mint a csalások felderítése és hálózati behatolás-detektálás, a bagging algoritmusok kiváló teljesítményt nyújtanak azáltal, hogy hatékonyan azonosítanak kiugró értékeket és anomáliákat az adatokban.

- Pénzügyi kockázatfelmérés: A banki szektorban bagging módszereket alkalmaznak hitelminősítési modellek fejlesztésére, így javítva a kölcsönigénylések jóváhagyása és pénzügyi kockázatok értékelése pontosságát.

- Orvosi diagnosztika: Az egészségügyben a bagging-t alkalmazták neurokognitív betegségek, például az Alzheimer-kór detektálására MRI-adatsorok elemzésével, segítve az korai diagnózist és kezelési terv felállítást.

- Természetes nyelvfeldolgozás (NLP): A bagging hozzájárul szövegosztályozási és szentimenfelemzési feladatokhoz azáltal, hogy több modell predikciójait összesíti, így megbízhatóbb nyelvmegértéshez vezet.

A bagging előnyei és hátrányai

Mint bármely gépi tanulási technika, a baggingnak megvannak a maga előnyei és hátrányai. E jellemzők megértése segít annak eldöntésében, mikor és hogyan alkalmazzuk a baggingot a modelljeinkben.

A Bagging előnyei:

- Csökkenti a szóródást és a túltanulást: A bagging egyik legjelentősebb előnye a gépi tanulásban a szóródás csökkentésének képessége, amely segít megelőzni a túltanulást. Azáltal, hogy több modellt tanítunk az adatok különböző részhalmazain, a bagging biztosítja, hogy a modell nem válik túlzottan érzékennyé a tanítási adatok ingadozásaira, így egy általánosíthatóbb és stabilabb modellt kapunk.

- Jól működik magas szóródású modellekkel: A bagging különösen hatékony magas szóródású modellekre alkalmazva, például döntési fákra. Ezek a modellek általában túltanulnak és magas szóródásúak, de a bagging ezt enyhíti azáltal, hogy több modell előrejelzéseit átlagolja vagy szavaztatja. Ez megbízhatóbb előrejelzéseket és kevésbé zajérzékeny viselkedést eredményez.

- Javítja a modell stabilitását és teljesítményét: Azáltal, hogy több, az adatok különböző részhalmazain tanított modellt kombinál, a bagging gyakran jobb általános teljesítményt nyújt. Javítja az előrejelzési pontosságot és csökkenti a modell érzékenységét az adathalmazban bekövetkezett apró változásokra, így végül megbízhatóbbá teszi a modellt.

A Bagging hátrányai:

- Növeli a számítási költségeket: Mivel a bagging több modell tanítását igényli, természetesen megnövekednek a számítási költségek. Sok modell tanítása és az előrejelzésik összesítése időigényes lehet, főként nagy adathalmazok vagy összetett modellek, például döntési fák esetén.

- Nem hatékony alacsony szóródású modellekre: Bár a bagging rendkívül hatékony magas szóródású modellekre, kevés előnnyel jár alacsony szóródású modellekre, például lineáris regresszióra alkalmazva. Ezekben az esetekben az egyes modellek már alacsony hibaarányúak, így az előrejelzések összesítése keveset javít az eredményen.

- Értelmezhetőség elvesztése: Több modell kombinálásával a bagging csökkentheti a végső modell értelmezhetőségét. Például a Random Forestben a döntéshozatali folyamat több döntési fa alapján működik, ami megnehezíti egy specifikus előrejelzés mögött meghúzódó logika követését.

Mikor használjam a baggingot?

A bagging alkalmazásának helyes időzítése kulcssfontosságú a gépi tanulási projektek optimális eredményeihez. Ez a technika specifikus helyzetekben jól működik, de nem mindig a legjobb választás minden problémához.

Amikor a Modell Túltanulásra Hajlamos

A bagging egyik fő felhasználási esete, amikor a modell túltanulásra hajlamos, különösen nagy varianciájú modellek, például döntési fák esetén. Ezek a modellek jól teljesíthetnek a betanítási adatokon, de gyakran kudarcot vallanak az új, láthatatlan adatokon, mivel túl szorosan alkalmazkodnak a betanítási készlet specifikus mintáihoz.

A bagging ezt úgy küzdi le, hogy több modellt tanít be az adatok különböző részhalmazain, majd átlagolással vagy szavazással stabilabb előrejelzést hoz létre. Ez csökkenti a túltanulás valószínűségét, és a modellt jobban felkészíti az új, ismeretlen adatok kezelésére.

Amikor a Stabilitás és Pontosság Javítása a Cél

Ha a modell stabilitását és pontosságát szeretnéd javítani anélkül, hogy az értelmezhetőséget jelentősen korlátoznád, a bagging kiváló választás. A több modellből származó előrejelzések összesítése erősebbé teszi a végeredményt, amely különösen hasznos zajosságot tartalmazó adatokkal végzett feladatok esetén.

Akár osztályozási feladatokkal, akár regresszióval foglalkozol, a bagging konzisztensebb eredményeket tud biztosítani, javítva a pontosságot az hatékonyság megőrzése mellett.

Amikor Elegendő Számítási Erőforrás Áll Rendelkezésre

A bagging alkalmazásáról szóló döntésben egy másik fontos tényező a számítási erőforrások elérhetősége. Mivel a bagging több modell párhuzamos betanítását igényli, a számítási költség jelentős lehet, különösen nagy adathalmazok vagy összetett modellek esetén.

Ha hozzáférsz a szükséges számítási teljesítményhez, a bagging előnyei messze túlsúlyozzák a költségeket. Ha azonban az erőforrások korlátozottak, fontolóra veheted alternatív technikákat vagy az ensemble modellek számának csökkentését.

Amikor Nagy Varianciájú Modellekkel Dolgozol

A bagging különösen hasznos nagy varianciájú modellek esetén, amelyek érzékenyek a betanítási adatok ingadozásaira. A döntési fákat például gyakran használják baggingben, Random Forests formájában, mert teljesítménye nagyban függ a betanítási adatoktól.

Több modellt betanítva az adatok különböző részhalmazain és előrejelzéseiket kombinálva, a bagging kiegyensúlyozza a varianciát, ami egy megbízhatóbb modellhez vezet.

Amikor Robusztus Osztályozóra van Szükséged

Ha osztályozási feladatokon dolgozol és robusztus osztályozóra van szükséged, a bagging jelentősen javíthatja előrejelzéseinek stabilitását. Például egy Random Forest, amely bagging osztályozóként működik, több egyedi döntési fa eredményét összesítve pontosabb előrejelzést tud adni.

Ez a megközelítés jól működik, ha az egyedi modellek gyengék, de kombinált erejük egy erős végmodellt hoz létre.

Ráadásul, ha megfelelő platformot keresed a bagging technikák hatékony megvalósításához, az olyan eszközök, mint a Databricks és Snowflake egységes elemzési platformot biztosítanak, amely nagyon hasznos lehet nagy adathalmazok kezeléséhez és olyan ensemble metódusok, mint a bagging futtatásához.

Ha kevésbé technikai megközelítést preferálsz a gépi tanulásban, kód nélküli AI eszközök szintén lehet lehetőség. Bár nem közvetlenül a bagging-hez hasonló fejlett technikákra összpontosítanak, sok kódmentes platform lehetővé teszi a felhasználók számára, hogy ensemble tanulási módszerekkel, köztük baggingel kísérletezzenek anélkül, hogy kiterjedt kódolási ismeretre lenne szükség.

Ez lehetővé teszi, hogy kifinomultabb technikákat alkalmazz és továbbra is pontosabb előrejelzéseket érj el, miközben a modell teljesítményre összpontosítasz az alapul szolgáló kód helyett.

Végső gondolatok

A bagging a gépi tanulásban egy erőteljes technika, amely a variancia csökkentésével és a stabilitás javításával növeli a modellek teljesítményét. Több, az adatok különböző részhalmazain betanított modell előrejelzéseit összesítve a bagging pontosabb és megbízhatóbb eredményeket hoz létre. Különösen hatékony nagy varianciájú modelleknél, például döntési fáknál, ahol megakadályozza a túltanulást és biztosítja, hogy a modell jobban általánosít az ismeretlen adatokra.

Bár a baggingnek jelentős előnyei vannak, például a túltanulás csökkentése és a pontosság javítása, léteznek néhány kompromisszumok. Növeli a számítási költséget több modell betanítása miatt, és csökkenti az értelmezhetőséget. Ezen hátrányok ellenére a teljesítmény javításában rejlő képessége értékes technikává teszi az ensemble tanulásban, más módszerek, mint a boosting és stacking mellett.

Alkalmaztál már baggingot gépi tanulási projektjeidben? Mesélj az élményeidről és arról, hogy milyen eredményt értem el!