A gépi tanulás és egyik alkategóriája, a mély tanulás, jelentős számítási kapacitást igényel, amit csak az GPU tudhat biztosítani. De nem mindegyik GPU működik, ezért itt vannak a legjobb GPUek a gépi tanuláshoz, miért szükségesek, és hogyan választhatod ki a megfelelőt a projektedhez.

Miért van szükségem GPU-re a gépi tanuláshoz?

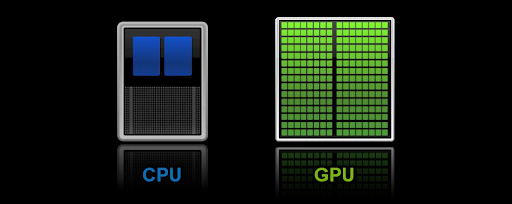

Ahogyan már említettem, a gépi tanulás sok teljesítményt igényel, amit csak az GPU tud nyújtani, és bár az CPU teljesen megfelel a kisebb alkalmazásokhoz, minden, ami nagyobb, mint az egyszálú feladatok vagy az általános célú számítás, csak frusztrációt és szűk keresztmetszeteket okoz. A számítási teljesítmény jelentős különbsége az GPU párhuzamos feldolgozási képességében és a magok számában rejlik. Egy tipikus CPU-nek 4 és 16 magja lehet, míg a legjobb GPUek a gépi tanuláshoz akár több ezer magot is tartalmazhatnak, különösen a Tensor magokat, amelyek mindegyike egy kis részt képes egyszerre feldolgozni.

Ez a párhuzamos feldolgozás az a kulcs, amely lehetővé teszi, hogy sokkal jobban kezeld a mátrix- és lineáris algebrai számításokat, mint az CPU, ezért az GPU sokkal jobb a nagy gépi tanulási modellek betanítása során. Azonban a legjobb GPUek kiválasztása a gépi tanuláshoz nem egyszerű.

Hogyan válaszd ki a legjobb GPU-t az AI-hoz és a mély tanuláshoz

Most, hogy legtöbb GPU elég erős a tipikus feladatok kezeléséhez, azonban a gépi tanulás és a mély tanulás egy másik szintű teljesítményt és minőséget igényel. Tehát a kérdés, amely marad: Mi tesz egy jó GPU-t a mély tanuláshoz?

Egy jó GPU a mély tanuláshoz a következő tulajdonságokkal és funkcióval kell rendelkeznie:

Cuda magok, Tensor magok és kompatibilitás

Az AMD és Nvidia a legjobb GPUeket nyújtja a gépi tanuláshoz és a mély tanuláshoz, az utóbbi pedig jóval előrébb van. Ez az Nvidia Tensor és CUDA magjainak köszönhető. A Tensor magok az AI-ban és a gépi tanulásban gyakori számításokat, például mátrixszorzásokat és konvolúciókat (amelyeket a mélyneurális hálózatokban használnak) kezelnek. A CUDA magok viszont lehetővé teszik a legjobb GPUeknek az AI-képzéshez, hogy párhuzamosan dolgozzanak a műveletek hatékony elosztásával az GPU között. Az GPUek ezen kettő nélkül általában küzdenek a gépi tanulás és mély tanulás terhelésével.

Ez azonban azt jelenti, hogy az AMD-nek az ROCm platform és az MI-sorozat gyorsítóihoz való közelmúltbeli frissítései javították az GPU-eit, és ezeket a listánkban látni fogod. Az Nvidia-nek azonban még mindig a legjobb GPUei vannak a mély tanuláshoz, a jól optimalizált szoftverekoszisztéma és a széles körű keretrendszer-támogatás miatt (például TensorFlow, PyTorch, JAX). A legjobb GPUek a gépi tanuláshoz nagy kompatibilitással kell rendelkezzenek ezekkel a gépi tanulási keretrendszerekkel, mivel az eltérés a gyorsítás hatékonyságában, az illesztőprogram és könyvtár támogatásában (például NVIDIA-val, cuDNN, TensorRT), valamint az általános jövőbiztos skálázhatóságban okozhat hatékonytalanságot.

Előfordulhat, hogy nem férsz hozzá az NVIDIA CUDA toolkit által biztosított összes eszközhöz, például a GPU-gyorsított könyvtárakhoz, a C és C++ fordítóhoz és futtatási környezethez, valamint az optimalizálási és hibakeresési eszközökhöz.

VRAM (Videó RAM), memória szabvány és memória sávszélesség

Mint minden számítógépes dologban, a memória is fontos, és ugyanez igaz a gépi tanuláshoz és mély tanuláshoz szükséges legjobb GPU-kra. Mivel a gépi tanulási modellek tanítási adathalmazai nagyon nagyok lehetnek (mély tanulásnál akár több TB-ig), a legjobb gépi tanulási GPU-knak bőséges memóriára van szükségük a gyors hozzáféréshez. Ez azért van, mert a mély tanulási modellek jelentős memóriát igényelnek a súlyok, aktivációk és egyéb köztes adatok tárolásához az edzés és az inferencia során. Az AI-edzéshez szükséges legjobb GPU-knak megfelelő memória-sávszélességgel is rendelkezniük kell, hogy könnyen kezelhess nagy adathalmazokat és felgyorsíthasd a számításokat.

Végül a memória szabvány is fontos tényező a legjobb mély tanulási GPU-k kiválasztásakor. A GPU-k általában GDDR (Graphics Double Data Rate) vagy HBM (High Bandwidth Memory) memóriával rendelkeznek. Bár a GDDR memóriák nagy sávszélességet kínálnak a gépi tanuláshoz és a játékokhoz, a legjobb gépi tanulási GPU-k HBM-et használnak, amelyek jóval nagyobb sávszélességgel és jobb hatékonysággal rendelkeznek.

| GPU típusa | VRAM kapacitása | Memória sávszélesség | Memória Standard | Legjobb a következőhöz |

| Alapszintű (pl. RTX 3060, RTX 4060) | 8GB – 12GB | ~200-300 GB/s | GDDR6 | Kis modellek, képosztályozás, hobbiprojektek |

| Közepes kategória (pl. RTX 3090, RTX 4090) | 24GB | ~1000 GB/s | GDDR6X | Nagy adathalmazok, mély neurális hálózatok, transzformerek |

| Csúcskategóriás AI GPU-k (pl. H100, H200, L40S, A100, MI300X) | 40GB – 80GB | ~1600+ GB/s | HBM2 | Nagy nyelvi modellek (LLM-ek), AI kutatás, vállalati szintű gépi tanulás |

| Extra csúcskategóriás GPU-k (pl. H100, L40S, A100, Instinct MI300X) | 80GB – 256GB | ~2000+ GB/s | HBM3 | Nagyszabású AI-edzés, szuperszámítógépes alkalmazások, kutatás hatalmas adathalmazokkal |

Azoknak, akik kifejezetten a nagy nyelvi modelleken dolgoznak, mint a ChatGPT, a Cloudzy kínál ChatGPT-optimalizált kiszolgáló megoldás a sima finomhangoláshoz és inferenciához szükséges teljesítménnyel.

TFLOPS (Teraflops) és lebegőpontos precizió

Természetesen a GPU teljesítménye a feldolgozási kapacitásának függvénye. Ez három tényezőtől függ: TFLOPS, memória-sávszélesség és lebegőpontos pontosság. A memória-sávszélességet már tárgyaltuk az AI-edzéshez szükséges legjobb GPU-k kapcsán; itt láthatod, mit jelentenek a másik kettő és miért fontosak. A TFLOPS (teraflops) az a mértékegység, amely azt méri, hogy egy GPU milyen gyorsan végez összetett számításokat. Tehát ahelyett, hogy egy processzor órajel-sebességét mérnénk (hány ciklust végez el másodpercenként), a TFLOPS azt méri, hány billió lebegőpontos operációt tud egy GPU másodpercenként végrehajtani. Egyszerűen szólva, a TFLOPS azt mutatja meg, milyen erős egy GPU a matematikai igénybevételű feladatokhoz.

A lebegőpontos pontosság viszont, ahogy a neve is mutatja, azt jelzi, milyen pontossággal tudja a GPU a modellt fenntartani. A legjobb mély tanulási GPU-k magasabb pontosságot (pl. FP32) használnak, amely pontosabb számításokat biztosít, de teljesítménybeli költséggel. Az alacsonyabb pontosság (pl. FP16) gyorsítja a feldolgozást enyhén csökkent pontossággal, amely az AI és a mély tanulási feladatokhoz gyakran elfogadható.

Kezdj el blogolni

Kezdj el blogolni

Üzemeljen WordPress-t csúcsminőségű hardveren, NVMe tárolóval és minimális késleltetéssel a világ különböző pontjain, válassza ki kedvenc disztribúcióját.

Szerezzen be WordPress VPS| Pontosság | Használati eset | Alkalmazási Példák |

| FP32 (Egyszeres pontosság) | Mély tanulási modellek edzése | Képfelismerés (ResNet, VGG) |

| TF32 (TensorFloat-32) | Vegyes pontosságú edzés | NLP, ajánlórendszerek |

| FP16 (Fél pontosság) | Gyors következtetés | Autonóm vezetés, beszédfelismerés, AI videójavítás |

Ahelyett, hogy nagyobb befektetést tennél fizikai hardverbe, azonnal hozzáférhetsz a Cloudzy mély tanulási GPU szerveréhez, amelyet RTX 4090-es GPU-k hajtanak meg, és gépi tanulási és mély tanulási feladatokra optimalizáltak.

Legjobb GPUek a gépi tanuláshoz 2025-ben

Most már tudod, mire figyelj a gépi tanuláshoz szükséges legjobb GPU-k kiválasztásakor. Íme a legjobb modellek rangsorolva teljesítmény, memóriasávszélesség, memória kapacitás és egyéb tényezők alapján.

| GPU | VRAM | Memória sávszélesség | Memória Standard | TFLOPS | Lebegőpontos pontosság | Kompatibilitas |

| NVIDIA H100 NVL | 188 GB | 7.8 TB/s | HBM3 | 3,958 | FP64, FP32, FP16 | CUDA, TensorFlow |

| NVIDIA Hopper Tensor Core | 80 GB | 2 TB/s | HBM2 | 1,979 | FP64, FP32, FP16 | CUDA, cuDNN, cuBLAS |

| NVIDIA RTX 4090 | 24 GB | 1.008 TB/s | GDDR6X | 82.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA Blackwell Tensor Core | 48 GB | 768 GB/s | GDDR6 | 40 | FP64, FP32, FP16 | CUDA, cuDNN, cuBLAS |

| NVIDIA GeForce RTX 4070 | 12 GB | 504 GB/s | GDDR6X | 35.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX 3090 Ti | 24 GB | 1.008 TB/s | GDDR6X | 40 | FP64, FP32, FP16 | CUDA, cuDNN, cuBLAS |

| AMD Radeon Instinct MI300 | 128 GB | 1.6 TB/s | HBM3 | 60 | FP64, FP32, FP16 | ROCm, TensorFlow |

NVIDIA H100 NVL

A legjobb gépi tanulási GPU, az NVIDIA H200 NVL kivételes teljesítményt nyújt a nagy léptékű mély tanuláshoz, a több-felhasználós, nagy teljesítményű feladatokra optimalizálva.

- Legjobb ehhez: Csúcstechnológiájú AI kutatás, nagymértékű modellek tanítása és inferencia.

- Hátrány: Nagyon drága, elsősorban vállalati vagy kutatási környezetekhez.

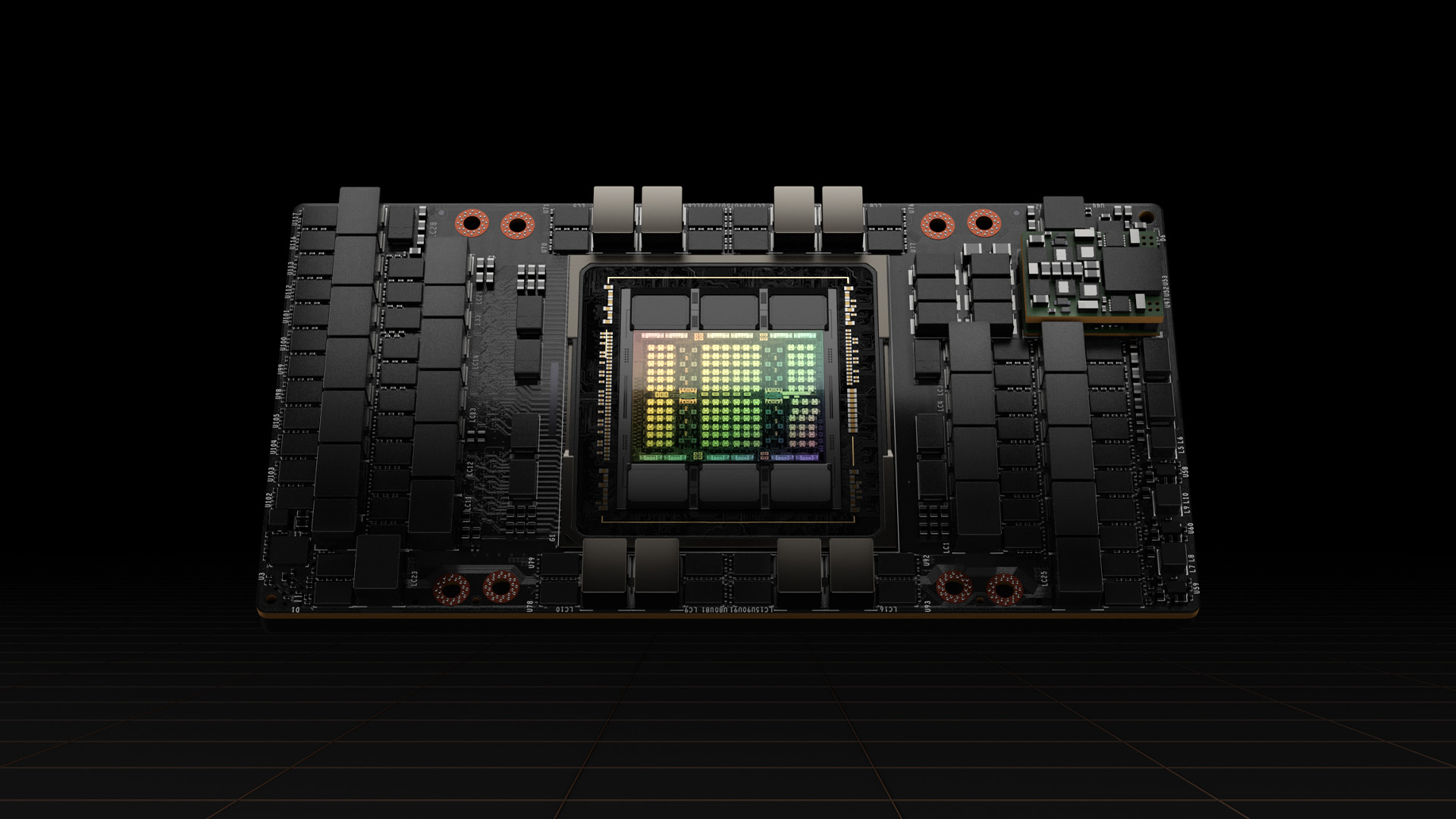

NVIDIA A100 Tensor Core GPU

Az H100 hatalmas teljesítményt biztosít neurális hálózatoknak 80 GB nagy sávszélességű memóriával (HBM2), nehéz feladatokhoz ideális.

- Legjobb ehhez: Nagy méretű gépi tanulási modellek, AI kutatás és felhő alapú alkalmazások.

- Hátrány: Drága, főként vállalatok számára.

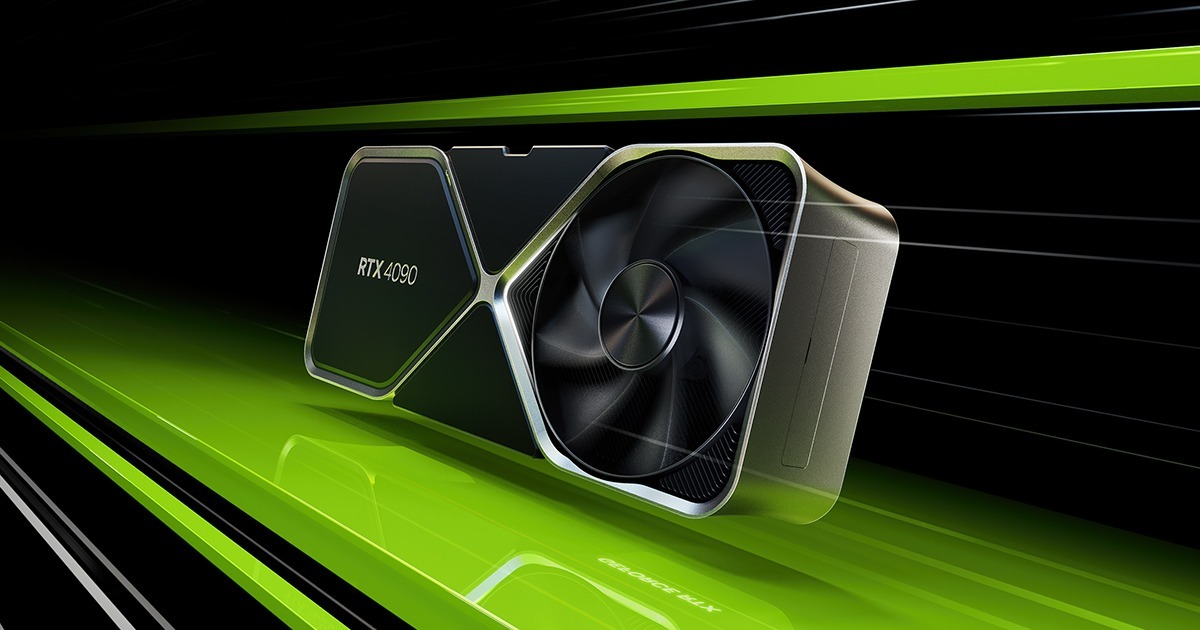

NVIDIA RTX 4090

Kiváló játékokhoz és AI feladatokhoz, 24 GB GDDR6X memóriával és hatalmas párhuzamos számítási kapacitással.

- Legjobb ehhez: Felső szintű gépi tanulási feladatok és szélsőséges számítási teljesítményt igénylő AI kutatás.

- Hátrány: Nagy energiafogyasztás, magas költség és nagy méret.

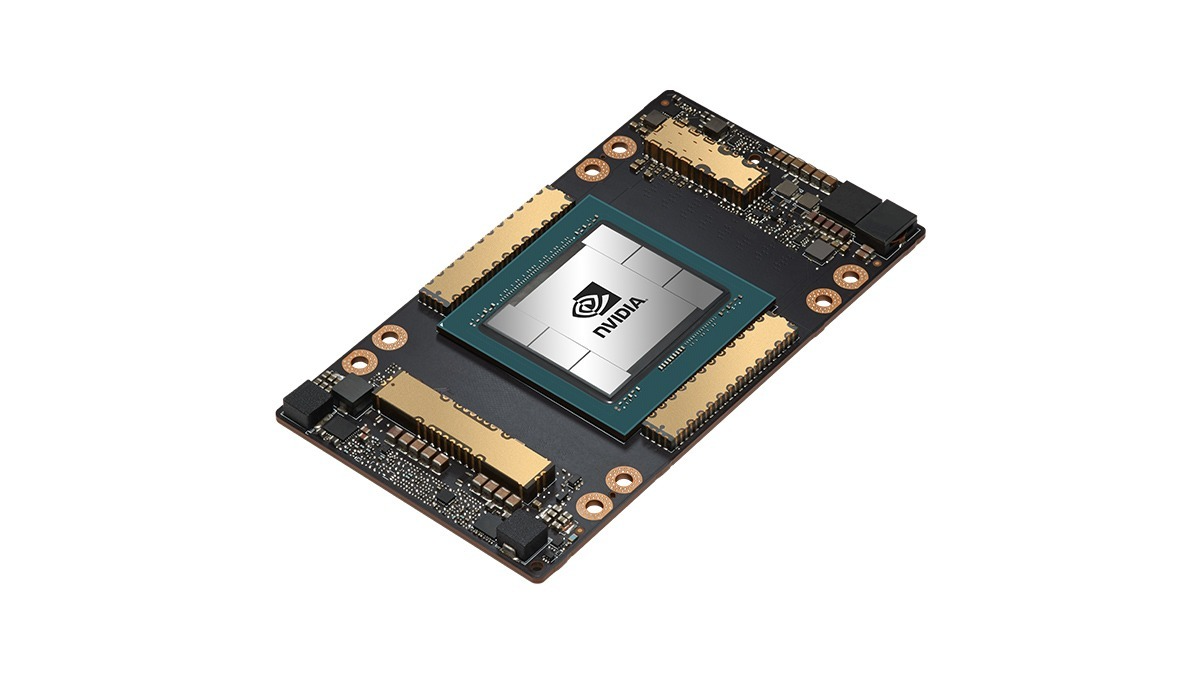

NVIDIA RTX A6000 Tensor Core GPU

AI alkalmazásokat támogat 48 GB GDDR6 memóriával, munkaállomások és professzionális felhasználók számára ideális.

- Legjobb ehhez: AI kutatás, mély tanulás és nagy teljesítményű feladatok.

- Hátrány: Magas költség, jellemzően professzionális környezetekhez.

NVIDIA GeForce RTX 4070

Jó egyensúly az ár és teljesítmény között erős ray-tracing képességgel, 12 GB GDDR6X memóriával.

- Legjobb ehhez: Lelkes felhasználók és kisebb vállalkozások közepes szintű gépi tanulási igényekhez.

- Hátrány: Korlátozott memória kapacitás nagyobb adathalmazokhoz és nagyon nagy modelleknél.

NVIDIA RTX 3090 Ti

NVIDIA RTX 3090 Ti – Nagy memóriakapacitás (24 GB GDDR6X) és számítási teljesítmény, ideális közepes és nagyobb modellek betanításához.

- Legjobb ehhez: Kutató- és hobbi felhasználók, akiknek erőteljes AI feldolgozásra van szükségük.

- Hátrány: Nagyon költséges, nagy áramfogyasztás, és kisebb projektekhez gyakran túlméretezett.

AMD Radeon Instinct MI300

Kiváló AI és HPC számítási feladatokhoz, versenyképes teljesítménnyel.

- Legjobb ehhez: Machine learning feladatok AMD-alapú infrastruktúrákhoz.

- Hátrány: Az NVIDIA-hoz képest kevésbé elterjedt a deep learningben, kevesebb keretrendszer támogatása.

Cloudzy felhő GPU VPS

Az RTX 4090 kétségkívül az egyik legjobb GPU a machine learninghez, de drága, megemeli az elektromosság-számlát, és a mérete miatt új számítógépházat kell venni vagy felújítani az alkatrészeket. Ez fej fejleszt, ezért kínálunk az Cloudzy-nél online GPU megoldást a machine learninghez, hogy ne kelljen ezekkel az ügyekkel foglalkozned. Az GPU VPS akár 2 Nvidia RTX 4090 GPU-vel, 4 TB NVMe SSD tárolóval, 25 TB/s sávszélességgel és 48 vCPU-vel felszerelt!

Mindez megfizethető áron, órás és havi elszámolás alapján, valamint számos fizetési lehetőséggel: PayPal, Alipay, hitelkártya (Stripe-on keresztül), PerfectMoney, Bitcoin és egyéb kriptovaluták.

Ha végül elégedetlen lennél a szolgáltatásunkkal, 14 napos pénzvisszafizetési garanciát kínálunk!

Az Augmented Reality (AR) felhő-alapú platformok nagymértékben függenek nagy teljesítményű GPU-ektől a valós idejű, magával ragadó élmények nyújtásához. A CUDA és Tensor magokkal rendelkező GPU-ek ugyanúgy elengedhetetlenek a deep learning modellek betanításához, mint a komplex AR-környezetek megjelenítéséhez és az AI-alapú funkciók – mint az objektumfelismerés és térbeli leképezés – támogatásához. Az Cloudzy-nél az AR Cloud a legmodernebb GPU technológiát használják a gyors működés, alacsony késleltetés és skálázhatóság biztosítására, ideális az AR-alkalmazások nagyméretű telepítéséhez.

Akár AI-alkalmazásokat fejlesztesz, modelleket tanítsál vagy kutatást végzel, az AI VPS megoldások a legjobb GPU teljesítményt nyújtja töredék áron.

Végső gondolatok

A növekvő számítási teljesítmény-igény és az egyre nagyobb, összetettebb AI-modellek miatt a GPU-ek biztosan szerves részét képezik majd az életünknek. Célszerű azért tanulmányozni őket, megérteni működésüket és hogy mik is valójában.

Ezért határozottan ajánlom, hogy nézd meg Tim Dettmerscikkét, amely mindent bemutat, amit tudnod kell a GPU-ekről, és praktikus tanácsokat ad a kiválasztásukhoz. Tudományos téren elismert és mély tanulásban jártas.