Machine learning dan subkategorinya, deep learning, membutuhkan daya komputasi yang sangat besar — dan hanya GPU yang bisa memenuhinya. Tapi tidak semua GPU cocok untuk keperluan ini. Berikut adalah GPU terbaik untuk machine learning, alasan mengapa mereka dibutuhkan, dan cara memilih yang tepat untuk proyekmu.

Mengapa Saya Membutuhkan GPU untuk Machine Learning?

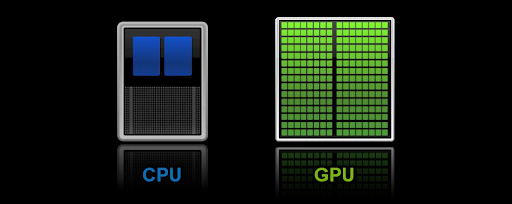

Seperti yang telah disebutkan, machine learning membutuhkan daya komputasi besar yang hanya bisa disediakan oleh GPU. CPU masih bisa digunakan untuk aplikasi berskala kecil, tetapi untuk tugas yang lebih berat dari pemrosesan single-thread atau komputasi umum, CPU akan menjadi bottleneck. Perbedaan utamanya terletak pada kemampuan pemrosesan paralel GPU dan jumlah core yang jauh lebih banyak. CPU biasa mungkin memiliki 4 hingga 16 core, sedangkan GPU terbaik untuk machine learning bisa memiliki ribuan core — khususnya tensor core — yang masing-masing mampu menangani sebagian kecil komputasi secara bersamaan.

Pemrosesan paralel inilah yang menjadi kunci dalam menangani kalkulasi matriks dan aljabar linear jauh lebih baik dibanding CPU. Itulah mengapa GPU jauh lebih unggul untuk tugas seperti melatih model machine learning berukuran besar. Namun, memilih GPU terbaik untuk machine learning bukan hal yang mudah.

Cara Memilih GPU Terbaik untuk AI dan Deep Learning

Kebanyakan GPU sudah cukup kuat untuk tugas-tugas umum. Tapi machine learning dan deep learning menuntut level daya dan kualitas yang berbeda. Pertanyaannya: apa yang membuat sebuah GPU benar-benar cocok untuk deep learning?

GPU yang baik untuk deep learning harus memiliki kualitas dan fitur berikut:

CUDA Core, Tensor Core, dan Kompatibilitas

AMD dan Nvidia menawarkan GPU terbaik untuk machine learning dan DL, dengan yang terakhir unggul cukup jauh. Ini berkat Tensor core dan CUDA core milik Nvidia. Tensor core menangani perhitungan yang umum dalam AI dan machine learning, seperti perkalian matriks dan konvolusi (yang digunakan dalam deep neural network). CUDA core, di sisi lain, memungkinkan GPU terbaik untuk pelatihan AI melakukan pemrosesan paralel dengan mendistribusikan operasi secara efisien ke seluruh GPU. GPU yang tidak memiliki keduanya biasanya kesulitan menangani beban kerja ML dan DL.

Meski begitu, peningkatan terbaru AMD pada platform ROCm dan akselerator seri MI telah meningkatkan kemampuan GPU-nya, dan Anda akan menemukannya di daftar kami. Namun, GPU dari Nvidia tetap menjadi pilihan terbaik untuk deep learning berkat ekosistem perangkat lunaknya yang teroptimasi dan dukungan framework yang luas (misalnya, TensorFlow, PyTorch, JAX). GPU terbaik untuk machine learning harus memiliki kompatibilitas tinggi dengan framework ML tersebut, karena ketidakcocokan dapat menyebabkan inefisiensi dalam akselerasi, dukungan driver dan library (misalnya, cuDNN dan TensorRT dari NVIDIA), serta skalabilitas jangka panjang secara keseluruhan.

Anda juga mungkin tidak mendapat akses penuh ke berbagai alat dalam toolkit NVIDIA CUDA, seperti library yang diakselerasi GPU, compiler dan runtime C dan C++, serta alat optimasi dan debugging.

VRAM (Video RAM), Standar Memori, dan Bandwidth Memori

Seperti halnya segala sesuatu yang berkaitan dengan komputer, RAM memegang peranan penting, dan hal ini berlaku pula untuk GPU terbaik dalam machine learning dan DL. Karena dataset untuk melatih model machine learning bisa sangat besar (hingga beberapa TB untuk deep learning), GPU terbaik untuk machine learning perlu memiliki VRAM yang memadai agar akses data tetap cepat. Ini karena model deep learning membutuhkan memori yang besar untuk menyimpan bobot, aktivasi, dan data perantara lainnya selama proses pelatihan dan inferensi. GPU terbaik untuk pelatihan AI juga harus memiliki bandwidth memori yang memadai agar dataset besar dapat dipindahkan dengan cepat dan komputasi dapat dipercepat.

Terakhir, standar memori merupakan faktor penting dalam memilih GPU terbaik untuk deep learning. GPU umumnya menggunakan GDDR (Graphics Double Data Rate) atau HBM (High Bandwidth Memory). Meskipun memori GDDR menawarkan bandwidth tinggi untuk keperluan seperti machine learning dan gaming, GPU terbaik untuk machine learning menggunakan HBM yang memiliki bandwidth jauh lebih tinggi dengan efisiensi yang lebih baik.

| Jenis GPU | Kapasitas VRAM | Bandwidth Memori | Memori Standar | Terbaik Untuk |

| Entry-level (misalnya, RTX 3060, RTX 4060) | 8GB – 12GB | ~200-300 GB/s | GDDR6 | Model kecil, klasifikasi gambar, proyek hobi |

| Mid-range (misalnya, RTX 3090, RTX 4090) | 24GB | ~1.000 GB/s | GDDR6X | Dataset besar, deep neural network, transformer |

| GPU AI kelas atas (misalnya, Nvidia A100, H100, AMD MI300X) | 40GB – 80GB | ~1.600+ GB/s | HBM2 | Large language model (LLM), riset AI, ML skala enterprise |

| GPU super high-end (misalnya, Nvidia H100, AMD Instinct MI300X) | 80GB – 256GB | ~2.000+ GB/dtk | HBM3 | Pelatihan AI skala besar, superkomputing, riset pada dataset masif |

Bagi Anda yang khusus mengerjakan large language model seperti ChatGPT, Cloudzy menawarkan VPS yang dioptimalkan untuk ChatGPT solusi dengan kapasitas yang dibutuhkan untuk fine-tuning dan inferensi yang lancar.

TFLOPS (Teraflops) dan Presisi Floating Point

Secara alami, performa GPU diukur dari kekuatan pemrosesannya. Ini bergantung pada tiga faktor: TFLOPS, bandwidth memori, dan floating-point precision. Bandwidth memori sudah kita bahas sebelumnya dalam konteks GPU terbaik untuk pelatihan AI. Berikut penjelasan dua faktor lainnya dan mengapa keduanya penting. TFLOPS, atau teraflops, adalah satuan yang mengukur seberapa cepat GPU menangani perhitungan kompleks. Alih-alih mengukur kecepatan clock prosesor (berapa banyak siklus yang diselesaikan per detik), TFLOPS mengukur berapa triliun operasi floating-point yang dapat dilakukan GPU per detik. Singkatnya, TFLOPS menunjukkan seberapa kuat sebuah GPU dalam menangani tugas yang berat secara matematis.

Sementara itu, floating-point precision, sesuai namanya, menunjukkan tingkat akurasi yang dapat dipertahankan model melalui GPU. GPU terbaik untuk deep learning menggunakan presisi lebih tinggi (misalnya, FP32), yang memberikan perhitungan lebih akurat namun dengan konsekuensi performa. Presisi lebih rendah (misalnya, FP16) mempercepat pemrosesan dengan sedikit pengurangan akurasi, yang umumnya masih dapat diterima untuk tugas AI dan deep learning.

Mulai Blogging

Mulai Blogging

Host WordPress Anda sendiri di atas hardware terbaik dengan storage NVMe dan latensi rendah di seluruh dunia. Pilih distro favorit Anda.

Dapatkan WordPress VPS| Presisi | Kasus Penggunaan | Contoh Aplikasi |

| FP32 (Presisi Tunggal) | Pelatihan model deep learning | Pengenalan gambar (ResNet, VGG) |

| TF32 (TensorFloat-32) | Pelatihan mixed-precision | NLP, sistem rekomendasi |

| FP16 (Presisi Setengah) | Inferensi cepat | Kendaraan otonom, pengenalan suara, peningkatan video berbasis AI |

Daripada berinvestasi besar pada perangkat keras fisik, Anda dapat langsung mengakses Deep Learning GPU VPS dari Cloudzy, ditenagai oleh RTX 4090, dioptimalkan untuk beban kerja machine learning dan deep learning.

GPU Terbaik untuk Machine Learning di 2025

Setelah memahami apa saja yang harus dimiliki GPU terbaik untuk machine learning, berikut daftar GPU terbaik yang kami rangking berdasarkan performa puncak, bandwidth memori, VRAM, dan lainnya.

| GPU | VRAM | Bandwidth Memori | Memori Standar | TFLOPS | Presisi Floating Point | Kompatibilitas |

| NVIDIA H100 NVL | 188 GB | 7.8 TB/s | HBM3 | 3,958 | FP64, FP32, FP16 | CUDA, TensorFlow |

| NVIDIA A100 Tensor Core | 80 GB | 2 TB/s | HBM2 | 1,979 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| NVIDIA RTX 4090 | 24 GB | 1.008 TB/s | GDDR6X | 82.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX A6000 Tensor Core | 48 GB | 768 GB/s | GDDR6 | 40 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| NVIDIA GeForce RTX 4070 | 12 GB | 504 GB/s | GDDR6X | 35.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX 3090 Ti | 24 GB | 1.008 TB/s | GDDR6X | 40 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| AMD Radeon Instinct MI300 | 128 GB | 1.6 TB/s | HBM3 | 60 | FP64, FP32, FP16 | ROCm, TensorFlow |

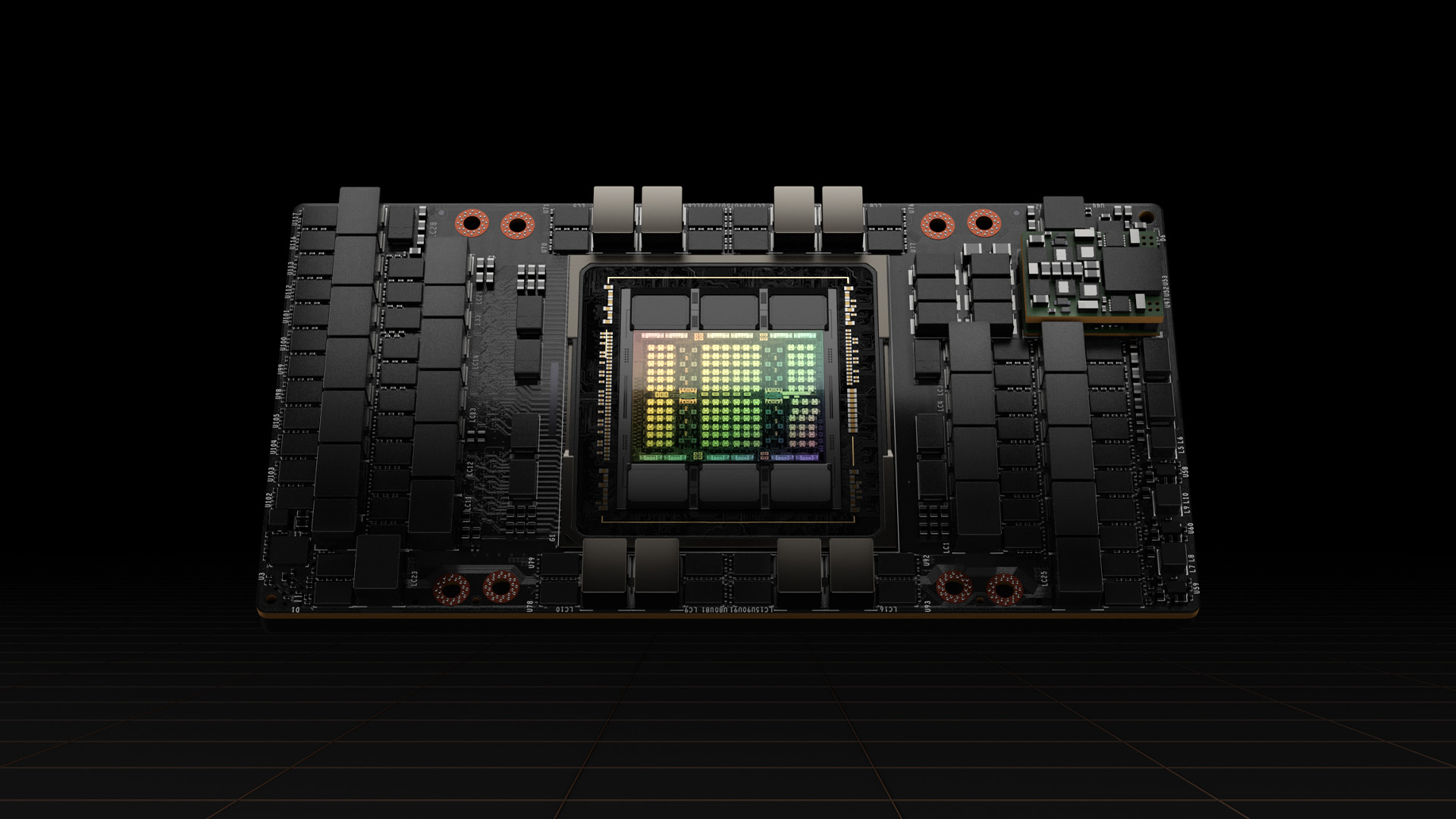

NVIDIA H100 NVL

GPU machine learning terbaik, H100 NVL, menawarkan performa luar biasa untuk deep learning dalam skala besar, dioptimalkan untuk beban kerja multi-tenant berperforma tinggi.

- Terbaik Untuk: Riset AI skala besar, pelatihan model besar, dan inferensi.

- Kekurangan: Harga sangat mahal dan terutama cocok untuk lingkungan enterprise atau riset.

NVIDIA A100 GPU Inti Tensor

A100 menghadirkan performa besar untuk jaringan neural dengan 80 GB memori high-bandwidth (HBM2), cocok untuk beban kerja berat.

- Terbaik Untuk: Model machine learning skala besar, riset AI, dan aplikasi berbasis cloud.

- Kekurangan: Harga mahal, umumnya ditujukan untuk enterprise.

NVIDIA RTX 4090

Unggul untuk gaming maupun beban kerja AI, dilengkapi 24 GB memori GDDR6X dan kapabilitas komputasi paralel yang besar.

- Terbaik Untuk: Tugas ML tingkat tinggi dan riset AI yang membutuhkan daya komputasi ekstrem.

- Kekurangan: Konsumsi daya besar, harga tinggi, dan ukuran fisik besar.

NVIDIA RTX A6000 GPU Tensor Core

Mendukung aplikasi AI dengan 48 GB memori GDDR6, sangat cocok untuk workstation dan kreator profesional.

- Terbaik Untuk: Riset AI, deep learning, dan beban kerja berperforma tinggi.

- Kekurangan: Harga tinggi, umumnya cocok untuk lingkungan profesional.

NVIDIA GeForce RTX 4070

Goimbangan harga dan performa yang solid dengan kemampuan ray-tracing yang kuat, dilengkapi 12 GB GDDR6X

- Terbaik Untuk: Pengguna hobi dan bisnis kecil dengan kebutuhan machine learning tingkat menengah.

- Kekurangan: VRAM terbatas untuk dataset besar dan model yang sangat besar.

NVIDIA RTX 3090 Ti

NVIDIA RTX 3090 TiKapasitas memori tinggi (24 GB GDDR6X) dan daya komputasi yang kuat, cocok untuk melatih model berukuran sedang hingga besar.

- Terbaik Untuk: Pengguna hobi dan aplikasi riset yang membutuhkan pemrosesan AI bertenaga tinggi.

- Kekurangan: Harganya sangat mahal, konsumsi daya besar, dan bisa berlebihan untuk proyek-proyek kecil.

AMD Radeon Instinct MI300

Cocok untuk beban kerja AI dan HPC, dengan performa yang kompetitif.

- Terbaik Untuk: Beban kerja machine learning pada pengaturan berbasis AMD.

- Kekurangan: Dukungan ekosistemnya untuk deep learning belum sekuat NVIDIA, dan framework yang didukung lebih sedikit.

Cloud GPU VPS dari Cloudzy

Salah satu GPU terbaik untuk machine learning saat ini adalah RTX 4090. Namun harganya mahal, tagihan listrik Anda akan melonjak, dan ukurannya bisa memaksa Anda mengganti casing komputer atau memodifikasi seluruh komponen. Sangat merepotkan. Itulah mengapa Cloudzy kini menyediakan GPU online untuk machine learning, sehingga Anda tidak perlu khawatir soal semua itu. Layanan kami GPU VPS dilengkapi dengan hingga 2 GPU Nvidia RTX 4090, penyimpanan SSD NVMe sebesar 4 TB, bandwidth 25 TB per detik, dan 48 vCPU!

Semuanya dengan harga terjangkau, tersedia penagihan pay-as-you-go per jam maupun per bulan, serta berbagai pilihan pembayaran seperti PayPal, Alipay, Kartu Kredit (via Stripe), PerfectMoney, Bitcoin, dan mata uang kripto lainnya.

Dan jika Anda tidak puas dengan layanan kami, kami memberikan garansi uang kembali 14 hari tanpa syarat.

Platform cloud Augmented Reality (AR) sangat bergantung pada GPU berkinerja tinggi untuk menghadirkan pengalaman imersif secara real-time. Sama seperti GPU dengan core CUDA dan Tensor yang krusial untuk melatih model deep learning, keduanya sama pentingnya untuk merender lingkungan AR yang kompleks dan mendukung fitur berbasis AI seperti pengenalan objek dan pemetaan spasial. Di Cloudzy, layanan kami AR Cloud menggunakan teknologi GPU terkini untuk memastikan performa optimal, latensi rendah, dan kemampuan penskalaan, sehingga ideal bagi bisnis yang ingin men-deploy aplikasi AR dalam skala besar.

Baik Anda sedang membangun aplikasi AI, melatih model, maupun menjalankan riset, layanan kami Solusi AI VPS dirancang untuk menghadirkan performa GPU terbaik dengan biaya yang jauh lebih hemat dari biasanya.

Pemikiran Akhir

Seiring meningkatnya kebutuhan komputasi dan semakin kompleksnya model AI, GPU pasti akan menjadi bagian penting dari keseharian kita. Karena itu, ada baiknya Anda mulai memahami cara kerja dan seluk-beluknya.

Itulah mengapa saya sangat menyarankan Anda membaca Tim Dettmerstentang semua yang perlu diketahui mengenai GPU beserta panduan praktis dalam memilih GPU yang tepat. Penulisnya memiliki latar belakang akademis yang kuat dan pengalaman mendalam di bidang deep learning.