決める場合は H100対RTX 4090 AIの場合、覚えておいて。ほとんどの「ベンチマーク」はモデルとキャッシュがVRAMに実際に収まるまで意味がない。XQNT0062ZZは単一GPUで24GB以内に収まる仕事の最適なポイント。

H100は、より大きなモデル、高い並行性、マルチユーザー分離、メモリ工作の削減が必要になったときに選ぶもの。

ワークロード別に説明して、ベンチマークの種類を示して、手持ちのスタックで実行できるテスト計画をお見せします。

簡単な答え:AIワークロード向けH100 vs XQNT0062ZZ

H100 大規模モデルの学習と本格的な運用で勝ります。大容量HBM、非常に高いメモリ帯域幅、NVLink、MIGによる分離を備えているから。 RTX 4090 「高い単一GPU速度がいい、価格も抑えたい」という場合に有利。ワークロードが24GBに収まれば、ずっと妥協せずに済みます。仕様とプラットフォーム機能を見ると判断は簡単。

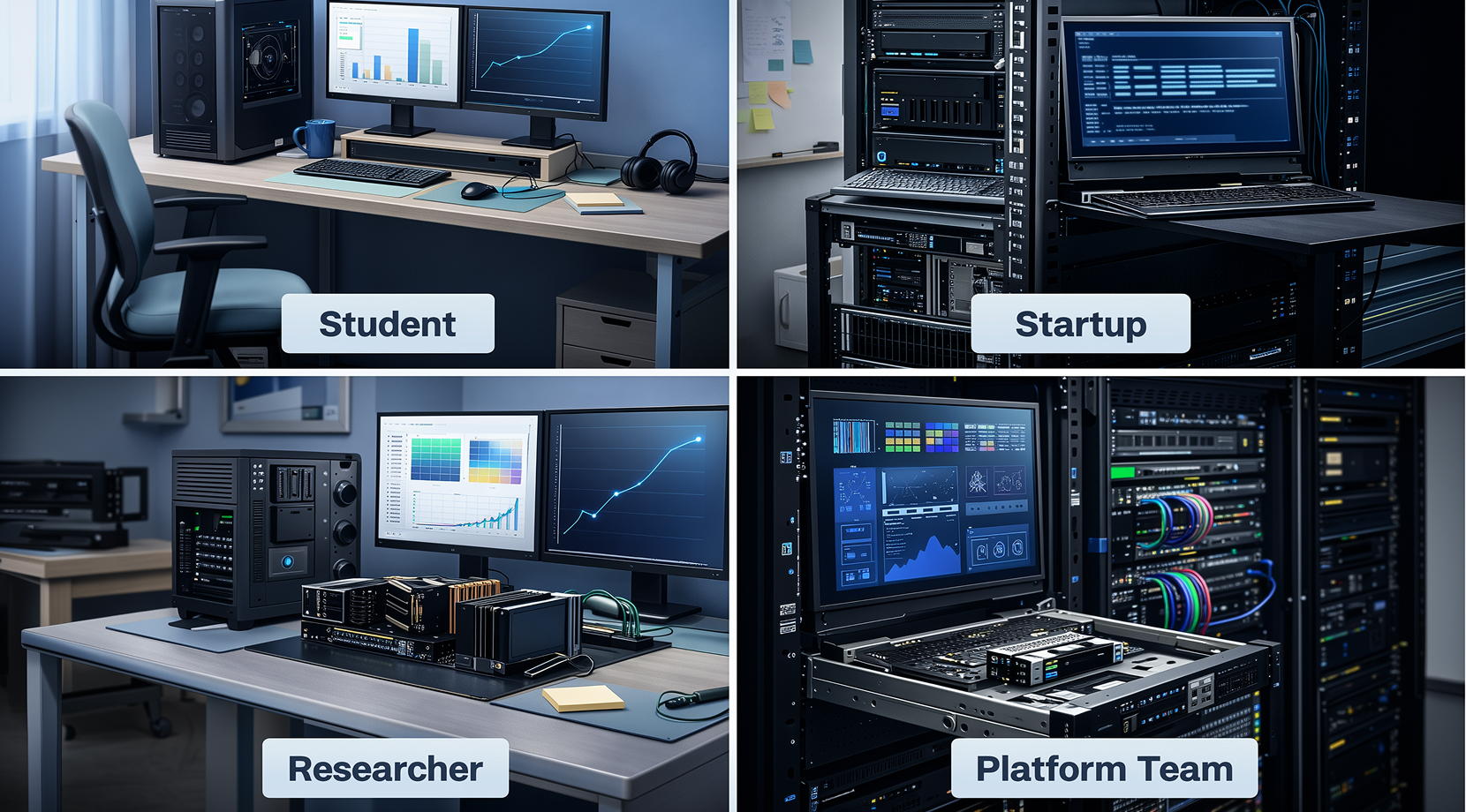

ペルソナ別のクイックピックリスト:

- ローカル開発をする人(個人開発者・学生): VRAMがボトルネックになるまでXQNT0062ZZ。

- スタートアップのMLエンジニア(MVPをリリースしている): 初期段階のサーバーと微調整ならXQNT0062ZZ、安定した並行性か大きなモデルが必要になったらH100。

- 応用研究者(実験が多い): OOM、バッチ制限、長いコンテキストに頻繁に引っかかるならH100。

- 本番環境/プラットフォームチーム(マルチテナント運用): MIGスライシング、より大きな余裕、スムーズなスケーリングに対応したH100。

こうした背景を踏まえて、この記事の以降の部分では、実運用で直面する制限と、ベンチマーク数値がそれらとどのように一致するかについて説明します。

検討すべき唯一のベンチマーク質問: VRAMに何が収まる必要があるか?

ほとんどのスレッドで H100対RTX 4090 は技術的にはVRAM関連の議論です。LLMの作業では、VRAMは 重さ, アクティベーション トレーニング中に、 オプティマイザーの状態 に消費され、 KV キャッシュ は推論時に消費されます。最後の項目が予期されにくいのは、コンテキスト長と並行数に応じて増加するためです。

以下の表は、正確な収納可否がフレームワーク、精度、オーバーヘッドに依存するため、意図的に大まかにしています。

「問題なく収まるか」という視点を以下に示します:

| ワークロード | RTX 4090(24 GB)での典型的なシングルGPUの現実 | H100(80~94 GB)での典型的なシングルGPUの現実 |

| 7B LLMの推論(FP16 / BF16) | 通常は問題ありません | 余裕のある環境 |

| 13B LLMの推論 | 多くの場合は綱渡り、コンテキストによる | 通常は問題ありません |

| 70B規模の推論 | 大幅な量子化/オフロードが必要 | はるかに現実的 |

| SD/SDXLの推論+小規模バッチ | 通常は問題ありません | 問題なく、さらに余裕あり |

| 高い並行数でのサービング | KVキャッシュの圧力がすぐに顕在化 | 余裕があり、負荷下でも安定 |

より広いGPUのショートリストが必要な場合(この2つだけではなく)、一般的なAI GPUs全体のVRAMとメモリ帯域幅をまとめた 2025年の機械学習に最適なGPU は便利なリファレンステーブルです。

ワークロードが収納できることが確認できたら、次に「スムーズ」さを左右するのはメモリ帯域幅です。

帯域幅: HBMがなぜ別格なのか

AI性能の議論の多くは計算ピークに固定されていますが、トランスフォーマーはメモリ移動に極めて敏感です。H100の強みは、大容量のHBMプールを非常に高いメモリ帯域幅と組み合わせ、さらにプラットフォーム側のNVLink帯域幅とMIGパーティショニングを備えていることです。

スペック概要

スペックシートだけではGPUを選べませんが、同じワークロードがあるカードでは楽々で、別のカードでは窮屈に感じる理由は説明されています。このスナップショットはLLMのトレーニング、推論、サービング動作に最も影響を与える要因を示しています。

| 仕様 | H100 (SXM / NVL) | RTX 4090 |

| VRAM | 80 GB / 94 GB | 24 GB |

| メモリ帯域幅 | 3.35~3.9 TB/s | GDDR6X(容量は24 GBに制限) |

| インターコネクト | NVLink + PCIe Gen5 | PCIe(コンシューマープラットフォーム) |

| マルチインスタンス | 最大7つのMIGインスタンス | 利用不可 |

スペック参照 NVIDIA H100, NVIDIA RTX 4090.

実際の運用ではこうなります:

- バッチサイズやコンテキスト長を増やそうとする場合、H100はトレードオフを余儀なくされるまで安定性を保ちやすいです。

- 複数のリクエストを同時に処理する場合、H100はより多くの「メモリ余裕」があるため、テールレイテンシの問題がすぐに顔を出しません。

- シングルユーザー、シングルモデル、控えめなコンテキスト長の作業であれば、RTX 4090は高速で満足のいく動作をします。

ただし、バンド幅は適切なベンチマークの代わりにはなりません。狭いテストでは2つのGPUが似た結果に見えても、実際の負荷では差が出てくる理由を説明するだけです。

信頼性の高いH100対RTX 4090ベンチマーク

ベンチマークはすべて同じではなく、だから「私の数字があなたの数字と一致しない」ことが絶えず起きるのです。 H100対RTX 4090の場合、ベンチマークを2つの種類に分けるとわかりやすくなります:

- 種類A(コミュニティ寄り): llama.cpp-style tokens/sec tests and simple inference scripts.

- 種類B(標準化されたスイート): 再現性のあるルールに重点を置いたMLPerf TrainingとMLPerf Inferenceスタイルの結果。

Llama.cpp風推論スナップショット

これは人々が自宅で実行してから3日間議論するタイプのテストです。多くの開発者が使う「実際のツールチェーン」を反映しているので有用ですが、フィット感と精度を無視すると誤読しやすいです。

公開されているllama.cpp風の比較 はRTX 4090が小さいモデルと量子化実行で非常に良好な結果を示す一方、より大きいモデルで高精度になるとVRAMの上限を大きく上回ることを示しています。

予想すべきパターンはこれです:

| モデル | GPU | 典型的な結果 |

| 7Bクラス | RTX 4090 | 高いトークン/秒、スムーズなシングルユーザー推論 |

| 13Bクラス | RTX 4090 | まだ良好ですが、コンテキストとオーバーヘッドが影響し始めます |

| 70Bクラス | RTX 4090 | 積極的な量子化/オフロードなしでは適切にフィットしません |

| 70Bクラス | H100 | 常に駐在させて確実にサービス提供するほうがはるかに現実的です |

このテーブルのポイントは「RTX 4090は悪い」または「H100は魔法」ではありません。VRAMの上限がメモリに常駐させられる量を決定し、それが速度、安定性、あなたが行う調整の量に影響するということです。

コンテキスト長を常に削り続けて生き残ろうとしているなら、この比較は理論的なものではなくなります。

MLPerfが従来型ベンチマークにもたらすもの

MLPerfが存在するのは、数千ドルの決定を前にして「適当なスクリプトと雰囲気」では通用しないからです。MLCommonsは より新しい生成AI系のワークロード を段階的に追加してきました。MLPerfは、異なるシステム間で結果をより比較しやすくするために設計されています。

トレーニング側では、 NVIDIAのMLPerf Training v5.1の報告書 は、ベンダーが学習完了時間をどのように報告するかの好例です。投入環境とベンチマークルールの詳細が記載されています。

このテストだけでは、プライベートなプロンプトの挙動は分かりませんが、システムレベルのスケーリングと「このクラスのハードウェアがルール下でどう動作するか」の妥当性チェックになります。

次に、購入判断に最も影響する部分、つまり作業完了までにかかる時間と費用について話しましょう。

コスト、時間、そして機会費用

たくさんの H100対RTX 4090 購入判断は「購入価格対レンタル価格」で説明されることが多いです。でも実際には、そうではありません。本当に重要なのは、実際に使えるモデルを完成させるまでに何時間かかるか、そして制約と戦うのに何時間を無駄にするかです。

3つのよくあるシナリオで、トレードオフは明確になります。

小〜中規模モデルの週次ファインチューニング

実行が24GB内に収まり、無理な調整なしで済むなら、4090の道は素晴らしく見えます。高速に反復できて、クラスタ時間をスケジュール管理する必要もなく、セットアップもシンプルです。しかし、毎回「バッチサイズを下げる、コンテキストを削減、再試行」の繰り返しになるなら、コストは高くても、H100の方がはるかに現実的です。

実際の同時処理を伴うサービング

同時処理はKVキャッシュへの負荷を急速に高めます。ここで、H100の余裕とプラットフォーム制御の価値が活躍します。特に予測可能なレイテンシーが必要な場合はそうです。

GPUサーバーがそもそも本当にあなたのデプロイメントに合っているのか、まだ判断中なら、私たちの GPU VPS対CPU VPS 比較表はワークロードをインフラタイプにマッピングするのに役立ちます。間違ったものの最適化に時間を費やす前に確認できます。

期限のある大規模トレーニングジョブ

1人1台を超えてスケーリングするとすぐに、退屈だけど重要なこと、つまり安定した環境、障害モードの削減、いわば「面倒見」に費やす時間の短縮に集中したくなります。それがH100が設計された目的です。

ここまで読んでもまだ迷っているなら、次のステップは無限に読むことではありません。ドライバの摩擦やマルチユーザーワークロードを含めて、実際にスタックがどう動作するか見ることです。

ソフトウェアと運用:ドライバ、安定性、マルチユーザー対応、サポート

ベンチマークチャートはほぼスキップするパートですが、日常の大きな部分を占めています。

RTX 4090は多くのAIワークフローで手軽で高速だから人気があります。トレードオフは、ユースケースが大きくなるにつれて、メモリの上限やマルチテナント環境向けに作られていないスケーリングパターンにぶつかるリスクが高まることです。

H100 はクラスタ向けに設計されています。MIG はプラットフォームチームにとって重要な機能です。1つの GPU を独立したスライスに分割でき、「ノイズの多い隣人」の問題を減らし、キャパシティプランニングが大幅に簡単になります。NVIDIA の公式 H100 スペックでは、フォームファクタに応じて最大7つの MIG インスタンスをサポートしています。

個人用でローカル実行するワークロードなら、4090 で長く快適に運用できます。マルチユーザーかつカスタマーフェーシングのワークロードなら、H100 がより安全な選択肢です。

結局のところ、誰が何を買うべきか。

ワークロードに合わせて選ぶ

ため H100対RTX 4090最終的には、最大の課題を解決してくれる選択肢が正解です。

ローカル LLM ビルダー(個人開発・学生向け)

7B~13B 範囲がメイン、量子化推論を実行、RAG で実験、SDXL で作業しているなら RTX 4090 を選びましょう。メモリ制限と戦うことより実装に時間を使うようになったら、アップグレードを検討します。

スタートアップの ML エンジニア(MVP 出荷)

MVP が単一モデルで中程度のトラフィック、メモリに余裕があるなら、4090 は堅実なスタート地点です。スパイク時に安定したレイテンシが必要、より高い同時実行性、ホストあたり複数ワークロードが必要なら、H100 が無難な選択肢です。

応用研究者(多数の実験を実施)

バッチサイズを削減したり精度を調整するなど、妥協を強いられることが多いなら、H100 でより清潔な実験と失敗の削減が実現できます。

本番環境・プラットフォームチーム(マルチテナント運用)

H100 が最適な選択肢です。主な理由は MIG と余裕のあるリソースがキャパシティプランニングを簡単にし、スパイク時の影響範囲を最小化するためです。

ハードウェア購入にまだコミットしたくないなら、レンタルが次善の策です。

実用的な中間選択肢:まず GPU をレンタルしてから購入を決める

最もシンプルな決定方法 H100対RTX 4090 に実行する あなたの モデル、 あなたの プロンプト、および あなたの 両方のハードウェアクラスでコンテキスト長を確認してから、tokens/sec とロード下でのテールレイテンシを比較します。

だからこそ、私たちは構築しました Cloudzy GPU VPSGPU ボックスを1分以内に起動でき、フルルートアクセスでスタックをインストールして、他人のベンチマークに基づいた推測から抜け出せます。

弊社の GPU VPS プランでこれが得られます:

- 専用 NVIDIA GPU (RTX 4090 および A100 クラスのオプション含む)ので、結果がノイズの多い隣人の影響を受けません。

- 最大40 Gbpsのネットワーク すべての GPU プランで利用可能で、これはデータセット取得、マルチノードワークフロー、アーティファクトの高速転送に大きな差があります。

- NVMe SSD ストレージ、プラス DDR5 RAM すべてのティアで高周波数 CPU オプションを提供しているので、残りのボックスが GPU のパフォーマンスを下げることはありません。

- DDoS保護 そして 99.95%のアップタイムため、長時間のジョブがランダムなインターネット遅延で台無しになることはありません。

- 時間単位の課金 (短いベンチマークテストに便利)と 14日間返金保証 低リスクのテスト向け。

まずRTX 4090プランで同じベンチマークチェックリストを実行し、より大きなコンテキスト、高い同時実行数、大規模なモデルに対応するようになったら、A100クラスのプランで繰り返します。その後、 H100対RTX 4090 は通常、自分のログから明らかになります。

ベンチマークチェックリスト:30分で自分自身で実行する

守れる判断を下したいなら、実際に本番環境で使うスタックから4つの数字を集めてください:

- トークン/秒 目標とするコンテキスト長で

- p95レイテンシー 予想される同時実行数で

- VRAM余裕 ピーク負荷時に

- 完了した実行1回あたりのコスト 開始から成果物までの間に

vLLMを使った最小限のスモークテストは以下のようになります:

pip install vllm transformers accelerate

python -m vllm.entrypoints.api_server \

--model meta-llama/Llama-3-8B-Instruct \

--dtype float16 \

--max-model-len 8192実際に何をレンタルしているのかを明確に理解したいなら、以下の記事をご覧ください: GPU VPS とは? 専用のGPUアクセス、vGPUの共有、プランを選ぶ前にチェックすべき項目の違いについて説明しています。