メモリ不足エラーを回避するために新しい GPU を購入する予定の場合、5070 Ti 対 5080 は間違った議論です。両方のカードは 16GB の VRAM を搭載しており、その容量制限はほとんどの人が予想するよりも早くディープラーニングで表示されます。

5080は高速ですが、実際には意味のある規模が大きいモデルを実行させることはほぼありません。現実には、バッチサイズを縮小したり、コンテキスト長を短くしたり、システムRAMにオフロードしたりして、とにかく実行を続けるしかありません。

だから、このレポートは5070 TiとVRAM制限に悩まされ続けることなくモデルの学習、ファインチューン、またはデプロイを目指す人向けに、5070 Ti対5080の現実的で役に立つ比較と選択肢を提示しています。

ここだけは目を通してください:スペック情報と「容量対スピード」セクション。この2つを読めば、間違った製品を買うことはありません。

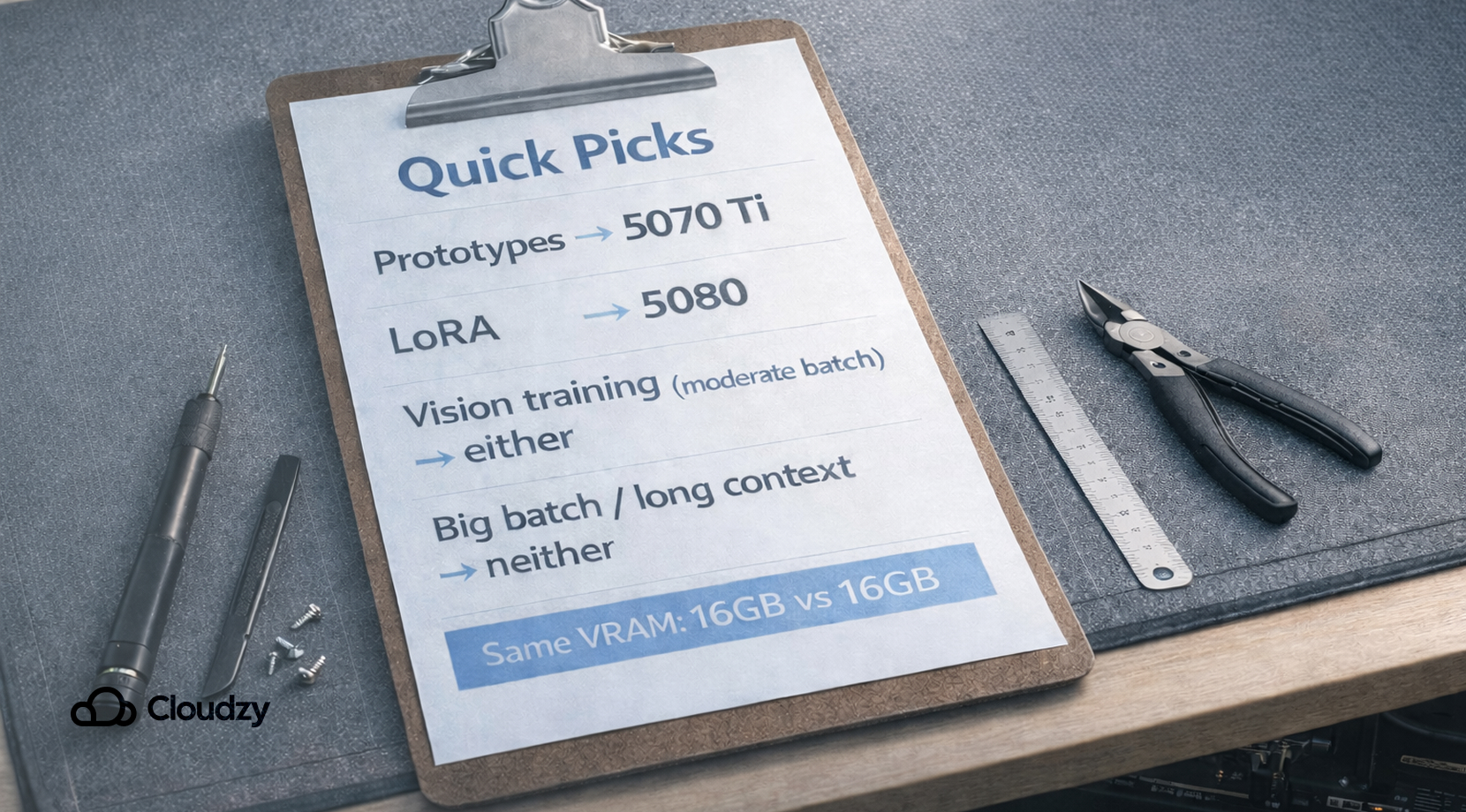

用途別クイックピック

ほとんどの人はGPUを気分で買いません。わたしたちは4つの典型的な購買層を繰り返し見かけており、5070 Ti対5080はそれぞれで判断が変わります。

ローカルLLM実験者

ノートブックを実行し、量子化設定を試し、完璧なスループットより「動けばOK」を優先するタイプです。あなたにとって5070 Ti対5080の選択は、通常は予算で決まります。両方のカードは小規模モデルと量子化推論ではどちらも快適に動き、コンテキスト長またはバッチサイズを増やすと同じVRAM上限に直面するからです。

ビジョンモデルを学習している大学院生

繰り返し可能な実験が必要で、何度もリトライしたくありません。隠れたコストはカード代ではなく、エポック3でデータローダー、前処理、モデルがメモリ競争を起こして実行が失敗する時間ロスです。

推論をデプロイするスタートアップエンジニア

テール遅延と並行処理性能を気にします。1ユーザーのデモは16GBで良好に見えます。でも本番トラフィックが来るとKVキャッシュがVRAMを徐々に圧迫します。デプロイ用途では、5070 Ti対5080の比較は、本当の課題がバッチ処理と長いプロンプト向けの容量にあるなら気になりすぎてもしかたありません。

MLもやるクリエイター

クリエイティブアプリとMLツールを行き来し、再起動、ドライバー問題、「Chromeを閉じてから学習」といったストレスを避けたいタイプです。あなたにとって5070 Ti対5080が意味あるのは、GPUがきちんとしたワークフロー全体の一部であり、マルチタスク時にすぐ不安定になるような脆い構成ではない場合だけです。

では、これらのシナリオを念頭に、ハードウェアの詳細と、重要な部分で同じボトルネックが生じる理由を見ていきましょう。

ディープラーニング向けの最優先スペック

5070 Ti対5080を理解する最速の方法は、マーケティング数字を無視して、メモリ行に注目することです。

詳細なスペック表が必要なら、ここに学習と推論の挙動に最も影響する項目に焦点を当てたテーブルがあります。(クロック速度と出力仕様は目立ちますが、実行が収まるかは決めません。)

| 仕様 (デスクトップ) | RTX 5070 Ti | RTX 5080 | なぜDLに表示されるのか |

| VRAM | 16 GB | 16 GB | 容量はウェイト、アクティベーション、KVキャッシュの絶対的な制限 |

| メモリタイプ | GDDR7 | GDDR7 | 動作は似ていますが、帯域幅は有用でも、容量が「収まる・収まらない」を決定 |

| メモリバス | 256ビット | 256ビット | 集約帯域幅に限界があり、スループットに役立つが、モデルサイズには影響なし |

| CUDA コア | 8,960 | 10,752 | コンピュート性能が高いほどトークン/秒は増えるが、「読み込めるか」には影響なし |

| 定格ボード電力 | 300 W | 360 W | 消費電力と放熱が増えるが、VRAMは増えない |

公式スペック情報: RTX 5080, RTX 5070ファミリー

基本的には5080の方が高速で、5070 Tiの方が安い。ディープラーニングでは、ワークロードがメモリに収まった後で差が目立つようになる。

次に、見た目では軽いセットアップでも、VRAMがなぜこんなに早く消費されるのかを見ていく。

VRAMがディープラーニングで急速に消費される理由

ゲームから来た人はVRAMをテクスチャプールのように考えることが多い。ディープラーニングではむしろ狭いキッチンカウンターに近い。材料を置くスペースが必要なだけでなく、切る、調理する、盛り付けるという作業を同時に行うスペースが必要だ。

実行中にVRAMに通常入っているのは以下の通り。

- モデルウェイト読み込んだパラメータ。FP16やBF16の場合もあるし、量子化されている場合もある。

- アクティベーション逆伝播のために保存した中間テンソル。訓練時のメモリ使用量の本当の原因。

- 勾配とオプティマイザの状態訓練のオーバーヘッド。メモリ需要を何倍にも増やす可能性がある。

- KV キャッシュ推論のオーバーヘッド。コンテキスト長と同時処理数に応じて増える。

これが5070 TiとVS 5080の議論が、重すぎるトレーラーを牽引しながらエンジン出力について言い合うようなものになってしまう理由だ。馬力は大きくなるかもしれないが、ヒッチの定格がボトルネックのままだ。

自社テストで使っているちょっとした確認方法は、PyTorchで割り当て済みメモリと予約済みメモリの両方をログに記録することだ。PyTorchのCUDAメモリに関するメモではキャッシュアロケータについて説明されており、なぜメモリがテンソア解放後もnvidia-smiなどのツールで「使用中」に見えるのかがわかる。

この議論の本質は、16 GBでのディープラーニング失敗のほとんどが遅いせいではなく、最悪なタイミングでOOMエラーが起きるということだ。

5070 Ti対5080で最初に限界に達するワークロード

以下は5070 Ti対5080のメモリ限界に最初にぶつかるディープラーニングパターンだ。

長いプロンプトと実際の同時処理を伴うLLM提供

単独のプロンプトが2Kトークンなら問題なく見える。長いコンテキストを追加して、バッチ処理を追加して、もう一人のユーザーを追加すると、KVキャッシュが増え始める。ここで5070 Ti対5080が同じ結果に陥り、最大コンテキストを制限するか、バッチサイズを減らして耐え凌ぐしかなくなる。

シンプルな確認方法。

- 実際の最大コンテキストとバッチでサーバーを実行する。

- 起動時だけでなく、時間経過に伴うVRAMを監視する。

- レイテンシが上昇する地点を記録してから、同じ時間枠でメモリ使用量を確認する。

プロジェクト化しない信頼性の高い監視セットアップが必要な場合は、 GPU監視ソフトウェア に関するガイドで、実際の実行に対応する実用的なCLIロギングパターンを学べます。

LoRAまたはQLoRAファインチューニング

「LoRAは16 GBで動く」と言う人は多く、それは間違っていません。落とし穴は、パイプラインの残りの部分がタダで済むと思い込むことです。トークン化バッファ、データローダーワーカー、混合精度スケーリング、検証ステップはすぐに積み重なります。

実際には、ここのボトルネックは計算力というより余裕の問題です。VRAMの余裕がなければ、実行を監視し続けることになります。

高解像度入力でのビジョンモデルトレーニング

画像モデルには厄介な失敗パターンがあります。解像度が少し上がったり、データ増強を1つ追加したりするだけで、安定から OOM に転じます。5070 Ti vs 5080 では、バッチサイズが1に縮小し、勾配蓄積がトレーニングをスローモーション化します。

1つのGPUでマルチモーダル実行

テキストエンコーダ、画像エンコーダ、融合層は問題ないかもしれません。ただし、シーケンス長を上げたり、より大きなビジョンバックボーンを追加したりすると、メモリ積み重ねが厳しくなります。

「私のGPUは大丈夫、デスクトップがダメ」

これが最も共感できるやつです。トレーニングを始めると、ブラウザ、IDE、その他実行しているものがVRAMを占有し、突然「安定した」設定が壊れます。 フォーラムのユーザー すべてを閉じたり、オーバーレイを無効にしたり、昨日実行した同じモデルでまたOOMに当たったりすることについて文句を言う。

そのパターンは頻繁に出現します 5070 Ti vs 5080のディスカッションでも、両方のカードが同じ容量制限にあるためです。これらが耳覚えがあれば、次の質問は「制限についてどうするか」です。

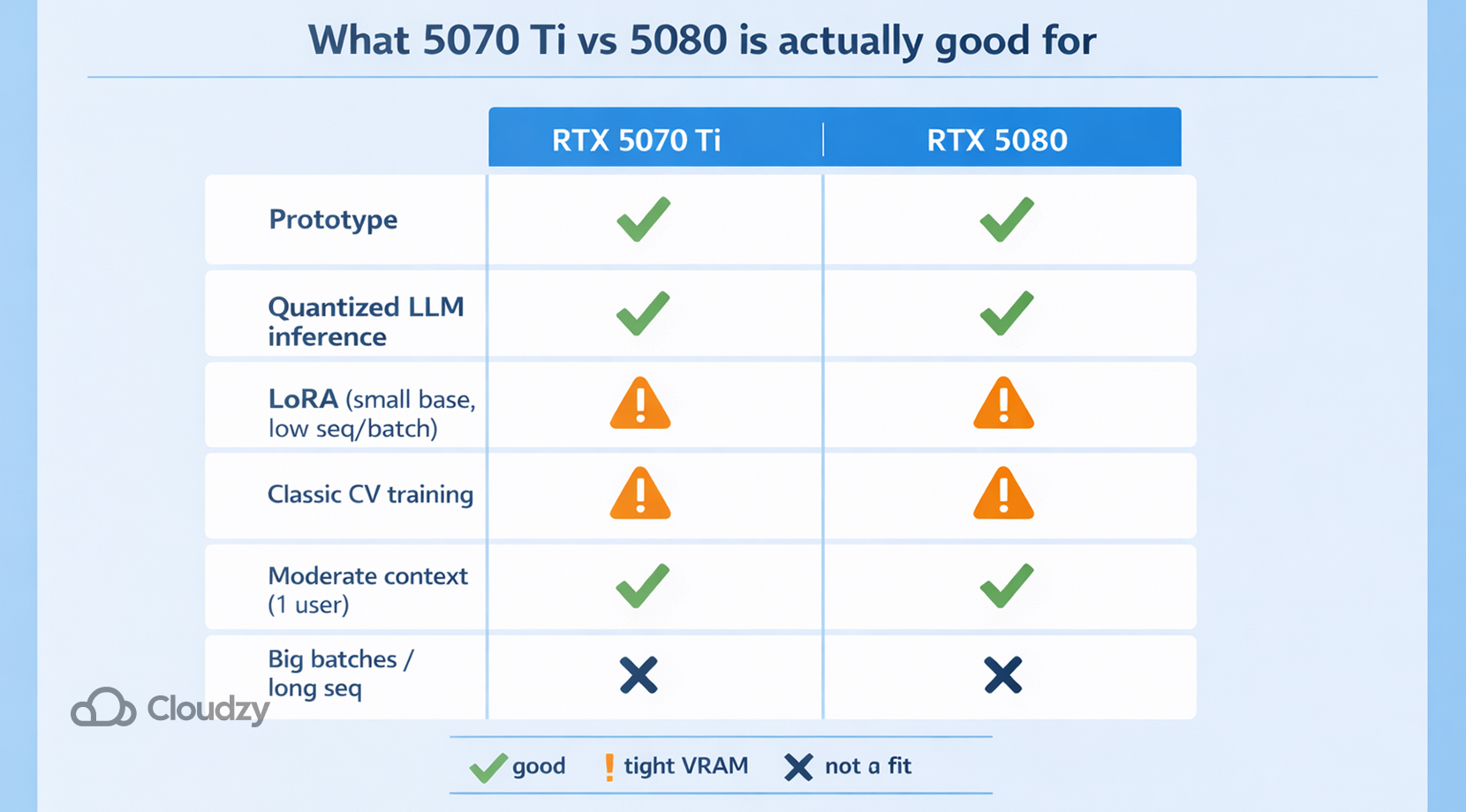

5070 Ti vs 5080 はActuallyにはGoodです

ML の世界では16 GBを貶すのは簡単ですが、それは無駄ではありません。ただ限定的です。

5070 Ti vs 5080 は完全に適切なセットアップになれます:

- プロトタイプ作業小さな実験、クイック検証、サニティチェック。

- 量子化LLM推論中程度のコンテキストを持つ小さいモデル、シングルユーザー。

- 小さいベースモデル上のLoRAシーケンス長とバッチを抑えるかぎり。

- 古典的なビジョントレーニング中程度の画像サイズ、中程度のバックボーン、辛抱強く。

要は、あなたの作業がメモリ制限内に収まっていれば、5080 は通常5070 Ti よりキビキビ感じられ、余分な計算力を楽しめます。

ただし「本格的な」深層学習をしようとした瞬間、メモリの余裕不足に当たります。では両方のカードで役立つ戦術について話しましょう。

限られたVRAMを効率よく使う。トレーニングを苦しくしない方法

これらのテクニックに魔法はない。5070 Tiと5080を長く役に立つ状態に保つための、実践的な手法の集まりだ。

まず計測から始める

ハイパーパラメータに手を加える前に、ステップごとのVRAMのピーク値を把握する。PyTorchでは max_memory_allocated() と max_memory_reserved() 実際の動作を素早く確認する方法がある。

それにより、こうした質問に答えられるようになる。

- モデル自体が主なコストか、それとも活性化か?

- VRAMは検証中にスパイクしているか?

- 断片化が時間とともに増加していないか?

ベースラインを把握すれば、後の調整がずっと明確になる。

できるだけメモリを削減する

私たちが使う単純な優先順位は

- バッチサイズを収まるまで減らす。

- 勾配累積を有効にして、有効なバッチサイズを戻す。

- スタックが対応していれば、混合精度(BF16/FP16)を有効にする。

- 活性化がボトルネックなら、勾配チェックポイントを追加する。

- その後で初めてモデルサイズをいじり始める。

コンテキスト長を予算として扱う

トランスフォーマーにおいて、コンテキスト長は最も問題を引き起こしやすい。注意計算とKVキャッシュサイズに影響する。5070 Tiと5080では、数千トークンを超えるとすぐに分かる。VRAMが急速に増加し、スループットが落ち、バッチサイズを下げざるを得なくなる。

推奨されるアプローチ:

- 余裕を持って実行できるデフォルトの最大コンテキスト長を決める。

- 「長いコンテキスト」用に別のプロフィールを作成し、バッチサイズを下げる。

- デバッグ中は両者を混ぜない。

PyTorchキャッシュと本当のメモリリークを混同しない

「メモリリーク」という報告の多くは、実はアロケータの動作が原因だ。PyTorchのドキュメントでは、キャッシング アロケータがテンソル解放後もメモリを確保し続けることがあると述べている。また empty_cache() 未使用のキャッシュブロックのほとんどを他のアプリケーションに返す。PyTorch自体には戻さない。

重要なのは、5070 Ti と 5080 ユーザーはメモリリークの本当の原因(バッチサイズ、シーケンス長、アクティベーションメモリ)ではなく、根拠のない情報に気を取られることが多いということです。

これらの調整でメモリ制限を実用的にできますが、根本的な現実は変わりません。より大きなモデル、より長いコンテキスト、またはより高い同時実行が必要な場合、より多くの VRAM が必要です。

容量か速度か。5070 Ti vs 5080 で何が必要か

速度は車をどれだけ速く走らせられるか、容量は何人の乗客を乗せられるかと考えることができます。ディープラーニングは両方を気にしますが、容量があってはじめて駐車場を出られるのです。

5080 は多くのワークロードで 5070 Ti よりも高いスループットを実現できます。しかし 5070 Ti vs 5080 の比較は「モデルを読み込んで実行できるか」という問題は変えません。両者ともその限界に達するからです。

だからアップグレード後に失望する人が多いのです。小さなテストでは速度向上を感じますが、実際のワークロードを試すと同じ壁にぶつかります。その壁がやってくるのが30秒遅れるだけです。

ディープラーニングを念頭に置いて購入を検討しているなら、自分がどちらのタイプに当てはまるかを決めるのが役に立ちます。

- スピード制限すでに要件を満たしていて、ステップを高速化したいだけの場合。

- 容量制限モデルが完全には収まらず、問題を縮小するのに時間をかけている場合。

5070 Ti vs 5080 についてディープラーニングを目的に調べている人の大半は、実は気づいていなくても2番目のグループに属しています。

ここで、通常、最も時間を節約できるオプションについて説明します。「大きな作業」をより大容量の GPU にオフロードし、新しいローカルマシンを中心に生活を再構築しないようにすることです。

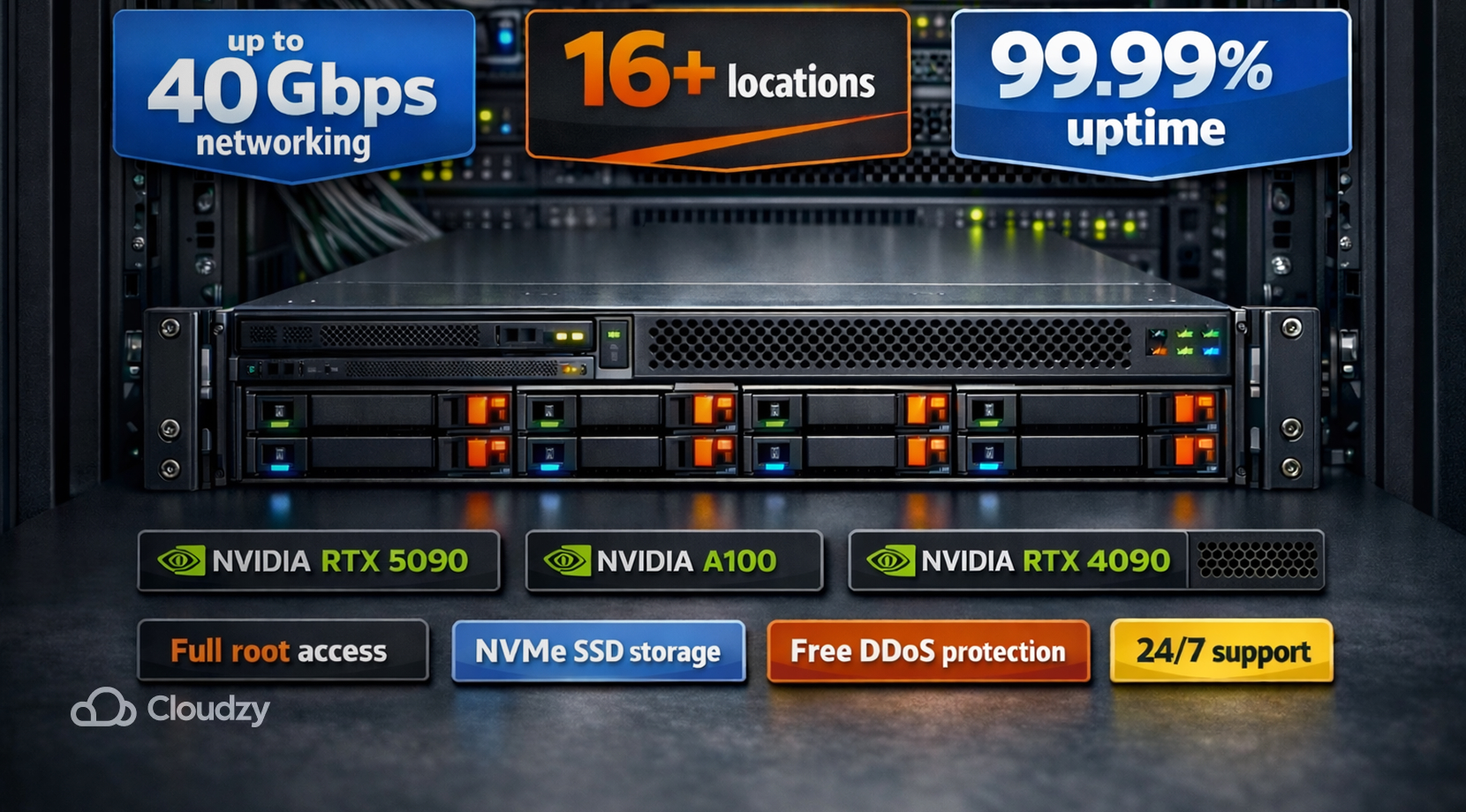

手頃な解決策:重い処理用に GPU VPS を使用する

当社のインフラチームで最もよく見られるパターンは、ユーザーがローカルでプロトタイプ作成し、5070 Ti vs 5080 が重要ではなくなるポイントに到達することです。なぜなら、作業が単純に収まらないからです。

それは、トレーニング用とリアルなサービステスト用により大容量の VRAM プールへのアクセスが必要になるときです。それはまさに以下の場所です。 Cloudzy GPU VPS ぴったり合っています。

当社の GPU VPS プランには、RTX 5090、A100、RTX 4090 などの NVIDIA オプションが含まれています。さらに、フルルートアクセス、NVMe SSD ストレージ、最大 40 Gbps ネットワーク、12 拠点、無料の DDoS 保護、24/7 サポート、99.95% アップタイム保証があります。

ただし、5070 Ti vs 5080 であれ、同じレベルの他の GPU であれ、これがどう役に立つのでしょうか。結論として。

- より多くの VRAM を備えたハードウェアで実際のモデルとプロンプトプロファイルを実行でき、独自のログから明白な決定を下すことができます。

- ローカルの GPU は開発と簡単なテストに使い、「大きなカード」は重い処理のときだけレンタルできます。

GPU VPS とは実際のところ何なのか、専有 GPU と共有アクセスの違いについて、簡単に復習したいときは、 GPU VPS について初心者ガイドで分かりやすく説明しています。

ワークロードに GPU が本当に必要かまだ確信が持てない場合は、 GPU対CPU VPS 比較することで、トレーニング、推論、データベース、ウェブアプリなど、実際のタスクにどのハードウェアが必要かが明確になります。

インフラが決まったら、最後は時間を無駄にしないワークフローを選ぶことです。

自分に必要なものを見つけるシンプルなワークフロー

多くのML開発者は、高性能なコンシューマーGPUを買うか苦労するか、という誤った選択肢に直面します。実際には、5070 Tiと5080は、本番スタック全体ではなくローカル開発ツールとして使えば、まともなワークフローの一部になります。

うまくいっているワークフローの例:

- 16 GB GPUをコード作成、デバッグ、小規模な実験に使う。

- リモート実行用に「大きなGPU」環境テンプレートを用意しておく。

- メモリが必要なトレーニングとサービング試験をGPU VPSに移す。

- 実行を監視し、ログを保存して、結果が再現可能にする。

ML作業全般に適したGPUクラスの選び方について詳しく知りたい場合は、 機械学習に最適なGPU が参考になります。

つまり、5070 Tiと5080はローカル計算の選択ですが、深層学習のスケーリングはインフラの選択です。スケーリングについて言えば、より大きなGPUクラスが実際のAI動作にどう影響するか気になる場合は、 H100 対 RTX 4090 ベンチマーク 比較表が役に立ちます。VRAMの適合性を最優先し、その後スピードという同じテーマに何度も立ち返るからです。