Machine learning และ deep learning ต้องการพลังประมวลผลสูงมาก ซึ่งมีแต่ GPU เท่านั้นที่รับไหว แต่ไม่ใช่ GPU ทุกตัวจะเหมาะกับงานนี้ บทความนี้รวบรวม GPU ที่ดีที่สุดสำหรับ machine learning พร้อมอธิบายว่าทำไมถึงจำเป็น และเลือกตัวไหนให้เหมาะกับโปรเจกต์ของคุณได้อย่างไร

ทำไมถึงต้องใช้ GPU สำหรับ Machine Learning?

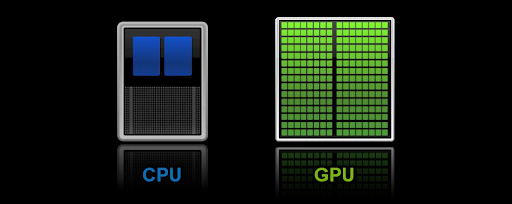

อย่างที่กล่าวไปก่อนหน้า machine learning ต้องการพลังประมวลผลสูงที่ CPU ทั่วไปรองรับไม่ไหว CPU ใช้งานได้กับแอปพลิเคชันขนาดเล็กพอได้ แต่งานที่หนักกว่า single-threaded tasks หรือ general-purpose computing จะสร้างคอขวดและทำให้ประสิทธิภาพตก สาเหตุหลักคือความสามารถในการประมวลผลแบบขนาน (parallel processing) และจำนวน cores ที่ต่างกันมาก CPU ทั่วไปมี 4 ถึง 16 cores ในขณะที่ GPU ที่ดีที่สุดสำหรับ machine learning มีได้หลายพัน cores โดยเฉพาะ tensor cores ซึ่งแต่ละตัวจัดการการคำนวณส่วนเล็ก ๆ ได้พร้อมกัน

การประมวลผลแบบขนานนี้คือกุญแจสำคัญที่ทำให้ GPU จัดการการคำนวณ matrix และ linear algebra ได้ดีกว่า CPU มาก จึงเหมาะอย่างยิ่งกับงานอย่างการเทรน machine learning model ขนาดใหญ่ อย่างไรก็ตาม การเลือก GPU ที่ดีที่สุดสำหรับ machine learning ไม่ใช่เรื่องง่าย

วิธีเลือก GPU ที่ดีที่สุดสำหรับ AI และ DL

GPU ส่วนใหญ่ในปัจจุบันรับมือกับงานทั่วไปได้ดี แต่ machine learning และ deep learning ต้องการพลังและคุณภาพในระดับที่สูงกว่านั้น คำถามคือ: อะไรที่ทำให้ GPU ตัวหนึ่งเหมาะกับ deep learning?

GPU ที่ดีสำหรับ deep learning ควรมีคุณสมบัติและฟีเจอร์ดังต่อไปนี้:

CUDA Cores, Tensor Cores และความเข้ากันได้

AMD และ NVIDIA ผลิต GPU ที่ดีที่สุดสำหรับ machine learning และ DL โดย NVIDIA ยังคงนำหน้าอยู่อย่างชัดเจน เพราะมี Tensor Cores และ CUDA Cores Tensor Cores รับมือกับการคำนวณที่พบบ่อยใน AI และ machine learning เช่น matrix multiplication และ convolution ที่ใช้ใน deep neural network ส่วน CUDA Cores ช่วยให้ GPU สามารถกระจายการประมวลผลแบบขนานได้อย่างมีประสิทธิภาพ GPU ที่ขาดทั้งสองอย่างนี้มักสะดุดกับ ML และ DL workloads

ถึงกระนั้น AMD ได้ปรับปรุง ROCm platform และ MI-series accelerators จนทำให้ GPU ของตัวเองดีขึ้นอย่างเห็นได้ชัด และมีรายชื่ออยู่ในลิสต์ของเราด้วย อย่างไรก็ตาม GPU ของ NVIDIA ยังเป็นตัวเลือกอันดับต้น ๆ สำหรับ deep learning เพราะ software ecosystem ที่ถูก optimize มาอย่างดีและรองรับ framework ได้กว้างขวาง ไม่ว่าจะเป็น PyTorch, TensorFlow หรือ JAX GPU ที่ดีที่สุดสำหรับ machine learning ควรรองรับ ML frameworks เหล่านี้ได้อย่างเต็มที่ เพราะถ้าไม่เข้ากัน จะส่งผลต่อประสิทธิภาพการเร่งความเร็ว, การรองรับ driver และ library อย่าง NVIDIA cuDNN และ TensorRT รวมถึงความยืดหยุ่นในอนาคต

นอกจากนี้ คุณอาจไม่สามารถเข้าถึงเครื่องมือต่าง ๆ ของ NVIDIA CUDA Toolkit ได้ครบ เช่น GPU-accelerated libraries, คอมไพเลอร์และ runtime สำหรับ C และ C++ รวมถึงเครื่องมือ optimization และ debugging

VRAM (Video RAM), มาตรฐานหน่วยความจำ และแบนด์วิดท์หน่วยความจำ

เช่นเดียวกับฮาร์ดแวร์คอมพิวเตอร์โดยทั่วไป RAM เป็นปัจจัยสำคัญ และเรื่องนี้ก็ใช้ได้กับ GPU สำหรับ machine learning และ DL เช่นกัน เนื่องจาก dataset สำหรับการเทรน machine learning model มีขนาดใหญ่มาก โดยเฉพาะ deep learning ที่อาจถึงหลาย TB GPU ที่ดีที่สุดจึงควรมี VRAM เพียงพอเพื่อให้เข้าถึงข้อมูลได้รวดเร็ว เพราะ deep learning model ต้องใช้หน่วยความจำสูงในการเก็บ weights, activations และข้อมูลชั่วคราวระหว่างการเทรนและ inference GPU ที่ดีที่สุดสำหรับ AI training ควรมี memory bandwidth ที่ดีพอด้วย เพื่อให้โยกย้าย dataset ขนาดใหญ่ได้คล่องและเร่งการคำนวณได้เต็มที่

มาตรฐานหน่วยความจำก็เป็นปัจจัยสำคัญเช่นกัน GPU โดยทั่วไปใช้ GDDR (Graphics Double Data Rate) หรือ HBM (High Bandwidth Memory) GDDR ให้แบนด์วิดท์สูงพอสำหรับงานอย่าง machine learning และเกม แต่ GPU ระดับสูงสำหรับ machine learning มักใช้ HBM ซึ่งให้แบนด์วิดท์สูงกว่าและมีประสิทธิภาพด้านพลังงานที่ดีกว่า

| ประเภท GPU | ความจุ VRAM | ความกว้างแบนด์วิดท์หน่วยความจำ | หน่วยความจำ Standard | เหมาะสำหรับ |

| ระดับเริ่มต้น (เช่น RTX 3060, RTX 4060) | 8GB – 12GB | ~200-300 GB/s | GDDR6 | โมเดลขนาดเล็ก, image classification, โปรเจกต์อดิเรก |

| ระดับกลาง (เช่น RTX 3090, RTX 4070 Ti) | 24GB | ~1,000 GB/s | GDDR6X | Dataset ขนาดใหญ่, deep neural network, transformers |

| GPU AI ระดับสูง (เช่น A100, H100, H200, RTX 6000 Pro MI300X) | 40GB – 80GB | ~1,600+ GB/วินาที | HBM2 | โมเดลภาษาขนาดใหญ่ (LLM), งานวิจัย AI, ML ระดับองค์กร |

| GPU ระดับสูงสุด (เช่น A100 H200, RTX 6000 Pro Instinct MI300X) | 80GB – 256GB | ~2,000+ GB/วินาที | HBM3 | การฝึก AI ขนาดใหญ่, ซูเปอร์คอมพิวติง, งานวิจัยบนชุดข้อมูลขนาดมหึมา |

สำหรับผู้ที่ทำงานเฉพาะด้าน โมเดลภาษาขนาดใหญ่ อย่าง ChatGPT, Cloudzy นำเสนอ เซิร์ฟเวอร์ที่ออกแบบมาสำหรับ ChatGPT โซลูชันที่มีพลังประมวลผลเพียงพอสำหรับการ fine-tune และ inference ได้อย่างราบรื่น

TFLOPS (Teraflops) และความแม่นยำของ Floating Point

ประสิทธิภาพของ GPU วัดได้จากพลังประมวลผล ซึ่งขึ้นอยู่กับสามปัจจัย ได้แก่ TFLOPS, Memory Bandwidth และ Floating-Point Precision เราได้พูดถึง Memory Bandwidth ไปแล้วในบทความ GPU ที่ดีที่สุดสำหรับการฝึก AI ส่วนที่เหลืออีกสองปัจจัยมีความหมายและความสำคัญดังนี้ TFLOPS หรือ Teraflops คือหน่วยที่ใช้วัดความเร็วในการคำนวณที่ซับซ้อนของ GPU แทนที่จะวัดความเร็วสัญญาณนาฬิกา (จำนวนรอบที่โปรเซสเซอร์ทำงานต่อวินาที) TFLOPS จะวัดจำนวนล้านล้าน Floating-Point Operations ที่ GPU สามารถประมวลผลได้ต่อวินาที พูดง่ายๆ คือ TFLOPS บอกให้รู้ว่า GPU นั้นทรงพลังแค่ไหนในการจัดการงานที่ต้องคำนวณหนัก

Floating-Point Precision คือระดับความแม่นยำที่ GPU ยอมให้โมเดลรักษาไว้ได้ GPU ที่ดีที่สุดสำหรับ deep learning มักใช้ precision สูง (เช่น FP32) ซึ่งให้ผลการคำนวณที่แม่นยำกว่า แต่แลกมาด้วยความเร็วที่ลดลง ส่วน precision ต่ำ (เช่น FP16) ช่วยเพิ่มความเร็วในการประมวลผลโดยยอมลดความแม่นยำเล็กน้อย ซึ่งมักเป็นที่ยอมรับได้สำหรับงาน AI และ deep learning

เริ่มต้นบล็อก

เริ่มต้นบล็อก

โฮสต์ WordPress ของคุณเองบนฮาร์ดแวร์ระดับสูง พร้อม storage แบบ NVMe และเวลาแฝงต่ำทั่วโลก เลือก distro ที่คุณถนัดได้เลย

รับ WordPress VPS| ความแม่นยำ | กรณีการใช้งาน | ตัวอย่างการใช้งาน |

| FP32 (ความแม่นยำเดี่ยว) | การฝึกโมเดล deep learning | การจดจำภาพ (ResNet, VGG) |

| TF32 (TensorFloat-32) | การฝึกแบบ mixed-precision | NLP, ระบบแนะนำสินค้า |

| FP16 (ความแม่นยำครึ่งหนึ่ง) | การอนุมานที่รวดเร็ว | รถยนต์ไร้คนขับ, การรู้จำเสียงพูด, การเพิ่มคุณภาพวิดีโอด้วย AI |

แทนที่จะลงทุนกับฮาร์ดแวร์จริงในราคาสูง คุณสามารถเข้าถึงได้ทันที Deep Learning GPU Server ของ Cloudzyที่ขับเคลื่อนด้วย AMD EPYC ออกแบบมาสำหรับ machine learning และ deep learning โดยเฉพาะ

GPU ที่ดีที่สุดสำหรับ Machine Learning ในปี 2025

เมื่อคุณเข้าใจแล้วว่า GPU ที่ดีที่สุดสำหรับ machine learning ควรมีคุณสมบัติอะไร ต่อไปนี้คือรายการ GPU ที่ดีที่สุดเรียงตาม TFLOPS, Memory Bandwidth, VRAM และอื่นๆ

| GPU | VRAM | ความกว้างแบนด์วิดท์หน่วยความจำ | หน่วยความจำ Standard | TFLOPS | ความแม่นยำจุดทศนิยม | ความเข้ากันได้ |

| NVIDIA H100 NVL | 188 GB | 7.8 TB/s | HBM3 | 3,958 | FP64, FP32, FP16 | CUDA, TensorFlow |

| NVIDIA H100 Tensor Core | 80 GB | 2 TB/s | HBM2 | 1,979 | FP64, FP32, FP16 | CUDA, ROCm, OpenCL |

| NVIDIA RTX 4090 | 24 GB | 1.008 TB/s | GDDR6X | 82.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA A100 Tensor Core | 48 GB | 768 GB/s | GDDR6 | 40 | FP64, FP32, FP16 | CUDA, ROCm, OpenCL |

| NVIDIA GeForce RTX 4070 | 12 GB | 504 GB/s | GDDR6X | 35.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX 3090 Ti | 24 GB | 1.008 TB/s | GDDR6X | 40 | FP64, FP32, FP16 | CUDA, ROCm, OpenCL |

| AMD Radeon Instinct MI300 | 128 GB | 1.6 TB/s | HBM3 | 60 | FP64, FP32, FP16 | ROCm, TensorFlow |

NVIDIA H100 NVL

GPU สำหรับ machine learning ที่ดีที่สุด อย่าง H200 NVL มอบประสิทธิภาพสูงสำหรับ deep learning ในระดับ scale เหมาะสำหรับ workload ที่มีผู้ใช้หลายรายและต้องการประสิทธิภาพสูง

- เหมาะสำหรับ: การวิจัย AI ขนาดใหญ่ การฝึกโมเดล และ inference

- ข้อเสีย: ราคาสูงมาก เหมาะสำหรับองค์กรขนาดใหญ่หรือสภาพแวดล้อมงานวิจัยเป็นหลัก

NVIDIA H100 Tensor Core GPU

A100 มอบประสิทธิภาพสูงสำหรับ neural network พร้อม HBM2 ความจุ 80 GB เหมาะกับงานหนักทุกประเภท

- เหมาะสำหรับ: โมเดล machine learning ขนาดใหญ่ งานวิจัย AI และแอปพลิเคชันบนคลาวด์

- ข้อเสีย: ราคาสูง มุ่งเป้าไปที่องค์กรขนาดใหญ่เป็นหลัก

NVIDIA RTX 4090

ทำงานได้ดีทั้งด้านเกมและงาน AI พร้อม GDDR6X ความจุ 24 GB และความสามารถ parallel computing สูง

- เหมาะสำหรับ: งาน ML ระดับสูงและงานวิจัย AI ที่ต้องการพลังประมวลผลสูงมาก

- ข้อเสีย: กินไฟมาก ราคาสูง และมีขนาดใหญ่

NVIDIA H200 Tensor Core GPU

รองรับงาน AI ด้วย GDDR6 ความจุ 48 GB เหมาะสำหรับเวิร์กสเตชันและนักสร้างสรรค์มืออาชีพ

- เหมาะสำหรับ: งานวิจัย AI, deep learning และ workload ประสิทธิภาพสูง

- ข้อเสีย: ราคาสูง เหมาะสำหรับสภาพแวดล้อมระดับมืออาชีพเป็นหลัก

NVIDIA GeForce RTX 4070

Go สมดุลระหว่างราคาและประสิทธิภาพได้ดี พร้อมความสามารถ ray-tracing ที่แข็งแกร่ง และ GDDR6X ความจุ 12 GB

- เหมาะสำหรับ: นักพัฒนาและธุรกิจขนาดเล็กที่มีความต้องการด้าน machine learning ระดับกลาง

- ข้อเสีย: VRAM จำกัดสำหรับชุดข้อมูลขนาดใหญ่และโมเดลที่มีขนาดใหญ่มาก

NVIDIA RTX 3090 Ti

NVIDIA RTX 3090 Ti มีความจุหน่วยความจำสูง (GDDR6X 24 GB) และพลังประมวลผลสูง เหมาะสำหรับการฝึกโมเดลขนาดกลางถึงใหญ่

- เหมาะสำหรับ: นักพัฒนาที่ชื่นชอบและงานวิจัยที่ต้องการพลังประมวลผล AI สูง

- ข้อเสีย: ราคาสูงมาก กินไฟมาก และอาจเกินความจำเป็นสำหรับโปรเจกต์ขนาดเล็ก

AMD Radeon Instinct MI300

ประสิทธิภาพดีสำหรับงาน AI และ HPC

- เหมาะสำหรับ: งาน machine learning บนระบบที่เน้น AMD

- ข้อเสีย: ประสบการณ์ด้าน deep learning ยังน้อยกว่า NVIDIA และรองรับ framework น้อยกว่า

Cloud GPU ของ Cloudzy

RTX 4090 ถือเป็นหนึ่งใน GPU ที่ดีที่สุดสำหรับ machine learning ในตอนนี้ แต่ราคาสูง ค่าไฟพุ่ง และขนาดที่ใหญ่อาจบังคับให้คุณต้องเปลี่ยนเคสหรือปรับชิ้นส่วนทั้งหมด ปวดหัวพอสมควร นั่นคือเหตุผลที่ Cloudzy เปิดให้บริการ GPU ออนไลน์สำหรับ machine learning เพื่อที่คุณจะได้ไม่ต้องกังวลกับปัญหาเหล่านั้น GPU VPS พร้อม GPU RTX 4090 สูงสุด 2 ตัว, พื้นที่เก็บข้อมูล NVMe SSD ขนาด 4 TB, แบนด์วิดท์ 25 TB ต่อวินาที และ 48 vCPU!

ทั้งหมดนี้ในราคาที่เข้าถึงได้ พร้อมตัวเลือกชำระเงินแบบรายชั่วโมงและรายเดือนตามการใช้งานจริง รวมถึงช่องทางชำระเงินหลากหลาย เช่น PayPal, Alipay, บัตรเครดิต (ผ่าน Stripe), PerfectMoney, Bitcoin และ Cryptocurrency อื่น ๆ

และในกรณีที่แย่ที่สุด หากคุณไม่พอใจบริการของเรา เรามีนโยบายคืนเงินภายใน 14 วัน

แพลตฟอร์ม Augmented Reality (AR) บนคลาวด์ต้องพึ่งพา GPU ประสิทธิภาพสูง ในการส่งมอบประสบการณ์แบบ real-time ที่น่าดื่มด่ำ เช่นเดียวกับที่ GPU ซึ่งมี CUDA และ Tensor cores เป็นสิ่งจำเป็นสำหรับการ train deep learning model ก็มีความสำคัญเท่ากันในการเรนเดอร์สภาพแวดล้อม AR ที่ซับซ้อน และรองรับฟีเจอร์ที่ขับเคลื่อนด้วย AI เช่น การจดจำวัตถุและการทำแผนที่เชิงพื้นที่ ที่ Cloudzy AR Cloud เราใช้เทคโนโลยี GPU ที่ทันสมัยเพื่อให้ได้ประสิทธิภาพสูง latency ต่ำ เหมาะสำหรับธุรกิจที่ต้องการ deploy แอปพลิเคชัน AR ในระดับใหญ่

ไม่ว่าคุณจะกำลังสร้างแอปพลิเคชัน AI, train model หรือทำวิจัย โซลูชัน AI VPS ออกแบบมาเพื่อให้ประสิทธิภาพ GPU สูงสุด ในราคาที่ต่ำกว่ามาตรฐานทั่วไปมาก

สรุป

ความต้องการด้านพลังการประมวลผลที่เพิ่มขึ้นและ AI model ที่ใหญ่และซับซ้อนขึ้นเรื่อย ๆ ทำให้ GPU กลายเป็นส่วนสำคัญในชีวิตของเราอย่างแน่นอน จึงควรทำความเข้าใจว่ามันคืออะไรและทำงานอย่างไร

นั่นคือเหตุผลที่ผมแนะนำให้คุณอ่าน ทิม เดทเมิร์สบทความที่รวบรวมทุกเรื่องที่ควรรู้เกี่ยวกับ GPU พร้อมคำแนะนำปฏิบัติในการเลือก GPU เขามีพื้นฐานทางวิชาการที่แน่นและมีความเชี่ยวชาญด้าน deep learning เป็นอย่างดี